ปัญญาประดิษฐ์ในการประมวลผลภาพกล้องจุลทรรศน์

ปัญญาประดิษฐ์กำลังปฏิวัติการประมวลผลภาพกล้องจุลทรรศน์ด้วยความสามารถทรงพลัง เช่น การแบ่งส่วนภาพอย่างแม่นยำ การลดสัญญาณรบกวน ความละเอียดสูง และการเก็บภาพอัตโนมัติ บทความนี้เน้นเครื่องมือ AI ที่สำคัญและแนวโน้มที่เกิดขึ้นใหม่ในการวิจัยทางวิทยาศาสตร์

เทคนิคปัญญาประดิษฐ์กำลังปฏิวัติวงการกล้องจุลทรรศน์ด้วยการ เพิ่มประสิทธิภาพการเก็บภาพ และ วิเคราะห์อัตโนมัติ ในกล้องจุลทรรศน์อัจฉริยะสมัยใหม่ โมดูล AI สามารถปรับพารามิเตอร์การถ่ายภาพแบบเรียลไทม์ (เช่น โฟกัส, การส่องสว่าง) เพื่อลดการซีดจางของแสงและเพิ่มสัญญาณ ในขณะเดียวกัน อัลกอริทึมการเรียนรู้เชิงลึกสามารถกรองข้อมูลภาพที่ซับซ้อนเพื่อดึงข้อมูลเชิงลึกทางชีวภาพที่ซ่อนอยู่และเชื่อมโยงภาพกับข้อมูลอื่น ๆ (เช่น จีโนมิกส์)

วิธีการ AI: การเรียนรู้ของเครื่องกับการเรียนรู้เชิงลึก

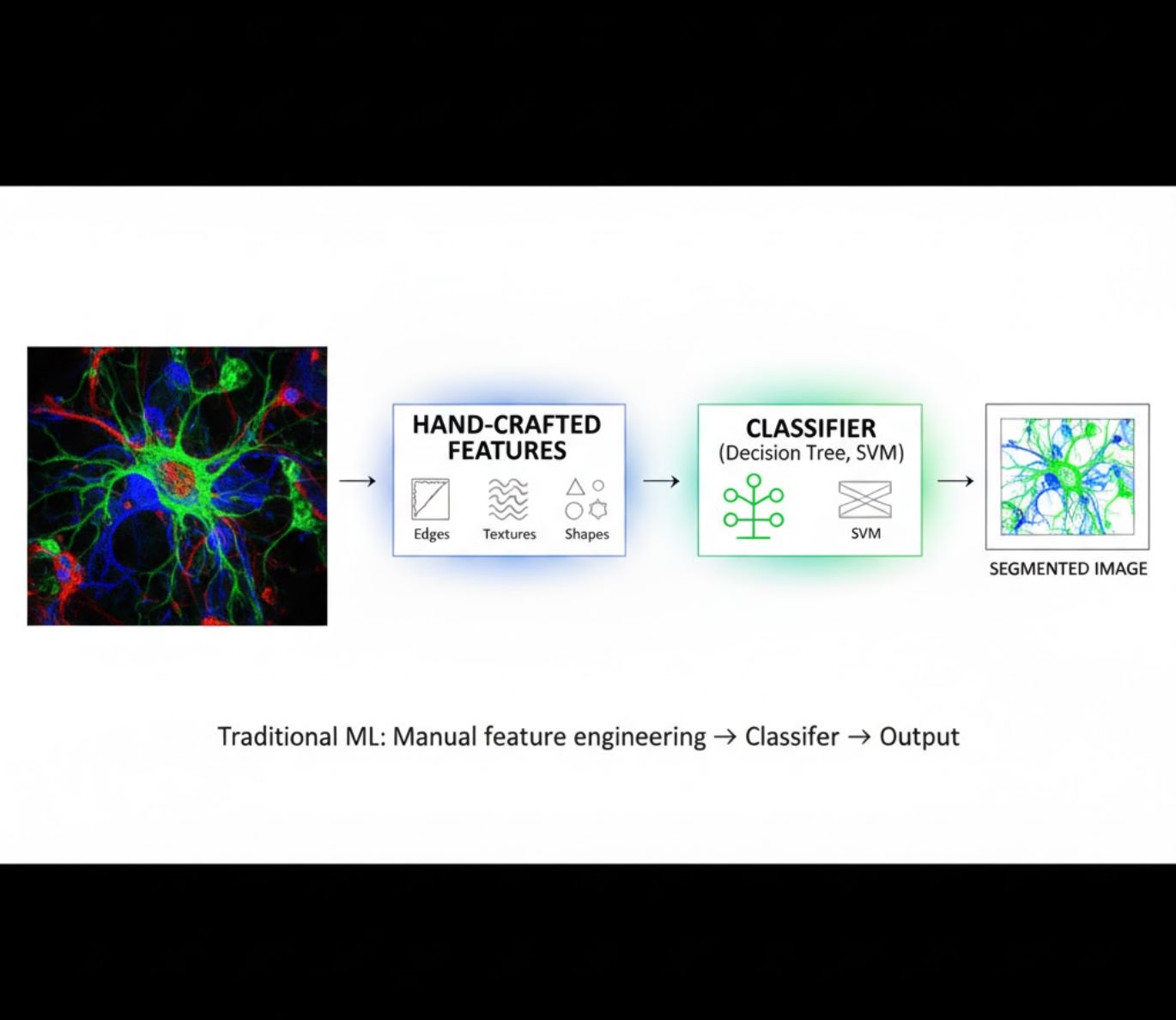

วิธีการ AI มีตั้งแต่ การเรียนรู้ของเครื่อง (ML) แบบดั้งเดิมจนถึง การเรียนรู้เชิงลึก (DL) สมัยใหม่ แต่ละวิธีมีจุดแข็งและข้อจำกัดที่แตกต่างกัน:

คุณลักษณะที่สร้างด้วยมือ

- นักวิจัยสร้างคุณลักษณะภาพด้วยมือ (ขอบ, ลวดลาย, รูปร่าง)

- ป้อนคุณลักษณะให้กับตัวจำแนก (ต้นไม้ตัดสินใจ, SVM)

- ฝึกได้เร็ว

- ทำงานยากกับภาพที่ซับซ้อนหรือมีสัญญาณรบกวน

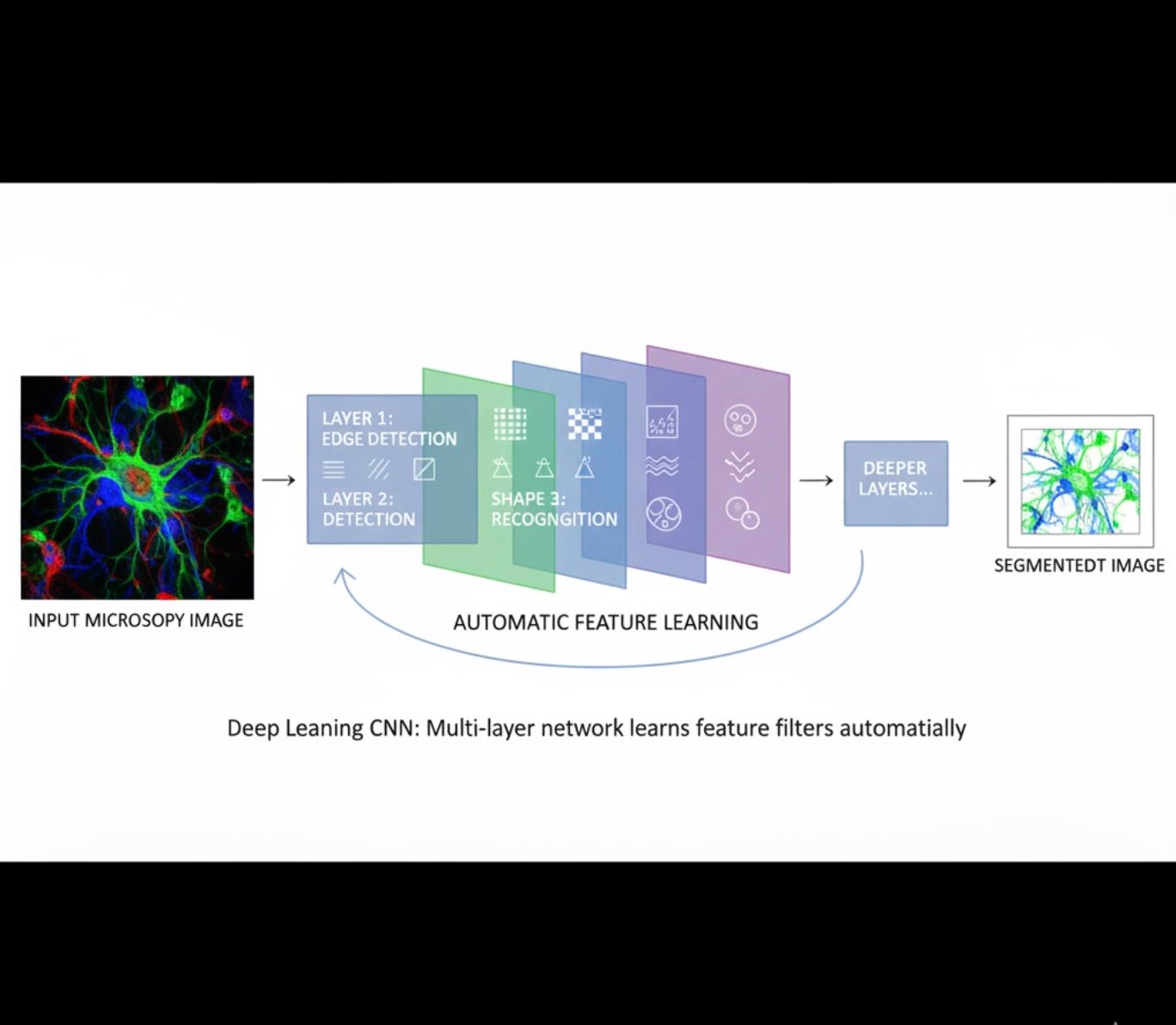

การเรียนรู้คุณลักษณะอัตโนมัติ

- โครงข่ายประสาทเทียมหลายชั้น (CNNs) เรียนรู้คุณลักษณะโดยอัตโนมัติ

- เรียนรู้แบบครบวงจรจากพิกเซลดิบ

- ทนทานต่อความแปรปรวนมากขึ้น

- จับลวดลายและโครงสร้างซับซ้อนได้อย่างน่าเชื่อถือ

การทำงานของ CNNs: โครงข่ายประสาทเทียมแบบคอนโวลูชันใช้ฟิลเตอร์ต่อเนื่องกับภาพกล้องจุลทรรศน์ เรียนรู้การตรวจจับรูปแบบง่าย ๆ (ขอบ) ในชั้นแรก และโครงสร้างซับซ้อน (รูปร่างเซลล์, ลวดลาย) ในชั้นลึก การเรียนรู้อย่างเป็นลำดับชั้นนี้ทำให้ DL มีความทนทานสูงแม้ความเข้มของภาพจะแตกต่างกันมาก

การเปรียบเทียบภาพ: กระบวนการ ML กับ DL

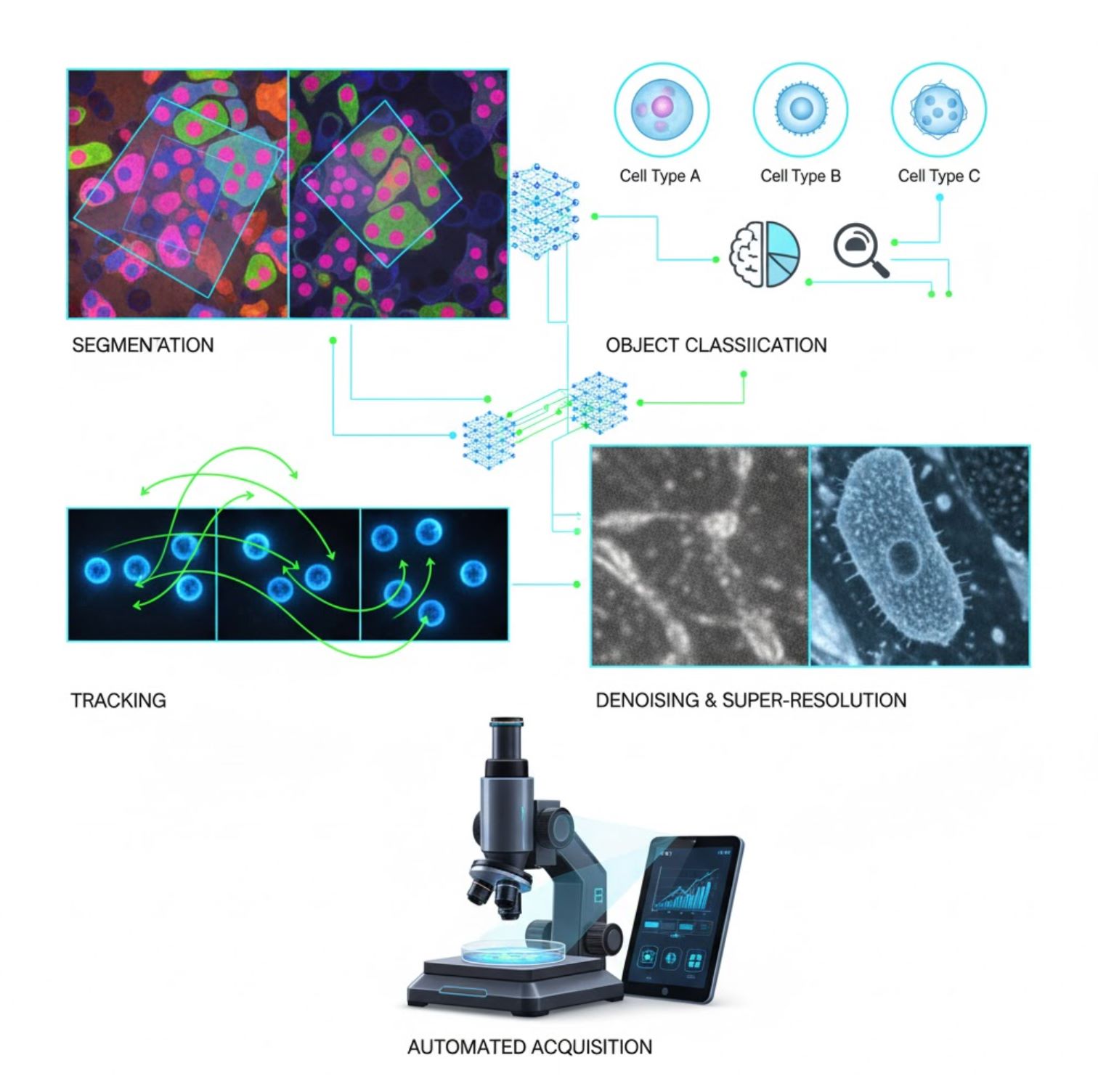

การประยุกต์ใช้ AI สำคัญในกล้องจุลทรรศน์

AI ถูกฝังอยู่ในงานประมวลผลภาพหลายขั้นตอนในกระบวนการกล้องจุลทรรศน์:

การแบ่งส่วนภาพ

แบ่งภาพออกเป็นส่วนต่าง ๆ (เช่น ระบุเซลล์หรือแกนเซลล์แต่ละอัน) โครงข่ายลึกอย่าง U-Net ทำงานนี้ได้ดีเยี่ยม

- การแบ่งส่วนเชิงความหมาย: ป้ายกำกับประเภทต่อพิกเซล

- การแบ่งส่วนเชิงวัตถุ: แยกวัตถุแต่ละชิ้น

- แม่นยำสูงในภาพที่แออัดหรือมืด

- โมเดลพื้นฐานด้านภาพ (เช่น μSAM) ปรับใช้กับกล้องจุลทรรศน์แล้ว

การจำแนกวัตถุ

หลังจากแบ่งส่วน AI จะจำแนกวัตถุแต่ละชิ้นด้วยความแม่นยำสูง

- ระบุชนิดเซลล์

- กำหนดระยะการแบ่งเซลล์

- ตรวจจับตัวบ่งชี้ทางพยาธิวิทยา

- แยกแยะลักษณะย่อยที่ยากต่อการวัดด้วยมือ

การติดตาม

ในกล้องจุลทรรศน์แบบจับภาพต่อเนื่อง AI ติดตามเซลล์หรืออนุภาคข้ามเฟรมด้วยความแม่นยำสูงสุด

- การเรียนรู้เชิงลึกช่วยเพิ่มความแม่นยำในการติดตามอย่างมาก

- ช่วยวิเคราะห์เซลล์ที่เคลื่อนไหวได้อย่างน่าเชื่อถือ

- จับกระบวนการชีวภาพที่เปลี่ยนแปลงได้

การลดสัญญาณรบกวนและความละเอียดสูง

โมเดล AI ปรับปรุงคุณภาพภาพโดยการกำจัดสัญญาณรบกวนและความเบลอ

- โมเดลเชิงฟิสิกส์เรียนรู้ระบบแสงของกล้องจุลทรรศน์

- สร้างภาพที่คมชัดและไม่มีสิ่งผิดปกติ

- ความละเอียดสูงขึ้นพร้อมลดสิ่งผิดปกติเมื่อเทียบกับวิธีดั้งเดิม

การเก็บภาพอัตโนมัติ

AI ควบคุมกล้องจุลทรรศน์แบบเรียลไทม์

- วิเคราะห์ภาพสดเพื่อการตัดสินใจอย่างชาญฉลาด

- ปรับโฟกัสและสแกนพื้นที่ที่สนใจโดยอัตโนมัติ

- ลดความเป็นพิษจากแสงและประหยัดเวลา

- รองรับการทดลองถ่ายภาพแบบความเร็วสูงและปรับตัวได้

เครื่องมือ AI ยอดนิยมในการประมวลผลภาพกล้องจุลทรรศน์

<ITEM_DESCRIPTION>ระบบนิเวศของเครื่องมือที่หลากหลายสนับสนุน AI ในการใช้กล้องจุลทรรศน์ นักวิจัยได้พัฒนาซอฟต์แวร์ทั้งแบบทั่วไปและเฉพาะด้าน ซึ่งหลายรายการเป็นโอเพนซอร์ส:</ITEM_DESCRIPTION>

Cellpose

| ผู้พัฒนา | Carsen Stringer และ Marius Pachitariu (กลุ่มวิจัย MouseLand) |

| แพลตฟอร์มที่รองรับ |

ต้องใช้ Python (ติดตั้งผ่าน pip/conda) GUI ใช้งานได้เฉพาะบนเดสก์ท็อปเท่านั้น |

| การสนับสนุนภาษา | เอกสารภาษาอังกฤษ; ใช้กันอย่างแพร่หลายในห้องปฏิบัติการวิจัยทั่วโลก |

| รูปแบบการคิดราคา | ฟรีและโอเพนซอร์ส ภายใต้สัญญาอนุญาต BSD-3-Clause |

ภาพรวม

Cellpose คือเครื่องมือแบ่งเซลล์ขั้นสูงที่ใช้การเรียนรู้เชิงลึก ออกแบบมาสำหรับภาพกล้องจุลทรรศน์ ในฐานะอัลกอริทึมทั่วไป สามารถแบ่งเซลล์ชนิดต่างๆ (นิวเคลียส, ไซโตพลาสซึม ฯลฯ) ได้อย่างแม่นยำในโหมดการถ่ายภาพที่หลากหลายโดยไม่ต้องฝึกสอนโมเดลใหม่ ด้วยความสามารถในการปรับแต่งโดยมนุษย์ในวงจร นักวิจัยสามารถปรับผลลัพธ์ ปรับโมเดลให้เข้ากับข้อมูลของตน และใช้ระบบกับงานภาพ 2 มิติและ 3 มิติได้

คุณสมบัติหลัก

ใช้งานได้ทันทีสำหรับเซลล์หลายชนิด, สีย้อม และโหมดการถ่ายภาพโดยไม่ต้องฝึกสอนเฉพาะ

รองรับสแตก 3 มิติเต็มรูปแบบโดยใช้วิธี "2.5D" ที่นำโมเดล 2D มาใช้กับข้อมูลปริมาตร

แก้ไขผลการแบ่งเซลล์ด้วยมือและฝึกสอนโมเดลใหม่บนข้อมูลเฉพาะของคุณเพื่อความแม่นยำที่ดีขึ้น

เข้าถึงผ่าน Python API, คำสั่ง CLI หรืออินเทอร์เฟซกราฟิกสำหรับเวิร์กโฟลว์ที่ยืดหยุ่น

ความสามารถในการลดเสียงรบกวน, ลบเบลอ และเพิ่มความละเอียดภาพเพื่อปรับปรุงคุณภาพก่อนแบ่งเซลล์

ดาวน์โหลดหรือเข้าถึง

พื้นฐานทางเทคนิค

Cellpose ถูกนำเสนอในงานวิจัยสำคัญโดย Stringer, Wang, Michaelos และ Pachitariu โดยฝึกสอนบนชุดข้อมูลขนาดใหญ่และหลากหลายที่มีวัตถุแบ่งเซลล์มากกว่า 70,000 ชิ้น ความหลากหลายนี้ช่วยให้โมเดลสามารถทั่วไปได้กับรูปร่าง ขนาดเซลล์ และการตั้งค่ากล้องจุลทรรศน์ต่างๆ ลดความจำเป็นในการฝึกสอนเฉพาะในหลายกรณี สำหรับข้อมูล 3 มิติ Cellpose ใช้วิธี "2.5D" ที่นำโมเดล 2D มาใช้ซ้ำโดยไม่ต้องใช้ข้อมูลฝึกสอนที่ติดป้าย 3 มิติเต็มรูปแบบ แต่ยังคงให้ผลการแบ่งเซลล์แบบปริมาตร Cellpose 2.0 เพิ่มความสามารถ ฝึกสอนโดยมนุษย์ในวงจร ช่วยให้ผู้ใช้แก้ไขผลลัพธ์ด้วยมือและฝึกสอนใหม่บนภาพของตนเพื่อประสิทธิภาพที่ดีขึ้นในชุดข้อมูลเฉพาะ

การติดตั้งและตั้งค่า

ตั้งค่าสภาพแวดล้อม Python โดยใช้ conda:

conda create -n cellpose python=3.10เปิดใช้งานสภาพแวดล้อมและติดตั้ง Cellpose:

# For GUI support

pip install cellpose[gui]

# For minimal setup (API/CLI only)

pip install cellposeเริ่มต้นใช้งาน

โหมด GUI

- เปิด GUI โดยรันคำสั่ง:

python -m cellpose - ลากและวางไฟล์ภาพ (

.tif,.pngเป็นต้น) ลงในอินเทอร์เฟซ - เลือกประเภทโมเดล (เช่น "cyto" สำหรับไซโตพลาสซึมหรือ "nuclei" สำหรับนิวเคลียส)

- ตั้งค่าขนาดเส้นผ่านศูนย์กลางเซลล์โดยประมาณหรือให้ Cellpose ปรับอัตโนมัติ

- คลิกเพื่อเริ่มแบ่งเซลล์และดูผลลัพธ์

โหมด Python API

from cellpose import models

# Load model

model = models.Cellpose(model_type='cyto')

# Segment images

masks, flows = model.eval(images, diameter=30)ปรับแต่งและฝึกสอนใหม่

- หลังจากสร้างหน้ากากแล้ว แก้ไขการแบ่งเซลล์ใน GUI โดยการรวมหรือ ลบหน้ากากด้วยมือ

- ใช้ฟังก์ชันฝึกสอนในตัวเพื่อฝึกสอนใหม่บนตัวอย่างที่แก้ไขแล้ว

- เพิ่มประสิทธิภาพโมเดลสำหรับชุดข้อมูลเฉพาะของคุณ

ประมวลผลข้อมูล 3D

- โหลดไฟล์ TIFF หลายชั้นหรือสแตกปริมาตร

- ใช้แฟล็ก

--Zstackใน GUI หรือ API เพื่อประมวลผลแบบ 3D - ปรับแต่งการไหล 3D ด้วยการทำให้เรียบหรือพารามิเตอร์เฉพาะเพื่อการแบ่งเซลล์ที่ดีขึ้น

ข้อจำกัดและข้อควรพิจารณา

- ข้อแลกเปลี่ยนของความทั่วไปของโมเดล: แม้โมเดลทั่วไปจะใช้งานได้กว้าง แต่รูปร่างเซลล์หรือสภาพการถ่ายภาพที่ผิดปกติสูงอาจต้องฝึกสอนใหม่

- ความพยายามในการติดป้าย: การฝึกสอนโดยมนุษย์ในวงจรต้องแก้ไขด้วยมือ ซึ่งอาจใช้เวลานานสำหรับชุดข้อมูลขนาดใหญ่

- ความซับซ้อนในการติดตั้ง: การติดตั้ง GUI อาจต้องใช้คำสั่งในบรรทัดคำสั่ง, สภาพแวดล้อม conda และการจัดการไลบรารี Python — ไม่ง่ายสำหรับผู้ที่ไม่ใช่นักโปรแกรมเมอร์

- ใช้งานเฉพาะเดสก์ท็อป: Cellpose ออกแบบมาเพื่อใช้งานบนเดสก์ท็อป ไม่มีแอปพลิเคชันบน Android หรือ iOS

คำถามที่พบบ่อย

ไม่จำเป็น — Cellpose มีโมเดลทั่วไปที่ผ่านการฝึกสอนล่วงหน้าซึ่งมักใช้งานได้ดีโดยไม่ต้องฝึกสอนใหม่ อย่างไรก็ตาม เพื่อผลลัพธ์ที่ดีที่สุดกับข้อมูลพิเศษหรือผิดปกติ คุณสามารถติดป้ายและฝึกสอนใหม่โดยใช้ฟีเจอร์มนุษย์ในวงจรได้

รองรับ — โดยใช้โมเดล 2D ซ้ำในรูปแบบ "2.5D" และคุณสามารถประมวลผลสแตกปริมาตรผ่าน GUI หรือ API ได้

แนะนำให้ใช้ GPU เพื่อการประมวลผลและฝึกสอนที่รวดเร็ว โดยเฉพาะกับชุดข้อมูลขนาดใหญ่หรือ 3D แต่ Cellpose สามารถทำงานบนเครื่องที่มี CPU อย่างเดียวได้แม้จะช้ากว่า

ใน GUI ให้ตั้งค่าขนาดเส้นผ่านศูนย์กลางเซลล์โดยประมาณด้วยมือ หรือให้ Cellpose ปรับอัตโนมัติ คุณสามารถปรับแต่งผลลัพธ์และฝึกสอนใหม่หากการแบ่งเซลล์ยังไม่เหมาะสม

ได้ — เวอร์ชันใหม่ (Cellpose 3) มีโมเดลฟื้นฟูภาพสำหรับลดเสียงรบกวน, ลบเบลอ และเพิ่มความละเอียดภาพเพื่อปรับปรุงคุณภาพก่อนการแบ่งเซลล์

StarDist

| ผู้พัฒนา | Uwe Schmidt, Martin Weigert, Coleman Broaddus, และ Gene Myers |

| แพลตฟอร์มที่รองรับ |

|

| การรองรับภาษา | โครงการโอเพนซอร์สพร้อมเอกสารและชุมชนส่วนใหญ่เป็นภาษาอังกฤษ |

| รูปแบบการกำหนดราคา | ฟรี และโอเพนซอร์ส ภายใต้สัญญาอนุญาต BSD-3-Clause |

ภาพรวม

StarDist เป็นเครื่องมือเรียนรู้เชิงลึกสำหรับการแบ่งส่วนอินสแตนซ์ในภาพกล้องจุลทรรศน์ โดยแทนวัตถุแต่ละชิ้น (เช่น แกนเซลล์) เป็นรูปหลายเหลี่ยมดาวเว้าใน 2 มิติ หรือรูปหลายหน้าใน 3 มิติ ช่วยให้ตรวจจับและแยกวัตถุที่แน่นหรือทับซ้อนได้อย่างแม่นยำ ด้วยสถาปัตยกรรมที่แข็งแกร่ง StarDist จึงถูกใช้อย่างแพร่หลายสำหรับการแบ่งส่วนเซลล์และแกนอัตโนมัติในกล้องจุลทรรศน์เรืองแสง, พยาธิวิทยา และการวิเคราะห์ภาพชีวภาพอื่นๆ

คุณสมบัติหลัก

การแบ่งส่วนอินสแตนซ์ที่แม่นยำสูงโดยใช้รูปหลายเหลี่ยมดาวเว้า (2 มิติ) และรูปหลายหน้า (3 มิติ) เพื่อการตรวจจับวัตถุที่เชื่อถือได้

โมเดลเฉพาะสำหรับภาพ 2 มิติและข้อมูลปริมาตร 3 มิติ เพื่อการวิเคราะห์กล้องจุลทรรศน์อย่างครบถ้วน

โมเดลพร้อมใช้งานสำหรับแกนเรืองแสง, พยาธิวิทยา H&E และสถานการณ์การถ่ายภาพทั่วไปอื่นๆ

จำแนกวัตถุที่ตรวจพบเป็นคลาสต่างๆ (เช่น ชนิดเซลล์ต่างกัน) ในการแบ่งส่วนครั้งเดียว

รวมเข้ากับ ImageJ/Fiji, QuPath และ napari อย่างราบรื่นสำหรับเวิร์กโฟลว์ที่ใช้ GUI

การประเมินการแบ่งส่วนอินสแตนซ์อย่างครบถ้วน รวมถึงความแม่นยำ, การเรียกคืน, คะแนน F1 และคุณภาพแบบพาโนปติก

พื้นฐานทางเทคนิค

นำเสนอครั้งแรกในบทความ MICCAI 2018 นวัตกรรมหลักของ StarDist คือการทำนายระยะทางตามรัศมีบนรังสีที่กำหนดร่วมกับความน่าจะเป็นของวัตถุในแต่ละพิกเซล ช่วยให้สร้างรูปร่างดาวเว้าได้อย่างแม่นยำ วิธีนี้แบ่งส่วนวัตถุที่สัมผัสกันอย่างใกล้ชิดซึ่งแยกยากด้วยวิธีแบบพิกเซลหรือกล่องล้อมแบบเดิมได้อย่างน่าเชื่อถือ

พัฒนาการล่าสุดได้ขยาย StarDist ไปสู่ภาพพยาธิวิทยา ไม่เพียงแต่แบ่งส่วนแกนเท่านั้น แต่ยังรวมถึงการจำแนกหลายคลาสของวัตถุที่ตรวจพบด้วย วิธีนี้ทำผลงานได้ดีเยี่ยมในความท้าทายต่างๆ เช่น การแข่งขัน CoNIC (Colon Nuclei Identification and Counting)

ดาวน์โหลดหรือเข้าถึง

การติดตั้งและตั้งค่า

ติดตั้ง TensorFlow (เวอร์ชัน 1.x หรือ 2.x) เป็นข้อกำหนดเบื้องต้นสำหรับ StarDist

ใช้ pip เพื่อติดตั้งแพ็กเกจ StarDist สำหรับ Python:

pip install stardistสำหรับ napari:

pip install stardist-napariสำหรับ QuPath: ติดตั้งส่วนขยาย StarDist โดยลากไฟล์ .jar เข้าไปใน QuPath

สำหรับ ImageJ/Fiji: ใช้ตัวจัดการปลั๊กอินในตัวหรือการติดตั้งด้วยตนเองผ่านเมนูปลั๊กอิน

การรันการแบ่งส่วน

โหลดโมเดลที่ฝึกไว้ล่วงหน้า ปรับภาพของคุณให้เป็นมาตรฐาน และรันการทำนาย:

from stardist.models import StarDist2D

model = StarDist2D.from_pretrained('2D_versatile_fluo')

labels, details = model.predict_instances(image)เปิดภาพของคุณใน napari เลือกปลั๊กอิน StarDist เลือกโมเดลที่ฝึกไว้ล่วงหน้าหรือโมเดลที่กำหนดเอง และรันการทำนายได้โดยตรงจาก GUI

ใช้ปลั๊กอิน StarDist จากเมนูปลั๊กอินเพื่อใช้โมเดลกับชุดภาพของคุณผ่านอินเทอร์เฟซที่ใช้งานง่าย

หลังติดตั้งส่วนขยายแล้ว รันการตรวจจับ StarDist ผ่านคอนโซลสคริปต์หรืออินเทอร์เฟซกราฟิกของ QuPath สำหรับการวิเคราะห์พยาธิวิทยา

การฝึกและปรับแต่ง

สร้างภาพป้ายกำกับข้อมูลจริงที่วัตถุแต่ละชิ้นมีป้ายกำกับเฉพาะ ใช้เครื่องมือระบุเช่น LabKit, QuPath หรือ Fiji เพื่อเตรียมชุดข้อมูลของคุณ

ใช้ Python API ของ StarDist เพื่อฝึกโมเดลใหม่หรือปรับแต่งโมเดลที่มีอยู่ด้วยข้อมูลที่คุณระบุเอง

ตัวเลือกหลังการประมวลผล

- ใช้การกดทับสูงสุดแบบไม่ซ้ำ (NMS) เพื่อลบรูปร่างที่ซ้ำซ้อน

- ใช้ StarDist OPP (Object Post-Processing) เพื่อรวมมาสก์สำหรับรูปร่างที่ไม่ใช่ดาวเว้า

ข้อจำกัดและข้อควรพิจารณา

- สมมติฐานดาวเว้าอาจไม่เหมาะกับรูปร่างที่ไม่เว้ามากหรือไม่สม่ำเสมออย่างมาก

- ความซับซ้อนในการติดตั้ง: การติดตั้งแบบกำหนดเองต้องใช้คอมไพเลอร์ C++ ที่เข้ากันได้สำหรับการสร้างส่วนขยาย

- การเร่งด้วย GPU ขึ้นอยู่กับเวอร์ชัน TensorFlow, CUDA และ cuDNN ที่เข้ากันได้

- ผู้ใช้บางรายรายงานปัญหาในการรันปลั๊กอิน ImageJ เนื่องจากการตั้งค่า Java

คำถามที่พบบ่อย

StarDist ทำงานได้กับภาพหลายประเภท รวมถึงภาพเรืองแสง, ภาพสว่าง และพยาธิวิทยา (เช่น H&E) เนื่องจากมีโมเดลฝึกไว้ล่วงหน้าที่ยืดหยุ่นและปรับใช้กับโหมดการถ่ายภาพต่างๆ ได้

ได้ — StarDist รองรับการแบ่งส่วนอินสแตนซ์ 3 มิติ โดยใช้รูปหลายหน้าดาวเว้าสำหรับข้อมูลปริมาตร ขยายความสามารถจาก 2 มิติไปสู่การวิเคราะห์ 3 มิติเต็มรูปแบบ

ไม่จำเป็นเสมอไป โมเดลฝึกไว้ล่วงหน้ามีให้ใช้งานและมักทำงานได้ดีทันที อย่างไรก็ตาม สำหรับข้อมูลเฉพาะหรือใหม่ การระบุและฝึกโมเดลเองจะช่วยเพิ่มความแม่นยำอย่างมาก

StarDist รวมเข้ากับ napari, ImageJ/Fiji และ QuPath ช่วยให้คุณรันการแบ่งส่วนผ่าน GUI โดยไม่ต้องเขียนโค้ด นอกจากนี้ยังรองรับการใช้งานผ่าน Python API โดยตรงสำหรับเวิร์กโฟลว์ขั้นสูง

StarDist มีฟังก์ชันในตัวสำหรับคำนวณเมตริกการแบ่งส่วนอินสแตนซ์ทั่วไป เช่น ความแม่นยำ, การเรียกคืน, คะแนน F1 และคุณภาพแบบพาโนปติก เพื่อประเมินประสิทธิภาพการแบ่งส่วน

SAM

ข้อมูลแอปพลิเคชัน

| ผู้พัฒนา | Meta AI Research (FAIR) |

| อุปกรณ์ที่รองรับ |

|

| ภาษาและการเข้าถึง | โมเดลพื้นฐานโอเพนซอร์สที่พร้อมใช้งานทั่วโลก; เอกสารเป็นภาษาอังกฤษ |

| ราคา | ฟรี — โอเพนซอร์สภายใต้ใบอนุญาตของ Meta ผ่าน GitHub และการผสานรวมกับ MIB |

ภาพรวมทั่วไป

SAM (Segment Anything Model) คือโมเดลพื้นฐาน AI ที่ทรงพลังสร้างโดย Meta ซึ่งช่วยให้สามารถแบ่งส่วนวัตถุใด ๆ ในภาพได้ทั้งแบบโต้ตอบและอัตโนมัติ โดยใช้คำสั่งเช่น จุด กล่องล้อมรอบ หรือหน้ากากหยาบ SAM สร้างหน้ากากแบ่งส่วนโดยไม่ต้องฝึกซ้ำเฉพาะงาน ในงานวิจัยจุลทรรศน์ ความยืดหยุ่นของ SAM ได้รับการปรับใช้สำหรับการแบ่งส่วนเซลล์ การตรวจจับออร์แกเนลล์ และการวิเคราะห์ทางพยาธิวิทยา ให้โซลูชันที่ขยายได้สำหรับนักวิจัยที่ต้องการเครื่องมือแบ่งส่วนทั่วไปที่สามารถใช้คำสั่งได้

บทนำโดยละเอียด

เดิมทีได้รับการฝึกอบรมโดย Meta บนหน้ากากมากกว่า 1 พันล้านหน้ากาก จากภาพกว่า 11 ล้านภาพ SAM ถูกออกแบบเป็นโมเดลพื้นฐานที่ใช้คำสั่งสำหรับการแบ่งส่วนด้วยประสิทธิภาพ "zero-shot" บนโดเมนใหม่ ในงานวิจัยภาพทางการแพทย์ SAM ได้รับการประเมินสำหรับการแบ่งส่วนพยาธิวิทยาแบบสไลด์เต็ม การตรวจจับเนื้องอก และการระบุเซลล์นิวเคลียส อย่างไรก็ตาม ประสิทธิภาพในกรณีที่มีตัวอย่างหนาแน่น เช่น เซลล์นิวเคลียส มีความผันผวน: แม้จะมีคำสั่งจำนวนมาก (เช่น 20 คลิกหรือกล่อง) การแบ่งส่วนแบบ zero-shot ก็อาจมีปัญหาในภาพจุลทรรศน์ที่ซับซ้อน

เพื่อแก้ไขข้อจำกัดนี้ มีการปรับใช้เฉพาะโดเมนดังนี้:

- SAMCell — ปรับแต่งบนชุดข้อมูลจุลทรรศน์ขนาดใหญ่เพื่อการแบ่งส่วน zero-shot ที่แข็งแกร่งในเซลล์หลายประเภทโดยไม่ต้องฝึกซ้ำในแต่ละการทดลอง

- μSAM — ฝึกซ้ำบนภาพจุลทรรศน์ที่มีการทำเครื่องหมายด้วยมือกว่า 17,000 ภาพเพื่อเพิ่มความแม่นยำในโครงสร้างเซลล์ขนาดเล็ก

คุณสมบัติหลัก

การโต้ตอบที่ยืดหยุ่นโดยใช้จุด กล่อง และหน้ากากเพื่อการควบคุมที่แม่นยำ

ทำการแบ่งส่วนโดยไม่ต้องปรับแต่งกับโดเมนภาพใหม่

ปรับใช้ได้สำหรับจุลทรรศน์และพยาธิวิทยาผ่านการฝึกซ้ำแบบ few-shot หรือใช้คำสั่ง

มีใน Microscopy Image Browser (MIB) พร้อมรองรับการแบ่งส่วน 3 มิติและการแทรกแซง

IDCC-SAM ช่วยให้นับเซลล์อัตโนมัติในภูมิคุ้มกันเซลล์วิทยาโดยไม่ต้องทำเครื่องหมายด้วยมือ

ดาวน์โหลดหรือเข้าถึง

คู่มือผู้ใช้

- เปิด Microscopy Image Browser และไปที่แผงแบ่งส่วน SAM

- ตั้งค่าตัวแปลภาษา Python และเลือกโมเดลระหว่าง SAM-1 หรือ SAM-2

- สำหรับเร่งความเร็วด้วย GPU ให้เลือก "cuda" ในสภาพแวดล้อมการทำงาน (แนะนำเพื่อประสิทธิภาพสูงสุด)

- คำสั่งจุด: คลิกบนวัตถุเพื่อกำหนดเมล็ดบวก; ใช้ Shift + คลิก เพื่อขยาย และ Ctrl + คลิก สำหรับเมล็ดลบ

- สแต็ก 3 มิติ: ใช้โหมดโต้ตอบ 3 มิติ — คลิกที่สไลซ์หนึ่ง เลื่อนด้วย shift และแทรกเมล็ดข้ามสไลซ์

- โหมดปรับแต่ง: แทนที่ เพิ่ม ลบหน้ากาก หรือสร้างเลเยอร์ใหม่ตามต้องการ

- ใช้ตัวเลือก "Automatic everything" ของ MIB ในแผง SAM-2 เพื่อแบ่งส่วนวัตถุทั้งหมดในพื้นที่ที่มองเห็น

- ตรวจสอบและปรับปรุงหน้ากากหลังการแบ่งส่วนตามต้องการ

- ใช้กระบวนการปรับแต่งด้วยคำสั่ง (เช่น "All-in-SAM") เพื่อสร้างการทำเครื่องหมายระดับพิกเซลจากคำสั่งผู้ใช้ที่กระจัดกระจาย

- สำหรับการนับเซลล์ ใช้ IDCC-SAM ซึ่งใช้ SAM ในกระบวนการ zero-shot พร้อมการประมวลผลหลัง

- สำหรับการแบ่งส่วนเซลล์ที่แม่นยำสูง ใช้ SAMCell ซึ่งปรับแต่งบนภาพเซลล์จุลทรรศน์

ข้อจำกัดและข้อควรพิจารณา

- ประสิทธิภาพ zero-shot ไม่สม่ำเสมอบนโครงสร้างหนาแน่นหรือซ้อนทับกันหากไม่มีการปรับแต่งโดเมน

- คุณภาพการแบ่งส่วนขึ้นอยู่กับการออกแบบและกลยุทธ์คำสั่งอย่างมาก

- แนะนำให้ใช้ GPU อย่างยิ่ง; การประมวลผลด้วย CPU ช้ามาก

- มีปัญหากับภาพสไลด์ความละเอียดสูงมากและโครงสร้างเนื้อเยื่อหลายระดับ

- การปรับแต่งหรือปรับใช้ SAM สำหรับจุลทรรศน์อาจต้องมีความชำนาญด้านการเรียนรู้ของเครื่อง

คำถามที่พบบ่อย

ได้ — ผ่านการปรับใช้เช่น SAMCell ซึ่งปรับแต่ง SAM บนชุดข้อมูลจุลทรรศน์โดยเฉพาะสำหรับงานแบ่งส่วนเซลล์

ไม่เสมอไป ด้วย IDCC-SAM คุณสามารถนับเซลล์แบบ zero-shot ได้โดยไม่ต้องทำเครื่องหมายด้วยมือ

ใช้การปรับแต่งด้วยคำสั่ง (เช่น "All-in-SAM") หรือเวอร์ชันจุลทรรศน์ที่ฝึกล่วงหน้า เช่น μSAM ซึ่งฝึกบนภาพจุลทรรศน์ที่มีการทำเครื่องหมายมากกว่า 17,000 ภาพ

แม้จะสามารถใช้ CPU ได้ แต่ แนะนำอย่างยิ่งให้ใช้ GPU เพื่อความเร็วในการประมวลผลและการแบ่งส่วนแบบโต้ตอบแบบเรียลไทม์

ได้ — การผสานรวม SAM-2 ใน MIB รองรับการแบ่งส่วน 3 มิติพร้อมการแทรกเมล็ดข้ามสไลซ์สำหรับการวิเคราะห์ปริมาตร

AxonDeepSeg

| ผู้พัฒนา | ห้องปฏิบัติการ NeuroPoly ที่ Polytechnique Montréal และ Université de Montréal |

| แพลตฟอร์มที่รองรับ |

|

| ภาษา | เอกสารภาษาอังกฤษ; เครื่องมือโอเพนซอร์สที่ใช้ทั่วโลก |

| ราคา | ฟรี และโอเพนซอร์ส |

ภาพรวม

AxonDeepSeg คือเครื่องมือที่ขับเคลื่อนด้วย AI สำหรับการแบ่งส่วนแอกซอนและไมอีลินในภาพกล้องจุลทรรศน์โดยอัตโนมัติ โดยใช้เครือข่ายประสาทเทียมแบบคอนโวลูชันเพื่อให้การแบ่งส่วนสามประเภทที่แม่นยำ (แอกซอน, ไมอีลิน, พื้นหลัง) ในหลายรูปแบบของการถ่ายภาพ เช่น TEM, SEM และกล้องจุลทรรศน์แบบ bright-field ด้วยการทำงานอัตโนมัติในการวัดรูปร่างเชิงปริมาณ เช่น เส้นผ่านศูนย์กลางแอกซอน, g-ratio และความหนาของไมอีลิน AxonDeepSeg ช่วยให้การวิเคราะห์เชิงปริมาณในงานวิจัยประสาทวิทยามีประสิทธิภาพมากขึ้น ลดเวลาการทำเครื่องหมายด้วยมือและเพิ่มความสม่ำเสมอของผลลัพธ์

คุณสมบัติหลัก

โมเดลพร้อมใช้งานที่ปรับแต่งสำหรับการถ่ายภาพด้วย TEM, SEM และ bright-field

การจำแนกพื้นที่แอกซอน, ไมอีลิน และพื้นหลังในภาพกล้องจุลทรรศน์อย่างแม่นยำ

คำนวณเส้นผ่านศูนย์กลางแอกซอน, g-ratio, ความหนาของไมอีลิน และความหนาแน่นโดยอัตโนมัติ

การรวมกับ Napari GUI ช่วยให้ปรับแต่งหน้ากากการแบ่งส่วนด้วยตนเองเพื่อความแม่นยำที่สูงขึ้น

ผสานรวมอย่างราบรื่นในกระบวนการวิเคราะห์เนื้อเยื่อประสาทขนาดใหญ่ที่กำหนดเอง

สคริปต์ทดสอบครบถ้วนเพื่อรับประกันความสม่ำเสมอและผลลัพธ์การแบ่งส่วนที่เชื่อถือได้

รายละเอียดทางเทคนิค

พัฒนาโดยห้องปฏิบัติการ NeuroPoly, AxonDeepSeg ใช้การเรียนรู้เชิงลึกเพื่อให้การแบ่งส่วนที่มีความแม่นยำสูงสำหรับงานประสาทวิทยาศาสตร์ โมเดลที่ผ่านการฝึกฝนล่วงหน้ามีให้สำหรับหลายรูปแบบของกล้องจุลทรรศน์ เพื่อความหลากหลายในการใช้งาน เครื่องมือนี้รวมกับ Napari ซึ่งช่วยให้สามารถแก้ไขหน้ากากการแบ่งส่วนแบบโต้ตอบ เพิ่มความแม่นยำในชุดข้อมูลที่ท้าทาย AxonDeepSeg คำนวณเมตริกเชิงรูปร่างสำคัญ สนับสนุนการศึกษาขนาดใหญ่เกี่ยวกับโครงสร้างและพยาธิสภาพของเนื้อเยื่อประสาท กรอบงานบน Python ช่วยให้ผสานรวมในกระบวนการวิเคราะห์ขนาดใหญ่ของรูปร่างแอกซอนและไมอีลินได้อย่างง่ายดาย

ดาวน์โหลดหรือเข้าถึง

การติดตั้งและตั้งค่า

ตรวจสอบให้แน่ใจว่าติดตั้ง Python 3.8 หรือเวอร์ชันใหม่กว่าแล้ว จากนั้นติดตั้ง AxonDeepSeg และ Napari ด้วยคำสั่ง pip:

pip install axondeepseg napariรันสคริปต์ทดสอบที่ให้มาเพื่อยืนยันว่าทุกส่วนติดตั้งและทำงานได้อย่างถูกต้อง

นำเข้าภาพกล้องจุลทรรศน์ (TEM, SEM หรือ bright-field) เข้าใน Napari หรือสภาพแวดล้อม Python ของคุณ

เลือกโมเดลที่ผ่านการฝึกฝนล่วงหน้าที่เหมาะสมกับรูปแบบภาพของคุณและรันการแบ่งส่วนเพื่อสร้างหน้ากากแอกซอนและไมอีลิน

คำนวณการวัดรูปร่างเชิงปริมาณโดยอัตโนมัติ เช่น เส้นผ่านศูนย์กลางแอกซอน, g-ratio, ความหนาแน่น และความหนาของไมอีลิน จากนั้นส่งออกผลลัพธ์ในรูปแบบ CSV

ใช้ Napari GUI เพื่อปรับแต่งหน้ากากการแบ่งส่วนด้วยตนเองในส่วนที่จำเป็น โดยรวมหรือยกเลิกหน้ากากเพื่อเพิ่มความแม่นยำ

ข้อควรพิจารณาที่สำคัญ

- ประสิทธิภาพอาจลดลงกับรูปแบบภาพใหม่หรือที่ไม่เคยฝึก

- อาจต้องแก้ไขด้วยตนเองในบริเวณที่ซับซ้อนหรือท้าทาย

- แนะนำให้ใช้ GPU เพื่อการประมวลผลที่รวดเร็วของชุดข้อมูลขนาดใหญ่; รองรับการประมวลผลด้วย CPU สำหรับงานขนาดเล็ก

คำถามที่พบบ่อย

AxonDeepSeg รองรับ TEM (Transmission Electron Microscopy), SEM (Scanning Electron Microscopy) และกล้องจุลทรรศน์แบบ bright-field โดยมีโมเดลที่ผ่านการฝึกฝนล่วงหน้าสำหรับแต่ละรูปแบบ

ใช่ AxonDeepSeg เป็นโอเพนซอร์สและใช้งานได้ฟรีสำหรับทั้งงานวิชาการและเชิงพาณิชย์

ได้ AxonDeepSeg คำนวณเส้นผ่านศูนย์กลางแอกซอน, g-ratio, ความหนาของไมอีลิน และความหนาแน่นโดยอัตโนมัติจากภาพที่แบ่งส่วนแล้ว

แนะนำให้ใช้ GPU เพื่อการแบ่งส่วนที่รวดเร็วสำหรับชุดข้อมูลขนาดใหญ่ แต่ก็รองรับการประมวลผลด้วย CPU สำหรับงานวิเคราะห์ขนาดเล็ก

ได้ การรวมกับ Napari GUI ช่วยให้สามารถแก้ไขและปรับแต่งหน้ากากการแบ่งส่วนแบบโต้ตอบเพื่อความแม่นยำสูงขึ้นในบริเวณที่ท้าทาย

Ilastik

| ผู้พัฒนา | ทีม Ilastik ที่ห้องปฏิบัติการชีววิทยาโมเลกุลยุโรป (EMBL) และพันธมิตรทางวิชาการที่เกี่ยวข้อง |

| แพลตฟอร์มที่รองรับ |

|

| ภาษา | อังกฤษ |

| ราคา | ฟรี และโอเพนซอร์ส |

ภาพรวม

Ilastik คือเครื่องมือทรงพลังที่ขับเคลื่อนด้วย AI สำหรับการแบ่งส่วนภาพ การจำแนก และการวิเคราะห์ข้อมูลกล้องจุลทรรศน์แบบโต้ตอบ โดยใช้เทคนิคการเรียนรู้ของเครื่อง เช่น ตัวจำแนก Random Forest ช่วยให้นักวิจัยสามารถแบ่งส่วนพิกเซล จำแนกวัตถุ ติดตามเซลล์ตามเวลา และทำการนับความหนาแน่นในชุดข้อมูล 2D และ 3D ด้วยอินเทอร์เฟซที่ใช้งานง่ายและผลตอบรับแบบเรียลไทม์ Ilastik จึงเข้าถึงได้สำหรับนักวิทยาศาสตร์ที่ไม่มีความเชี่ยวชาญด้านการเขียนโปรแกรม และได้รับการยอมรับอย่างกว้างขวางในสาขาชีววิทยาเซลล์ ประสาทวิทยา และการถ่ายภาพทางการแพทย์

คุณสมบัติหลัก

ผลตอบรับแบบเรียลไทม์ขณะที่คุณระบุพื้นที่ตัวอย่างเพื่อให้ได้ผลลัพธ์การแบ่งส่วนทันที

จัดประเภทโครงสร้างที่แบ่งส่วนตามลักษณะรูปร่างและความเข้มของภาพ

ติดตามการเคลื่อนไหวและการแบ่งเซลล์ในข้อมูลกล้องจุลทรรศน์ไทม์แลปส์ 2D และ 3D

วัดปริมาณในพื้นที่แออัดโดยไม่ต้องแบ่งส่วนวัตถุแต่ละชิ้นอย่างชัดเจน

การแบ่งส่วนกึ่งอัตโนมัติสำหรับปริมาตร 3D ที่ซับซ้อนด้วยการโต้ตอบที่เข้าใจง่าย

ประมวลผลภาพหลายภาพโดยอัตโนมัติด้วยโหมดคำสั่งแบบไม่มีอินเทอร์เฟซ

ดาวน์โหลด

คู่มือเริ่มต้นใช้งาน

ดาวน์โหลด Ilastik สำหรับระบบปฏิบัติการของคุณจากเว็บไซต์ทางการ แพ็กเกจนี้รวมไลบรารี Python ที่จำเป็นทั้งหมดไว้แล้ว ดังนั้นโปรดปฏิบัติตามคำแนะนำการติดตั้งสำหรับแพลตฟอร์มของคุณ

เปิด Ilastik และเลือกเวิร์กโฟลว์การวิเคราะห์ของคุณ: การจำแนกพิกเซล การจำแนกวัตถุ การติดตาม หรือการนับความหนาแน่น โหลดชุดข้อมูลภาพของคุณซึ่งอาจรวมถึงภาพหลายช่องสัญญาณ 3D หรือไทม์แลปส์

ทำการระบุพิกเซลหรือวัตถุตัวอย่างในภาพของคุณ ตัวจำแนก Random Forest ของ Ilastik จะเรียนรู้จากการระบุเหล่านี้และทำนายป้ายกำกับโดยอัตโนมัติทั่วทั้งชุดข้อมูลของคุณ

ใช้โมเดลที่ฝึกสอนแล้วเพื่อแบ่งส่วนหรือจำแนกชุดข้อมูลทั้งหมด ส่งออกผลลัพธ์เป็นภาพที่มีป้ายกำกับ แผนที่ความน่าจะเป็น หรือ ตารางเชิงปริมาณสำหรับการวิเคราะห์และการแสดงผลต่อไป

ใช้โหมดไม่มีอินเทอร์เฟซของ Ilastik เพื่อประมวลผลภาพหลายภาพโดยอัตโนมัติ เหมาะสำหรับสายงานวิเคราะห์ขนาดใหญ่

ข้อจำกัดและข้อควรพิจารณา

- การระบุแบบโต้ตอบ อาจใช้เวลานานสำหรับชุดข้อมูลขนาดใหญ่มาก

- ความแม่นยำขึ้นอยู่กับ คุณภาพและความเป็นตัวแทนของการระบุโดยผู้ใช้

- ความต้องการหน่วยความจำ — ชุดข้อมูลความละเอียดสูงหรือขนาดหลายกิกะไบต์อาจต้องการ RAM จำนวนมาก

- ข้อมูลซับซ้อน — ตัวจำแนก Random Forest อาจทำงานด้อยกว่าระบบเครือข่ายประสาทลึกในข้อมูลภาพที่มีความแปรปรวนสูงหรือซับซ้อน

คำถามที่พบบ่อย

ใช่ Ilastik รองรับปริมาตร 3D และการทดลองไทม์แลปส์สำหรับการแบ่งส่วน การติดตาม และการวิเคราะห์เชิงปริมาณในหลายช่วงเวลาอย่างเต็มที่

ใช่ Ilastik เป็นซอฟต์แวร์ฟรีและโอเพนซอร์สอย่างสมบูรณ์ พร้อมให้ใช้งานสำหรับผู้ใช้ทุกคนโดยไม่มีข้อจำกัดด้านใบอนุญาต

ไม่ Ilastik มีอินเทอร์เฟซกราฟิกที่ใช้งานง่ายพร้อมผลตอบรับแบบเรียลไทม์ ทำให้นักวิจัยที่ไม่มีความเชี่ยวชาญด้านการเขียนโปรแกรมสามารถใช้งานได้ ผู้ใช้ขั้นสูงยังสามารถใช้การประมวลผลแบบชุดผ่านคำสั่งได้

ใช่ เวิร์กโฟลว์การติดตามเฉพาะช่วยให้วิเคราะห์การเคลื่อนไหวและการแบ่งเซลล์ในชุดข้อมูลไทม์แลปส์ 2D และ 3D พร้อมการติดตามสายพันธุ์อัตโนมัติ

ผลลัพธ์การแบ่งส่วนสามารถส่งออกเป็นภาพที่มีป้ายกำกับ แผนที่ความน่าจะเป็น หรือ ตารางเชิงปริมาณ ทำให้สามารถผสานรวมกับเครื่องมือวิเคราะห์และซอฟต์แวร์แสดงผลต่อไปได้อย่างราบรื่น

เครื่องมือเหล่านี้ครอบคลุมตั้งแต่ระดับผู้เริ่มต้นจนถึงผู้เชี่ยวชาญ หลายตัวเป็นซอฟต์แวร์ฟรีและโอเพนซอร์ส ช่วยให้กระบวนการทำงาน AI สามารถทำซ้ำและแบ่งปันในชุมชนนักวิจัยได้

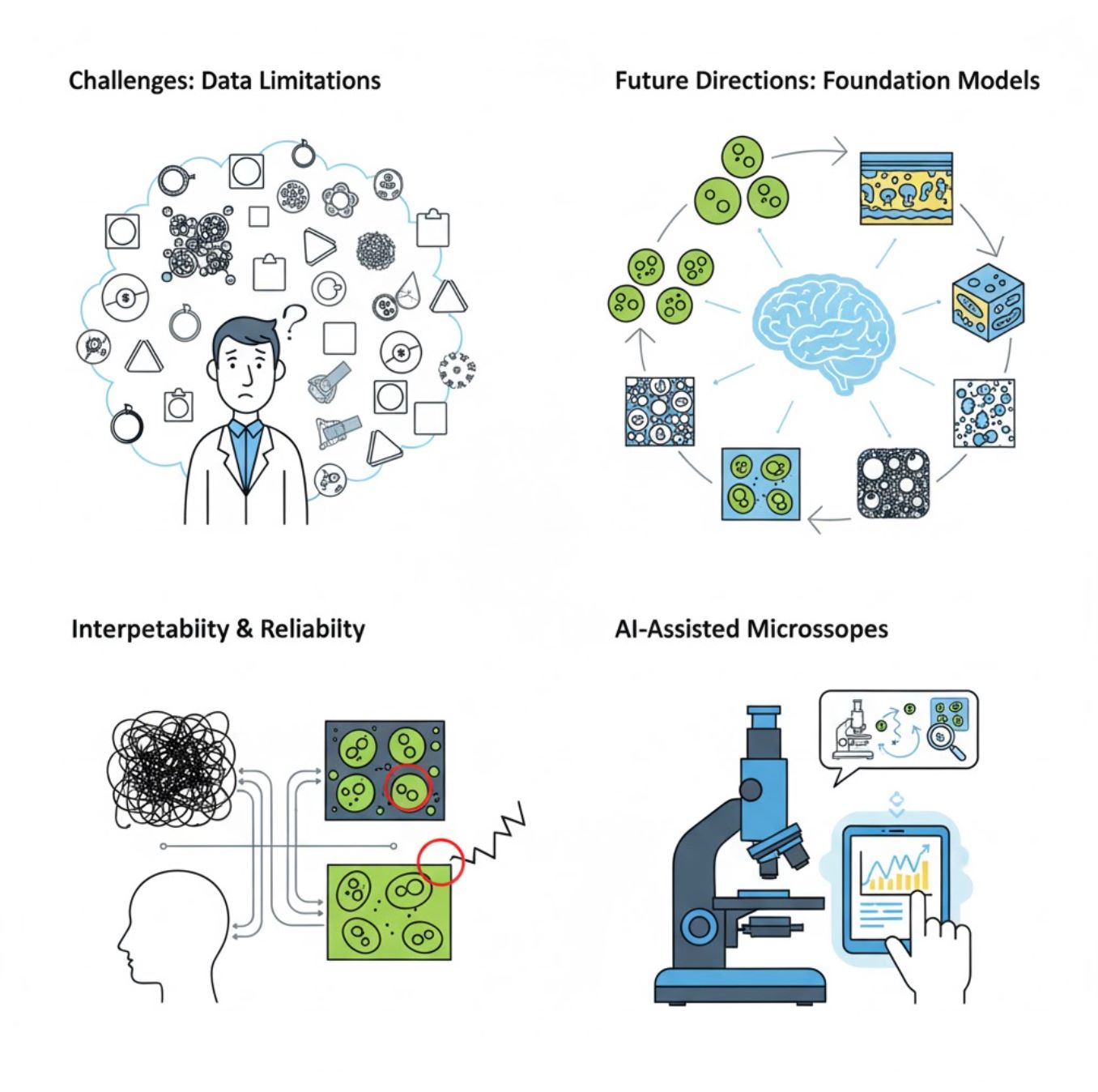

ความท้าทายและทิศทางในอนาคต

ความท้าทายในปัจจุบัน

แนวโน้มที่เกิดขึ้นใหม่

โมเดลพื้นฐานด้านภาพ

ระบบ AI รุ่นใหม่สัญญาว่าจะลดความจำเป็นในการฝึกเฉพาะงาน

- โมเดลเช่น SAM และระบบที่ใช้ CLIP

- AI หนึ่งตัวจัดการงานกล้องจุลทรรศน์หลายอย่าง

- การนำไปใช้และปรับตัวที่รวดเร็วขึ้น

กล้องจุลทรรศน์ที่ช่วยด้วย AI

ระบบกล้องจุลทรรศน์อัจฉริยะและอัตโนมัติเต็มรูปแบบกำลังกลายเป็นความจริง

- ควบคุมด้วยภาษาธรรมชาติผ่าน LLMs

- วงจรป้อนกลับอัตโนมัติเต็มรูปแบบ

- เปิดโอกาสเข้าถึงกล้องจุลทรรศน์ขั้นสูงอย่างทั่วถึง

สรุปประเด็นสำคัญ

- AI กำลังเปลี่ยนแปลงการประมวลผลภาพกล้องจุลทรรศน์อย่างรวดเร็วด้วยความแม่นยำและระบบอัตโนมัติที่ดีขึ้น

- การเรียนรู้เชิงลึกทำงานได้ดีกว่าการเรียนรู้ของเครื่องแบบดั้งเดิมกับภาพกล้องจุลทรรศน์ที่ซับซ้อนและแปรปรวน

- CNNs เรียนรู้คุณลักษณะเป็นลำดับชั้นจากพิกเซลดิบเพื่อการวิเคราะห์ที่ทนทาน

- การประยุกต์ใช้หลักได้แก่ การแบ่งส่วน, การจำแนก, การติดตาม, การลดสัญญาณรบกวน และการเก็บภาพอัตโนมัติ

- ความสำเร็จขึ้นอยู่กับข้อมูลคุณภาพและการตรวจสอบอย่างรอบคอบโดยผู้เชี่ยวชาญ

- โมเดลพื้นฐานด้านภาพและกล้องจุลทรรศน์ที่ช่วยด้วย AI คืออนาคตของสาขานี้

ด้วยความก้าวหน้าอย่างต่อเนื่องและความร่วมมือในชุมชน (เครื่องมือโอเพนซอร์ส, ชุดข้อมูลที่แบ่งปัน) AI จะกลายเป็นส่วนสำคัญของ "ดวงตา" ของกล้องจุลทรรศน์ ช่วยให้นักวิทยาศาสตร์เห็นสิ่งที่มองไม่เห็น

No comments yet. Be the first to comment!