مائیکروسکوپ امیج پروسیسنگ میں مصنوعی ذہانت

مصنوعی ذہانت مائیکروسکوپ امیج پروسیسنگ میں انقلاب لا رہی ہے، جیسے کہ درست تقسیم، شور کی کمی، سپر ریزولوشن، اور خودکار تصویر حاصل کرنا۔ یہ مضمون سائنسی تحقیق میں اہم AI آلات اور ابھرتے ہوئے رجحانات کو اجاگر کرتا ہے۔

مصنوعی ذہانت کی تکنیکیں مائیکروسکوپی میں انقلاب لا رہی ہیں، تصویر حاصل کرنے کی اصلاح اور تجزیہ کو خودکار بنانے کے ذریعے۔ جدید سمارٹ مائیکروسکوپ میں، AI ماڈیولز تصویری پیرامیٹرز کو فوری طور پر ایڈجسٹ کر سکتے ہیں (جیسے فوکس، روشنی) تاکہ فوٹوبلیچنگ کو کم کیا جا سکے اور سگنل کو بہتر بنایا جا سکے۔ اس دوران، گہری تعلیم کے الگورتھمز پیچیدہ تصویری ڈیٹا میں چھپے حیاتیاتی بصیرتوں کو نکال سکتے ہیں اور تصاویر کو دیگر ڈیٹا (جیسے جینومکس) سے بھی جوڑ سکتے ہیں۔

AI کے طریقے: مشین لرننگ بمقابلہ گہری تعلیم

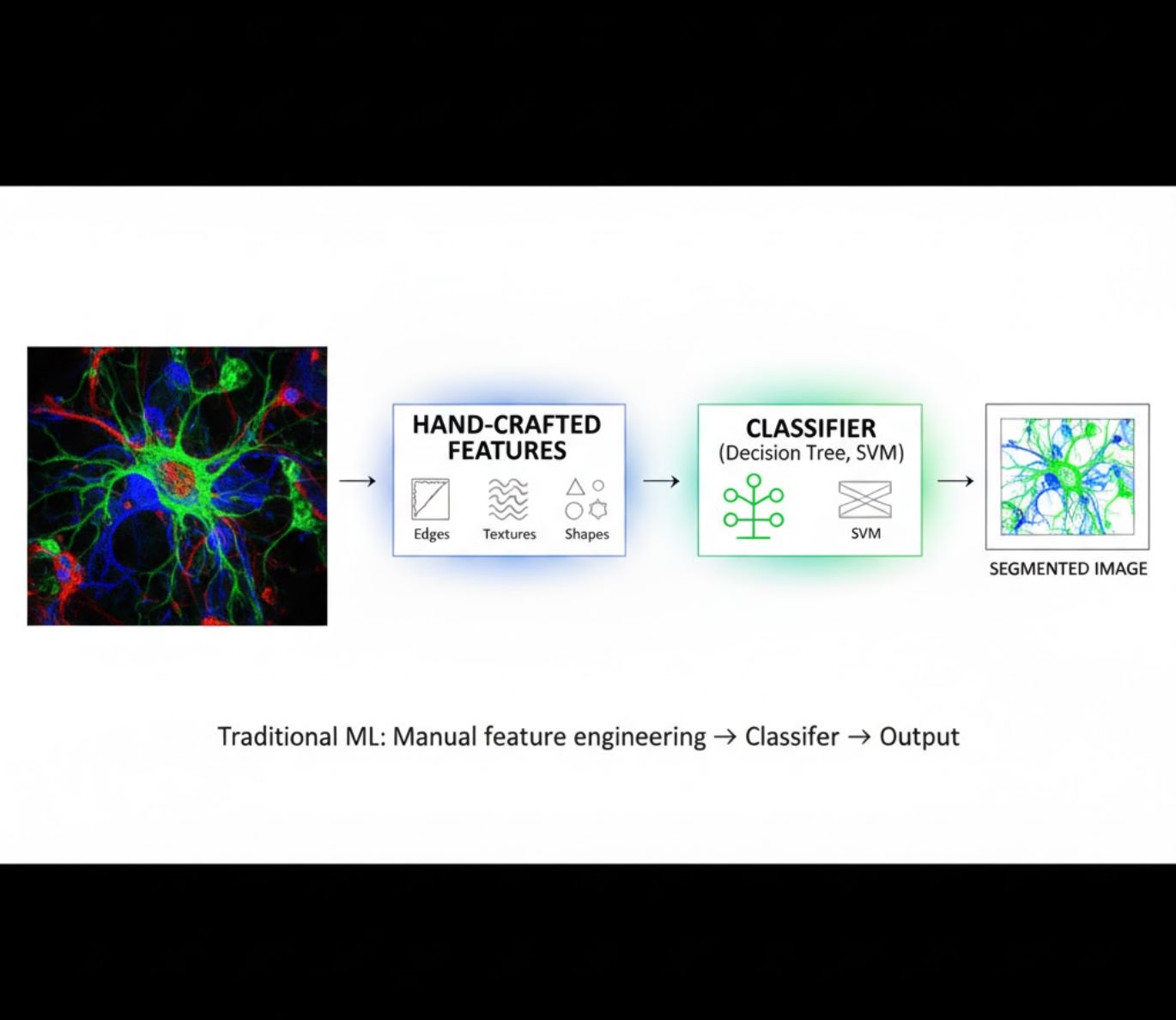

مصنوعی ذہانت کے طریقے کلاسیکی مشین لرننگ (ML) سے لے کر جدید گہری تعلیم (DL) تک ہوتے ہیں۔ ہر طریقہ کی اپنی خاص طاقتیں اور حدود ہیں:

ہاتھ سے تیار کردہ خصوصیات

- محققین تصویری خصوصیات (کنارے، بناوٹ، اشکال) خود تیار کرتے ہیں

- خصوصیات کو درجہ بندی کرنے والوں (decision trees, SVM) کو دیا جاتا ہے

- تیزی سے تربیت پاتی ہے

- پیچیدہ یا شور والے تصاویر کے ساتھ مشکل پیش آتی ہے

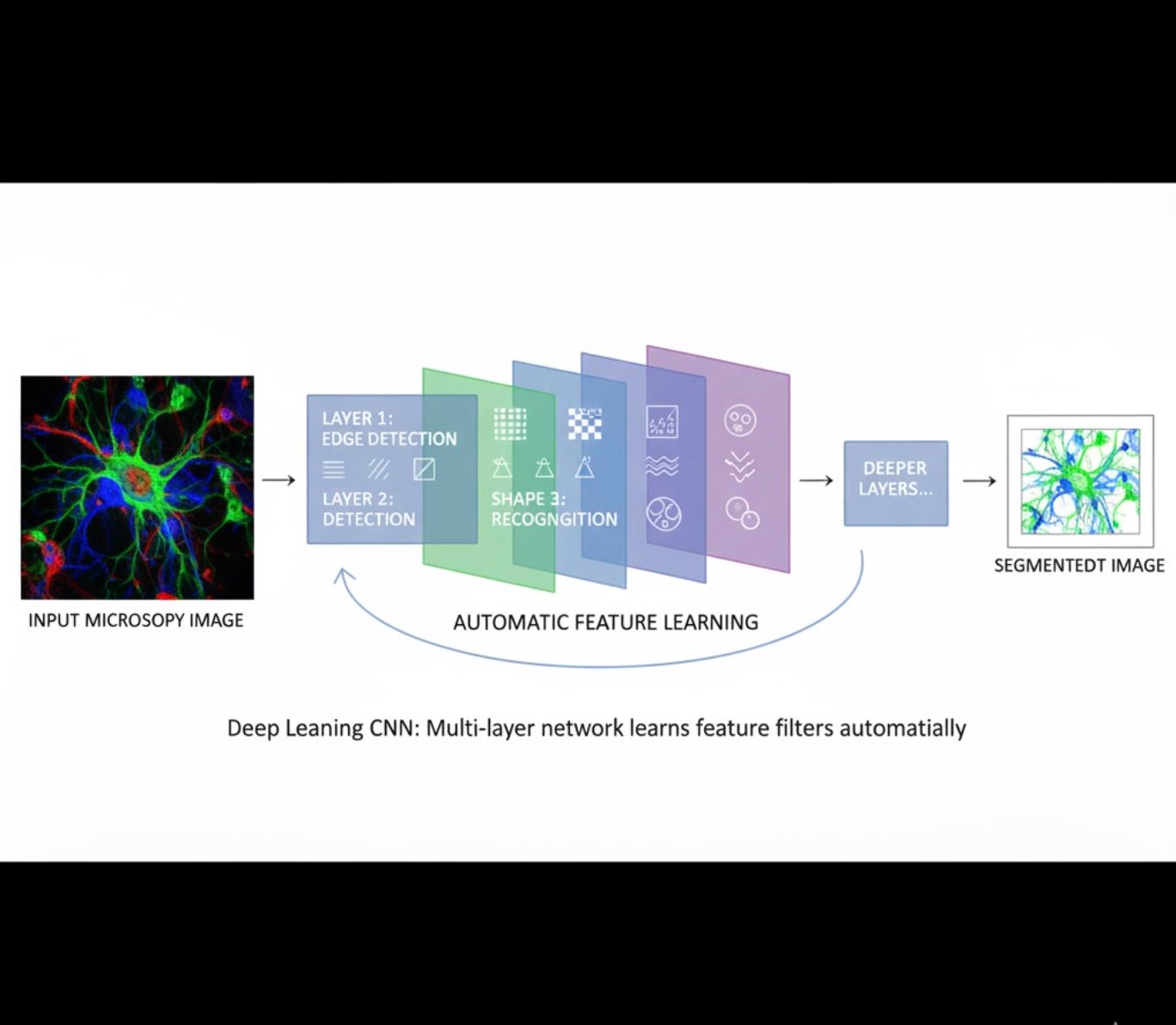

خودکار خصوصیات کی تعلیم

- کثیر پرت نیورل نیٹ ورکس (CNNs) خود بخود خصوصیات سیکھتے ہیں

- خام پکسلز سے اینڈ ٹو اینڈ تعلیم

- تبدیلیوں کے لیے بہت زیادہ مضبوط

- باریک بناوٹ اور ساختوں کو قابل اعتماد طریقے سے پکڑتا ہے

CNNs کیسے کام کرتے ہیں: کنولوشنل نیورل نیٹ ورکس مائیکروسکوپی تصاویر پر متواتر فلٹرز لگاتے ہیں، ابتدائی پرتوں میں سادہ پیٹرنز (کنارے) اور گہری پرتوں میں پیچیدہ ساختیں (سیل کی شکلیں، بناوٹ) سیکھتے ہیں۔ یہ درجہ بندی والی تعلیم گہری تعلیم کو انتہائی مضبوط بناتی ہے، خاص طور پر جب شدت کے پروفائلز میں نمایاں فرق ہو۔

بصری موازنہ: ML بمقابلہ DL پائپ لائنز

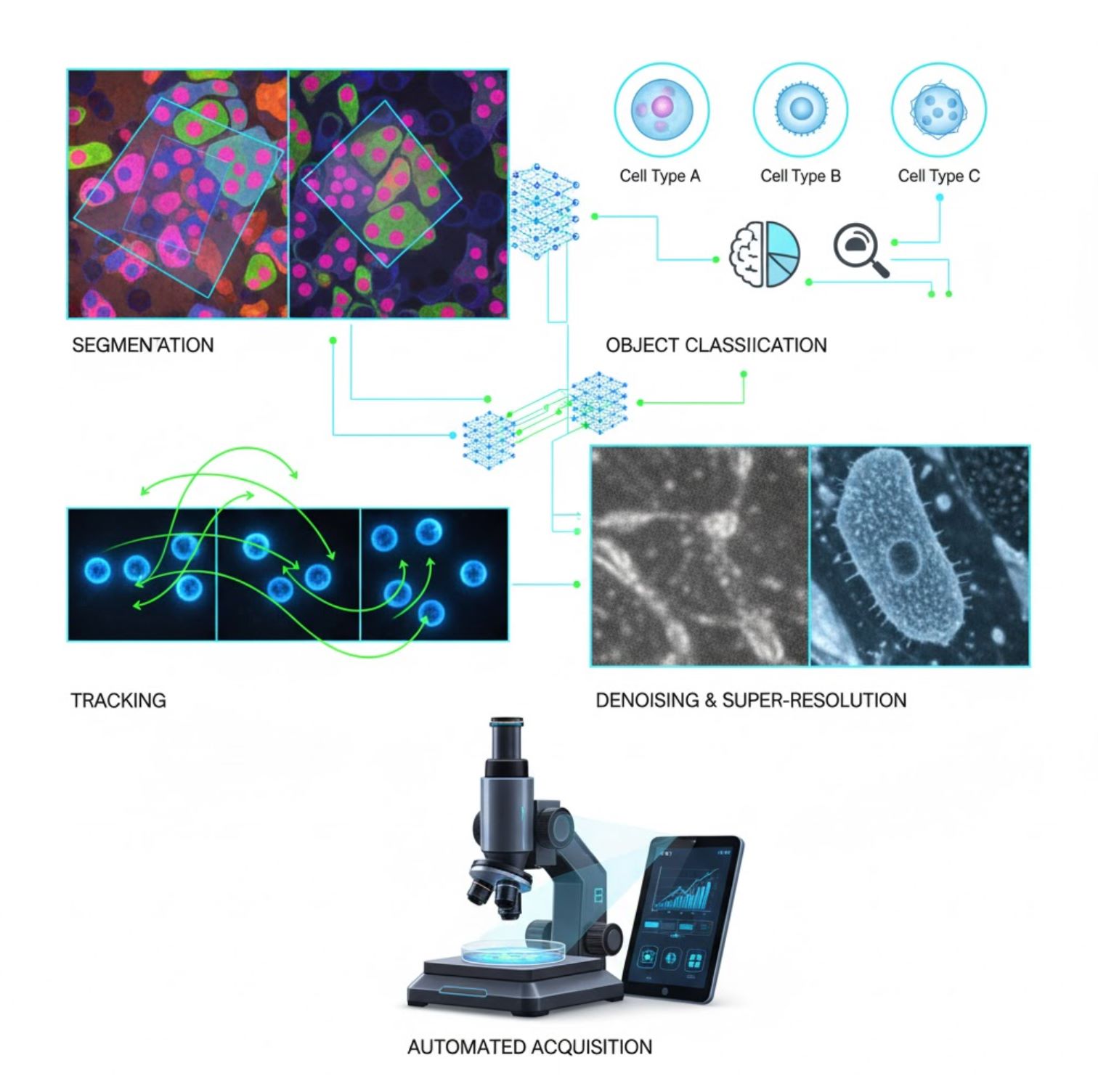

مائیکروسکوپی میں اہم AI اطلاقات

مصنوعی ذہانت اب مائیکروسکوپی ورک فلو کے مختلف تصویری پروسیسنگ کاموں میں شامل ہے:

تقسیم

تصاویر کو حصوں میں تقسیم کرنا (مثلاً ہر سیل یا نیوکلئیس کی شناخت کرنا)۔ گہری نیٹ ورکس جیسے U-Net اس کام میں مہارت رکھتے ہیں۔

- سمانٹک تقسیم: ہر پکسل کے لیے کلاس لیبلز

- انسٹینس تقسیم: انفرادی اشیاء کو الگ کرنا

- بھیڑ یا مدھم تصاویر پر اعلیٰ درستگی

- ویژن فاؤنڈیشن ماڈلز (مثلاً μSAM) اب مائیکروسکوپی کے لیے ڈھالے گئے ہیں

آبجیکٹ کی درجہ بندی

تقسیم کے بعد، AI ہر آبجیکٹ کو اعلیٰ درستگی کے ساتھ درجہ بندی کرتا ہے۔

- سیل کی قسم کی شناخت

- مائٹوٹک مرحلے کا تعین

- پیتھالوجی کے اشارے کی دریافت

- باریک فینوٹائپس کی تمیز جو دستی طور پر ناپنا مشکل ہے

ٹریکنگ

ٹائم لیپس مائیکروسکوپی میں، AI سیلز یا ذرات کو فریمز کے درمیان بے مثال درستگی کے ساتھ ٹریک کرتا ہے۔

- گہری تعلیم ٹریکنگ کی درستگی کو نمایاں طور پر بہتر بناتی ہے

- حرکت پذیر سیلز کے قابل اعتماد تجزیے کو ممکن بناتی ہے

- حرکی حیاتیاتی عمل کو پکڑتی ہے

شور کی کمی اور سپر ریزولوشن

AI ماڈلز تصویر کے معیار کو بہتر بناتے ہیں، شور اور دھند کو دور کر کے۔

- فزکس سے مطلع گہری ماڈلز مائیکروسکوپ آپٹکس سیکھتے ہیں

- تیز، بغیر نقائص کے تصاویر کی تعمیر نو

- روایتی طریقوں کے مقابلے میں کم نقائص کے ساتھ اعلیٰ ریزولوشن

خودکار حصول

AI خود مائیکروسکوپ کو حقیقی وقت میں رہنمائی کرتا ہے۔

- لائیو تصاویر کا تجزیہ کر کے ذہین فیصلے کرتا ہے

- خودکار طور پر فوکس ایڈجسٹ کرتا ہے اور دلچسپی کے علاقوں کو اسکین کرتا ہے

- فوٹوٹوکسیسٹی کو کم کرتا ہے اور وقت بچاتا ہے

- ہائی تھروپٹ اور موافق امیجنگ تجربات کو ممکن بناتا ہے

مائیکروسکوپ امیج پروسیسنگ میں مقبول AI آلات

<ITEM_DESCRIPTION>ایک بھرپور آلات کا ماحولیاتی نظام مائیکروسکوپی میں مصنوعی ذہانت کی معاونت کرتا ہے۔ محققین نے عمومی اور مخصوص سافٹ ویئر تیار کیے ہیں، جن میں سے بہت سے اوپن سورس ہیں:</ITEM_DESCRIPTION>

Cellpose

| ڈویلپر | کارسن اسٹرنگر اور ماریوس پاچیتاریو (MouseLand ریسرچ گروپ) |

| معاون پلیٹ فارمز |

پائتھن (pip/conda انسٹالیشن) کی ضرورت ہے۔ GUI صرف ڈیسک ٹاپ پر دستیاب ہے۔ |

| زبان کی حمایت | انگریزی دستاویزات؛ دنیا بھر کے تحقیقی لیبارٹریوں میں وسیع پیمانے پر اپنایا گیا |

| قیمت کا ماڈل | مفت اور اوپن سورس BSD-3-Clause لائسنس کے تحت |

جائزہ

سیلپوز ایک جدید، گہری تعلیم پر مبنی تقسیم کا آلہ ہے جو مائیکروسکوپی تصاویر کے لیے ڈیزائن کیا گیا ہے۔ ایک جنرل الگورتھم کے طور پر، یہ مختلف خلیاتی اقسام (نیوکلئی، سائٹوپلازم وغیرہ) کو مختلف امیجنگ طریقوں میں بغیر ماڈل کی دوبارہ تربیت کے درست طریقے سے تقسیم کرتا ہے۔ انسانی مداخلت کی صلاحیتوں کے ساتھ، محققین نتائج کو بہتر بنا سکتے ہیں، ماڈل کو اپنے ڈیٹا کے مطابق ڈھال سکتے ہیں، اور نظام کو 2D اور 3D دونوں امیجنگ ورک فلو میں استعمال کر سکتے ہیں۔

اہم خصوصیات

بغیر کسٹم تربیت کے، مختلف خلیاتی اقسام، داغ، اور امیجنگ طریقوں کے لیے باکس سے باہر کام کرتا ہے۔

"2.5D" طریقہ استعمال کرتے ہوئے مکمل 3D اسٹیکس کی حمایت کرتا ہے جو والیومیٹرک ڈیٹا کے لیے 2D ماڈلز کو دوبارہ استعمال کرتا ہے۔

دستی طور پر تقسیم کے نتائج کو درست کریں اور اپنی مرضی کے ڈیٹا پر ماڈل کو دوبارہ تربیت دیں تاکہ درستگی میں بہتری آئے۔

لچکدار ورک فلو کے لیے پائتھن API، کمانڈ لائن انٹرفیس، یا گرافیکل یوزر انٹرفیس کے ذریعے رسائی حاصل کریں۔

تقسیم سے پہلے تصویر کے معیار کو بہتر بنانے کے لیے شور کم کرنا، دھندلا پن دور کرنا، اور اپسمپلنگ کی صلاحیتیں۔

ڈاؤن لوڈ یا رسائی

تکنیکی پس منظر

سیلپوز کو اسٹرنگر، وانگ، مائیکلوس، اور پاچیتاریو کی ایک اہم تحقیق میں متعارف کرایا گیا تھا، جو ایک بڑے اور انتہائی متنوع ڈیٹا سیٹ پر تربیت یافتہ تھا جس میں 70,000 سے زائد تقسیم شدہ اشیاء شامل تھیں۔ یہ تنوع ماڈل کو خلیاتی شکلوں، سائز، اور مائیکروسکوپی سیٹنگز میں عام کرنے کے قابل بناتا ہے، جس سے زیادہ تر استعمال کے معاملات میں کسٹم تربیت کی ضرورت نمایاں طور پر کم ہو جاتی ہے۔ 3D ڈیٹا کے لیے، سیلپوز اپنی 2D ماڈل کو "2.5D" انداز میں دوبارہ استعمال کرتا ہے، مکمل 3D تشریح شدہ تربیتی ڈیٹا کی ضرورت سے بچتے ہوئے والیومیٹرک تقسیم فراہم کرتا ہے۔ سیلپوز 2.0 نے انسانی مداخلت کے ذریعے دوبارہ تربیت متعارف کروائی، جو صارفین کو دستی طور پر پیش گوئیاں درست کرنے اور اپنی تصاویر پر دوبارہ تربیت دینے کی اجازت دیتی ہے تاکہ مخصوص ڈیٹا سیٹس پر کارکردگی بہتر ہو سکے۔

تنصیب اور سیٹ اپ

conda استعمال کرتے ہوئے پائتھن ماحول قائم کریں:

conda create -n cellpose python=3.10ماحول کو فعال کریں اور سیلپوز انسٹال کریں:

# For GUI support

pip install cellpose[gui]

# For minimal setup (API/CLI only)

pip install cellposeشروع کریں

GUI موڈ

- GUI کو چلائیں:

python -m cellpose - تصویری فائلیں (

.tif,.pngوغیرہ) انٹرفیس میں گھسیٹیں اور چھوڑیں - ماڈل کی قسم منتخب کریں (مثلاً "cyto" سائٹوپلازم کے لیے یا "nuclei" نیوکلئی کے لیے)

- متوقع خلیے کا قطر مقرر کریں یا سیلپوز کو خودکار طریقے سے کیلائبریٹ کرنے دیں

- سیگمنٹیشن شروع کرنے کے لیے کلک کریں اور نتائج دیکھیں

پائتھن API موڈ

from cellpose import models

# Load model

model = models.Cellpose(model_type='cyto')

# Segment images

masks, flows = model.eval(images, diameter=30)بہتر بنائیں اور دوبارہ تربیت دیں

- ماسک بنانے کے بعد، GUI میں تقسیم کو دستی طور پر درست کریں، ماسک کو ضم یا حذف کریں

- درست شدہ مثالوں پر دوبارہ تربیت کے لیے بلٹ ان تربیتی فنکشنز استعمال کریں

- اپنے مخصوص ڈیٹا سیٹ پر ماڈل کی کارکردگی بہتر بنائیں

3D ڈیٹا پروسیس کریں

- ملٹی-Z TIFF یا والیومیٹرک اسٹیک لوڈ کریں

- GUI یا API میں

--Zstackفلیگ استعمال کریں تاکہ 3D کے طور پر پروسیس کیا جا سکے - بہتر تقسیم کے لیے 3D فلو کو ہموار کرنے یا مخصوص پیرامیٹرز کے ذریعے بہتر بنائیں

حدود اور غور و فکر

- ماڈل کی عمومیّت کا سودا: اگرچہ جنرل ماڈل وسیع پیمانے پر کام کرتا ہے، بہت غیر معمولی خلیاتی شکلیں یا امیجنگ حالات دوبارہ تربیت کی ضرورت ہو سکتی ہے۔

- تشریح کی محنت: انسانی مداخلت کی تربیت کے لیے دستی اصلاحات کی ضرورت ہوتی ہے، جو بڑے ڈیٹا سیٹس کے لیے وقت طلب ہو سکتی ہیں۔

- تنصیب کی پیچیدگی: GUI کی تنصیب کے لیے کمانڈ لائن، conda ماحول، اور پائتھن انحصارات کا انتظام درکار ہو سکتا ہے — جو غیر پروگرامرز کے لیے ہمیشہ آسان نہیں۔

- صرف ڈیسک ٹاپ: سیلپوز ڈیسک ٹاپ استعمال کے لیے ڈیزائن کیا گیا ہے؛ کوئی مقامی Android یا iOS ایپ دستیاب نہیں۔

اکثر پوچھے جانے والے سوالات

نہیں — سیلپوز پہلے سے تربیت یافتہ جنرل ماڈلز فراہم کرتا ہے جو اکثر بغیر دوبارہ تربیت کے اچھے کام کرتے ہیں۔ تاہم، خاص یا غیر معمولی ڈیٹا پر بہترین نتائج کے لیے، آپ انسانی مداخلت کی خصوصیات استعمال کرتے ہوئے تشریح کر کے دوبارہ تربیت کر سکتے ہیں۔

جی ہاں — یہ 3D کی حمایت کرتا ہے اپنی 2D ماڈل کو دوبارہ استعمال کرتے ہوئے (جسے "2.5D" کہا جاتا ہے)، اور آپ والیومیٹرک اسٹیکس کو GUI یا API کے ذریعے چلا سکتے ہیں۔

GPU تیز رفتار انفرنس اور تربیت کے لیے سختی سے سفارش کی جاتی ہے، خاص طور پر بڑے یا 3D ڈیٹا سیٹس پر، لیکن سیلپوز CPU صرف مشینوں پر بھی چل سکتا ہے مگر کارکردگی کم ہوگی۔

GUI میں، متوقع خلیے کا قطر دستی طور پر مقرر کریں یا سیلپوز کو خودکار طریقے سے کیلائبریٹ کرنے دیں۔ اگر تقسیم مثالی نہ ہو تو آپ نتائج کو بہتر بنا سکتے ہیں اور دوبارہ تربیت دے سکتے ہیں۔

جی ہاں — نئے ورژنز (Cellpose 3) میں تصویر کی بحالی کے ماڈلز شامل ہیں جو شور کم کرنے، دھندلا پن دور کرنے، اور اپسمپلنگ کی صلاحیتیں فراہم کرتے ہیں تاکہ تقسیم سے پہلے تصویر کا معیار بہتر بنایا جا سکے۔

StarDist

| ڈویلپر | اوی شمٹ، مارٹن ویگرٹ، کولمین براؤڈس، اور جین مائرز |

| معاون پلیٹ فارمز |

|

| زبان کی حمایت | اوپن سورس پروجیکٹ جس کی دستاویزات اور کمیونٹی بنیادی طور پر انگریزی میں ہے |

| قیمت کا ماڈل | مفت اور اوپن سورس۔ BSD-3-Clause لائسنس کے تحت |

جائزہ

StarDist خوردبین کی تصاویر میں انسٹینس سیگمنٹیشن کے لیے ایک گہری تعلیم کا آلہ ہے۔ یہ ہر شے (جیسے خلیاتی نیوکلئی) کو 2D میں ستار-کونویکس کثیرالاضلاع یا 3D میں کثیرالسطحی کے طور پر ظاہر کرتا ہے، جو گنجان یا اوورلیپنگ اشیاء کی درست شناخت اور علیحدگی کو ممکن بناتا ہے۔ اپنی مضبوط ساخت کے ساتھ، StarDist فلوروسینس خوردبین، ہسٹاپیتھولوجی، اور دیگر بایو امیج تجزیہ کی ایپلیکیشنز میں خودکار خلیہ اور نیوکلئیس سیگمنٹیشن کے لیے وسیع پیمانے پر استعمال ہوتا ہے۔

اہم خصوصیات

ستار-کونویکس کثیرالاضلاع (2D) اور کثیرالسطحی (3D) کے ذریعے انتہائی درست انسٹینس سیگمنٹیشن جو قابل اعتماد شے کی شناخت فراہم کرتی ہے۔

دونوں 2D تصاویر اور 3D والیومٹرک ڈیٹا کے لیے مخصوص ماڈلز جو جامع خوردبین تجزیہ کے لیے ہیں۔

فلوروسینس نیوکلئی، H&E سے رنگے ہوئے ہسٹولوجی، اور دیگر عام امیجنگ منظرناموں کے لیے تیار شدہ ماڈلز۔

ایک ہی سیگمنٹیشن رن میں مختلف کلاسوں (مثلاً مختلف خلیاتی اقسام) میں شناخت شدہ اشیاء کی درجہ بندی۔

ImageJ/Fiji، QuPath، اور napari کے ساتھ آسان GUI پر مبنی ورک فلو کے لیے مربوط انضمام۔

انسٹینس سیگمنٹیشن کی مکمل تشخیص بشمول پریسیژن، ریکال، F1 اسکور، اور پیناپٹک کوالٹی۔

تکنیکی پس منظر

StarDist کو اصل میں MICCAI 2018 کے مقالے میں متعارف کرایا گیا، جس کی بنیادی جدت یہ ہے کہ ہر پکسل کے لیے اشیاء کے امکانات کے ساتھ مقررہ شعاعوں کے ساتھ ریڈیئل فاصلے کی پیش گوئی کی جاتی ہے، جو ستار-کونویکس اشکال کی درست تعمیر نو کو ممکن بناتی ہے۔ یہ طریقہ روایتی پکسل پر مبنی یا باؤنڈنگ باکس طریقوں کے مقابلے میں قریب سے جڑی ہوئی اشیاء کو قابل اعتماد طور پر الگ کرتا ہے جو علیحدہ کرنا مشکل ہوتی ہیں۔

حالیہ ترقیات نے StarDist کو ہسٹاپیتھولوجی تصاویر تک بڑھایا ہے، جو نہ صرف نیوکلئیس سیگمنٹیشن بلکہ شناخت شدہ اشیاء کی کثیرالطبقات درجہ بندی بھی ممکن بناتی ہے۔ اس طریقہ نے CoNIC (کولون نیوکلئی شناخت اور گنتی) چیلنج جیسے مقابلوں میں اعلیٰ کارکردگی حاصل کی ہے۔

ڈاؤن لوڈ یا رسائی

انسٹالیشن اور سیٹ اپ

StarDist کے لیے پیشگی شرط کے طور پر TensorFlow (ورژن 1.x یا 2.x) انسٹال کریں۔

StarDist پائتھن پیکیج انسٹال کرنے کے لیے pip استعمال کریں:

pip install stardistnapari کے لیے:

pip install stardist-napariQuPath کے لیے: StarDist ایکسٹینشن کو QuPath میں .jar فائل گھسیٹ کر انسٹال کریں۔

ImageJ/Fiji کے لیے: بلٹ ان پلگ ان مینیجر یا پلگ انز مینو کے ذریعے دستی انسٹالیشن استعمال کریں۔

سیگمنٹیشن چلانا

پہلے سے تربیت یافتہ ماڈل لوڈ کریں، اپنی تصویر کو نارملائز کریں، اور پیش گوئی چلائیں:

from stardist.models import StarDist2D

model = StarDist2D.from_pretrained('2D_versatile_fluo')

labels, details = model.predict_instances(image)اپنی تصویر napari میں کھولیں، StarDist پلگ ان منتخب کریں، پہلے سے تربیت یافتہ یا حسب ضرورت ماڈل منتخب کریں، اور GUI سے براہ راست پیش گوئی چلائیں۔

پلگ انز مینو سے StarDist پلگ ان استعمال کریں تاکہ اپنی تصویر اسٹیک پر ماڈل لگائیں، ایک آسان انٹرفیس کے ساتھ۔

ایکسٹینشن انسٹال کرنے کے بعد، QuPath کے اسکرپٹنگ کنسول یا گرافیکل انٹرفیس کے ذریعے StarDist ڈیٹیکشن چلائیں، ہسٹاپیتھولوجی تجزیہ کے لیے۔

تربیت اور فائن ٹوننگ

ایسے گراؤنڈ ٹروتھ لیبل تصاویر بنائیں جہاں ہر شے منفرد طور پر لیبل کی گئی ہو۔ اپنے ڈیٹا سیٹ کی تیاری کے لیے LabKit، QuPath، یا Fiji جیسے تشریحی آلات استعمال کریں۔

StarDist کے پائتھن API کا استعمال کرتے ہوئے نیا ماڈل تربیت دیں یا اپنی حسب ضرورت تشریح شدہ ڈیٹا کے ساتھ موجودہ ماڈل کو فائن ٹون کریں۔

بعد از عمل کے اختیارات

- غیر زیادہ سے زیادہ دباؤ (NMS) کا اطلاق کریں تاکہ غیر ضروری امیدوار اشکال کو ختم کیا جا سکے

- غیر ستار-کونویکس اشکال کے لیے ماسک کو ضم کرنے کے لیے StarDist OPP (آبجیکٹ پوسٹ پروسیسنگ) استعمال کریں

حدود اور غور و فکر

- ستار-کونویکس مفروضہ انتہائی غیر کونویکس یا بہت بے قاعدہ اشکال کو مکمل طور پر ماڈل نہیں کر سکتا

- انسٹالیشن کی پیچیدگی: حسب ضرورت انسٹالیشن کے لیے ایک مطابقت پذیر C++ کمپائلر کی ضرورت ہوتی ہے تاکہ ایکسٹینشنز بنائی جا سکیں

- GPU تیز رفتاری کا انحصار مطابقت پذیر TensorFlow، CUDA، اور cuDNN ورژنز پر ہے

- کچھ صارفین Java کنفیگریشن کی وجہ سے ImageJ پلگ ان چلانے میں مسائل کی اطلاع دیتے ہیں

اکثر پوچھے جانے والے سوالات

StarDist مختلف قسم کی تصاویر کے ساتھ کام کرتا ہے جن میں فلوروسینس، برائٹ فیلڈ، اور ہسٹاپیتھولوجی (مثلاً H&E) شامل ہیں، اس کے لچکدار پہلے سے تربیت یافتہ ماڈلز اور مختلف امیجنگ طریقوں کے مطابق ہونے کی بدولت۔

جی ہاں — StarDist 3D والیومٹرک ڈیٹا کے لیے ستار-کونویکس کثیرالسطحی کا استعمال کرتے ہوئے 3D انسٹینس سیگمنٹیشن کی حمایت کرتا ہے، جو 2D صلاحیتوں کو مکمل 3D تجزیہ تک بڑھاتا ہے۔

ضروری نہیں۔ پہلے سے تربیت یافتہ ماڈلز دستیاب ہیں اور اکثر بغیر کسی تبدیلی کے اچھا کام کرتے ہیں۔ تاہم، مخصوص یا نئے ڈیٹا کے لیے، تشریح اور حسب ضرورت ماڈلز کی تربیت درستگی کو نمایاں طور پر بہتر بناتی ہے۔

StarDist napari، ImageJ/Fiji، اور QuPath کے ساتھ مربوط ہوتا ہے، جو آپ کو بغیر کوڈنگ کے GUI سے سیگمنٹیشن چلانے کی اجازت دیتا ہے۔ یہ پیچیدہ ورک فلو کے لیے براہ راست پائتھن API کے استعمال کی بھی حمایت کرتا ہے۔

StarDist پریسیژن، ریکال، F1 اسکور، اور پیناپٹک کوالٹی سمیت عام انسٹینس سیگمنٹیشن میٹرکس کے حساب کے لیے بلٹ ان فنکشنز فراہم کرتا ہے تاکہ سیگمنٹیشن کی کارکردگی کا اندازہ لگایا جا سکے۔

SAM

درخواست کی معلومات

| ڈیولپر | میٹا AI ریسرچ (FAIR) |

| معاون آلات |

|

| زبان اور دستیابی | عالمی سطح پر دستیاب اوپن سورس بنیادی ماڈل؛ دستاویزات انگریزی میں |

| قیمت | مفت — میٹا کے لائسنس کے تحت GitHub اور MIB انضمام کے ذریعے اوپن سورس |

عمومی جائزہ

SAM (Segment Anything Model) ایک طاقتور AI بنیادی ماڈل ہے جو میٹا نے تیار کیا ہے، جو تصاویر میں تقریباً کسی بھی شے کی تعاملی اور خودکار تقسیم کو ممکن بناتا ہے۔ نقاط، باؤنڈنگ باکسز، یا تقریبی ماسک جیسے پرامپٹس کا استعمال کرتے ہوئے، SAM بغیر کسی مخصوص کام کی دوبارہ تربیت کے تقسیم ماسک تیار کرتا ہے۔ خوردبین تحقیق میں، SAM کی لچک کو خلیہ تقسیم، آرگنیل کی شناخت، اور ہسٹاپیتھولوجی تجزیہ کے لیے ڈھالا گیا ہے، جو محققین کے لیے ایک قابل توسیع حل فراہم کرتا ہے جو ایک پرامپٹ ایبل، عمومی مقصد کے تقسیم آلے کی تلاش میں ہیں۔

تفصیلی تعارف

اصل میں میٹا نے SAM کو 1 بلین سے زائد ماسک پر 11 ملین تصاویر کے ذریعے تربیت دی، یہ ایک پرامپٹ ایبل بنیادی ماڈل کے طور پر ڈیزائن کیا گیا تھا جو نئے شعبوں پر "زیرو شاٹ" کارکردگی دکھاتا ہے۔ طبی تصویری تحقیق میں، SAM کو پورے سلائیڈ کی ہسٹاپیتھولوجی تقسیم، ٹیومر کی شناخت، اور خلیہ نیوکلئی کی شناخت کے لیے جانچا گیا ہے۔ تاہم، گھنے یا پیچیدہ تصاویر میں، جیسے خلیہ نیوکلئی، اس کی کارکردگی مخلوط ہے: یہاں تک کہ وسیع پرامپٹس (مثلاً 20 کلکس یا باکسز) کے باوجود، زیرو شاٹ تقسیم پیچیدہ خوردبینی تصاویر میں مشکلات کا سامنا کر سکتی ہے۔

اس محدودیت کو دور کرنے کے لیے، مخصوص شعبوں کے لیے ڈھالے گئے ورژنز سامنے آئے ہیں:

- SAMCell — بڑے خوردبینی ڈیٹا سیٹس پر فائن ٹیون کیا گیا تاکہ مختلف خلیہ اقسام پر مضبوط زیرو شاٹ تقسیم ممکن ہو بغیر ہر تجربے کی دوبارہ تربیت کے

- μSAM — 17,000 سے زائد دستی طور پر تشریح شدہ خوردبینی تصاویر پر دوبارہ تربیت یافتہ تاکہ چھوٹے خلیاتی ڈھانچوں کی درستگی بہتر ہو

اہم خصوصیات

نقاط، باکسز، اور ماسک کے ذریعے لچکدار تعامل برائے درست کنٹرول۔

نئے تصویری شعبوں پر بغیر فائن ٹیوننگ کے تقسیم انجام دیتا ہے۔

چند شاٹ یا پرامپٹ پر مبنی دوبارہ تربیت کے ذریعے خوردبینی اور ہسٹاپیتھولوجی کے لیے قابل تطبیق۔

مائیکروسکوپی امیج براؤزر (MIB) میں 3D اور انٹرپولیٹڈ تقسیم کی حمایت کے ساتھ دستیاب۔

IDCC-SAM امیونوسائٹوکیمسٹری میں خودکار خلیات کی گنتی کو بغیر دستی تشریح کے ممکن بناتا ہے۔

ڈاؤن لوڈ یا رسائی

صارف گائیڈ

- مائیکروسکوپی امیج براؤزر کھولیں اور SAM تقسیم پینل پر جائیں

- پائتھن انٹرپریٹر کو ترتیب دیں اور SAM-1 یا SAM-2 ماڈلز میں سے انتخاب کریں

- GPU تیز رفتاری کے لیے، عمل درآمد کے ماحول میں "cuda" منتخب کریں (بہترین کارکردگی کے لیے سفارش کی جاتی ہے)

- نقطہ پرامپٹس: کسی شے پر کلک کریں تاکہ مثبت بیج مقرر ہو؛ Shift + کلک سے توسیع کریں اور Ctrl + کلک سے منفی بیج لگائیں

- 3D اسٹیکس: تعاملی 3D موڈ استعمال کریں—ایک سلائس پر کلک کریں، شفٹ-اسکرول کریں، اور سلائسز کے درمیان بیج انٹرپولیٹ کریں

- ایڈجسٹ موڈ: ماسک کو تبدیل کریں، شامل کریں، منہا کریں، یا ضرورت کے مطابق نئی پرت بنائیں

- MIB کے SAM-2 پینل میں "آٹومیٹک ایوری تھنگ" آپشن استعمال کریں تاکہ کسی علاقے میں تمام نظر آنے والی اشیاء کی تقسیم کی جا سکے

- تقسیم کے بعد ماسک کا جائزہ لیں اور حسب ضرورت بہتر کریں

- پرامپٹ پر مبنی فائن ٹیوننگ پائپ لائنز (مثلاً "All-in-SAM") استعمال کریں تاکہ کم تعداد میں صارف پرامپٹس سے پکسل سطح کی تشریحات تیار کی جا سکیں

- خلیات کی گنتی کے لیے، IDCC-SAM استعمال کریں، جو SAM کو زیرو شاٹ پائپ لائن میں پوسٹ پروسیسنگ کے ساتھ استعمال کرتا ہے

- اعلی درستگی والی خلیہ تقسیم کے لیے، خوردبینی خلیہ تصاویر پر فائن ٹیون کیا گیا SAMCell استعمال کریں

محدودیتیں اور غور و فکر

- زیرو شاٹ کارکردگی گھنے یا اوورلیپنگ ڈھانچوں پر شعبے کی تربیت کے بغیر غیر مستقل

- تقسیم کا معیار پرامپٹ ڈیزائن اور حکمت عملی پر بہت منحصر

- GPU کی سخت سفارش؛ CPU انفرنس بہت سست

- بہت زیادہ ریزولوشن والی پورے سلائیڈ کی تصاویر اور کثیر پیمانے پر ٹشو ڈھانچوں میں مشکلات

- خوردبینی کے لیے SAM کی فائن ٹیوننگ یا تطبیق کے لیے مشین لرننگ کی مہارت درکار ہو سکتی ہے

اکثر پوچھے جانے والے سوالات

جی ہاں—ایسے ورژنز جیسے SAMCell کے ذریعے، جو خاص طور پر خوردبینی ڈیٹا سیٹس پر خلیہ تقسیم کے کام کے لیے SAM کو فائن ٹیون کرتا ہے۔

ہمیشہ نہیں۔ IDCC-SAM کے ساتھ، آپ بغیر دستی تشریحات کے زیرو شاٹ خلیات کی گنتی کر سکتے ہیں۔

پرامپٹ پر مبنی فائن ٹیوننگ (مثلاً "All-in-SAM") یا پہلے سے تربیت یافتہ خوردبینی ورژنز جیسے μSAM استعمال کریں، جو 17,000 سے زائد تشریح شدہ خوردبینی تصاویر پر تربیت یافتہ ہے۔

اگرچہ CPU پر ممکن ہے، GPU کی سخت سفارش کی جاتی ہے تاکہ عملی انفرنس کی رفتار اور حقیقی وقت تعاملی تقسیم ممکن ہو۔

جی ہاں—MIB کا SAM-2 انضمام 3D تقسیم کی حمایت کرتا ہے، جس میں سلائسز کے درمیان بیج کی انٹرپولیشن شامل ہے تاکہ حجماتی تجزیہ ممکن ہو۔

AxonDeepSeg

| ڈیولپر | نیوروپولی لیب، پولیٹیکنیک مونٹریال اور یونیورسٹی آف مونٹریال |

| معاون پلیٹ فارمز |

|

| زبان | انگریزی دستاویزات؛ عالمی سطح پر استعمال ہونے والا اوپن سورس ٹول |

| قیمت | مفت اور اوپن سورس |

جائزہ

AxonDeepSeg ایک اے آئی سے چلنے والا ٹول ہے جو خوردبین کی تصاویر میں ایکسونز اور مائلین کی خودکار سیگمنٹیشن کے لیے ہے۔ کنولوشنل نیورل نیٹ ورکس کا استعمال کرتے ہوئے، یہ TEM، SEM، اور برائٹ-فیلڈ خوردبین سمیت متعدد امیجنگ طریقوں میں درست تین کلاس کی سیگمنٹیشن (ایکسون، مائلین، پس منظر) فراہم کرتا ہے۔ ایکسون کے قطر، جی-ریشو، اور مائلین کی موٹائی جیسے مورفومیٹرک پیمائشوں کو خودکار بنا کر، AxonDeepSeg نیوروسائنس تحقیق میں مقداری تجزیے کو آسان بناتا ہے، دستی تشریح کے وقت کو نمایاں طور پر کم کرتا ہے اور قابلِ تکراریت کو بہتر بناتا ہے۔

اہم خصوصیات

TEM، SEM، اور برائٹ-فیلڈ خوردبین کے لیے تیار شدہ ماڈلز جو بہتر کارکردگی کے لیے موزوں ہیں۔

خوردبین کی تصاویر میں ایکسون، مائلین، اور پس منظر کے علاقوں کی درست درجہ بندی۔

ایکسون کے قطر، جی-ریشو، مائلین کی موٹائی، اور کثافت کے میٹرکس کا خودکار حساب۔

Napari GUI کے انضمام سے سیگمنٹیشن ماسکس کی دستی درستگی ممکن ہے تاکہ درستگی میں اضافہ ہو۔

نیورل ٹشو کے بڑے پیمانے پر تجزیے کے لیے حسب ضرورت پائپ لائنز میں آسان انضمام۔

جامع ٹیسٹ اسکرپٹس جو قابلِ تکرار اور معتبر سیگمنٹیشن نتائج کو یقینی بناتے ہیں۔

تکنیکی تفصیلات

نیوروپولی لیب کی جانب سے تیار کردہ AxonDeepSeg ڈیپ لرننگ کا استعمال کرتے ہوئے نیوروسائنسی ایپلیکیشنز کے لیے اعلیٰ درستگی کی سیگمنٹیشن فراہم کرتا ہے۔ مختلف خوردبینی طریقوں کے لیے پری ٹرینڈ ماڈلز دستیاب ہیں جو امیجنگ تکنیکوں میں ورسٹائل ہیں۔ یہ ٹول Napari کے ساتھ انضمام کرتا ہے، جو سیگمنٹیشن ماسکس کی انٹرایکٹو اصلاحات کی اجازت دیتا ہے، جس سے مشکل ڈیٹا سیٹس پر درستگی میں اضافہ ہوتا ہے۔ AxonDeepSeg اہم مورفومیٹرک میٹرکس کا حساب لگاتا ہے، جو نیورل ٹشو کی ساخت اور بیماریوں کے بڑے پیمانے پر مطالعات کی حمایت کرتا ہے۔ اس کا پائتھن پر مبنی فریم ورک ایکسون اور مائلین کی مورفولوجی کے بڑے پیمانے پر تجزیے کے لیے حسب ضرورت پائپ لائنز میں انضمام کو ممکن بناتا ہے۔

ڈاؤن لوڈ یا رسائی

تنصیب اور سیٹ اپ

یقینی بنائیں کہ Python 3.8 یا اس سے جدید ورژن انسٹال ہے، پھر pip کے ذریعے AxonDeepSeg اور Napari انسٹال کریں:

pip install axondeepseg napariدئیے گئے ٹیسٹ اسکرپٹس چلائیں تاکہ تمام اجزاء کی درست تنصیب اور کارکردگی کی تصدیق ہو سکے۔

خوردبین کی تصاویر (TEM، SEM، یا برائٹ-فیلڈ) کو Napari یا اپنے پائتھن ماحول میں امپورٹ کریں۔

اپنی امیجنگ موڈیلٹی کے لیے مناسب پری ٹرینڈ ماڈل منتخب کریں اور ایکسون اور مائلین کے ماسکس بنانے کے لیے سیگمنٹیشن چلائیں۔

خودکار طور پر مورفومیٹرک پیمائشیں جیسے ایکسون کا قطر، جی-ریشو، کثافت، اور مائلین کی موٹائی کا حساب لگائیں، پھر نتائج CSV فارمیٹ میں برآمد کریں۔

جہاں ضرورت ہو، Napari GUI کا استعمال کرتے ہوئے سیگمنٹیشن ماسکس کو دستی طور پر ایڈجسٹ کریں، ماسکس کو ضم یا حذف کر کے درستگی میں اضافہ کریں۔

اہم نکات

- نئی یا غیر تربیت یافتہ امیجنگ موڈیلٹیز پر کارکردگی کم ہو سکتی ہے

- مشکل یا پیچیدہ علاقوں کے لیے دستی اصلاحات کی ضرورت ہو سکتی ہے

- بڑے ڈیٹا سیٹس کی تیز پروسیسنگ کے لیے GPU کی سفارش کی جاتی ہے؛ CPU پروسیسنگ بھی دستیاب ہے

اکثر پوچھے جانے والے سوالات

AxonDeepSeg TEM (ٹرانسمیشن الیکٹران خوردبین)، SEM (سکیننگ الیکٹران خوردبین)، اور برائٹ-فیلڈ خوردبین کی حمایت کرتا ہے، ہر موڈیلٹی کے لیے بہتر کارکردگی کے لیے پری ٹرینڈ ماڈلز کے ساتھ۔

جی ہاں، AxonDeepSeg مکمل طور پر مفت اور اوپن سورس ہے، تعلیمی اور تجارتی استعمال کے لیے دستیاب ہے۔

جی ہاں، AxonDeepSeg سیگمنٹ کی گئی تصاویر سے ایکسون کے قطر، جی-ریشو، مائلین کی موٹائی، اور کثافت کے میٹرکس خودکار طور پر حساب کرتا ہے۔

بڑے ڈیٹا سیٹس کی تیز سیگمنٹیشن کے لیے GPU کی سفارش کی جاتی ہے، لیکن چھوٹے تجزیوں کے لیے CPU پروسیسنگ بھی دستیاب ہے۔

جی ہاں، Napari GUI کے انضمام سے سیگمنٹیشن ماسکس کی انٹرایکٹو اصلاحات اور بہتر درستگی کے لیے دستی ترمیم ممکن ہے، خاص طور پر مشکل علاقوں میں۔

Ilastik

| ڈیولپر | یورپی مالیکیولر بایولوجی لیبارٹری (EMBL) کی Ilastik ٹیم اور متعلقہ تعلیمی شراکت دار |

| معاون پلیٹ فارمز |

|

| زبان | انگریزی |

| قیمت | مفت اور اوپن سورس |

جائزہ

Ilastik ایک طاقتور، AI سے چلنے والا آلہ ہے جو خوردبین کے ڈیٹا کی انٹرایکٹو امیج سیگمنٹیشن، درجہ بندی، اور تجزیہ کے لیے استعمال ہوتا ہے۔ رینڈم فاریسٹ کلاسیفائرز جیسے مشین لرننگ تکنیکوں کا استعمال کرتے ہوئے، یہ محققین کو پکسلز کو سیگمنٹ کرنے، آبجیکٹس کی درجہ بندی کرنے، وقت کے ساتھ سیلز کو ٹریک کرنے، اور 2D اور 3D ڈیٹا سیٹس میں ڈینسٹی کاؤنٹنگ کرنے کی سہولت دیتا ہے۔ اپنی آسان انٹرفیس اور حقیقی وقت فیڈبیک کے ساتھ، Ilastik سائنسدانوں کے لیے قابل رسائی ہے جنہیں پروگرامنگ کی مہارت حاصل نہیں اور یہ سیل بایولوجی، نیوروسائنس، اور بایومیڈیکل امیجنگ میں وسیع پیمانے پر استعمال ہوتا ہے۔

اہم خصوصیات

نمائندہ علاقوں کی تشریح کرتے ہوئے فوری سیگمنٹیشن کے نتائج کے لیے حقیقی وقت فیڈبیک۔

سیگمنٹ کیے گئے ڈھانچوں کو مورفولوجیکل اور شدت کی خصوصیات کی بنیاد پر درجہ بند کریں۔

2D اور 3D ٹائم-لیپس خوردبین تجربات میں سیل کی حرکت اور تقسیم کو ٹریک کریں۔

انفرادی آبجیکٹس کی واضح سیگمنٹیشن کے بغیر گنجان علاقوں کی مقدار کا اندازہ لگائیں۔

پیچیدہ 3D والیومز کے لیے نیم خودکار سیگمنٹیشن، آسان انٹرایکشن کے ساتھ۔

ہیڈلیس کمانڈ لائن موڈ کے ذریعے متعدد تصاویر کو خودکار طریقے سے پروسیس کریں۔

ڈاؤن لوڈ

شروعاتی رہنما

اپنے آپریٹنگ سسٹم کے لیے Ilastik کو سرکاری ویب سائٹ سے ڈاؤن لوڈ کریں۔ پیکیج میں تمام ضروری پائتھن انحصارات شامل ہیں، لہٰذا اپنے پلیٹ فارم کے لیے تنصیب کی ہدایات پر عمل کریں۔

Ilastik کھولیں اور اپنا تجزیاتی ورک فلو منتخب کریں: پکسل کی درجہ بندی، آبجیکٹ کی درجہ بندی، ٹریکنگ، یا ڈینسٹی کاؤنٹنگ۔ اپنا امیج ڈیٹا سیٹ لوڈ کریں، جو کثیر چینل، 3D، یا ٹائم-لیپس تصاویر پر مشتمل ہو سکتا ہے۔

اپنی تصاویر میں چند نمائندہ پکسلز یا آبجیکٹس کو لیبل کریں۔ Ilastik کا رینڈم فاریسٹ کلاسیفائر ان تشریحات سے سیکھتا ہے اور خودکار طور پر پورے ڈیٹا سیٹ میں لیبلز کی پیش گوئی کرتا ہے۔

تربیت یافتہ ماڈل کو اپنے مکمل ڈیٹا سیٹ پر لاگو کریں تاکہ سیگمنٹیشن یا درجہ بندی کی جا سکے۔ نتائج کو لیبل شدہ تصاویر، احتمال کے نقشے، یا مقداری جدولوں کی صورت میں برآمد کریں تاکہ بعد کی تجزیہ اور بصری نمائندگی کے لیے استعمال کیا جا سکے۔

Ilastik کے ہیڈلیس موڈ کا استعمال کرتے ہوئے متعدد تصاویر کو بغیر دستی مداخلت کے خودکار طریقے سے پروسیس کریں، جو بڑے پیمانے پر تجزیاتی پائپ لائنز کے لیے مثالی ہے۔

حدود اور غور و فکر

- انٹرایکٹو لیبلنگ بہت بڑے ڈیٹا سیٹس کے لیے وقت طلب ہو سکتی ہے

- درستگی صارف کی تشریحات کے معیار اور نمائندگی پر منحصر ہے

- میموری کی ضروریات — بہت اعلیٰ ریزولوشن یا کثیر گیگابائٹ ڈیٹا سیٹس کے لیے نمایاں RAM کی ضرورت ہو سکتی ہے

- پیچیدہ ڈیٹا — رینڈم فاریسٹ کلاسیفائرز گہرے نیورل نیٹ ورکس کے مقابلے میں متغیر یا پیچیدہ امیجنگ ڈیٹا پر کم مؤثر ہو سکتے ہیں

اکثر پوچھے جانے والے سوالات

جی ہاں، Ilastik مکمل طور پر 3D والیومز اور ٹائم-لیپس تجربات کی حمایت کرتا ہے تاکہ سیگمنٹیشن، ٹریکنگ، اور متعدد وقت پوائنٹس پر مقداری تجزیہ کیا جا سکے۔

جی ہاں، Ilastik مکمل طور پر مفت اور اوپن سورس ہے، اور تمام صارفین کے لیے بغیر لائسنس کی پابندیوں کے دستیاب ہے۔

نہیں، Ilastik ایک آسان گرافیکل انٹرفیس فراہم کرتا ہے جس میں حقیقی وقت فیڈبیک شامل ہے، جو محققین کے لیے بغیر پروگرامنگ مہارت کے قابل رسائی ہے۔ ماہر صارفین کمانڈ لائن بیچ پروسیسنگ بھی استعمال کر سکتے ہیں۔

جی ہاں، مخصوص ٹریکنگ ورک فلو سیل کی حرکت اور تقسیم کا تجزیہ 2D اور 3D ٹائم-لیپس ڈیٹا سیٹس میں خودکار نسل کی ٹریکنگ کے ساتھ ممکن بناتا ہے۔

سیگمنٹیشن کے نتائج کو لیبل شدہ تصاویر، احتمال کے نقشے، یا مقداری جدولوں کی صورت میں برآمد کیا جا سکتا ہے، جو بعد کی تجزیہ اور بصری نمائندگی کے اوزار کے ساتھ آسانی سے ضم ہو جاتے ہیں۔

یہ آلات نو آموز سے ماہر سطح تک پھیلے ہوئے ہیں۔ بہت سے مفت اور اوپن سورس ہیں، جو تحقیق کی کمیونٹی میں AI ورک فلو کی قابل تکرار اور قابل اشتراک سہولت فراہم کرتے ہیں۔

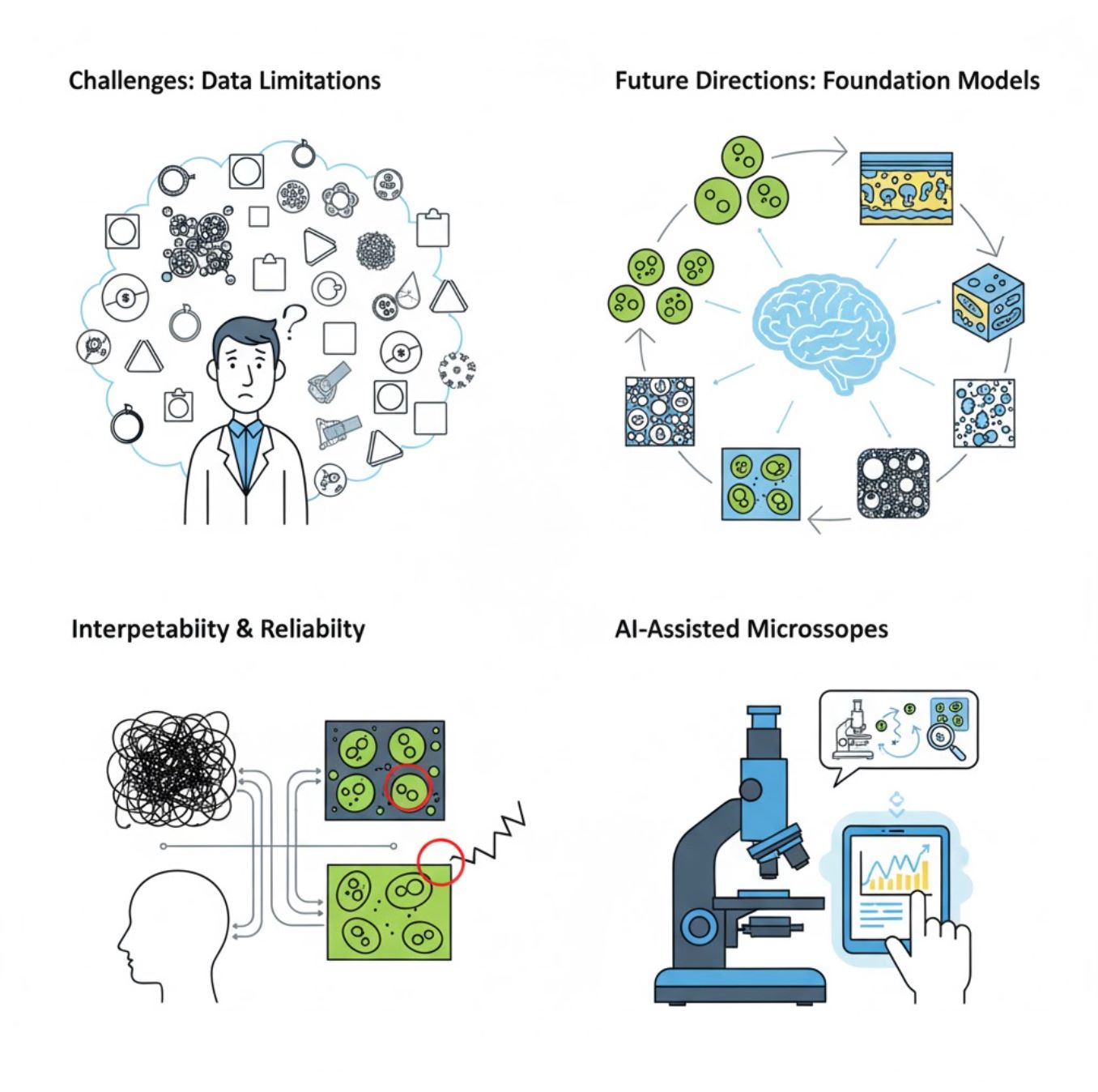

چیلنجز اور مستقبل کے رجحانات

موجودہ چیلنجز

ابھرتے ہوئے رجحانات

ویژن فاؤنڈیشن ماڈلز

اگلی نسل کے AI نظام مخصوص کام کی تربیت کی ضرورت کو کم کرنے کا وعدہ کرتے ہیں۔

- SAM اور CLIP پر مبنی ماڈلز جیسے

- ایک AI کئی مائیکروسکوپی کام سنبھالتا ہے

- تیز تر تعیناتی اور موافقت

AI معاون مائیکروسکوپ

مکمل خود مختار اور ذہین مائیکروسکوپی نظام حقیقت بنتے جا رہے ہیں۔

- LLMs کے ذریعے قدرتی زبان کا کنٹرول

- مکمل خودکار فیڈ بیک لوپس

- جدید مائیکروسکوپی تک رسائی کو جمہوری بنانا

اہم نکات

- مصنوعی ذہانت تیزی سے مائیکروسکوپ امیج پروسیسنگ کو بہتر درستگی اور خودکاری کے ساتھ بدل رہی ہے

- گہری تعلیم پیچیدہ، متغیر مائیکروسکوپی تصاویر پر روایتی مشین لرننگ سے بہتر کارکردگی دکھاتی ہے

- CNNs خام پکسلز سے درجہ بندی شدہ خصوصیات خود بخود سیکھتے ہیں تاکہ مضبوط تجزیہ ممکن ہو

- اہم اطلاقات میں تقسیم، درجہ بندی، ٹریکنگ، شور کی کمی، اور خودکار حصول شامل ہیں

- کامیابی کا انحصار معیاری ڈیٹا اور ماہرین کی محتاط تصدیق پر ہے

- ویژن فاؤنڈیشن ماڈلز اور AI معاون مائیکروسکوپ اس میدان کا مستقبل ہیں

مسلسل ترقیات اور کمیونٹی کی کوششوں (اوپن سورس آلات، مشترکہ ڈیٹا سیٹس) کے ساتھ، AI مائیکروسکوپ کی "آنکھ" کا ایک بنیادی حصہ بنتا جائے گا، سائنسدانوں کی مدد کرے گا کہ وہ پوشیدہ چیزوں کو دیکھ سکیں۔

No comments yet. Be the first to comment!