顕微鏡画像処理におけるAI

AIは、精密なセグメンテーション、ノイズ除去、超解像、自動画像取得などの強力な機能で顕微鏡画像処理を革新しています。本記事では、科学研究における重要なAIツールと新たなトレンドを紹介します。

AI技術は、画像取得の最適化と解析の自動化により顕微鏡学を革新しています。最新のスマート顕微鏡では、AIモジュールが撮影パラメータ(例:焦点、照明)をリアルタイムで調整し、光退色を最小限に抑え信号を強化します。一方、ディープラーニングアルゴリズムは複雑な画像データから隠れた生物学的知見を抽出し、画像と他のデータ(例:ゲノミクス)を結びつけることも可能です。

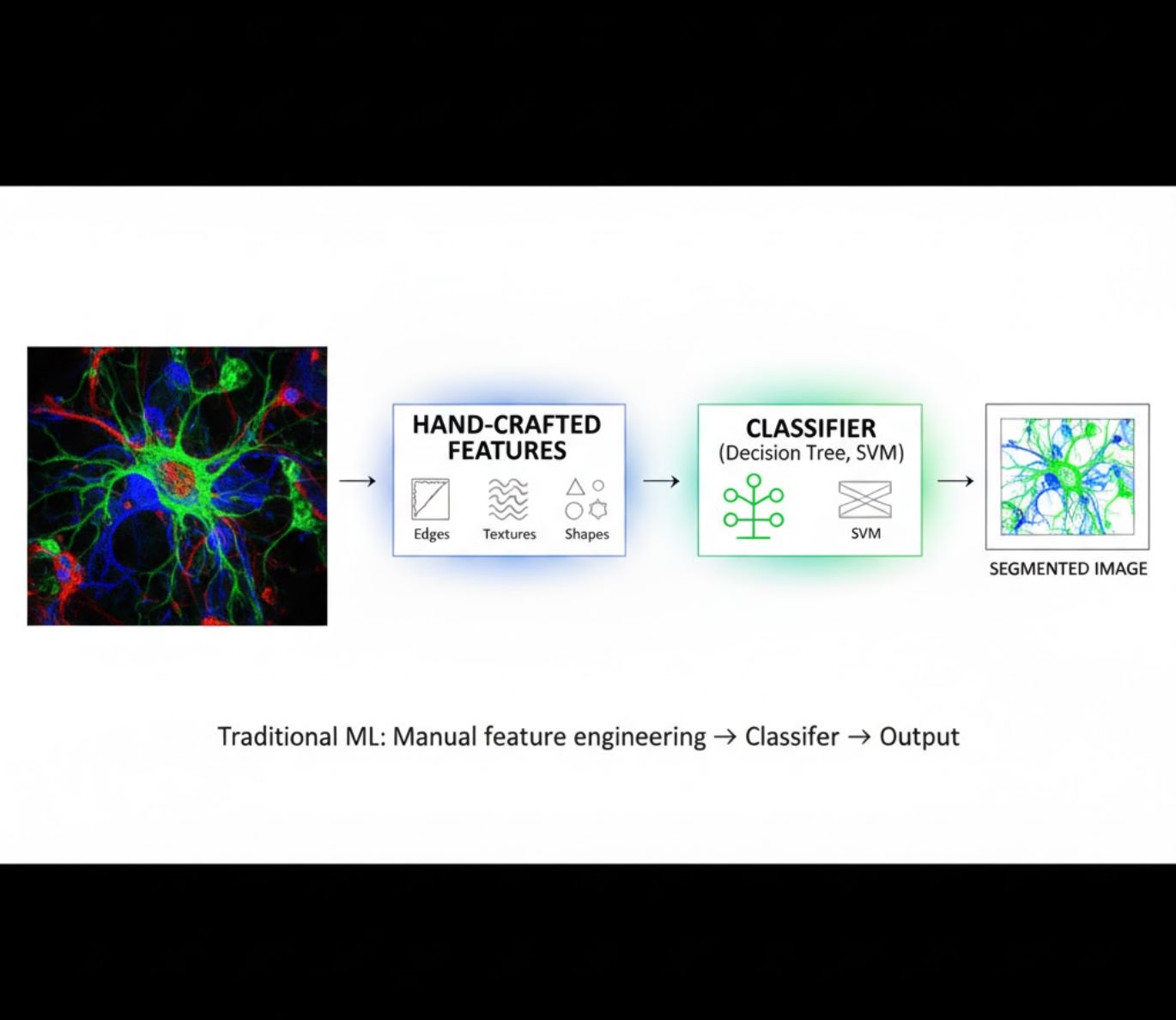

AI手法:機械学習とディープラーニングの比較

AI手法は、古典的な機械学習(ML)から最新のディープラーニング(DL)まで多岐にわたります。それぞれに特徴的な強みと制約があります:

手作り特徴量

- 研究者が手動で画像特徴(エッジ、テクスチャ、形状)を設計

- 特徴量を分類器(決定木、SVM)に入力

- 学習が高速

- 複雑またはノイズの多い画像には弱い

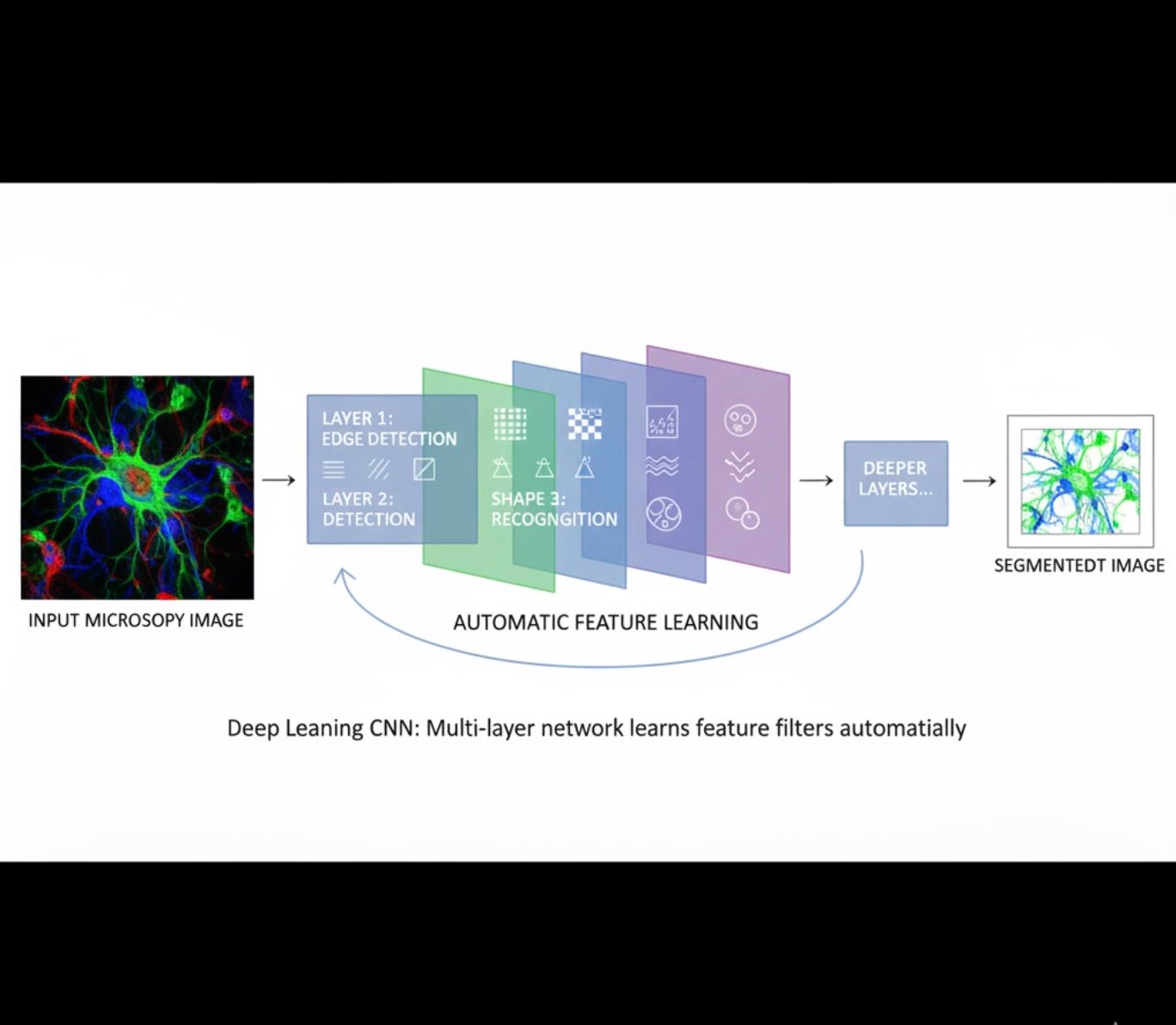

自動特徴学習

- 多層ニューラルネットワーク(CNN)が特徴を自動で学習

- 生のピクセルからエンドツーエンドで学習

- 変動に対して非常に頑健

- 複雑なテクスチャや構造を確実に捉える

CNNの仕組み:畳み込みニューラルネットワークは顕微鏡画像に連続的にフィルターを適用し、初期層で単純なパターン(エッジ)を、深い層で複雑な構造(細胞形状、テクスチャ)を検出することを学習します。この階層的学習により、強度プロファイルが大きく変動してもDLは非常に頑健です。

視覚的比較:MLとDLのパイプライン

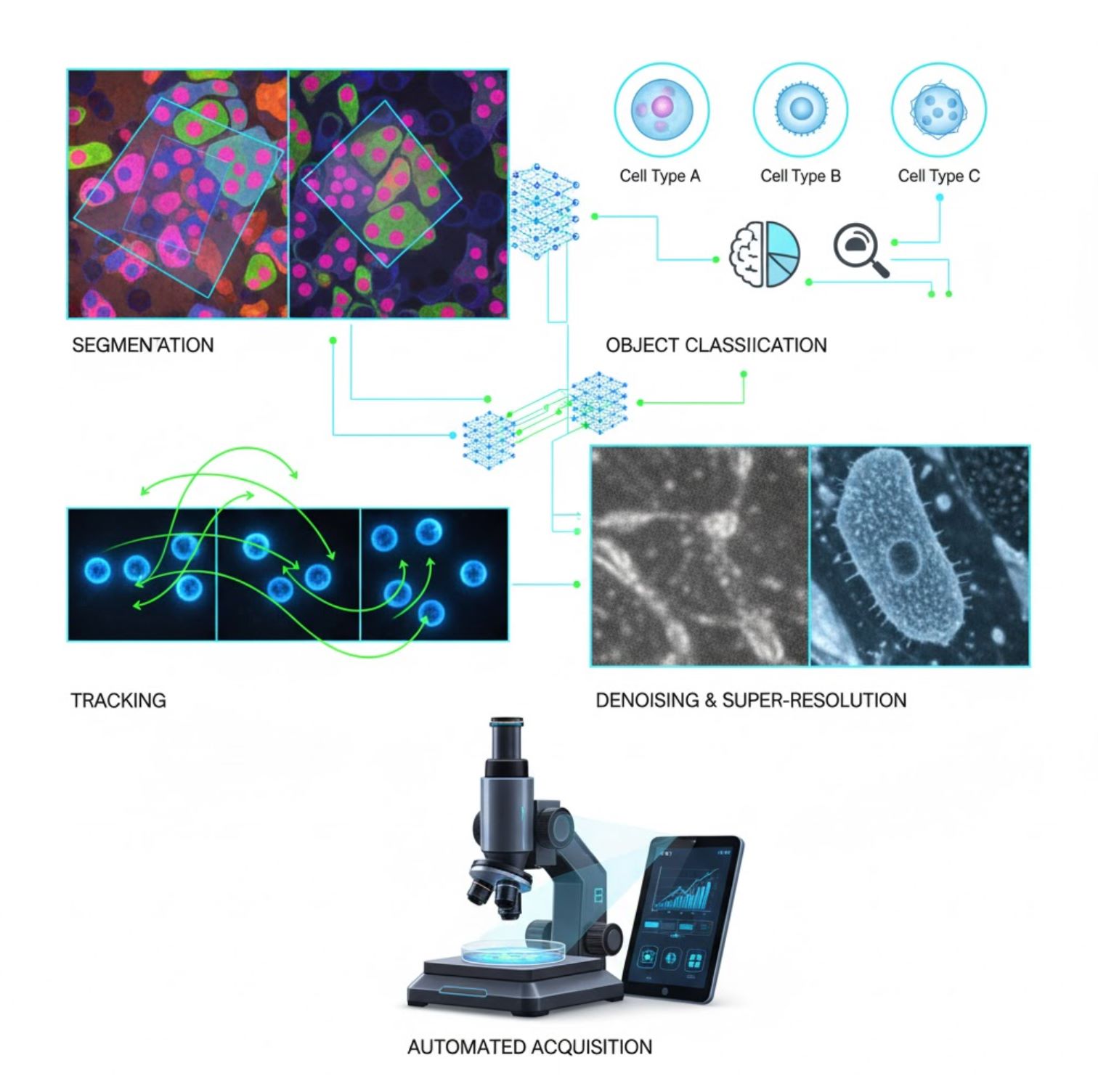

顕微鏡における主要なAI応用

AIは現在、顕微鏡の画像処理ワークフローの多くのタスクに組み込まれています:

セグメンテーション

画像を領域に分割(例:細胞や核の個別識別)。U-Netのような深層ネットワークがこのタスクに優れています。

- セマンティックセグメンテーション:ピクセル単位のクラスラベル付け

- インスタンスセグメンテーション:個々のオブジェクトの分離

- 混雑や暗い画像でも高精度

- μSAMなどのビジョン基盤モデルが顕微鏡向けに適応中

オブジェクト分類

セグメンテーション後、AIは各オブジェクトを高精度で分類します。

- 細胞タイプの識別

- 有糸分裂段階の判定

- 病理指標の検出

- 手動では定量困難な微細な表現型を区別

トラッキング

タイムラプス顕微鏡では、AIがフレーム間で細胞や粒子を前例のない精度で追跡します。

- ディープラーニングによりトラッキング精度が大幅向上

- 動く細胞の信頼性の高い解析を実現

- 動的な生物学的プロセスを捉える

ノイズ除去&超解像

AIモデルはノイズやぼやけを除去し画像品質を向上させます。

- 物理知識を組み込んだ深層モデルが顕微鏡光学を学習

- より鮮明でアーティファクトのない画像を再構築

- 従来法より高解像度かつアーティファクト低減

自動取得

AIがリアルタイムで顕微鏡を制御します。

- ライブ画像を解析し賢明な判断を下す

- 自動で焦点調整や関心領域のスキャンを実施

- 光毒性を軽減し時間を節約

- ハイスループットかつ適応的なイメージング実験を可能に

顕微鏡画像処理で人気のAIツール

顕微鏡観察におけるAIを支える豊富なツールのエコシステムが整っています。研究者の手により、汎用性の高いものから専門的なものまで、多くのオープンソースソフトウェアが開発されています。

Cellpose

| 開発者 | Carsen Stringer と Marius Pachitariu(MouseLand研究グループ) |

| 対応プラットフォーム |

Python(pip/condaインストール)が必要です。GUIはデスクトップのみ対応。 |

| 言語サポート | 英語ドキュメント;世界中の研究室で広く採用されています |

| 価格モデル | BSD-3-Clauseライセンスの無料オープンソース |

概要

Cellposeは、顕微鏡画像向けに設計された高度な深層学習ベースのセグメンテーションツールです。汎用アルゴリズムとして、モデルの再学習を必要とせずに多様な細胞タイプ(核、細胞質など)や異なるイメージングモダリティに対して正確にセグメント化します。人間の介入機能により、研究者は結果を微調整し、モデルを自身のデータに適応させ、2Dおよび3Dのイメージングワークフローに適用できます。

主な特徴

カスタムトレーニングなしで、多様な細胞タイプ、染色法、イメージングモダリティに対応可能です。

2Dモデルを再利用する「2.5D」アプローチで、フル3Dスタックをサポートします。

セグメンテーション結果を手動で修正し、カスタムデータでモデルを再学習させて精度を向上させます。

Python API、コマンドラインインターフェース、グラフィカルユーザーインターフェースからアクセス可能で柔軟なワークフローに対応します。

セグメンテーション前に画像のノイズ除去、ぼかし除去、アップサンプリングを行い画質を向上させます。

ダウンロードまたはアクセス

技術的背景

Cellposeは、Stringer、Wang、Michaelos、Pachitariuによる画期的な研究で発表され、7万以上のセグメント化されたオブジェクトを含む大規模かつ多様なデータセットで学習されました。この多様性により、細胞の形状やサイズ、顕微鏡の設定を超えてモデルが汎用化され、多くのケースでカスタムトレーニングの必要性を大幅に削減しています。3Dデータに対しては、完全な3D注釈付きトレーニングデータを必要とせず、2Dモデルを「2.5D」方式で巧みに再利用し、体積的なセグメンテーションを実現しています。Cellpose 2.0では人間の介入による再学習が導入され、ユーザーが予測を手動で修正し、自身の画像で再学習させることで特定のデータセットに対する性能を向上させることが可能です。

インストールとセットアップ

condaを使ってPython環境をセットアップします:

conda create -n cellpose python=3.10環境をアクティベートし、Cellposeをインストールします:

# For GUI support

pip install cellpose[gui]

# For minimal setup (API/CLI only)

pip install cellposeはじめに

GUIモード

- 次のコマンドでGUIを起動します:

python -m cellpose - 画像ファイル(

.tif、.pngなど)をインターフェースにドラッグ&ドロップ - モデルタイプを選択(例:「cyto」は細胞質、「nuclei」は核)

- 推定細胞直径を設定するか、Cellposeに自動調整させる

- セグメンテーションを開始し、結果を表示

Python APIモード

from cellpose import models

# Load model

model = models.Cellpose(model_type='cyto')

# Segment images

masks, flows = model.eval(images, diameter=30)微調整と再学習

- マスク生成後、GUIでマスクを手動で結合または削除してセグメンテーションを修正

- 組み込みのトレーニング機能を使い、修正済みの例で再学習

- 特定のデータセットでモデル性能が向上

3Dデータの処理

- マルチZ TIFFまたは体積スタックを読み込む

- GUIまたはAPIで

--Zstackフラグを使い3Dとして処理 - 必要に応じてスムージングや専用パラメータで3Dフローを微調整し、セグメンテーションを改善

制限事項と注意点

- モデルの汎用性とトレードオフ:汎用モデルは広範囲に対応しますが、非常に特殊な細胞形状やイメージング条件では再学習が必要になることがあります。

- アノテーションの手間:人間の介入によるトレーニングは手動修正が必要で、大規模データセットでは時間がかかる場合があります。

- インストールの複雑さ:GUIのインストールにはコマンドライン操作、conda環境の管理、Python依存関係の調整が必要で、プログラミング経験のない方には必ずしも簡単ではありません。

- デスクトップ専用:Cellposeはデスクトップ利用を想定しており、ネイティブのAndroidやiOSアプリは提供されていません。

よくある質問

いいえ — Cellposeは事前学習済みの汎用モデルを提供しており、多くの場合再学習なしで十分に機能します。ただし、特殊または異常なデータで最適な結果を得るには、人間の介入機能を使ってアノテーションを行い再学習することが可能です。

はい — 2Dモデルを再利用する「2.5D」方式で3Dをサポートしており、GUIやAPIを通じて体積スタックを処理できます。

高速な推論やトレーニングにはGPUが強く推奨されます。特に大規模または3Dデータセットの場合はGPUがあると便利ですが、CPUのみの環境でも動作しますが速度は遅くなります。

GUIでは推定細胞直径を手動で設定するか、Cellposeに自動調整させることができます。セグメンテーションが最適でない場合は結果を微調整し、再学習も可能です。

はい — 新しいバージョン(Cellpose 3)には、ノイズ除去、ぼかし除去、アップサンプリングを行う画像復元モデルが含まれており、処理前に画像品質を向上させることができます。

StarDist

| 開発者 | ウーヴェ・シュミット、マーティン・ワイガート、コールマン・ブロードダス、ジーン・マイヤーズ |

| 対応プラットフォーム |

|

| 言語サポート | オープンソースプロジェクトで、ドキュメントとコミュニティは主に英語です |

| 価格モデル | 無料かつオープンソース。BSD-3-Clauseライセンスの下で提供されています |

概要

StarDistは顕微鏡画像のインスタンスセグメンテーションのための深層学習ツールです。各オブジェクト(細胞核など)を2Dの星形凸多角形または3Dの多面体として表現し、密集または重なり合ったオブジェクトの正確な検出と分離を可能にします。その堅牢なアーキテクチャにより、蛍光顕微鏡、組織病理学、その他のバイオイメージ解析で広く利用されています。

主な特徴

星形凸多角形(2D)および多面体(3D)を用いた高精度なインスタンスセグメンテーションで信頼性の高いオブジェクト検出を実現。

2D画像と3Dボリュームデータの両方に対応した専用モデルで包括的な顕微鏡解析をサポート。

蛍光核、H&E染色組織など、一般的なイメージングシナリオ向けのすぐに使えるモデルを提供。

検出したオブジェクトを単一のセグメンテーション実行で異なるクラス(例:異なる細胞タイプ)に分類可能。

ImageJ/Fiji、QuPath、napariとのシームレスな統合により、GUIベースのワークフローを簡単に実現。

精度、再現率、F1スコア、パノプティック品質など、包括的なインスタンスセグメンテーション評価を提供。

技術的背景

StarDistは2018年のMICCAI論文で初めて紹介され、固定された放射状レイに沿った距離と各ピクセルの物体確率を予測する革新的な手法により、星形凸形状の正確な再構築を可能にしました。このアプローチは、従来のピクセルベースやバウンディングボックス手法では分離が困難な密着したオブジェクトの信頼性の高いセグメンテーションを実現します。

最近の開発では、StarDistは組織病理学画像にも拡張され、核のセグメンテーションだけでなく検出オブジェクトのマルチクラス分類も可能になりました。この手法はCoNIC(大腸核識別およびカウント)チャレンジなどでトップパフォーマンスを達成しています。

ダウンロードまたはアクセス

インストールとセットアップ

StarDistの前提条件としてTensorFlow(バージョン1.xまたは2.x)をインストールしてください。

pipを使用してStarDistのPythonパッケージをインストールします:

pip install stardistnapariの場合:

pip install stardist-napariQuPathの場合: StarDist拡張機能を.jarファイルをQuPathにドラッグ&ドロップしてインストールしてください。

ImageJ/Fijiの場合: 組み込みのプラグインマネージャーまたはプラグインメニューから手動でインストール可能です。

セグメンテーションの実行

事前学習済みモデルを読み込み、画像を正規化して予測を実行します:

from stardist.models import StarDist2D

model = StarDist2D.from_pretrained('2D_versatile_fluo')

labels, details = model.predict_instances(image)napariで画像を開き、StarDistプラグインを選択し、事前学習済みまたはカスタムモデルを選んでGUIから直接予測を実行します。

プラグインメニューからStarDistプラグインを使用し、直感的なインターフェースで画像スタックにモデルを適用します。

拡張機能をインストール後、QuPathのスクリプトコンソールまたはグラフィカルインターフェースからStarDist検出を実行し、組織病理解析を行います。

トレーニングとファインチューニング

各オブジェクトが一意にラベル付けされた正解ラベル画像を作成してください。LabKit、QuPath、Fijiなどのアノテーションツールを使用してデータセットを準備します。

StarDistのPython APIを使用して、新しいモデルのトレーニングや既存モデルのカスタムデータによるファインチューニングを行います。

ポストプロセッシングオプション

- 非最大抑制(NMS)を適用して冗長な候補形状を除去

- StarDist OPP(オブジェクトポストプロセッシング)を使用して非星形凸形状のマスクを統合

制限事項と注意点

- 星形凸の仮定は、非常に非凸または不規則な形状を完全にはモデル化できない場合があります

- インストールの複雑さ:カスタムインストールには拡張機能のビルド用に対応するC++コンパイラが必要です

- GPUアクセラレーションは対応するTensorFlow、CUDA、cuDNNのバージョンに依存します

- 一部ユーザーはJava設定の問題によりImageJプラグインの実行で問題を報告しています

よくある質問

StarDistは蛍光、明視野、組織病理学(例:H&E染色)など多様な画像タイプに対応しており、柔軟な事前学習済みモデルと異なるイメージングモダリティへの適応性を備えています。

はい。StarDistは星形凸多面体を用いた3Dインスタンスセグメンテーションに対応しており、2D機能を拡張して完全な3D解析を可能にします。

必ずしも必要ではありません。事前学習済みモデルは多くの場合そのまま利用可能ですが、特殊または新規のデータの場合はアノテーションとカスタムモデルのトレーニングにより精度が大幅に向上します。

StarDistはnapari、ImageJ/Fiji、QuPathと統合されており、GUIからコーディング不要でセグメンテーションを実行できます。高度なワークフローにはPython APIの直接利用も可能です。

StarDistは精度、再現率、F1スコア、パノプティック品質などの一般的なインスタンスセグメンテーション指標を計算する組み込み機能を提供し、セグメンテーション性能を評価できます。

SAM

アプリケーション情報

| 開発者 | Meta AI Research (FAIR) |

| 対応デバイス |

|

| 言語と提供状況 | オープンソースの基盤モデルとして世界中で利用可能;ドキュメントは英語 |

| 価格 | 無料 — MetaのライセンスのもとGitHubおよびMIB統合で提供 |

概要

SAM(Segment Anything Model)は、Metaが開発した強力なAI基盤モデルで、画像内のほぼすべてのオブジェクトを対話的かつ自動的にセグメンテーション可能です。ポイント、バウンディングボックス、ラフマスクなどのプロンプトを用いて、タスク固有の再学習なしにセグメンテーションマスクを生成します。顕微鏡研究分野では、細胞セグメンテーション、細胞小器官検出、組織病理解析に適応され、プロンプト可能な汎用セグメンテーションツールとして研究者にスケーラブルなソリューションを提供しています。

詳細紹介

Metaによって11百万枚の画像、10億以上のマスクを用いて学習されたSAMは、新規ドメインに対して「ゼロショット」性能を発揮するプロンプト可能な基盤モデルとして設計されました。医療画像研究では、全スライド病理セグメンテーション、腫瘍検出、細胞核識別に評価されています。しかし、細胞核のような密集したインスタンスに対する性能はまちまちで、20回のクリックやボックスなど多くのプロンプトを用いても、複雑な顕微鏡画像ではゼロショットセグメンテーションが困難な場合があります。

この制約に対応するため、ドメイン固有の適応が進んでいます:

- SAMCell — 大規模顕微鏡データセットで微調整され、実験ごとの再学習なしに多様な細胞タイプで強力なゼロショットセグメンテーションを実現

- μSAM — 17,000枚以上の手動注釈付き顕微鏡画像で再学習され、小さな細胞構造の精度向上を図る

主な特徴

ポイント、ボックス、マスクを用いた柔軟な操作で精密な制御が可能。

新しい画像ドメインに対して微調整なしでセグメンテーションを実行。

少数ショットやプロンプトベースの再学習により、顕微鏡や組織病理に適応可能。

Microscopy Image Browser(MIB)で3Dおよび補間セグメンテーションに対応。

IDCC-SAMにより免疫細胞化学での手動注釈不要の自動細胞計数を実現。

ダウンロードまたはアクセス

ユーザーガイド

- Microscopy Image Browserを開き、SAMセグメンテーションパネルに移動

- Pythonインタープリターを設定し、SAM-1またはSAM-2モデルを選択

- GPUアクセラレーションには実行環境で「cuda」を選択(最適な性能のため推奨)

- ポイントプロンプト:オブジェクトをクリックしてポジティブシードを定義。Shift + クリックで拡張、Ctrl + クリックでネガティブシードを設定

- 3Dスタック:インタラクティブ3Dモードを使用。1スライスをクリックし、Shiftスクロールでスライス間のシードを補間

- 調整モード:マスクの置換、追加、減算、または新規レイヤー作成が可能

- MIBのSAM-2パネルの「Automatic everything」オプションで領域内のすべての可視オブジェクトをセグメント

- セグメンテーション後にマスクを確認し、必要に応じて修正

- プロンプトベースの微調整パイプライン(例:「All-in-SAM」)を用いて、疎なユーザープロンプトからピクセルレベルの注釈を生成

- 細胞計数には、SAMをゼロショットパイプラインと後処理で利用するIDCC-SAMを適用

- 高精度な細胞セグメンテーションには、顕微鏡細胞画像で微調整されたSAMCellを使用

制限事項と考慮点

- ドメイン調整なしでは密集または重複構造に対するゼロショット性能が不安定

- セグメンテーション品質はプロンプト設計と戦略に大きく依存

- GPUの使用を強く推奨;CPU推論は非常に遅い

- 超高解像度の全スライド画像や多スケール組織構造には苦戦

- 顕微鏡用途への微調整や適応には機械学習の専門知識が必要な場合あり

よくある質問

はい。SAMCellのような適応により、顕微鏡データセットでの細胞セグメンテーションタスクに特化してSAMを微調整しています。

必ずしもそうではありません。IDCC-SAMを使えば、手動注釈なしでゼロショット細胞計数が可能です。

プロンプトベースの微調整(例:「All-in-SAM」)や、17,000枚以上の注釈付き顕微鏡画像で学習したμSAMのような事前学習済み顕微鏡モデルを利用してください。

CPUでも動作可能ですが、実用的な推論速度とリアルタイムの対話型セグメンテーションにはGPUの使用を強く推奨します。

はい。MIBのSAM-2統合は、スライス間のシード補間による3Dセグメンテーションをサポートし、体積解析に対応しています。

AxonDeepSeg

| 開発者 | モントリオール工科大学およびモントリオール大学 NeuroPolyラボ |

| 対応プラットフォーム |

|

| 言語 | 英語ドキュメント;世界中で利用されているオープンソースツール |

| 価格 | 無料かつオープンソース |

概要

AxonDeepSegは、顕微鏡画像における軸索と髄鞘の自動セグメンテーションのためのAI搭載ツールです。畳み込みニューラルネットワークを用いて、TEM、SEM、明視野顕微鏡など複数の撮影モダリティにわたり、軸索、髄鞘、背景の3クラスを正確にセグメントします。軸索径、g比、髄鞘厚などの形態計測を自動化することで、神経科学研究における定量解析を効率化し、手動アノテーションの時間を大幅に削減し、再現性を向上させます。

主な特徴

TEM、SEM、明視野顕微鏡モダリティに最適化されたすぐに使えるモデル。

顕微鏡画像内の軸索、髄鞘、背景領域を正確に分類。

軸索径、g比、髄鞘厚、密度などの指標を自動計算。

Napari GUIとの統合により、セグメンテーションマスクの手動修正が可能で精度向上。

大規模な神経組織解析のためのカスタムパイプラインにシームレスに統合可能。

包括的なテストスクリプトにより、再現性と信頼性の高いセグメンテーション結果を保証。

技術詳細

NeuroPolyラボによって開発されたAxonDeepSegは、神経科学用途において高精度なセグメンテーションを実現する深層学習技術を活用しています。異なる顕微鏡モダリティ向けの事前学習済みモデルを提供し、多様な撮影技術に対応可能です。Napariとの統合により、難しいデータセットに対してもセグメンテーションマスクのインタラクティブな修正が可能で、精度を高めます。AxonDeepSegは主要な形態計測指標を算出し、神経組織構造や病理のハイスループット研究を支援します。Pythonベースのフレームワークにより、軸索および髄鞘形態の大規模解析用カスタムパイプラインへの組み込みが容易です。

ダウンロードまたはアクセス

インストールとセットアップ

Python 3.8以降がインストールされていることを確認し、pipを使ってAxonDeepSegとNapariをインストールしてください:

pip install axondeepseg napari提供されたテストスクリプトを実行し、すべてのコンポーネントが正しくインストールされ機能していることを確認してください。

TEM、SEM、または明視野の顕微鏡画像をNapariまたはPython環境にインポートしてください。

撮影モダリティに適した事前学習済みモデルを選択し、軸索および髄鞘のマスクを生成するためにセグメンテーションを実行してください。

軸索径、g比、密度、髄鞘厚などの形態計測値を自動計算し、結果をCSV形式でエクスポートします。

必要に応じてNapari GUIを使用し、セグメンテーションマスクを手動で調整、マスクの統合や削除を行い精度を向上させてください。

重要な注意点

- 未学習または新規の撮影モダリティでは性能が低下する可能性があります

- 複雑または難しい領域では手動修正が必要になる場合があります

- 大規模データセットの高速処理にはGPU推奨;CPU処理も対応可能です

よくある質問

AxonDeepSegは、TEM(透過型電子顕微鏡)、SEM(走査型電子顕微鏡)、および明視野顕微鏡に対応しており、それぞれのモダリティに最適化された事前学習済みモデルを提供しています。

はい、AxonDeepSegは完全に無料でオープンソースであり、学術利用および商用利用が可能です。

はい、AxonDeepSegはセグメント化された画像から軸索径、g比、髄鞘厚、密度などの指標を自動的に計算します。

大規模データセットの高速セグメンテーションにはGPUが推奨されますが、小規模解析ではCPU処理もサポートされています。

はい、Napari GUIとの統合により、難しい領域のセグメンテーションマスクをインタラクティブに修正・調整して精度を高めることが可能です。

Ilastik

| 開発者 | 欧州分子生物学研究所(EMBL)および関連する学術パートナーのIlastikチーム |

| 対応プラットフォーム |

|

| 言語 | 英語 |

| 価格 | 無料かつオープンソース |

概要

Ilastikは、顕微鏡データのインタラクティブな画像セグメンテーション、分類、解析のための強力なAI駆動ツールです。ランダムフォレスト分類器などの機械学習技術を用いて、ピクセルのセグメンテーション、オブジェクトの分類、細胞の時間経過追跡、密度カウントを2Dおよび3Dデータセットで可能にします。直感的なインターフェースとリアルタイムフィードバックにより、プログラミングの専門知識がない研究者にも利用しやすく、細胞生物学、神経科学、医用画像分野で広く採用されています。

主な特徴

代表的な領域を注釈することでリアルタイムにフィードバックを受け、即座にセグメンテーション結果を得られます。

形態学的特徴や強度特徴に基づいてセグメント化された構造を分類します。

2Dおよび3Dのタイムラプス顕微鏡実験で細胞の移動や分裂を追跡します。

個々のオブジェクトを明示的にセグメント化せずに混雑領域の数量を定量化します。

直感的な操作で複雑な3Dボリュームの半自動セグメンテーションを行います。

ヘッドレスのコマンドラインモードを使用して複数の画像を自動処理します。

ダウンロード

はじめにガイド

公式ウェブサイトからお使いのOS用のIlastikをダウンロードしてください。パッケージには必要なPython依存関係がすべて含まれているため、プラットフォームごとのインストール手順に従ってください。

Ilastikを開き、解析ワークフロー(ピクセル分類、オブジェクト分類、追跡、密度カウント)を選択します。マルチチャネル、3D、タイムラプス画像を含む画像データセットを読み込みます。

画像内の代表的なピクセルやオブジェクトにラベルを付けます。Ilastikのランダムフォレスト分類器はこれらの注釈から学習し、データセット全体に自動的にラベルを予測します。

学習済みモデルを適用してデータセット全体をセグメント化または分類します。結果はラベル付き画像、確率マップ、定量テーブルとしてエクスポートし、後続の解析や可視化に利用できます。

Ilastikのヘッドレスモードを使用して、手動操作なしで複数の画像を自動処理できます。大規模解析パイプラインに最適です。

制限事項と注意点

- インタラクティブなラベリングは非常に大きなデータセットでは時間がかかる場合があります

- 精度はユーザーの注釈の質と代表性に依存します

- メモリ要件 — 非常に高解像度または数ギガバイトのデータセットは大量のRAMを必要とする場合があります

- 複雑なデータ — ランダムフォレスト分類器は、変動が大きいまたは複雑な画像データに対して深層ニューラルネットワークより性能が劣る場合があります

よくある質問

はい、Ilastikは3Dボリュームおよびタイムラプス実験を完全にサポートしており、複数の時間点にわたるセグメンテーション、追跡、定量解析が可能です。

はい、Ilastikは完全に無料でオープンソースであり、ライセンス制限なくすべてのユーザーが利用できます。

いいえ、Ilastikは直感的なグラフィカルインターフェースとリアルタイムフィードバックを提供しており、プログラミングの専門知識がない研究者でも利用可能です。上級ユーザーはコマンドラインのバッチ処理も利用できます。

はい、専用の追跡ワークフローにより、2Dおよび3Dのタイムラプスデータセットで細胞の移動や分裂を解析し、自動的に系統を追跡できます。

セグメンテーションの出力は、ラベル付き画像、確率マップ、定量テーブルとしてエクスポートでき、後続の解析ツールや可視化ソフトウェアとシームレスに連携可能です。

これらのツールは初心者から専門家まで幅広く対応。多くは無料かつオープンソースで、研究コミュニティ間で再現可能かつ共有可能なAIワークフローを促進します。

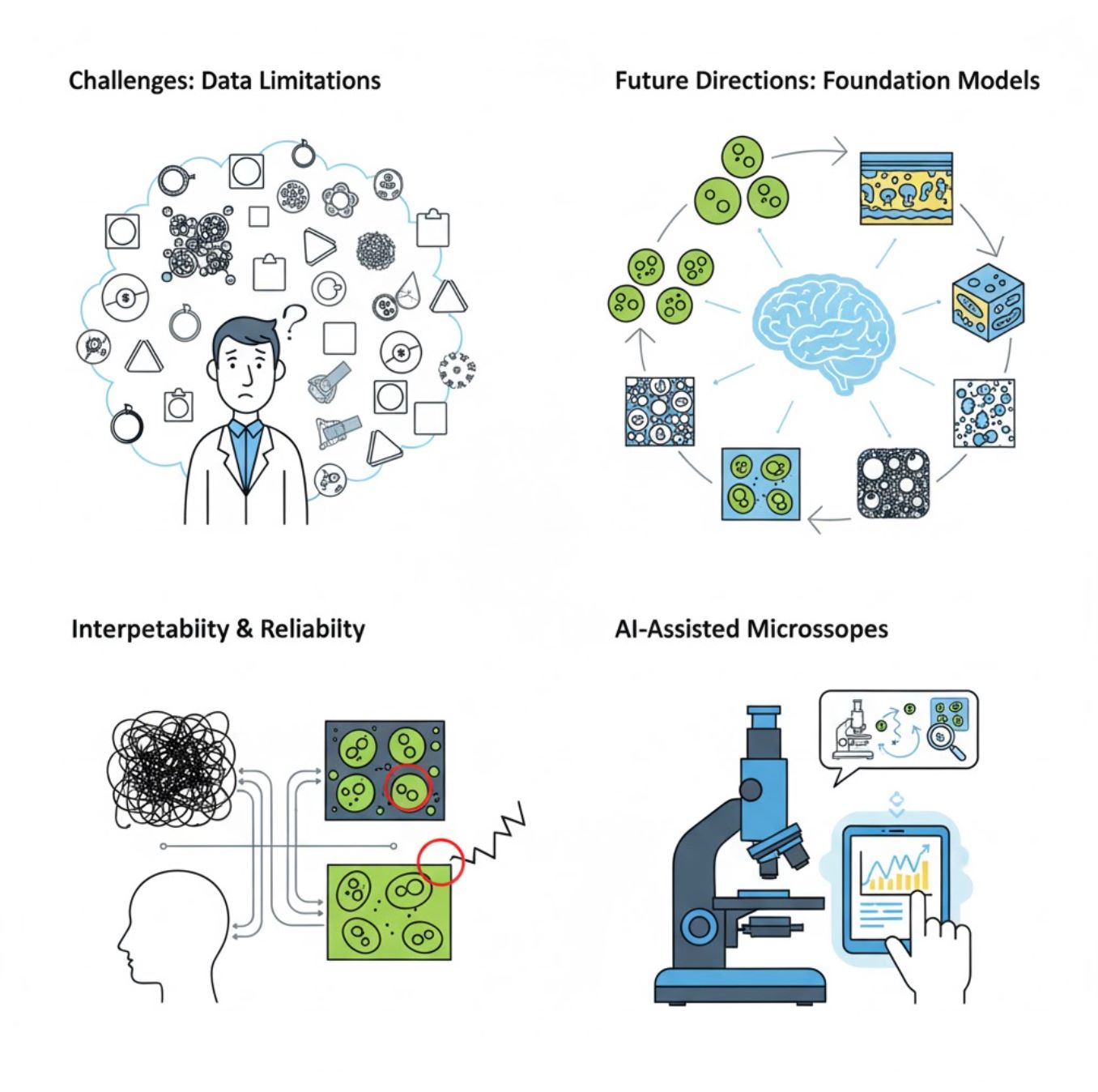

課題と今後の展望

現在の課題

新たなトレンド

ビジョン基盤モデル

次世代AIシステムは、タスク固有の学習を減らすことが期待されています。

- SAMやCLIPベースのモデル

- 1つのAIで多様な顕微鏡タスクを処理

- より迅速な展開と適応

AI支援顕微鏡

完全自律かつ知能的な顕微鏡システムが現実のものに。

- LLMによる自然言語制御

- 完全自動のフィードバックループ

- 高度な顕微鏡技術の民主化

主要ポイントまとめ

- AIは精度向上と自動化により顕微鏡画像処理を急速に変革中

- ディープラーニングは複雑で変動の大きい顕微鏡画像で従来の機械学習を上回る

- CNNは生のピクセルから階層的特徴を自動学習し堅牢な解析を実現

- 主要応用はセグメンテーション、分類、トラッキング、ノイズ除去、自動取得

- 成功には高品質データと専門家による慎重な検証が不可欠

- ビジョン基盤モデルとAI支援顕微鏡が今後の分野を牽引

オープンソースツールや共有データセットなどコミュニティの継続的な努力により、AIは顕微鏡の「目」として見えないものを科学者に見せる中核技術となっていくでしょう。

No comments yet. Be the first to comment!