AI trong xử lý hình ảnh kính hiển vi

AI đang cách mạng hóa xử lý hình ảnh kính hiển vi với các khả năng mạnh mẽ như phân đoạn chính xác, giảm nhiễu, siêu phân giải và tự động thu thập hình ảnh. Bài viết này làm nổi bật các công cụ AI thiết yếu và xu hướng mới nổi trong nghiên cứu khoa học.

Các kỹ thuật AI đang cách mạng hóa kính hiển vi bằng cách tối ưu hóa thu thập hình ảnh và tự động hóa phân tích. Trong các kính hiển vi thông minh hiện đại, các mô-đun AI có thể điều chỉnh tham số chụp ảnh ngay lập tức (ví dụ: lấy nét, chiếu sáng) để giảm thiểu phai màu và tăng cường tín hiệu. Trong khi đó, các thuật toán học sâu có thể lọc qua dữ liệu hình ảnh phức tạp để trích xuất các hiểu biết sinh học ẩn và thậm chí liên kết hình ảnh với các dữ liệu khác (ví dụ: gen học).

Phương pháp AI: Học máy và Học sâu

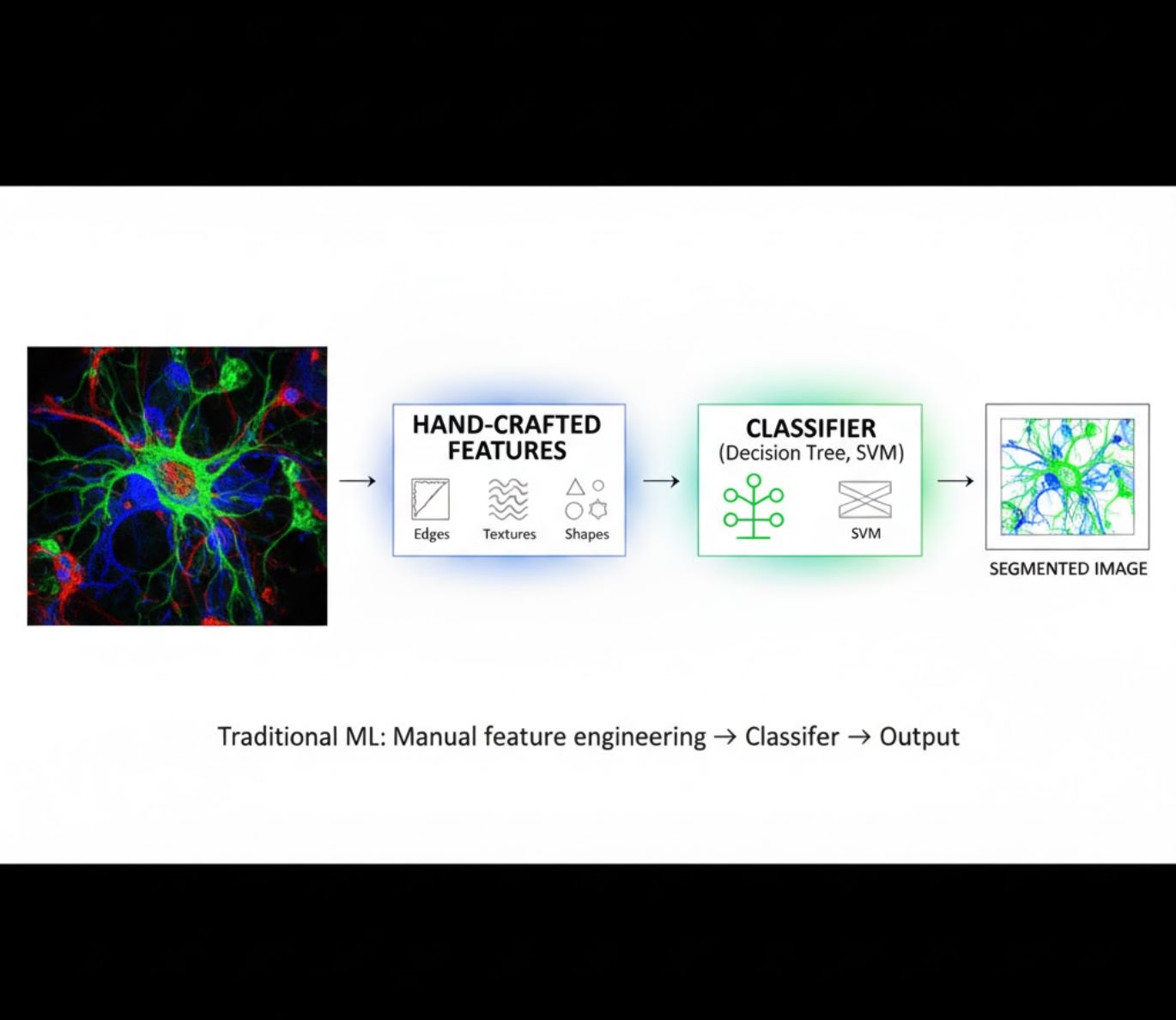

Các phương pháp AI trải dài từ học máy (ML) truyền thống đến học sâu (DL) hiện đại. Mỗi phương pháp có điểm mạnh và hạn chế riêng:

Đặc trưng thủ công

- Nhà nghiên cứu tự tay tạo đặc trưng hình ảnh (cạnh, kết cấu, hình dạng)

- Đặc trưng được đưa vào bộ phân loại (cây quyết định, SVM)

- Huấn luyện nhanh

- Khó xử lý hình ảnh phức tạp hoặc nhiều nhiễu

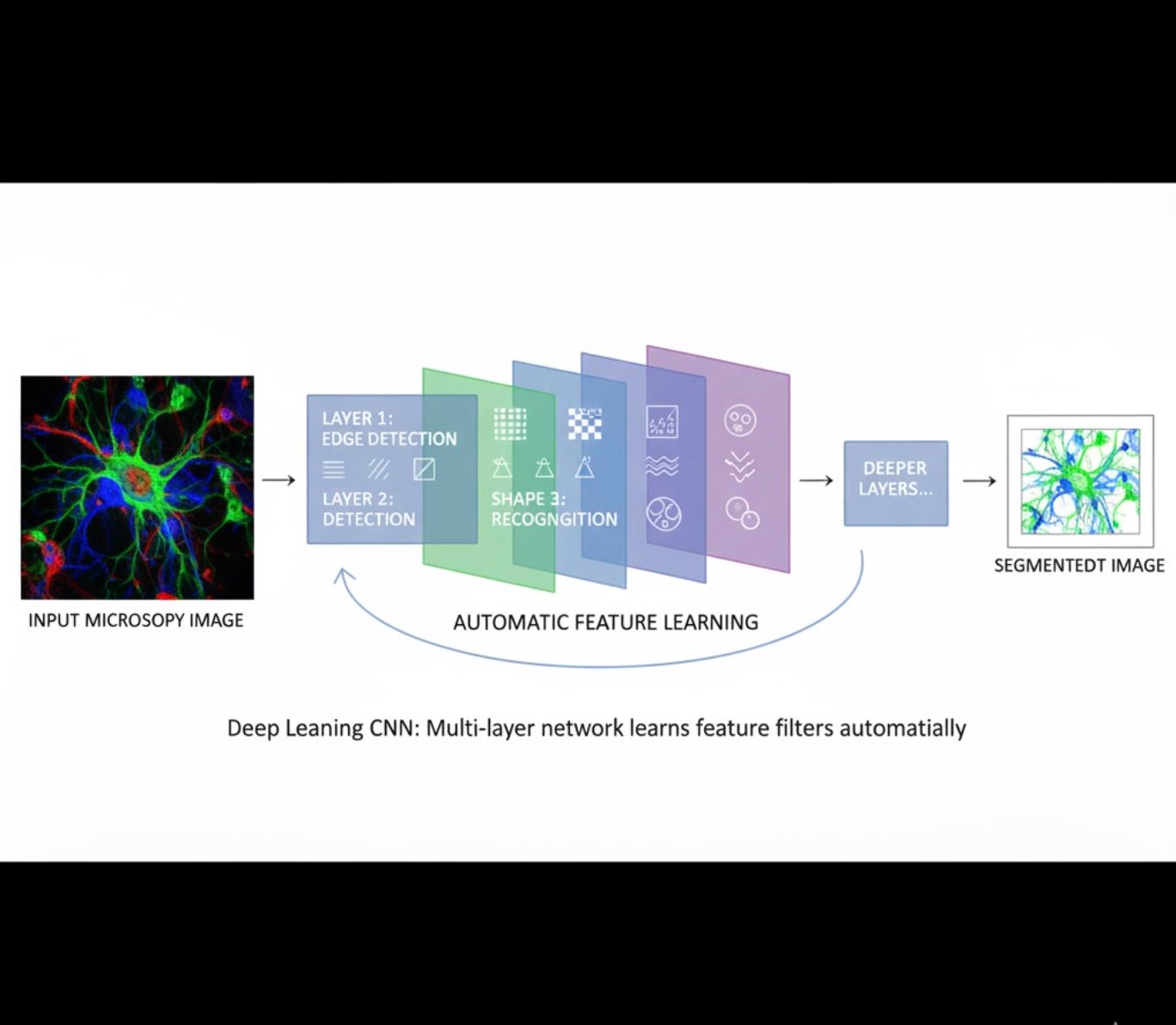

Học đặc trưng tự động

- Mạng nơ-ron đa lớp (CNN) tự học đặc trưng

- Học từ đầu đến cuối từ điểm ảnh thô

- Độ bền cao với biến đổi

- Bắt được kết cấu và cấu trúc phức tạp một cách tin cậy

Cách CNN hoạt động: Mạng nơ-ron tích chập áp dụng các bộ lọc liên tiếp lên hình ảnh kính hiển vi, học phát hiện các mẫu đơn giản (cạnh) ở lớp đầu và cấu trúc phức tạp (hình dạng tế bào, kết cấu) ở các lớp sâu hơn. Cách học phân cấp này giúp học sâu rất bền vững ngay cả khi cường độ ảnh thay đổi đáng kể.

So sánh trực quan: Quy trình ML và DL

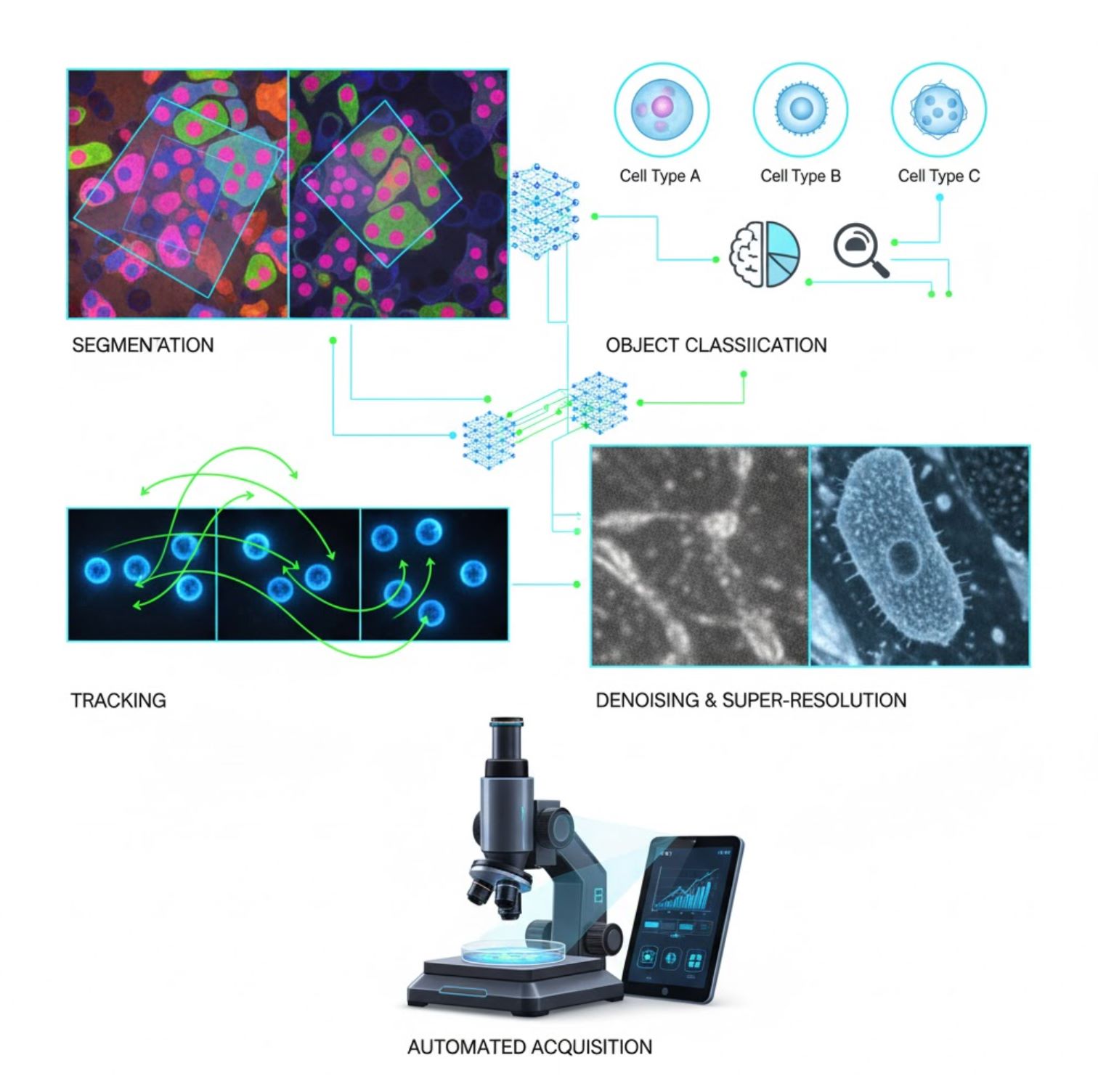

Ứng dụng AI chính trong kính hiển vi

AI hiện được tích hợp trong nhiều nhiệm vụ xử lý hình ảnh trong quy trình kính hiển vi:

Phân đoạn

Chia ảnh thành các vùng (ví dụ: xác định từng tế bào hoặc nhân). Mạng sâu như U-Net rất xuất sắc trong nhiệm vụ này.

- Phân đoạn ngữ nghĩa: Gán nhãn lớp cho từng điểm ảnh

- Phân đoạn thể hiện: Tách các đối tượng riêng biệt

- Độ chính xác cao trên ảnh đông đúc hoặc mờ

- Mô hình nền tảng thị giác (ví dụ: μSAM) hiện được điều chỉnh cho kính hiển vi

Phân loại đối tượng

Sau phân đoạn, AI phân loại từng đối tượng với độ chính xác cao.

- Xác định loại tế bào

- Xác định giai đoạn phân bào

- Phát hiện chỉ số bệnh lý

- Phân biệt các kiểu hình tinh vi khó định lượng thủ công

Theo dõi

Trong kính hiển vi thời gian thực, AI theo dõi tế bào hoặc hạt qua các khung hình với độ chính xác chưa từng có.

- Học sâu cải thiện đáng kể độ chính xác theo dõi

- Cho phép phân tích tin cậy các tế bào chuyển động

- Bắt được các quá trình sinh học động

Giảm nhiễu & Siêu phân giải

Mô hình AI nâng cao chất lượng ảnh bằng cách loại bỏ nhiễu và mờ.

- Mô hình học sâu dựa trên vật lý học quang học kính hiển vi

- Tái tạo ảnh sắc nét, không có hiện tượng giả

- Độ phân giải cao hơn với ít hiện tượng giả so với phương pháp truyền thống

Thu thập tự động

AI điều khiển kính hiển vi theo thời gian thực.

- Phân tích ảnh trực tiếp để đưa ra quyết định thông minh

- Tự động điều chỉnh lấy nét và quét vùng quan tâm

- Giảm độc tính quang học và tiết kiệm thời gian

- Cho phép thí nghiệm chụp ảnh tốc độ cao và thích ứng

Công cụ AI phổ biến trong xử lý hình ảnh kính hiển vi

Hệ sinh thái phong phú các công cụ hỗ trợ AI trong kính hiển vi. Các nhà nghiên cứu đã phát triển cả phần mềm đa năng và phần mềm chuyên dụng, nhiều trong số đó là mã nguồn mở:

Cellpose

| Nhà phát triển | Carsen Stringer và Marius Pachitariu (nhóm nghiên cứu MouseLand) |

| Nền tảng hỗ trợ |

Yêu cầu Python (cài đặt qua pip/conda). GUI chỉ có trên máy tính để bàn. |

| Hỗ trợ ngôn ngữ | Tài liệu tiếng Anh; được áp dụng rộng rãi trong các phòng thí nghiệm nghiên cứu toàn cầu |

| Mô hình giá | Miễn phí và mã nguồn mở theo giấy phép BSD-3-Clause |

Tổng quan

Cellpose là công cụ phân đoạn tiên tiến dựa trên học sâu, được thiết kế cho hình ảnh kính hiển vi. Là thuật toán đa năng, nó phân đoạn chính xác nhiều loại tế bào khác nhau (nhân, tế bào chất, v.v.) trên các phương thức chụp khác nhau mà không cần huấn luyện lại mô hình. Với khả năng có sự tham gia của người dùng, các nhà nghiên cứu có thể tinh chỉnh kết quả, điều chỉnh mô hình theo dữ liệu của họ và áp dụng hệ thống cho cả quy trình làm việc ảnh 2D và 3D.

Tính năng chính

Hoạt động ngay khi sử dụng cho nhiều loại tế bào, thuốc nhuộm và phương thức chụp mà không cần huấn luyện tùy chỉnh.

Hỗ trợ toàn bộ chồng ảnh 3D sử dụng phương pháp "2.5D" tái sử dụng mô hình 2D cho dữ liệu thể tích.

Chỉnh sửa thủ công kết quả phân đoạn và huấn luyện lại mô hình trên dữ liệu tùy chỉnh để tăng độ chính xác.

Truy cập qua API Python, giao diện dòng lệnh hoặc giao diện đồ họa để linh hoạt trong quy trình làm việc.

Khả năng khử nhiễu, làm nét và tăng kích thước ảnh để nâng cao chất lượng hình ảnh trước khi phân đoạn.

Tải về hoặc truy cập

Nền tảng kỹ thuật

Cellpose được giới thiệu trong một nghiên cứu quan trọng của Stringer, Wang, Michaelos và Pachitariu, được huấn luyện trên bộ dữ liệu lớn và rất đa dạng với hơn 70.000 đối tượng đã phân đoạn. Sự đa dạng này giúp mô hình tổng quát hóa trên các hình dạng, kích thước tế bào và các thiết lập kính hiển vi khác nhau, giảm đáng kể nhu cầu huấn luyện tùy chỉnh trong hầu hết các trường hợp sử dụng. Đối với dữ liệu 3D, Cellpose khéo léo tái sử dụng mô hình 2D theo cách "2.5D", tránh cần dữ liệu huấn luyện có chú thích 3D đầy đủ nhưng vẫn cung cấp phân đoạn thể tích. Cellpose 2.0 giới thiệu huấn luyện lại có sự tham gia của người dùng, cho phép người dùng chỉnh sửa thủ công dự đoán và huấn luyện lại trên hình ảnh của họ để cải thiện hiệu suất trên bộ dữ liệu cụ thể.

Cài đặt & Thiết lập

Thiết lập môi trường Python sử dụng conda:

conda create -n cellpose python=3.10Kích hoạt môi trường và cài đặt Cellpose:

# For GUI support

pip install cellpose[gui]

# For minimal setup (API/CLI only)

pip install cellposeBắt đầu sử dụng

Chế độ GUI

- Khởi chạy GUI bằng cách chạy:

python -m cellpose - Kéo thả các tệp ảnh (

.tif,.png, v.v.) vào giao diện - Chọn loại mô hình (ví dụ: "cyto" cho tế bào chất hoặc "nuclei" cho nhân tế bào)

- Đặt đường kính tế bào ước tính hoặc để Cellpose tự động hiệu chỉnh

- Nhấn để bắt đầu phân đoạn và xem kết quả

Chế độ API Python

from cellpose import models

# Load model

model = models.Cellpose(model_type='cyto')

# Segment images

masks, flows = model.eval(images, diameter=30)Tinh chỉnh & Huấn luyện lại

- Sau khi tạo mặt nạ, chỉnh sửa phân đoạn trong GUI bằng cách gộp hoặc xóa mặt nạ thủ công

- Sử dụng chức năng huấn luyện tích hợp để huấn luyện lại trên các ví dụ đã chỉnh sửa

- Cải thiện hiệu suất mô hình trên bộ dữ liệu cụ thể của bạn

Xử lý dữ liệu 3D

- Tải tệp TIFF đa Z hoặc chồng thể tích

- Sử dụng cờ

--Zstacktrong GUI hoặc API để xử lý như 3D - Tùy chọn tinh chỉnh luồng 3D qua làm mượt hoặc tham số chuyên biệt để phân đoạn tốt hơn

Hạn chế & Lưu ý

- Đánh đổi tính tổng quát của mô hình: Mặc dù mô hình đa năng hoạt động rộng rãi, các hình dạng tế bào hoặc điều kiện chụp rất đặc biệt có thể cần huấn luyện lại.

- Công sức chú thích: Huấn luyện có sự tham gia của người dùng đòi hỏi chỉnh sửa thủ công, có thể tốn thời gian với bộ dữ liệu lớn.

- Độ phức tạp khi cài đặt: Cài đặt GUI có thể yêu cầu sử dụng dòng lệnh, môi trường conda và quản lý phụ thuộc Python — không phải lúc nào cũng đơn giản với người không chuyên lập trình.

- Chỉ dành cho máy tính để bàn: Cellpose được thiết kế cho máy tính để bàn; không có ứng dụng gốc cho Android hoặc iOS.

Câu hỏi thường gặp

Không — Cellpose cung cấp các mô hình đa năng đã được huấn luyện sẵn, thường hoạt động tốt mà không cần huấn luyện lại. Tuy nhiên, để có kết quả tối ưu trên dữ liệu đặc biệt hoặc hiếm gặp, bạn có thể chú thích và huấn luyện lại bằng tính năng có sự tham gia của người dùng.

Có — nó hỗ trợ 3D bằng cách tái sử dụng mô hình 2D (gọi là "2.5D"), và bạn có thể chạy chồng thể tích qua GUI hoặc API.

GPU rất được khuyến khích để tăng tốc suy luận và huấn luyện, đặc biệt với bộ dữ liệu lớn hoặc 3D, nhưng Cellpose có thể chạy trên máy chỉ có CPU với hiệu suất chậm hơn.

Trong GUI, bạn có thể đặt đường kính tế bào ước tính thủ công hoặc để Cellpose tự động hiệu chỉnh. Bạn có thể tinh chỉnh kết quả và huấn luyện lại nếu phân đoạn chưa tối ưu.

Có — các phiên bản mới hơn (Cellpose 3) bao gồm mô hình phục hồi hình ảnh để khử nhiễu, làm nét và tăng kích thước ảnh nhằm cải thiện chất lượng phân đoạn trước khi xử lý.

StarDist

| Nhà phát triển | Uwe Schmidt, Martin Weigert, Coleman Broaddus, và Gene Myers |

| Nền tảng hỗ trợ |

|

| Hỗ trợ ngôn ngữ | Dự án mã nguồn mở với tài liệu và cộng đồng chủ yếu bằng tiếng Anh |

| Mô hình giá | Miễn phí và mã nguồn mở. Cấp phép theo BSD-3-Clause |

Tổng quan

StarDist là công cụ học sâu dùng để phân đoạn từng đối tượng trong ảnh kính hiển vi. Nó biểu diễn mỗi đối tượng (như nhân tế bào) dưới dạng đa giác sao lồi 2D hoặc đa diện sao lồi 3D, giúp phát hiện và tách biệt chính xác các đối tượng chồng chéo hoặc xếp chặt. Với kiến trúc mạnh mẽ, StarDist được sử dụng rộng rãi cho phân đoạn tự động tế bào và nhân trong kính hiển vi huỳnh quang, mô bệnh học và các ứng dụng phân tích ảnh sinh học khác.

Tính năng chính

Phân đoạn đối tượng chính xác cao sử dụng đa giác sao lồi (2D) và đa diện sao lồi (3D) để phát hiện đối tượng đáng tin cậy.

Mô hình chuyên biệt cho ảnh 2D và dữ liệu thể tích 3D phục vụ phân tích kính hiển vi toàn diện.

Mô hình sẵn sàng dùng cho nhân huỳnh quang, mô nhuộm H&E và các kịch bản chụp ảnh phổ biến khác.

Phân loại các đối tượng phát hiện thành các lớp riêng biệt (ví dụ: các loại tế bào khác nhau) trong một lần chạy phân đoạn.

Tích hợp mượt mà với ImageJ/Fiji, QuPath và napari cho quy trình làm việc dựa trên giao diện người dùng dễ tiếp cận.

Đánh giá phân đoạn đối tượng toàn diện bao gồm độ chính xác, độ thu hồi, điểm F1 và chất lượng panoptic.

Nền tảng kỹ thuật

Được giới thiệu lần đầu trong bài báo MICCAI 2018, đổi mới cốt lõi của StarDist là dự đoán khoảng cách xuyên tâm theo các tia cố định kết hợp với xác suất đối tượng cho từng điểm ảnh, cho phép tái tạo chính xác hình dạng sao lồi. Phương pháp này phân đoạn đáng tin cậy các đối tượng tiếp xúc gần nhau mà các phương pháp dựa trên điểm ảnh hoặc hộp giới hạn truyền thống khó tách biệt.

Phát triển gần đây đã mở rộng StarDist sang ảnh mô bệnh học, không chỉ phân đoạn nhân mà còn phân loại đa lớp các đối tượng phát hiện. Phương pháp này đạt hiệu suất hàng đầu trong các thử thách như CoNIC (Xác định và Đếm Nhân Đại Tràng).

Tải về hoặc truy cập

Cài đặt & Thiết lập

Cài đặt TensorFlow (phiên bản 1.x hoặc 2.x) làm điều kiện tiên quyết cho StarDist.

Sử dụng pip để cài đặt gói StarDist Python:

pip install stardistĐối với napari:

pip install stardist-napariĐối với QuPath: Cài đặt tiện ích mở rộng StarDist bằng cách kéo thả tệp .jar vào QuPath.

Đối với ImageJ/Fiji: Sử dụng trình quản lý plugin tích hợp hoặc cài đặt thủ công qua menu plugins.

Chạy phân đoạn

Tải mô hình đã huấn luyện, chuẩn hóa ảnh, và chạy dự đoán:

from stardist.models import StarDist2D

model = StarDist2D.from_pretrained('2D_versatile_fluo')

labels, details = model.predict_instances(image)Mở ảnh trong napari, chọn plugin StarDist, chọn mô hình đã huấn luyện hoặc tùy chỉnh, và chạy dự đoán trực tiếp từ giao diện người dùng.

Sử dụng plugin StarDist từ menu Plugins để áp dụng mô hình lên chuỗi ảnh với giao diện trực quan.

Sau khi cài tiện ích mở rộng, chạy phát hiện StarDist qua bảng điều khiển kịch bản hoặc giao diện đồ họa của QuPath cho phân tích mô bệnh học.

Huấn luyện & Tinh chỉnh

Tạo ảnh nhãn mặt nạ đúng, mỗi đối tượng được gán nhãn riêng biệt. Sử dụng công cụ chú thích như LabKit, QuPath hoặc Fiji để chuẩn bị bộ dữ liệu.

Dùng API Python của StarDist để huấn luyện mô hình mới hoặc tinh chỉnh mô hình hiện có với dữ liệu chú thích tùy chỉnh.

Tùy chọn hậu xử lý

- Áp dụng loại bỏ cực đại không tối đa (NMS) để loại bỏ các hình dạng ứng viên trùng lặp

- Sử dụng StarDist OPP (Hậu xử lý đối tượng) để hợp nhất mặt nạ cho các hình dạng không sao lồi

Hạn chế & Lưu ý

- Giả định sao lồi có thể không mô hình hóa hoàn hảo các hình dạng rất không lồi hoặc rất bất thường

- Phức tạp khi cài đặt: cài đặt tùy chỉnh cần trình biên dịch C++ tương thích để xây dựng tiện ích mở rộng

- Tăng tốc GPU phụ thuộc vào phiên bản TensorFlow, CUDA và cuDNN tương thích

- Một số người dùng báo lỗi khi chạy plugin ImageJ do cấu hình Java

Câu hỏi thường gặp

StarDist làm việc với nhiều loại ảnh bao gồm huỳnh quang, sáng truyền qua, và mô bệnh học (ví dụ: H&E), nhờ các mô hình đã huấn luyện linh hoạt và khả năng thích ứng với nhiều phương thức chụp ảnh khác nhau.

Có — StarDist hỗ trợ phân đoạn đối tượng 3D sử dụng đa diện sao lồi cho dữ liệu thể tích, mở rộng khả năng 2D sang phân tích 3D đầy đủ.

Không nhất thiết. Có sẵn các mô hình đã huấn luyện và thường hoạt động tốt ngay khi sử dụng. Tuy nhiên, với dữ liệu chuyên biệt hoặc mới, việc chú thích và huấn luyện mô hình tùy chỉnh sẽ cải thiện đáng kể độ chính xác.

StarDist tích hợp với napari, ImageJ/Fiji, và QuPath, cho phép bạn chạy phân đoạn qua giao diện người dùng mà không cần lập trình. Nó cũng hỗ trợ sử dụng API Python trực tiếp cho các quy trình nâng cao.

StarDist cung cấp các hàm tích hợp để tính các chỉ số phân đoạn phổ biến như độ chính xác, độ thu hồi, điểm F1 và chất lượng panoptic nhằm đánh giá hiệu suất phân đoạn.

SAM

Thông Tin Ứng Dụng

| Nhà Phát Triển | Meta AI Research (FAIR) |

| Thiết Bị Hỗ Trợ |

|

| Ngôn Ngữ & Khả Dụng | Mô hình nền tảng mã nguồn mở có sẵn toàn cầu; tài liệu bằng tiếng Anh |

| Giá Cả | Miễn phí — mã nguồn mở theo giấy phép của Meta qua GitHub và tích hợp MIB |

Tổng Quan Chung

SAM (Segment Anything Model) là một mô hình nền tảng AI mạnh mẽ do Meta tạo ra, cho phép phân đoạn tương tác và tự động hầu như bất kỳ đối tượng nào trong hình ảnh. Sử dụng các lời nhắc như điểm, hộp giới hạn hoặc mặt nạ thô, SAM tạo ra mặt nạ phân đoạn mà không cần đào tạo lại cho nhiệm vụ cụ thể. Trong nghiên cứu kính hiển vi, tính linh hoạt của SAM đã được điều chỉnh để phân đoạn tế bào, phát hiện bào quan và phân tích mô bệnh học, cung cấp giải pháp mở rộng cho các nhà nghiên cứu cần công cụ phân đoạn đa năng có thể điều khiển bằng lời nhắc.

Giới Thiệu Chi Tiết

Ban đầu được Meta đào tạo trên hơn 1 tỷ mặt nạ trải dài trên 11 triệu hình ảnh, SAM được thiết kế như một mô hình nền tảng có thể điều khiển bằng lời nhắc với hiệu suất "zero-shot" trên các lĩnh vực mới. Trong nghiên cứu hình ảnh y tế, SAM đã được đánh giá cho phân đoạn toàn bộ lát cắt mô bệnh học, phát hiện khối u và nhận dạng nhân tế bào. Tuy nhiên, hiệu suất trên các đối tượng dày đặc—như nhân tế bào—còn chưa ổn định: ngay cả với nhiều lời nhắc (ví dụ, 20 lần nhấp hoặc hộp), phân đoạn zero-shot vẫn gặp khó khăn trong các hình ảnh kính hiển vi phức tạp.

Để khắc phục hạn chế này, các điều chỉnh chuyên ngành đã được phát triển:

- SAMCell — Tinh chỉnh trên bộ dữ liệu kính hiển vi lớn để phân đoạn zero-shot mạnh mẽ trên nhiều loại tế bào mà không cần đào tạo lại cho từng thí nghiệm

- μSAM — Đào tạo lại trên hơn 17.000 hình ảnh kính hiển vi được chú thích thủ công nhằm cải thiện độ chính xác trên các cấu trúc tế bào nhỏ

Các Tính Năng Chính

Tương tác linh hoạt sử dụng điểm, hộp và mặt nạ để kiểm soát chính xác.

Thực hiện phân đoạn mà không cần tinh chỉnh trên các lĩnh vực hình ảnh mới.

Có thể điều chỉnh cho kính hiển vi và mô bệnh học qua đào tạo lại ít dữ liệu hoặc dựa trên lời nhắc.

Có trong Microscopy Image Browser (MIB) với hỗ trợ phân đoạn 3D và nội suy.

IDCC-SAM cho phép đếm tế bào tự động trong miễn dịch tế bào mà không cần chú thích thủ công.

Tải Về hoặc Truy Cập

Hướng Dẫn Sử Dụng

- Mở Microscopy Image Browser và điều hướng đến bảng phân đoạn SAM

- Cấu hình trình thông dịch Python và chọn giữa các mô hình SAM-1 hoặc SAM-2

- Để tăng tốc GPU, chọn "cuda" trong môi trường thực thi (khuyến nghị để đạt hiệu suất tối ưu)

- Lời nhắc điểm: Nhấp vào đối tượng để xác định điểm dương; dùng Shift + nhấp để mở rộng và Ctrl + nhấp cho điểm âm

- Chuỗi 3D: Sử dụng chế độ 3D tương tác—nhấp vào một lát cắt, cuộn shift và nội suy điểm trên các lát cắt

- Chế độ điều chỉnh: Thay thế, thêm, bớt mặt nạ hoặc tạo lớp mới khi cần

- Sử dụng tùy chọn "Tự động mọi thứ" trong bảng SAM-2 của MIB để phân đoạn tất cả đối tượng hiển thị trong vùng

- Xem lại và chỉnh sửa mặt nạ sau khi phân đoạn nếu cần

- Sử dụng các quy trình tinh chỉnh dựa trên lời nhắc (ví dụ, "All-in-SAM") để tạo chú thích cấp pixel từ lời nhắc người dùng thưa thớt

- Đối với đếm tế bào, áp dụng IDCC-SAM, sử dụng SAM trong quy trình zero-shot với xử lý hậu kỳ

- Để phân đoạn tế bào chính xác cao, dùng SAMCell, đã được tinh chỉnh trên hình ảnh tế bào kính hiển vi

Hạn Chế & Lưu Ý

- Hiệu suất zero-shot không ổn định trên các cấu trúc dày đặc hoặc chồng chéo nếu không tinh chỉnh chuyên ngành

- Chất lượng phân đoạn phụ thuộc nhiều vào thiết kế và chiến lược lời nhắc

- Khuyến nghị sử dụng GPU; phân tích trên CPU rất chậm

- Gặp khó khăn với hình ảnh toàn bộ lát cắt độ phân giải rất cao và cấu trúc mô đa quy mô

- Cần có kiến thức về học máy để tinh chỉnh hoặc điều chỉnh SAM cho kính hiển vi

Câu Hỏi Thường Gặp

Có—qua các điều chỉnh như SAMCell, tinh chỉnh SAM trên bộ dữ liệu kính hiển vi chuyên biệt cho nhiệm vụ phân đoạn tế bào.

Không phải lúc nào cũng cần. Với IDCC-SAM, bạn có thể đếm tế bào zero-shot mà không cần chú thích thủ công.

Sử dụng tinh chỉnh dựa trên lời nhắc (ví dụ, "All-in-SAM") hoặc các phiên bản kính hiển vi đã được đào tạo trước như μSAM, được huấn luyện trên hơn 17.000 hình ảnh kính hiển vi có chú thích.

Mặc dù có thể chạy trên CPU, GPU được khuyến nghị mạnh mẽ để đạt tốc độ suy luận thực tế và phân đoạn tương tác thời gian thực.

Có—tích hợp SAM-2 trong MIB hỗ trợ phân đoạn 3D với nội suy điểm trên các lát cắt để phân tích thể tích.

AxonDeepSeg

| Nhà phát triển | NeuroPoly Lab tại Polytechnique Montréal và Université de Montréal |

| Nền tảng hỗ trợ |

|

| Ngôn ngữ | Tài liệu tiếng Anh; công cụ mã nguồn mở được sử dụng toàn cầu |

| Giá cả | Miễn phí và mã nguồn mở |

Tổng quan

AxonDeepSeg là công cụ sử dụng AI để tự động phân đoạn trục thần kinh và myelin trong hình ảnh kính hiển vi. Sử dụng mạng nơ-ron tích chập, nó cung cấp phân đoạn chính xác ba lớp (trục thần kinh, myelin, nền) trên nhiều phương thức hình ảnh bao gồm TEM, SEM và kính hiển vi trường sáng. Bằng cách tự động hóa các phép đo hình thái học như đường kính trục thần kinh, tỷ lệ g và độ dày myelin, AxonDeepSeg giúp đơn giản hóa phân tích định lượng trong nghiên cứu thần kinh học, giảm đáng kể thời gian chú thích thủ công và nâng cao khả năng tái lập.

Tính năng chính

Mô hình sẵn sàng sử dụng, tối ưu cho các phương thức kính hiển vi TEM, SEM và trường sáng.

Phân loại chính xác các vùng trục thần kinh, myelin và nền trong hình ảnh kính hiển vi.

Tự động tính toán đường kính trục thần kinh, tỷ lệ g, độ dày myelin và các chỉ số mật độ.

Tích hợp giao diện Napari cho phép tinh chỉnh thủ công mặt nạ phân đoạn nhằm nâng cao độ chính xác.

Dễ dàng tích hợp vào các quy trình tùy chỉnh cho phân tích mô thần kinh quy mô lớn.

Các kịch bản kiểm thử toàn diện đảm bảo khả năng tái lập và kết quả phân đoạn đáng tin cậy.

Chi tiết kỹ thuật

Được phát triển bởi NeuroPoly Lab, AxonDeepSeg tận dụng học sâu để cung cấp phân đoạn chính xác cao cho các ứng dụng khoa học thần kinh. Các mô hình đã được huấn luyện sẵn cho nhiều phương thức kính hiển vi khác nhau, đảm bảo tính linh hoạt trên các kỹ thuật hình ảnh. Công cụ tích hợp với Napari, cho phép chỉnh sửa tương tác mặt nạ phân đoạn, nâng cao độ chính xác trên các bộ dữ liệu khó. AxonDeepSeg tính toán các chỉ số hình thái học quan trọng, hỗ trợ các nghiên cứu quy mô lớn về cấu trúc và bệnh lý mô thần kinh. Khung làm việc dựa trên Python giúp tích hợp dễ dàng vào các quy trình tùy chỉnh cho phân tích hình thái trục thần kinh và myelin.

Tải về hoặc truy cập

Cài đặt & Thiết lập

Đảm bảo đã cài Python 3.8 trở lên, sau đó cài AxonDeepSeg và Napari bằng pip:

pip install axondeepseg napariChạy các kịch bản kiểm thử được cung cấp để xác nhận tất cả thành phần đã được cài đặt và hoạt động đúng.

Nhập hình ảnh kính hiển vi (TEM, SEM hoặc trường sáng) vào Napari hoặc môi trường Python của bạn.

Chọn mô hình đã huấn luyện phù hợp với phương thức hình ảnh và chạy phân đoạn để tạo mặt nạ trục thần kinh và myelin.

Tự động tính toán các chỉ số hình thái học bao gồm đường kính trục thần kinh, tỷ lệ g, mật độ và độ dày myelin, sau đó xuất kết quả dưới dạng CSV.

Sử dụng giao diện Napari để điều chỉnh thủ công mặt nạ phân đoạn khi cần, hợp nhất hoặc xóa mặt nạ nhằm nâng cao độ chính xác.

Những lưu ý quan trọng

- Hiệu suất có thể giảm khi áp dụng cho các phương thức hình ảnh mới hoặc chưa được huấn luyện

- Có thể cần chỉnh sửa thủ công cho các vùng phức tạp hoặc khó phân đoạn

- Khuyến nghị sử dụng GPU để xử lý nhanh bộ dữ liệu lớn; CPU cũng được hỗ trợ cho các phân tích nhỏ hơn

Câu hỏi thường gặp

AxonDeepSeg hỗ trợ TEM (Kính hiển vi điện tử truyền qua), SEM (Kính hiển vi điện tử quét) và kính hiển vi trường sáng với các mô hình đã huấn luyện tối ưu cho từng phương thức.

Có, AxonDeepSeg hoàn toàn miễn phí và mã nguồn mở, có thể sử dụng cho mục đích học thuật và thương mại.

Có, AxonDeepSeg tự động tính toán đường kính trục thần kinh, tỷ lệ g, độ dày myelin và các chỉ số mật độ từ hình ảnh đã phân đoạn.

Khuyến nghị sử dụng GPU để phân đoạn nhanh các bộ dữ liệu lớn, nhưng CPU cũng được hỗ trợ cho các phân tích nhỏ hơn.

Có, tích hợp giao diện Napari cho phép chỉnh sửa tương tác và tinh chỉnh mặt nạ phân đoạn để nâng cao độ chính xác trên các vùng khó.

Ilastik

| Nhà phát triển | Nhóm Ilastik tại Phòng thí nghiệm Sinh học Phân tử Châu Âu (EMBL) và các đối tác học thuật liên kết |

| Nền tảng hỗ trợ |

|

| Ngôn ngữ | Tiếng Anh |

| Giá cả | Miễn phí và mã nguồn mở |

Tổng quan

Ilastik là công cụ mạnh mẽ, dựa trên trí tuệ nhân tạo, dùng để phân đoạn ảnh tương tác, phân loại và phân tích dữ liệu kính hiển vi. Sử dụng các kỹ thuật học máy như bộ phân loại Random Forest, nó cho phép các nhà nghiên cứu phân đoạn điểm ảnh, phân loại đối tượng, theo dõi tế bào theo thời gian và thực hiện đếm mật độ trên cả dữ liệu 2D và 3D. Với giao diện trực quan và phản hồi thời gian thực, Ilastik dễ tiếp cận với các nhà khoa học không chuyên về lập trình và được ứng dụng rộng rãi trong sinh học tế bào, khoa học thần kinh và hình ảnh y sinh.

Tính năng chính

Phản hồi thời gian thực khi bạn chú thích các vùng đại diện để có kết quả phân đoạn ngay lập tức.

Phân loại các cấu trúc đã phân đoạn dựa trên đặc trưng hình thái và cường độ.

Theo dõi chuyển động và phân chia tế bào trong các thí nghiệm kính hiển vi thời gian trôi 2D và 3D.

Định lượng các vùng đông đúc mà không cần phân đoạn rõ ràng từng đối tượng.

Phân đoạn bán tự động cho các thể tích 3D phức tạp với tương tác trực quan.

Xử lý nhiều ảnh tự động bằng chế độ dòng lệnh không giao diện.

Tải về

Hướng dẫn bắt đầu

Tải Ilastik cho hệ điều hành của bạn từ trang web chính thức. Gói phần mềm bao gồm tất cả các thư viện Python cần thiết, hãy làm theo hướng dẫn cài đặt cho nền tảng của bạn.

Mở Ilastik và chọn quy trình phân tích: Phân loại điểm ảnh, Phân loại đối tượng, Theo dõi hoặc Đếm mật độ. Tải bộ dữ liệu ảnh của bạn, có thể bao gồm ảnh đa kênh, 3D hoặc thời gian trôi.

Gán nhãn một vài điểm ảnh hoặc đối tượng đại diện trong ảnh. Bộ phân loại Random Forest của Ilastik sẽ học từ các chú thích này và tự động dự đoán nhãn trên toàn bộ bộ dữ liệu.

Áp dụng mô hình đã huấn luyện để phân đoạn hoặc phân loại toàn bộ bộ dữ liệu. Xuất kết quả dưới dạng ảnh đã gán nhãn, bản đồ xác suất hoặc bảng số liệu để phân tích và trực quan hóa tiếp theo.

Sử dụng chế độ không giao diện của Ilastik để tự động xử lý nhiều ảnh mà không cần can thiệp thủ công, rất phù hợp cho các quy trình phân tích quy mô lớn.

Hạn chế & Lưu ý

- Gán nhãn tương tác có thể tốn thời gian đối với các bộ dữ liệu rất lớn

- Độ chính xác phụ thuộc vào chất lượng và tính đại diện của các chú thích người dùng

- Yêu cầu bộ nhớ — các bộ dữ liệu độ phân giải rất cao hoặc dung lượng nhiều gigabyte có thể cần RAM lớn

- Dữ liệu phức tạp — bộ phân loại Random Forest có thể hoạt động kém hơn so với mạng nơ-ron sâu trên dữ liệu hình ảnh biến đổi hoặc phức tạp cao

Câu hỏi thường gặp

Có, Ilastik hoàn toàn hỗ trợ các thể tích 3D và thí nghiệm thời gian trôi cho phân đoạn, theo dõi và phân tích định lượng qua nhiều thời điểm.

Có, Ilastik hoàn toàn miễn phí và mã nguồn mở, dành cho tất cả người dùng mà không có giới hạn về giấy phép.

Không, Ilastik cung cấp giao diện đồ họa trực quan với phản hồi thời gian thực, giúp các nhà nghiên cứu không chuyên về lập trình cũng có thể sử dụng dễ dàng. Người dùng nâng cao cũng có thể sử dụng chế độ xử lý hàng loạt qua dòng lệnh.

Có, quy trình theo dõi chuyên biệt cho phép phân tích chuyển động và phân chia tế bào trên cả dữ liệu thời gian trôi 2D và 3D với theo dõi dòng dõi tự động.

Kết quả phân đoạn có thể được xuất dưới dạng ảnh đã gán nhãn, bản đồ xác suất hoặc bảng số liệu định lượng, cho phép tích hợp dễ dàng với các công cụ phân tích và phần mềm trực quan hóa tiếp theo.

Các công cụ này phù hợp từ người mới đến chuyên gia. Nhiều công cụ miễn phí và mã nguồn mở, giúp quy trình AI trong cộng đồng nghiên cứu dễ tái tạo và chia sẻ.

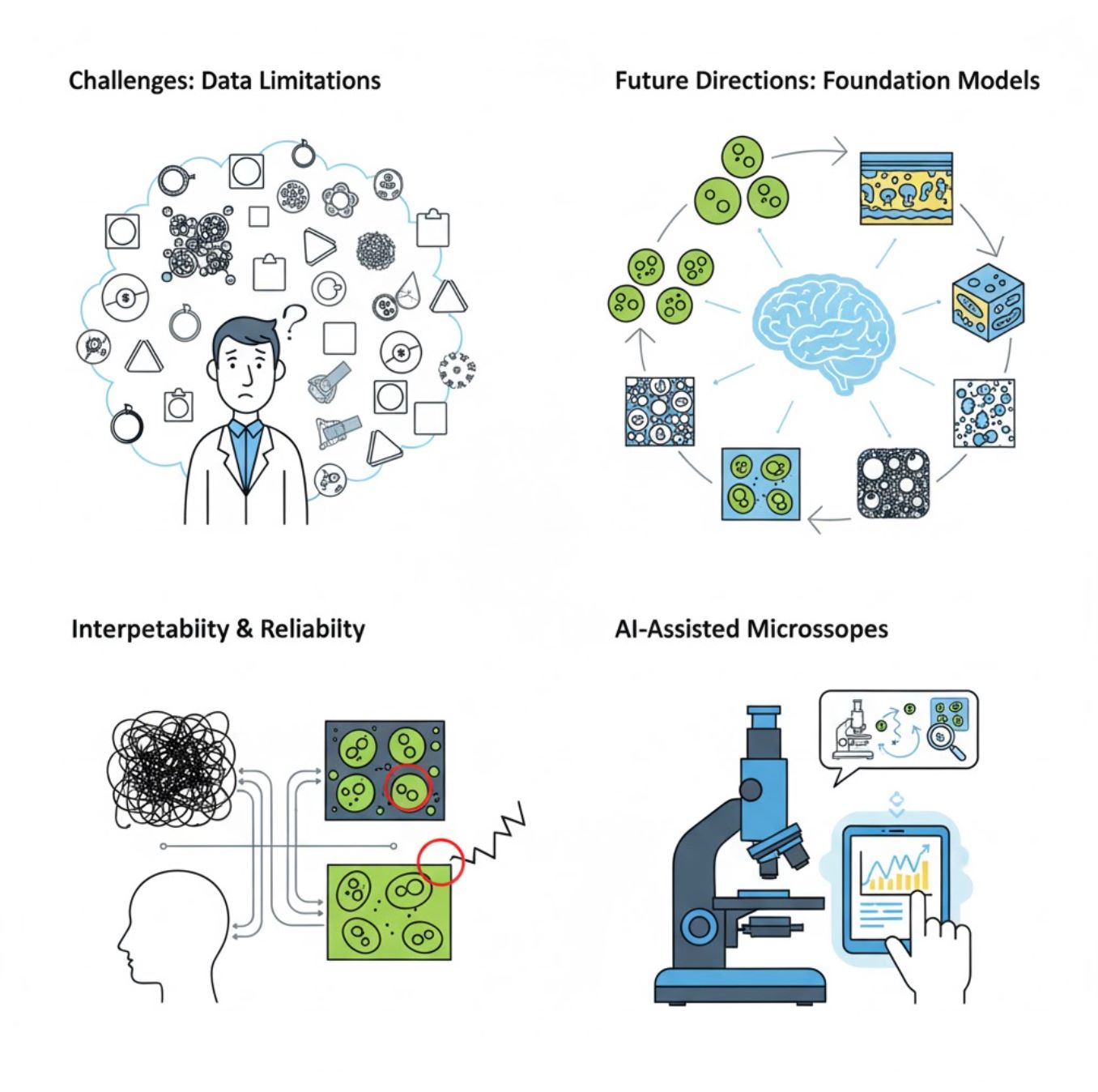

Thách thức và hướng phát triển tương lai

Thách thức hiện tại

Xu hướng mới nổi

Mô hình nền tảng thị giác

Hệ thống AI thế hệ mới hứa hẹn giảm nhu cầu huấn luyện theo từng nhiệm vụ cụ thể.

- Mô hình như SAM và hệ thống dựa trên CLIP

- Một AI xử lý nhiều nhiệm vụ kính hiển vi

- Triển khai và thích ứng nhanh hơn

Kính hiển vi hỗ trợ AI

Hệ thống kính hiển vi tự động và thông minh hoàn toàn đang trở thành hiện thực.

- Điều khiển bằng ngôn ngữ tự nhiên qua LLM

- Vòng phản hồi tự động hoàn toàn

- Phổ cập truy cập kính hiển vi tiên tiến

Những điểm chính cần nhớ

- AI đang nhanh chóng biến đổi xử lý hình ảnh kính hiển vi với độ chính xác và tự động hóa cải thiện

- Học sâu vượt trội học máy truyền thống trên ảnh kính hiển vi phức tạp và biến đổi

- CNN tự động học đặc trưng phân cấp từ điểm ảnh thô để phân tích bền vững

- Ứng dụng chính gồm phân đoạn, phân loại, theo dõi, giảm nhiễu và thu thập tự động

- Thành công phụ thuộc vào dữ liệu chất lượng và xác thực cẩn thận bởi chuyên gia

- Mô hình nền tảng thị giác và kính hiển vi hỗ trợ AI là tương lai của lĩnh vực

Với tiến bộ liên tục và nỗ lực cộng đồng (công cụ mã nguồn mở, bộ dữ liệu chia sẻ), AI sẽ ngày càng trở thành "đôi mắt" cốt lõi của kính hiển vi, giúp các nhà khoa học nhìn thấy những điều chưa từng thấy.

Chưa có bình luận nào. Hãy là người đầu tiên bình luận!