AI in microscoopbeeldverwerking

AI revolutioneert microscoopbeeldverwerking met krachtige mogelijkheden zoals nauwkeurige segmentatie, ruisonderdrukking, superresolutie en geautomatiseerde beeldacquisitie. Dit artikel belicht essentiële AI-tools en opkomende trends in wetenschappelijk onderzoek.

AI-technieken revolutioneren microscopie door beeldacquisitie te optimaliseren en analyse te automatiseren. In moderne slimme microscopen kunnen AI-modules beeldparameters realtime aanpassen (bijv. focus, verlichting) om fotobleking te minimaliseren en het signaal te verbeteren. Tegelijkertijd kunnen deep learning-algoritmen complexe beeldgegevens doorzoeken om verborgen biologische inzichten te extraheren en zelfs beelden te koppelen aan andere data (bijv. genomica).

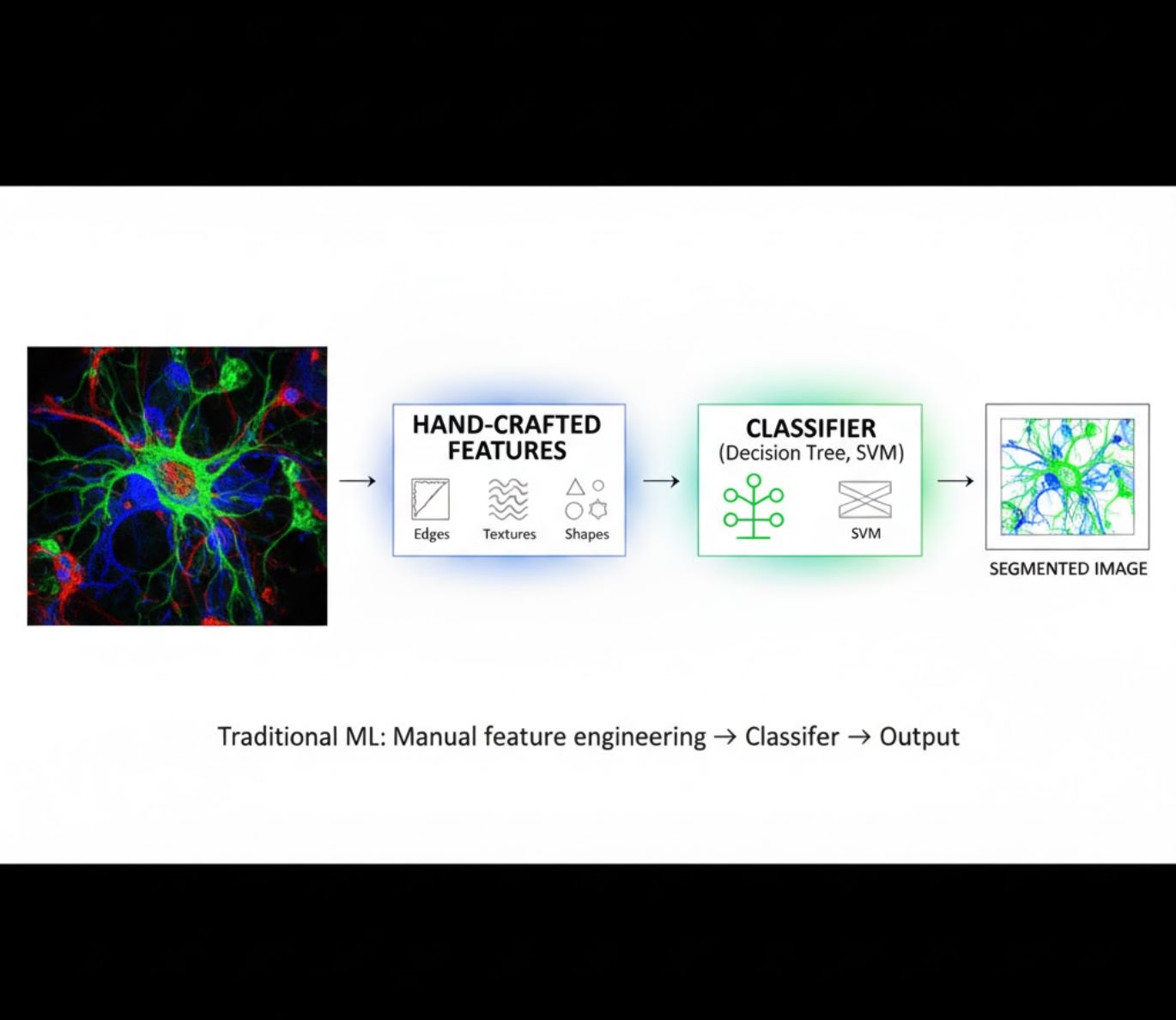

AI-methoden: Machine Learning versus Deep Learning

AI-methoden variëren van klassieke machine learning (ML) tot moderne deep learning (DL). Elke benadering heeft eigen sterke en zwakke punten:

Handgemaakte kenmerken

- Onderzoekers creëren handmatig beeldkenmerken (randen, texturen, vormen)

- Kenmerken worden gevoed aan classifiers (beslissingsbomen, SVM)

- Snel te trainen

- Lastig bij complexe of ruisachtige beelden

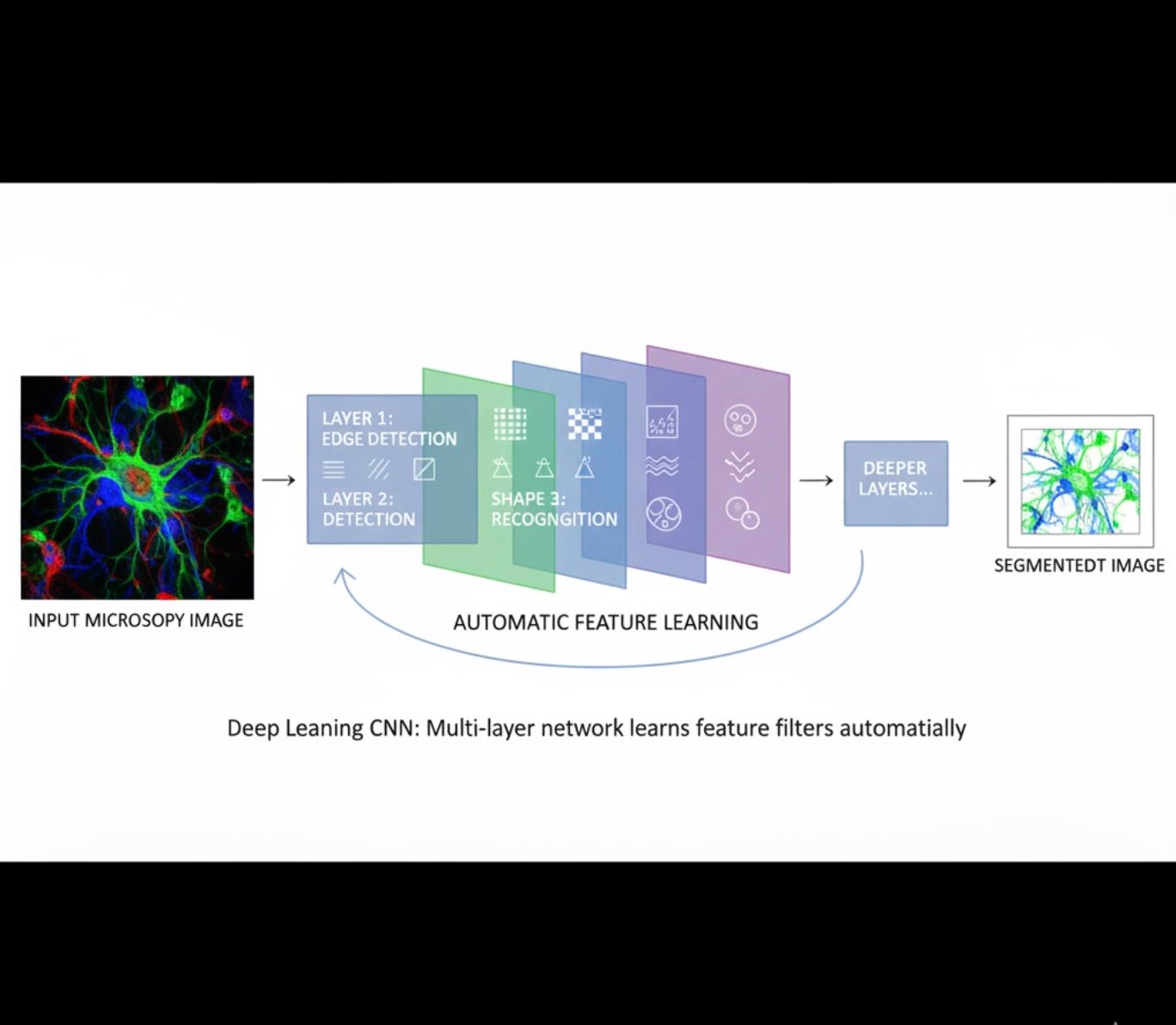

Automatisch kenmerken leren

- Meerlaagse neurale netwerken (CNN’s) leren kenmerken automatisch

- Eind-tot-eind leren van ruwe pixels

- Veel robuuster tegen variaties

- Legt ingewikkelde texturen en structuren betrouwbaar vast

Hoe CNN’s werken: Convolutionele neurale netwerken passen opeenvolgende filters toe op microscoopbeelden, leren eenvoudige patronen (randen) in vroege lagen te detecteren en complexe structuren (celvormen, texturen) in diepere lagen. Deze hiërarchische leerwijze maakt DL uitzonderlijk robuust, zelfs bij grote variaties in intensiteitsprofielen.

Visuele vergelijking: ML versus DL-pijplijnen

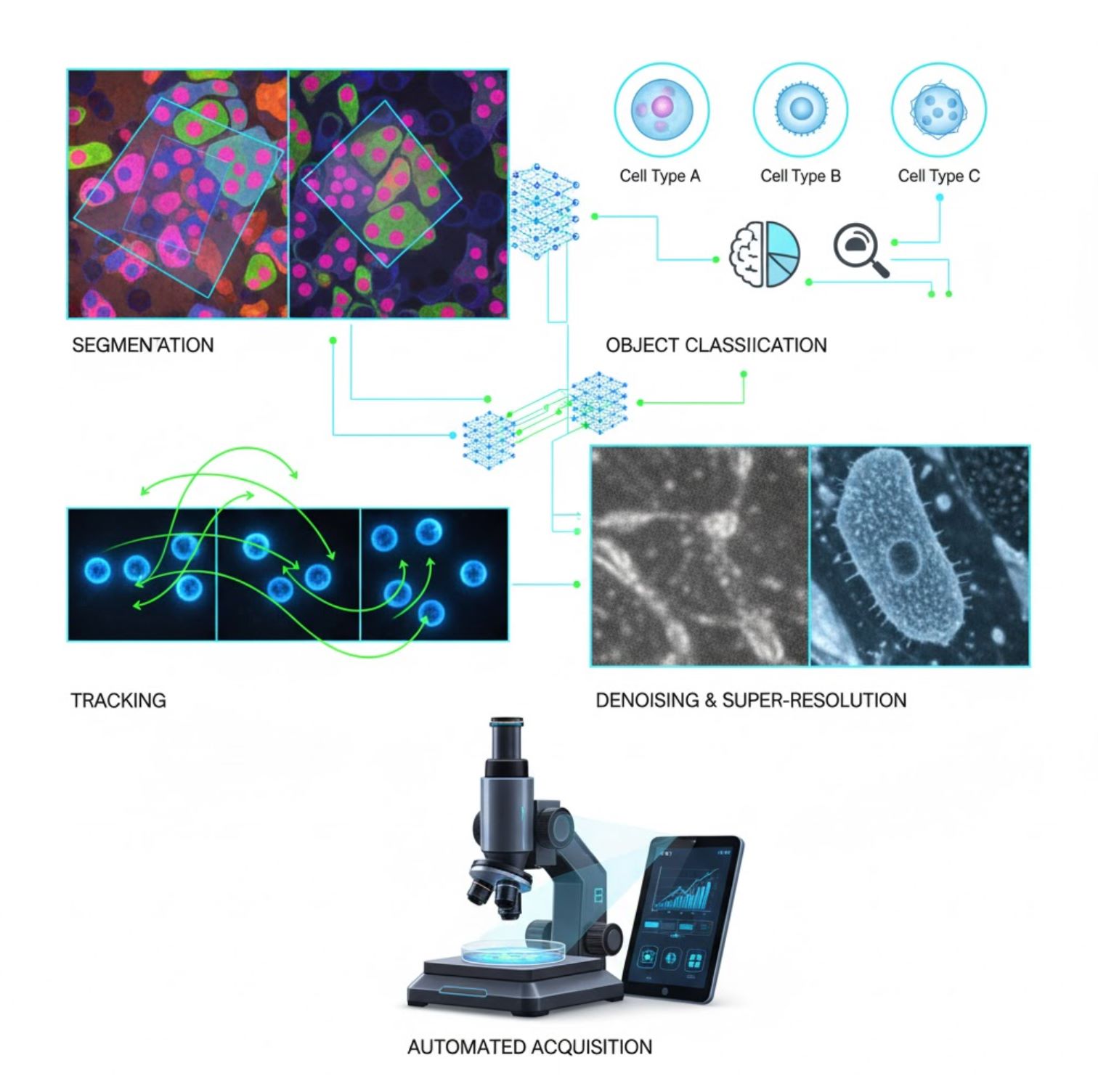

Belangrijke AI-toepassingen in microscopie

AI is nu geïntegreerd in veel beeldverwerkingstaken binnen de microscopieworkflow:

Segmentatie

Beelden opdelen in regio’s (bijv. elke cel of kern identificeren). Diepe netwerken zoals U-Net excelleren in deze taak.

- Semantische segmentatie: Per-pixel klasse labels

- Instance-segmentatie: Individuele objecten scheiden

- Hoge nauwkeurigheid bij drukke of vage beelden

- Vision foundation models (bijv. μSAM) nu aangepast voor microscopie

Objectclassificatie

Na segmentatie classificeert AI elk object met hoge precisie.

- Celtype-identificatie

- Bepaling mitotische fase

- Detectie van pathologische indicatoren

- Onderscheidt subtiele fenotypes die handmatig moeilijk te kwantificeren zijn

Tracking

In timelapse-microscopie volgt AI cellen of deeltjes over frames met ongekende nauwkeurigheid.

- Deep learning verbetert tracking nauwkeurigheid drastisch

- Maakt betrouwbare analyse van bewegende cellen mogelijk

- Legt dynamische biologische processen vast

Ruisonderdrukking & Superresolutie

AI-modellen verbeteren beeldkwaliteit door ruis en onscherpte te verwijderen.

- Fysica-geïnformeerde diepe modellen leren microscoopoptiek

- Reconstrueren scherpere, artefactvrije beelden

- Hogere resolutie met minder artefacten dan traditionele methoden

Geautomatiseerde acquisitie

AI stuurt de microscoop zelf in realtime aan.

- Analyseert live beelden om intelligente beslissingen te nemen

- Stelt automatisch scherp en scant interessegebieden

- Vermindert fototoxiciteit en bespaart tijd

- Maakt high-throughput en adaptieve beeldvormings-experimenten mogelijk

Populaire AI-tools in microscoopbeeldverwerking

<ITEM_DESCRIPTION>Een rijk ecosysteem van tools ondersteunt AI in microscopie. Onderzoekers hebben zowel algemene als gespecialiseerde software ontwikkeld, veelal open-source:</ITEM_DESCRIPTION>

Cellpose

| Ontwikkelaar | Carsen Stringer en Marius Pachitariu (MouseLand onderzoeksgroep) |

| Ondersteunde Platforms |

Vereist Python (pip/conda installatie). GUI alleen beschikbaar op desktop. |

| Taalondersteuning | Engelstalige documentatie; wereldwijd gebruikt in onderzoekslaboratoria |

| Prijsmodel | Gratis en open-source onder BSD-3-Clause licentie |

Overzicht

Cellpose is een geavanceerde, op deep learning gebaseerde segmentatietool voor microscopische beelden. Als generalistisch algoritme segmenteert het nauwkeurig diverse celtypen (kernen, cytoplasma, enz.) over verschillende beeldvormingsmodaliteiten zonder dat modelhertraining nodig is. Met human-in-the-loop mogelijkheden kunnen onderzoekers resultaten verfijnen, het model aanpassen aan hun data en het systeem toepassen op zowel 2D- als 3D-beeldverwerking.

Belangrijkste Kenmerken

Werkt direct voor een breed scala aan celtypen, kleurstoffen en beeldmodaliteiten zonder aangepaste training.

Ondersteunt volledige 3D-stacks met een "2,5D" aanpak die 2D-modellen hergebruikt voor volumetrische data.

Corrigeer segmentatieresultaten handmatig en train het model opnieuw met je eigen data voor betere nauwkeurigheid.

Toegang via Python API, command-line interface of grafische gebruikersinterface voor flexibele workflows.

Ruisonderdrukking, onscherpte verwijderen en opschalen om beeldkwaliteit te verbeteren vóór segmentatie.

Downloaden of Toegang

Technische Achtergrond

Cellpose werd geïntroduceerd in een baanbrekende studie door Stringer, Wang, Michaelos en Pachitariu, getraind op een grote en zeer gevarieerde dataset met meer dan 70.000 gesegmenteerde objecten. Deze diversiteit stelt het model in staat te generaliseren over celvormen, -groottes en microscopie-instellingen, waardoor de noodzaak voor aangepaste training in de meeste gevallen sterk afneemt. Voor 3D-data hergebruikt Cellpose slim zijn 2D-model in een "2,5D" stijl, waardoor volledig 3D-geannoteerde trainingsdata niet nodig zijn, terwijl het toch volumetrische segmentatie levert. Cellpose 2.0 introduceerde human-in-the-loop hertraining, waarmee gebruikers voorspellingen handmatig kunnen corrigeren en opnieuw trainen op hun eigen beelden voor betere prestaties op specifieke datasets.

Installatie & Setup

Stel een Python-omgeving in met conda:

conda create -n cellpose python=3.10Activeer de omgeving en installeer Cellpose:

# For GUI support

pip install cellpose[gui]

# For minimal setup (API/CLI only)

pip install cellposeAan de Slag

GUI-modus

- Start de GUI door het volgende uit te voeren:

python -m cellpose - Sleep afbeeldingsbestanden (

.tif,.png, enz.) naar de interface - Selecteer het modeltype (bijv. "cyto" voor cytoplasma of "nuclei" voor kernen)

- Stel de geschatte celdiameter in of laat Cellpose automatisch kalibreren

- Klik om segmentatie te starten en bekijk de resultaten

Python API-modus

from cellpose import models

# Load model

model = models.Cellpose(model_type='cyto')

# Segment images

masks, flows = model.eval(images, diameter=30)Verfijnen & Hertrainen

- Corrigeer segmentaties in de GUI door maskers handmatig samen te voegen of te verwijderen nadat ze zijn gegenereerd

- Gebruik ingebouwde trainingsfuncties om opnieuw te trainen op de gecorrigeerde voorbeelden

- Verbeterde modelprestaties op jouw specifieke dataset

3D Data Verwerken

- Laad een multi-Z TIFF of volumetrische stack

- Gebruik de

--Zstackvlag in GUI of API om als 3D te verwerken - Verfijn optioneel 3D flows via smoothing of gespecialiseerde parameters voor betere segmentatie

Beperkingen & Overwegingen

- Algemeenheid van het model: Hoewel het generalistische model breed inzetbaar is, kunnen zeer afwijkende celvormen of beeldcondities hertraining vereisen.

- Annotatie-inspanning: Human-in-the-loop training vereist handmatige correcties, wat tijdrovend kan zijn bij grote datasets.

- Installatiecomplexiteit: GUI-installatie kan command-line gebruik, conda-omgevingen en beheer van Python-afhankelijkheden vereisen — niet altijd eenvoudig voor niet-programmeurs.

- Alleen desktop: Cellpose is ontworpen voor desktopgebruik; er zijn geen native Android- of iOS-apps beschikbaar.

Veelgestelde Vragen

Nee — Cellpose biedt voorgetrainde, generalistische modellen die vaak goed werken zonder hertraining. Voor optimale resultaten op speciale of afwijkende data kun je echter annoteren en hertrainen met de human-in-the-loop functies.

Ja — het ondersteunt 3D door het 2D-model opnieuw te gebruiken (de zogenaamde "2,5D" methode), en je kunt volumetrische stacks verwerken via de GUI of API.

Een GPU wordt sterk aanbevolen voor snellere inferentie en training, vooral bij grote of 3D datasets, maar Cellpose kan ook op CPU-only machines draaien met tragere prestaties.

In de GUI stel je de geschatte celdiameter handmatig in of laat je Cellpose deze automatisch kalibreren. Je kunt resultaten verfijnen en hertrainen als de segmentatie niet optimaal is.

Ja — nieuwere versies (Cellpose 3) bevatten beeldherstelmodellen voor ruisonderdrukking, onscherpte verwijderen en opschalen om de segmentatiekwaliteit vóór verwerking te verbeteren.

StarDist

| Ontwikkelaar | Uwe Schmidt, Martin Weigert, Coleman Broaddus en Gene Myers |

| Ondersteunde Platforms |

|

| Taalondersteuning | Open-source project met documentatie en community voornamelijk in het Engels |

| Prijsmodel | Gratis en open source. Gelicentieerd onder BSD-3-Clause |

Overzicht

StarDist is een deep-learningtool voor instance-segmentatie in microscopische beelden. Het representeert elk object (zoals celkernen) als een sterconvexe veelhoek in 2D of veelvlak in 3D, wat nauwkeurige detectie en scheiding van dicht opeengepakte of overlappende objecten mogelijk maakt. Met zijn robuuste architectuur wordt StarDist veel gebruikt voor geautomatiseerde cel- en kernsegmentatie in fluorescentiemicroscopie, histopathologie en andere bio-beeldanalyse toepassingen.

Belangrijkste Kenmerken

Zeer nauwkeurige instance-segmentatie met sterconvexe veelhoeken (2D) en veelvlakken (3D) voor betrouwbare objectdetectie.

Specifieke modellen voor zowel 2D-beelden als 3D-volumetrische data voor uitgebreide microscopie-analyse.

Klaar-voor-gebruik modellen voor fluorescerende kernen, H&E-gekleurde histologie en andere veelvoorkomende beeldvormingsscenario’s.

Classificeer gedetecteerde objecten in verschillende klassen (bijv. verschillende celtypen) in één segmentatieronde.

Naadloze integratie met ImageJ/Fiji, QuPath en napari voor toegankelijke GUI-gebaseerde workflows.

Uitgebreide evaluatie van instance-segmentatie inclusief precisie, recall, F1-score en panoptic quality.

Technische Achtergrond

Oorspronkelijk geïntroduceerd in een MICCAI 2018-publicatie, is de kerninnovatie van StarDist de voorspelling van radiale afstanden langs vaste stralen gecombineerd met objectkans per pixel, wat een nauwkeurige reconstructie van sterconvexe vormen mogelijk maakt. Deze aanpak segmenteert betrouwbaar dicht aangrenzende objecten die moeilijk te scheiden zijn met traditionele pixelgebaseerde of bounding-box methoden.

Recente ontwikkelingen hebben StarDist uitgebreid naar histopathologiebeelden, waardoor niet alleen kernsegmentatie maar ook multi-klasse classificatie van gedetecteerde objecten mogelijk is. De methode behaalde topresultaten in uitdagingen zoals de CoNIC (Colon Nuclei Identification and Counting) challenge.

Download of Toegang

Installatie & Setup

Installeer TensorFlow (versie 1.x of 2.x) als vereiste voor StarDist.

Gebruik pip om het StarDist Python-pakket te installeren:

pip install stardistVoor napari:

pip install stardist-napariVoor QuPath: Installeer de StarDist-extensie door het .jar bestand in QuPath te slepen.

Voor ImageJ/Fiji: Gebruik de ingebouwde pluginmanager of handmatige installatie via het plugins-menu.

Segmentatie Uitvoeren

Laad een voorgetraind model, normaliseer je afbeelding en voer de voorspelling uit:

from stardist.models import StarDist2D

model = StarDist2D.from_pretrained('2D_versatile_fluo')

labels, details = model.predict_instances(image)Open je afbeelding in napari, selecteer de StarDist-plugin, kies een voorgetraind of aangepast model en voer de voorspelling direct vanuit de GUI uit.

Gebruik de StarDist-plugin vanuit het Plugins-menu om een model toe te passen op je afbeeldingsstapel met een intuïtieve interface.

Na installatie van de extensie, voer StarDist-detectie uit via de scriptingconsole of grafische interface van QuPath voor histopathologie-analyse.

Training & Fijnstelling

Maak grondwaarheidslabelafbeeldingen waarbij elk object uniek gelabeld is. Gebruik annotatietools zoals LabKit, QuPath of Fiji om je dataset voor te bereiden.

Gebruik de StarDist Python API om een nieuw model te trainen of een bestaand model fijn te stellen met je eigen geannoteerde data.

Post-Processing Opties

- Pas non-maximum suppressie (NMS) toe om overbodige kandidaatvormen te elimineren

- Gebruik StarDist OPP (Object Post-Processing) om maskers te combineren voor niet-sterconvexe vormen

Beperkingen & Overwegingen

- De sterconvexe aanname kan niet perfect zijn voor sterk niet-convexe of zeer onregelmatige vormen

- Installatiecomplexiteit: aangepaste installaties vereisen een compatibele C++ compiler voor het bouwen van extensies

- GPU-versnelling is afhankelijk van compatibele versies van TensorFlow, CUDA en cuDNN

- Sommige gebruikers melden problemen met het draaien van de ImageJ-plugin vanwege Java-configuratie

Veelgestelde Vragen

StarDist werkt met diverse beeldtypen, waaronder fluorescentie, brightfield en histopathologie (bijv. H&E), dankzij de flexibele voorgetrainde modellen en aanpasbaarheid aan verschillende beeldvormingsmodaliteiten.

Ja — StarDist ondersteunt 3D instance-segmentatie met sterconvexe veelvlakken voor volumetrische data, waarmee de 2D-mogelijkheden worden uitgebreid naar volledige 3D-analyse.

Niet per se. Er zijn voorgetrainde modellen beschikbaar die vaak direct goed werken. Voor gespecialiseerde of nieuwe data verbetert het annoteren en trainen van aangepaste modellen de nauwkeurigheid aanzienlijk.

StarDist integreert met napari, ImageJ/Fiji en QuPath, waardoor je segmentatie kunt uitvoeren via een GUI zonder te programmeren. Het ondersteunt ook directe Python API-gebruik voor geavanceerde workflows.

StarDist biedt ingebouwde functies voor het berekenen van gangbare instance-segmentatiemetrieken zoals precisie, recall, F1-score en panoptic quality om de segmentatieprestaties te beoordelen.

SAM

Toepassingsinformatie

| Ontwikkelaar | Meta AI Research (FAIR) |

| Ondersteunde apparaten |

|

| Taal & Beschikbaarheid | Open-source fundamentmodel wereldwijd beschikbaar; documentatie in het Engels |

| Prijsstelling | Gratis — open-source onder Meta's licentie via GitHub en MIB-integratie |

Algemene Overzicht

SAM (Segment Anything Model) is een krachtig AI-fundamentmodel ontwikkeld door Meta dat interactieve en automatische segmentatie van vrijwel elk object in afbeeldingen mogelijk maakt. Met prompts zoals punten, selectiekaders of ruwe maskers genereert SAM segmentatiemaskers zonder dat taakgerichte hertraining nodig is. In microscopisch onderzoek is SAM’s flexibiliteit aangepast voor celsegmentatie, organeldetectie en histopathologische analyse, wat een schaalbare oplossing biedt voor onderzoekers die een promptbare, algemene segmentatietool zoeken.

Gedetailleerde Introductie

Oorspronkelijk getraind door Meta op meer dan 1 miljard maskers verspreid over 11 miljoen afbeeldingen, is SAM ontworpen als een promptbaar fundamentmodel voor segmentatie met "zero-shot" prestaties op nieuwe domeinen. In medisch beeldonderzoek is SAM geëvalueerd voor segmentatie van hele weefselplakken, tumordetectie en identificatie van celkernen. De prestaties op dicht opeengepakte instanties—zoals celkernen—zijn echter wisselend: zelfs met uitgebreide prompts (bijv. 20 klikken of kaders) kan zero-shot segmentatie moeite hebben bij complexe microscopische beelden.

Om deze beperking aan te pakken, zijn domeinspecifieke aanpassingen ontwikkeld:

- SAMCell — Gefinetuned op grote microscopiedatasets voor sterke zero-shot segmentatie van diverse celtypen zonder per-experiment hertraining

- μSAM — Opnieuw getraind op meer dan 17.000 handmatig geannoteerde microscopiebeelden om nauwkeurigheid op kleine cellulaire structuren te verbeteren

Belangrijkste Kenmerken

Flexibele interactie met punten, kaders en maskers voor nauwkeurige controle.

Voert segmentatie uit zonder bijstelling op nieuwe afbeeldingsdomeinen.

Aanpasbaar voor microscopie en histopathologie via few-shot of prompt-gebaseerde hertraining.

Beschikbaar in Microscopy Image Browser (MIB) met ondersteuning voor 3D en geïnterpoleerde segmentatie.

IDCC-SAM maakt automatische cel-telling mogelijk in immunocytochemie zonder handmatige annotatie.

Download of Toegang

Gebruikershandleiding

- Open Microscopy Image Browser en navigeer naar het SAM segmentatiepaneel

- Configureer de Python-interpreter en kies tussen SAM-1 of SAM-2 modellen

- Voor GPU-versnelling, selecteer "cuda" in de uitvoeringsomgeving (aanbevolen voor optimale prestaties)

- Point prompts: Klik op een object om een positieve seed te definiëren; gebruik Shift + klik om uit te breiden en Ctrl + klik voor negatieve seeds

- 3D-stacks: Gebruik de interactieve 3D-modus—klik op een slice, shift-scroll en interpoleer seeds over slices

- Aanpassingsmodus: Vervang, voeg toe, trek af van maskers of maak een nieuwe laag aan indien nodig

- Gebruik de optie "Automatic everything" in het SAM-2 paneel van MIB om alle zichtbare objecten in een gebied te segmenteren

- Controleer en verfijn maskers na segmentatie indien nodig

- Gebruik prompt-gebaseerde fine-tuning pipelines (bijv. "All-in-SAM") om pixelniveau annotaties te genereren vanuit spaarzame gebruikersprompts

- Voor cel-telling, pas IDCC-SAM toe, dat SAM gebruikt in een zero-shot pipeline met nabewerking

- Voor zeer nauwkeurige celsegmentatie, gebruik SAMCell, gefinetuned op microscopische celbeelden

Beperkingen & Overwegingen

- Zero-shot prestaties inconsistent bij dichte of overlappende structuren zonder domeinafstemming

- Segmentatiekwaliteit hangt sterk af van promptontwerp en strategie

- GPU sterk aanbevolen; CPU-inferentie is zeer traag

- Heeft moeite met zeer hoge resolutie hele-plaat beelden en multiscale weefselstructuren

- Fine-tuning of aanpassing van SAM voor microscopie kan machine learning expertise vereisen

Veelgestelde Vragen

Ja—via aanpassingen zoals SAMCell, dat SAM finetuned op microscopiedatasets specifiek voor celsegmentatietaken.

Niet altijd. Met IDCC-SAM kunt u zero-shot cel-telling uitvoeren zonder handmatige annotaties.

Gebruik prompt-gebaseerde fine-tuning (bijv. "All-in-SAM") of voorgetrainde microscopieversies zoals μSAM, getraind op meer dan 17.000 geannoteerde microscopiebeelden.

Hoewel mogelijk op CPU, is GPU sterk aanbevolen voor praktische inferentiesnelheid en realtime interactieve segmentatie.

Ja—de SAM-2 integratie in MIB ondersteunt 3D segmentatie met seed-interpolatie over slices voor volumetrische analyse.

AxonDeepSeg

| Ontwikkelaar | NeuroPoly Lab van Polytechnique Montréal en Université de Montréal |

| Ondersteunde Platforms |

|

| Taal | Engelstalige documentatie; open-source tool wereldwijd gebruikt |

| Prijs | Gratis en open-source |

Overzicht

AxonDeepSeg is een AI-gestuurde tool voor automatische segmentatie van axonen en myeline in microscopische beelden. Met convolutionele neurale netwerken levert het nauwkeurige segmentatie in drie klassen (axon, myeline, achtergrond) over meerdere beeldmodaliteiten, waaronder TEM, SEM en helderveldmicroscopie. Door morfometrische metingen zoals axondiameter, g-ratio en mylinedikte te automatiseren, stroomlijnt AxonDeepSeg kwantitatieve analyse in neurowetenschappelijk onderzoek, wat handmatige annotatietijd aanzienlijk vermindert en reproduceerbaarheid verbetert.

Belangrijkste Kenmerken

Klaar voor gebruik modellen geoptimaliseerd voor TEM, SEM en helderveldmicroscopie modaliteiten.

Precieze classificatie van axon-, myeline- en achtergrondgebieden in microscopische beelden.

Automatische berekening van axondiameter, g-ratio, mylinedikte en dichtheidsmetingen.

Integratie met Napari GUI maakt handmatige verfijning van segmentatiemaskers mogelijk voor verbeterde nauwkeurigheid.

Naadloze integratie in aangepaste workflows voor grootschalige analyse van zenuwweefsel.

Uitgebreide testscripts garanderen reproduceerbaarheid en betrouwbare segmentatieresultaten.

Technische Details

Ontwikkeld door het NeuroPoly Lab, maakt AxonDeepSeg gebruik van deep learning voor hoogprecisie segmentatie in neurowetenschappelijke toepassingen. Voorgetrainde modellen zijn beschikbaar voor verschillende microscopiemodaliteiten, wat veelzijdigheid over beeldtechnieken garandeert. De tool integreert met Napari, waardoor interactieve correcties van segmentatiemaskers mogelijk zijn, wat de nauwkeurigheid op uitdagende datasets verhoogt. AxonDeepSeg berekent belangrijke morfometrische metrieken en ondersteunt grootschalige studies van zenuwweefselstructuur en pathologie. Het Python-gebaseerde framework maakt integratie in aangepaste workflows voor uitgebreide analyse van axon- en myeline-morfologie mogelijk.

Download of Toegang

Installatie & Setup

Zorg dat Python 3.8 of hoger is geïnstalleerd, installeer vervolgens AxonDeepSeg en Napari via pip:

pip install axondeepseg napariVoer de meegeleverde testscripts uit om te bevestigen dat alle componenten correct zijn geïnstalleerd en functioneren.

Importeer microscopische beelden (TEM, SEM of helderveld) in Napari of uw Python-omgeving.

Kies het juiste voorgetrainde model voor uw beeldmodaliteit en voer segmentatie uit om axon- en myeline-maskers te genereren.

Bereken automatisch morfometrische metingen zoals axondiameter, g-ratio, dichtheid en mylinedikte, en exporteer de resultaten in CSV-formaat.

Gebruik de Napari GUI om segmentatiemaskers handmatig aan te passen waar nodig, door maskers samen te voegen of te verwijderen voor betere nauwkeurigheid.

Belangrijke Overwegingen

- Prestaties kunnen afnemen bij nieuwe of niet-getrainde beeldmodaliteiten

- Handmatige correcties kunnen nodig zijn voor complexe of uitdagende gebieden

- GPU aanbevolen voor snellere verwerking van grote datasets; CPU-verwerking wordt ook ondersteund

Veelgestelde Vragen

AxonDeepSeg ondersteunt TEM (transmissie-elektronenmicroscopie), SEM (scanning-elektronenmicroscopie) en helderveldmicroscopie met voorgetrainde modellen die voor elke modaliteit zijn geoptimaliseerd.

Ja, AxonDeepSeg is volledig gratis en open-source, beschikbaar voor zowel academisch als commercieel gebruik.

Ja, AxonDeepSeg berekent automatisch axondiameter, g-ratio, mylinedikte en dichtheidsmetingen uit gesegmenteerde beelden.

Een GPU wordt aanbevolen voor snellere segmentatie van grote datasets, maar CPU-verwerking wordt ook ondersteund voor kleinere analyses.

Ja, integratie met de Napari GUI maakt interactieve correcties en verfijning van segmentatiemaskers mogelijk voor hogere nauwkeurigheid bij uitdagende gebieden.

Ilastik

| Ontwikkelaar | Ilastik-team van het European Molecular Biology Laboratory (EMBL) en aangesloten academische partners |

| Ondersteunde platforms |

|

| Taal | Engels |

| Prijs | Gratis en open-source |

Overzicht

Ilastik is een krachtig, AI-gestuurd hulpmiddel voor interactieve beeldsegmentatie, classificatie en analyse van microscopiedata. Met machine learning-technieken zoals Random Forest-classifiers kunnen onderzoekers pixels segmenteren, objecten classificeren, cellen volgen in de tijd en dichtheidstellingen uitvoeren in zowel 2D- als 3D-datasets. Dankzij de intuïtieve interface en realtime feedback is Ilastik toegankelijk voor wetenschappers zonder programmeerkennis en wordt het breed toegepast in celbiologie, neurowetenschappen en biomedische beeldvorming.

Belangrijkste functies

Realtime feedback terwijl u representatieve regio’s annoteert voor directe segmentatieresultaten.

Categoriseer gesegmenteerde structuren op basis van morfologische en intensiteitskenmerken.

Volg celbeweging en -deling in 2D- en 3D-tijdreeks microscopie-experimenten.

Kwantificeer drukke regio’s zonder expliciete segmentatie van individuele objecten.

Semi-automatische segmentatie voor complexe 3D-volumes met intuïtieve interactie.

Verwerk meerdere beelden automatisch met de headless commandoregelmodus.

Download

Startgids

Download Ilastik voor uw besturingssysteem van de officiële website. Het pakket bevat alle benodigde Python-afhankelijkheden, volg daarom de installatie-instructies voor uw platform.

Open Ilastik en kies uw analyseworkflow: Pixelclassificatie, Objectclassificatie, Tracking of Dichtheidstelling. Laad uw beelddataset, die multi-kanaal, 3D of tijdreeksen kan bevatten.

Label enkele representatieve pixels of objecten in uw beelden. Ilastiks Random Forest-classifier leert van deze annotaties en voorspelt automatisch labels voor uw volledige dataset.

Pas het getrainde model toe om uw volledige dataset te segmenteren of classificeren. Exporteer resultaten als gelabelde beelden, waarschijnlijkheidskaarten of kwantitatieve tabellen voor verdere analyse en visualisatie.

Gebruik Ilastiks headless modus om meerdere beelden automatisch te verwerken zonder handmatige tussenkomst, ideaal voor grootschalige analysepipelines.

Beperkingen & aandachtspunten

- Interactief labelen kan tijdrovend zijn bij zeer grote datasets

- Nauwkeurigheid hangt af van de kwaliteit en representativiteit van gebruikersannotaties

- Geheugenvereisten — zeer hoge resolutie of multi-gigabyte datasets kunnen veel RAM vereisen

- Complexe data — Random Forest-classifiers presteren mogelijk minder goed dan diepe neurale netwerken bij sterk variërende of complexe beelddata

Veelgestelde vragen

Ja, Ilastik ondersteunt volledig 3D-volumes en tijdreeksexperimenten voor segmentatie, tracking en kwantitatieve analyse over meerdere tijdstippen.

Ja, Ilastik is volledig gratis en open-source, beschikbaar voor alle gebruikers zonder licentiebeperkingen.

Nee, Ilastik biedt een intuïtieve grafische interface met realtime feedback, waardoor het toegankelijk is voor onderzoekers zonder programmeerkennis. Gevorderde gebruikers kunnen ook batchverwerking via de commandoregel gebruiken.

Ja, de speciale tracking-workflow maakt analyse van celbeweging en -deling mogelijk in zowel 2D- als 3D-tijdreeksdatasets met automatische lijnage-tracking.

Segmentatie-uitvoer kan worden geëxporteerd als gelabelde beelden, waarschijnlijkheidskaarten of kwantitatieve tabellen, wat naadloze integratie met downstream analysetools en visualisatiesoftware mogelijk maakt.

Deze tools variëren van beginners- tot expert-niveau. Veel zijn gratis en open-source, wat reproduceerbare en deelbare AI-workflows binnen de onderzoeksgemeenschap bevordert.

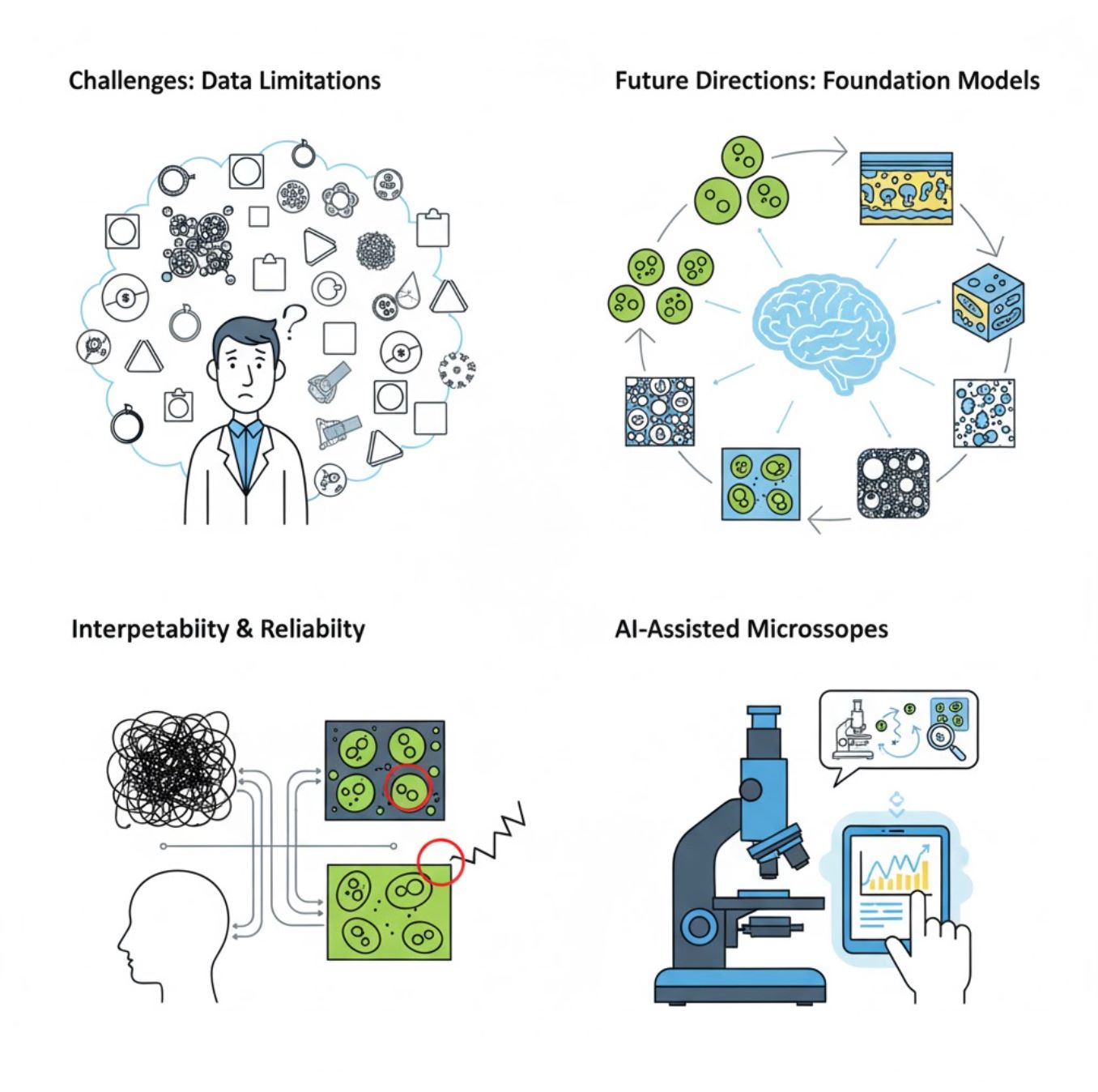

Uitdagingen en toekomstige richtingen

Huidige uitdagingen

Opkomende trends

Vision Foundation Models

AI-systemen van de volgende generatie beloven de noodzaak van taak-specifieke training te verminderen.

- Modellen zoals SAM en CLIP-gebaseerde systemen

- Één AI voor veel microscopietaken

- Snellere implementatie en aanpassing

AI-ondersteunde microscopen

Volledig autonome en intelligente microscopiesystemen worden realiteit.

- Natuurlijke taalbesturing via LLM’s

- Volledig geautomatiseerde feedbackloops

- Democratiseert toegang tot geavanceerde microscopie

Belangrijkste conclusies

- AI transformeert microscoopbeeldverwerking snel met verbeterde nauwkeurigheid en automatisering

- Deep learning presteert beter dan traditionele machine learning bij complexe, variabele microscoopbeelden

- CNN’s leren automatisch hiërarchische kenmerken van ruwe pixels voor robuuste analyse

- Belangrijke toepassingen zijn segmentatie, classificatie, tracking, ruisonderdrukking en geautomatiseerde acquisitie

- Succes hangt af van kwalitatieve data en zorgvuldige validatie door experts

- Vision foundation models en AI-ondersteunde microscopen vertegenwoordigen de toekomst van het vakgebied

Met voortdurende vooruitgang en gemeenschapsinspanningen (open-source tools, gedeelde datasets) zal AI steeds meer een kernonderdeel worden van het "oog" van de microscoop, waardoor wetenschappers het onzichtbare kunnen zien.

No comments yet. Be the first to comment!