सूक्ष्मदर्शी छवि प्रसंस्करण में एआई

एआई सूक्ष्मदर्शी छवि प्रसंस्करण में क्रांति ला रहा है, जिसमें सटीक विभाजन, शोर कम करना, सुपर-रिज़ॉल्यूशन, और स्वचालित छवि अधिग्रहण जैसी शक्तिशाली क्षमताएँ शामिल हैं। यह लेख वैज्ञानिक अनुसंधान में आवश्यक एआई उपकरणों और उभरते रुझानों को उजागर करता है।

एआई तकनीकें छवि अधिग्रहण को अनुकूलित और विश्लेषण को स्वचालित करके सूक्ष्मदर्शी में क्रांति ला रही हैं। आधुनिक स्मार्ट सूक्ष्मदर्शियों में, एआई मॉड्यूल फोकस, प्रकाश आदि जैसे इमेजिंग पैरामीटर को तुरंत समायोजित कर सकते हैं ताकि फोटोब्लिचिंग कम हो और सिग्नल बेहतर हो। इसी बीच, गहरे शिक्षण एल्गोरिदम जटिल छवि डेटा में छिपी जैविक अंतर्दृष्टि निकाल सकते हैं और छवियों को अन्य डेटा (जैसे जीनोमिक्स) से जोड़ भी सकते हैं।

एआई विधियाँ: मशीन लर्निंग बनाम डीप लर्निंग

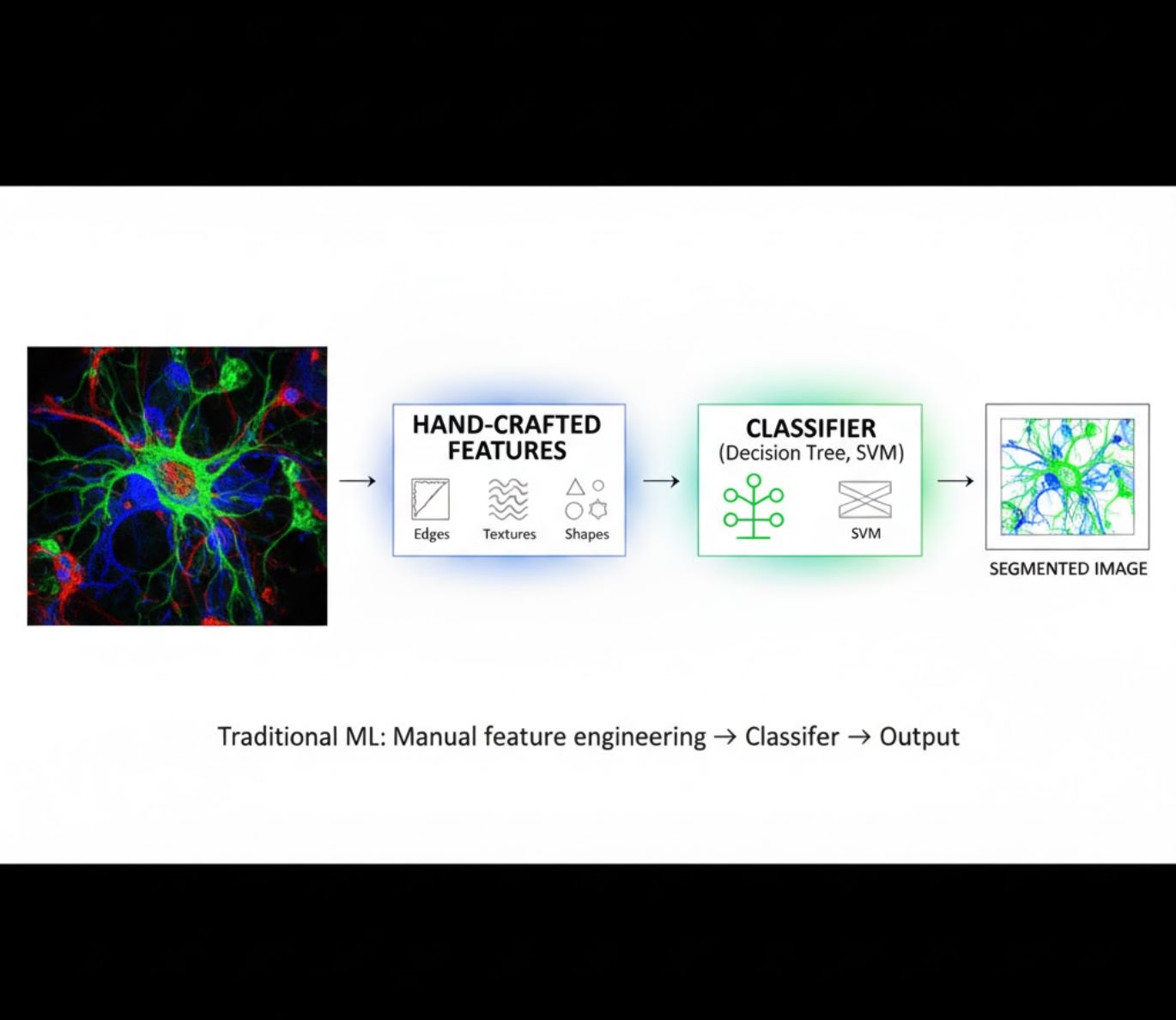

एआई विधियाँ पारंपरिक मशीन लर्निंग (एमएल) से लेकर आधुनिक डीप लर्निंग (डीएल) तक होती हैं। प्रत्येक दृष्टिकोण की अपनी ताकत और सीमाएँ हैं:

हाथ से बनाए गए फीचर्स

- शोधकर्ता छवि फीचर्स (किनारे, बनावट, आकार) मैन्युअल रूप से बनाते हैं

- फीचर्स को क्लासिफायर (डिसीजन ट्री, एसवीएम) को दिया जाता है

- प्रशिक्षण तेज़ होता है

- जटिल या शोरयुक्त छवियों में संघर्ष करता है

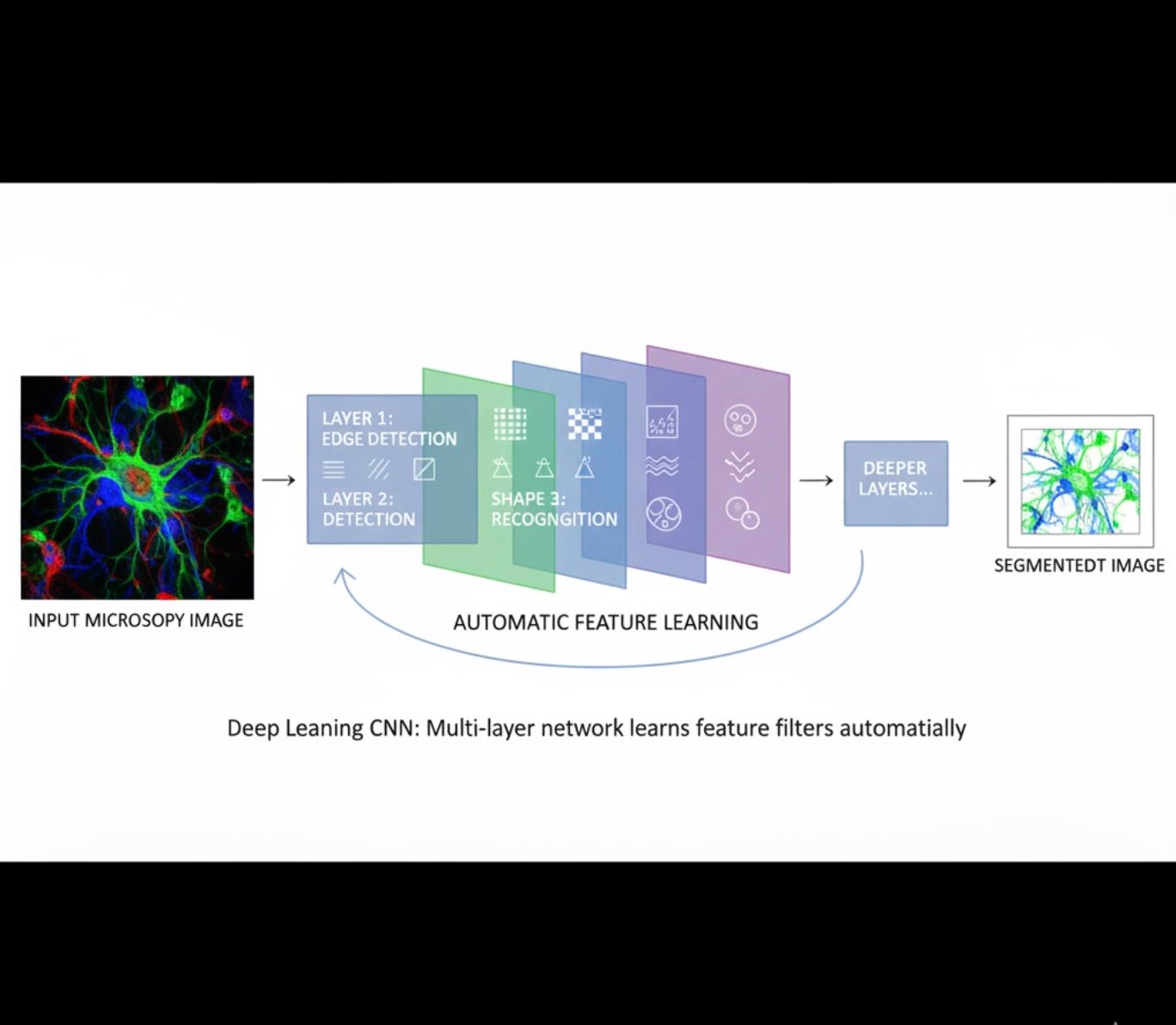

स्वचालित फीचर सीखना

- मल्टी-लेयर न्यूरल नेटवर्क (सीएनएन) फीचर्स स्वचालित सीखते हैं

- कच्चे पिक्सल से एंड-टू-एंड सीखना

- परिवर्तनों के प्रति अधिक मजबूत

- जटिल बनावट और संरचनाओं को विश्वसनीय रूप से पकड़ता है

सीएनएन कैसे काम करते हैं: कन्वोल्यूशनल न्यूरल नेटवर्क सूक्ष्मदर्शी छवियों पर लगातार फिल्टर लगाते हैं, शुरुआती परतों में सरल पैटर्न (किनारे) और गहरी परतों में जटिल संरचनाएँ (कोशिका के आकार, बनावट) सीखते हैं। यह पदानुक्रमित सीखना डीएल को तीव्रता प्रोफाइल में बड़े बदलावों के बावजूद अत्यंत मजबूत बनाता है।

दृश्य तुलना: एमएल बनाम डीएल पाइपलाइन्स

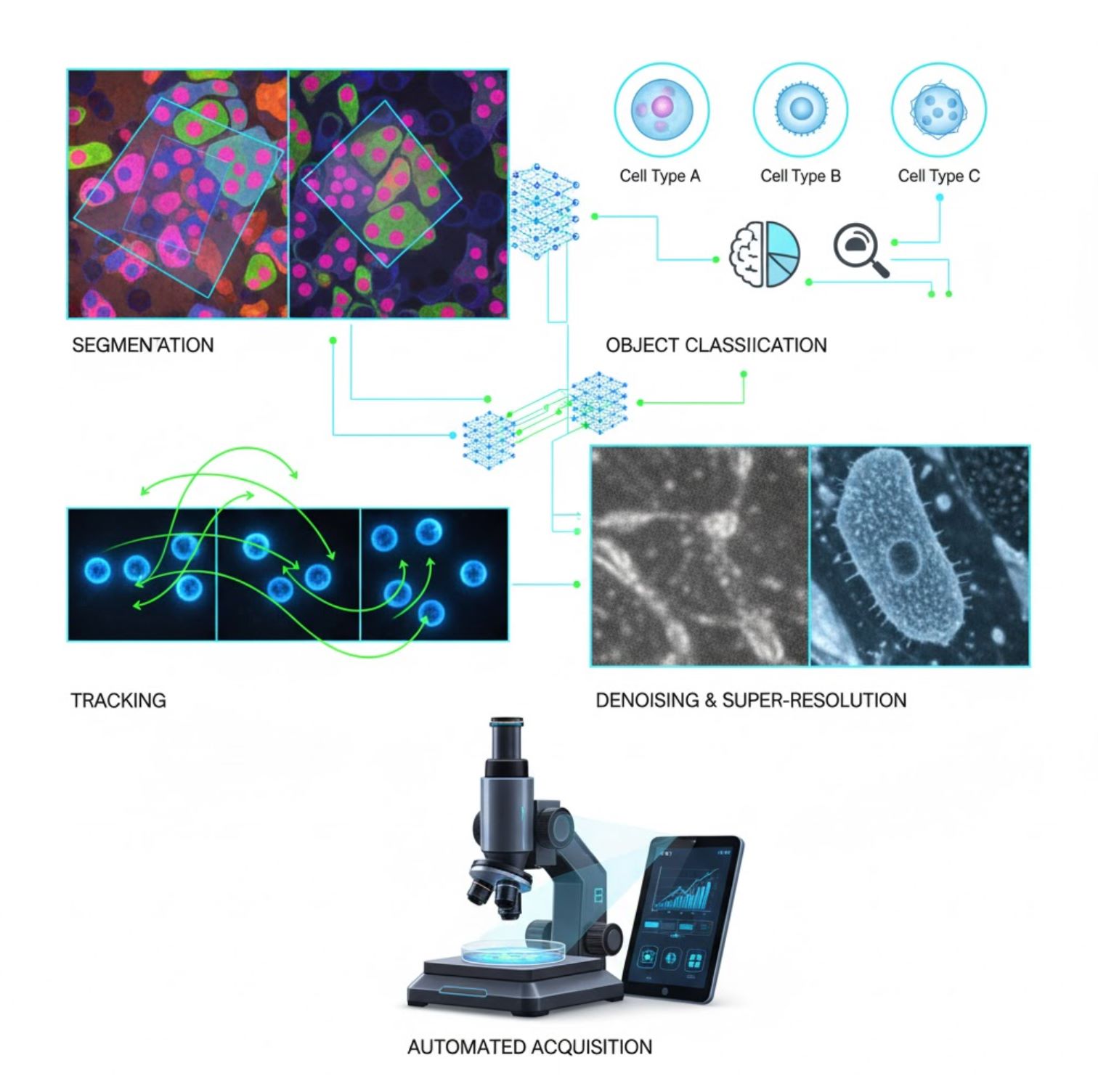

सूक्ष्मदर्शी में प्रमुख एआई अनुप्रयोग

एआई अब सूक्ष्मदर्शी कार्यप्रवाह में कई छवि-प्रसंस्करण कार्यों में अंतर्निहित है:

विभाजन

छवियों को क्षेत्रों में विभाजित करना (जैसे, प्रत्येक कोशिका या नाभिक की पहचान)। यू-नेट जैसे गहरे नेटवर्क इस कार्य में उत्कृष्ट हैं।

- सामान्य विभाजन: प्रति-पिक्सेल वर्ग लेबल

- इंस्टेंस विभाजन: व्यक्तिगत वस्तुओं को अलग करना

- भीड़-भाड़ या धुंधली छवियों पर उच्च सटीकता

- विजन फाउंडेशन मॉडल (जैसे μSAM) अब सूक्ष्मदर्शी के लिए अनुकूलित

वस्तु वर्गीकरण

विभाजन के बाद, एआई प्रत्येक वस्तु को उच्च सटीकता से वर्गीकृत करता है।

- कोशिका प्रकार की पहचान

- माइटोटिक चरण निर्धारण

- रोग विज्ञान संकेतक पहचान

- मैन्युअल रूप से मापना कठिन सूक्ष्म लक्षणों को अलग करता है

ट्रैकिंग

टाइम-लैप्स सूक्ष्मदर्शी में, एआई फ्रेमों में कोशिकाओं या कणों को अभूतपूर्व सटीकता से ट्रैक करता है।

- डीप लर्निंग ट्रैकिंग सटीकता में नाटकीय सुधार करता है

- गतिशील कोशिकाओं के विश्वसनीय विश्लेषण को सक्षम बनाता है

- गतिशील जैविक प्रक्रियाओं को पकड़ता है

शोर कम करना और सुपर-रिज़ॉल्यूशन

एआई मॉडल छवि गुणवत्ता को शोर और धुंध को हटाकर बढ़ाते हैं।

- भौतिकी-सूचित गहरे मॉडल सूक्ष्मदर्शी ऑप्टिक्स सीखते हैं

- तेज, कलाकृतिरहित छवियों का पुनर्निर्माण

- पारंपरिक विधियों की तुलना में कम कलाकृतियों के साथ उच्च रिज़ॉल्यूशन

स्वचालित अधिग्रहण

एआई वास्तविक समय में सूक्ष्मदर्शी को स्वयं मार्गदर्शन करता है।

- सजीव छवियों का विश्लेषण कर बुद्धिमान निर्णय लेना

- स्वचालित रूप से फोकस समायोजित करना और रुचि के क्षेत्रों को स्कैन करना

- फोटोटॉक्सिसिटी कम करता है और समय बचाता है

- उच्च-थ्रूपुट और अनुकूली इमेजिंग प्रयोग सक्षम करता है

सूक्ष्मदर्शी छवि प्रसंस्करण में लोकप्रिय एआई उपकरण

माइक्रोस्कोपी में एआई का समर्थन करने वाले उपकरणों का एक समृद्ध पारिस्थितिकी तंत्र है। शोधकर्ताओं ने सामान्य प्रयोजन और विशिष्ट सॉफ्टवेयर दोनों विकसित किए हैं, जिनमें से कई ओपन-सोर्स हैं:

Cellpose

| डेवलपर | कार्सेन स्ट्रिंगर और मारीउस पचितारियु (माउसलैंड रिसर्च ग्रुप) |

| समर्थित प्लेटफ़ॉर्म |

पायथन (pip/conda इंस्टॉलेशन) आवश्यक। GUI केवल डेस्कटॉप पर उपलब्ध। |

| भाषा समर्थन | अंग्रेज़ी दस्तावेज़ीकरण; विश्वभर के अनुसंधान प्रयोगशालाओं में व्यापक रूप से अपनाया गया |

| मूल्य निर्धारण मॉडल | मुफ़्त और ओपन-सोर्स BSD-3-Clause लाइसेंस के तहत |

अवलोकन

सेलपोज़ एक उन्नत, गहन-शिक्षण-आधारित विभाजन उपकरण है जो माइक्रोस्कोपी छवियों के लिए डिज़ाइन किया गया है। एक सामान्य एल्गोरिदम के रूप में, यह विभिन्न इमेजिंग मोडैलिटीज़ में विविध कोशिका प्रकारों (नाभिक, साइटोप्लाज्म आदि) को सटीक रूप से विभाजित करता है बिना मॉडल पुनःप्रशिक्षण की आवश्यकता के। मानव-इन-द-लूप क्षमताओं के साथ, शोधकर्ता परिणामों को परिष्कृत कर सकते हैं, मॉडल को अपने डेटा के अनुसार अनुकूलित कर सकते हैं, और इसे 2D और 3D इमेजिंग वर्कफ़्लोज़ दोनों पर लागू कर सकते हैं।

मुख्य विशेषताएँ

कस्टम प्रशिक्षण के बिना कई प्रकार की कोशिकाओं, दागों, और इमेजिंग मोडैलिटीज़ के लिए तुरंत काम करता है।

"2.5D" दृष्टिकोण का उपयोग करते हुए पूर्ण 3D स्टैक्स का समर्थन करता है जो वॉल्यूमेट्रिक डेटा के लिए 2D मॉडलों का पुन: उपयोग करता है।

मैन्युअल रूप से विभाजन परिणामों को सुधारें और बेहतर सटीकता के लिए अपने कस्टम डेटा पर मॉडल को पुनःप्रशिक्षित करें।

लचीले वर्कफ़्लोज़ के लिए पायथन API, कमांड-लाइन इंटरफेस, या ग्राफिकल यूजर इंटरफेस के माध्यम से पहुँच।

विभाजन से पहले छवि गुणवत्ता बढ़ाने के लिए डिनॉइज़िंग, डिब्लरिंग, और अपसैंपलिंग क्षमताएँ।

डाउनलोड या एक्सेस करें

तकनीकी पृष्ठभूमि

सेलपोज़ को स्ट्रिंगर, वांग, माइकलोस, और पचितारियु द्वारा एक महत्वपूर्ण अध्ययन में प्रस्तुत किया गया था, जो 70,000 से अधिक विभाजित वस्तुओं वाले एक बड़े और अत्यंत विविध डेटासेट पर प्रशिक्षित था। यह विविधता मॉडल को कोशिका आकृतियों, आकारों, और माइक्रोस्कोपी सेटिंग्स के बीच सामान्यीकृत करने में सक्षम बनाती है, जिससे अधिकांश उपयोग मामलों में कस्टम प्रशिक्षण की आवश्यकता काफी कम हो जाती है। 3D डेटा के लिए, सेलपोज़ अपने 2D मॉडल का "2.5D" तरीके से पुनः उपयोग करता है, पूर्ण 3D-एनोटेटेड प्रशिक्षण डेटा की आवश्यकता से बचते हुए वॉल्यूमेट्रिक विभाजन प्रदान करता है। सेलपोज़ 2.0 ने मानव-इन-द-लूप पुनःप्रशिक्षण पेश किया, जिससे उपयोगकर्ता मैन्युअल रूप से पूर्वानुमानों को सुधार सकते हैं और अपने स्वयं के चित्रों पर पुनःप्रशिक्षण कर सकते हैं ताकि विशिष्ट डेटासेट पर प्रदर्शन बेहतर हो सके।

स्थापना और सेटअप

conda का उपयोग करके पायथन पर्यावरण सेट करें:

conda create -n cellpose python=3.10पर्यावरण सक्रिय करें और सेलपोज़ इंस्टॉल करें:

# For GUI support

pip install cellpose[gui]

# For minimal setup (API/CLI only)

pip install cellposeआरंभ करें

GUI मोड

- GUI लॉन्च करें:

python -m cellpose - इंटरफ़ेस में छवि फ़ाइलें (

.tif,.png, आदि) ड्रैग और ड्रॉप करें - मॉडल प्रकार चुनें (जैसे, साइटो के लिए "cyto" या नाभिक के लिए "nuclei")

- अनुमानित सेल व्यास सेट करें या सेलपोज़ को स्वचालित रूप से कैलिब्रेट करने दें

- विभाजन शुरू करने और परिणाम देखने के लिए क्लिक करें

पायथन API मोड

from cellpose import models

# Load model

model = models.Cellpose(model_type='cyto')

# Segment images

masks, flows = model.eval(images, diameter=30)परिष्कृत करें और पुनःप्रशिक्षित करें

- मास्क बनाने के बाद, GUI में मैन्युअल रूप से मास्क मर्ज या हटाकर विभाजन सुधारें

- सुधारित उदाहरणों पर पुनःप्रशिक्षण के लिए अंतर्निहित प्रशिक्षण फ़ंक्शन का उपयोग करें

- अपने विशिष्ट डेटासेट पर बेहतर मॉडल प्रदर्शन प्राप्त करें

3D डेटा संसाधित करें

- मल्टी-ज़ेड TIFF या वॉल्यूमेट्रिक स्टैक लोड करें

- GUI या API में

--Zstackफ़्लैग का उपयोग करके 3D के रूप में संसाधित करें - बेहतर विभाजन के लिए स्मूथिंग या विशेष पैरामीटर के माध्यम से 3D फ्लोज़ को वैकल्पिक रूप से परिष्कृत करें

सीमाएँ और विचार

- मॉडल सामान्यता का समझौता: जबकि सामान्य मॉडल व्यापक रूप से काम करता है, अत्यधिक असामान्य कोशिका आकृतियाँ या इमेजिंग स्थितियाँ पुनःप्रशिक्षण की आवश्यकता हो सकती हैं।

- एनोटेशन प्रयास: मानव-इन-द-लूप प्रशिक्षण के लिए मैन्युअल सुधार आवश्यक हैं, जो बड़े डेटासेट के लिए समय लेने वाला हो सकता है।

- स्थापना जटिलता: GUI स्थापना के लिए कमांड-लाइन उपयोग, conda पर्यावरण, और पायथन निर्भरताओं का प्रबंधन आवश्यक हो सकता है — जो गैर-प्रोग्रामरों के लिए हमेशा सरल नहीं होता।

- केवल डेस्कटॉप: सेलपोज़ डेस्कटॉप उपयोग के लिए डिज़ाइन किया गया है; कोई मूल Android या iOS ऐप उपलब्ध नहीं है।

अक्सर पूछे जाने वाले प्रश्न

नहीं — सेलपोज़ पूर्व-प्रशिक्षित, सामान्य मॉडल प्रदान करता है जो अक्सर पुनःप्रशिक्षण के बिना अच्छी तरह काम करते हैं। हालांकि, विशेष या असामान्य डेटा पर सर्वोत्तम परिणामों के लिए, आप मानव-इन-द-लूप सुविधाओं का उपयोग करके एनोटेट और पुनःप्रशिक्षित कर सकते हैं।

हाँ — यह अपने 2D मॉडल ("2.5D" के रूप में जाना जाता है) का पुनः उपयोग करके 3D का समर्थन करता है, और आप GUI या API के माध्यम से वॉल्यूमेट्रिक स्टैक्स चला सकते हैं।

GPU तेज़ पूर्वानुमान और प्रशिक्षण के लिए अत्यधिक अनुशंसित है, विशेष रूप से बड़े या 3D डेटासेट पर, लेकिन सेलपोज़ CPU-केवल मशीनों पर धीमे प्रदर्शन के साथ चल सकता है।

GUI में, अनुमानित सेल व्यास मैन्युअल रूप से सेट करें या सेलपोज़ को स्वचालित रूप से कैलिब्रेट करने दें। यदि विभाजन आदर्श नहीं है, तो आप परिणामों को परिष्कृत कर सकते हैं और पुनःप्रशिक्षण कर सकते हैं।

हाँ — नए संस्करण (Cellpose 3) में डिनॉइज़िंग, डिब्लरिंग, और अपसैंपलिंग के लिए छवि पुनर्स्थापन मॉडल शामिल हैं जो विभाजन से पहले गुणवत्ता सुधारते हैं।

StarDist

| डेवलपर | उवे श्मिट, मार्टिन वेइगर्ट, कोलमैन ब्रॉडस, और जीन मायर्स |

| समर्थित प्लेटफ़ॉर्म |

|

| भाषा समर्थन | ओपन-सोर्स प्रोजेक्ट जिसमें दस्तावेज़ और समुदाय मुख्य रूप से अंग्रेज़ी में है |

| मूल्य निर्धारण मॉडल | मुफ़्त और ओपन सोर्स। BSD-3-Clause लाइसेंस के तहत लाइसेंस प्राप्त |

अवलोकन

StarDist माइक्रोस्कोपी छवियों में इंस्टेंस सेगमेंटेशन के लिए एक डीप-लर्निंग टूल है। यह प्रत्येक ऑब्जेक्ट (जैसे कोशिका नाभिक) को 2D में स्टार-कॉन्वेक्स बहुभुज या 3D में पॉलीहेड्रा के रूप में प्रस्तुत करता है, जो घनीभूत या ओवरलैपिंग वस्तुओं का सटीक पता लगाने और पृथक्करण को सक्षम बनाता है। अपनी मजबूत संरचना के साथ, StarDist फ्लोरोसेंस माइक्रोस्कोपी, हिस्टोपैथोलॉजी, और अन्य बायोइमेज विश्लेषण अनुप्रयोगों में स्वचालित कोशिका और नाभिक सेगमेंटेशन के लिए व्यापक रूप से उपयोग किया जाता है।

मुख्य विशेषताएँ

विश्वसनीय ऑब्जेक्ट डिटेक्शन के लिए स्टार-कॉन्वेक्स बहुभुजों (2D) और पॉलीहेड्रा (3D) का उपयोग करके अत्यंत सटीक इंस्टेंस सेगमेंटेशन।

व्यापक माइक्रोस्कोपी विश्लेषण के लिए 2D छवियों और 3D वॉल्यूमेट्रिक डेटा दोनों के लिए समर्पित मॉडल।

फ्लोरोसेंस नाभिक, H&E-रंगित हिस्टोलॉजी, और अन्य सामान्य इमेजिंग परिदृश्यों के लिए तैयार-से-उपयोग मॉडल।

एकल सेगमेंटेशन रन में पाए गए ऑब्जेक्ट्स को विभिन्न वर्गों (जैसे, विभिन्न कोशिका प्रकार) में वर्गीकृत करें।

ImageJ/Fiji, QuPath, और napari के साथ सहज एकीकरण के लिए GUI-आधारित वर्कफ़्लोज़।

प्रिसिजन, रिकॉल, F1 स्कोर, और पैनोप्टिक क्वालिटी सहित व्यापक इंस्टेंस सेगमेंटेशन मूल्यांकन।

तकनीकी पृष्ठभूमि

मूल रूप से MICCAI 2018 पेपर में प्रस्तुत, StarDist का मुख्य नवाचार प्रत्येक पिक्सेल के लिए ऑब्जेक्ट संभावना के साथ निश्चित किरणों के साथ रेडियल दूरी की भविष्यवाणी है, जो स्टार-कॉन्वेक्स आकृतियों के सटीक पुनर्निर्माण को सक्षम बनाता है। यह दृष्टिकोण पारंपरिक पिक्सेल-आधारित या बॉक्स विधियों से अलग करना कठिन निकट संपर्क वस्तुओं को विश्वसनीय रूप से सेगमेंट करता है।

हाल के विकासों ने StarDist को हिस्टोपैथोलॉजी छवियों तक विस्तारित किया है, जो न केवल नाभिक सेगमेंटेशन बल्कि पाए गए ऑब्जेक्ट्स की मल्टी-क्लास वर्गीकरण भी सक्षम करता है। इस विधि ने CoNIC (Colon Nuclei Identification and Counting) जैसे चुनौतियों में शीर्ष प्रदर्शन प्राप्त किया।

डाउनलोड या एक्सेस

इंस्टॉलेशन और सेटअप

StarDist के लिए पूर्वापेक्षा के रूप में TensorFlow (संस्करण 1.x या 2.x) स्थापित करें।

StarDist पायथन पैकेज स्थापित करने के लिए pip का उपयोग करें:

pip install stardistnapari के लिए:

pip install stardist-napariQuPath के लिए: StarDist एक्सटेंशन को QuPath में .jar फ़ाइल ड्रैग करके स्थापित करें।

ImageJ/Fiji के लिए: बिल्ट-इन प्लगइन मैनेजर या प्लगइन्स मेनू के माध्यम से मैनुअल इंस्टॉलेशन का उपयोग करें।

सेगमेंटेशन चलाना

पूर्व-प्रशिक्षित मॉडल लोड करें, अपनी छवि को सामान्यीकृत करें, और भविष्यवाणी चलाएं:

from stardist.models import StarDist2D

model = StarDist2D.from_pretrained('2D_versatile_fluo')

labels, details = model.predict_instances(image)अपनी छवि napari में खोलें, StarDist प्लगइन चुनें, पूर्व-प्रशिक्षित या कस्टम मॉडल चुनें, और GUI से सीधे भविष्यवाणी चलाएं।

प्लगइन्स मेनू से StarDist प्लगइन का उपयोग करके अपनी छवि स्टैक पर मॉडल लागू करें, एक सहज इंटरफ़ेस के साथ।

एक्सटेंशन स्थापित करने के बाद, हिस्टोपैथोलॉजी विश्लेषण के लिए QuPath के स्क्रिप्टिंग कंसोल या ग्राफिकल इंटरफ़ेस के माध्यम से StarDist डिटेक्शन चलाएं।

प्रशिक्षण और फाइन-ट्यूनिंग

ग्राउंड-ट्रूथ लेबल छवियाँ बनाएं जहाँ प्रत्येक ऑब्जेक्ट को विशिष्ट रूप से लेबल किया गया हो। अपने डेटासेट को तैयार करने के लिए LabKit, QuPath, या Fiji जैसे एनोटेशन टूल्स का उपयोग करें।

StarDist के पायथन API का उपयोग करके नया मॉडल प्रशिक्षित करें या अपने कस्टम एनोटेटेड डेटा के साथ मौजूदा मॉडल को फाइन-ट्यून करें।

पोस्ट-प्रोसेसिंग विकल्प

- अतिरिक्त उम्मीदवार आकृतियों को हटाने के लिए नॉन-मैक्सिमम सप्रेशन (NMS) लागू करें

- गैर-स्टार-कॉन्वेक्स आकृतियों के लिए मास्क को मर्ज करने के लिए StarDist OPP (ऑब्जेक्ट पोस्ट-प्रोसेसिंग) का उपयोग करें

सीमाएँ और विचार

- स्टार-कॉन्वेक्स मान्यता अत्यधिक गैर-कॉन्वेक्स या बहुत अनियमित आकृतियों को पूरी तरह से मॉडल नहीं कर सकती

- इंस्टॉलेशन जटिलता: कस्टम इंस्टॉलेशन के लिए एक्सटेंशन्स बनाने हेतु संगत C++ कंपाइलर आवश्यक

- GPU एक्सेलेरेशन संगत TensorFlow, CUDA, और cuDNN संस्करणों पर निर्भर करता है

- कुछ उपयोगकर्ताओं ने Java कॉन्फ़िगरेशन के कारण ImageJ प्लगइन चलाने में समस्याएँ रिपोर्ट की हैं

अक्सर पूछे जाने वाले प्रश्न

StarDist फ्लोरोसेंस, ब्राइटफील्ड, और हिस्टोपैथोलॉजी (जैसे H&E) सहित विभिन्न छवि प्रकारों के साथ काम करता है, इसके लचीले पूर्व-प्रशिक्षित मॉडलों और विभिन्न इमेजिंग मोडैलिटीज़ के अनुकूलन के कारण।

हाँ — StarDist स्टार-कॉन्वेक्स पॉलीहेड्रा का उपयोग करके 3D इंस्टेंस सेगमेंटेशन का समर्थन करता है, जो 2D क्षमताओं को पूर्ण 3D विश्लेषण तक विस्तारित करता है।

जरूरी नहीं। पूर्व-प्रशिक्षित मॉडल उपलब्ध हैं और अक्सर बिना किसी बदलाव के अच्छी तरह काम करते हैं। हालांकि, विशेष या नए डेटा के लिए, कस्टम मॉडल को एनोटेट और प्रशिक्षित करने से सटीकता में काफी सुधार होता है।

StarDist napari, ImageJ/Fiji, और QuPath के साथ एकीकृत होता है, जिससे आप GUI से बिना कोडिंग के सेगमेंटेशन चला सकते हैं। यह उन्नत वर्कफ़्लोज़ के लिए सीधे पायथन API उपयोग को भी सपोर्ट करता है।

StarDist सटीकता, पुनः प्राप्ति, F1 स्कोर, और पैनोप्टिक गुणवत्ता सहित सामान्य इंस्टेंस सेगमेंटेशन मेट्रिक्स की गणना के लिए बिल्ट-इन फ़ंक्शन प्रदान करता है ताकि सेगमेंटेशन प्रदर्शन का आकलन किया जा सके।

SAM

आवेदन जानकारी

| डेवलपर | मेटा एआई रिसर्च (FAIR) |

| समर्थित उपकरण |

|

| भाषा और उपलब्धता | ओपन-सोर्स फाउंडेशन मॉडल जो विश्वव्यापी उपलब्ध है; दस्तावेज़ अंग्रेज़ी में |

| मूल्य निर्धारण | मुफ्त — मेटा के लाइसेंस के तहत GitHub और MIB एकीकरण के माध्यम से ओपन-सोर्स |

सामान्य अवलोकन

SAM (सेगमेंट एनीथिंग मॉडल) एक शक्तिशाली एआई फाउंडेशन मॉडल है जिसे मेटा द्वारा बनाया गया है, जो छवियों में लगभग किसी भी वस्तु का इंटरैक्टिव और स्वचालित सेगमेंटेशन सक्षम बनाता है। पॉइंट्स, बॉन्डिंग बॉक्सेस, या मोटे मास्क जैसे प्रॉम्प्ट्स का उपयोग करके, SAM बिना किसी कार्य-विशिष्ट पुनः प्रशिक्षण के सेगमेंटेशन मास्क उत्पन्न करता है। माइक्रोस्कोपी अनुसंधान में, SAM की लचीलापन कोशिका सेगमेंटेशन, ऑर्गेनेल डिटेक्शन, और हिस्टोपैथोलॉजी विश्लेषण के लिए अनुकूलित की गई है, जो शोधकर्ताओं को एक प्रॉम्प्टेबल, सामान्य-उद्देश्य सेगमेंटेशन उपकरण प्रदान करता है।

विस्तृत परिचय

मूल रूप से मेटा द्वारा 1 बिलियन से अधिक मास्क पर 11 मिलियन छवियों के पार प्रशिक्षित, SAM को "जीरो-शॉट" प्रदर्शन के साथ सेगमेंटेशन के लिए एक प्रॉम्प्टेबल फाउंडेशन मॉडल के रूप में डिज़ाइन किया गया था। चिकित्सा इमेजिंग अनुसंधान में, SAM का मूल्यांकन पूरे-स्लाइड पैथोलॉजी सेगमेंटेशन, ट्यूमर डिटेक्शन, और सेल नाभिक पहचान के लिए किया गया है। हालांकि, घने पैक किए गए उदाहरणों—जैसे सेल नाभिक—पर इसका प्रदर्शन मिश्रित है: व्यापक प्रॉम्प्ट्स (जैसे, 20 क्लिक या बॉक्सेस) के बावजूद, जटिल माइक्रोस्कोपी छवियों में जीरो-शॉट सेगमेंटेशन संघर्ष कर सकता है।

इस सीमा को दूर करने के लिए, डोमेन-विशिष्ट अनुकूलन उभरे हैं:

- SAMCell — बड़े माइक्रोस्कोपी डेटासेट्स पर फाइन-ट्यून किया गया, जो विभिन्न कोशिका प्रकारों में मजबूत जीरो-शॉट सेगमेंटेशन प्रदान करता है बिना प्रति-प्रयोग पुनः प्रशिक्षण के

- μSAM — 17,000 से अधिक मैन्युअल रूप से एनोटेटेड माइक्रोस्कोपी छवियों पर पुनः प्रशिक्षित, छोटे सेलुलर संरचनाओं पर सटीकता सुधारने के लिए

प्रमुख विशेषताएँ

सटीक नियंत्रण के लिए पॉइंट्स, बॉक्सेस, और मास्क का लचीला इंटरैक्शन।

नए छवि डोमेन पर फाइन-ट्यूनिंग के बिना सेगमेंटेशन करता है।

कुछ-शॉट या प्रॉम्प्ट-आधारित पुनः प्रशिक्षण के माध्यम से माइक्रोस्कोपी और हिस्टोपैथोलॉजी के लिए अनुकूलनीय।

माइक्रोस्कोपी इमेज ब्राउज़र (MIB) में 3D और इंटरपोलेटेड सेगमेंटेशन समर्थन के साथ उपलब्ध।

IDCC-SAM इम्यूनोसाइटोकेमिस्ट्री में मैनुअल एनोटेशन के बिना स्वचालित सेल काउंटिंग सक्षम करता है।

डाउनलोड या एक्सेस

उपयोगकर्ता मार्गदर्शिका

- माइक्रोस्कोपी इमेज ब्राउज़र खोलें और SAM सेगमेंटेशन पैनल पर जाएं

- पायथन इंटरप्रेटर कॉन्फ़िगर करें और SAM-1 या SAM-2 मॉडल में से चुनें

- GPU त्वरक के लिए, निष्पादन वातावरण में "cuda" चुनें (उत्तम प्रदर्शन के लिए अनुशंसित)

- पॉइंट प्रॉम्प्ट्स: किसी वस्तु पर क्लिक करके पॉजिटिव सीड परिभाषित करें; विस्तार के लिए Shift + क्लिक और नकारात्मक सीड के लिए Ctrl + क्लिक का उपयोग करें

- 3D स्टैक्स: इंटरैक्टिव 3D मोड का उपयोग करें—एक स्लाइस पर क्लिक करें, शिफ्ट-स्क्रॉल करें, और स्लाइस के बीच सीड इंटरपोलेट करें

- समायोजन मोड: मास्क को बदलें, जोड़ें, घटाएं, या आवश्यकतानुसार नया लेयर बनाएं

- MIB के SAM-2 पैनल में "ऑटोमैटिक एवरीथिंग" विकल्प का उपयोग करके क्षेत्र में सभी दिखाई देने वाली वस्तुओं का सेगमेंटेशन करें

- सेगमेंटेशन के बाद मास्क की समीक्षा और सुधार करें

- स्पार्स उपयोगकर्ता प्रॉम्प्ट्स से पिक्सेल-स्तरीय एनोटेशन उत्पन्न करने के लिए प्रॉम्प्ट-आधारित फाइन-ट्यूनिंग पाइपलाइनों (जैसे, "ऑल-इन-SAM") का उपयोग करें

- सेल काउंटिंग के लिए, IDCC-SAM लागू करें, जो पोस्ट-प्रोसेसिंग के साथ SAM का जीरो-शॉट पाइपलाइन में उपयोग करता है

- उच्च-सटीकता सेल सेगमेंटेशन के लिए, माइक्रोस्कोपी सेल छवियों पर फाइन-ट्यून किया गया SAMCell का उपयोग करें

सीमाएँ और विचार

- डोमेन ट्यूनिंग के बिना घने या ओवरलैपिंग संरचनाओं पर जीरो-शॉट प्रदर्शन असंगत

- सेगमेंटेशन गुणवत्ता प्रॉम्प्ट डिज़ाइन और रणनीति पर बहुत निर्भर

- GPU अत्यधिक अनुशंसित; CPU निष्कर्षण बहुत धीमा है

- बहुत उच्च-रिज़ॉल्यूशन पूरे-स्लाइड छवियों और बहु-स्केल ऊतक संरचनाओं के साथ संघर्ष करता है

- माइक्रोस्कोपी के लिए SAM का फाइन-ट्यूनिंग या अनुकूलन मशीन लर्निंग दक्षता की आवश्यकता हो सकती है

अक्सर पूछे जाने वाले प्रश्न

हाँ—ऐसे अनुकूलनों के माध्यम से जैसे SAMCell, जो विशेष रूप से सेल सेगमेंटेशन कार्यों के लिए माइक्रोस्कोपी डेटासेट्स पर SAM को फाइन-ट्यून करता है।

हमेशा नहीं। IDCC-SAM के साथ, आप मैन्युअल एनोटेशन के बिना जीरो-शॉट सेल काउंटिंग कर सकते हैं।

प्रॉम्प्ट-आधारित फाइन-ट्यूनिंग (जैसे, "ऑल-इन-SAM") या पूर्व-प्रशिक्षित माइक्रोस्कोपी संस्करणों जैसे μSAM का उपयोग करें, जिसे 17,000 से अधिक एनोटेटेड माइक्रोस्कोपी छवियों पर प्रशिक्षित किया गया है।

CPU पर संभव होने के बावजूद, व्यावहारिक निष्कर्षण गति और वास्तविक समय इंटरैक्टिव सेगमेंटेशन के लिए GPU अत्यधिक अनुशंसित है।

हाँ—MIB का SAM-2 एकीकरण 3D सेगमेंटेशन का समर्थन करता है जिसमें स्लाइस के बीच सीड इंटरपोलेशन शामिल है, जो आयतन विश्लेषण के लिए उपयुक्त है।

AxonDeepSeg

| डेवलपर | Polytechnique Montréal और Université de Montréal में NeuroPoly Lab |

| समर्थित प्लेटफ़ॉर्म |

|

| भाषा | अंग्रेज़ी दस्तावेज़; वैश्विक रूप से उपयोग किया जाने वाला ओपन-सोर्स टूल |

| मूल्य निर्धारण | मुफ़्त और ओपन-सोर्स |

अवलोकन

AxonDeepSeg माइक्रोस्कोपी छवियों में एक्सोन और माइलिन के स्वचालित सेगमेंटेशन के लिए एआई-संचालित उपकरण है। कन्वोल्यूशनल न्यूरल नेटवर्क का उपयोग करते हुए, यह TEM, SEM, और ब्राइट-फील्ड माइक्रोस्कोपी सहित कई इमेजिंग मोडालिटीज़ में सटीक तीन-क्लास सेगमेंटेशन (एक्सोन, माइलिन, पृष्ठभूमि) प्रदान करता है। एक्सोन व्यास, g-राशि, और माइलिन मोटाई जैसे मर्फोमेट्रिक मापों को स्वचालित करके, AxonDeepSeg न्यूरोसाइंस अनुसंधान में मात्रात्मक विश्लेषण को सरल बनाता है, मैनुअल एनोटेशन समय को काफी कम करता है और पुनरुत्पादकता में सुधार करता है।

मुख्य विशेषताएँ

TEM, SEM, और ब्राइट-फील्ड माइक्रोस्कोपी मोडालिटीज़ के लिए तैयार-से-उपयोग मॉडल।

माइक्रोस्कोपी छवियों में एक्सोन, माइलिन, और पृष्ठभूमि क्षेत्रों का सटीक वर्गीकरण।

एक्सोन व्यास, g-राशि, माइलिन मोटाई, और घनत्व मेट्रिक्स की स्वचालित गणना।

Napari GUI एकीकरण सेगमेंटेशन मास्क के मैनुअल सुधार को सक्षम बनाता है ताकि सटीकता बढ़े।

बड़े पैमाने पर न्यूरल टिशू विश्लेषण के लिए कस्टम पाइपलाइनों में सहज एकीकरण।

व्यापक टेस्ट स्क्रिप्ट्स पुनरुत्पादकता और विश्वसनीय सेगमेंटेशन परिणाम सुनिश्चित करते हैं।

तकनीकी विवरण

NeuroPoly Lab द्वारा विकसित, AxonDeepSeg न्यूरोसाइंटिफिक अनुप्रयोगों के लिए उच्च-सटीकता सेगमेंटेशन प्रदान करने के लिए डीप लर्निंग का उपयोग करता है। विभिन्न माइक्रोस्कोपी मोडालिटीज़ के लिए पूर्व-प्रशिक्षित मॉडल उपलब्ध हैं, जो इमेजिंग तकनीकों में बहुमुखी प्रतिभा सुनिश्चित करते हैं। यह उपकरण Napari के साथ एकीकृत होता है, जो चुनौतीपूर्ण डेटासेट पर सटीकता बढ़ाने के लिए सेगमेंटेशन मास्क के इंटरैक्टिव सुधार की अनुमति देता है। AxonDeepSeg प्रमुख मर्फोमेट्रिक मेट्रिक्स की गणना करता है, जो न्यूरल टिशू संरचना और रोग विज्ञान के उच्च-थ्रूपुट अध्ययनों का समर्थन करता है। इसका पाइथन-आधारित फ्रेमवर्क एक्सोन और माइलिन आकृति के बड़े पैमाने पर विश्लेषण के लिए कस्टम पाइपलाइनों में एकीकरण सक्षम बनाता है।

डाउनलोड या एक्सेस

स्थापना और सेटअप

सुनिश्चित करें कि Python 3.8 या बाद का संस्करण स्थापित है, फिर pip का उपयोग करके AxonDeepSeg और Napari स्थापित करें:

pip install axondeepseg napariसुनिश्चित करने के लिए प्रदान किए गए टेस्ट स्क्रिप्ट्स चलाएँ कि सभी घटक सही ढंग से स्थापित और कार्यरत हैं।

Napari या अपने पाइथन वातावरण में माइक्रोस्कोपी छवियाँ (TEM, SEM, या ब्राइट-फील्ड) आयात करें।

अपनी इमेजिंग मोडालिटी के लिए उपयुक्त पूर्व-प्रशिक्षित मॉडल चुनें और एक्सोन तथा माइलिन मास्क उत्पन्न करने के लिए सेगमेंटेशन चलाएँ।

स्वचालित रूप से मर्फोमेट्रिक माप जैसे एक्सोन व्यास, g-राशि, घनत्व, और माइलिन मोटाई की गणना करें, फिर परिणाम CSV प्रारूप में निर्यात करें।

जहाँ आवश्यक हो, बेहतर सटीकता के लिए Napari GUI का उपयोग करके सेगमेंटेशन मास्क को मैनुअल रूप से समायोजित करें, मास्क को मर्ज या डिलीट करें।

महत्वपूर्ण विचार

- नवीन या बिना प्रशिक्षण वाली इमेजिंग मोडालिटीज़ पर प्रदर्शन कम हो सकता है

- चुनौतीपूर्ण या जटिल क्षेत्रों के लिए मैनुअल सुधार आवश्यक हो सकते हैं

- बड़े डेटासेट के तेज़ प्रसंस्करण के लिए GPU की सिफारिश की जाती है; CPU प्रसंस्करण भी समर्थित है

अक्सर पूछे जाने वाले प्रश्न

AxonDeepSeg TEM (ट्रांसमिशन इलेक्ट्रॉन माइक्रोस्कोपी), SEM (स्कैनिंग इलेक्ट्रॉन माइक्रोस्कोपी), और ब्राइट-फील्ड माइक्रोस्कोपी का समर्थन करता है, प्रत्येक मोडालिटी के लिए अनुकूलित पूर्व-प्रशिक्षित मॉडल के साथ।

हाँ, AxonDeepSeg पूरी तरह से मुफ्त और ओपन-सोर्स है, शैक्षणिक और व्यावसायिक उपयोग के लिए उपलब्ध।

हाँ, AxonDeepSeg सेगमेंट की गई छवियों से एक्सोन व्यास, g-राशि, माइलिन मोटाई, और घनत्व मेट्रिक्स स्वचालित रूप से गणना करता है।

बड़े डेटासेट के तेज़ सेगमेंटेशन के लिए GPU की सिफारिश की जाती है, लेकिन छोटे विश्लेषणों के लिए CPU प्रसंस्करण भी समर्थित है।

हाँ, Napari GUI एकीकरण चुनौतीपूर्ण क्षेत्रों पर उच्च सटीकता के लिए सेगमेंटेशन मास्क के इंटरैक्टिव सुधार और परिष्करण की अनुमति देता है।

Ilastik

| डेवलपर | यूरोपीय आणविक जीवविज्ञान प्रयोगशाला (EMBL) में Ilastik टीम और संबंधित शैक्षणिक साझेदार |

| समर्थित प्लेटफ़ॉर्म |

|

| भाषा | अंग्रेज़ी |

| मूल्य निर्धारण | मुफ़्त और ओपन-सोर्स |

अवलोकन

Ilastik एक शक्तिशाली, AI-संचालित उपकरण है जो माइक्रोस्कोपी डेटा के इंटरैक्टिव इमेज सेगमेंटेशन, वर्गीकरण, और विश्लेषण के लिए है। रैंडम फॉरेस्ट क्लासिफायर जैसे मशीन लर्निंग तकनीकों का उपयोग करते हुए, यह शोधकर्ताओं को पिक्सेल सेगमेंट करने, ऑब्जेक्ट वर्गीकृत करने, समय के साथ कोशिकाओं को ट्रैक करने, और 2D और 3D दोनों डेटासेट में डेंसिटी काउंटिंग करने में सक्षम बनाता है। इसके सहज इंटरफ़ेस और रियल-टाइम फीडबैक के साथ, Ilastik उन वैज्ञानिकों के लिए सुलभ है जिनके पास प्रोग्रामिंग विशेषज्ञता नहीं है और यह सेल बायोलॉजी, न्यूरोसाइंस, और बायोमेडिकल इमेजिंग में व्यापक रूप से अपनाया गया है।

मुख्य विशेषताएँ

प्रतिनिधि क्षेत्रों को एनोटेट करते समय त्वरित सेगमेंटेशन परिणामों के लिए रियल-टाइम फीडबैक।

आकार और तीव्रता विशेषताओं के आधार पर सेगमेंट किए गए संरचनाओं को वर्गीकृत करें।

2D और 3D टाइम-लैप माइक्रोस्कोपी प्रयोगों में कोशिका की गति और विभाजन को ट्रैक करें।

व्यक्तिगत ऑब्जेक्ट के स्पष्ट सेगमेंटेशन के बिना भीड़-भाड़ वाले क्षेत्रों की मात्रा को मापें।

जटिल 3D वॉल्यूम के लिए सहज इंटरैक्शन के साथ अर्ध-स्वचालित सेगमेंटेशन।

हेडलैस कमांड-लाइन मोड का उपयोग करके कई छवियों को स्वचालित रूप से प्रोसेस करें।

डाउनलोड

आरंभिक मार्गदर्शिका

अपने ऑपरेटिंग सिस्टम के लिए आधिकारिक वेबसाइट से Ilastik डाउनलोड करें। पैकेज में सभी आवश्यक Python निर्भरताएँ शामिल हैं, इसलिए अपने प्लेटफ़ॉर्म के लिए स्थापना निर्देशों का पालन करें।

Ilastik खोलें और अपना विश्लेषण वर्कफ़्लो चुनें: पिक्सेल वर्गीकरण, ऑब्जेक्ट वर्गीकरण, ट्रैकिंग, या डेंसिटी काउंटिंग। अपनी इमेज डेटासेट लोड करें, जिसमें मल्टी-चैनल, 3D, या टाइम-लैप इमेज शामिल हो सकते हैं।

अपनी छवियों में कुछ प्रतिनिधि पिक्सेल या ऑब्जेक्ट्स को लेबल करें। Ilastik का रैंडम फॉरेस्ट क्लासिफायर इन एनोटेशन से सीखता है और स्वचालित रूप से पूरे डेटासेट में लेबल की भविष्यवाणी करता है।

प्रशिक्षित मॉडल को अपने पूरे डेटासेट पर लागू करें ताकि सेगमेंटेशन या वर्गीकरण किया जा सके। परिणामों को लेबल की गई छवियों, संभावना मानचित्रों, या मात्रात्मक तालिकाओं के रूप में निर्यात करें ताकि आगे विश्लेषण और विज़ुअलाइज़ेशन किया जा सके।

बड़े पैमाने पर विश्लेषण पाइपलाइनों के लिए, Ilastik के हेडलेस मोड का उपयोग करके कई छवियों को बिना मैनुअल हस्तक्षेप के स्वचालित रूप से प्रोसेस करें।

सीमाएँ और विचार

- इंटरैक्टिव लेबलिंग बहुत बड़े डेटासेट के लिए समय लेने वाली हो सकती है

- सटीकता निर्भर करती है उपयोगकर्ता एनोटेशन की गुणवत्ता और प्रतिनिधित्व पर

- मेमोरी आवश्यकताएँ — बहुत उच्च-रिज़ॉल्यूशन या मल्टी-गीगाबाइट डेटासेट के लिए पर्याप्त RAM की आवश्यकता हो सकती है

- जटिल डेटा — रैंडम फॉरेस्ट क्लासिफायर अत्यधिक परिवर्तनशील या जटिल इमेजिंग डेटा पर गहरे न्यूरल नेटवर्क की तुलना में कम प्रदर्शन कर सकता है

अक्सर पूछे जाने वाले प्रश्न

हाँ, Ilastik पूरी तरह से 3D वॉल्यूम और टाइम-लैप प्रयोगों का समर्थन करता है, सेगमेंटेशन, ट्रैकिंग, और कई समय बिंदुओं पर मात्रात्मक विश्लेषण के लिए।

हाँ, Ilastik पूरी तरह से मुफ्त और ओपन-सोर्स है, सभी उपयोगकर्ताओं के लिए बिना लाइसेंस प्रतिबंधों के उपलब्ध।

नहीं, Ilastik एक सहज ग्राफिकल इंटरफ़ेस प्रदान करता है जिसमें रियल-टाइम फीडबैक होता है, जिससे यह प्रोग्रामिंग विशेषज्ञता के बिना शोधकर्ताओं के लिए सुलभ है। उन्नत उपयोगकर्ता कमांड-लाइन बैच प्रोसेसिंग भी कर सकते हैं।

हाँ, समर्पित ट्रैकिंग वर्कफ़्लो 2D और 3D टाइम-लैप डेटासेट में कोशिका की गति और विभाजन के विश्लेषण के लिए स्वचालित वंशावली ट्रैकिंग सक्षम करता है।

सेगमेंटेशन आउटपुट को लेबल की गई छवियों, संभावना मानचित्रों, या मात्रात्मक तालिकाओं के रूप में निर्यात किया जा सकता है, जिससे आगे विश्लेषण उपकरणों और विज़ुअलाइज़ेशन सॉफ़्टवेयर के साथ सहज एकीकरण संभव होता है।

ये उपकरण नौसिखिया से विशेषज्ञ स्तर तक फैले हैं। कई मुफ्त और ओपन-सोर्स हैं, जो शोध समुदाय में पुनरुत्पादन योग्य और साझा करने योग्य एआई कार्यप्रवाह को सुविधाजनक बनाते हैं।

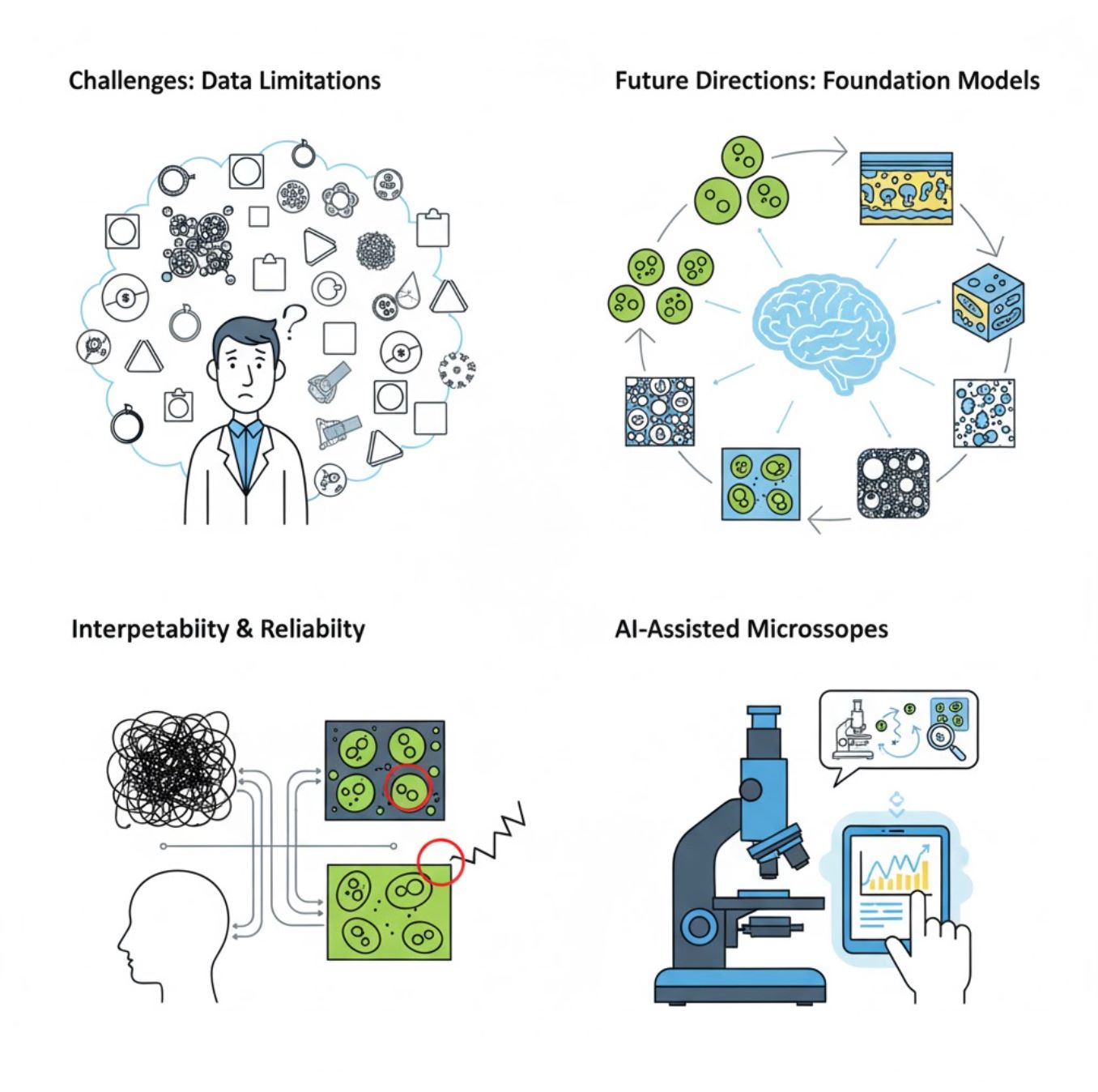

चुनौतियाँ और भविष्य की दिशा

वर्तमान चुनौतियाँ

उभरते रुझान

विजन फाउंडेशन मॉडल

अगली पीढ़ी के एआई सिस्टम कार्य-विशिष्ट प्रशिक्षण की आवश्यकता को कम करने का वादा करते हैं।

- एसएएम और क्लिप-आधारित सिस्टम जैसे मॉडल

- एक एआई कई सूक्ष्मदर्शी कार्य संभालता है

- तेज तैनाती और अनुकूलन

एआई-सहायता प्राप्त सूक्ष्मदर्शी

पूर्ण स्वायत्त और बुद्धिमान सूक्ष्मदर्शी सिस्टम वास्तविकता बन रहे हैं।

- एलएलएम के माध्यम से प्राकृतिक भाषा नियंत्रण

- पूर्ण स्वचालित फीडबैक लूप

- उन्नत सूक्ष्मदर्शी पहुंच को लोकतांत्रित करता है

मुख्य निष्कर्ष

- एआई तेजी से सूक्ष्मदर्शी छवि प्रसंस्करण को बेहतर सटीकता और स्वचालन के साथ बदल रहा है

- डीप लर्निंग जटिल, परिवर्तनीय सूक्ष्मदर्शी छवियों पर पारंपरिक मशीन लर्निंग से बेहतर प्रदर्शन करता है

- सीएनएन कच्चे पिक्सल से पदानुक्रमित फीचर्स स्वचालित रूप से सीखते हैं जो मजबूत विश्लेषण के लिए आवश्यक हैं

- प्रमुख अनुप्रयोगों में विभाजन, वर्गीकरण, ट्रैकिंग, शोर कम करना, और स्वचालित अधिग्रहण शामिल हैं

- सफलता गुणवत्ता डेटा और विशेषज्ञों द्वारा सावधानीपूर्वक सत्यापन पर निर्भर करती है

- विजन फाउंडेशन मॉडल और एआई-सहायता प्राप्त सूक्ष्मदर्शी क्षेत्र का भविष्य हैं

लगातार प्रगति और सामुदायिक प्रयासों (ओपन-सोर्स उपकरण, साझा डेटासेट) के साथ, एआई सूक्ष्मदर्शी की "आंख" का एक मुख्य हिस्सा बनता जाएगा, जिससे वैज्ञानिक अनदेखे को देख सकेंगे।

No comments yet. Be the first to comment!