Sztuczna inteligencja w przetwarzaniu obrazów mikroskopowych

Sztuczna inteligencja rewolucjonizuje przetwarzanie obrazów mikroskopowych dzięki potężnym możliwościom, takim jak precyzyjna segmentacja, redukcja szumów, superrozdzielczość oraz automatyczne pozyskiwanie obrazów. Artykuł przedstawia kluczowe narzędzia SI oraz najnowsze trendy w badaniach naukowych.

Techniki sztucznej inteligencji rewolucjonizują mikroskopię poprzez optymalizację pozyskiwania obrazów oraz automatyzację analizy. W nowoczesnych inteligentnych mikroskopach moduły SI mogą na bieżąco dostosowywać parametry obrazowania (np. ostrość, oświetlenie), aby zminimalizować fotobleczenie i wzmocnić sygnał. Tymczasem algorytmy głębokiego uczenia potrafią przeszukiwać złożone dane obrazowe, wydobywając ukryte biologiczne informacje, a nawet łączyć obrazy z innymi danymi (np. genomiką).

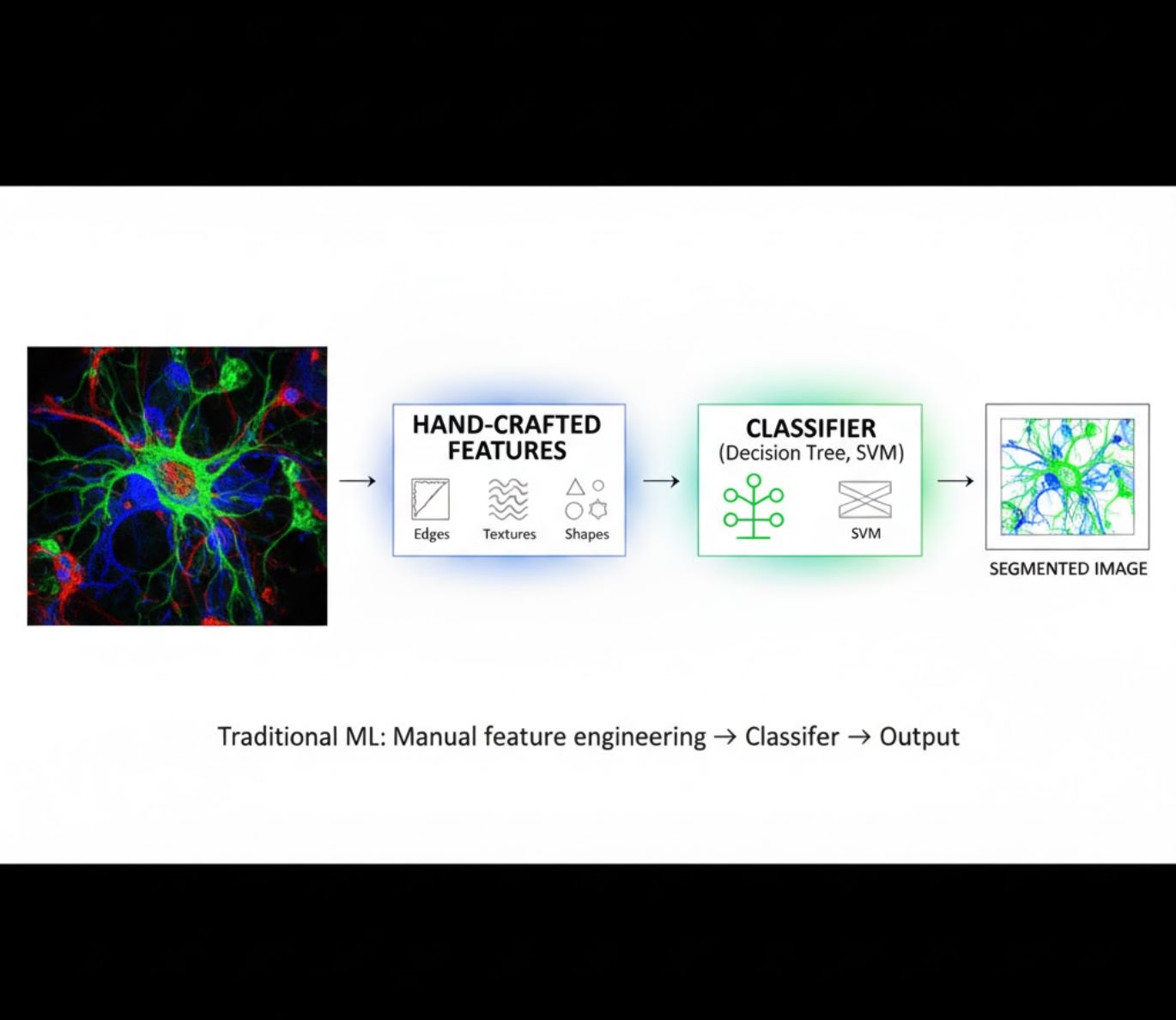

Metody SI: uczenie maszynowe kontra głębokie

Metody SI obejmują klasyczne uczenie maszynowe (ML) oraz nowoczesne głębokie uczenie (DL). Każde podejście ma swoje mocne i słabe strony:

Ręcznie tworzone cechy

- Badacze ręcznie definiują cechy obrazu (krawędzie, tekstury, kształty)

- Cechy przekazywane do klasyfikatorów (drzewa decyzyjne, SVM)

- Szybkie trenowanie

- Problemy z obrazami złożonymi lub zaszumionymi

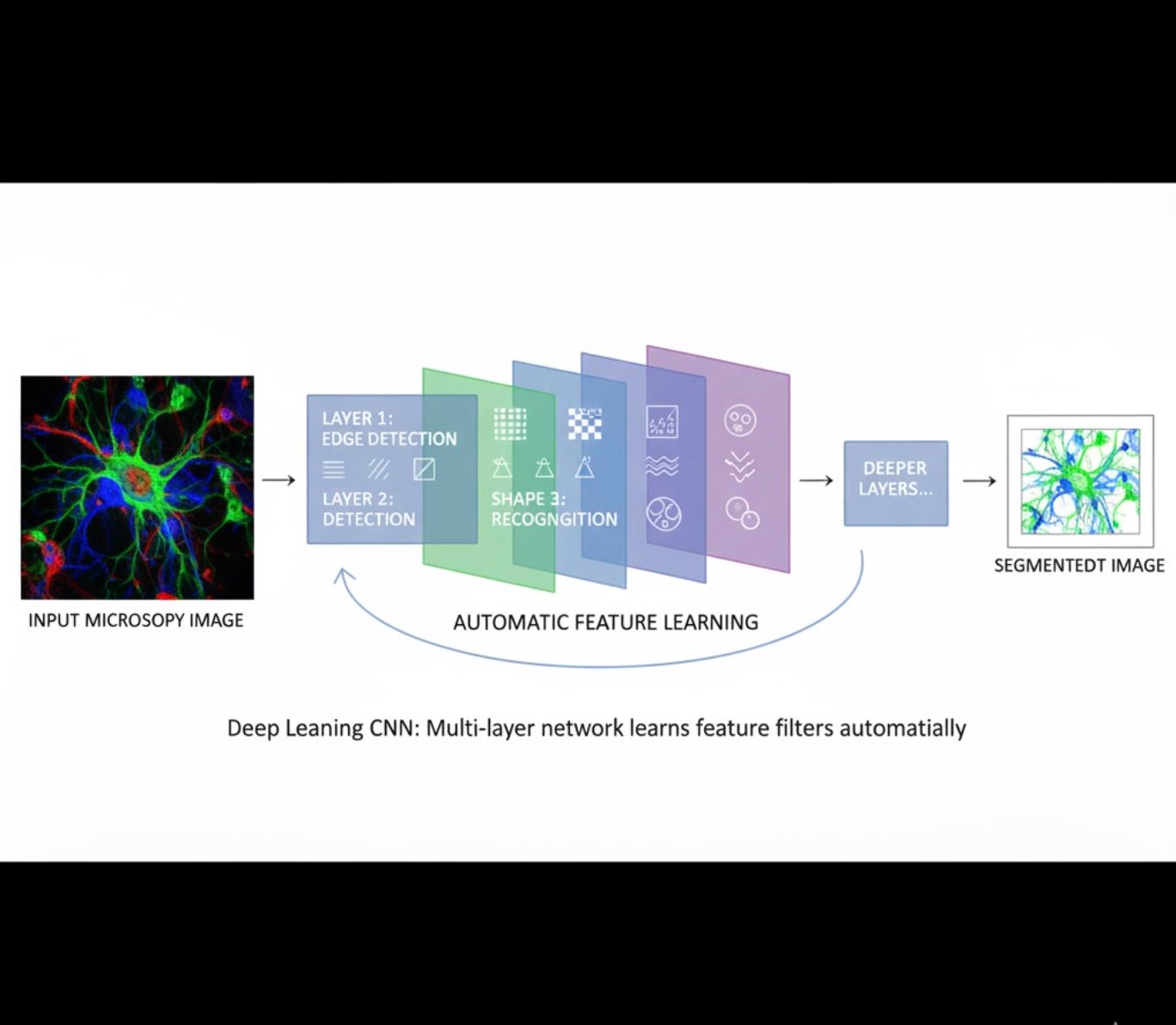

Automatyczne uczenie cech

- Wielowarstwowe sieci neuronowe (CNN) uczą się cech automatycznie

- Uczenie end-to-end z surowych pikseli

- Znacznie bardziej odporne na zmienność

- Skutecznie wychwytuje złożone tekstury i struktury

Jak działają CNN: Konwolucyjne sieci neuronowe stosują kolejne filtry do obrazów mikroskopowych, ucząc się wykrywać proste wzorce (krawędzie) na wczesnych warstwach oraz złożone struktury (kształty komórek, tekstury) na głębszych. Ta hierarchiczna nauka sprawia, że DL jest wyjątkowo odporne nawet przy dużych różnicach w profilach intensywności.

Porównanie wizualne: pipeline ML kontra DL

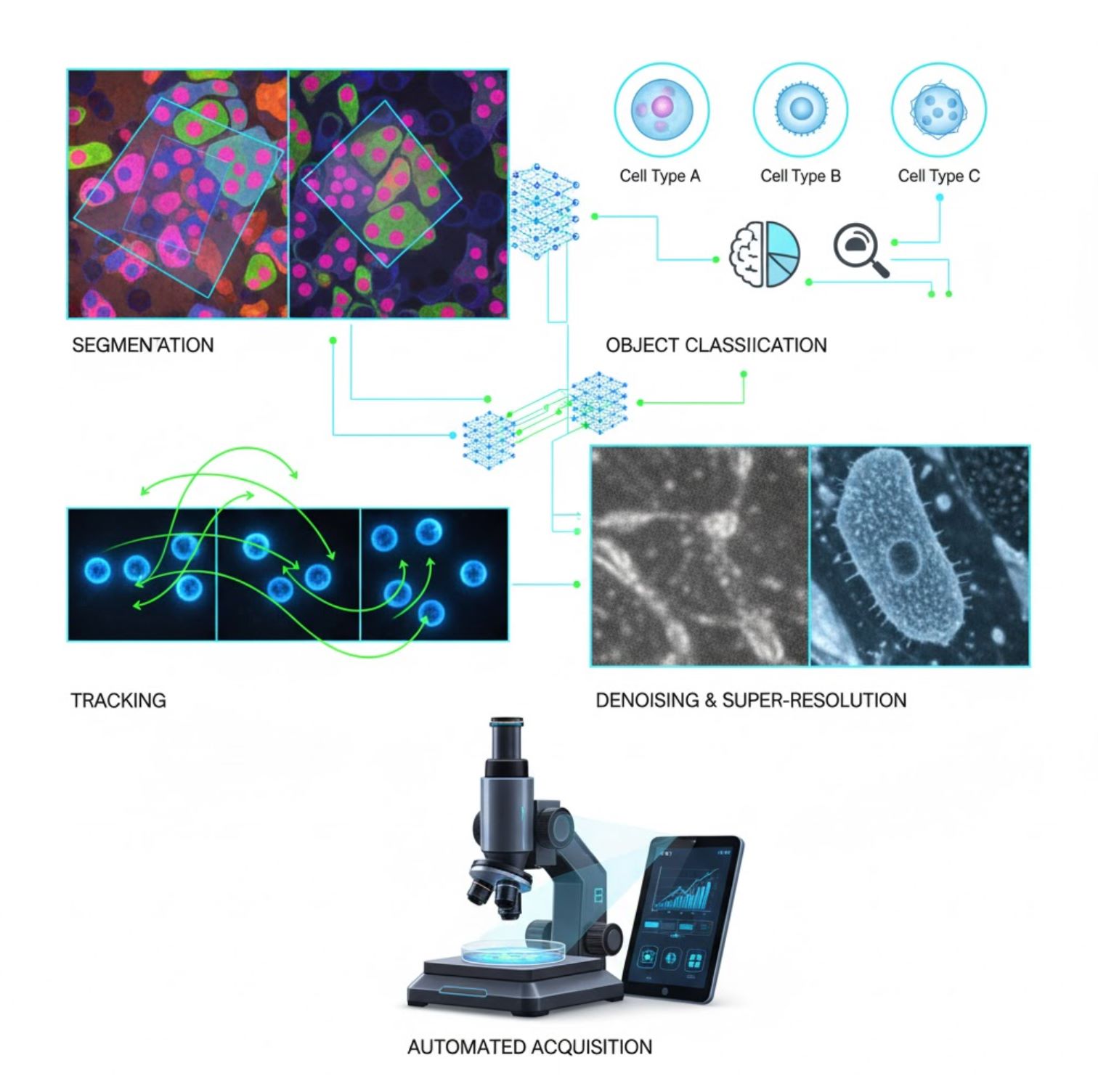

Kluczowe zastosowania SI w mikroskopii

SI jest obecnie wbudowana w wiele zadań przetwarzania obrazów w całym procesie mikroskopowym:

Segmentacja

Podział obrazów na regiony (np. identyfikacja każdej komórki lub jądra). Sieci głębokie, takie jak U-Net, doskonale radzą sobie z tym zadaniem.

- Segmentacja semantyczna: etykiety klas na poziomie pikseli

- Segmentacja instancji: rozdzielanie pojedynczych obiektów

- Wysoka dokładność na zatłoczonych lub słabo oświetlonych obrazach

- Modele bazowe wizji (np. μSAM) dostosowane do mikroskopii

Klasyfikacja obiektów

Po segmentacji SI precyzyjnie klasyfikuje każdy obiekt.

- Identyfikacja typów komórek

- Określanie fazy mitozy

- Wykrywanie wskaźników patologii

- Rozróżnianie subtelnych fenotypów trudnych do manualnej oceny

Śledzenie

W mikroskopii czasowo-przestrzennej SI śledzi komórki lub cząstki między klatkami z niespotykaną dokładnością.

- Głębokie uczenie znacząco poprawia precyzję śledzenia

- Umożliwia wiarygodną analizę ruchu komórek

- Rejestruje dynamiczne procesy biologiczne

Redukcja szumów i superrozdzielczość

Modele SI poprawiają jakość obrazów, usuwając szumy i rozmycia.

- Modele głębokie oparte na fizyce uczą się optyki mikroskopu

- Rekonstrukcja ostrzejszych, wolnych od artefaktów obrazów

- Wyższa rozdzielczość z mniejszą ilością artefaktów w porównaniu do metod tradycyjnych

Automatyczne pozyskiwanie

SI steruje mikroskopem w czasie rzeczywistym.

- Analizuje obrazy na żywo, podejmując inteligentne decyzje

- Automatycznie reguluje ostrość i skanuje obszary zainteresowania

- Zmniejsza fototoksyczność i oszczędza czas

- Umożliwia eksperymenty o wysokiej przepustowości i adaptacyjne obrazowanie

Popularne narzędzia SI w przetwarzaniu obrazów mikroskopowych

Bogaty ekosystem narzędzi wspiera sztuczną inteligencję w mikroskopii. Naukowcy opracowali zarówno uniwersalne, jak i specjalistyczne oprogramowanie, wiele z nich jest open-source:

Cellpose

| Twórcy | Carsen Stringer oraz Marius Pachitariu (grupa badawcza MouseLand) |

| Obsługiwane platformy |

Wymaga Pythona (instalacja przez pip/conda). GUI dostępne tylko na komputerach stacjonarnych. |

| Obsługa językowa | Dokumentacja w języku angielskim; powszechnie stosowany w laboratoriach badawczych na całym świecie |

| Model cenowy | Darmowy i otwartoźródłowy na licencji BSD-3-Clause |

Przegląd

Cellpose to zaawansowane narzędzie do segmentacji oparte na głębokim uczeniu, przeznaczone do obrazów mikroskopowych. Jako algorytm uniwersalny, precyzyjnie segmentuje różnorodne typy komórek (jądra, cytoplazma itd.) w różnych modalnościach obrazowania, bez konieczności ponownego trenowania modelu. Dzięki funkcjom z udziałem użytkownika, badacze mogą udoskonalać wyniki, dostosowywać model do własnych danych oraz stosować system zarówno w przepływach pracy 2D, jak i 3D.

Kluczowe cechy

Działa od razu dla szerokiego zakresu typów komórek, barwień i modalności obrazowania bez potrzeby indywidualnego treningu.

Obsługuje pełne stosy 3D, wykorzystując podejście „2,5D”, które ponownie wykorzystuje modele 2D do danych wolumetrycznych.

Ręczna korekta wyników segmentacji i ponowne trenowanie modelu na własnych danych dla lepszej dokładności.

Dostęp przez Python API, interfejs wiersza poleceń lub graficzny interfejs użytkownika dla elastycznych przepływów pracy.

Możliwości usuwania szumów, odszumiania i powiększania obrazu w celu poprawy jakości przed segmentacją.

Pobierz lub uzyskaj dostęp

Tło techniczne

Cellpose został przedstawiony w przełomowym badaniu autorstwa Stringera, Wanga, Michaelosa i Pachitariua, wytrenowany na dużym i bardzo zróżnicowanym zbiorze danych zawierającym ponad 70 000 segmentowanych obiektów. Ta różnorodność pozwala modelowi uogólniać się na różne kształty i rozmiary komórek oraz ustawienia mikroskopowe, znacznie ograniczając potrzebę indywidualnego treningu w większości zastosowań. Dla danych 3D Cellpose sprytnie wykorzystuje swój model 2D w podejściu „2,5D”, unikając konieczności posiadania w pełni oznaczonych danych treningowych 3D, a jednocześnie dostarczając segmentację wolumetryczną. Cellpose 2.0 wprowadził trenowanie z udziałem użytkownika, umożliwiające ręczną korektę predykcji i ponowne trenowanie na własnych obrazach dla lepszej wydajności na konkretnych zbiorach danych.

Instalacja i konfiguracja

Skonfiguruj środowisko Python za pomocą conda:

conda create -n cellpose python=3.10Aktywuj środowisko i zainstaluj Cellpose:

# For GUI support

pip install cellpose[gui]

# For minimal setup (API/CLI only)

pip install cellposePierwsze kroki

Tryb GUI

- Uruchom GUI, wykonując:

python -m cellpose - Przeciągnij i upuść pliki obrazów (

.tif,.pngitd.) do interfejsu - Wybierz typ modelu (np. „cyto” dla cytoplazmy lub „nuclei” dla jąder)

- Ustaw szacowaną średnicę komórki lub pozwól Cellpose na automatyczną kalibrację

- Kliknij, aby rozpocząć segmentację i zobaczyć wyniki

Tryb Python API

from cellpose import models

# Load model

model = models.Cellpose(model_type='cyto')

# Segment images

masks, flows = model.eval(images, diameter=30)Udoskonalanie i ponowne trenowanie

- Po wygenerowaniu masek popraw segmentację w GUI, łącząc lub usuwając maski ręcznie

- Użyj wbudowanych funkcji treningowych, aby ponownie wytrenować model na poprawionych przykładach

- Uzyskaj lepszą wydajność modelu na własnym zbiorze danych

Przetwarzanie danych 3D

- Załaduj wielowarstwowy TIFF lub stos wolumetryczny

- Użyj flagi

--Zstackw GUI lub API, aby przetwarzać dane jako 3D - Opcjonalnie udoskonal przepływy 3D przez wygładzanie lub specjalne parametry dla lepszej segmentacji

Ograniczenia i uwagi

- Kompleksowość modelu: Choć model uniwersalny działa szeroko, bardzo nietypowe kształty komórek lub warunki obrazowania mogą wymagać ponownego trenowania.

- Wysiłek anotacji: Trenowanie z udziałem użytkownika wymaga ręcznych korekt, co może być czasochłonne przy dużych zbiorach danych.

- Trudności instalacyjne: Instalacja GUI może wymagać użycia wiersza poleceń, środowisk conda i zarządzania zależnościami Pythona — nie zawsze jest to proste dla osób bez doświadczenia programistycznego.

- Tylko na komputery stacjonarne: Cellpose jest przeznaczony do użytku na komputerach stacjonarnych; brak natywnych aplikacji na Androida lub iOS.

Najczęściej zadawane pytania

Nie — Cellpose oferuje wstępnie wytrenowane, uniwersalne modele, które często działają dobrze bez ponownego trenowania. Jednak dla optymalnych wyników na specjalnych lub nietypowych danych można anotować i ponownie trenować model z wykorzystaniem funkcji z udziałem użytkownika.

Tak — obsługuje 3D, ponownie wykorzystując swój model 2D (tzw. „2,5D”), a także można przetwarzać stosy wolumetryczne przez GUI lub API.

Karta GPU jest wysoce zalecana dla szybszego działania i treningu, zwłaszcza na dużych lub 3D zbiorach danych, ale Cellpose może działać na maszynach z samym CPU, choć z wolniejszą wydajnością.

W GUI można ręcznie ustawić szacowaną średnicę komórki lub pozwolić Cellpose na automatyczną kalibrację. Można też udoskonalać wyniki i ponownie trenować model, jeśli segmentacja nie jest optymalna.

Tak — nowsze wersje (Cellpose 3) zawierają modele do odtwarzania obrazu, które usuwają szumy, rozmycia i powiększają obraz, poprawiając jakość segmentacji przed przetwarzaniem.

StarDist

| Twórcy | Uwe Schmidt, Martin Weigert, Coleman Broaddus oraz Gene Myers |

| Obsługiwane platformy |

|

| Obsługa językowa | Projekt open-source z dokumentacją i społecznością głównie w języku angielskim |

| Model cenowy | Darmowy i otwartoźródłowy. Licencjonowany na podstawie BSD-3-Clause |

Przegląd

StarDist to narzędzie uczenia głębokiego do segmentacji instancji w obrazach mikroskopowych. Reprezentuje każdy obiekt (np. jądra komórkowe) jako wielokąt gwiaździstokonweksowy w 2D lub wielościan w 3D, co umożliwia dokładne wykrywanie i rozdzielanie gęsto upakowanych lub nakładających się obiektów. Dzięki solidnej architekturze StarDist jest szeroko stosowany do automatycznej segmentacji komórek i jąder w mikroskopii fluorescencyjnej, histopatologii oraz innych zastosowaniach analizy bioobrazów.

Kluczowe cechy

Bardzo dokładna segmentacja instancji z użyciem wielokątów gwiaździstokonweksowych (2D) i wielościanów (3D) dla niezawodnego wykrywania obiektów.

Dedykowane modele zarówno dla obrazów 2D, jak i danych wolumetrycznych 3D, zapewniające kompleksową analizę mikroskopową.

Gotowe do użycia modele dla jąder fluorescencyjnych, histologii barwionej H&E oraz innych popularnych scenariuszy obrazowania.

Klasyfikacja wykrytych obiektów do różnych klas (np. różnych typów komórek) w jednym przebiegu segmentacji.

Płynna integracja z ImageJ/Fiji, QuPath i napari dla wygodnych przepływów pracy opartych na GUI.

Kompleksowa ocena segmentacji instancji obejmująca precyzję, czułość, F1 oraz jakość panoptyczną.

Tło techniczne

Pierwotnie przedstawiony w artykule MICCAI 2018, kluczową innowacją StarDist jest przewidywanie odległości radialnych wzdłuż ustalonych promieni wraz z prawdopodobieństwem obiektu dla każdego piksela, co umożliwia dokładną rekonstrukcję kształtów gwiaździstokonweksowych. Podejście to skutecznie segmentuje ściśle przylegające obiekty, które trudno rozdzielić tradycyjnymi metodami opartymi na pikselach lub ramkach ograniczających.

Ostatnie rozwinięcia rozszerzyły StarDist na obrazy histopatologiczne, umożliwiając nie tylko segmentację jąder, ale także klasyfikację wieloklasową wykrytych obiektów. Metoda osiągnęła czołowe wyniki w wyzwaniach takich jak CoNIC (Colon Nuclei Identification and Counting).

Pobierz lub uzyskaj dostęp

Instalacja i konfiguracja

Zainstaluj TensorFlow (wersja 1.x lub 2.x) jako wymóg wstępny dla StarDist.

Użyj pip, aby zainstalować pakiet StarDist dla Pythona:

pip install stardistDla napari:

pip install stardist-napariDla QuPath: Zainstaluj rozszerzenie StarDist, przeciągając plik .jar do QuPath.

Dla ImageJ/Fiji: Użyj wbudowanego menedżera wtyczek lub instalacji ręcznej przez menu wtyczek.

Uruchamianie segmentacji

Wczytaj model wstępnie wytrenowany, znormalizuj obraz i uruchom predykcję:

from stardist.models import StarDist2D

model = StarDist2D.from_pretrained('2D_versatile_fluo')

labels, details = model.predict_instances(image)Otwórz obraz w napari, wybierz wtyczkę StarDist, wybierz model wstępnie wytrenowany lub własny i uruchom predykcję bezpośrednio z GUI.

Użyj wtyczki StarDist z menu Wtyczki, aby zastosować model na stosie obrazów za pomocą intuicyjnego interfejsu.

Po instalacji rozszerzenia uruchom detekcję StarDist przez konsolę skryptową QuPath lub interfejs graficzny do analizy histopatologicznej.

Trening i dostrajanie

Utwórz obrazy z etykietami prawdy podstawowej, gdzie każdy obiekt jest unikalnie oznaczony. Użyj narzędzi do adnotacji takich jak LabKit, QuPath lub Fiji, aby przygotować swój zestaw danych.

Użyj API Pythona StarDist, aby wytrenować nowy model lub dostroić istniejący na podstawie własnych oznaczonych danych.

Opcje post-processingu

- Zastosuj tłumienie nienajwyższych wartości (NMS) w celu eliminacji nadmiarowych kandydatów na kształty

- Użyj StarDist OPP (Object Post-Processing) do łączenia masek dla kształtów niebędących gwiaździstokonweksowymi

Ograniczenia i uwagi

- Założenie gwiaździstokonweksowości może nie odzwierciedlać idealnie bardzo nieregularnych lub silnie niekonweksowych kształtów

- Kompleksowość instalacji: niestandardowe instalacje wymagają kompatybilnego kompilatora C++ do budowy rozszerzeń

- Przyspieszenie GPU zależy od kompatybilnych wersji TensorFlow, CUDA i cuDNN

- Niektórzy użytkownicy zgłaszają problemy z uruchomieniem wtyczki ImageJ z powodu konfiguracji Javy

Najczęściej zadawane pytania

StarDist działa z różnymi typami obrazów, w tym fluorescencyjnymi, jasnego pola oraz histopatologicznymi (np. H&E), dzięki elastycznym modelom wstępnie wytrenowanym i adaptacji do różnych modalności obrazowania.

Tak — StarDist obsługuje segmentację instancji 3D, wykorzystując gwiaździstokonweksowe wielościany dla danych wolumetrycznych, rozszerzając możliwości 2D na pełną analizę 3D.

Niekoniecznie. Dostępne są modele wstępnie wytrenowane, które często działają dobrze od razu. Jednak dla specjalistycznych lub nowych danych oznaczanie i trenowanie własnych modeli znacząco poprawia dokładność.

StarDist integruje się z napari, ImageJ/Fiji oraz QuPath, umożliwiając uruchamianie segmentacji z GUI bez konieczności programowania. Obsługuje także bezpośrednie użycie API Pythona dla zaawansowanych przepływów pracy.

StarDist oferuje wbudowane funkcje do obliczania popularnych metryk segmentacji instancji, w tym precyzji, czułości, F1 oraz jakości panoptycznej, aby ocenić skuteczność segmentacji.

SAM

Informacje o aplikacji

| Twórca | Meta AI Research (FAIR) |

| Obsługiwane urządzenia |

|

| Język i dostępność | Model podstawowy open-source dostępny globalnie; dokumentacja w języku angielskim |

| Cena | Bezpłatny — open-source na licencji Meta dostępny przez GitHub i integrację z MIB |

Ogólny przegląd

SAM (Segment Anything Model) to potężny model podstawowy AI stworzony przez Meta, umożliwiający interaktywną i automatyczną segmentację praktycznie dowolnego obiektu na obrazach. Korzystając z podpowiedzi takich jak punkty, ramki ograniczające czy przybliżone maski, SAM generuje maski segmentacyjne bez konieczności ponownego trenowania pod kątem konkretnego zadania. W badaniach mikroskopowych elastyczność SAM została zaadaptowana do segmentacji komórek, wykrywania organelli oraz analizy histopatologicznej, oferując skalowalne rozwiązanie dla badaczy potrzebujących uniwersalnego narzędzia segmentacyjnego sterowanego podpowiedziami.

Szczegółowe wprowadzenie

Pierwotnie wytrenowany przez Meta na ponad 1 miliardzie masek na 11 milionach obrazów, SAM został zaprojektowany jako model podstawowy sterowany podpowiedziami, oferujący wydajność "zero-shot" na nowych domenach. W badaniach obrazowania medycznego SAM był oceniany pod kątem segmentacji całych preparatów, wykrywania guzów oraz identyfikacji jąder komórkowych. Jednak jego wydajność na gęsto upakowanych obiektach — takich jak jądra komórkowe — jest mieszana: nawet przy rozbudowanych podpowiedziach (np. 20 kliknięć lub ramek) segmentacja zero-shot może mieć trudności w złożonych obrazach mikroskopowych.

Aby rozwiązać ten problem, powstały adaptacje specyficzne dla danej dziedziny:

- SAMCell — dostrojony na dużych zestawach danych mikroskopowych, zapewnia silną segmentację zero-shot dla różnych typów komórek bez potrzeby ponownego trenowania dla każdego eksperymentu

- μSAM — ponownie wytrenowany na ponad 17 000 ręcznie anotowanych obrazach mikroskopowych, aby poprawić dokładność na małych strukturach komórkowych

Kluczowe cechy

Elastyczna interakcja za pomocą punktów, ramek i masek dla precyzyjnej kontroli.

Wykonuje segmentację bez dostrajania na nowych domenach obrazów.

Możliwa adaptacja do mikroskopii i histopatologii poprzez few-shot lub sterowane podpowiedziami ponowne trenowanie.

Dostępny w Microscopy Image Browser (MIB) z obsługą segmentacji 3D i interpolowanej.

IDCC-SAM umożliwia automatyczne liczenie komórek w immunocytochemii bez ręcznej anotacji.

Pobierz lub uzyskaj dostęp

Przewodnik użytkownika

- Otwórz Microscopy Image Browser i przejdź do panelu segmentacji SAM

- Skonfiguruj interpreter Pythona i wybierz model SAM-1 lub SAM-2

- Dla przyspieszenia GPU wybierz "cuda" w środowisku wykonawczym (zalecane dla optymalnej wydajności)

- Podpowiedzi punktowe: Kliknij na obiekt, aby zdefiniować pozytywny punkt startowy; użyj Shift + klik, aby rozszerzyć oraz Ctrl + klik dla punktów negatywnych

- Stosy 3D: Użyj trybu interaktywnego 3D — kliknij na pojedynczą warstwę, przewijaj z wciśniętym Shift i interpoluj punkty między warstwami

- Tryb dostosowywania: Zastępuj, dodawaj, odejmuj maski lub twórz nową warstwę według potrzeb

- Użyj opcji "Automatycznie wszystko" w panelu SAM-2 w MIB, aby segmentować wszystkie widoczne obiekty w wybranym obszarze

- Przejrzyj i popraw maski po segmentacji w razie potrzeby

- Wykorzystaj pipeline'y dostrajania sterowane podpowiedziami (np. "All-in-SAM") do generowania anotacji na poziomie pikseli z rzadkich podpowiedzi użytkownika

- Do liczenia komórek zastosuj IDCC-SAM, który używa SAM w trybie zero-shot z postprocessingiem

- Dla wysokiej dokładności segmentacji komórek użyj SAMCell, dostrojonego na obrazach mikroskopowych komórek

Ograniczenia i uwagi

- Wydajność zero-shot jest niestabilna na gęstych lub nakładających się strukturach bez dostrajania domenowego

- Jakość segmentacji silnie zależy od strategii i typu podpowiedzi

- Zdecydowanie zalecana karta GPU; inferencja na CPU jest bardzo wolna

- Problemy z bardzo wysokorozdzielczymi obrazami całych preparatów i strukturami tkankowymi o wielu skalach

- Dostrajanie lub adaptacja SAM do mikroskopii może wymagać zaawansowanej wiedzy z zakresu uczenia maszynowego

Najczęściej zadawane pytania

Tak — poprzez adaptacje takie jak SAMCell, które dostrajają SAM na zestawach danych mikroskopowych specjalnie do zadań segmentacji komórek.

Nie zawsze. Dzięki IDCC-SAM można wykonywać liczenie komórek w trybie zero-shot bez ręcznych anotacji.

Skorzystaj z dostrajania sterowanego podpowiedziami (np. "All-in-SAM") lub z wytrenowanych wersji mikroskopowych, takich jak μSAM, który jest trenowany na ponad 17 000 anotowanych obrazach mikroskopowych.

Chociaż możliwe jest użycie CPU, karta GPU jest zdecydowanie zalecana dla praktycznej szybkości inferencji i interaktywnej segmentacji w czasie rzeczywistym.

Tak — integracja SAM-2 w MIB wspiera segmentację 3D z interpolacją punktów między warstwami dla analizy wolumetrycznej.

AxonDeepSeg

| Deweloper | NeuroPoly Lab w Polytechnique Montréal i Université de Montréal |

| Obsługiwane platformy |

|

| Język | Dokumentacja w języku angielskim; narzędzie open-source używane globalnie |

| Cena | Darmowe i open-source |

Przegląd

AxonDeepSeg to narzędzie oparte na sztucznej inteligencji do automatycznej segmentacji aksonów i mieliny na obrazach mikroskopowych. Wykorzystując splotowe sieci neuronowe, zapewnia precyzyjną segmentację trójklasową (akson, mielina, tło) w różnych modalnościach obrazowania, w tym TEM, SEM i mikroskopii jasnego pola. Automatyzując pomiary morfometryczne, takie jak średnica aksonu, współczynnik g i grubość mieliny, AxonDeepSeg usprawnia ilościową analizę w badaniach neurobiologicznych, znacznie skracając czas ręcznej anotacji i poprawiając powtarzalność wyników.

Kluczowe funkcje

Gotowe do użycia modele zoptymalizowane pod kątem mikroskopii TEM, SEM i jasnego pola.

Dokładna klasyfikacja obszarów aksonu, mieliny i tła na obrazach mikroskopowych.

Automatyczne obliczanie średnicy aksonu, współczynnika g, grubości mieliny oraz metryk gęstości.

Integracja z Napari GUI umożliwia ręczne poprawki masek segmentacyjnych dla zwiększenia dokładności.

Bezproblemowa integracja z niestandardowymi pipeline’ami do analizy dużych zbiorów danych tkanki nerwowej.

Kompleksowe skrypty testowe zapewniają powtarzalność i wiarygodność wyników segmentacji.

Szczegóły techniczne

Opracowany przez NeuroPoly Lab, AxonDeepSeg wykorzystuje głębokie uczenie do precyzyjnej segmentacji w zastosowaniach neurobiologicznych. Dostępne są wstępnie wytrenowane modele dla różnych modalności mikroskopowych, co zapewnia wszechstronność w technikach obrazowania. Narzędzie integruje się z Napari, umożliwiając interaktywne korekty masek segmentacyjnych, co zwiększa dokładność na trudnych zestawach danych. AxonDeepSeg oblicza kluczowe metryki morfometryczne, wspierając badania wysokoprzepustowe struktury i patologii tkanki nerwowej. Jego platforma oparta na Pythonie pozwala na integrację z niestandardowymi pipeline’ami do analizy dużych zbiorów danych dotyczących morfologii aksonów i mieliny.

Pobierz lub uzyskaj dostęp

Instalacja i konfiguracja

Upewnij się, że masz zainstalowanego Pythona w wersji 3.8 lub nowszej, następnie zainstaluj AxonDeepSeg i Napari za pomocą pip:

pip install axondeepseg napariUruchom dostarczone skrypty testowe, aby potwierdzić poprawność instalacji i działania wszystkich komponentów.

Importuj obrazy mikroskopowe (TEM, SEM lub jasnego pola) do Napari lub środowiska Python.

Wybierz odpowiedni wstępnie wytrenowany model dla swojej modalności obrazowania i uruchom segmentację, aby wygenerować maski aksonów i mieliny.

Automatycznie obliczaj pomiary morfometryczne, takie jak średnica aksonu, współczynnik g, gęstość i grubość mieliny, a następnie eksportuj wyniki w formacie CSV.

Użyj interfejsu Napari GUI, aby ręcznie poprawić maski segmentacyjne tam, gdzie jest to potrzebne, łącząc lub usuwając maski dla lepszej dokładności.

Ważne uwagi

- Wydajność może być niższa na nowych lub nieobjętych treningiem modalnościach obrazowania

- W trudnych lub złożonych obszarach może być konieczna ręczna korekta

- Zalecane GPU dla szybszego przetwarzania dużych zbiorów danych; obsługiwany jest także CPU

Najczęściej zadawane pytania

AxonDeepSeg obsługuje TEM (transmisyjna mikroskopia elektronowa), SEM (skaningowa mikroskopia elektronowa) oraz mikroskopię jasnego pola z wstępnie wytrenowanymi modelami zoptymalizowanymi dla każdej z tych modalności.

Tak, AxonDeepSeg jest całkowicie darmowy i open-source, dostępny do użytku akademickiego i komercyjnego.

Tak, AxonDeepSeg automatycznie oblicza średnicę aksonu, współczynnik g, grubość mieliny oraz metryki gęstości na podstawie segmentowanych obrazów.

Zalecane jest użycie GPU dla szybszej segmentacji dużych zbiorów danych, jednak przetwarzanie na CPU jest również wspierane dla mniejszych analiz.

Tak, integracja z interfejsem Napari GUI umożliwia interaktywne korekty i doprecyzowanie masek segmentacyjnych dla większej dokładności w trudnych obszarach.

Ilastik

| Twórca | Zespół Ilastik w Europejskim Laboratorium Biologii Molekularnej (EMBL) oraz powiązani partnerzy akademiccy |

| Obsługiwane platformy |

|

| Język | Angielski |

| Cena | Darmowe i otwarte oprogramowanie |

Przegląd

Ilastik to potężne narzędzie oparte na sztucznej inteligencji do interaktywnej segmentacji, klasyfikacji i analizy danych mikroskopowych. Wykorzystując techniki uczenia maszynowego, takie jak klasyfikatory Random Forest, umożliwia badaczom segmentację pikseli, klasyfikację obiektów, śledzenie komórek w czasie oraz liczenie gęstości w danych 2D i 3D. Dzięki intuicyjnemu interfejsowi i sprzężeniu zwrotnemu w czasie rzeczywistym Ilastik jest dostępny dla naukowców bez umiejętności programowania i jest szeroko stosowany w biologii komórki, neurobiologii oraz obrazowaniu biomedycznym.

Kluczowe funkcje

Sprzężenie zwrotne w czasie rzeczywistym podczas oznaczania reprezentatywnych obszarów dla natychmiastowych wyników segmentacji.

Kategoryzacja segmentowanych struktur na podstawie cech morfologicznych i intensywności.

Śledzenie ruchu i podziału komórek w eksperymentach mikroskopowych 2D i 3D w czasie.

Kwotowanie zatłoczonych obszarów bez wyraźnej segmentacji pojedynczych obiektów.

Półautomatyczna segmentacja złożonych wolumenów 3D z intuicyjną interakcją.

Automatyczne przetwarzanie wielu obrazów w trybie bezgłowym z poziomu wiersza poleceń.

Pobierz

Przewodnik rozpoczęcia pracy

Pobierz Ilastik dla swojego systemu operacyjnego z oficjalnej strony. Pakiet zawiera wszystkie niezbędne zależności Pythona, więc postępuj zgodnie z instrukcjami instalacji dla swojej platformy.

Otwórz Ilastik i wybierz swój proces analizy: klasyfikacja pikseli, klasyfikacja obiektów, śledzenie lub liczenie gęstości. Załaduj swój zestaw obrazów, który może zawierać obrazy wielokanałowe, 3D lub zarejestrowane w czasie.

Oznacz kilka reprezentatywnych pikseli lub obiektów na swoich obrazach. Klasyfikator Random Forest Ilastik uczy się na podstawie tych adnotacji i automatycznie przewiduje etykiety dla całego zestawu danych.

Zastosuj wytrenowany model do segmentacji lub klasyfikacji całego zestawu danych. Eksportuj wyniki jako obrazy z etykietami, mapy prawdopodobieństwa lub tabele ilościowe do dalszej analizy i wizualizacji.

Użyj trybu bezgłowego Ilastik do automatycznego przetwarzania wielu obrazów bez ręcznej interwencji, co jest idealne dla dużych pipeline’ów analitycznych.

Ograniczenia i uwagi

- Interaktywne oznaczanie może być czasochłonne dla bardzo dużych zbiorów danych

- Dokładność zależy od jakości i reprezentatywności adnotacji użytkownika

- Wymagania pamięciowe — bardzo wysokorozdzielcze lub wielogigabajtowe zbiory mogą wymagać znacznej ilości pamięci RAM

- Złożone dane — klasyfikatory Random Forest mogą działać słabiej niż głębokie sieci neuronowe na wysoce zmiennych lub złożonych danych obrazowych

Najczęściej zadawane pytania

Tak, Ilastik w pełni obsługuje wolumeny 3D oraz eksperymenty zarejestrowane w czasie do segmentacji, śledzenia i analizy ilościowej na wielu punktach czasowych.

Tak, Ilastik jest całkowicie darmowy i otwarty, dostępny dla wszystkich użytkowników bez ograniczeń licencyjnych.

Nie, Ilastik oferuje intuicyjny interfejs graficzny ze sprzężeniem zwrotnym w czasie rzeczywistym, co czyni go dostępnym dla badaczy bez umiejętności programowania. Zaawansowani użytkownicy mogą również korzystać z przetwarzania wsadowego z poziomu wiersza poleceń.

Tak, dedykowany proces śledzenia pozwala na analizę ruchu i podziału komórek zarówno w danych 2D, jak i 3D zarejestrowanych w czasie, z automatycznym śledzeniem linii komórkowej.

Wyniki segmentacji można eksportować jako obrazy z etykietami, mapy prawdopodobieństwa lub tabele ilościowe, co umożliwia płynną integrację z narzędziami do dalszej analizy i oprogramowaniem do wizualizacji.

Narzędzia te obejmują poziomy od początkującego do eksperta. Wiele z nich jest darmowych i otwartoźródłowych, co ułatwia powtarzalne i współdzielone przepływy pracy SI w środowisku badawczym.

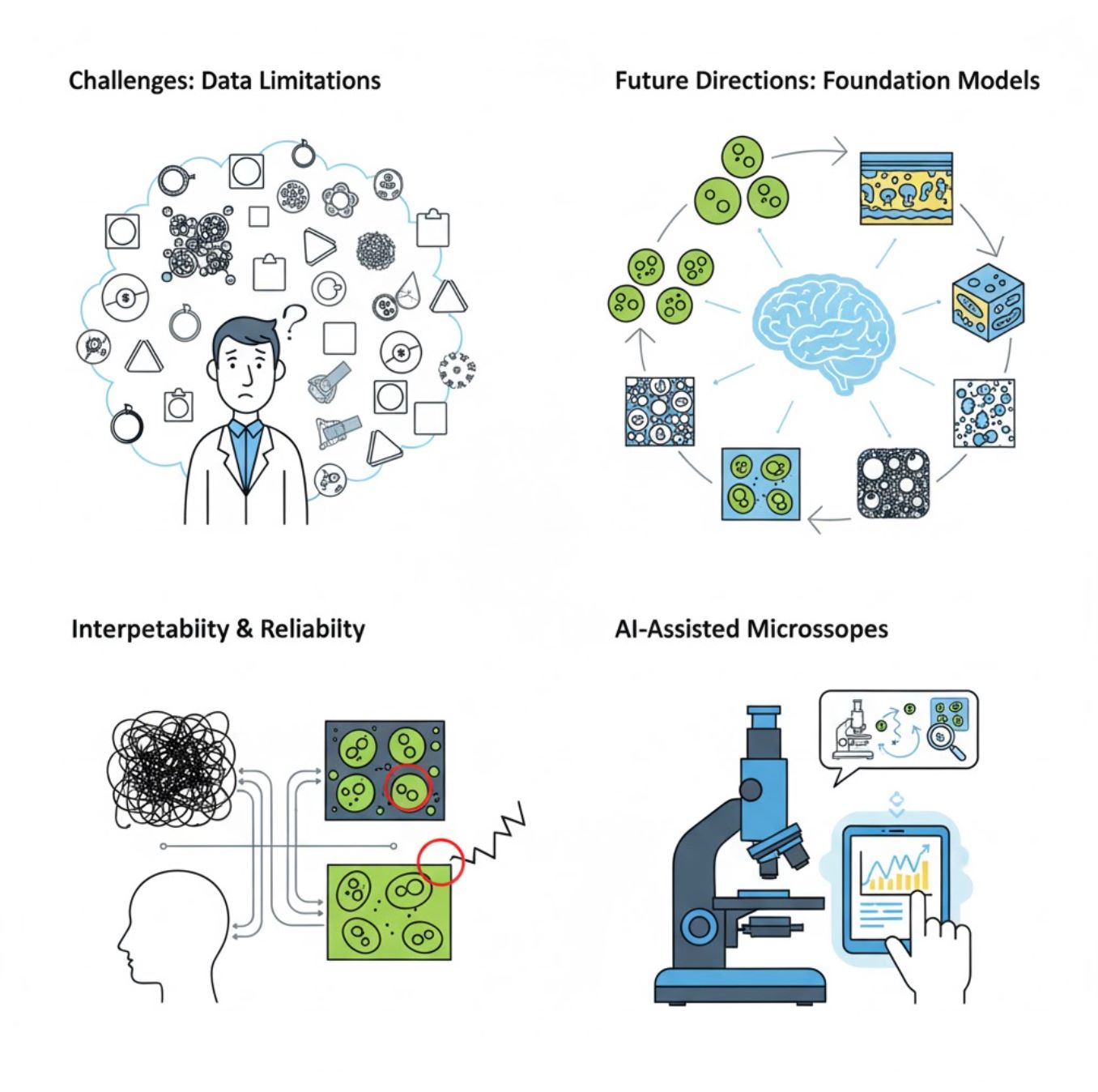

Wyzwania i kierunki rozwoju

Aktualne wyzwania

Nowe trendy

Modele bazowe wizji

Systemy SI nowej generacji obiecują zmniejszyć potrzebę treningu specyficznego dla zadania.

- Modele takie jak SAM i systemy oparte na CLIP

- Jeden model SI obsługuje wiele zadań mikroskopowych

- Szybsze wdrażanie i adaptacja

Mikroskopy wspomagane SI

W pełni autonomiczne i inteligentne systemy mikroskopowe stają się rzeczywistością.

- Sterowanie językiem naturalnym za pomocą dużych modeli językowych (LLM)

- W pełni zautomatyzowane pętle sprzężenia zwrotnego

- Demokratyzacja dostępu do zaawansowanej mikroskopii

Kluczowe wnioski

- SI szybko zmienia przetwarzanie obrazów mikroskopowych, poprawiając dokładność i automatyzację

- Głębokie uczenie przewyższa tradycyjne uczenie maszynowe na złożonych, zmiennych obrazach mikroskopowych

- CNN automatycznie uczą się hierarchicznych cech z surowych pikseli dla odpornej analizy

- Kluczowe zastosowania to segmentacja, klasyfikacja, śledzenie, redukcja szumów i automatyczne pozyskiwanie

- Sukces zależy od jakości danych i starannej weryfikacji przez ekspertów

- Modele bazowe wizji i mikroskopy wspomagane SI to przyszłość dziedziny

Dzięki dalszym postępom i wysiłkom społeczności (narzędzia open-source, współdzielone zbiory danych) SI stanie się coraz bardziej integralną częścią „oka” mikroskopu, pomagając naukowcom dostrzegać to, co niewidoczne.

No comments yet. Be the first to comment!