显微镜图像处理中的人工智能

人工智能正在以精准分割、降噪、超分辨率和自动图像采集等强大功能,彻底改变显微镜图像处理。本文重点介绍了科学研究中关键的人工智能工具和新兴趋势。

人工智能技术正在通过优化图像采集和自动化分析,彻底革新显微镜领域。在现代智能显微镜中,人工智能模块可以实时调整成像参数(如焦距、照明),以减少光漂白并增强信号。同时,深度学习算法能够筛选复杂的图像数据,提取隐藏的生物学信息,甚至将图像与其他数据(如基因组学)关联起来。

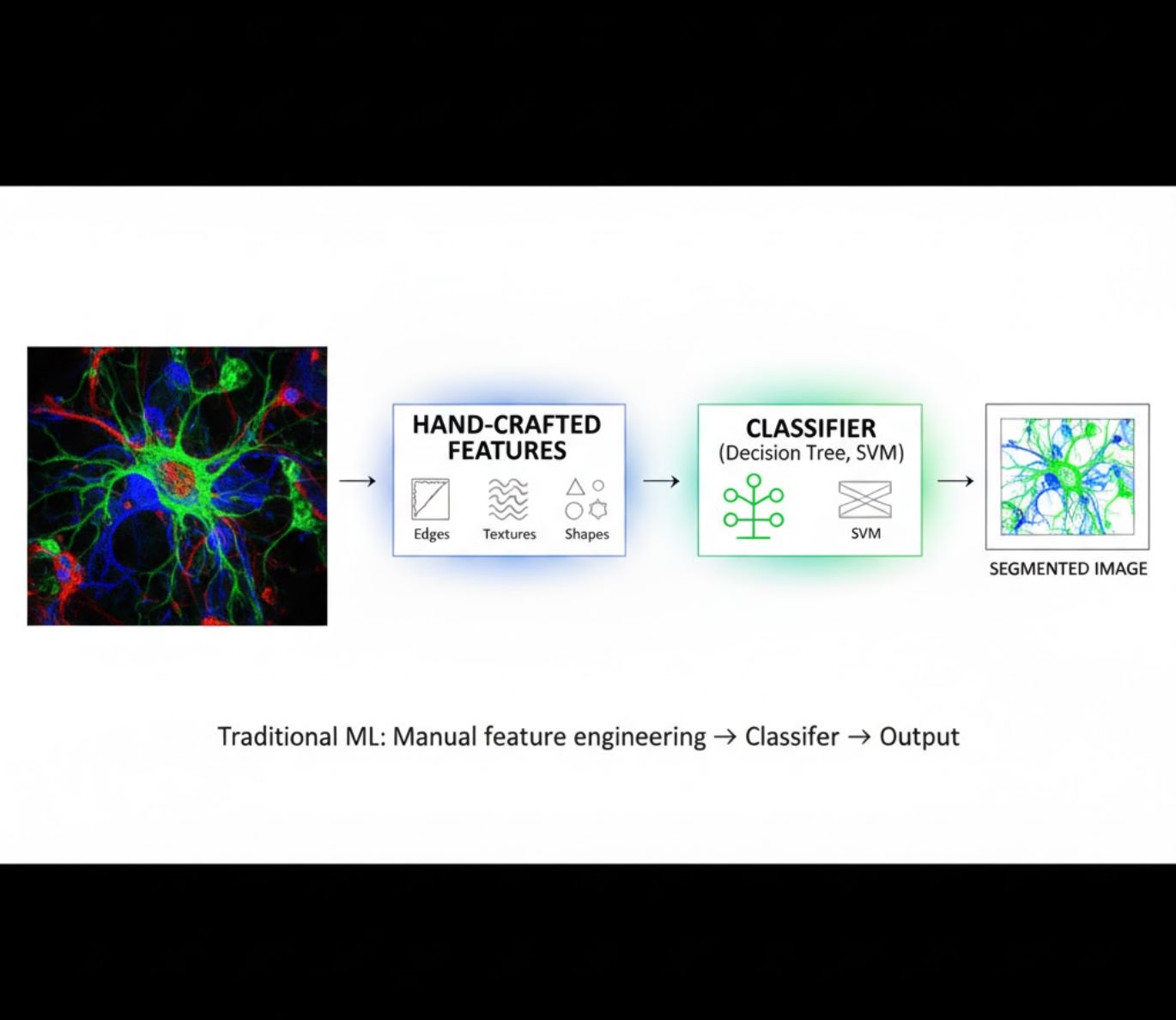

人工智能方法:机器学习与深度学习

人工智能方法涵盖经典的机器学习(ML)到现代的深度学习(DL),每种方法都有其独特的优势和局限:

手工特征设计

- 研究人员手动设计图像特征(边缘、纹理、形状)

- 将特征输入分类器(决策树、支持向量机)

- 训练速度快

- 对复杂或噪声图像表现欠佳

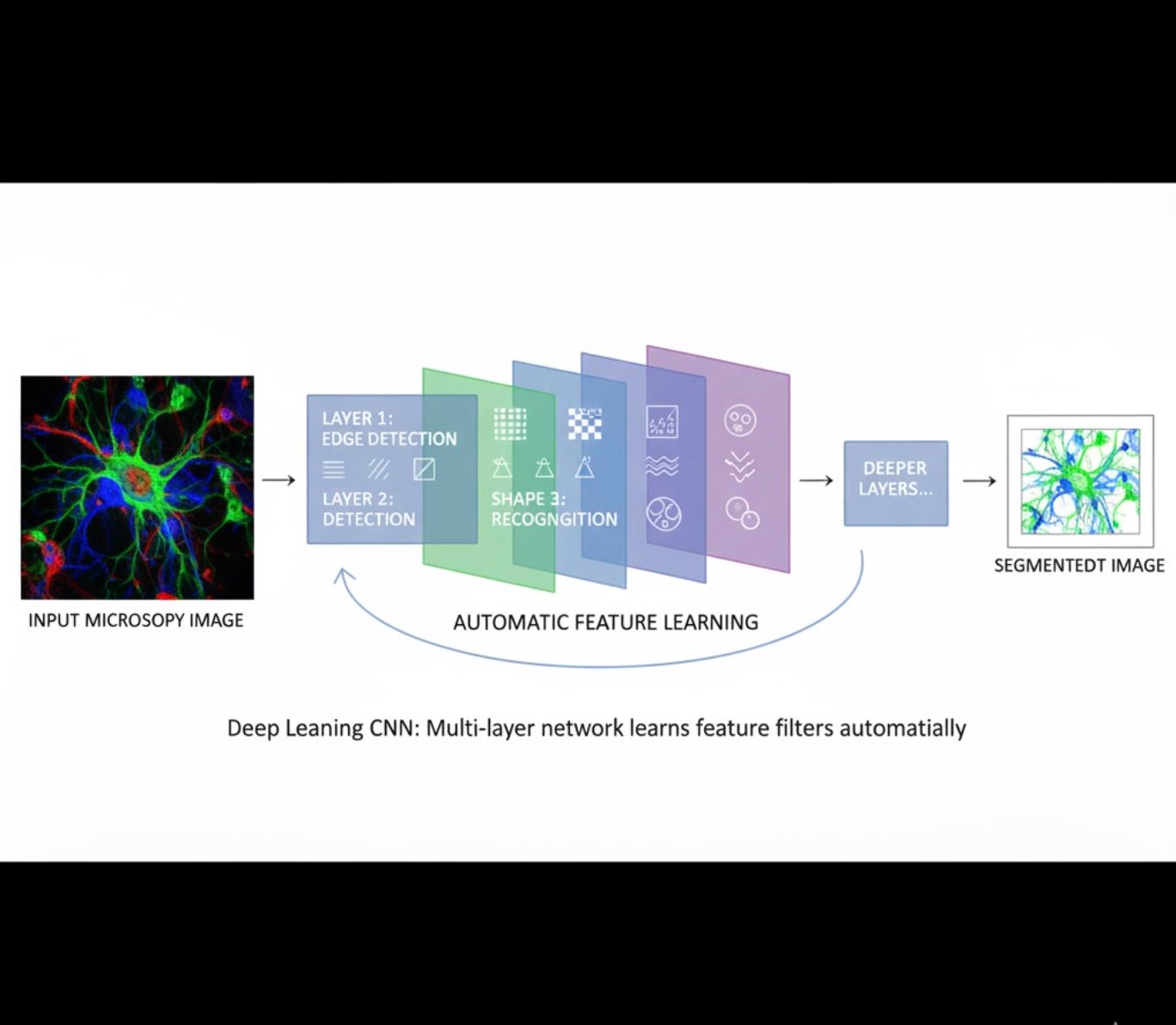

自动特征学习

- 多层神经网络(卷积神经网络,CNN)自动学习特征

- 端到端从原始像素学习

- 对变化更具鲁棒性

- 可靠捕捉复杂纹理和结构

CNN工作原理:卷积神经网络对显微镜图像应用连续滤波器,早期层学习检测简单模式(边缘),深层学习复杂结构(细胞形状、纹理)。这种分层学习使深度学习即使在强度变化显著时也极为稳健。

视觉对比:机器学习与深度学习流程

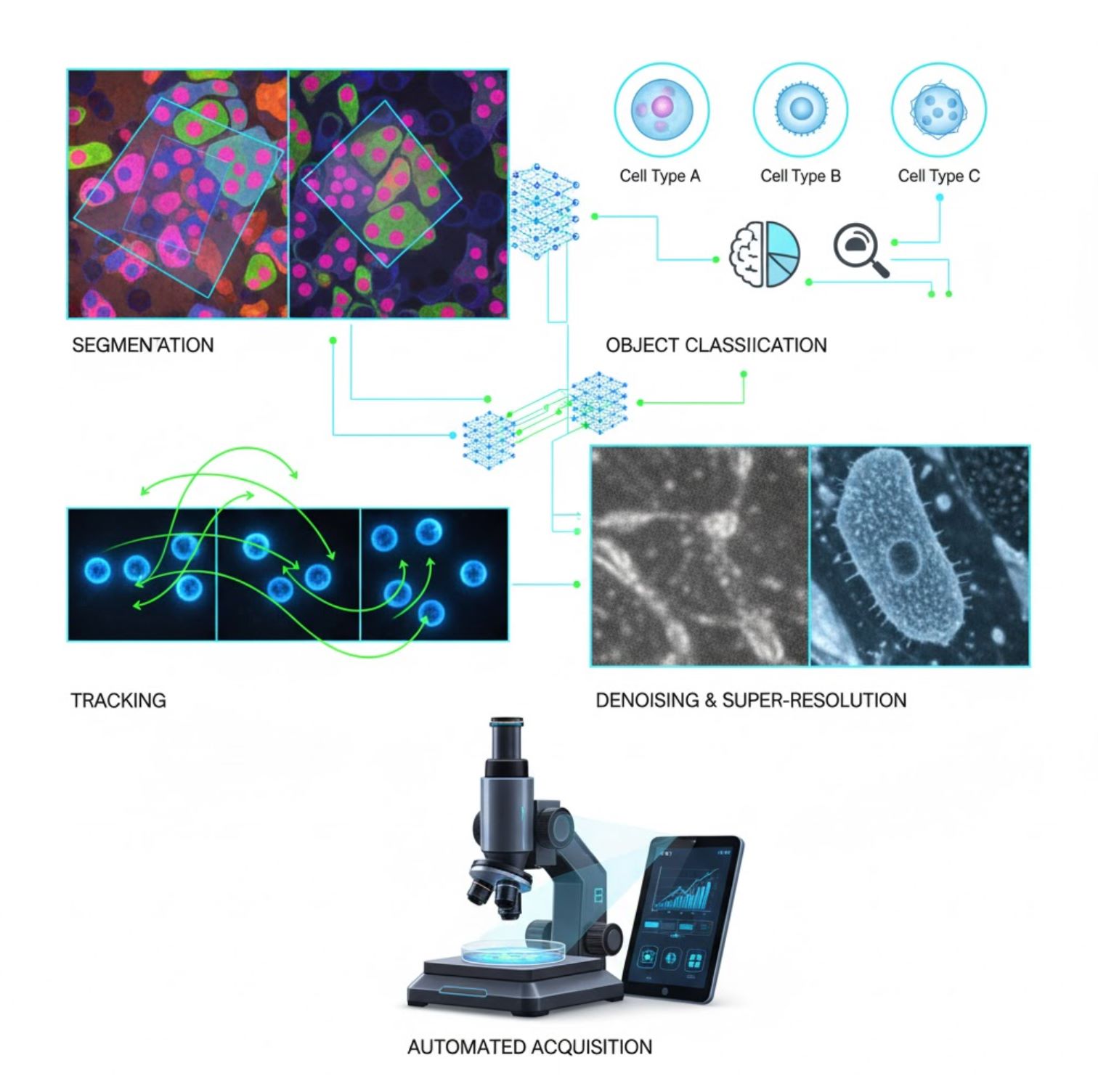

显微镜中的关键人工智能应用

人工智能现已嵌入显微镜工作流程中的多项图像处理任务:

分割

将图像划分为不同区域(如识别每个细胞或细胞核)。深度网络如U-Net在此任务中表现出色。

- 语义分割:每像素类别标签

- 实例分割:区分单个对象

- 在密集或暗淡图像上准确率高

- 视觉基础模型(如μSAM)现已适配显微镜

对象分类

分割后,人工智能对每个对象进行高精度分类。

- 细胞类型识别

- 有丝分裂阶段判定

- 病理指标检测

- 区分难以手动量化的细微表型

追踪

在时间序列显微镜中,人工智能以空前准确度追踪细胞或颗粒的运动轨迹。

- 深度学习显著提升追踪准确性

- 实现对运动细胞的可靠分析

- 捕捉动态生物过程

降噪与超分辨率

人工智能模型通过去除噪声和模糊提升图像质量。

- 物理驱动的深度模型学习显微镜光学特性

- 重建更清晰、无伪影的图像

- 相比传统方法,分辨率更高且伪影更少

自动采集

人工智能实时引导显微镜操作。

- 分析实时图像做出智能决策

- 自动调整焦距并扫描感兴趣区域

- 减少光毒性并节省时间

- 实现高通量和自适应成像实验

显微镜图像处理中流行的人工智能工具

一个丰富的工具生态系统支持显微镜中的人工智能。研究人员开发了多种通用和专业软件,其中许多是开源的:

Cellpose

| 开发者 | Carsen Stringer 和 Marius Pachitariu(MouseLand 研究组) |

| 支持平台 |

需要 Python(通过 pip/conda 安装)。图形界面仅限桌面使用。 |

| 语言支持 | 英文文档;全球研究实验室广泛采用 |

| 价格模式 | 免费开源,采用 BSD-3-Clause 许可证 |

概述

Cellpose 是一款先进的基于深度学习的显微镜图像分割工具。作为通用算法,它能准确分割不同成像模式下的多种细胞类型(细胞核、细胞质等),无需重新训练模型。借助人机交互功能,研究人员可以优化分割结果,调整模型以适应自有数据,并应用于二维和三维成像流程。

主要特性

无需定制训练,即可支持多种细胞类型、染色和成像模式,开箱即用。

通过“2.5D”方法支持完整三维图像堆栈,复用二维模型处理体积数据。

手动修正分割结果,并在自定义数据上重新训练模型以提升准确度。

支持 Python API、命令行界面和图形用户界面,满足灵活的工作流程需求。

具备去噪、去模糊和上采样功能,提升分割前的图像质量。

下载或访问

技术背景

Cellpose 由 Stringer、Wang、Michaelos 和 Pachitariu 在一项开创性研究中提出,训练数据集包含超过 70,000 个分割对象,高度多样化。这种多样性使模型能够泛化处理不同细胞形状、大小和显微镜设置,大幅减少大多数应用场景下的定制训练需求。对于三维数据,Cellpose 巧妙地以“2.5D”方式复用二维模型,避免了对完整三维标注训练数据的需求,同时实现体积分割。Cellpose 2.0 引入了 人机交互式再训练,允许用户手动修正预测结果,并在自有图像上重新训练以提升特定数据集的性能。

安装与设置

使用 conda 创建 Python 环境:

conda create -n cellpose python=3.10激活环境并安装 Cellpose:

# For GUI support

pip install cellpose[gui]

# For minimal setup (API/CLI only)

pip install cellpose快速入门

图形界面模式

- 运行以下命令启动图形界面:

python -m cellpose - 将图像文件(

.tif、.png等)拖拽至界面 - 选择模型类型(例如“cyto”表示细胞质,“nuclei”表示细胞核)

- 设置估计细胞直径,或让 Cellpose 自动校准

- 点击开始分割并查看结果

Python API 模式

from cellpose import models

# Load model

model = models.Cellpose(model_type='cyto')

# Segment images

masks, flows = model.eval(images, diameter=30)优化与再训练

- 生成掩膜后,在图形界面手动合并或删除掩膜以修正分割

- 使用内置训练功能,在修正后的样本上重新训练模型

- 提升模型在特定数据集上的表现

处理三维数据

- 加载多层 Z 轴 TIFF 或体积堆栈

- 在图形界面或 API 中使用

--Zstack标志以三维方式处理 - 可选地通过平滑或专用参数优化三维流以提升分割效果

限制与注意事项

- 模型通用性权衡:通用模型适用范围广,但极端异常的细胞形状或成像条件可能需要重新训练。

- 标注工作量:人机交互式训练需手动修正,处理大型数据集时耗时较长。

- 安装复杂度:图形界面安装可能涉及命令行操作、conda 环境及 Python 依赖管理,对非程序员不够友好。

- 仅限桌面:Cellpose 设计用于桌面使用,无原生 Android 或 iOS 应用。

常见问题

不需要——Cellpose 提供预训练的通用模型,通常无需重新训练即可获得良好效果。但针对特殊或异常数据,您可以使用人机交互功能进行标注和再训练以获得最佳结果。

可以——它通过复用二维模型实现“三维2.5D”支持,您可以通过图形界面或 API 处理体积堆栈。

强烈推荐使用 GPU 以加快推理和训练速度,尤其是处理大型或三维数据集时,但 Cellpose 也能在仅 CPU 的机器上运行,只是速度较慢。

在图形界面中,您可以手动设置估计细胞直径,或让 Cellpose 自动校准。如果分割效果不理想,还可以优化结果并进行再训练。

可以——新版(Cellpose 3)包含图像修复模型,支持去噪、去模糊和上采样,提升分割前的图像质量。

StarDist

| 开发者 | Uwe Schmidt、Martin Weigert、Coleman Broaddus 和 Gene Myers |

| 支持平台 |

|

| 语言支持 | 开源项目,文档和社区主要使用英语 |

| 价格模式 | 免费且开源。采用 BSD-3-Clause 许可证 |

概述

StarDist 是一款用于显微镜图像实例分割的深度学习工具。它将每个对象(如细胞核)表示为二维星形凸多边形或三维多面体,实现对密集或重叠对象的准确检测与分离。凭借其稳健的架构,StarDist 广泛应用于荧光显微镜、组织病理学及其他生物图像分析中的自动细胞和细胞核分割。

主要特性

利用二维星形凸多边形和三维多面体实现高精度实例分割,确保可靠的对象检测。

针对二维图像和三维体数据提供专用模型,满足全面的显微镜分析需求。

提供适用于荧光细胞核、H&E 染色组织学及其他常见成像场景的即用型模型。

在单次分割运行中将检测到的对象分类为不同类别(如不同细胞类型)。

与 ImageJ/Fiji、QuPath 和 napari 无缝集成,支持基于 GUI 的便捷工作流程。

提供全面的实例分割评估,包括精确率、召回率、F1 分数和全景质量指标。

技术背景

StarDist 最初发表于 2018 年 MICCAI 会议论文,其核心创新是结合每像素的物体概率与沿固定射线的径向距离预测,实现星形凸形状的准确重建。该方法能够可靠分割传统像素级或边界框方法难以区分的紧密接触对象。

近期发展将 StarDist 扩展至组织病理学图像,不仅实现细胞核分割,还支持检测对象的多类别分类。该方法在 CoNIC(结肠细胞核识别与计数)挑战赛中表现优异,获得顶尖成绩。

下载或访问

安装与设置

安装 TensorFlow(版本 1.x 或 2.x)作为 StarDist 的前置条件。

使用 pip 安装 StarDist Python 包:

pip install stardist针对 napari:

pip install stardist-napari针对 QuPath:通过将 .jar 文件拖入 QuPath 安装 StarDist 扩展。

针对 ImageJ/Fiji:使用内置插件管理器或通过插件菜单手动安装。

运行分割

加载预训练模型,归一化图像,运行预测:

from stardist.models import StarDist2D

model = StarDist2D.from_pretrained('2D_versatile_fluo')

labels, details = model.predict_instances(image)在 napari 中打开图像,选择 StarDist 插件,选择预训练或自定义模型,直接通过 GUI 运行预测。

通过插件菜单使用 StarDist 插件,在直观界面上对图像堆栈应用模型。

安装扩展后,通过 QuPath 的脚本控制台或图形界面运行 StarDist 检测,适用于组织病理学分析。

训练与微调

创建真实标注标签图像,确保每个对象唯一标记。可使用 LabKit、QuPath 或 Fiji 等标注工具准备数据集。

使用 StarDist Python API 训练新模型或用自定义标注数据微调现有模型。

后处理选项

- 应用非极大值抑制(NMS)以消除冗余候选形状

- 使用 StarDist OPP(对象后处理)合并非星形凸形状的掩膜

限制与注意事项

- 星形凸假设可能无法完美建模高度非凸或极不规则形状

- 安装复杂:自定义安装需兼容的 C++ 编译器以构建扩展

- GPU 加速依赖兼容的 TensorFlow、CUDA 和 cuDNN 版本

- 部分用户报告因 Java 配置问题导致 ImageJ 插件运行异常

常见问题

StarDist 支持多种图像类型,包括荧光、明场和组织病理学(如 H&E),得益于其灵活的预训练模型和对不同成像模式的适应性。

可以——StarDist 支持使用星形凸多面体对三维体数据进行实例分割,将二维能力扩展到完整三维分析。

不一定。已有预训练模型通常可直接使用。但对于专业或新颖数据,标注并训练自定义模型能显著提升准确性。

StarDist 可集成于 napari、ImageJ/Fiji 和 QuPath,支持无代码 GUI 分割操作,也支持直接使用 Python API 进行高级工作流程。

StarDist 提供内置函数计算常用实例分割指标,包括精确率、召回率、F1 分数和全景质量,用于评估分割性能。

SAM

应用信息

| 开发者 | Meta AI 研究院(FAIR) |

| 支持设备 |

|

| 语言及可用性 | 全球开源基础模型;文档为英文 |

| 价格 | 免费 — 通过Meta许可在GitHub及MIB集成中开源提供 |

概述

SAM(Segment Anything Model)是Meta开发的强大AI基础模型,能够实现几乎任何图像对象的交互式和自动分割。通过点、边界框或粗略掩码等提示,SAM无需针对特定任务重新训练即可生成分割掩码。在显微镜研究中,SAM的灵活性被用于细胞分割、细胞器检测和组织病理学分析,为需要可提示、通用分割工具的研究人员提供了可扩展的解决方案。

详细介绍

SAM最初由Meta基于超过10亿个掩码和1100万张图像训练,设计为可提示的基础分割模型,具备在新领域实现“零样本”性能的能力。在医学影像研究中,SAM已被用于全切片病理分割、肿瘤检测和细胞核识别。然而,对于密集堆积的实例(如细胞核),其表现参差不齐:即使使用大量提示(如20次点击或框选),零样本分割在复杂显微镜图像中仍存在困难。

为解决此限制,出现了领域特定的适配版本:

- SAMCell — 在大型显微镜数据集上微调,实现对多种细胞类型的强零样本分割,无需每次实验重新训练

- μSAM — 在超过17,000张手工标注的显微镜图像上重新训练,提高对小型细胞结构的分割准确度

主要特性

通过点、框和掩码灵活交互,实现精确控制。

无需针对新图像领域微调即可执行分割。

通过少量样本或基于提示的重新训练,适配显微镜和组织病理学。

在显微镜图像浏览器(MIB)中提供,支持三维及插值分割。

IDCC-SAM实现免疫细胞化学中无需手动标注的自动细胞计数。

下载或访问

用户指南

- 打开显微镜图像浏览器,导航至SAM分割面板

- 配置Python解释器,选择SAM-1或SAM-2模型

- 为GPU加速,执行环境选择“cuda”(推荐以获得最佳性能)

- 点提示:点击对象定义正向种子;使用Shift + 点击扩展,Ctrl + 点击定义负向种子

- 三维堆栈:使用交互式三维模式——点击单层,Shift滚动,并在切片间插值种子

- 调整模式:根据需要替换、添加、减去掩码,或创建新图层

- 在SAM-2面板中使用MIB的“自动全部”选项,分割区域内所有可见对象

- 分割后根据需要审查和优化掩码

- 使用基于提示的微调流程(如“All-in-SAM”),从稀疏用户提示生成像素级标注

- 细胞计数应用中,使用IDCC-SAM,结合零样本流程和后处理

- 高精度细胞分割可使用在显微镜细胞图像上微调的SAMCell

限制与注意事项

- 未微调时,零样本性能在密集或重叠结构上不稳定

- 分割质量严重依赖提示设计和策略

- 强烈建议使用GPU;CPU推理速度极慢

- 对超高分辨率全切片图像和多尺度组织结构处理存在困难

- 显微镜领域的微调或适配可能需要机器学习专业知识

常见问题

可以——通过如SAMCell等适配版本,专门在显微镜数据集上微调以完成细胞分割任务。

不一定。借助IDCC-SAM,可以实现零样本细胞计数,无需手动标注。

可使用基于提示的微调(如“All-in-SAM”)或预训练的显微镜版本,如在超过17,000张标注显微镜图像上训练的μSAM。

虽然CPU可用,但强烈推荐GPU以获得实用的推理速度和实时交互分割体验。

可以——MIB的SAM-2集成支持三维分割,并可在切片间插值种子,实现体积分析。

AxonDeepSeg

| 开发者 | 蒙特利尔理工学院与蒙特利尔大学NeuroPoly实验室 |

| 支持平台 |

|

| 语言 | 英文文档;全球开源工具 |

| 价格 | 免费且开源 |

概述

AxonDeepSeg是一款基于人工智能的自动分割工具,用于显微镜图像中的轴突和髓鞘分割。通过卷积神经网络,实现对轴突、髓鞘和背景三类的精准分割,支持透射电子显微镜(TEM)、扫描电子显微镜(SEM)及明场显微镜等多种成像模式。自动化的形态计量测量(如轴径、g比和髓鞘厚度)极大简化了神经科学研究中的定量分析,显著减少手动标注时间并提升重复性。

主要功能

针对TEM、SEM和明场显微镜模式优化的即用型模型。

精确分类显微镜图像中的轴突、髓鞘和背景区域。

自动计算轴径、g比、髓鞘厚度及密度等指标。

集成Napari图形界面,支持手动细化分割掩膜以提升准确性。

无缝集成至定制化流程,支持大规模神经组织分析。

全面的测试脚本确保结果可重复且分割可靠。

技术细节

AxonDeepSeg由NeuroPoly实验室开发,利用深度学习实现神经科学应用中的高精度分割。提供针对不同显微镜模式的预训练模型,确保多种成像技术的适用性。工具集成Napari,支持交互式掩膜修正,提升复杂数据集的分割准确度。AxonDeepSeg计算关键形态计量指标,支持神经组织结构与病理的高通量研究。其基于Python的框架便于集成至大规模轴突和髓鞘形态分析的定制流程中。

下载或访问

安装与设置

确保安装Python 3.8或更高版本,然后使用pip安装AxonDeepSeg和Napari:

pip install axondeepseg napari运行提供的测试脚本,确认所有组件正确安装并正常运行。

将显微镜图像(TEM、SEM或明场)导入Napari或Python环境。

选择适合成像模式的预训练模型,运行分割生成轴突和髓鞘掩膜。

自动计算轴径、g比、密度和髓鞘厚度等形态计量指标,并导出CSV格式结果。

使用Napari图形界面手动调整分割掩膜,合并或删除掩膜以提升准确度。

重要注意事项

- 在新颖或未训练的成像模式下性能可能下降

- 复杂区域可能需要手动修正

- 推荐使用GPU加速大数据集处理;CPU也支持小规模分析

常见问题

AxonDeepSeg支持透射电子显微镜(TEM)、扫描电子显微镜(SEM)和明场显微镜,提供针对各模式优化的预训练模型。

是的,AxonDeepSeg完全免费且开源,适用于学术和商业用途。

可以,AxonDeepSeg能自动从分割图像中计算轴径、g比、髓鞘厚度和密度等指标。

推荐使用GPU以加快大数据集分割速度,但CPU也支持较小规模的分析。

可以,集成的Napari图形界面支持交互式修正和细化分割掩膜,提高复杂区域的准确性。

Ilastik

| 开发者 | 欧洲分子生物学实验室(EMBL)Ilastik 团队及相关学术合作伙伴 |

| 支持平台 |

|

| 语言 | 英语 |

| 价格 | 免费且开源 |

概述

Ilastik 是一款功能强大的 AI 驱动工具,用于交互式显微镜图像的分割、分类和分析。通过随机森林分类器等机器学习技术,研究人员可以对像素进行分割、对对象进行分类、跟踪细胞随时间变化,并在二维和三维数据集中执行密度计数。凭借直观的界面和实时反馈,Ilastik 对无编程经验的科学家也非常友好,广泛应用于细胞生物学、神经科学和生物医学成像领域。

主要功能

在标注代表区域时提供实时反馈,实现即时分割结果。

基于形态和强度特征对分割结构进行分类。

跟踪二维和三维时序显微镜实验中的细胞运动和分裂。

无需明确分割单个对象即可量化拥挤区域。

通过直观交互实现复杂三维体积的半自动分割。

使用无界面命令行模式自动处理多张图像。

下载

入门指南

从官方网站下载适用于您操作系统的 Ilastik。软件包包含所有必要的 Python 依赖,请按照平台安装说明操作。

打开 Ilastik,选择您的分析工作流程:像素分类、对象分类、跟踪或密度计数。加载您的图像数据集,支持多通道、三维或时序图像。

在图像中标注少量代表性像素或对象。Ilastik 的随机森林分类器将基于这些标注学习,并自动预测整个数据集的标签。

应用训练好的模型对完整数据集进行分割或分类。导出标注图像、概率图或定量表格,便于后续分析和可视化。

使用 Ilastik 的无界面模式自动处理多张图像,适合大规模分析流程。

限制与注意事项

- 交互式标注 对于超大数据集可能耗时较长

- 准确性依赖 用户标注的质量和代表性

- 内存需求 — 超高分辨率或多 GB 级数据集可能需要大量内存

- 复杂数据 — 随机森林分类器在高度变化或复杂成像数据上可能不及深度神经网络

常见问题

可以,Ilastik 完全支持三维体积和时序实验,用于分割、跟踪及多时间点的定量分析。

是的,Ilastik 完全免费且开源,所有用户均可无许可限制使用。

不需要,Ilastik 提供直观的图形界面和实时反馈,方便无编程经验的研究人员使用。高级用户也可使用命令行批量处理功能。

可以,专用的跟踪工作流程支持二维和三维时序数据中细胞运动和分裂的自动谱系跟踪分析。

分割输出可导出为标注图像、概率图或定量表格,方便与后续分析工具和可视化软件无缝集成。

这些工具覆盖从初学者到专家的不同水平。许多为免费开源,促进研究社区内可复现和共享的人工智能工作流程。

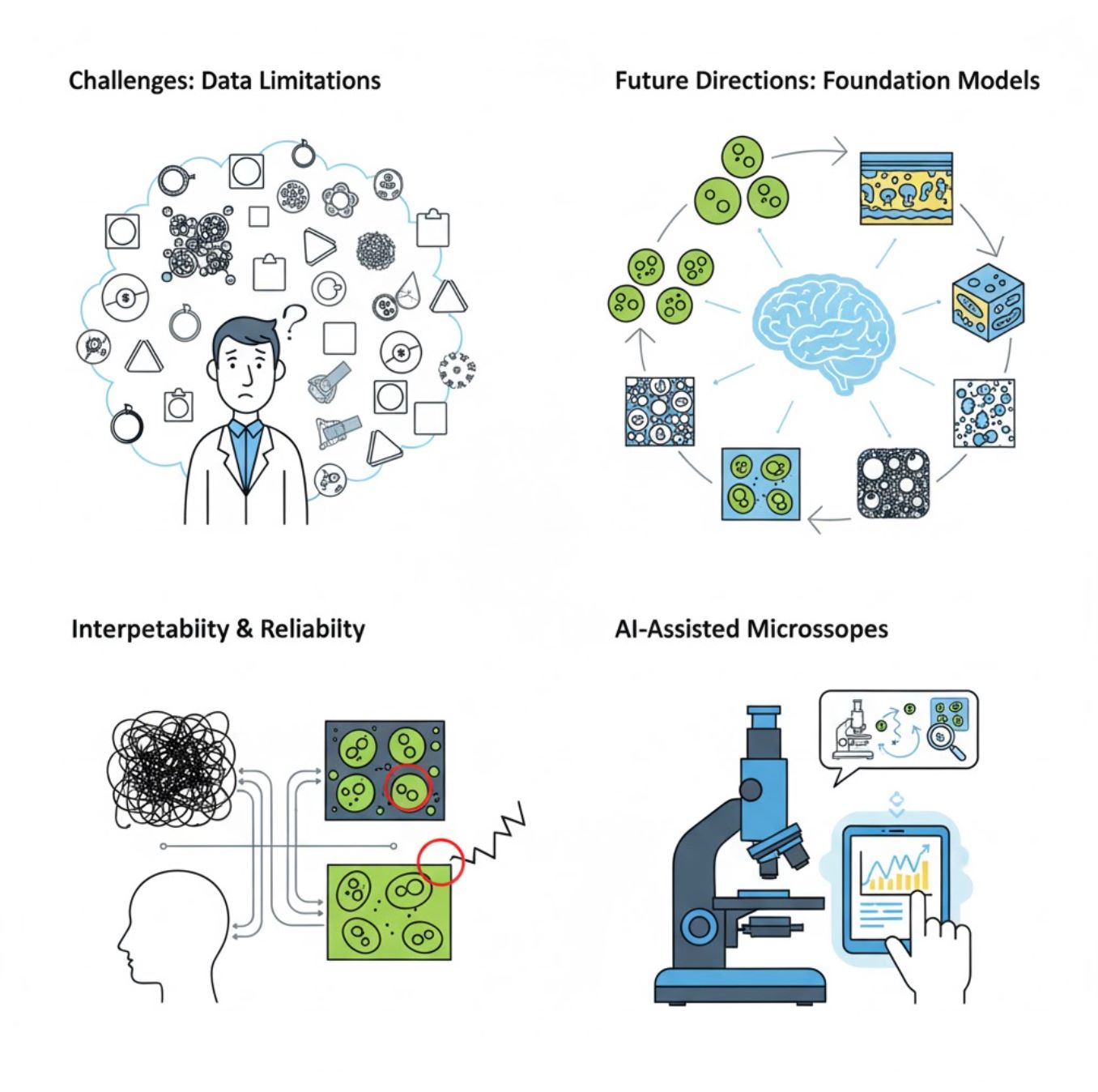

挑战与未来方向

当前挑战

新兴趋势

视觉基础模型

下一代人工智能系统有望减少对特定任务训练的依赖。

- 如SAM和基于CLIP的模型

- 一套人工智能处理多种显微镜任务

- 部署和适应更快

人工智能辅助显微镜

完全自主智能显微镜系统正逐步成为现实。

- 通过大型语言模型实现自然语言控制

- 全自动反馈回路

- 普及先进显微镜技术的使用

关键要点总结

- 人工智能正快速改变显微镜图像处理,提高准确性和自动化水平

- 深度学习在复杂多变的显微镜图像上优于传统机器学习

- 卷积神经网络自动从原始像素学习分层特征,实现稳健分析

- 关键应用包括分割、分类、追踪、降噪和自动采集

- 成功依赖于高质量数据和专家的严谨验证

- 视觉基础模型和人工智能辅助显微镜代表未来发展方向

随着技术进步和社区努力(开源工具、共享数据集),人工智能将日益成为显微镜“之眼”的核心,助力科学家洞察未见之物。

No comments yet. Be the first to comment!