هوش مصنوعی در پردازش تصاویر میکروسکوپی

هوش مصنوعی با قابلیتهای قدرتمندی مانند تقسیمبندی دقیق، کاهش نویز، وضوح فوقالعاده و اکتساب خودکار تصویر، پردازش تصاویر میکروسکوپی را متحول میکند. این مقاله ابزارهای کلیدی هوش مصنوعی و روندهای نوظهور در تحقیقات علمی را برجسته میکند.

تکنیکهای هوش مصنوعی با بهینهسازی اکتساب تصویر و خودکارسازی تحلیل، میکروسکوپی را متحول میکنند. در میکروسکوپهای هوشمند مدرن، ماژولهای هوش مصنوعی میتوانند پارامترهای تصویربرداری را بهصورت لحظهای تنظیم کنند (مثلاً فوکوس، روشنایی) تا از فوتوبلیچینگ جلوگیری کرده و سیگنال را تقویت کنند. در همین حال، الگوریتمهای یادگیری عمیق میتوانند دادههای پیچیده تصویری را پردازش کرده و بینشهای زیستی پنهان را استخراج کنند و حتی تصاویر را به دادههای دیگر (مثلاً ژنومیک) مرتبط سازند.

روشهای هوش مصنوعی: یادگیری ماشین در مقابل یادگیری عمیق

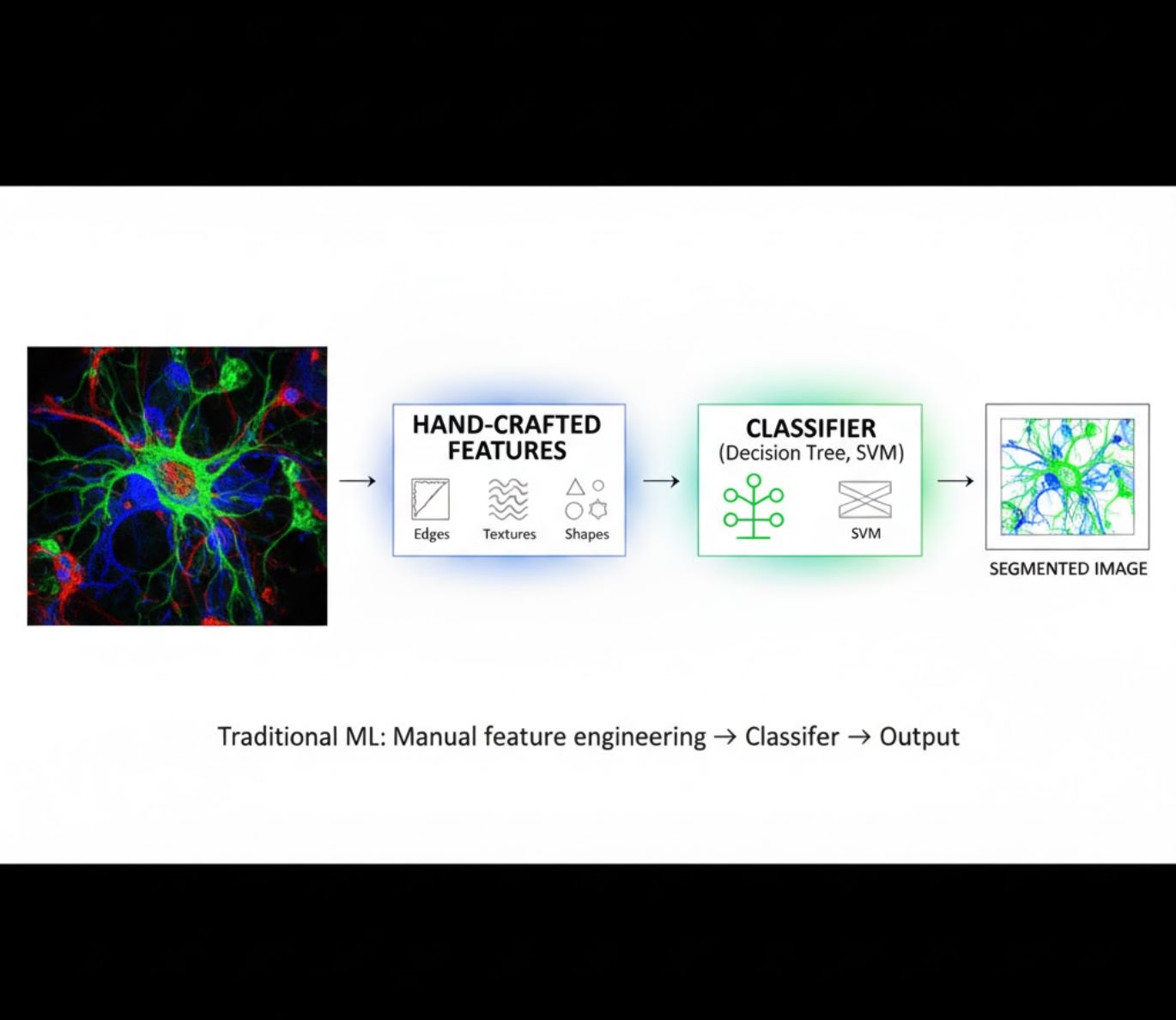

روشهای هوش مصنوعی از یادگیری ماشین (ML) کلاسیک تا یادگیری عمیق (DL) مدرن متغیر است. هر رویکرد نقاط قوت و محدودیتهای خاص خود را دارد:

ویژگیهای دستی ساخته شده

- پژوهشگران ویژگیهای تصویری (لبهها، بافتها، اشکال) را بهصورت دستی استخراج میکنند

- ویژگیها به طبقهبندها (درخت تصمیم، SVM) داده میشوند

- سرعت آموزش بالا

- در تصاویر پیچیده یا نویزی عملکرد ضعیف دارد

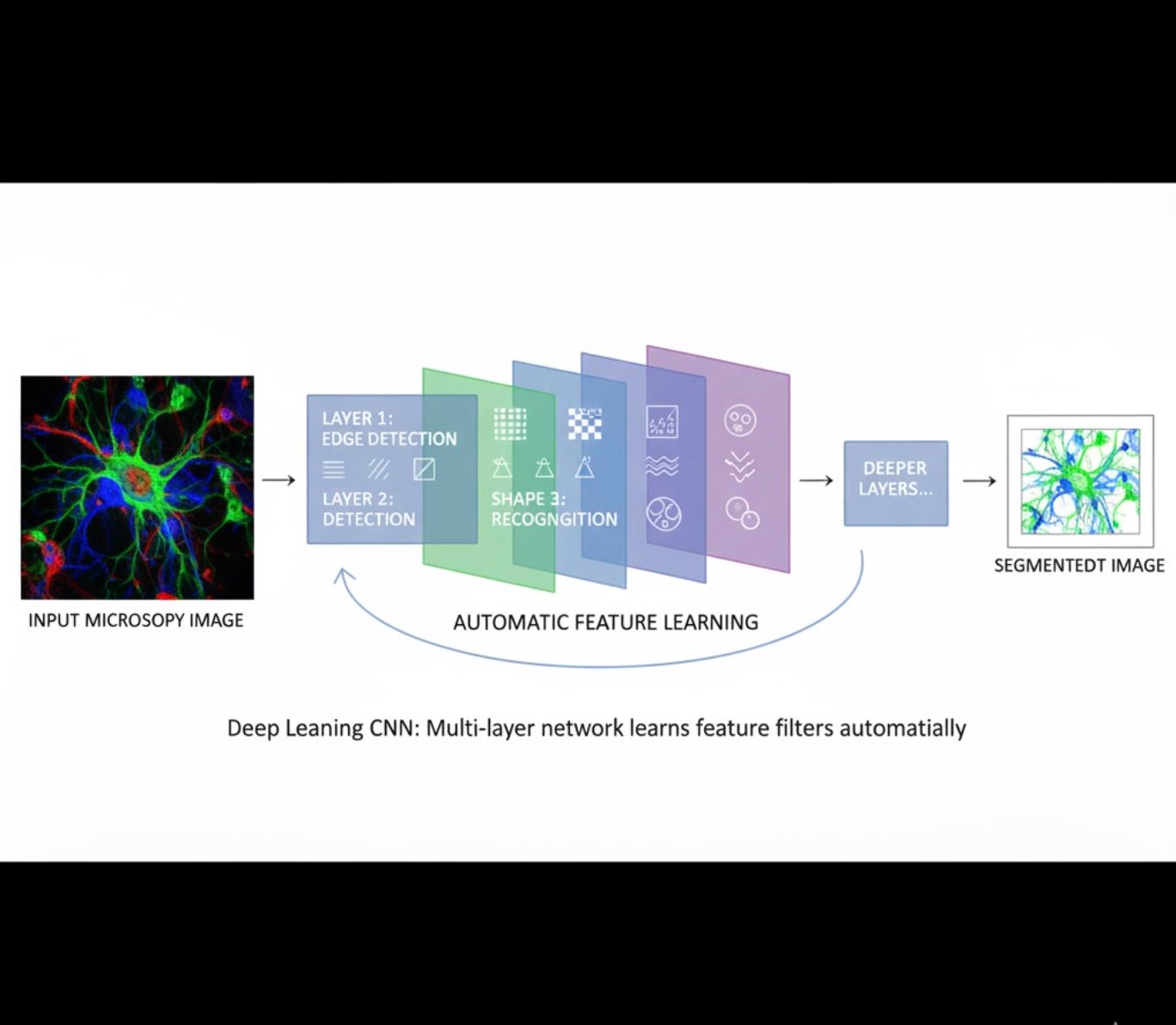

یادگیری خودکار ویژگیها

- شبکههای عصبی چندلایه (CNNها) ویژگیها را بهصورت خودکار یاد میگیرند

- یادگیری انتها به انتها از پیکسلهای خام

- بسیار مقاومتر در برابر تغییرات

- ویژگیها و ساختارهای پیچیده را بهطور قابل اعتماد شناسایی میکند

نحوه عملکرد CNNها: شبکههای عصبی کانولوشنی فیلترهای متوالی را روی تصاویر میکروسکوپی اعمال میکنند، الگوهای ساده (لبهها) را در لایههای ابتدایی و ساختارهای پیچیدهتر (شکل سلولها، بافتها) را در لایههای عمیقتر یاد میگیرند. این یادگیری سلسلهمراتبی باعث میشود یادگیری عمیق حتی زمانی که پروفایل شدت بهطور قابل توجهی تغییر میکند، بسیار مقاوم باشد.

مقایسه تصویری: روندهای یادگیری ماشین در مقابل یادگیری عمیق

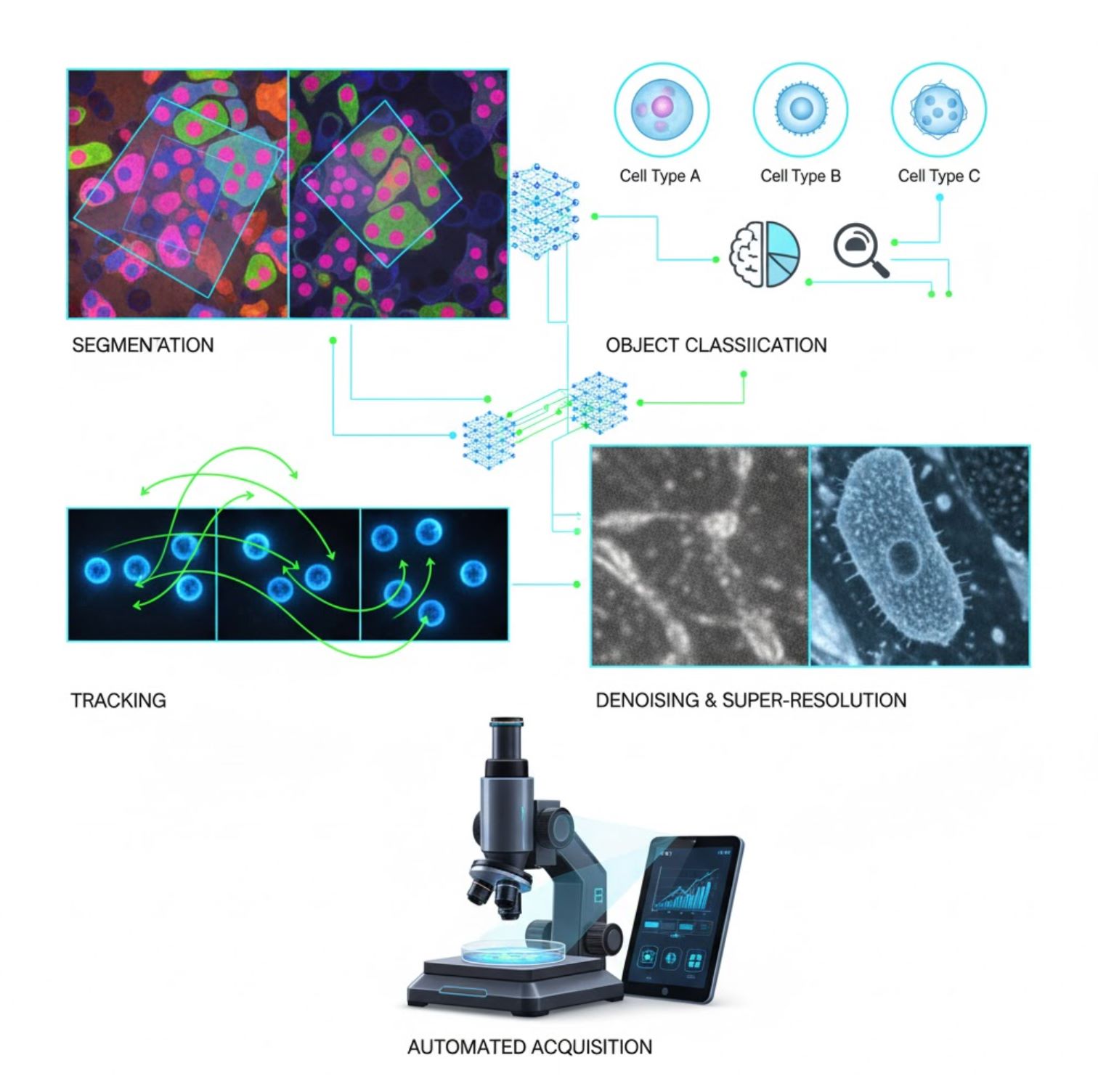

کاربردهای کلیدی هوش مصنوعی در میکروسکوپی

هوش مصنوعی اکنون در بسیاری از وظایف پردازش تصویر در سراسر روند کاری میکروسکوپی تعبیه شده است:

تقسیمبندی

تقسیم تصاویر به نواحی (مثلاً شناسایی هر سلول یا هسته). شبکههای عمیق مانند U-Net در این کار بسیار موفق هستند.

- تقسیمبندی معنایی: برچسبگذاری کلاس به ازای هر پیکسل

- تقسیمبندی نمونهای: جدا کردن اشیاء منفرد

- دقت بالا در تصاویر شلوغ یا کمنور

- مدلهای پایه بینایی (مثلاً μSAM) اکنون برای میکروسکوپی تطبیق یافتهاند

طبقهبندی اشیاء

پس از تقسیمبندی، هوش مصنوعی هر شیء را با دقت بالا طبقهبندی میکند.

- شناسایی نوع سلول

- تعیین مرحله میتوز

- شناسایی شاخصهای پاتولوژی

- تشخیص فنوتیپهای ظریف که بهسختی بهصورت دستی قابل اندازهگیری هستند

ردیابی

در میکروسکوپی زمانگذشته، هوش مصنوعی سلولها یا ذرات را در فریمهای مختلف با دقت بیسابقه ردیابی میکند.

- یادگیری عمیق بهطور چشمگیری دقت ردیابی را بهبود میبخشد

- امکان تحلیل قابل اعتماد سلولهای متحرک را فراهم میکند

- فرآیندهای زیستی پویا را ثبت میکند

کاهش نویز و وضوح فوقالعاده

مدلهای هوش مصنوعی کیفیت تصویر را با حذف نویز و تاری بهبود میبخشند.

- مدلهای عمیق مبتنی بر فیزیک که اپتیک میکروسکوپ را یاد میگیرند

- بازسازی تصاویر واضحتر و بدون آرتیفکت

- وضوح بالاتر با کاهش آرتیفکت نسبت به روشهای سنتی

اکتساب خودکار

هوش مصنوعی بهصورت بلادرنگ میکروسکوپ را هدایت میکند.

- تصاویر زنده را تحلیل کرده و تصمیمات هوشمند میگیرد

- بهطور خودکار فوکوس را تنظیم و نواحی مورد علاقه را اسکن میکند

- سمیت نوری را کاهش داده و زمان را صرفهجویی میکند

- امکان آزمایشهای تصویربرداری با بازده بالا و تطبیقی را فراهم میکند

ابزارهای محبوب هوش مصنوعی در پردازش تصاویر میکروسکوپی

<ITEM_DESCRIPTION>اکوسیستم غنی از ابزارها، هوش مصنوعی را در میکروسکوپی پشتیبانی میکند. پژوهشگران نرمافزارهای عمومی و تخصصی متعددی ساختهاند که بسیاری از آنها متنباز هستند:</ITEM_DESCRIPTION>

Cellpose

| توسعهدهنده | کارسن استرینگر و ماریوس پاچیتاریو (گروه تحقیقاتی MouseLand) |

| پلتفرمهای پشتیبانیشده |

نیازمند پایتون (نصب از طریق pip/conda). رابط گرافیکی فقط روی دسکتاپ در دسترس است. |

| پشتیبانی زبانی | مستندات به زبان انگلیسی؛ در آزمایشگاههای تحقیقاتی سراسر جهان به طور گسترده پذیرفته شده است |

| مدل قیمتگذاری | رایگان و متنباز تحت مجوز BSD-3-Clause |

مرور کلی

سلپوز یک ابزار پیشرفته تقسیمبندی مبتنی بر یادگیری عمیق است که برای تصاویر میکروسکوپی طراحی شده است. به عنوان یک الگوریتم عمومی، انواع مختلف سلولها (هسته، سیتوپلاسم و غیره) را در مدالیتههای تصویربرداری مختلف با دقت بالا تقسیمبندی میکند بدون نیاز به آموزش مجدد مدل. با قابلیتهای دخالت کاربر، پژوهشگران میتوانند نتایج را اصلاح کنند، مدل را با دادههای خود تطبیق دهند و سیستم را در جریانهای کاری تصویربرداری دو و سهبعدی به کار ببرند.

ویژگیهای کلیدی

برای انواع مختلف سلولها، رنگآمیزیها و مدالیتههای تصویربرداری بدون نیاز به آموزش سفارشی، آماده استفاده است.

از پشتههای سهبعدی کامل با رویکرد «۲.۵ بعدی» که مدلهای دو بعدی را برای دادههای حجمی به کار میگیرد، پشتیبانی میکند.

نتایج تقسیمبندی را به صورت دستی اصلاح کنید و مدل را روی دادههای سفارشی خود برای دقت بهتر آموزش مجدد دهید.

دسترسی از طریق API پایتون، رابط خط فرمان یا رابط گرافیکی برای جریانهای کاری انعطافپذیر.

قابلیتهای حذف نویز، رفع تاری و افزایش نمونهبرداری برای بهبود کیفیت تصویر پیش از تقسیمبندی.

دانلود یا دسترسی

پیشزمینه فنی

سلپوز در مطالعهای بنیادی توسط استرینگر، وانگ، مایکلوس و پاچیتاریو معرفی شد که روی مجموعه دادهای بزرگ و بسیار متنوع شامل بیش از ۷۰,۰۰۰ شیء تقسیمبندیشده آموزش دیده است. این تنوع به مدل امکان تعمیم در اشکال، اندازهها و تنظیمات میکروسکوپی مختلف را میدهد و نیاز به آموزش سفارشی را در اکثر موارد به طور قابل توجهی کاهش میدهد. برای دادههای سهبعدی، سلپوز بهطور هوشمندانه مدل دو بعدی خود را به صورت «۲.۵ بعدی» مجدداً به کار میگیرد و از نیاز به دادههای آموزشی کاملاً سهبعدی جلوگیری میکند در حالی که تقسیمبندی حجمی ارائه میدهد. نسخه ۲.۰ سلپوز قابلیت آموزش مجدد با دخالت کاربر را معرفی کرد که به کاربران اجازه میدهد پیشبینیها را به صورت دستی اصلاح کرده و روی تصاویر خود آموزش مجدد انجام دهند تا عملکرد روی مجموعه دادههای خاص بهبود یابد.

نصب و راهاندازی

یک محیط پایتون با استفاده از conda راهاندازی کنید:

conda create -n cellpose python=3.10محیط را فعال کرده و Cellpose را نصب کنید:

# For GUI support

pip install cellpose[gui]

# For minimal setup (API/CLI only)

pip install cellposeشروع به کار

حالت رابط گرافیکی

- رابط گرافیکی را با اجرای:

python -m cellposeراهاندازی کنید - فایلهای تصویری (

.tif،.pngو غیره) را به داخل رابط بکشید و رها کنید - نوع مدل را انتخاب کنید (مثلاً «cyto» برای سیتوپلاسم یا «nuclei» برای هسته)

- قطر تخمینی سلول را تنظیم کنید یا اجازه دهید سلپوز به صورت خودکار کالیبره کند

- برای شروع تقسیمبندی کلیک کنید و نتایج را مشاهده نمایید

حالت API پایتون

from cellpose import models

# Load model

model = models.Cellpose(model_type='cyto')

# Segment images

masks, flows = model.eval(images, diameter=30)اصلاح و آموزش مجدد

- پس از تولید ماسکها، تقسیمبندی را در رابط گرافیکی با ادغام یا حذف ماسکها به صورت دستی اصلاح کنید

- از توابع آموزش داخلی برای آموزش مجدد روی نمونههای اصلاحشده استفاده کنید

- عملکرد مدل روی مجموعه داده خاص شما بهبود مییابد

پردازش دادههای سهبعدی

- یک فایل TIFF چند-Z یا پشته حجمی بارگذاری کنید

- از گزینه

--Zstackدر رابط گرافیکی یا API برای پردازش به صورت سهبعدی استفاده کنید - در صورت تمایل جریانهای سهبعدی را با پارامترهای هموارسازی یا تخصصی برای تقسیمبندی بهتر اصلاح کنید

محدودیتها و ملاحظات

- محدودیت تعمیم مدل: در حالی که مدل عمومی به طور گسترده کار میکند، اشکال سلولی بسیار غیرمعمول یا شرایط تصویربرداری خاص ممکن است نیاز به آموزش مجدد داشته باشند.

- نیاز به حاشیهنویسی: آموزش با دخالت کاربر نیازمند اصلاحات دستی است که برای مجموعه دادههای بزرگ میتواند زمانبر باشد.

- پیچیدگی نصب: نصب رابط گرافیکی ممکن است نیازمند استفاده از خط فرمان، محیطهای conda و مدیریت وابستگیهای پایتون باشد — که برای کاربران غیر برنامهنویس همیشه ساده نیست.

- فقط دسکتاپ: سلپوز برای استفاده دسکتاپ طراحی شده است؛ اپلیکیشن بومی اندروید یا iOS ندارد.

سوالات متداول

خیر — سلپوز مدلهای عمومی پیشآموزشدیدهای ارائه میدهد که اغلب بدون آموزش مجدد به خوبی کار میکنند. با این حال، برای نتایج بهینه روی دادههای خاص یا غیرمعمول، میتوانید با استفاده از قابلیتهای دخالت کاربر، حاشیهنویسی کرده و آموزش مجدد انجام دهید.

بله — این ابزار با استفاده از مدل دو بعدی خود به صورت «۲.۵ بعدی» از دادههای سهبعدی پشتیبانی میکند و میتوانید پشتههای حجمی را از طریق رابط گرافیکی یا API پردازش کنید.

استفاده از GPU برای سرعت بخشیدن به استنتاج و آموزش، به ویژه روی دادههای بزرگ یا سهبعدی، بسیار توصیه میشود، اما سلپوز میتواند روی دستگاههای فقط CPU با عملکرد کندتر اجرا شود.

در رابط گرافیکی، قطر تخمینی سلول را به صورت دستی تنظیم کنید یا اجازه دهید سلپوز به طور خودکار آن را کالیبره کند. میتوانید نتایج را اصلاح کرده و در صورت عدم بهینگی تقسیمبندی، آموزش مجدد انجام دهید.

بله — نسخههای جدیدتر (Cellpose 3) شامل مدلهای بازسازی تصویر برای حذف نویز، رفع تاری و افزایش نمونهبرداری هستند تا کیفیت تقسیمبندی پیش از پردازش بهبود یابد.

StarDist

| توسعهدهندگان | اوه اشمیت، مارتین ویگرت، کولمن برادوس و جین مایرز |

| پلتفرمهای پشتیبانیشده |

|

| پشتیبانی زبانی | پروژه متنباز با مستندات و جامعه عمدتاً به زبان انگلیسی |

| مدل قیمتگذاری | رایگان و متنباز. دارای مجوز BSD-3-Clause |

مرور کلی

StarDist ابزاری مبتنی بر یادگیری عمیق برای بخشبندی نمونهها در تصاویر میکروسکوپی است. این ابزار هر شیء (مانند هستههای سلولی) را به صورت چندضلعی ستارهای محدب در ۲بعد یا چندوجهی در ۳بعد نمایش میدهد که امکان تشخیص و جداسازی دقیق اشیاء متراکم یا همپوشان را فراهم میکند. با معماری قدرتمند خود، StarDist به طور گستردهای برای بخشبندی خودکار سلول و هسته در میکروسکوپ فلورسانس، هیستوپاتولوژی و سایر کاربردهای تحلیل تصاویر زیستی استفاده میشود.

ویژگیهای کلیدی

بخشبندی نمونهای بسیار دقیق با استفاده از چندضلعیهای ستارهای محدب (۲بعدی) و چندوجهیها (۳بعدی) برای تشخیص قابل اعتماد اشیاء.

مدلهای اختصاصی برای تصاویر ۲بعدی و دادههای حجمی ۳بعدی برای تحلیل جامع میکروسکوپی.

مدلهای آماده برای هستههای فلورسانس، بافتهای رنگآمیزی شده H&E و سایر سناریوهای رایج تصویربرداری.

طبقهبندی اشیاء شناساییشده به کلاسهای متمایز (مثلاً انواع مختلف سلول) در یک اجرای بخشبندی.

ادغام بیوقفه با ImageJ/Fiji، QuPath و napari برای جریانهای کاری مبتنی بر رابط کاربری گرافیکی.

ارزیابی جامع بخشبندی نمونهها شامل دقت، بازیابی، امتیاز F1 و کیفیت پانورامیک.

پیشزمینه فنی

StarDist که نخستین بار در مقالهای در MICCAI 2018 معرفی شد، نوآوری اصلی آن پیشبینی فاصلههای شعاعی در امتداد پرتوهای ثابت همراه با احتمال شیء برای هر پیکسل است که امکان بازسازی دقیق اشکال ستارهای محدب را فراهم میکند. این روش به طور قابل اعتمادی اشیاء نزدیک به هم را که جداسازی آنها با روشهای سنتی مبتنی بر پیکسل یا جعبه محدود دشوار است، بخشبندی میکند.

تحولات اخیر StarDist را به تصاویر هیستوپاتولوژی گسترش داده است، به طوری که نه تنها بخشبندی هسته بلکه طبقهبندی چندکلاسه اشیاء شناساییشده را نیز ممکن میسازد. این روش در چالشهایی مانند CoNIC (شناسایی و شمارش هستههای روده بزرگ) عملکرد برتر داشته است.

دانلود یا دسترسی

نصب و راهاندازی

TensorFlow (نسخه ۱.x یا ۲.x) را به عنوان پیشنیاز StarDist نصب کنید.

از pip برای نصب بسته پایتون StarDist استفاده کنید:

pip install stardistبرای napari:

pip install stardist-napariبرای QuPath: افزونه StarDist را با کشیدن فایل .jar به داخل QuPath نصب کنید.

برای ImageJ/Fiji: از مدیر افزونه داخلی یا نصب دستی از طریق منوی افزونهها استفاده کنید.

اجرای بخشبندی

یک مدل پیشآموزشدیده را بارگذاری کنید، تصویر خود را نرمالسازی کنید و پیشبینی را اجرا نمایید:

from stardist.models import StarDist2D

model = StarDist2D.from_pretrained('2D_versatile_fluo')

labels, details = model.predict_instances(image)تصویر خود را در napari باز کنید، افزونه StarDist را انتخاب کنید، یک مدل پیشآموزشدیده یا سفارشی را برگزینید و پیشبینی را مستقیماً از رابط گرافیکی اجرا کنید.

از افزونه StarDist در منوی افزونهها برای اعمال مدل روی پشته تصاویر خود با رابط کاربری شهودی استفاده کنید.

پس از نصب افزونه، تشخیص StarDist را از طریق کنسول اسکریپت یا رابط گرافیکی QuPath برای تحلیل هیستوپاتولوژی اجرا کنید.

آموزش و تنظیم دقیق

تصاویر برچسبگذاری شده واقعی ایجاد کنید که هر شیء به طور یکتا برچسبگذاری شده باشد. از ابزارهای حاشیهنویسی مانند LabKit، QuPath یا Fiji برای آمادهسازی دادهها استفاده کنید.

از رابط برنامهنویسی پایتون StarDist برای آموزش مدل جدید یا تنظیم دقیق مدل موجود با دادههای حاشیهنویسی شده سفارشی خود استفاده کنید.

گزینههای پسپردازش

- اعمال سرکوب غیرحداکثری (NMS) برای حذف اشکال کاندیدای تکراری

- استفاده از StarDist OPP (پسپردازش شیء) برای ادغام ماسکها در اشکال غیرستارهای محدب

محدودیتها و ملاحظات

- فرض ستارهای محدب ممکن است اشکال بسیار غیرمحدب یا نامنظم را به خوبی مدل نکند

- پیچیدگی نصب: نصبهای سفارشی نیازمند کامپایلر C++ سازگار برای ساخت افزونهها است

- شتابدهی GPU وابسته به نسخههای سازگار TensorFlow، CUDA و cuDNN است

- برخی کاربران گزارش دادهاند که اجرای افزونه ImageJ به دلیل پیکربندی جاوا با مشکل مواجه است

پرسشهای متداول

StarDist با انواع مختلف تصاویر از جمله فلورسانس، روشنایی زمینه و هیستوپاتولوژی (مثلاً H&E) کار میکند، به لطف مدلهای پیشآموزشدیده انعطافپذیر و سازگاری با مدالیتههای مختلف تصویربرداری.

بله — StarDist بخشبندی نمونهای ۳بعدی را با استفاده از چندوجهیهای ستارهای محدب برای دادههای حجمی پشتیبانی میکند و قابلیتهای ۲بعدی را به تحلیل کامل ۳بعدی گسترش میدهد.

ضروری نیست. مدلهای پیشآموزشدیده موجود هستند و اغلب به خوبی به صورت آماده کار میکنند. با این حال، برای دادههای تخصصی یا جدید، حاشیهنویسی و آموزش مدلهای سفارشی دقت را به طور قابل توجهی افزایش میدهد.

StarDist با napari، ImageJ/Fiji و QuPath ادغام میشود و امکان اجرای بخشبندی از طریق رابط کاربری گرافیکی بدون نیاز به برنامهنویسی را فراهم میکند. همچنین استفاده مستقیم از API پایتون برای جریانهای کاری پیشرفته را پشتیبانی میکند.

StarDist توابع داخلی برای محاسبه معیارهای رایج بخشبندی نمونهها از جمله دقت، بازیابی، امتیاز F1 و کیفیت پانورامیک را فراهم میکند تا عملکرد بخشبندی را ارزیابی کنید.

SAM

اطلاعات کاربردی

| توسعهدهنده | Meta AI Research (FAIR) |

| دستگاههای پشتیبانیشده |

|

| زبان و دسترسی | مدل پایه متنباز در دسترس جهانی؛ مستندات به زبان انگلیسی |

| قیمتگذاری | رایگان — متنباز تحت مجوز Meta از طریق گیتهاب و ادغام در MIB |

مرور کلی

SAM (مدل تقسیمبندی هر چیزی) یک مدل پایه هوش مصنوعی قدرتمند است که توسط Meta ایجاد شده و امکان تقسیمبندی تعاملی و خودکار تقریباً هر شیء در تصاویر را فراهم میکند. با استفاده از ورودیهایی مانند نقاط، جعبههای محدودکننده یا ماسکهای تقریبی، SAM ماسکهای تقسیمبندی را بدون نیاز به آموزش مجدد اختصاصی تولید میکند. در پژوهشهای میکروسکوپی، انعطافپذیری SAM برای تقسیمبندی سلولها، شناسایی اندامکها و تحلیل هیستوپاتولوژی تطبیق یافته است و راهحلی مقیاسپذیر برای پژوهشگرانی است که به دنبال ابزاری عمومی و قابل فرمان برای تقسیمبندی هستند.

معرفی مفصل

سام در ابتدا توسط Meta روی بیش از یک میلیارد ماسک در ۱۱ میلیون تصویر آموزش داده شده است و به عنوان یک مدل پایه قابل فرمان برای تقسیمبندی با عملکرد «صفر-شات» در حوزههای جدید طراحی شده است. در پژوهشهای تصویربرداری پزشکی، سام برای تقسیمبندی کل اسلایدهای پاتولوژی، شناسایی تومور و تشخیص هستههای سلولی ارزیابی شده است. با این حال، عملکرد آن روی نمونههای متراکم—مانند هستههای سلولی—متفاوت است: حتی با ورودیهای گسترده (مثلاً ۲۰ کلیک یا جعبه)، تقسیمبندی صفر-شات در تصاویر میکروسکوپی پیچیده ممکن است دچار مشکل شود.

برای رفع این محدودیت، تطبیقهای حوزهمحور به وجود آمدهاند:

- SAMCell — تنظیم دقیق شده روی مجموعه دادههای بزرگ میکروسکوپی برای تقسیمبندی صفر-شات قوی در انواع مختلف سلول بدون نیاز به آموزش مجدد برای هر آزمایش

- μSAM — آموزش مجدد روی بیش از ۱۷۰۰۰ تصویر میکروسکوپی با حاشیهنویسی دستی برای افزایش دقت روی ساختارهای سلولی کوچک

ویژگیهای کلیدی

تعامل انعطافپذیر با استفاده از نقاط، جعبهها و ماسکها برای کنترل دقیق.

انجام تقسیمبندی بدون نیاز به تنظیم دقیق روی حوزههای تصویری جدید.

قابل تطبیق برای میکروسکوپی و هیستوپاتولوژی از طریق آموزش چند-نمونه یا مبتنی بر ورودی.

در مرورگر تصویر میکروسکوپی (MIB) با پشتیبانی از تقسیمبندی سهبعدی و درونیابی در دسترس است.

IDCC-SAM امکان شمارش خودکار سلولها در ایمونوسیتوشیمی بدون نیاز به حاشیهنویسی دستی را فراهم میکند.

دانلود یا دسترسی

راهنمای کاربر

- مرورگر تصویر میکروسکوپی را باز کرده و به پنل تقسیمبندی SAM بروید

- مفسر پایتون را پیکربندی کرده و بین مدلهای SAM-1 یا SAM-2 انتخاب کنید

- برای شتابدهی GPU، گزینه «cuda» را در محیط اجرا انتخاب کنید (برای عملکرد بهینه توصیه میشود)

- ورودی نقطهای: روی یک شیء کلیک کنید تا یک نقطه مثبت تعریف شود؛ برای گسترش از Shift + کلیک و برای نقاط منفی از Ctrl + کلیک استفاده کنید

- پشتههای سهبعدی: از حالت تعاملی سهبعدی استفاده کنید—روی یک برش کلیک کنید، با شیفت اسکرول کنید و نقاط را در برشها درونیابی کنید

- حالت تنظیم: ماسکها را جایگزین، اضافه یا کم کنید، یا در صورت نیاز لایه جدید بسازید

- از گزینه «همه چیز خودکار» در پنل SAM-2 در MIB برای تقسیمبندی همه اشیاء قابل مشاهده در یک ناحیه استفاده کنید

- پس از تقسیمبندی، ماسکها را بررسی و در صورت نیاز اصلاح کنید

- از خطوط لوله تنظیم دقیق مبتنی بر ورودی (مثلاً «All-in-SAM») برای تولید حاشیهنویسیهای پیکسلی از ورودیهای پراکنده کاربر استفاده کنید

- برای شمارش سلول، از IDCC-SAM استفاده کنید که سام را در یک خط لوله صفر-شات با پردازش پسین به کار میگیرد

- برای تقسیمبندی سلول با دقت بالا، از SAMCell که روی تصاویر سلولی میکروسکوپی تنظیم دقیق شده است بهره ببرید

محدودیتها و ملاحظات

- عملکرد صفر-شات در ساختارهای متراکم یا همپوشان بدون تنظیم حوزهمحور ناپایدار است

- کیفیت تقسیمبندی به شدت به طراحی و استراتژی ورودیها وابسته است

- استفاده از GPU به شدت توصیه میشود؛ اجرای روی CPU بسیار کند است

- در تصاویر کل اسلاید با وضوح بسیار بالا و ساختارهای بافت چندمقیاسی دچار مشکل میشود

- تنظیم دقیق یا تطبیق سام برای میکروسکوپی ممکن است نیازمند مهارت در یادگیری ماشین باشد

پرسشهای متداول

بله—از طریق تطبیقهایی مانند SAMCell که سام را به طور خاص برای وظایف تقسیمبندی سلول روی مجموعه دادههای میکروسکوپی تنظیم دقیق میکند.

همیشه نه. با IDCC-SAM میتوانید شمارش سلول صفر-شات را بدون حاشیهنویسی دستی انجام دهید.

از تنظیم دقیق مبتنی بر ورودی (مثلاً «All-in-SAM») یا نسخههای پیشآموزشدیده میکروسکوپی مانند μSAM استفاده کنید که روی بیش از ۱۷۰۰۰ تصویر میکروسکوپی حاشیهنویسی شده آموزش دیده است.

اگرچه روی CPU ممکن است، GPU به شدت توصیه میشود برای سرعت استنتاج عملی و تقسیمبندی تعاملی در زمان واقعی.

بله—ادغام سام-۲ در MIB از تقسیمبندی سهبعدی با درونیابی نقاط در برشها برای تحلیل حجمی پشتیبانی میکند.

AxonDeepSeg

| توسعهدهنده | آزمایشگاه NeuroPoly در پلیتکنیک مونترال و دانشگاه مونترال |

| پلتفرمهای پشتیبانیشده |

|

| زبان | مستندات به زبان انگلیسی؛ ابزار متنباز با استفاده جهانی |

| قیمتگذاری | رایگان و متنباز |

مرور کلی

AxonDeepSeg ابزاری مبتنی بر هوش مصنوعی برای تقسیمبندی خودکار آکسونها و مایلین در تصاویر میکروسکوپی است. با استفاده از شبکههای عصبی کانولوشنی، تقسیمبندی دقیق سهکلاسه (آکسون، مایلین، پسزمینه) را در چندین مدالیته تصویربرداری از جمله TEM، SEM و میکروسکوپی میدان روشن ارائه میدهد. با خودکارسازی اندازهگیریهای مورفومتریک مانند قطر آکسون، نسبت g و ضخامت مایلین، AxonDeepSeg تحلیل کمی در تحقیقات علوم اعصاب را تسهیل کرده و به طور قابل توجهی زمان حاشیهنویسی دستی را کاهش داده و قابلیت تکرارپذیری را بهبود میبخشد.

ویژگیهای کلیدی

مدلهای آماده استفاده بهینهشده برای مدالیتههای میکروسکوپی TEM، SEM و میدان روشن.

طبقهبندی دقیق مناطق آکسون، مایلین و پسزمینه در تصاویر میکروسکوپی.

محاسبه خودکار قطر آکسون، نسبت g، ضخامت مایلین و معیارهای چگالی.

ادغام با رابط کاربری Napari امکان اصلاح دستی ماسکهای تقسیمبندی برای دقت بالاتر را فراهم میکند.

ادغام بیوقفه در خطوط پردازش سفارشی برای تحلیل گسترده بافت عصبی.

اسکریپتهای تست جامع تضمینکننده تکرارپذیری و نتایج قابل اعتماد تقسیمبندی.

جزئیات فنی

AxonDeepSeg که توسط آزمایشگاه NeuroPoly توسعه یافته است، از یادگیری عمیق برای ارائه تقسیمبندی با دقت بالا در کاربردهای علوم اعصاب بهره میبرد. مدلهای پیشآموزشدیده برای مدالیتههای مختلف میکروسکوپی در دسترس هستند که انعطافپذیری در تکنیکهای تصویربرداری را تضمین میکند. این ابزار با Napari ادغام شده و امکان اصلاح تعاملی ماسکهای تقسیمبندی را فراهم میآورد که دقت را در مجموعه دادههای چالشبرانگیز افزایش میدهد. AxonDeepSeg معیارهای مورفومتریک کلیدی را محاسبه میکند و از مطالعات با حجم بالا در ساختار و آسیبشناسی بافت عصبی پشتیبانی میکند. چارچوب مبتنی بر پایتون آن امکان ادغام در خطوط پردازش سفارشی برای تحلیل گسترده مورفولوژی آکسون و مایلین را فراهم میسازد.

دانلود یا دسترسی

نصب و راهاندازی

اطمینان حاصل کنید که پایتون نسخه 3.8 یا بالاتر نصب شده است، سپس AxonDeepSeg و Napari را با استفاده از pip نصب کنید:

pip install axondeepseg napariاسکریپتهای تست ارائهشده را اجرا کنید تا از نصب صحیح و عملکرد درست همه اجزا اطمینان حاصل شود.

تصاویر میکروسکوپی (TEM، SEM یا میدان روشن) را در Napari یا محیط پایتون خود وارد کنید.

مدل پیشآموزشدیده مناسب برای مدالیته تصویربرداری خود را انتخاب کرده و تقسیمبندی را اجرا کنید تا ماسکهای آکسون و مایلین تولید شود.

اندازهگیریهای مورفومتریک شامل قطر آکسون، نسبت g، چگالی و ضخامت مایلین را به صورت خودکار محاسبه کرده و نتایج را در قالب CSV صادر کنید.

از رابط کاربری Napari برای تنظیم دستی ماسکهای تقسیمبندی در صورت نیاز استفاده کنید، ماسکها را ادغام یا حذف کنید تا دقت بهبود یابد.

نکات مهم

- عملکرد ممکن است در مدالیتههای تصویربرداری نوین یا آموزشندیده کاهش یابد

- اصلاحات دستی ممکن است برای مناطق چالشبرانگیز یا پیچیده لازم باشد

- استفاده از GPU برای پردازش سریعتر دادههای بزرگ توصیه میشود؛ پردازش با CPU نیز پشتیبانی میشود

پرسشهای متداول

AxonDeepSeg از میکروسکوپ الکترونی عبوری (TEM)، میکروسکوپ الکترونی روبشی (SEM) و میکروسکوپ میدان روشن با مدلهای پیشآموزشدیده بهینهشده برای هر مدالیته پشتیبانی میکند.

بله، AxonDeepSeg کاملاً رایگان و متنباز است و برای استفادههای دانشگاهی و تجاری در دسترس است.

بله، AxonDeepSeg به طور خودکار قطر آکسون، نسبت g، ضخامت مایلین و معیارهای چگالی را از تصاویر تقسیمبندیشده محاسبه میکند.

استفاده از GPU برای تقسیمبندی سریعتر دادههای بزرگ توصیه میشود، اما پردازش با CPU نیز برای تحلیلهای کوچکتر پشتیبانی میشود.

بله، ادغام با رابط کاربری Napari امکان اصلاح تعاملی و بهبود ماسکهای تقسیمبندی را برای دقت بالاتر در مناطق چالشبرانگیز فراهم میکند.

Ilastik

| توسعهدهنده | تیم Ilastik در آزمایشگاه زیستشناسی مولکولی اروپا (EMBL) و شرکای دانشگاهی مرتبط |

| پلتفرمهای پشتیبانیشده |

|

| زبان | انگلیسی |

| قیمتگذاری | رایگان و متنباز |

مرور کلی

Ilastik ابزاری قدرتمند و مبتنی بر هوش مصنوعی برای بخشبندی تعاملی تصاویر، طبقهبندی و تحلیل دادههای میکروسکوپی است. با استفاده از تکنیکهای یادگیری ماشین مانند طبقهبندهای جنگل تصادفی، به پژوهشگران امکان میدهد پیکسلها را بخشبندی کنند، اشیاء را طبقهبندی نمایند، سلولها را در طول زمان ردیابی کنند و شمارش چگالی را در دادههای دوبعدی و سهبعدی انجام دهند. با رابط کاربری شهودی و بازخورد بلادرنگ، Ilastik برای دانشمندانی که تخصص برنامهنویسی ندارند نیز قابل دسترسی است و در زیستشناسی سلولی، علوم اعصاب و تصویربرداری پزشکی به طور گستردهای استفاده میشود.

ویژگیهای کلیدی

بازخورد بلادرنگ هنگام نشانهگذاری مناطق نماینده برای دریافت نتایج بخشبندی فوری.

دستهبندی ساختارهای بخشبندیشده بر اساس ویژگیهای مورفولوژیکی و شدت نور.

ردیابی حرکت و تقسیم سلول در آزمایشهای میکروسکوپی زمانگذری دوبعدی و سهبعدی.

کمیتسنجی مناطق شلوغ بدون بخشبندی صریح اشیاء منفرد.

بخشبندی نیمهخودکار برای حجمهای پیچیده سهبعدی با تعامل شهودی.

پردازش خودکار چندین تصویر با استفاده از حالت خط فرمان بدون رابط گرافیکی.

دانلود

راهنمای شروع کار

نرمافزار Ilastik را برای سیستمعامل خود از وبسایت رسمی دانلود کنید. بسته شامل تمام وابستگیهای پایتون لازم است، بنابراین دستورالعملهای نصب مربوط به پلتفرم خود را دنبال کنید.

Ilastik را باز کنید و گردش کار تحلیل خود را انتخاب نمایید: طبقهبندی پیکسل، طبقهبندی اشیاء، ردیابی یا شمارش چگالی. مجموعه داده تصویری خود را بارگذاری کنید که میتواند شامل تصاویر چندکاناله، سهبعدی یا زمانگذری باشد.

چند پیکسل یا شیء نماینده را در تصاویر خود نشانهگذاری کنید. طبقهبند جنگل تصادفی Ilastik از این نشانهها یاد میگیرد و به طور خودکار برچسبها را در کل مجموعه داده پیشبینی میکند.

مدل آموزشدیده را برای بخشبندی یا طبقهبندی کل مجموعه داده خود اعمال کنید. نتایج را به صورت تصاویر برچسبخورده، نقشههای احتمال یا جداول کمی برای تحلیل و نمایشهای بعدی صادر کنید.

از حالت بدون رابط گرافیکی Ilastik برای پردازش خودکار چندین تصویر بدون دخالت دستی استفاده کنید، که برای خطوط پردازش تحلیل در مقیاس بزرگ ایدهآل است.

محدودیتها و ملاحظات

- نشانهگذاری تعاملی ممکن است برای مجموعه دادههای بسیار بزرگ زمانبر باشد

- دقت به کیفیت و نمایندگی نشانهگذاریهای کاربر بستگی دارد

- نیازمندیهای حافظه — دادههای با وضوح بسیار بالا یا چند گیگابایتی ممکن است به حافظه رم قابل توجهی نیاز داشته باشند

- دادههای پیچیده — طبقهبندهای جنگل تصادفی ممکن است نسبت به شبکههای عصبی عمیق در دادههای تصویری بسیار متغیر یا پیچیده عملکرد ضعیفتری داشته باشند

پرسشهای متداول

بله، Ilastik به طور کامل از حجمهای سهبعدی و آزمایشهای زمانگذری برای بخشبندی، ردیابی و تحلیل کمی در چندین نقطه زمانی پشتیبانی میکند.

بله، Ilastik کاملاً رایگان و متنباز است و برای همه کاربران بدون محدودیت مجوز در دسترس است.

خیر، Ilastik رابط گرافیکی شهودی با بازخورد بلادرنگ ارائه میدهد که آن را برای پژوهشگرانی بدون تخصص برنامهنویسی قابل دسترس میکند. کاربران پیشرفته نیز میتوانند از پردازش دستهای خط فرمان استفاده کنند.

بله، گردش کار اختصاصی ردیابی امکان تحلیل حرکت و تقسیم سلول را در دادههای زمانگذری دوبعدی و سهبعدی با ردیابی خودکار نسل فراهم میکند.

خروجیهای بخشبندی را میتوان به صورت تصاویر برچسبخورده، نقشههای احتمال یا جداول کمی صادر کرد که امکان ادغام بیوقفه با ابزارهای تحلیل و نرمافزارهای نمایش را فراهم میسازد.

این ابزارها از سطح مبتدی تا حرفهای را پوشش میدهند. بسیاری رایگان و متنباز هستند و امکان ایجاد روندهای کاری هوش مصنوعی قابل بازتولید و اشتراکگذاری در جامعه پژوهشی را فراهم میکنند.

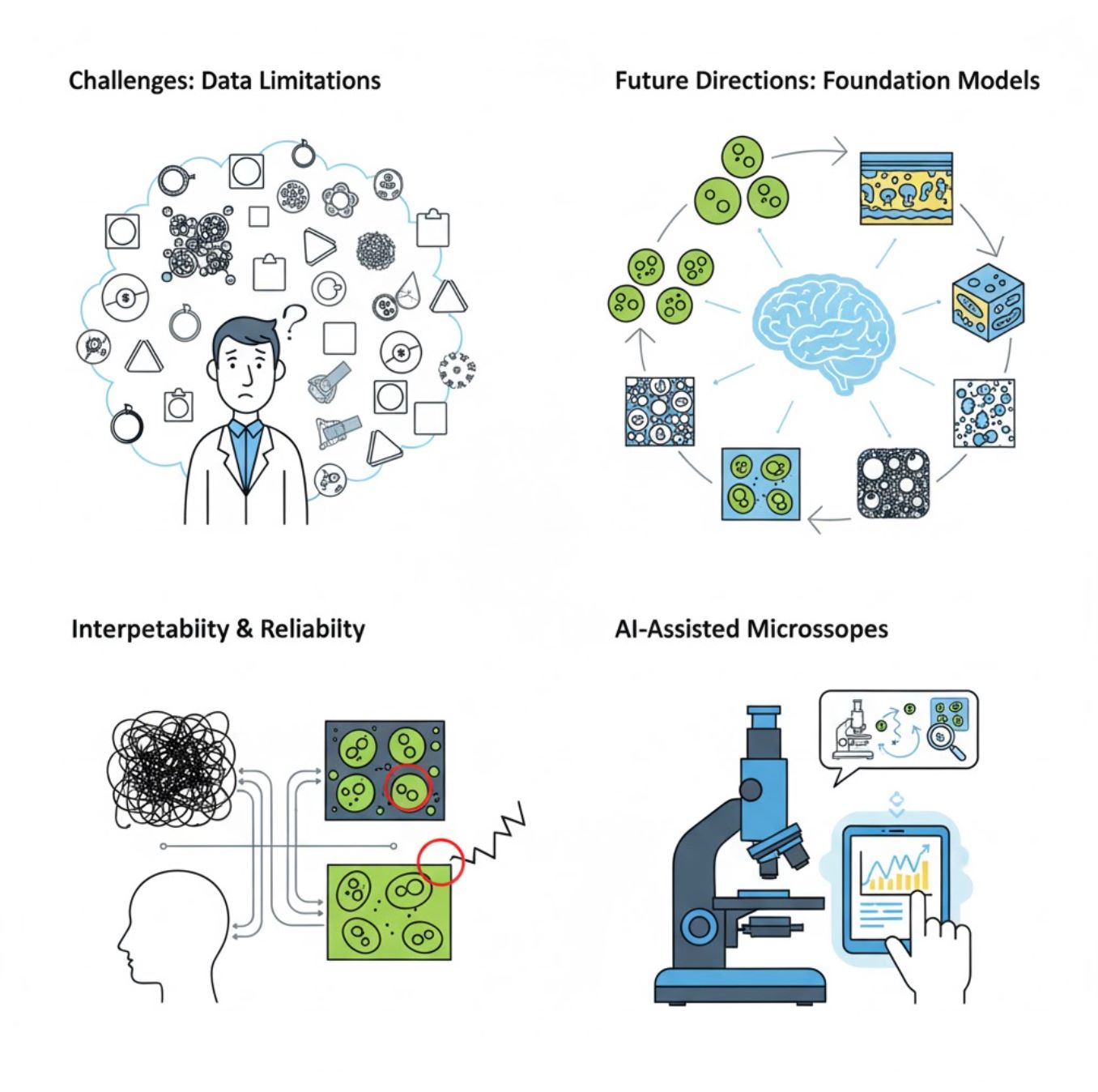

چالشها و مسیرهای آینده

چالشهای فعلی

روندهای نوظهور

مدلهای پایه بینایی

سیستمهای هوش مصنوعی نسل بعدی وعده کاهش نیاز به آموزشهای خاص وظیفه را میدهند.

- مدلهایی مانند SAM و سیستمهای مبتنی بر CLIP

- یک هوش مصنوعی برای انجام بسیاری از وظایف میکروسکوپی

- استقرار و تطبیق سریعتر

میکروسکوپهای هوش مصنوعییار

سیستمهای میکروسکوپی کاملاً خودکار و هوشمند در حال تبدیل به واقعیت هستند.

- کنترل زبان طبیعی از طریق مدلهای زبان بزرگ (LLM)

- حلقههای بازخورد کاملاً خودکار

- دموکراتیزه کردن دسترسی به میکروسکوپی پیشرفته

نکات کلیدی

- هوش مصنوعی با دقت و خودکارسازی بهبود یافته، پردازش تصاویر میکروسکوپی را به سرعت متحول میکند

- یادگیری عمیق در تصاویر میکروسکوپی پیچیده و متغیر، از یادگیری ماشین سنتی پیشی میگیرد

- CNNها ویژگیهای سلسلهمراتبی را از پیکسلهای خام بهصورت خودکار یاد میگیرند تا تحلیل مقاوم ارائه دهند

- کاربردهای کلیدی شامل تقسیمبندی، طبقهبندی، ردیابی، کاهش نویز و اکتساب خودکار است

- موفقیت به دادههای با کیفیت و اعتبارسنجی دقیق توسط کارشناسان بستگی دارد

- مدلهای پایه بینایی و میکروسکوپهای هوش مصنوعییار نمایانگر آینده این حوزه هستند

با پیشرفتهای مداوم و تلاشهای جامعه (ابزارهای متنباز، مجموعه دادههای مشترک)، هوش مصنوعی بهطور فزایندهای به بخشی اساسی از «چشم» میکروسکوپ تبدیل خواهد شد و به دانشمندان کمک میکند آنچه را که دیده نمیشود، ببینند.

No comments yet. Be the first to comment!