Dialogue de personnages généré par IA dans les jeux

L’IA transforme la manière dont les personnages de jeu interagissent avec les joueurs. Cet article explique comment l’IA alimente des dialogues dynamiques pour les PNJ, met en avant des outils phares comme Inworld AI, GPT-4 et Convai, et explore des exemples concrets de jeux utilisant la conversation générative.

Les jeux vidéo ont traditionnellement reposé sur des arbres de dialogue pré-écrits, où les PNJ (personnages non-joueurs) délivrent des répliques fixes en réponse aux actions du joueur. Aujourd’hui, le dialogue piloté par l’IA utilise des modèles d’apprentissage automatique — en particulier les grands modèles de langage (LLM) — pour générer dynamiquement les réponses des personnages. Comme le rapporte l’Associated Press, les studios « expérimentent avec l’IA générative pour aider à créer les dialogues des PNJ » et concevoir des mondes « plus réactifs » à la créativité des joueurs.

En pratique, cela signifie que les PNJ peuvent se souvenir des interactions passées, répondre avec des répliques inédites et engager des conversations libres au lieu de répéter des réponses préenregistrées. Les studios de jeux et les chercheurs notent que la forte compréhension contextuelle des LLM produit des « réponses au son naturel » qui peuvent remplacer les scripts de dialogue traditionnels.

Pourquoi le dialogue IA est important

Immersion & rejouabilité

Les PNJ gagnent des personnalités réalistes, riches et dynamiques, créant des conversations plus profondes et un engagement plus fort des joueurs.

Conscience contextuelle

Les personnages se souviennent des rencontres passées et s’adaptent aux choix du joueur, rendant les mondes plus réactifs et vivants.

Gameplay émergent

Les joueurs peuvent interagir librement, générant des histoires émergentes au lieu de suivre des quêtes prédéfinies.

L’IA comme outil créatif, pas un remplacement

Le dialogue alimenté par l’IA est conçu pour assister les développeurs, pas remplacer la créativité humaine. Ubisoft souligne que les scénaristes et artistes définissent toujours l’identité fondamentale de chaque personnage.

Les développeurs « façonnent [le] caractère, l’histoire et le style de conversation d’un PNJ », puis utilisent l’IA « seulement si cela leur apporte une valeur » – l’IA « ne doit pas remplacer » la créativité humaine.

— Ubisoft, projet NEO NPC

Dans le prototype « NEO NPC » d’Ubisoft, les concepteurs créent d’abord l’histoire et la voix d’un PNJ, puis guident l’IA pour qu’elle suive ce personnage. Les outils génératifs fonctionnent comme des « copilotes » narratifs, aidant les scénaristes à explorer rapidement et efficacement des idées.

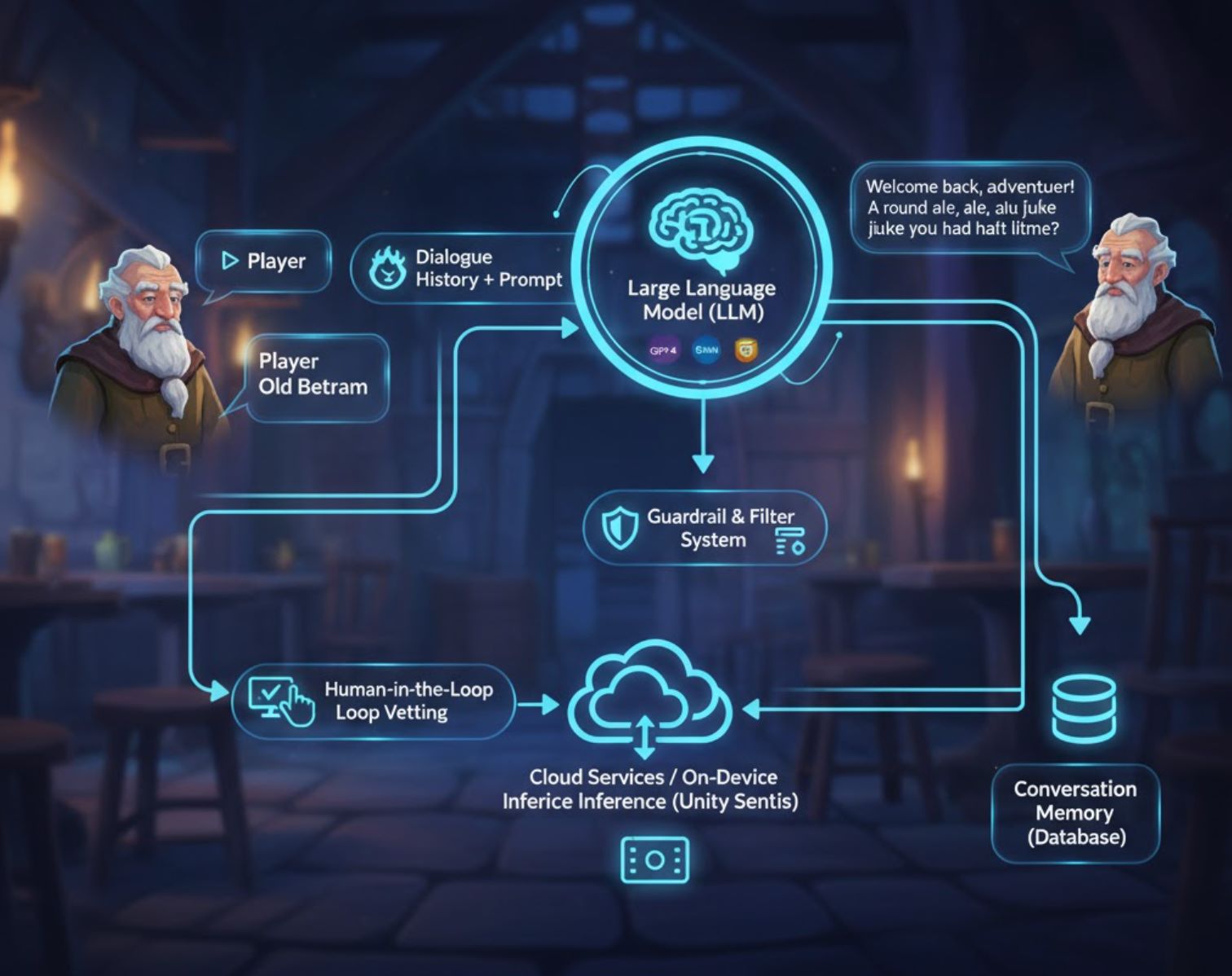

Comment fonctionnent les systèmes de dialogue IA

La plupart des systèmes de dialogue IA utilisent des grands modèles de langage (LLM) comme GPT-4, Google Gemini ou Claude — des réseaux neuronaux entraînés sur d’immenses corpus textuels pour générer des réponses cohérentes.

Définition du personnage

Les développeurs fournissent une consigne décrivant la personnalité et le contexte du PNJ (ex. : « Vous êtes un vieux tavernier nommé Old Bertram, qui parle gentiment et se souvient des commandes précédentes du joueur »)

Génération en temps réel

Quand un joueur parle à un PNJ IA, le jeu envoie la consigne et l’historique du dialogue au modèle de langage via une API

Livraison de la réponse

L’IA renvoie une réplique, que le jeu affiche ou vocalise en temps réel ou quasi temps réel

Rétention de la mémoire

Les journaux de conversation sont stockés pour que l’IA sache ce qui a été dit auparavant et maintienne la cohérence entre les sessions

Mesures de sécurité & contrôle qualité

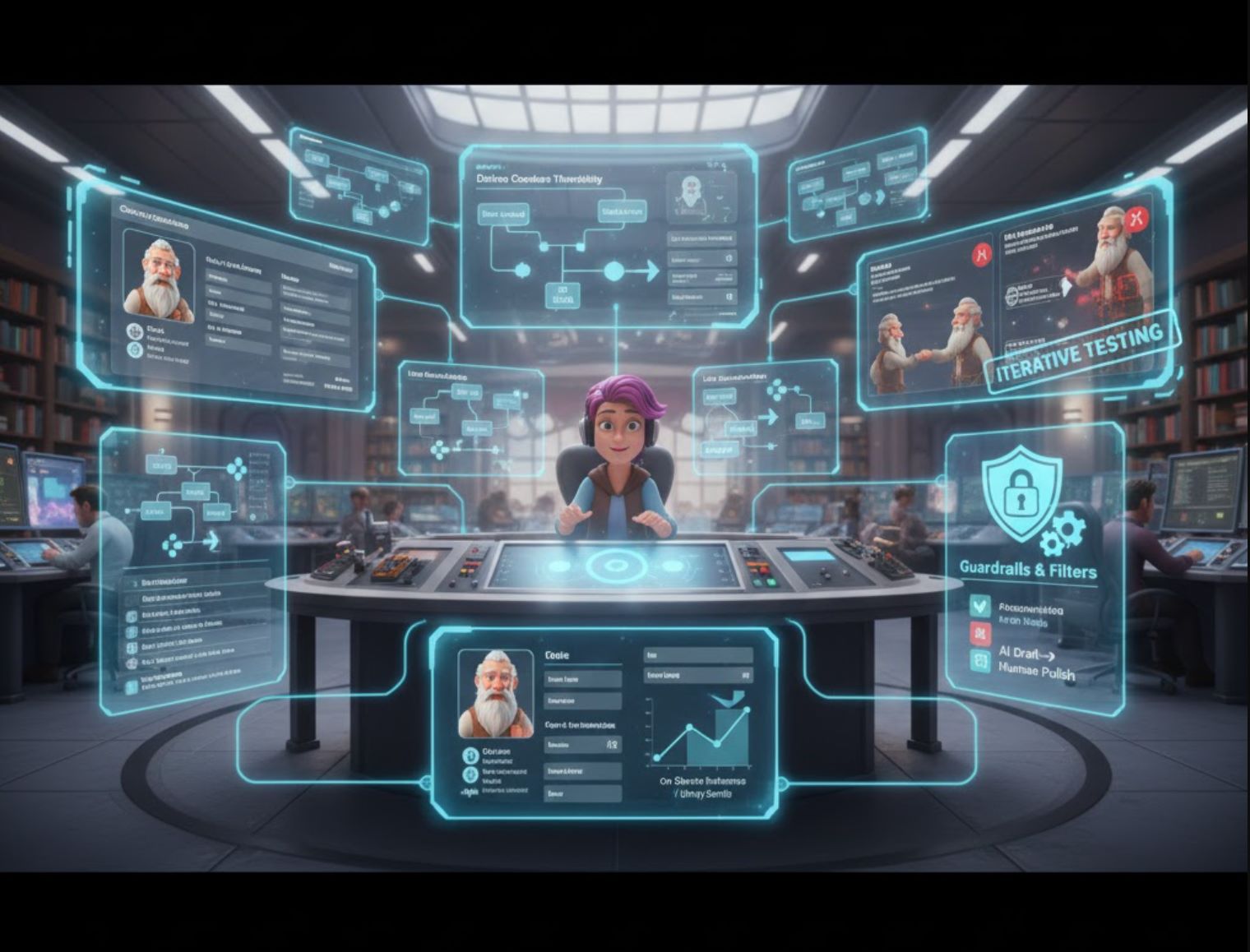

Les équipes intègrent plusieurs mesures pour maintenir la cohérence des personnages et éviter les réponses inappropriées :

- Des systèmes de garde-fous et des filtres anti-toxicité maintiennent les PNJ dans leur rôle

- Itération avec intervention humaine : si un PNJ « a répondu comme le personnage imaginé », les développeurs conservent la réponse ; sinon, ils ajustent les consignes du modèle

- Des consignes de haute qualité garantissent un dialogue de qualité (« poubelle entrée, poubelle sortie »)

- Services cloud ou inférence locale (ex. Unity Sentis) optimisent les performances et réduisent la latence

Avantages et défis

Bénéfices pour développeurs & joueurs

- Gain de temps : Rédiger rapidement des conversations au lieu d’écrire chaque réplique manuellement

- Brainstorming créatif : Utiliser l’IA comme point de départ pour explorer de nouvelles directions de dialogue

- Scalabilité : Générer de longues sessions de chat et des branches d’histoire personnalisées

- Engagement des joueurs : Les PNJ qui se souviennent des rencontres passées paraissent plus vivants et adaptatifs

- Récit émergent : Les joueurs peuvent créer des interactions libres dans des jeux bac à sable ou multijoueurs

Pièges à gérer

- Dialogue sans sens : Un dialogue illimité et aléatoire est « juste un bruit sans fin » et casse l’immersion

- Hallucination : L’IA peut générer des répliques hors sujet si elle n’est pas bien encadrée par le contexte

- Coût computationnel : Les appels API LLM s’accumulent à grande échelle ; les frais peuvent peser sur les budgets

- Questions éthiques : Les acteurs vocaux et scénaristes craignent pour leur emploi

- Transparence : Certains envisagent de divulguer aux joueurs les répliques écrites par IA

Outils & plateformes pour le dialogue IA dans les jeux

<ITEM_DESCRIPTION>Les créateurs de jeux disposent de nombreuses options pour les dialogues assistés par intelligence artificielle. Voici quelques outils et technologies remarquables :</ITEM_DESCRIPTION>

Inworld AI

Informations sur l’application

| Développeur | Inworld AI, Inc. |

| Plates-formes supportées |

|

| Support linguistique | Principalement l’anglais ; génération vocale multilingue et fonctionnalités de localisation en développement. |

| Modèle tarifaire | Freemium : crédits gratuits avec paiement à l’usage pour les dialogues LLM et la synthèse vocale. |

Vue d’ensemble

Inworld AI est une plateforme d’IA générative conçue pour créer des personnages non-joueurs (PNJ) très réalistes et émotionnellement intelligents pour les jeux. En combinant mémoire, objectifs, personnalité et synthèse vocale, elle permet des conversations dynamiques et contextuelles qui évoluent selon le comportement du joueur et l’état du monde. Les développeurs de jeux peuvent créer des personnages pilotés par IA à l’aide d’outils visuels, puis les intégrer aux moteurs de jeu comme Unreal ou via API.

Fonctionnalités clés

Personnages avec mémoire, objectifs et dynamique émotionnelle qui répondent naturellement aux interactions des joueurs.

Interface Studio sans code, basée sur des graphes, pour définir la personnalité, les connaissances, les relations et le style de dialogue.

Synthèse vocale à faible latence avec archétypes vocaux intégrés adaptés au jeu et aux nuances émotionnelles.

Les PNJ se souviennent des interactions passées et font évoluer leurs relations avec les joueurs au fil du temps.

Filtrer les connaissances des personnages et modérer les réponses pour garantir un comportement réaliste et sûr des PNJ.

SDK et plugins pour Unreal Engine, Unity (accès anticipé) et modèles d’agents Node.js.

Télécharger ou accéder

Premiers pas

Inscrivez-vous sur le site d’Inworld pour accéder au créateur de personnages Studio.

Utilisez Studio pour définir la personnalité, la mémoire, les graphes émotionnels et la base de connaissances de votre PNJ.

Téléchargez le SDK Unreal Runtime ou le plugin Unity, puis importez les composants du modèle de personnage dans votre projet.

Configurez les entrées du joueur (voix ou texte), connectez-les au graphe de dialogue et associez la sortie à la synthèse vocale et à la synchronisation labiale.

Définissez ce que votre PNJ sait et comment ses connaissances évoluent en fonction des actions du joueur au fil du temps.

Prototypage des interactions dans Studio, révision des dialogues générés, ajustement des objectifs et des poids émotionnels du personnage, puis redéploiement.

Utilisez l’API ou le SDK intégré pour lancer vos PNJ pilotés par IA dans votre jeu ou expérience interactive.

Considérations importantes

Configuration et optimisation

- Le réglage de la mémoire et le filtrage de sécurité demandent une configuration rigoureuse pour éviter des réponses irréalistes ou non sécurisées des PNJ

- La localisation vocale s’étend progressivement mais toutes les langues ne sont pas encore disponibles

- Testez soigneusement le comportement des personnages avant le déploiement en production pour garantir des interactions de qualité

Questions fréquentes

Oui, Inworld Studio offre une interface sans code, basée sur des graphes, pour concevoir la personnalité, le dialogue et le comportement des personnages sans connaissances en programmation.

Oui, Inworld comprend une API de synthèse vocale expressive avec des voix optimisées pour le jeu et des archétypes de personnages intégrés. La synthèse vocale est intégrée au moteur Inworld.

Inworld utilise un tarif basé sur l’usage : vous payez par million de caractères pour la synthèse vocale et les coûts de calcul pour la génération de dialogues LLM. Des crédits gratuits sont disponibles pour commencer.

Oui, Inworld prend en charge la mémoire à long terme, permettant aux PNJ de se souvenir des interactions passées et de maintenir des relations évolutives avec les joueurs sur plusieurs sessions.

Oui, le plugin Inworld AI NPC Engine est disponible sur l’Epic Games Marketplace pour l’intégration avec Unreal Engine.

HammerAI

Informations sur l’application

| Développeur | HammerAI (développeur solo / petite équipe) |

| Plates-formes prises en charge |

|

| Support linguistique | Principalement l’anglais ; la création de personnages prend en charge divers styles sans limitation géographique |

| Modèle tarifaire | Offre gratuite avec conversations et personnages illimités ; les forfaits payants (Starter, Advanced, Ultimate) offrent une taille de contexte étendue et des fonctionnalités avancées |

Présentation

HammerAI est une plateforme d’IA puissante conçue pour créer des dialogues de personnages réalistes et expressifs. Elle permet aux écrivains, développeurs de jeux et rôlistes d’interagir avec des personnages pilotés par IA via un chat intuitif, leur offrant la possibilité de construire un lore riche, des arrière-plans et des conversations immersives. La plateforme prend en charge à la fois les modèles linguistiques locaux et les options hébergées dans le cloud, offrant une flexibilité entre confidentialité et évolutivité.

Fonctionnalités clés

L’offre gratuite permet des chats et créations de personnages illimités sans restrictions.

Exécutez des LLM puissants localement via l’application de bureau pour la confidentialité ou utilisez des modèles hébergés dans le cloud pour plus de commodité.

Construisez un lore détaillé, des arrière-plans et des paramètres de personnages pour enrichir les dialogues et maintenir la cohérence.

Mode spécialisé pour écrire des dialogues pour les cinématiques de jeux et les séquences narratives interactives.

L’application de bureau prend en charge la génération d’images pendant les chats grâce à des modèles intégrés comme Flux.

Invitez jusqu’à 10 personnages dans une seule conversation de groupe pour des interactions complexes multi-personnages.

Introduction détaillée

HammerAI offre un environnement unique pour créer et converser avec des personnages IA. Via l’application de bureau, les utilisateurs peuvent exécuter des modèles linguistiques localement sur leur propre matériel en utilisant ollama ou llama.cpp, garantissant confidentialité et fonctionnement hors ligne. Pour ceux qui préfèrent les solutions cloud, HammerAI propose un hébergement distant sécurisé pour un chat IA illimité sans nécessiter de compte.

Le système de personnages prend en charge les lorebooks, les histoires personnelles et l’ajustement du style de dialogue, ce qui le rend idéal pour le développement narratif dans les jeux, les scénarios et la fiction interactive. La plateforme inclut des outils spécialisés pour la génération de dialogues de cinématiques, permettant une création rapide de séquences cinématographiques et narratives de jeux avec un formatage adapté pour les dialogues parlés, les pensées et la narration.

Téléchargement ou accès

Guide de démarrage

Obtenez HammerAI depuis sa page itch.io pour Windows, macOS ou Linux.

Utilisez l’onglet « Modèles » dans l’application de bureau pour télécharger des modèles linguistiques comme Mistral-Nemo ou Smart Lemon Cookie.

Choisissez parmi les cartes de personnages IA existantes ou créez votre propre personnage personnalisé via le mode Auteur.

Entrez des dialogues ou des actions en texte normal pour le discours ou en italique pour la narration et les pensées.

Cliquez sur « Régénérer » si la réponse de l’IA ne vous satisfait pas, ou modifiez votre saisie pour orienter de meilleures réponses.

Créez et stockez les histoires des personnages et le lore du monde pour maintenir un contexte cohérent tout au long des conversations.

Basculez en mode dialogue de cinématique pour écrire des échanges narratifs cinématographiques ou interactifs pour jeux et histoires.

Limitations & notes importantes

- L’utilisation hors ligne nécessite le téléchargement préalable des fichiers de personnages et de modèles

- Les modèles cloud sont limités à un contexte de 4 096 tokens sur le plan gratuit ; les plans supérieurs offrent un contexte étendu

- Les discussions et personnages sont stockés localement ; la synchronisation multi-appareils n’est pas disponible faute de système de connexion

- Les modèles hébergés dans le cloud utilisent des filtres de contenu ; les modèles locaux sont moins restreints

- Les performances des modèles locaux dépendent de la RAM et des ressources GPU disponibles

Questions fréquentes

Oui — HammerAI propose une offre gratuite qui permet des conversations et créations de personnages illimitées. Les forfaits payants (Starter, Advanced, Ultimate) offrent une taille de contexte étendue et des fonctionnalités supplémentaires pour les utilisateurs avancés.

Oui, via l’application de bureau exécutant des modèles linguistiques locaux. Vous devez télécharger à l’avance les fichiers de personnages et de modèles pour activer la fonctionnalité hors ligne.

Oui — l’application de bureau prend en charge la génération d’images pendant le chat grâce à des modèles intégrés comme Flux, vous permettant de créer du contenu visuel en parallèle de vos conversations.

Utilisez la fonction lorebook pour construire et gérer les histoires des personnages, leurs traits de personnalité et les connaissances du monde. Cela garantit un contexte cohérent tout au long de vos conversations.

Vous pouvez régénérer la réponse, modifier vos entrées pour mieux guider l’IA, ou ajuster vos prompts de jeu de rôle pour orienter l’IA vers une meilleure qualité de réponse.

Large Language Models (LLMs)

Informations sur l’application

| Développeur | Plusieurs fournisseurs : OpenAI (série GPT), Meta (LLaMA), Anthropic (Claude) et autres |

| Plates-formes prises en charge |

|

| Support linguistique | Principalement l’anglais ; le support multilingue varie selon le modèle (espagnol, français, chinois et autres disponibles) |

| Modèle tarifaire | Freemium ou payant ; des niveaux gratuits sont disponibles pour certaines API, tandis que les modèles plus grands ou les usages intensifs nécessitent un abonnement ou un paiement à l’usage |

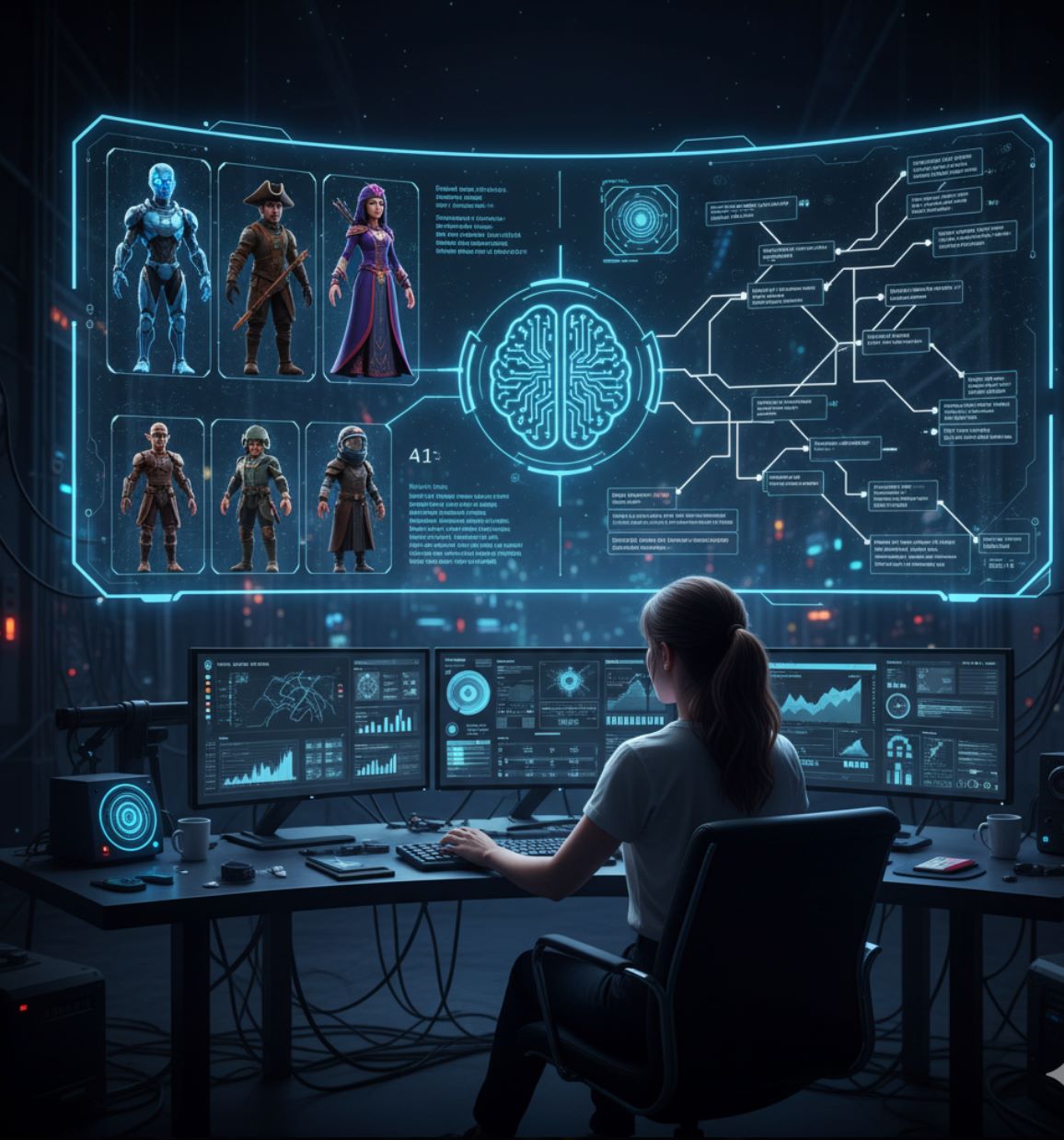

Vue d’ensemble

Les grands modèles de langage (LLM) sont des systèmes d’IA avancés qui génèrent un texte cohérent et sensible au contexte pour des expériences de jeu dynamiques. Dans le développement de jeux, les LLM alimentent des PNJ intelligents avec des dialogues en temps réel, une narration adaptative et un jeu de rôle interactif. Contrairement aux scripts statiques, les personnages propulsés par LLM répondent aux entrées du joueur, conservent la mémoire des conversations et créent des expériences narratives uniques qui évoluent avec les choix du joueur.

Fonctionnement des LLM dans les jeux

Les LLM analysent d’énormes quantités de données textuelles pour prédire et générer des sorties en langage naturel adaptées aux contextes de jeu. Les développeurs utilisent l’ingénierie des prompts et l’ajustement fin pour façonner les réponses des PNJ tout en maintenant la cohérence de l’histoire. Des techniques avancées comme la génération augmentée par récupération (RAG) permettent aux personnages de se souvenir des interactions précédentes et du lore, créant des PNJ crédibles et immersifs pour les jeux de rôle, d’aventure et narratifs.

Crée des conversations PNJ sensibles au contexte en temps réel, répondant naturellement aux entrées du joueur.

Génère des quêtes, événements et branches narratives qui s’adaptent à l’état du jeu et aux décisions du joueur.

Maintient la cohérence des personnages grâce à des histoires, objectifs et traits de personnalité définis.

Se souvient des interactions précédentes et des faits du monde du jeu pour un dialogue multi-tours cohérent et une connaissance persistante des personnages.

Télécharger ou accéder

Premiers pas

Choisissez un modèle (OpenAI GPT, Meta LLaMA, Anthropic Claude) qui correspond aux exigences et aux performances de votre jeu.

Utilisez les API cloud pour plus de commodité ou configurez des instances locales sur un matériel compatible pour un meilleur contrôle et respect de la vie privée.

Créez des histoires détaillées, des traits de personnalité et des bases de connaissances pour guider les réponses des LLM.

Élaborez des prompts qui orientent les réponses des LLM selon le contexte du jeu, les entrées du joueur et les objectifs narratifs.

Connectez les sorties des LLM aux systèmes de dialogue de votre jeu via des SDK, API ou solutions middleware personnalisées.

Évaluez la qualité des dialogues des PNJ, affinez les prompts et ajustez la gestion de la mémoire pour garantir cohérence et immersion.

Considérations importantes

- Hallucinations : Les LLM peuvent produire des dialogues incohérents ou factuellement incorrects si les prompts sont ambigus ; utilisez des instructions claires et spécifiques

- Matériel & latence : L’intégration en temps réel nécessite un matériel puissant ou une infrastructure cloud pour un gameplay réactif

- Risques éthiques & biais : Les sorties des LLM peuvent inclure des biais non intentionnels ; mettez en place une modération et une conception rigoureuse des prompts

- Coûts d’abonnement : Les modèles à fort volume ou ajustés finement nécessitent généralement un accès API payant

Questions fréquemment posées

Oui. Avec une conception appropriée des personas, une intégration de la mémoire et une ingénierie des prompts, les LLM peuvent maintenir la cohérence des personnages sur plusieurs interactions et conversations.

Oui, bien que les performances dépendent du matériel ou de la latence cloud. Les modèles locaux plus petits peuvent être préférés pour une réactivité en temps réel, tandis que les API cloud fonctionnent bien pour les jeux au tour par tour ou asynchrones.

De nombreux modèles supportent le dialogue multilingue, mais la qualité varie selon la langue et le modèle spécifique. Testez soigneusement pour vos langues cibles.

Mettez en place des filtres de modération, contraignez les prompts avec des directives claires et utilisez les couches de sécurité fournies par la plateforme du modèle. Des tests réguliers et les retours de la communauté aident à identifier et corriger les problèmes.

Certains niveaux gratuits existent pour un usage basique, mais les modèles à grand contexte ou les scénarios à fort volume nécessitent généralement un abonnement ou un paiement à l’usage. Évaluez les coûts en fonction de l’échelle de votre jeu et de sa base de joueurs.

Convai

Informations sur l’application

| Développeur | Convai Technologies Inc. |

| Plates-formes supportées |

|

| Support linguistique | Plus de 65 langues prises en charge mondialement via les intégrations web et moteurs. |

| Modèle tarifaire | Accès gratuit au Convai Playground ; les déploiements entreprise et à grande échelle nécessitent des plans payants ou un contact pour licence. |

Qu’est-ce que Convai ?

Convai est une plateforme d’IA conversationnelle qui permet aux développeurs de créer des personnages IA incarnés et très interactifs (PNJ) pour les jeux, mondes XR et expériences virtuelles. Ces agents intelligents perçoivent leur environnement, écoutent et parlent naturellement, et répondent en temps réel. Grâce à des intégrations fluides avec Unity, Unreal Engine et les environnements web, Convai donne vie à des humains virtuels réalistes, ajoutant une profondeur narrative immersive et des dialogues crédibles aux mondes interactifs.

Fonctionnalités clés

Les PNJ réagissent intelligemment à la voix, au texte et aux stimuli environnementaux pour des interactions dynamiques.

Chat vocal à faible latence avec les personnages IA pour un dialogue naturel et immersif.

Importez documents et lore pour façonner la connaissance du personnage et maintenir des conversations cohérentes et contextuelles.

Outils basés sur des graphes pour définir déclencheurs, objectifs et flux de dialogue tout en conservant des interactions flexibles et ouvertes.

SDK natif Unity et plugin Unreal Engine pour une intégration fluide des PNJ IA dans vos projets.

Permettez aux personnages IA de converser de manière autonome entre eux dans des scènes partagées pour un récit dynamique.

Télécharger ou accéder

Guide de démarrage

Créez votre compte Convai via leur site web pour accéder au Playground et commencer à créer des personnages IA.

Dans le Playground, définissez la personnalité, l’histoire, la base de connaissances et les paramètres vocaux de votre personnage pour lui donner vie.

Utilisez le graphe de conception narrative de Convai pour établir déclencheurs, points de décision et objectifs qui guident le comportement du personnage.

Unity : Téléchargez le SDK Convai Unity depuis l’Asset Store, importez-le et configurez votre clé API.

Unreal Engine : Installez le plugin Convai Unreal Engine (Beta) pour activer la voix, la perception et les conversations en temps réel.

Activez le système NPC2NPC de Convai pour permettre aux personnages IA de converser de manière autonome entre eux.

Testez vos scènes en profondeur, affinez les paramètres d’apprentissage automatique, les déclencheurs de dialogue et les comportements des personnages selon les retours.

Limitations & considérations importantes

- Les avatars créés avec les outils web de Convai peuvent nécessiter des modèles externes pour l’export vers les moteurs de jeu.

- La gestion du flux narratif entre plusieurs agents IA demande une conception et une planification rigoureuses.

- Les conversations vocales en temps réel peuvent subir des latences selon les performances du backend et les conditions réseau.

- Les déploiements complexes ou à grande échelle nécessitent généralement une licence entreprise ; l’accès gratuit est principalement via le Playground.

Questions fréquemment posées

Oui — Convai prend en charge les conversations PNJ à PNJ via sa fonctionnalité NPC2NPC dans Unity et Unreal Engine, permettant des interactions autonomes entre personnages.

La création basique de personnages se fait sans code via le Playground, mais l’intégration aux moteurs de jeu (Unity, Unreal) requiert des compétences en développement et des connaissances techniques.

Oui — vous pouvez définir une base de connaissances et un système de mémoire pour chaque personnage, garantissant un dialogue cohérent et contextuel tout au long des interactions.

Oui — les conversations vocales en temps réel sont entièrement supportées, incluant la reconnaissance vocale et la synthèse vocale pour des interactions naturelles.

Oui — Convai propose des options entreprises incluant le déploiement sur site et des certifications de conformité sécurité telles que ISO 27001 pour les projets commerciaux et à grande échelle.

Nvidia ACE

Informations sur l’application

| Développeur | NVIDIA Corporation |

| Plates-formes supportées |

|

| Support linguistique | Plusieurs langues pour texte et voix ; disponible mondialement pour les développeurs |

| Modèle tarifaire | Accès entreprise/développeur via le programme NVIDIA ; licence commerciale requise |

Qu’est-ce que NVIDIA ACE ?

NVIDIA ACE (Avatar Cloud Engine) est une plateforme d’IA générative qui permet aux développeurs de créer des PNJ intelligents et réalistes pour les jeux et mondes virtuels. Elle combine des modèles de langage avancés, la reconnaissance vocale, la synthèse vocale et l’animation faciale en temps réel pour offrir des dialogues naturels, interactifs et un comportement autonome des personnages. En intégrant ACE, les développeurs peuvent concevoir des PNJ qui répondent de manière contextuelle, conversent naturellement et affichent des comportements guidés par leur personnalité, améliorant significativement l’immersion dans les expériences de jeu.

Fonctionnement

NVIDIA ACE s’appuie sur un ensemble de composants d’IA spécialisés fonctionnant en synergie :

- NeMo — Compréhension avancée du langage et modélisation des dialogues

- Riva — Conversion en temps réel de la parole en texte et du texte en parole

- Audio2Face — Animation faciale en temps réel, synchronisation labiale et expressions émotionnelles

Les PNJ propulsés par ACE perçoivent les indices audio et visuels, planifient leurs actions de manière autonome et interagissent avec les joueurs via des dialogues et expressions réalistes. Les développeurs peuvent affiner les personnalités, mémoires et contextes conversationnels des PNJ pour créer des interactions cohérentes et immersives. La plateforme supporte l’intégration dans les moteurs de jeu populaires et le déploiement cloud, permettant des implémentations évolutives de personnages IA pour des scénarios de jeu complexes.

Fonctionnalités clés

Affinez les dialogues des PNJ avec leurs histoires, personnalités et contexte conversationnel.

Reconnaissance vocale et synthèse vocale propulsées par NVIDIA Riva pour des interactions vocales naturelles.

Expressions faciales et synchronisation labiale en temps réel grâce à Audio2Face dans NVIDIA Omniverse.

Les PNJ perçoivent les entrées audio et visuelles, agissent de manière autonome et prennent des décisions intelligentes.

Déploiement cloud ou sur appareil via un SDK flexible pour une intégration évolutive et efficace.

Démarrage

Guide d’installation et de configuration

Inscrivez-vous au programme NVIDIA Developer pour obtenir le SDK ACE, les identifiants API et la documentation.

Assurez-vous de disposer d’un GPU NVIDIA (série RTX recommandée) ou d’une instance cloud provisionnée pour l’inférence et le traitement IA en temps réel.

Installez et configurez les trois composants principaux :

- NeMo — Déployez pour la modélisation des dialogues et la compréhension du langage

- Riva — Configurez pour les services de reconnaissance et synthèse vocale

- Audio2Face — Activez pour l’animation faciale et les expressions en temps réel

Configurez les traits de personnalité, systèmes de mémoire, paramètres de comportement et garde-fous conversationnels pour chaque PNJ.

Connectez les composants ACE à Unity, Unreal Engine ou votre moteur de jeu personnalisé pour permettre les interactions des PNJ dans votre univers de jeu.

Évaluez la qualité des dialogues, la fluidité des animations et la latence des réponses. Affinez les paramètres IA et l’allocation matérielle pour une expérience de jeu optimale.

Considérations importantes

Questions fréquemment posées

Oui. NVIDIA Riva offre des capacités de reconnaissance vocale et de synthèse vocale en temps réel, permettant aux PNJ de tenir des conversations vocales naturelles avec les joueurs.

Oui. Audio2Face fournit une animation faciale en temps réel, la synchronisation labiale et des expressions émotionnelles, rendant les PNJ visuellement expressifs et émotionnellement engageants.

Oui. Avec des GPU RTX ou un déploiement cloud optimisé, ACE supporte des interactions à faible latence adaptées aux scénarios de jeux en temps réel.

Oui. L’intégration au moteur et la configuration multi-composants nécessitent des compétences solides en programmation et une expérience des frameworks de développement de jeux.

Non. L’accès est disponible via le programme développeur NVIDIA. Une licence entreprise ou un abonnement est requis pour un usage commercial.

Bonnes pratiques pour les développeurs

Définir les personnages en détail

Rédigez une histoire claire et un style pour chaque PNJ. Utilisez cela comme « consigne système » pour l’IA afin qu’elle sache comment parler. L’expérience d’Ubisoft a fait écrire aux scénaristes des notes détaillées avant d’impliquer l’IA.

Maintenir le contexte

Incluez le contexte pertinent du jeu dans chaque consigne. Transmettez le chat récent du joueur et les événements clés (quêtes accomplies, relations) pour que la réponse de l’IA reste cohérente. Beaucoup de systèmes stockent l’historique des conversations pour simuler la mémoire.

Utiliser des garde-fous

Ajoutez des filtres et contraintes. Définissez des listes de mots à éviter pour l’IA, ou programmez des déclencheurs pour des arbres de dialogue spéciaux. Ubisoft a utilisé des garde-fous pour que le PNJ ne s’écarte jamais de sa personnalité.

Tester de manière itérative

Testez les conversations et affinez les consignes. Si une réponse du PNJ semble hors personnage, ajustez l’entrée ou ajoutez des exemples de dialogues. Si la réponse ne correspond pas vraiment au personnage, revenez en arrière et analysez ce qui s’est passé dans le modèle.

Gérer coûts et performances

Équilibrez l’usage de l’IA de manière stratégique. Vous n’avez pas besoin d’IA pour chaque réplique jetable. Envisagez de pré-générer des réponses courantes ou de combiner l’IA avec des arbres de dialogue traditionnels. Le moteur Sentis de Unity peut exécuter des modèles optimisés localement pour réduire les appels serveur.

Combiner IA et écriture manuelle

Rappelez-vous que les scénaristes humains doivent sélectionner les productions de l’IA. Utilisez l’IA comme source d’inspiration, pas comme voix finale. L’arc narratif doit venir des humains. Beaucoup d’équipes utilisent l’IA pour rédiger ou étoffer les dialogues, puis relisent et peaufinent les résultats.

L’avenir du dialogue dans les jeux

L’IA inaugure une nouvelle ère pour le dialogue dans les jeux vidéo. Des mods indépendants aux laboratoires R&D AAA, les développeurs appliquent des modèles génératifs pour faire parler, réagir et se souvenir les PNJ comme jamais auparavant. Des initiatives officielles comme Project Explora de Microsoft et NEO NPC d’Ubisoft montrent que l’industrie adopte cette technologie — toujours avec un regard éthique et une supervision des scénaristes.

Les outils actuels (GPT-4, Inworld AI, Convai, assets Unity et autres) donnent aux créateurs le pouvoir de prototyper rapidement des dialogues riches. À l’avenir, nous pourrions voir des récits entièrement procéduraux et des histoires personnalisées générées à la volée. Pour l’instant, le dialogue IA signifie plus de flexibilité créative et d’immersion, tant que nous l’utilisons responsablement, en complément de l’art humain.

No comments yet. Be the first to comment!