एआई और एल्गोरिदमिक पक्षपात

एआई एल्गोरिदम विभिन्न क्षेत्रों में तेजी से उपयोग किए जा रहे हैं, जैसे भर्ती से लेकर वित्त तक, लेकिन इनमें पक्षपात और भेदभाव के जोखिम होते हैं। स्वचालित एआई निर्णय प्रशिक्षण डेटा में पक्षपात या विविधता की कमी होने पर सामाजिक अन्याय को प्रतिबिंबित या बढ़ा सकते हैं। एल्गोरिदमिक पक्षपात को समझना व्यवसायों, डेवलपर्स और उपयोगकर्ताओं को निष्पक्ष, अधिक पारदर्शी एआई सिस्टम बनाने, प्रबंधित करने और पहचानने में मदद करता है।

क्या आप एआई में एल्गोरिदमिक पक्षपात के बारे में जानना चाहते हैं? इस लेख में INVIAI के साथ एआई और एल्गोरिदमिक पक्षपात के बारे में अधिक जानें!

कृत्रिम बुद्धिमत्ता (एआई) हमारे दैनिक जीवन में तेजी से समाहित हो रही है – भर्ती निर्णय से लेकर स्वास्थ्य सेवा और पुलिसिंग तक – लेकिन इसके उपयोग ने एल्गोरिदमिक पक्षपात को लेकर चिंताएं बढ़ा दी हैं। एल्गोरिदमिक पक्षपात का मतलब है एआई सिस्टम के आउटपुट में व्यवस्थित और अनुचित पूर्वाग्रह, जो अक्सर सामाजिक रूढ़ियों और असमानताओं को दर्शाते हैं।

मूल रूप से, एक एआई एल्गोरिदम अनजाने में अपने प्रशिक्षण डेटा या डिजाइन में मौजूद मानव पूर्वाग्रहों को दोहरा सकता है, जिससे भेदभावपूर्ण परिणाम निकल सकते हैं।

नीचे, हम एल्गोरिदमिक पक्षपात के कारणों, इसके प्रभाव के वास्तविक उदाहरणों, और एआई को अधिक निष्पक्ष बनाने के प्रयासों की चर्चा करेंगे।

एल्गोरिदमिक पक्षपात और इसके कारणों को समझना

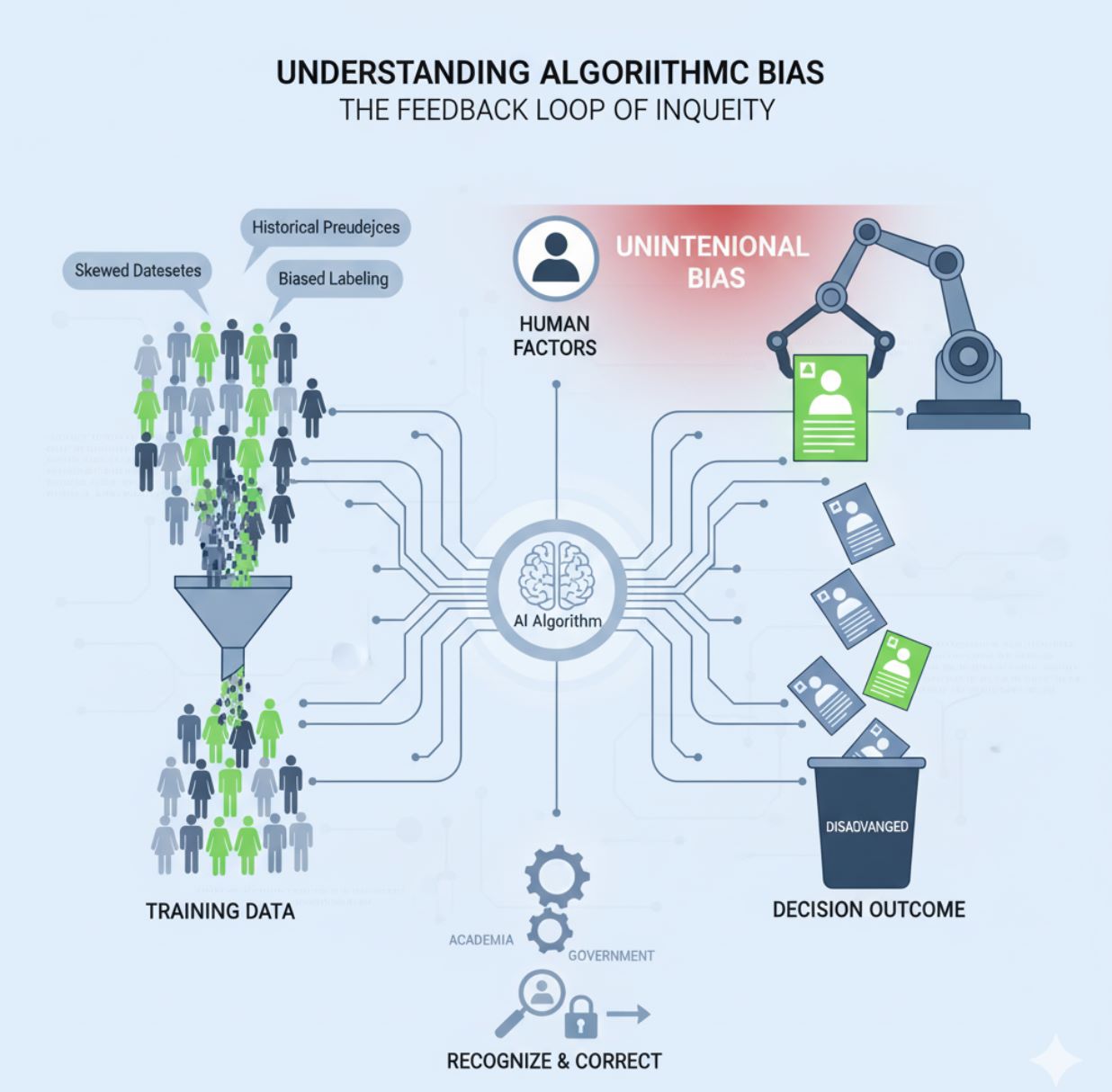

एल्गोरिदमिक पक्षपात आमतौर पर इसलिए नहीं होता कि एआई "भेदभाव करना चाहता है", बल्कि मानव कारकों के कारण होता है। एआई सिस्टम डेटा से सीखते हैं और लोगों द्वारा बनाए गए नियमों का पालन करते हैं – और लोगों में पूर्वाग्रह होते हैं (अक्सर अवचेतन)। यदि प्रशिक्षण डेटा पक्षपाती है या ऐतिहासिक पूर्वाग्रहों को दर्शाता है, तो एआई संभवतः उन पैटर्न को सीख लेगा।

पक्षपाती प्रशिक्षण डेटा

डेटासेट में निहित ऐतिहासिक पूर्वाग्रह

- अपूर्ण डेटासेट

- प्रतिनिधित्वहीन नमूने

- ऐतिहासिक भेदभाव के पैटर्न

पक्षपाती डेटा लेबलिंग

डेटा एनोटेशन में मानव पूर्वाग्रह

- विषयगत वर्गीकरण

- सांस्कृतिक धारणाएं

- अवचेतन रूढ़िवादिता

सुधार संबंधी समस्याएं

निष्पक्षता की तुलना में सटीकता के लिए एल्गोरिदम का अनुकूलन

- कुल मिलाकर सटीकता पर ध्यान

- अल्पसंख्यक समूहों की उपेक्षा

- निष्पक्षता के समझौते की अनदेखी

एआई एल्गोरिदम अपने निर्माताओं और डेटा के पूर्वाग्रहों को विरासत में लेते हैं जब तक कि जानबूझकर उन पूर्वाग्रहों को पहचानने और सुधारने के कदम न उठाए जाएं।

— प्रमुख शोध निष्कर्ष

यह ध्यान रखना महत्वपूर्ण है कि एल्गोरिदमिक पक्षपात आमतौर पर अनजाने में होता है। संगठन अक्सर निर्णयों को अधिक वस्तुनिष्ठ बनाने के लिए एआई अपनाते हैं, लेकिन यदि वे सिस्टम को पक्षपाती जानकारी देते हैं या डिजाइन में समानता पर विचार नहीं करते हैं, तो परिणाम फिर भी अनुचित हो सकता है। एआई पक्षपात अवसरों का अनुचित आवंटन कर सकता है और गलत परिणाम दे सकता है, जिससे लोगों की भलाई पर नकारात्मक प्रभाव पड़ता है और एआई में विश्वास कम होता है।

पक्षपात क्यों होता है यह समझना समाधान की दिशा में पहला कदम है – और यह कदम अब विश्वभर के अकादमिक, उद्योग और सरकारें गंभीरता से उठा रही हैं।

एआई पक्षपात के वास्तविक दुनिया के उदाहरण

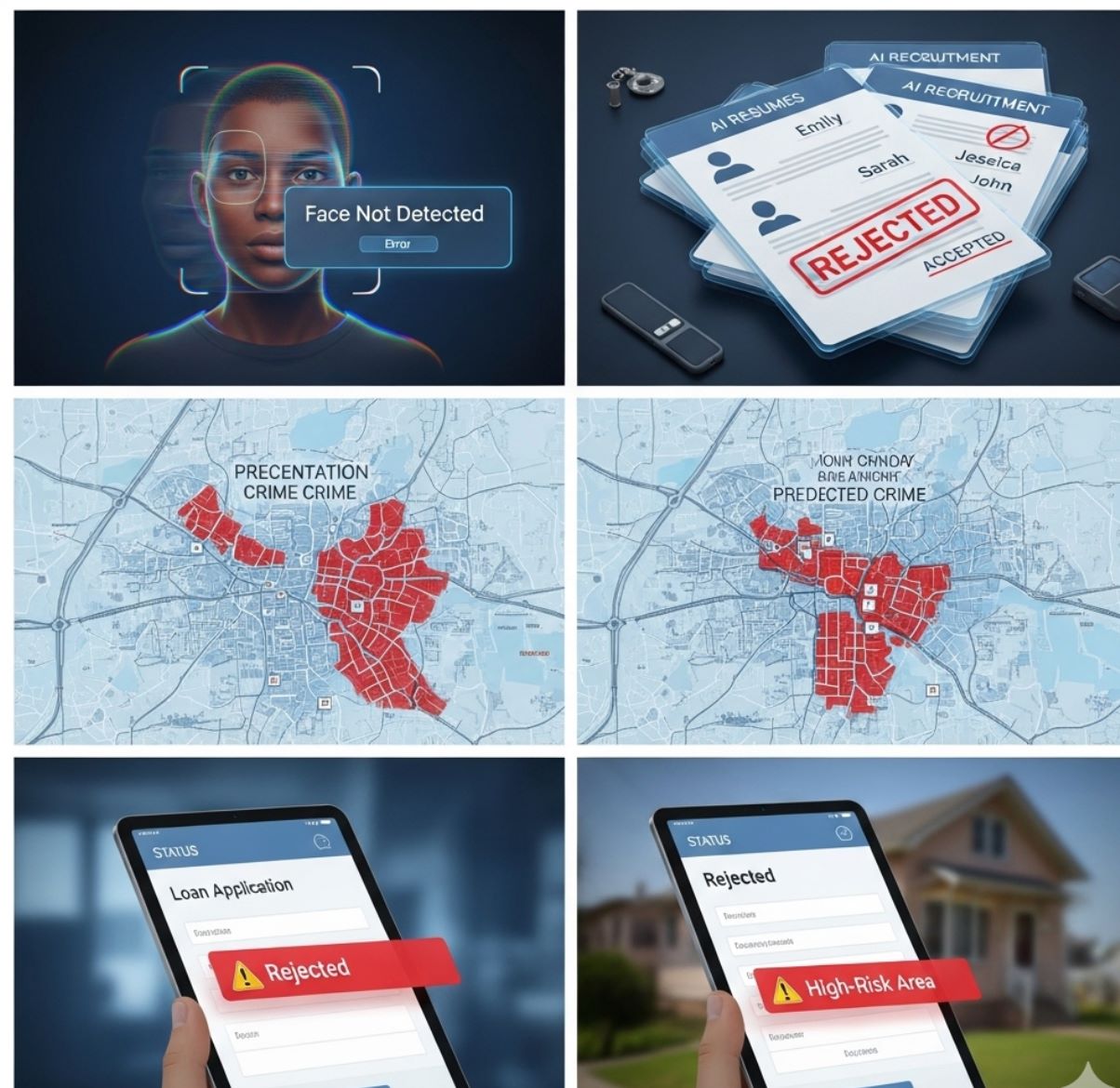

एआई में पक्षपात केवल एक काल्पनिक चिंता नहीं है; कई वास्तविक दुनिया के मामले ने दिखाया है कि एल्गोरिदमिक पक्षपात भेदभाव को कैसे जन्म दे सकता है। विभिन्न क्षेत्रों में एआई पक्षपात के उल्लेखनीय उदाहरण हैं:

आपराधिक न्याय प्रणाली

मामला: यू.एस. पुनरावृत्ति भविष्यवाणी एल्गोरिदम

प्रभाव: काले अभियुक्तों के खिलाफ पक्षपाती, अक्सर काले अभियुक्तों को उच्च जोखिम और सफेद अभियुक्तों को कम जोखिम वाला माना गया, जिससे नस्लीय असमानताएं बढ़ीं।

परिणाम: पुलिसिंग और न्यायालयों में ऐतिहासिक पूर्वाग्रहों को बढ़ावा मिला

भर्ती और चयन

मामला: अमेज़न का एआई भर्ती उपकरण

प्रभाव: महिलाओं के खिलाफ भेदभाव के कारण बंद कर दिया गया. यह पिछले अधिकांश पुरुषों के रिज्यूमे पर प्रशिक्षित था, और "महिलाओं" या सभी महिला कॉलेजों वाले रिज्यूमे को कमतर आंका.

परिणाम: तकनीकी नौकरियों के लिए योग्य महिलाओं को अनुचित रूप से बाहर किया जाता

चेहरे की पहचान तकनीक में पक्षपात

चेहरे की पहचान तकनीक ने जनसांख्यिकीय वर्गों में सटीकता में महत्वपूर्ण पक्षपात दिखाया है. यू.एस. नेशनल इंस्टिट्यूट ऑफ स्टैंडर्ड्स एंड टेक्नोलॉजी (NIST) के 2019 के एक व्यापक अध्ययन ने चिंताजनक असमानताएं उजागर कीं:

- एशियाई और अफ्रीकी-अमेरिकी चेहरों के लिए झूठे सकारात्मक पहचान की संभावना कॉकसियन चेहरों की तुलना में 10 से 100 गुना अधिक थी

- सबसे अधिक गलत पहचान की दर काले महिलाओं के लिए एक-से-कई खोजों में थी

- खतरनाक पक्षपात के कारण निर्दोष लोगों की गलत गिरफ्तारी हो चुकी है

जनरेटिव एआई और सामग्री में पक्षपात

यहां तक कि नवीनतम एआई सिस्टम भी इससे अछूते नहीं हैं। 2024 के यूनेस्को अध्ययन ने दिखाया कि बड़े भाषा मॉडल अक्सर पीछे हटने वाले लिंग और नस्लीय रूढ़ियों को उत्पन्न करते हैं:

घरेलू केंद्रित

- घरेलू भूमिकाओं में 4 गुना अधिक वर्णित

- "घर" और "बच्चों" से जुड़ा

- पारंपरिक लिंग रूढ़ियां

पेशेवर केंद्रित

- "कार्यकारी" और "वेतन" से जुड़ा

- "करियर" उन्नति से संबंधित

- नेतृत्व शब्दावली

एआई के जोखिम मौजूदा असमानताओं पर बढ़ रहे हैं, जिससे पहले से हाशिए पर रहने वाले समूहों को और नुकसान हो रहा है।

— यूनेस्को चेतावनी

ये उदाहरण दर्शाते हैं कि एल्गोरिदमिक पक्षपात कोई दूर का या दुर्लभ समस्या नहीं है – यह आज विभिन्न क्षेत्रों में हो रहा है। नौकरी के अवसरों से लेकर न्याय, स्वास्थ्य सेवा से ऑनलाइन जानकारी तक, पक्षपाती एआई सिस्टम मौजूदा भेदभाव को दोहरा सकते हैं और बढ़ा भी सकते हैं।

नुकसान अक्सर ऐतिहासिक रूप से वंचित समूहों को होता है, जो गंभीर नैतिक और मानवाधिकार चिंताएं उठाता है। चूंकि अब लाखों लोग दैनिक जीवन में जनरेटिव एआई का उपयोग करते हैं, सामग्री में सूक्ष्म पक्षपात भी वास्तविक दुनिया में असमानताओं को बढ़ा सकता है, बड़े पैमाने पर रूढ़ियों को मजबूत करता है।

एआई पक्षपात क्यों महत्वपूर्ण है?

एआई पक्षपात को संबोधित करने के दांव बहुत बड़े हैं। यदि अनियंत्रित छोड़ दिया जाए, तो पक्षपाती एल्गोरिदम प्रणालीगत भेदभाव को तकनीकी तटस्थता के आवरण के पीछे मजबूत कर सकते हैं. एआई द्वारा किए गए (या निर्देशित) निर्णय – कौन भर्ती होता है, कौन ऋण या पैरोल पाता है, पुलिस निगरानी कैसे करती है – लोगों के जीवन पर वास्तविक प्रभाव डालते हैं।

मानवाधिकार प्रभाव

समानता और गैर-भेदभाव के सिद्धांतों को कमजोर करता है

- अवसरों से वंचित

- आर्थिक असमानताएं

- व्यक्तिगत स्वतंत्रता के खतरे

विश्वास में कमी

प्रौद्योगिकी में सार्वजनिक विश्वास को नुकसान पहुंचाता है

- एआई अपनाने में कमी

- प्रतिष्ठा को नुकसान

- नवाचार में बाधाएं

लाभों में कमी

एआई की सकारात्मक क्षमता को सीमित करता है

- गलत परिणाम

- प्रभावशीलता में कमी

- लाभों तक असमान पहुंच

यदि ये निर्णय कुछ लिंगों, जातियों या समुदायों के खिलाफ अनुचित रूप से झुके हुए हैं, तो सामाजिक असमानताएं बढ़ती हैं। इससे अवसरों से वंचित होना, आर्थिक असमानताएं, या प्रभावित समूहों के लिए व्यक्तिगत स्वतंत्रता और सुरक्षा के खतरे हो सकते हैं।

बड़े परिप्रेक्ष्य में, एल्गोरिदमिक पक्षपात मानवाधिकारों और सामाजिक न्याय को कमजोर करता है, जो लोकतांत्रिक समाजों द्वारा समर्थित समानता और गैर-भेदभाव के सिद्धांतों के विपरीत है।

इसके अलावा, एल्गोरिदमिक पक्षपात एआई के संभावित लाभों को कम कर सकता है. एआई दक्षता और निर्णय लेने में सुधार का वादा करता है, लेकिन यदि इसके परिणाम आबादी के कुछ हिस्सों के लिए भेदभावपूर्ण या गलत हैं, तो यह अपनी पूरी सकारात्मक क्षमता तक नहीं पहुंच सकता।

उदाहरण के लिए, एक एआई स्वास्थ्य उपकरण जो एक जनसांख्यिकीय के लिए अच्छा काम करता है लेकिन दूसरों के लिए खराब, वास्तव में प्रभावी या स्वीकार्य नहीं है। जैसा कि OECD ने देखा, एआई में पक्षपात अवसरों को अनुचित रूप से सीमित करता है और व्यवसायों की प्रतिष्ठा और उपयोगकर्ताओं के विश्वास को नुकसान पहुंचा सकता है.

संक्षेप में, पक्षपात को संबोधित करना केवल नैतिक आवश्यकता नहीं बल्कि सभी व्यक्तियों के लिए निष्पक्ष तरीके से एआई के लाभों का उपयोग करने के लिए भी महत्वपूर्ण है।

एआई पक्षपात को कम करने की रणनीतियाँ

चूंकि एल्गोरिदमिक पक्षपात अब व्यापक रूप से पहचाना गया है, इसे कम करने के लिए कई रणनीतियाँ और सर्वोत्तम प्रथाएं उभरी हैं। यह सुनिश्चित करने के लिए कि एआई सिस्टम निष्पक्ष और समावेशी हों, विकास और तैनाती के कई चरणों में कार्रवाई आवश्यक है:

बेहतर डेटा प्रथाएं

चूंकि पक्षपाती डेटा एक मूल कारण है, डेटा गुणवत्ता में सुधार करना महत्वपूर्ण है। इसका मतलब है विविध, प्रतिनिधि प्रशिक्षण डेटासेट का उपयोग करना जिसमें अल्पसंख्यक समूह शामिल हों, और पक्षपात या अंतराल के लिए कड़ाई से जांच करना।

- विविध, प्रतिनिधि प्रशिक्षण डेटासेट का उपयोग करें जिसमें अल्पसंख्यक समूह शामिल हों

- ऐतिहासिक पूर्वाग्रहों के लिए डेटा का कड़ाई से ऑडिट करें (जाति/लिंग के अनुसार विभिन्न परिणाम)

- मॉडल प्रशिक्षण से पहले पक्षपाती डेटा को सुधारें या संतुलित करें

- अल्पप्रतिनिधि समूहों के लिए डेटा संवर्धन या सिंथेटिक डेटा लागू करें

- पक्षपात मुद्दों को जल्दी पहचानने के लिए एआई आउटपुट की निरंतर निगरानी करें

निष्पक्ष एल्गोरिदम डिजाइन

डेवलपर्स को मॉडल प्रशिक्षण में निष्पक्षता प्रतिबंध और पक्षपात कम करने की तकनीकों को जानबूझकर शामिल करना चाहिए। इसमें ऐसे एल्गोरिदम का उपयोग शामिल हो सकता है जिन्हें निष्पक्षता के लिए ट्यून किया जा सकता है (सिर्फ सटीकता के लिए नहीं)।

निष्पक्षता तकनीकों को लागू करें

निष्पक्षता के लिए ट्यून किए गए एल्गोरिदम का उपयोग करें, समूहों के बीच त्रुटि दरों को समान करने के लिए तकनीकों को लागू करें, डेटा का पुनःभार करें, या निर्णय सीमा को सोच-समझकर बदलें।

पक्षपात परीक्षण उपकरणों का उपयोग करें

मॉडल के पक्षपात के लिए परीक्षण और विकास के दौरान समायोजन के लिए ओपन-सोर्स टूल और फ्रेमवर्क का लाभ उठाएं।

निष्पक्षता मानदंड परिभाषित करें

निष्पक्षता मानदंड परिभाषित करते समय डोमेन विशेषज्ञों और प्रभावित समुदायों के साथ काम करें, क्योंकि निष्पक्षता की कई गणितीय परिभाषाएं होती हैं और कभी-कभी वे टकराती हैं।

मानव निगरानी और जवाबदेही

कोई भी एआई सिस्टम बिना मानव जवाबदेही के अकेले काम नहीं करना चाहिए। मानव निगरानी महत्वपूर्ण है ताकि मशीन द्वारा सीखे गए पक्षपात को पकड़ा और सुधारा जा सके।

मानव-इन-द-लूप

- भर्ती करने वाले एआई-स्क्रीन किए गए उम्मीदवारों की समीक्षा करते हैं

- न्यायाधीश एआई जोखिम स्कोर को सावधानी से देखते हैं

- चिकित्सा पेशेवर एआई निदान की पुष्टि करते हैं

जवाबदेही उपाय

- एआई निर्णयों का नियमित ऑडिट

- पक्षपात प्रभाव आकलन

- व्याख्यायोग्य एआई तर्क

- स्पष्ट जिम्मेदारी निर्धारण

संगठनों को याद रखना चाहिए कि वे अपने एल्गोरिदम द्वारा लिए गए निर्णयों के लिए जिम्मेदार हैं, जैसे वे कर्मचारियों द्वारा लिए गए निर्णयों के लिए होते हैं। पारदर्शिता भी एक स्तंभ है: यह बताना कि एआई सिस्टम कैसे काम करता है और इसकी ज्ञात सीमाएं क्या हैं, विश्वास बनाने और स्वतंत्र जांच की अनुमति देने में मदद करता है।

कुछ न्यायक्षेत्र उच्च-जोखिम एल्गोरिदमिक निर्णयों के लिए पारदर्शिता अनिवार्य करने की ओर बढ़ रहे हैं (सार्वजनिक एजेंसियों को यह बताने की आवश्यकता कि नागरिकों को प्रभावित करने वाले निर्णयों में एल्गोरिदम कैसे उपयोग किए जाते हैं)। लक्ष्य यह सुनिश्चित करना है कि एआई मानव निर्णय लेने को बढ़ाए बिना नैतिक निर्णय या कानूनी जिम्मेदारी को प्रतिस्थापित किए।

विविध टीम और विनियमन

समावेशी विकास

विशेषज्ञों की बढ़ती आवाज़ एआई डेवलपर्स और हितधारकों में विविधता के महत्व पर जोर देती है। एआई उत्पाद उन लोगों के दृष्टिकोण और अंधेरे स्थानों को प्रतिबिंबित करते हैं जो उन्हें बनाते हैं।

विनियमन और नैतिक दिशानिर्देश

सरकारें और अंतरराष्ट्रीय निकाय अब सक्रिय रूप से कदम उठा रहे हैं ताकि एआई पक्षपात को संबोधित किया जा सके:

- यूनेस्को का एआई नैतिकता पर सिफारिश (2021): पहला वैश्विक ढांचा सर्वसम्मति से अपनाया गया, पारदर्शिता, निष्पक्षता और गैर-भेदभाव के सिद्धांतों को स्थापित करता है

- ईयू एआई अधिनियम (2024): पक्षपात रोकथाम को प्राथमिकता बनाता है, उच्च-जोखिम एआई सिस्टम में निष्पक्षता के लिए कड़े मूल्यांकन आवश्यक करता है

- स्थानीय सरकारी कार्रवाई: सैन फ्रांसिस्को, बॉस्टन, मिनियापोलिस जैसे दर्जनों प्रमुख शहरों ने नस्लीय पक्षपात के कारण पुलिस द्वारा चेहरे की पहचान के उपयोग पर प्रतिबंध लगाया है

आगे का रास्ता: नैतिक एआई का निर्माण

एआई और एल्गोरिदमिक पक्षपात एक वैश्विक चुनौती है जिसे हम अभी प्रभावी ढंग से हल करना शुरू कर रहे हैं. ऊपर दिए गए उदाहरण और प्रयास स्पष्ट करते हैं कि एआई पक्षपात कोई सीमित समस्या नहीं है – यह आर्थिक अवसरों, न्याय, स्वास्थ्य और सामाजिक एकता को विश्व स्तर पर प्रभावित करता है।

इसे प्राप्त करने के लिए सतत सतर्कता की आवश्यकता होगी: एआई सिस्टम का लगातार पक्षपात के लिए परीक्षण करना, डेटा और एल्गोरिदम में सुधार करना, विविध हितधारकों को शामिल करना, और तकनीक के विकास के साथ नियमों को अपडेट करना।

मूल रूप से, एल्गोरिदमिक पक्षपात से लड़ना एआई को हमारे समानता और निष्पक्षता के मूल्यों के साथ संरेखित करने के बारे में है। जैसा कि यूनेस्को की निदेशक-जनरल ऑड्रे अजुले ने कहा, यहां तक कि "एआई सामग्री में छोटे पक्षपात भी वास्तविक दुनिया में असमानताओं को काफी बढ़ा सकते हैं".

एआई सामग्री में छोटे पक्षपात वास्तविक दुनिया में असमानताओं को काफी बढ़ा सकते हैं।

— ऑड्रे अजुले, यूनेस्को निदेशक-जनरल

इसलिए, बिना पक्षपात वाले एआई का लक्ष्य यह सुनिश्चित करना है कि तकनीक समाज के सभी वर्गों को ऊपर उठाए, न कि पुराने पूर्वाग्रहों को मजबूत करे.

एआई डिजाइन में नैतिक सिद्धांतों को प्राथमिकता देकर – और उन्हें ठोस कार्रवाई और नीतियों के साथ समर्थन देकर – हम एआई की नवाचार शक्ति का उपयोग कर सकते हैं और मानव गरिमा की रक्षा कर सकते हैं।

No comments yet. Be the first to comment!