AI och algoritmisk partiskhet

AI-algoritmer används i allt större utsträckning inom olika sektorer, från rekrytering till finans, men de medför risker för partiskhet och diskriminering. Automatiserade AI-beslut kan spegla eller förstärka sociala orättvisor om träningsdata är partisk eller icke-diversifierad. Att förstå algoritmisk partiskhet hjälper företag, utvecklare och användare att identifiera, hantera och bygga rättvisare och mer transparenta AI-system.

Undrar du över algoritmisk partiskhet i AI? Gå med i INVIAI för att lära dig mer om AI och algoritmisk partiskhet i denna artikel!

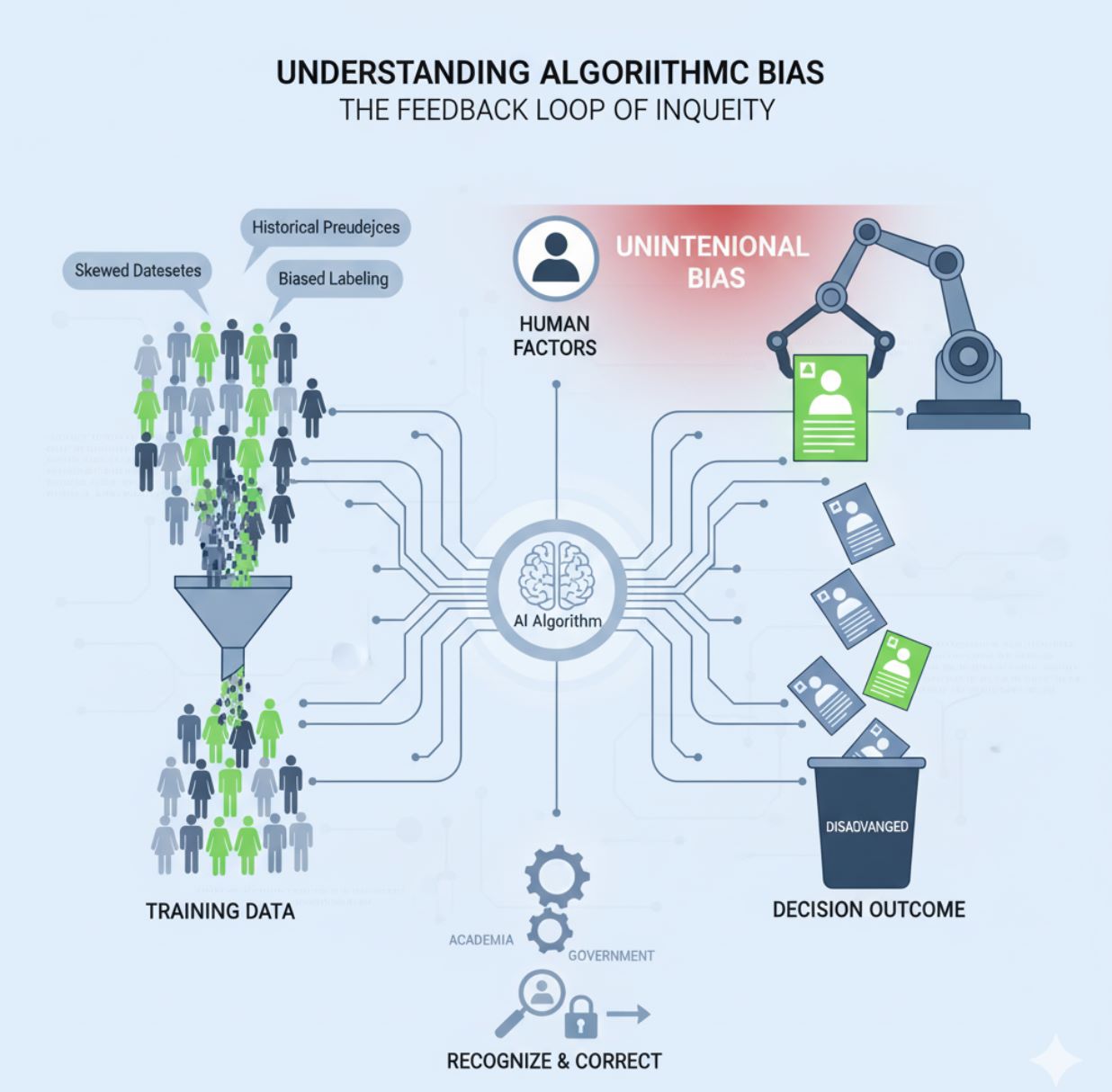

Artificiell intelligens (AI) är alltmer integrerad i våra dagliga liv – från anställningsbeslut till sjukvård och polisarbete – men dess användning har väckt oro kring algoritmisk partiskhet. Algoritmisk partiskhet avser systematiska och orättvisa fördomar i AI-systemens resultat, som ofta speglar samhälleliga stereotyper och ojämlikheter.

I grund och botten kan en AI-algoritm oavsiktligt reproducera mänskliga fördomar som finns i dess träningsdata eller design, vilket leder till diskriminerande utfall.

Nedan utforskar vi vad som orsakar algoritmisk partiskhet, verkliga exempel på dess påverkan och hur världen strävar efter att göra AI rättvisare.

Förstå algoritmisk partiskhet och dess orsaker

Algoritmisk partiskhet uppstår vanligtvis inte för att AI "vill" diskriminera, utan på grund av mänskliga faktorer. AI-system lär sig från data och följer regler skapade av människor – och människor har fördomar (ofta omedvetna). Om träningsdata är snedvriden eller speglar historiska fördomar, kommer AI sannolikt att lära sig dessa mönster.

Partisk träningsdata

Historiska fördomar inbäddade i datamängder

- Ofullständiga datamängder

- Orepresentativa urval

- Historiska diskrimineringsmönster

Partisk datamärkning

Mänskliga fördomar vid dataannotering

- Subjektiv kategorisering

- Kulturella antaganden

- Omedveten stereotypering

Optimeringsproblem

Algoritmer optimerade för noggrannhet framför rättvisa

- Fokus på total noggrannhet

- Försummelse av minoritetsgrupper

- Ignorerade rättviseavvägningar

AI-algoritmer ärver sina skaparnas och datas fördomar om inte medvetna steg tas för att känna igen och korrigera dessa fördomar.

— Viktigt forskningsresultat

Det är viktigt att notera att algoritmisk partiskhet vanligtvis är oavsiktlig. Organisationer använder ofta AI för att göra beslut mer objektiva, men om de "matat" systemet med partisk information eller inte beaktar rättvisa i designen kan resultatet ändå bli orättvist. AI-partiskhet kan orättvist fördela möjligheter och ge felaktiga resultat, vilket påverkar människors välbefinnande negativt och urholkar förtroendet för AI.

Att förstå varför partiskhet uppstår är första steget mot lösningar – och det är ett steg som akademi, industri och regeringar världen över nu tar på allvar.

Verkliga exempel på AI-partiskhet

Partiskhet i AI är inte bara en hypotetisk oro; många verkliga fall har visat hur algoritmisk partiskhet kan leda till diskriminering. Framstående exempel på AI-partiskhet inom olika sektorer inkluderar:

Rättssystemet

Fall: Amerikansk algoritm för återfallsriskbedömning

Påverkan: Partisk mot svarta åtalade, bedömde ofta svarta åtalade som hög risk och vita som låg risk, vilket förstärkte rasrelaterade skillnader i domar.

Konsekvens: Förstärkt historisk partiskhet inom polis och domstolar

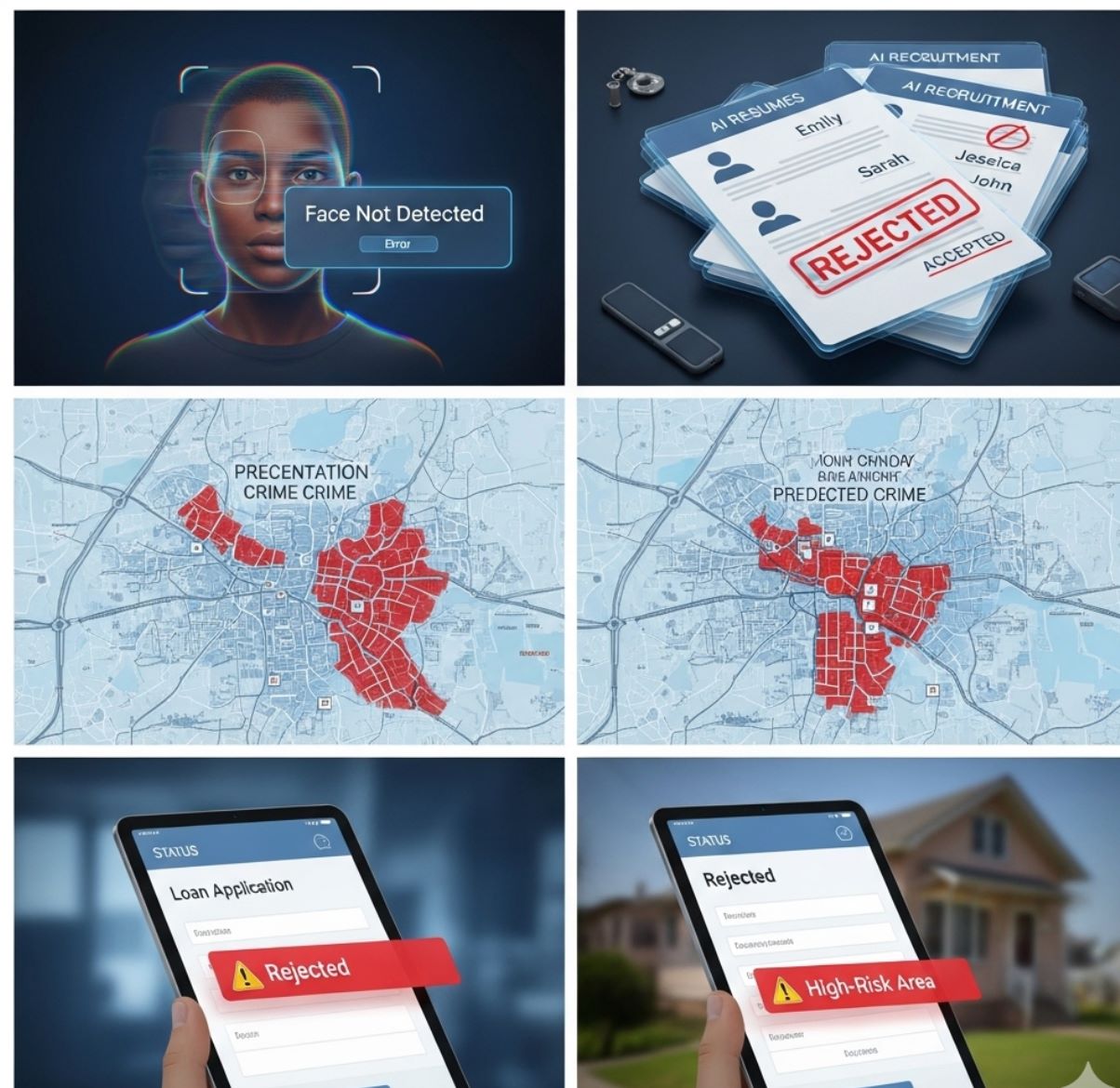

Anställning och rekrytering

Fall: Amazons AI-rekryteringsverktyg

Påverkan: Skrotades efter diskriminering mot kvinnor. Tränat på tidigare CV:n mest från män, nedgraderade CV:n som innehöll "kvinnors" eller helt kvinnliga högskolor.

Konsekvens: Skulle orättvist ha filtrerat bort kvalificerade kvinnor för tekniska jobb

Partiskhet i ansiktsigenkänningsteknologi

Ansiktsigenkänningsteknologi har visat betydande partiskhet i noggrannhet över demografiska grupper. En omfattande studie 2019 av det amerikanska National Institute of Standards and Technology (NIST) avslöjade alarmerande skillnader:

- Falska positiva identifieringar för asiatiska och afroamerikanska ansikten var 10 till 100 gånger mer sannolika än för kaukasiska ansikten

- Högsta felidentifieringsfrekvenserna var för svarta kvinnor i en-till-många-sökningar

- Farlig partiskhet har redan lett till att oskyldiga personer felaktigt gripits

Generativ AI och innehållspartiskhet

Även de senaste AI-systemen är inte immuna. En UNESCO-studie från 2024 visade att stora språkmodeller ofta producerar regressiva köns- och rasstereotyper:

Heminriktning

- Beskrivs i hemrelaterade roller 4 gånger oftare

- Kopplas till "hem" och "barn"

- Traditionella könsstereotyper

Yrkesinriktning

- Kopplas till "chef" och "lön"

- Kopplas till "karriär" och avancemang

- Ledarskapstermer

AI:s risker förstärker befintliga ojämlikheter och orsakar ytterligare skada för redan marginaliserade grupper.

— UNESCO-varning

Dessa exempel understryker att algoritmisk partiskhet inte är ett avlägset eller sällsynt problem – det händer inom många områden idag. Från jobbmöjligheter till rättvisa, sjukvård till onlineinformation kan partiska AI-system reproducera och till och med förstärka befintlig diskriminering.

Skadan drabbar ofta historiskt missgynnade grupper, vilket väcker allvarliga etiska och mänskliga rättighetsfrågor. Eftersom miljontals nu använder generativ AI i vardagen kan även subtila partiskheter i innehåll förstärka ojämlikheter i verkliga världen och befästa stereotyper i stor skala.

Varför är AI-partiskhet viktigt?

Insatserna för att hantera AI-partiskhet är höga. Om partiska algoritmer lämnas utan kontroll kan de befästa systematisk diskriminering bakom en fasad av teknisk neutralitet. Beslut som fattas (eller styrs) av AI – vem som anställs, vem som får lån eller villkorlig frigivning, hur polisen riktar övervakning – har verkliga konsekvenser för människors liv.

Påverkan på mänskliga rättigheter

Underminering av principer om jämlikhet och icke-diskriminering

- Förnekade möjligheter

- Ekonomiska skillnader

- Hot mot personlig frihet

Förtroendeförlust

Skadar allmänhetens förtroende för teknik

- Minskad AI-användning

- Skadat rykte

- Hinder för innovation

Minskade fördelar

Begränsar AI:s positiva potential

- Felaktiga resultat

- Minskad effektivitet

- Ojämlik tillgång till fördelar

Om dessa beslut orättvist gynnar eller missgynnar vissa kön, raser eller samhällen ökar sociala ojämlikheter. Detta kan leda till förnekade möjligheter, ekonomiska skillnader eller till och med hot mot personlig frihet och säkerhet för drabbade grupper.

På ett större plan underminerar algoritmisk partiskhet mänskliga rättigheter och social rättvisa, vilket strider mot principer om jämlikhet och icke-diskriminering som demokratiska samhällen värnar om.

Dessutom kan algoritmisk partiskhet minska AI:s potentiella fördelar. AI har löftet att förbättra effektivitet och beslutsfattande, men om dess resultat är diskriminerande eller felaktiga för delar av befolkningen kan det inte nå sin fulla positiva effekt.

Till exempel är ett AI-verktyg för hälsa som fungerar bra för en demografisk grupp men dåligt för andra inte verkligt effektivt eller acceptabelt. Som OECD observerade begränsar partiskhet i AI orättvist möjligheter och kan kosta företag deras rykte och användarnas förtroende.

Sammanfattningsvis är det inte bara en moralisk skyldighet att hantera partiskhet utan också avgörande för att utnyttja AI:s fördelar för alla på ett rättvist sätt.

Strategier för att minska AI-partiskhet

Eftersom algoritmisk partiskhet nu är allmänt erkänd har en rad strategier och bästa praxis utvecklats för att minska den. Att säkerställa att AI-system är rättvisa och inkluderande kräver åtgärder i flera utvecklings- och implementeringsfaser:

Bättre datapraxis

Eftersom partisk data är en grundorsak är förbättrad datakvalitet avgörande. Det innebär att använda diversifierade, representativa träningsdatamängder som inkluderar minoritetsgrupper och noggrant kontrollera för snedvridning eller luckor.

- Använd diversifierade, representativa träningsdatamängder som inkluderar minoritetsgrupper

- Genomför rigorösa revisioner av data för historiska fördomar (olika resultat baserat på ras/kön)

- Korrigera eller balansera partisk data innan modellen tränas

- Använd dataaugmentation eller syntetisk data för underrepresenterade grupper

- Implementera kontinuerlig övervakning av AI-resultat för att tidigt upptäcka partiskhetsproblem

Rättvis algoritmdesign

Utvecklare bör medvetet integrera rättvisebegränsningar och tekniker för att minska partiskhet i modellträningen. Detta kan inkludera att använda algoritmer som kan justeras för rättvisa (inte bara noggrannhet).

Använd rättvistekniker

Använd algoritmer som är inställda för rättvisa, tillämpa tekniker för att jämna ut felaktighetsnivåer mellan grupper, omvikt data eller ändra beslutströsklar på ett genomtänkt sätt.

Använd verktyg för partiskhetstestning

Utnyttja open source-verktyg och ramverk för att testa modeller för partiskhet och göra justeringar under utvecklingen.

Definiera rättvisekriterier

Arbeta med ämnesexperter och berörda samhällen när rättvisekriterier definieras, eftersom flera matematiska definitioner av rättvisa finns och ibland kan stå i konflikt.

Mänsklig övervakning och ansvar

Inget AI-system bör fungera i ett vakuum utan mänskligt ansvar. Mänsklig övervakning är avgörande för att upptäcka och korrigera partiskheter som en maskin kan lära sig.

Människa i loopen

- Rekryterare som granskar AI-screenade kandidater

- Domare som med försiktighet överväger AI-riskbedömningar

- Medicinska experter som validerar AI-diagnoser

Ansvarsåtgärder

- Regelbundna revisioner av AI-beslut

- Bedömningar av partiskhetens påverkan

- Förklarbar AI-resonemang

- Tydlig ansvarsfördelning

Organisationer måste komma ihåg att de är ansvariga för beslut som fattas av deras algoritmer precis som om de fattades av anställda. Transparens är en annan pelare här: att vara öppen om hur ett AI-system fungerar och dess kända begränsningar kan bygga förtroende och möjliggöra oberoende granskning.

Vissa jurisdiktioner rör sig mot att kräva transparens för algoritmiska beslut med höga insatser (kräver att offentliga myndigheter redovisar hur algoritmer används i beslut som påverkar medborgare). Målet är att säkerställa att AI förstärker mänskligt beslutsfattande utan att ersätta etiskt omdöme eller juridiskt ansvar.

Mångfald i team och reglering

Inkluderande utveckling

En växande skara experter betonar värdet av mångfald bland AI-utvecklare och intressenter. AI-produkter speglar perspektiven och blinda fläckar hos dem som bygger dem.

Reglering och etiska riktlinjer

Regeringar och internationella organ ingriper nu aktivt för att säkerställa att AI-partiskhet hanteras:

- UNESCO:s rekommendation om AI-etik (2021): Första globala ramverket enhälligt antaget, som fastställer principer om transparens, rättvisa och icke-diskriminering

- EU:s AI-förordning (2024): Prioriterar förebyggande av partiskhet och kräver strikta utvärderingar av rättvisa i högrisk-AI-system

- Lokala myndigheters åtgärder: Mer än ett dussin stora städer (San Francisco, Boston, Minneapolis) har förbjudit polisens användning av ansiktsigenkänning på grund av raspartiskhet

Vägen framåt: att bygga etisk AI

AI och algoritmisk partiskhet är en global utmaning som vi bara börjar hantera effektivt. Exemplen och insatserna ovan visar tydligt att AI-partiskhet inte är en nischfråga – den påverkar ekonomiska möjligheter, rättvisa, hälsa och social sammanhållning världen över.

Att uppnå detta kräver ständig vaksamhet: kontinuerlig testning av AI-system för partiskhet, förbättring av data och algoritmer, involvering av olika intressenter och uppdatering av regleringar i takt med att tekniken utvecklas.

I grunden handlar kampen mot algoritmisk partiskhet om att anpassa AI till våra värderingar om jämlikhet och rättvisa. Som UNESCO:s generaldirektör Audrey Azoulay noterade, även "små partiskheter i [AI]-innehåll kan avsevärt förstärka ojämlikheter i verkliga världen".

Små partiskheter i AI-innehåll kan avsevärt förstärka ojämlikheter i verkliga världen.

— Audrey Azoulay, UNESCO:s generaldirektör

Därför är strävan efter opartisk AI avgörande för att säkerställa att tekniken lyfter alla samhällssegment snarare än att befästa gamla fördomar.

Genom att prioritera etiska principer i AI-design – och stödja dem med konkreta åtgärder och policyer – kan vi utnyttja AI:s innovativa kraft samtidigt som vi skyddar människovärdet.

No comments yet. Be the first to comment!