Штучний інтелект та алгоритмічні упередження

Алгоритми штучного інтелекту все частіше використовуються у різних сферах — від найму до фінансів, але вони несуть ризики упереджень і дискримінації. Автоматизовані рішення ШІ можуть відображати або посилювати соціальну несправедливість, якщо навчальні дані упереджені або не різноманітні. Розуміння алгоритмічних упереджень допомагає бізнесу, розробникам і користувачам виявляти, керувати та створювати більш справедливі й прозорі системи ШІ.

Цікавитесь алгоритмічними упередженнями у ШІ? Приєднуйтесь до INVIAI, щоб дізнатися більше про штучний інтелект та алгоритмічні упередження у цій статті!

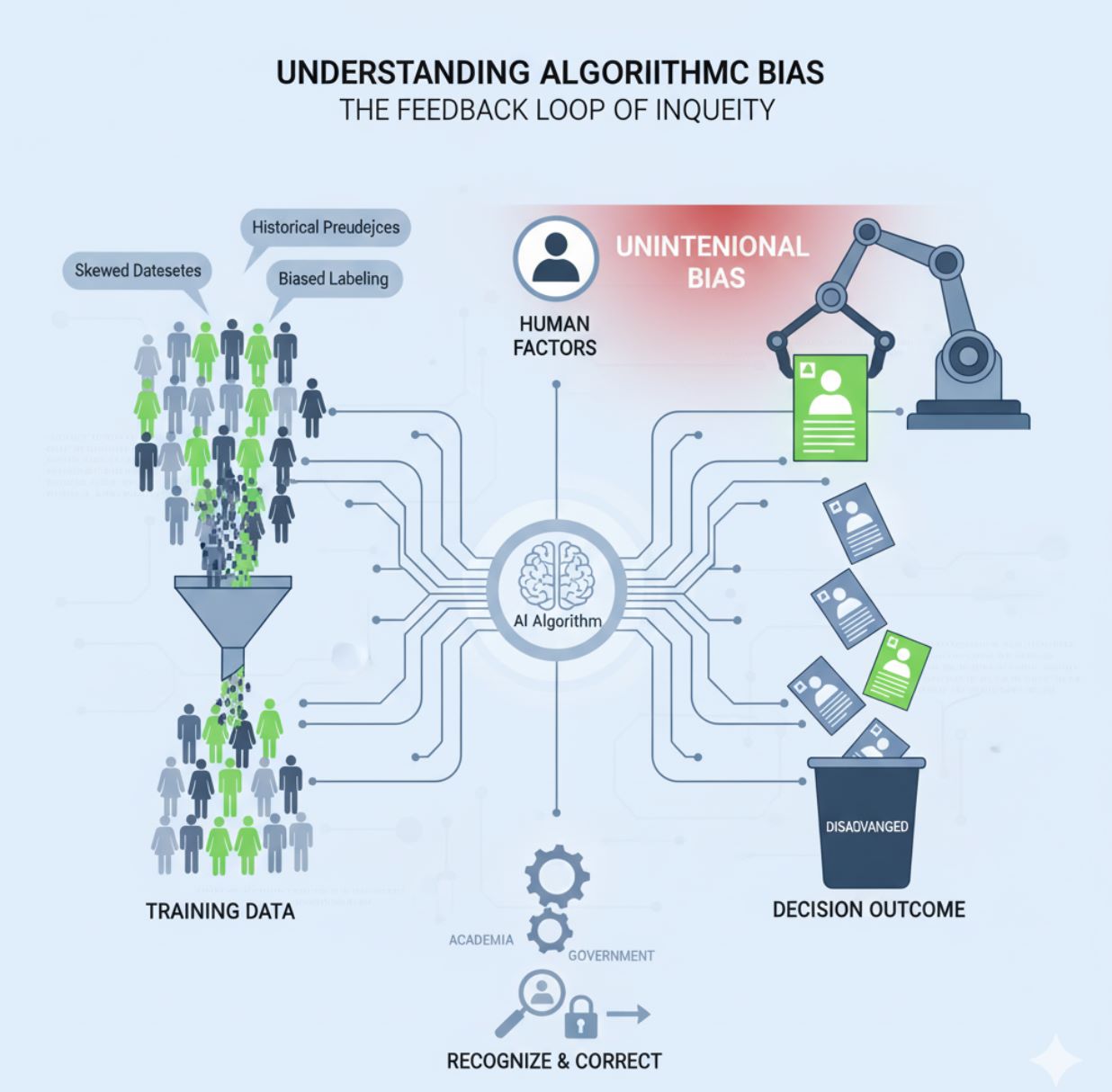

Штучний інтелект (ШІ) дедалі більше інтегрується в наше повсякденне життя — від рішень про найм до охорони здоров’я та правоохоронної діяльності — але його використання викликає занепокоєння щодо алгоритмічних упереджень. Алгоритмічні упередження — це систематичні та несправедливі упередження у результатах роботи систем ШІ, які часто відображають суспільні стереотипи та нерівності.

По суті, алгоритм ШІ може ненавмисно відтворювати людські упередження, присутні у навчальних даних або дизайні, що призводить до дискримінаційних наслідків.

Нижче ми розглянемо причини алгоритмічних упереджень, реальні приклади їхнього впливу та зусилля світу щодо створення більш справедливого ШІ.

Розуміння алгоритмічних упереджень та їх причин

Алгоритмічні упередження зазвичай виникають не тому, що ШІ «хоче» дискримінувати, а через людські фактори. Системи ШІ навчаються на даних і виконують правила, створені людьми — а люди мають упередження (часто несвідомі). Якщо навчальні дані спотворені або відображають історичні упередження, ШІ, ймовірно, засвоїть ці шаблони.

Упереджені навчальні дані

Історичні упередження, закладені в наборах даних

- Неповні набори даних

- Нерепрезентативні вибірки

- Історичні моделі дискримінації

Упереджене маркування даних

Людські упередження в анотації даних

- Суб’єктивна категоризація

- Культурні припущення

- Несвідомі стереотипи

Проблеми оптимізації

Алгоритми оптимізовані на точність, а не на справедливість

- Фокус на загальній точності

- Ігнорування меншин

- Ігнорування компромісів справедливості

Алгоритми ШІ успадковують упередження своїх творців і даних, якщо не вжити свідомих заходів для їх виявлення та виправлення.

— Ключове дослідницьке відкриття

Важливо зазначити, що алгоритмічні упередження зазвичай ненавмисні. Організації часто впроваджують ШІ, щоб зробити рішення об’єктивнішими, але якщо вони «подають» системі упереджену інформацію або не враховують справедливість у дизайні, результат все одно може бути несправедливим. Упередження ШІ може несправедливо розподіляти можливості та давати неточні результати, що негативно впливає на добробут людей і підриває довіру до ШІ.

Розуміння причин упереджень — це перший крок до їх подолання, і цей крок серйозно сприймають академія, індустрія та уряди по всьому світу.

Реальні приклади упереджень у ШІ

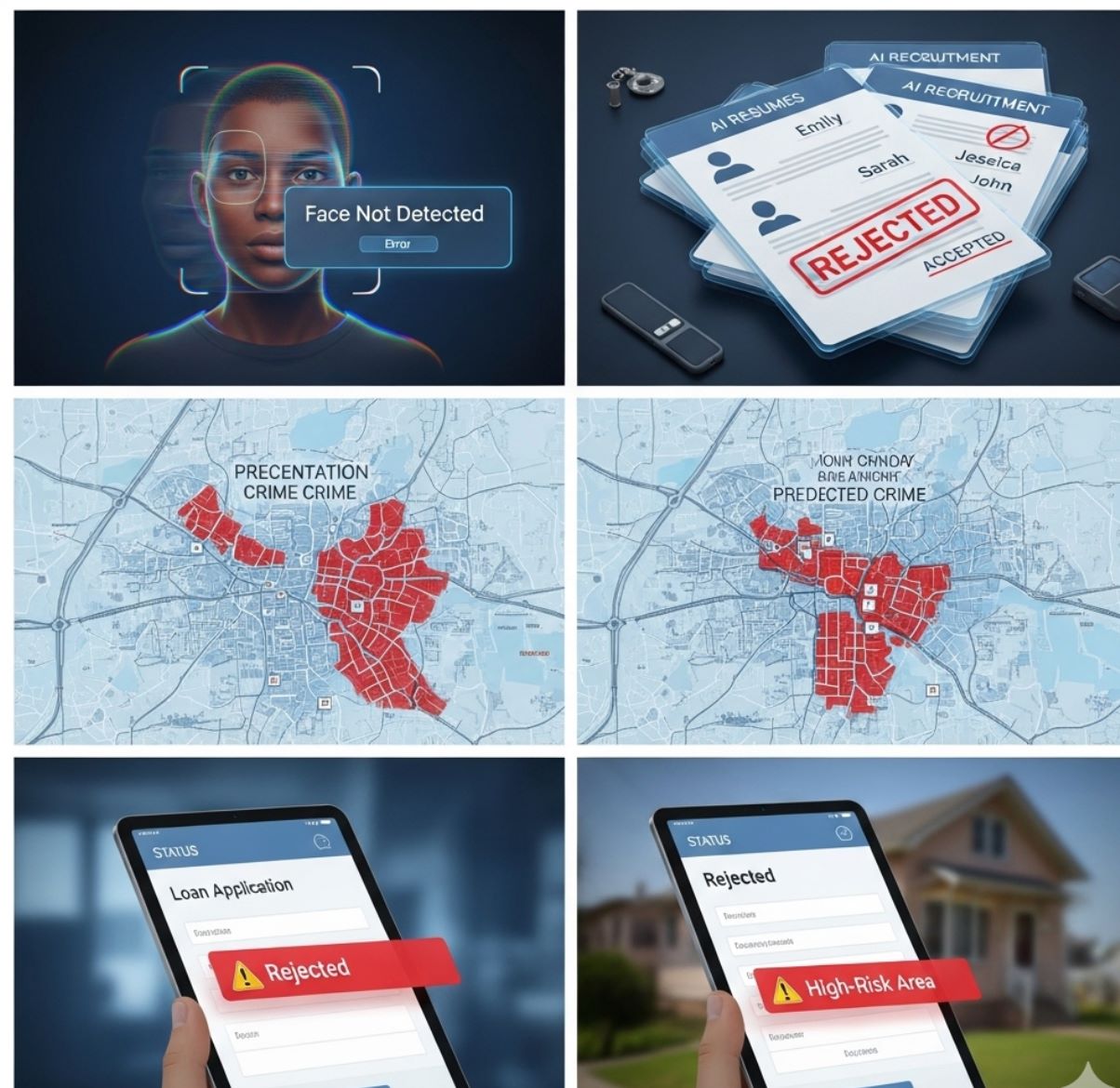

Упередження у ШІ — це не просто гіпотетична проблема; численні реальні випадки показали, як алгоритмічні упередження можуть призводити до дискримінації. Відомі приклади упереджень у різних сферах включають:

Кримінальна юстиція

Випадок: алгоритм прогнозування рецидивізму у США

Вплив: упереджений проти чорношкірих обвинувачених, часто оцінював їх як високоризикових, а білих — як низькоризикових, посилюючи расові нерівності у судочинстві.

Наслідок: посилення історичних упереджень у поліції та судах

Найм і рекрутинг

Випадок: інструмент рекрутингу ШІ від Amazon

Вплив: припинений після дискримінації жінок. Навчений на резюме переважно чоловіків, занижував рейтинг резюме з «жіночими» або виключно жіночими коледжами.

Наслідок: несправедливо відсіював кваліфікованих жінок для технічних посад

Упередження технологій розпізнавання облич

Технології розпізнавання облич показали значні упередження у точності за демографічними ознаками. Всеосяжне дослідження 2019 року Національного інституту стандартів і технологій США (NIST) виявило тривожні розбіжності:

- Хибнопозитивні ідентифікації для азіатських та афроамериканських облич були у 10–100 разів частішими, ніж для європеоїдних

- Найвищі показники помилкової ідентифікації були у чорношкірих жінок при пошуку «один до багатьох»

- Небезпечні упередження вже призводили до помилкових арештів невинних людей

Упередження генеративного ШІ та контенту

Навіть найновіші системи ШІ не застраховані. Дослідження ЮНЕСКО 2024 року показало, що великі мовні моделі часто продукують регресивні гендерні та расові стереотипи:

Домашній фокус

- Описуються у домашніх ролях в 4 рази частіше

- Пов’язані з «домом» та «дітьми»

- Традиційні гендерні стереотипи

Професійний фокус

- Пов’язані з «керівництвом» та «зарплатою»

- Пов’язані з кар’єрним зростанням

- Термінологія лідерства

Ризики ШІ накопичуються на фоні існуючих нерівностей, завдаючи шкоди вже маргіналізованим групам.

— Попередження ЮНЕСКО

Ці приклади підкреслюють, що алгоритмічні упередження — це не віддалена чи рідкісна проблема, а реальність сьогодні. Від робочих можливостей до правосуддя, охорони здоров’я та онлайн-інформації упереджені системи ШІ можуть відтворювати і навіть посилювати існуючу дискримінацію.

Шкода найчастіше стосується історично знедолених груп, що викликає серйозні етичні та правозахисні занепокоєння. Оскільки мільйони людей щодня користуються генеративним ШІ, навіть тонкі упередження у контенті можуть посилювати нерівності у реальному світі, масштабно закріплюючи стереотипи.

Чому упередження ШІ має значення?

Ставки у боротьбі з упередженнями ШІ дуже високі. Якщо їх не контролювати, упереджені алгоритми можуть закріпити системну дискримінацію під маскою технологічної нейтральності. Рішення, прийняті (або підказані) ШІ — хто отримує роботу, кредит чи умовно-дострокове звільнення, як поліція здійснює нагляд — мають реальні наслідки для життя людей.

Вплив на права людини

Підриває принципи рівності та недискримінації

- Відмова у можливостях

- Економічна нерівність

- Загрози особистій свободі

Підрив довіри

Пошкоджує довіру громадськості до технологій

- Зниження впровадження ШІ

- Пошкодження репутації

- Перешкоди для інновацій

Зменшення вигод

Обмежує позитивний потенціал ШІ

- Неточні результати

- Зниження ефективності

- Нерівний доступ до переваг

Якщо рішення несправедливо упереджені проти певних статей, рас чи спільнот, соціальна нерівність зростає. Це може призвести до відмови у можливостях, економічної нерівності або навіть загроз особистій свободі та безпеці постраждалих груп.

У ширшому контексті алгоритмічні упередження підривають права людини та соціальну справедливість, суперечачи принципам рівності та недискримінації, які підтримують демократичні суспільства.

Крім того, алгоритмічні упередження можуть зменшити потенційні вигоди ШІ. ШІ має потенціал підвищувати ефективність і якість рішень, але якщо його результати дискримінаційні або неточні для певних груп населення, він не зможе реалізувати свій повний позитивний вплив.

Наприклад, інструмент ШІ для охорони здоров’я, який добре працює для однієї демографічної групи, але погано для інших, не є справді ефективним або прийнятним. Як зазначає ОЕСР, упередження у ШІ несправедливо обмежує можливості і може коштувати бізнесу репутації та довіри користувачів.

Отже, боротьба з упередженнями — це не лише моральний обов’язок, а й критично важливо для використання переваг ШІ для всіх людей справедливо.

Стратегії пом’якшення упереджень у ШІ

Оскільки алгоритмічні упередження тепер широко визнані, з’явився ряд стратегій і найкращих практик для їх пом’якшення. Забезпечення справедливості та інклюзивності систем ШІ вимагає дій на різних етапах розробки та впровадження:

Покращення практик роботи з даними

Оскільки упереджені дані — корінь проблеми, ключове значення має покращення якості даних. Це означає використання різноманітних, репрезентативних навчальних наборів даних, що включають меншини, і ретельну перевірку на спотворення чи прогалини.

- Використання різноманітних, репрезентативних навчальних наборів даних, що включають меншини

- Ретельний аудит даних на наявність історичних упереджень (різні результати за расою/статтю)

- Виправлення або балансування упереджених даних перед навчанням моделі

- Застосування доповнення даних або синтетичних даних для недостатньо представлених груп

- Впровадження постійного моніторингу результатів ШІ для раннього виявлення проблем упереджень

Справедливий дизайн алгоритмів

Розробники повинні свідомо інтегрувати обмеження справедливості та методи пом’якшення упереджень у навчання моделей. Це може включати використання алгоритмів, які можна налаштовувати для справедливості (а не лише для точності).

Застосування технік справедливості

Використання алгоритмів, налаштованих на справедливість, застосування методів вирівнювання рівня помилок між групами, перенавантаження ваг даних або продумане коригування порогів прийняття рішень.

Використання інструментів тестування упереджень

Застосування відкритих інструментів і фреймворків для тестування моделей на упередження та внесення коригувань під час розробки.

Визначення критеріїв справедливості

Співпраця з експертами галузі та постраждалими спільнотами при визначенні критеріїв справедливості, оскільки існує кілька математичних визначень справедливості, які іноді суперечать одне одному.

Людський контроль і відповідальність

Жодна система ШІ не повинна працювати у вакуумі без людської відповідальності. Людський контроль є критично важливим для виявлення та виправлення упереджень, які машина може засвоїти.

Людина в циклі

- Рекрутери, що переглядають кандидатів, відбраних ШІ

- Судді, які з обережністю розглядають ризикові оцінки ШІ

- Медичні фахівці, що підтверджують діагнози ШІ

Заходи відповідальності

- Регулярні аудити рішень ШІ

- Оцінки впливу упереджень

- Пояснювана логіка ШІ

- Чітке розподілення відповідальності

Організації повинні пам’ятати, що вони відповідають за рішення, прийняті їхніми алгоритмами, так само, як і за рішення, прийняті працівниками. Прозорість — ще один важливий аспект: відкритість щодо роботи системи ШІ та її відомих обмежень може зміцнити довіру і дозволити незалежний контроль.

Деякі юрисдикції рухаються до вимоги прозорості для алгоритмічних рішень з високими ставками (зобов’язуючи державні органи розкривати, як алгоритми використовуються у рішеннях, що впливають на громадян). Мета — забезпечити, щоб ШІ доповнював людське прийняття рішень без заміни етичного судження чи юридичної відповідальності.

Різноманітні команди та регулювання

Інклюзивна розробка

Зростаючий гурт експертів підкреслює цінність різноманітності серед розробників і зацікавлених сторін ШІ. Продукти ШІ відображають перспективи та сліпі плями тих, хто їх створює.

Регулювання та етичні настанови

Уряди та міжнародні організації активно втручаються, щоб забезпечити боротьбу з упередженнями у ШІ:

- Рекомендації ЮНЕСКО з етики ШІ (2021): перша глобальна рамка, прийнята одноголосно, що закріплює принципи прозорості, справедливості та недискримінації

- Закон ЄС про ШІ (2024): робить пріоритетом запобігання упередженням, вимагаючи суворих оцінок справедливості для систем ШІ з високим ризиком

- Дії місцевих органів влади: понад десяток великих міст (Сан-Франциско, Бостон, Міннеаполіс) заборонили поліції використовувати розпізнавання облич через расові упередження

Шлях уперед: створення етичного ШІ

Штучний інтелект і алгоритмічні упередження — це глобальний виклик, який ми лише починаємо ефективно долати. Наведені приклади та зусилля чітко показують, що упередження у ШІ — це не вузькопрофільна проблема, а питання, що впливає на економічні можливості, правосуддя, здоров’я та соціальну згуртованість у всьому світі.

Досягнення цього вимагатиме постійної пильності: безперервного тестування систем ШІ на упередження, покращення даних і алгоритмів, залучення різноманітних зацікавлених сторін і оновлення регуляцій у міру розвитку технологій.

У своїй основі боротьба з алгоритмічними упередженнями полягає у узгодженні ШІ з нашими цінностями рівності та справедливості. Як зазначила генеральний директор ЮНЕСКО Одрі Азуле, навіть «невеликі упередження в контенті [ШІ] можуть значно посилити нерівності у реальному світі».

Невеликі упередження в контенті ШІ можуть значно посилити нерівності у реальному світі.

— Одрі Азуле, генеральний директор ЮНЕСКО

Отже, прагнення до неупередженого ШІ є критично важливим, щоб технологія піднімала всі верстви суспільства, а не закріплювала старі упередження.

Пріоритетність етичних принципів у дизайні ШІ — і підтримка їх конкретними діями та політиками — дозволить нам використовувати інноваційну силу ШІ, одночасно захищаючи гідність людини.

No comments yet. Be the first to comment!