AI dan Bias Algoritmik

Algoritma AI semakin banyak digunakan di berbagai sektor, mulai dari perekrutan hingga keuangan, namun membawa risiko bias dan diskriminasi. Keputusan otomatis AI dapat mencerminkan atau memperkuat ketidakadilan sosial jika data pelatihan bias atau tidak beragam. Memahami bias algoritmik membantu bisnis, pengembang, dan pengguna mengidentifikasi, mengelola, dan membangun sistem AI yang lebih adil dan transparan.

Apakah Anda penasaran tentang bias algoritmik dalam AI? Bergabunglah dengan INVIAI untuk mempelajari lebih lanjut tentang AI dan Bias Algoritmik dalam artikel ini!

Kecerdasan Buatan (AI) semakin tertanam dalam kehidupan sehari-hari kita – mulai dari keputusan perekrutan hingga layanan kesehatan dan kepolisian – namun penggunaannya menimbulkan kekhawatiran tentang bias algoritmik. Bias algoritmik mengacu pada prasangka sistematis dan tidak adil dalam keluaran sistem AI, yang sering mencerminkan stereotip dan ketidaksetaraan sosial.

Intinya, algoritma AI dapat secara tidak sengaja mereproduksi bias manusia yang ada dalam data pelatihan atau desainnya, yang mengarah pada hasil diskriminatif.

Di bawah ini, kami mengeksplorasi penyebab bias algoritmik, contoh dampaknya di dunia nyata, dan bagaimana dunia berupaya membuat AI lebih adil.

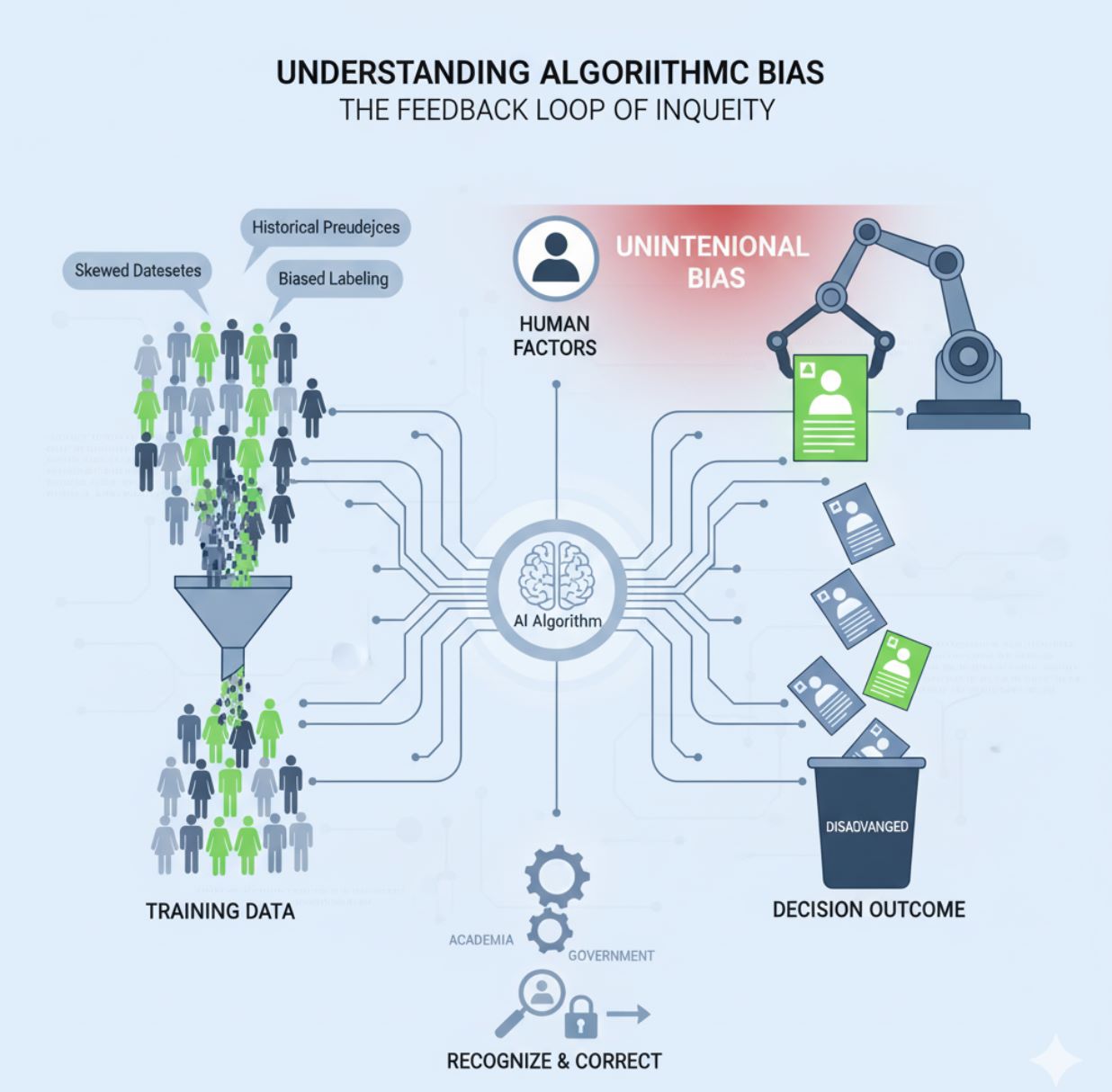

Memahami Bias Algoritmik dan Penyebabnya

Bias algoritmik biasanya muncul bukan karena AI "ingin" mendiskriminasi, tetapi karena faktor manusia. Sistem AI belajar dari data dan mengikuti aturan yang dibuat oleh manusia – dan manusia memiliki bias (seringkali tidak disadari). Jika data pelatihan miring atau mencerminkan prasangka historis, AI kemungkinan akan mempelajari pola tersebut.

Data Pelatihan yang Bias

Prasangka historis yang tertanam dalam dataset

- Dataset yang tidak lengkap

- Sampel yang tidak representatif

- Polanya diskriminasi historis

Pelabelan Data yang Bias

Prasangka manusia dalam anotasi data

- Kategorisasi subjektif

- Asumsi budaya

- Stereotip tidak sadar

Masalah Optimasi

Algoritma dioptimalkan untuk akurasi daripada keadilan

- Fokus pada akurasi keseluruhan

- Mengabaikan kelompok minoritas

- Mengabaikan kompromi keadilan

Algoritma AI mewarisi bias dari pembuat dan datanya kecuali langkah sengaja diambil untuk mengenali dan memperbaiki bias tersebut.

— Temuan Penelitian Utama

Penting untuk dicatat bahwa bias algoritmik biasanya tidak disengaja. Organisasi sering mengadopsi AI untuk membuat keputusan lebih objektif, tetapi jika mereka "memberi makan" sistem dengan informasi bias atau gagal mempertimbangkan keadilan dalam desain, hasilnya tetap bisa tidak adil. Bias AI dapat secara tidak adil mengalokasikan peluang dan menghasilkan hasil yang tidak akurat, berdampak negatif pada kesejahteraan orang dan mengikis kepercayaan pada AI.

Memahami mengapa bias terjadi adalah langkah pertama menuju solusi – dan ini adalah langkah yang kini diambil dengan serius oleh akademisi, industri, dan pemerintah di seluruh dunia.

Contoh Bias AI di Dunia Nyata

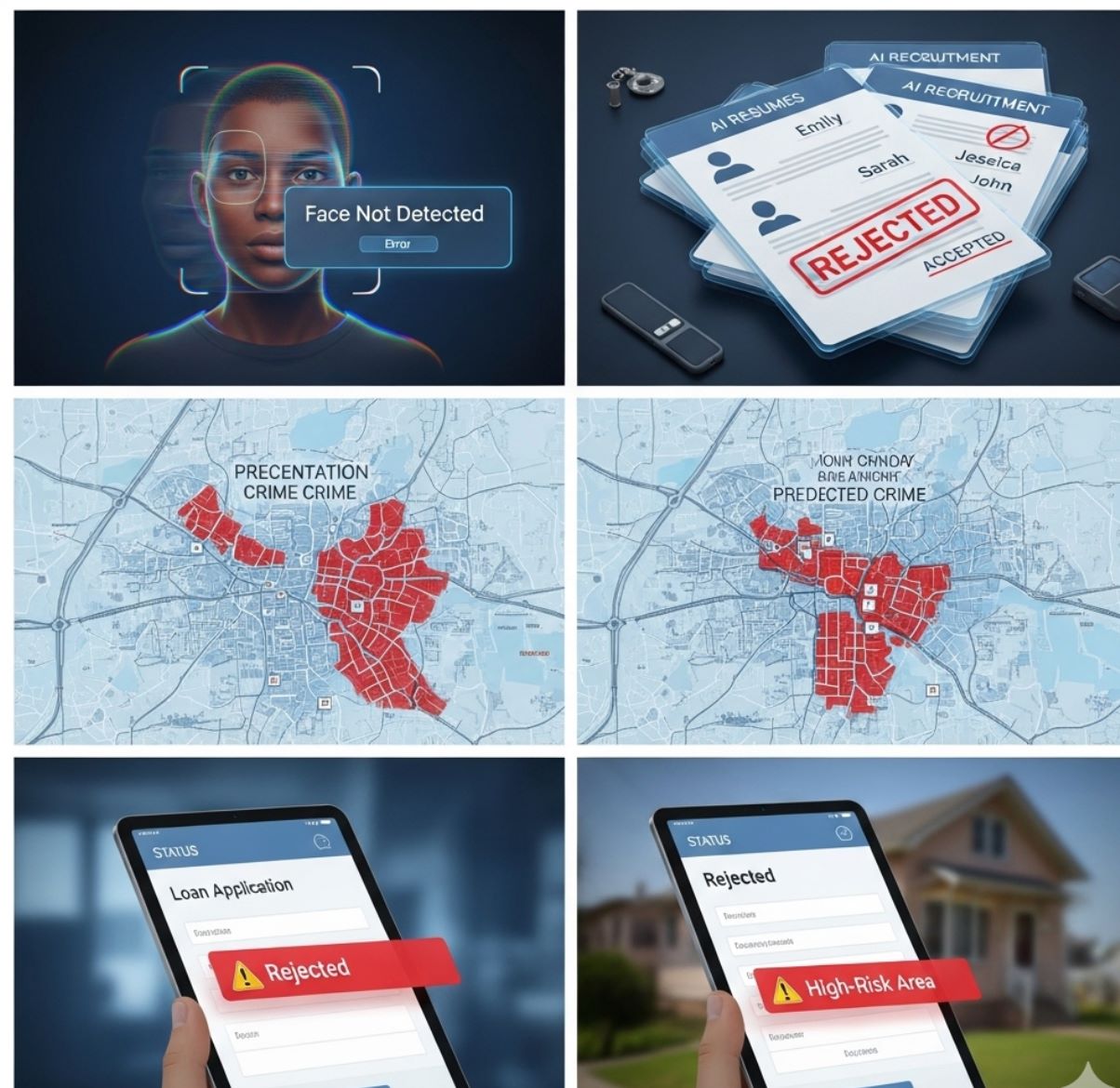

Bias dalam AI bukan hanya kekhawatiran hipotetis; banyak kasus nyata telah mengungkap bagaimana bias algoritmik dapat menyebabkan diskriminasi. Contoh penting bias AI di berbagai sektor meliputi:

Sistem Peradilan Pidana

Kasus: Algoritma prediksi residivisme di AS

Dampak: Bias terhadap terdakwa kulit hitam, sering menilai terdakwa kulit hitam berisiko tinggi dan terdakwa kulit putih berisiko rendah, memperparah ketimpangan rasial dalam hukuman.

Konsekuensi: Memperkuat bias historis dalam kepolisian dan pengadilan

Perekrutan & Rekrutmen

Kasus: Alat perekrutan AI Amazon

Dampak: Dihentikan setelah diskriminasi terhadap perempuan. Dilatih dengan resume masa lalu yang sebagian besar dari pria, menurunkan peringkat resume yang mengandung kata "perempuan" atau perguruan tinggi khusus perempuan.

Konsekuensi: Akan secara tidak adil menyaring keluar perempuan yang berkualifikasi untuk pekerjaan teknis

Bias Teknologi Pengenalan Wajah

Teknologi pengenalan wajah menunjukkan bias signifikan dalam akurasi di berbagai demografi. Studi komprehensif 2019 oleh National Institute of Standards and Technology (NIST) AS mengungkap disparitas mengkhawatirkan:

- Identifikasi positif palsu untuk wajah Asia dan Afrika-Amerika 10 hingga 100 kali lebih mungkin dibandingkan wajah Kaukasia

- Tingkat kesalahan tertinggi terjadi pada wanita kulit hitam dalam pencarian satu-ke-banyak

- Bias berbahaya ini sudah menyebabkan orang tak bersalah ditangkap secara salah

Bias AI Generatif dan Konten

Bahkan sistem AI terbaru tidak kebal. Studi UNESCO 2024 mengungkap bahwa model bahasa besar sering menghasilkan stereotip gender dan ras yang regresif:

Fokus Domestik

- Sering digambarkan dalam peran domestik 4x lebih sering

- Terhubung dengan "rumah" dan "anak-anak"

- Stereotip gender tradisional

Fokus Profesional

- Berhubungan dengan "eksekutif" dan "gaji"

- Terhubung dengan kemajuan "karier"

- Terminologi kepemimpinan

Risiko AI bertambah di atas ketidaksetaraan yang sudah ada, menyebabkan kerugian lebih lanjut bagi kelompok yang sudah termarjinalkan.

— Peringatan UNESCO

Contoh-contoh ini menegaskan bahwa bias algoritmik bukan masalah jauh atau langka – ini terjadi di berbagai domain hari ini. Dari peluang kerja hingga keadilan, kesehatan hingga informasi daring, sistem AI yang bias dapat mereplikasi dan bahkan memperkuat diskriminasi yang sudah ada.

Kerugian sering ditanggung oleh kelompok yang secara historis dirugikan, menimbulkan kekhawatiran serius tentang etika dan hak asasi manusia. Mengingat jutaan orang kini menggunakan AI generatif dalam kehidupan sehari-hari, bahkan bias halus dalam konten dapat memperkuat ketidaksetaraan di dunia nyata, memperkokoh stereotip secara masif.

Mengapa Bias AI Penting?

Taruhannya tinggi untuk menangani bias AI. Jika dibiarkan, algoritma bias dapat memperkuat diskriminasi sistemik di balik tampilan netralitas teknologi. Keputusan yang dibuat (atau dipandu) oleh AI – siapa yang diterima kerja, siapa yang mendapat pinjaman atau pembebasan bersyarat, bagaimana polisi menargetkan pengawasan – membawa konsekuensi nyata bagi kehidupan orang.

Dampak Hak Asasi Manusia

Merusak prinsip kesetaraan dan non-diskriminasi

- Peluang yang ditolak

- Ketimpangan ekonomi

- Ancaman terhadap kebebasan pribadi

Erosi Kepercayaan

Merusak kepercayaan publik pada teknologi

- Pengurangan adopsi AI

- Kerusakan reputasi

- Hambatan inovasi

Manfaat Berkurang

Membatasi potensi positif AI

- Hasil yang tidak akurat

- Efektivitas berkurang

- Akses tidak setara ke manfaat

Jika keputusan tersebut secara tidak adil memihak gender, ras, atau komunitas tertentu, ketidaksetaraan sosial akan melebar. Ini dapat menyebabkan peluang yang ditolak, ketimpangan ekonomi, atau bahkan ancaman terhadap kebebasan dan keselamatan pribadi kelompok yang terdampak.

Dalam gambaran besar, bias algoritmik merusak hak asasi manusia dan keadilan sosial, bertentangan dengan prinsip kesetaraan dan non-diskriminasi yang dijunjung oleh masyarakat demokratis.

Selain itu, bias algoritmik dapat mengurangi manfaat potensial AI. AI menjanjikan peningkatan efisiensi dan pengambilan keputusan, tetapi jika hasilnya diskriminatif atau tidak akurat untuk sebagian populasi, AI tidak dapat mencapai dampak positif penuh.

Misalnya, alat kesehatan AI yang bekerja baik untuk satu demografis tetapi buruk untuk yang lain tidak benar-benar efektif atau dapat diterima. Seperti yang diamati OECD, bias dalam AI secara tidak adil membatasi peluang dan dapat merugikan reputasi bisnis serta kepercayaan pengguna.

Singkatnya, menangani bias bukan hanya kewajiban moral tetapi juga penting untuk memanfaatkan manfaat AI secara adil bagi semua individu.

Strategi Mengurangi Bias AI

Karena bias algoritmik kini diakui luas, berbagai strategi dan praktik terbaik telah muncul untuk menguranginya. Memastikan sistem AI adil dan inklusif memerlukan tindakan di berbagai tahap pengembangan dan penerapan:

Praktik Data yang Lebih Baik

Karena data bias adalah penyebab utama, meningkatkan kualitas data sangat penting. Ini berarti menggunakan dataset pelatihan yang beragam dan representatif yang mencakup kelompok minoritas, serta memeriksa secara ketat adanya bias atau kekurangan.

- Gunakan dataset pelatihan yang beragam dan representatif yang mencakup kelompok minoritas

- Audit data secara ketat untuk bias historis (hasil berbeda berdasarkan ras/gender)

- Perbaiki atau seimbangkan data bias sebelum melatih model

- Terapkan augmentasi data atau data sintetis untuk kelompok yang kurang terwakili

- Lakukan pemantauan berkelanjutan terhadap keluaran AI untuk mendeteksi masalah bias sejak dini

Desain Algoritma yang Adil

Pengembang harus secara sadar mengintegrasikan kontraint keadilan dan teknik mitigasi bias dalam pelatihan model. Ini bisa termasuk menggunakan algoritma yang dapat disesuaikan untuk keadilan (bukan hanya akurasi).

Terapkan Teknik Keadilan

Gunakan algoritma yang disesuaikan untuk keadilan, terapkan teknik untuk menyamakan tingkat kesalahan antar kelompok, beri bobot ulang data, atau ubah ambang keputusan dengan bijak.

Gunakan Alat Pengujian Bias

Manfaatkan alat dan kerangka kerja sumber terbuka untuk menguji model terhadap bias dan melakukan penyesuaian selama pengembangan.

Tentukan Kriteria Keadilan

Bekerja sama dengan ahli domain dan komunitas terdampak saat menentukan kriteria keadilan, karena ada banyak definisi matematis keadilan yang kadang bertentangan.

Pengawasan dan Akuntabilitas Manusia

Tidak ada sistem AI yang boleh beroperasi tanpa akuntabilitas manusia. Pengawasan manusia sangat penting untuk menangkap dan memperbaiki bias yang mungkin dipelajari mesin.

Manusia dalam Proses

- Rekruter meninjau kandidat yang disaring AI

- Hakim mempertimbangkan skor risiko AI dengan hati-hati

- Profesional medis memvalidasi diagnosis AI

Langkah Akuntabilitas

- Audit rutin keputusan AI

- Penilaian dampak bias

- Penjelasan AI yang dapat dipahami

- Penetapan tanggung jawab yang jelas

Organisasi harus ingat bahwa mereka bertanggung jawab atas keputusan yang dibuat oleh algoritma mereka sama seperti jika dibuat oleh karyawan. Transparansi adalah pilar lain di sini: terbuka tentang cara kerja sistem AI dan keterbatasan yang diketahui dapat membangun kepercayaan dan memungkinkan pengawasan independen.

Beberapa yurisdiksi bergerak menuju kewajiban transparansi untuk keputusan algoritmik berisiko tinggi (mengharuskan lembaga publik mengungkapkan bagaimana algoritma digunakan dalam keputusan yang memengaruhi warga). Tujuannya adalah memastikan AI mendukung pengambilan keputusan manusia tanpa menggantikan penilaian etis atau tanggung jawab hukum.

Tim Beragam dan Regulasi

Pengembangan Inklusif

Semakin banyak ahli menekankan nilai keanekaragaman di antara pengembang dan pemangku kepentingan AI. Produk AI mencerminkan perspektif dan titik buta pembuatnya.

Regulasi dan Pedoman Etika

Pemerintah dan badan internasional kini aktif memastikan bias AI ditangani:

- Rekomendasi UNESCO tentang Etika AI (2021): Kerangka kerja global pertama yang diadopsi secara bulat, mengabadikan prinsip transparansi, keadilan, dan non-diskriminasi

- EU AI Act (2024): Menjadikan pencegahan bias prioritas, mengharuskan evaluasi ketat untuk keadilan dalam sistem AI berisiko tinggi

- Tindakan Pemerintah Lokal: Lebih dari selusin kota besar (San Francisco, Boston, Minneapolis) melarang penggunaan pengenalan wajah oleh polisi karena bias rasial

Jalan ke Depan: Membangun AI Etis

AI dan bias algoritmik adalah tantangan global yang baru mulai kita tangani secara efektif. Contoh dan upaya di atas menunjukkan bahwa bias AI bukan masalah khusus – ini memengaruhi peluang ekonomi, keadilan, kesehatan, dan kohesi sosial di seluruh dunia.

Mencapai ini memerlukan kewaspadaan berkelanjutan: terus menguji sistem AI untuk bias, memperbaiki data dan algoritma, melibatkan pemangku kepentingan beragam, dan memperbarui regulasi seiring perkembangan teknologi.

Intinya, melawan bias algoritmik adalah tentang menyelaraskan AI dengan nilai-nilai kita tentang kesetaraan dan keadilan. Seperti yang dicatat Direktur Jenderal UNESCO Audrey Azoulay, bahkan "bias kecil dalam konten [AI] dapat secara signifikan memperkuat ketidaksetaraan di dunia nyata".

Bias kecil dalam konten AI dapat secara signifikan memperkuat ketidaksetaraan di dunia nyata.

— Audrey Azoulay, Direktur Jenderal UNESCO

Oleh karena itu, mengejar AI tanpa bias sangat penting untuk memastikan teknologi mengangkat semua lapisan masyarakat daripada memperkuat prasangka lama.

Dengan memprioritaskan prinsip etika dalam desain AI – dan mendukungnya dengan tindakan dan kebijakan konkret – kita dapat memanfaatkan kekuatan inovatif AI sambil menjaga martabat manusia.

No comments yet. Be the first to comment!