AI và Định kiến Thuật toán

Các thuật toán AI ngày càng được sử dụng rộng rãi trong nhiều lĩnh vực, từ tuyển dụng đến tài chính, nhưng chúng tiềm ẩn nguy cơ định kiến và phân biệt đối xử. Các quyết định tự động của AI có thể phản ánh hoặc khuếch đại bất công xã hội nếu dữ liệu huấn luyện bị thiên lệch hoặc thiếu đa dạng. Hiểu về định kiến thuật toán giúp doanh nghiệp, nhà phát triển và người dùng nhận diện, quản lý và xây dựng hệ thống AI công bằng, minh bạch hơn.

Bạn đang thắc mắc về định kiến thuật toán trong AI? Hãy cùng INVIAI tìm hiểu thêm về AI và Định kiến Thuật toán trong bài viết này!

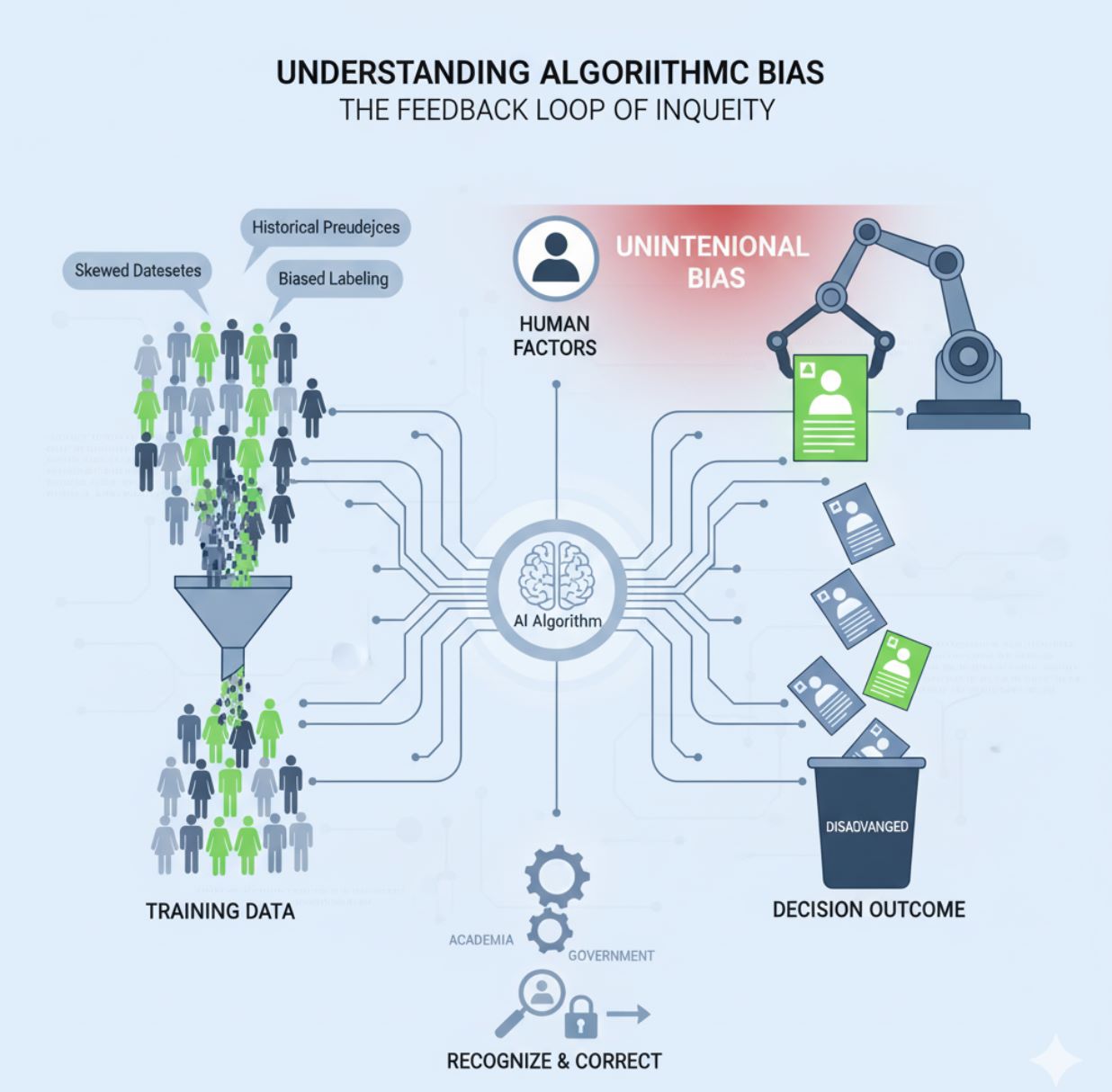

Trí tuệ nhân tạo (AI) ngày càng được tích hợp sâu vào cuộc sống hàng ngày của chúng ta – từ quyết định tuyển dụng đến chăm sóc sức khỏe và an ninh – nhưng việc sử dụng nó đã gây ra những lo ngại về định kiến thuật toán. Định kiến thuật toán đề cập đến những thành kiến hệ thống và không công bằng trong kết quả của các hệ thống AI, thường phản ánh các định kiến và bất bình đẳng xã hội.

Về cơ bản, một thuật toán AI có thể vô tình tái tạo các định kiến con người có trong dữ liệu huấn luyện hoặc thiết kế, dẫn đến kết quả phân biệt đối xử.

Dưới đây, chúng ta sẽ khám phá nguyên nhân gây ra định kiến thuật toán, các ví dụ thực tế về tác động của nó, và cách thế giới đang nỗ lực để làm cho AI công bằng hơn.

Hiểu về Định kiến Thuật toán và Nguyên nhân của nó

Định kiến thuật toán thường phát sinh không phải vì AI "muốn" phân biệt đối xử, mà do các yếu tố con người. Hệ thống AI học từ dữ liệu và tuân theo các quy tắc do con người tạo ra – và con người có định kiến (thường là vô thức). Nếu dữ liệu huấn luyện bị lệch hoặc phản ánh các định kiến lịch sử, AI rất có thể sẽ học theo các mẫu đó.

Dữ liệu Huấn luyện Thiên lệch

Các định kiến lịch sử được nhúng trong bộ dữ liệu

- Bộ dữ liệu không đầy đủ

- Mẫu không đại diện

- Mô hình phân biệt lịch sử

Gán nhãn Dữ liệu Thiên lệch

Định kiến con người trong việc chú thích dữ liệu

- Phân loại chủ quan

- Giả định văn hóa

- Định kiến vô thức

Vấn đề Tối ưu hóa

Thuật toán được tối ưu cho độ chính xác hơn là công bằng

- Tập trung vào độ chính xác tổng thể

- Bỏ qua nhóm thiểu số

- Bỏ qua các đánh đổi về công bằng

Thuật toán AI kế thừa định kiến của người tạo và dữ liệu trừ khi có các bước chủ ý để nhận diện và sửa chữa những định kiến đó.

— Phát hiện Nghiên cứu Quan trọng

Cần lưu ý rằng định kiến thuật toán thường là vô ý. Các tổ chức thường áp dụng AI để đưa ra quyết định khách quan hơn, nhưng nếu họ "cung cấp" cho hệ thống thông tin thiên lệch hoặc không xem xét công bằng trong thiết kế, kết quả vẫn có thể không công bằng. Định kiến AI có thể phân bổ cơ hội không công bằng và tạo ra kết quả không chính xác, ảnh hưởng tiêu cực đến phúc lợi của con người và làm giảm niềm tin vào AI.

Hiểu được lý do tại sao định kiến xảy ra là bước đầu tiên hướng tới giải pháp – và đây là bước mà giới học thuật, ngành công nghiệp và chính phủ trên toàn thế giới đang nghiêm túc thực hiện.

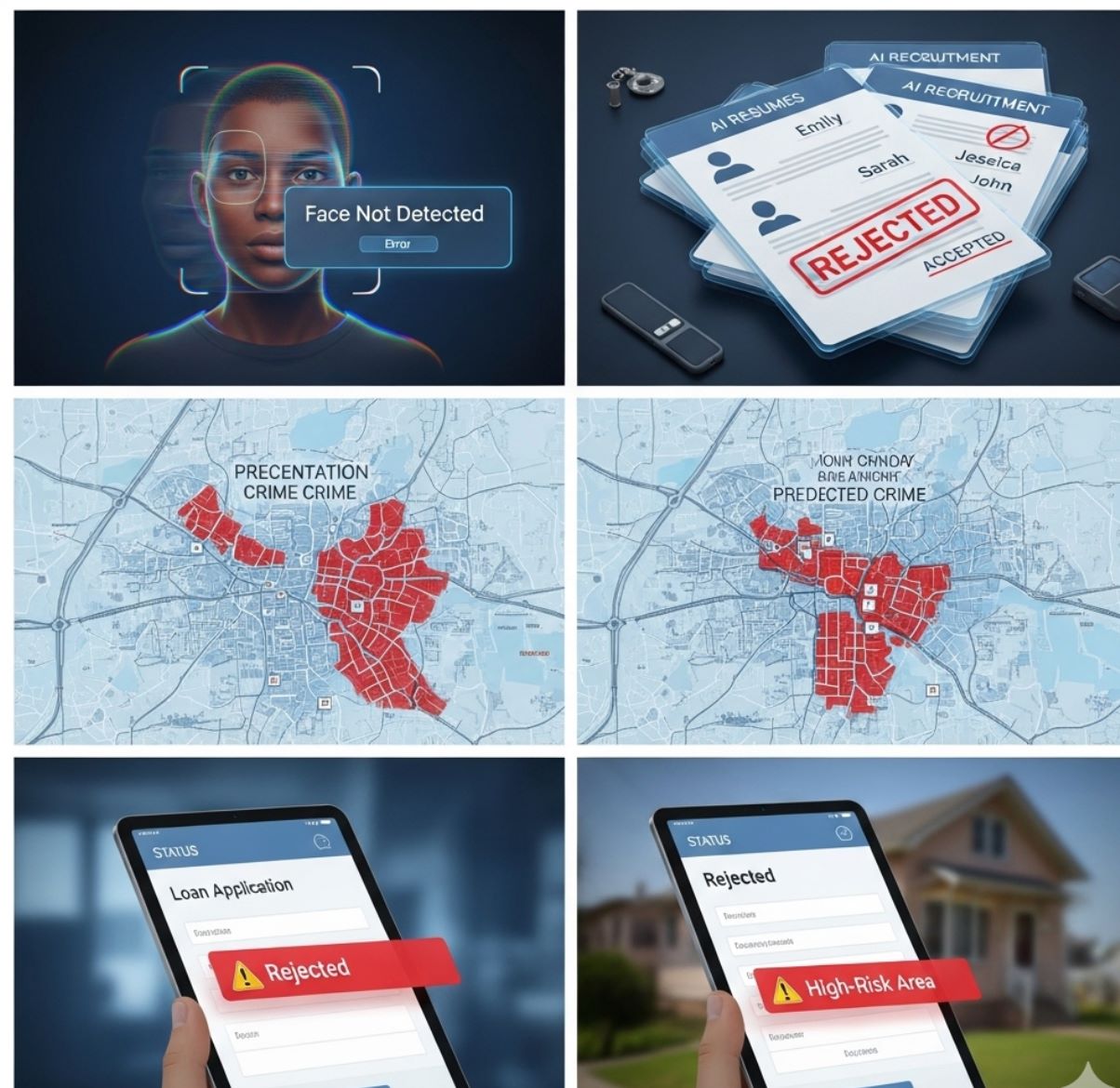

Ví dụ Thực tế về Định kiến AI

Định kiến trong AI không chỉ là mối quan tâm giả định; nhiều trường hợp thực tế đã phơi bày cách định kiến thuật toán có thể dẫn đến phân biệt đối xử. Các ví dụ nổi bật về định kiến AI trong các lĩnh vực khác nhau bao gồm:

Hệ thống Tư pháp Hình sự

Trường hợp: Thuật toán dự đoán tái phạm tại Mỹ

Tác động: Thiên vị chống lại bị cáo người da đen, thường đánh giá sai bị cáo da đen là nguy cơ cao và bị cáo da trắng là nguy cơ thấp, làm gia tăng sự chênh lệch chủng tộc trong xét xử.

Hệ quả: Khuếch đại các định kiến lịch sử trong cảnh sát và tòa án

Tuyển dụng & Tuyển chọn

Trường hợp: Công cụ tuyển dụng AI của Amazon

Tác động: Bị loại bỏ sau khi phân biệt đối xử với phụ nữ. Được huấn luyện trên hồ sơ xin việc chủ yếu của nam giới, công cụ hạ điểm hồ sơ có chứa từ "phụ nữ" hoặc các trường đại học dành riêng cho nữ.

Hệ quả: Sẽ loại bỏ không công bằng các ứng viên nữ đủ năng lực cho các vị trí kỹ thuật

Định kiến trong Công nghệ Nhận diện Khuôn mặt

Công nghệ nhận diện khuôn mặt đã thể hiện định kiến đáng kể về độ chính xác theo các nhóm dân số. Một nghiên cứu toàn diện năm 2019 của Viện Tiêu chuẩn và Công nghệ Quốc gia Mỹ (NIST) đã tiết lộ sự chênh lệch đáng báo động:

- Nhận dạng dương tính giả cho khuôn mặt người châu Á và người Mỹ gốc Phi có khả năng cao hơn 10 đến 100 lần so với khuôn mặt người da trắng

- Tỷ lệ nhận dạng sai cao nhất là với phụ nữ da đen trong các tìm kiếm một-nhiều

- Định kiến nguy hiểm đã dẫn đến việc bắt giữ nhầm người vô tội

Định kiến trong AI Tạo nội dung

Ngay cả các hệ thống AI mới nhất cũng không miễn nhiễm. Một nghiên cứu của UNESCO năm 2024 cho thấy các mô hình ngôn ngữ lớn thường tạo ra các định kiến giới và chủng tộc lạc hậu:

Tập trung vào Vai trò Gia đình

- Được mô tả trong các vai trò gia đình nhiều hơn 4 lần

- Liên kết với "gia đình" và "trẻ em"

- Định kiến giới truyền thống

Tập trung vào Vai trò Chuyên nghiệp

- Liên quan đến "giám đốc" và "mức lương"

- Liên kết với sự thăng tiến trong "sự nghiệp"

- Thuật ngữ lãnh đạo

Rủi ro của AI đang chồng chất lên các bất bình đẳng hiện có, gây tổn hại thêm cho các nhóm đã bị thiệt thòi.

— Cảnh báo của UNESCO

Những ví dụ này nhấn mạnh rằng định kiến thuật toán không phải là vấn đề xa vời hay hiếm gặp – nó đang xảy ra trên nhiều lĩnh vực ngay hôm nay. Từ cơ hội việc làm đến công lý, chăm sóc sức khỏe đến thông tin trực tuyến, các hệ thống AI thiên lệch có thể tái tạo và thậm chí làm trầm trọng thêm sự phân biệt đối xử hiện hữu.

Tác hại thường thuộc về các nhóm bị thiệt thòi lịch sử, đặt ra những lo ngại nghiêm trọng về đạo đức và quyền con người. Khi hàng triệu người hiện nay sử dụng AI tạo nội dung trong cuộc sống hàng ngày, ngay cả những định kiến nhỏ trong nội dung cũng có thể khuếch đại bất bình đẳng trong thế giới thực, củng cố các định kiến trên quy mô lớn.

Tại sao Định kiến AI lại Quan trọng?

Việc giải quyết định kiến AI có tầm quan trọng lớn. Nếu không kiểm soát, các thuật toán thiên lệch có thể củng cố phân biệt hệ thống dưới lớp vỏ trung lập công nghệ. Các quyết định được AI đưa ra (hoặc hỗ trợ) – ai được tuyển dụng, ai được vay tiền hay ân xá, cách cảnh sát giám sát – đều có hậu quả thực sự đối với cuộc sống con người.

Tác động đến Quyền con người

Làm suy yếu nguyên tắc bình đẳng và không phân biệt đối xử

- Bị từ chối cơ hội

- Bất bình đẳng kinh tế

- Đe dọa tự do cá nhân

Suy giảm Niềm tin

Gây tổn hại niềm tin công chúng vào công nghệ

- Giảm mức độ áp dụng AI

- Tổn hại danh tiếng

- Rào cản đổi mới

Giảm Thiệu Lợi ích

Hạn chế tiềm năng tích cực của AI

- Kết quả không chính xác

- Hiệu quả giảm

- Tiếp cận lợi ích không đồng đều

Nếu các quyết định đó bị thiên lệch không công bằng chống lại một số giới tính, chủng tộc hoặc cộng đồng nhất định, bất bình đẳng xã hội sẽ gia tăng. Điều này có thể dẫn đến việc bị từ chối cơ hội, chênh lệch kinh tế hoặc thậm chí đe dọa tự do và an toàn cá nhân cho các nhóm bị ảnh hưởng.

Trong bức tranh lớn hơn, định kiến thuật toán làm suy yếu quyền con người và công bằng xã hội, mâu thuẫn với các nguyên tắc bình đẳng và không phân biệt đối xử được các xã hội dân chủ bảo vệ.

Hơn nữa, định kiến thuật toán có thể làm giảm lợi ích tiềm năng của AI. AI có tiềm năng cải thiện hiệu quả và ra quyết định, nhưng nếu kết quả của nó phân biệt đối xử hoặc không chính xác với một số nhóm dân cư, nó không thể đạt được tác động tích cực tối đa.

Ví dụ, một công cụ AI trong y tế hoạt động tốt với một nhóm dân cư nhưng kém với nhóm khác thì không thực sự hiệu quả hay chấp nhận được. Như OECD đã quan sát, định kiến trong AI giới hạn cơ hội không công bằng và có thể khiến doanh nghiệp mất danh tiếng và người dùng mất niềm tin.

Tóm lại, giải quyết định kiến không chỉ là nghĩa vụ đạo đức mà còn là yếu tố then chốt để khai thác lợi ích AI cho mọi cá nhân một cách công bằng.

Chiến lược Giảm thiểu Định kiến AI

Vì định kiến thuật toán hiện đã được công nhận rộng rãi, nhiều chiến lược và thực hành tốt nhất đã được phát triển để giảm thiểu nó. Đảm bảo hệ thống AI công bằng và bao trùm đòi hỏi hành động ở nhiều giai đoạn phát triển và triển khai:

Thực hành Dữ liệu Tốt hơn

Vì dữ liệu thiên lệch là nguyên nhân gốc rễ, cải thiện chất lượng dữ liệu là then chốt. Điều này có nghĩa là sử dụng bộ dữ liệu huấn luyện đa dạng, đại diện bao gồm các nhóm thiểu số, và kiểm tra kỹ lưỡng sự lệch hoặc thiếu hụt.

- Sử dụng bộ dữ liệu huấn luyện đa dạng, đại diện bao gồm các nhóm thiểu số

- Kiểm toán dữ liệu nghiêm ngặt để phát hiện định kiến lịch sử (kết quả khác biệt theo chủng tộc/giới tính)

- Sửa chữa hoặc cân bằng dữ liệu thiên lệch trước khi huấn luyện mô hình

- Áp dụng tăng cường dữ liệu hoặc dữ liệu tổng hợp cho các nhóm thiếu đại diện

- Thực hiện giám sát liên tục các kết quả AI để phát hiện sớm các vấn đề định kiến

Thiết kế Thuật toán Công bằng

Nhà phát triển nên tích hợp có ý thức các ràng buộc công bằng và kỹ thuật giảm thiểu định kiến vào quá trình huấn luyện mô hình. Điều này có thể bao gồm sử dụng các thuật toán có thể điều chỉnh cho công bằng (không chỉ độ chính xác).

Áp dụng Kỹ thuật Công bằng

Sử dụng thuật toán được điều chỉnh cho công bằng, áp dụng kỹ thuật để cân bằng tỷ lệ lỗi giữa các nhóm, tái trọng số dữ liệu hoặc thay đổi ngưỡng quyết định một cách thận trọng.

Sử dụng Công cụ Kiểm tra Định kiến

Tận dụng các công cụ và khung mã nguồn mở để kiểm tra mô hình về định kiến và điều chỉnh trong quá trình phát triển.

Xác định Tiêu chí Công bằng

Làm việc với chuyên gia lĩnh vực và cộng đồng bị ảnh hưởng khi xác định tiêu chí công bằng, vì có nhiều định nghĩa toán học về công bằng và đôi khi chúng mâu thuẫn.

Giám sát và Trách nhiệm của Con người

Không hệ thống AI nào nên hoạt động trong môi trường không có trách nhiệm của con người. Giám sát con người rất quan trọng để phát hiện và sửa chữa các định kiến mà máy có thể học được.

Con người trong Vòng lặp

- Nhà tuyển dụng xem xét lại các ứng viên được AI sàng lọc

- Thẩm phán cân nhắc điểm rủi ro AI một cách thận trọng

- Chuyên gia y tế xác nhận chẩn đoán AI

Biện pháp Trách nhiệm

- Kiểm toán định kỳ các quyết định AI

- Đánh giá tác động định kiến

- Giải thích được lý do AI

- Phân công trách nhiệm rõ ràng

Các tổ chức phải nhớ rằng họ chịu trách nhiệm về các quyết định do thuật toán của họ đưa ra như thể do nhân viên thực hiện. Minh bạch là một trụ cột khác ở đây: công khai cách hệ thống AI hoạt động và các giới hạn đã biết có thể xây dựng niềm tin và cho phép kiểm tra độc lập.

Một số khu vực pháp lý đang tiến tới yêu cầu minh bạch cho các quyết định thuật toán có rủi ro cao (bắt buộc các cơ quan công khai cách thuật toán được sử dụng trong các quyết định ảnh hưởng đến công dân). Mục tiêu là đảm bảo AI hỗ trợ quyết định con người mà không thay thế phán đoán đạo đức hoặc trách nhiệm pháp lý.

Đội ngũ Đa dạng và Quy định

Phát triển Bao trùm

Ngày càng nhiều chuyên gia nhấn mạnh giá trị của sự đa dạng trong nhóm phát triển và các bên liên quan AI. Sản phẩm AI phản ánh quan điểm và điểm mù của những người tạo ra chúng.

Quy định và Hướng dẫn Đạo đức

Chính phủ và các tổ chức quốc tế hiện đang tích cực can thiệp để đảm bảo định kiến AI được giải quyết:

- Khuyến nghị về Đạo đức AI của UNESCO (2021): Khung toàn cầu đầu tiên được thông qua nhất trí, ghi nhận các nguyên tắc minh bạch, công bằng và không phân biệt đối xử

- Đạo luật AI của EU (2024): Ưu tiên phòng ngừa định kiến, yêu cầu đánh giá nghiêm ngặt về công bằng trong các hệ thống AI rủi ro cao

- Hành động Chính quyền Địa phương: Hơn một tá thành phố lớn (San Francisco, Boston, Minneapolis) đã cấm cảnh sát sử dụng nhận diện khuôn mặt do định kiến chủng tộc

Con đường Tiến tới: Xây dựng AI Đạo đức

AI và định kiến thuật toán là thách thức toàn cầu mà chúng ta mới chỉ bắt đầu giải quyết hiệu quả. Các ví dụ và nỗ lực trên cho thấy định kiến AI không phải là vấn đề nhỏ lẻ – nó ảnh hưởng đến cơ hội kinh tế, công lý, sức khỏe và sự gắn kết xã hội trên toàn thế giới.

Để đạt được điều này cần sự cảnh giác liên tục: kiểm tra hệ thống AI thường xuyên về định kiến, cải thiện dữ liệu và thuật toán, tham gia các bên liên quan đa dạng, và cập nhật quy định khi công nghệ phát triển.

Về cốt lõi, chống lại định kiến thuật toán là điều chỉnh AI phù hợp với các giá trị bình đẳng và công bằng của chúng ta. Như Giám đốc UNESCO Audrey Azoulay đã lưu ý, ngay cả "những định kiến nhỏ trong nội dung [AI] cũng có thể khuếch đại đáng kể bất bình đẳng trong thế giới thực".

Những định kiến nhỏ trong nội dung AI có thể khuếch đại đáng kể bất bình đẳng trong thế giới thực.

— Audrey Azoulay, Giám đốc UNESCO

Do đó, việc theo đuổi AI không định kiến là rất quan trọng để đảm bảo công nghệ nâng cao mọi tầng lớp xã hội thay vì củng cố các định kiến cũ.

Bằng cách ưu tiên các nguyên tắc đạo đức trong thiết kế AI – và hỗ trợ chúng bằng các hành động và chính sách cụ thể – chúng ta có thể khai thác sức mạnh đổi mới của AI đồng thời bảo vệ phẩm giá con người.

Chưa có bình luận nào. Hãy là người đầu tiên bình luận!