AI at Pagkiling ng Algorithm

Ang mga algorithm ng AI ay lalong ginagamit sa iba't ibang sektor, mula sa pagkuha ng empleyado hanggang sa pananalapi, ngunit may dalang panganib ng pagkiling at diskriminasyon. Ang mga awtomatikong desisyon ng AI ay maaaring magpakita o magpalala ng mga sosyal na kawalang-katarungan kung ang datos na pinag-aralan ay may pagkiling o hindi magkakaiba. Ang pag-unawa sa pagkiling ng algorithm ay tumutulong sa mga negosyo, developer, at mga gumagamit na tukuyin, pamahalaan, at bumuo ng mas patas at mas malinaw na mga sistema ng AI.

Nagtatanong ka ba tungkol sa mga pagkiling ng algorithm sa AI? Sumali sa INVIAI upang matuto pa tungkol sa AI at Pagkiling ng Algorithm sa artikulong ito!

Ang Artipisyal na Intelihensiya (AI) ay lalong nakapaloob sa ating pang-araw-araw na buhay – mula sa mga desisyon sa pagkuha ng empleyado hanggang sa pangangalaga sa kalusugan at pagpapatupad ng batas – ngunit ang paggamit nito ay nagdulot ng mga alalahanin tungkol sa pagkiling ng algorithm. Ang pagkiling ng algorithm ay tumutukoy sa sistematiko at hindi patas na mga pagkiling sa mga resulta ng mga sistema ng AI, na madalas na sumasalamin sa mga panlipunang stereotype at hindi pagkakapantay-pantay.

Sa esensya, ang isang AI algorithm ay maaaring hindi sinasadyang ulitin ang mga pagkiling ng tao na nasa datos na pinag-aralan o disenyo, na nagreresulta sa mga diskriminatoryong kinalabasan.

Sa ibaba, tatalakayin natin kung ano ang mga sanhi ng pagkiling ng algorithm, mga totoong halimbawa ng epekto nito, at kung paano nagsusumikap ang mundo na gawing mas patas ang AI.

Pag-unawa sa Pagkiling ng Algorithm at ang mga Sanhi Nito

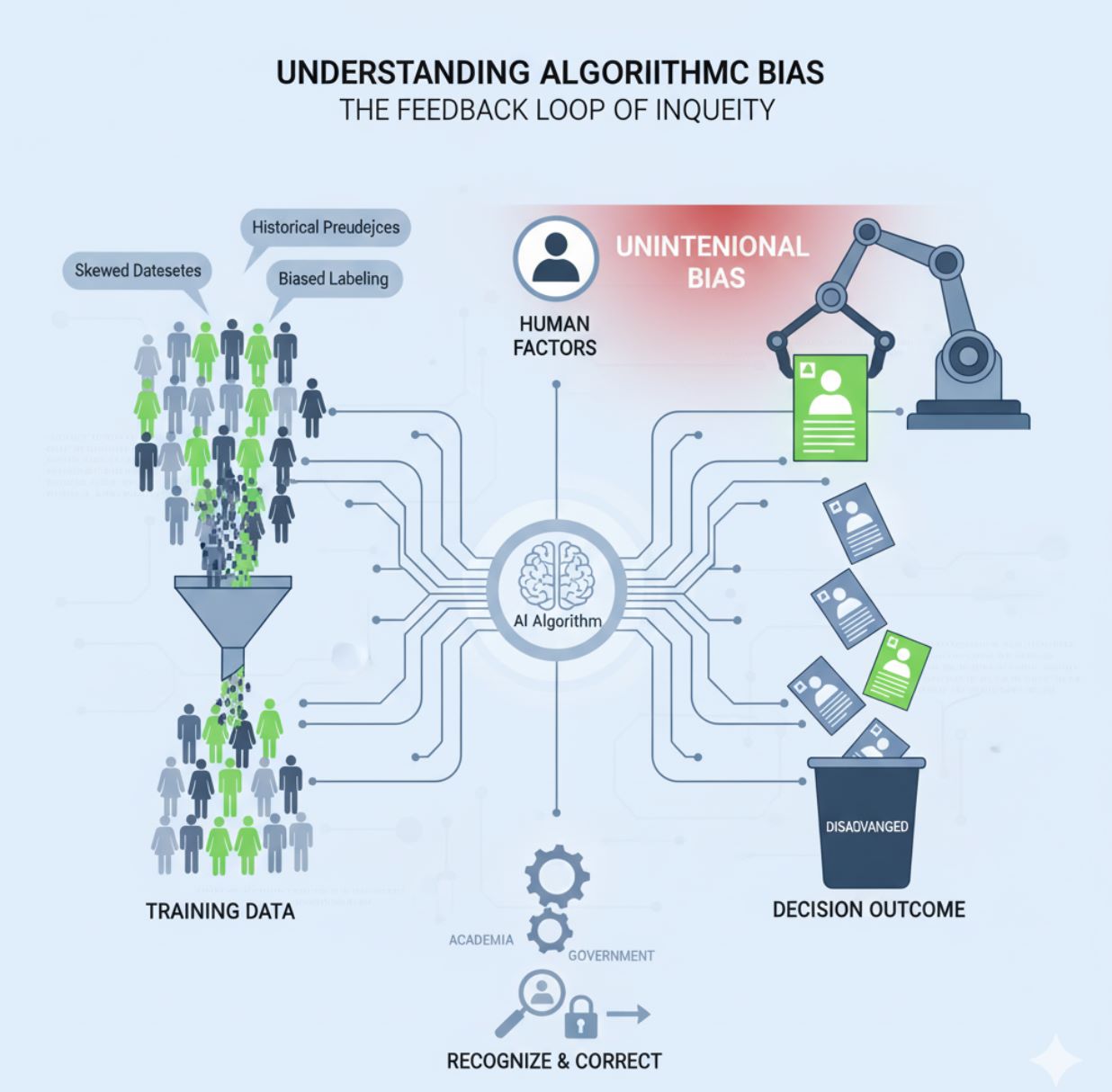

Karaniwang nangyayari ang pagkiling ng algorithm hindi dahil "nais" ng AI na magdiskrimina, kundi dahil sa mga salik ng tao. Ang mga sistema ng AI ay natututo mula sa datos at sumusunod sa mga patakarang nilikha ng mga tao – at ang mga tao ay may mga pagkiling (madalas ay hindi sinasadya). Kung ang datos na pinag-aralan ay baluktot o sumasalamin sa mga makasaysayang pagkiling, malamang na matutunan ng AI ang mga pattern na iyon.

Baluktot na Datos sa Pagsasanay

Mga makasaysayang pagkiling na nakapaloob sa mga dataset

- Hindi kumpletong mga dataset

- Hindi kinakatawang mga sample

- Mga pattern ng makasaysayang diskriminasyon

Baluktot na Pag-label ng Datos

Mga pagkiling ng tao sa anotasyon ng datos

- Subhetibong pagkategorya

- Mga kultural na palagay

- Hindi sinasadyang stereotyping

Mga Isyu sa Optimisasyon

Mga algorithm na ini-optimize para sa katumpakan kaysa sa katarungan

- Pokús sa pangkalahatang katumpakan

- Pagpapabaya sa mga minoryang grupo

- Hindi pinapansin ang mga trade-off sa katarungan

Namamana ng mga algorithm ng AI ang mga pagkiling ng kanilang mga tagalikha at datos maliban kung may mga sinadyang hakbang upang kilalanin at itama ang mga pagkiling na iyon.

— Pangunahing Natuklasan sa Pananaliksik

Mahalagang tandaan na ang pagkiling ng algorithm ay karaniwang hindi sinasadya. Madalas gamitin ng mga organisasyon ang AI upang gawing mas obhetibo ang mga desisyon, ngunit kung "pinapakain" nila ang sistema ng baluktot na impormasyon o hindi isinasaalang-alang ang pagkakapantay-pantay sa disenyo, maaaring maging hindi patas pa rin ang resulta. Ang pagkiling ng AI ay maaaring hindi patas na maglaan ng mga oportunidad at magbigay ng maling resulta, na negatibong nakakaapekto sa kapakanan ng mga tao at nagpapahina ng tiwala sa AI.

Ang pag-unawa kung bakit nangyayari ang pagkiling ay unang hakbang patungo sa mga solusyon – at ito ay isang hakbang na seryosong tinatanggap ngayon ng akademya, industriya, at mga pamahalaan sa buong mundo.

Mga Totoong Halimbawa ng Pagkiling sa AI

Ang pagkiling sa AI ay hindi lamang isang haka-haka; maraming totoong kaso ang nagpakita kung paano maaaring magdulot ng diskriminasyon ang pagkiling ng algorithm. Ilan sa mga kilalang halimbawa ng pagkiling sa AI sa iba't ibang sektor ay:

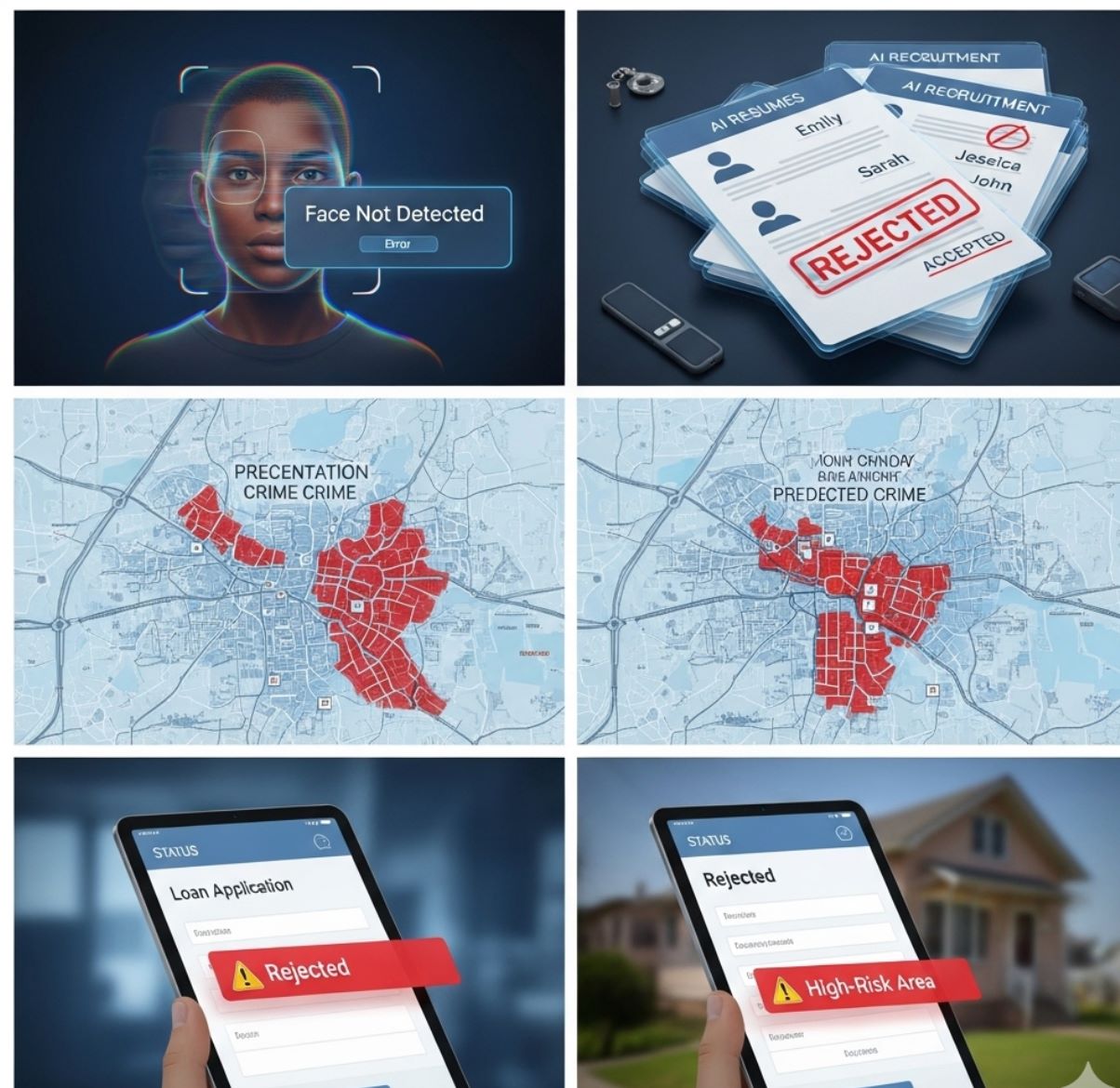

Sistema ng Hustisyang Pansakdal

Kaso: Algorithm sa prediksyon ng recidivism sa U.S.

Epekto: May pagkiling laban sa mga itim na nasasakdal, madalas maling itinuturing ang mga itim na nasasakdal bilang mataas ang panganib at mga puting nasasakdal bilang mababa ang panganib, na nagpapalala ng mga pagkakaiba sa lahi sa paghatol.

Kahihinatnan: Pinalala ang mga makasaysayang pagkiling sa pagpapatupad ng batas at korte

Pagkuha at Rekrutment

Kaso: AI na tool sa pagre-recruit ng Amazon

Epekto: Itinigil matapos magdiskrimina laban sa mga babae. Sinanay sa mga resume na karamihan ay mula sa mga lalaki, binawasan ang halaga ng mga resume na may "women's" o mga kolehiyo na puro babae.

Kahihinatnan: Hindi patas na na-filter ang mga kwalipikadong babae para sa mga teknikal na trabaho

Pagkiling sa Teknolohiya ng Pagkilala sa Mukha

Ang teknolohiya ng pagkilala sa mukha ay nagpakita ng malaking pagkiling sa katumpakan sa iba't ibang demograpiko. Isang komprehensibong pag-aaral noong 2019 ng U.S. National Institute of Standards and Technology (NIST) ang nagpakita ng nakakabahalang mga pagkakaiba:

- Ang maling positibong pagkilala para sa mga mukha ng Asyano at Aprikano-Amerikano ay 10 hanggang 100 beses na mas malamang kaysa sa mga mukha ng puti

- Pinakamataas na rate ng maling pagkilala ay para sa mga itim na babae sa mga one-to-many na paghahanap

- Ang mapanganib na pagkiling ay nagdulot na ng maling pag-aresto sa mga inosenteng tao

Pagkiling sa Generative AI at Nilalaman

Kahit ang mga pinakabagong sistema ng AI ay hindi ligtas. Isang pag-aaral ng UNESCO noong 2024 ang nagpakita na madalas maglabas ang malalaking language model ng mga regresibong stereotype sa kasarian at lahi:

Pokus sa Bahay

- Inilalarawan sa mga tungkulin sa bahay 4x na mas madalas

- Konektado sa "bahay" at "mga bata"

- Tradisyunal na mga stereotype sa kasarian

Pokus sa Propesyon

- Kaugnay sa "executive" at "sahod"

- Konektado sa pag-unlad ng "karera"

- Terminolohiya ng pamumuno

Ang mga panganib ng AI ay nagpapalala sa mga umiiral na hindi pagkakapantay-pantay, na nagreresulta sa karagdagang pinsala sa mga grupong nasa laylayan na.

— Babala ng UNESCO

Pinatutunayan ng mga halimbawang ito na ang pagkiling ng algorithm ay hindi isang malayong o bihirang problema – nangyayari ito sa iba't ibang larangan ngayon. Mula sa mga oportunidad sa trabaho hanggang sa hustisya, pangangalaga sa kalusugan hanggang sa impormasyon online, ang mga baluktot na sistema ng AI ay maaaring ulitin at palalimin pa ang umiiral na diskriminasyon.

Ang pinsala ay kadalasang dinadala ng mga grupong makasaysayang nasa laylayan, na nagdudulot ng seryosong mga alalahanin sa etika at karapatang pantao. Dahil milyon-milyon ang gumagamit ng generative AI sa pang-araw-araw na buhay, kahit ang mga banayad na pagkiling sa nilalaman ay maaaring magpalala ng mga hindi pagkakapantay-pantay sa totoong mundo, na nagpapatibay ng mga stereotype sa malawakang sukat.

Bakit Mahalaga ang Pagkiling sa AI?

Mataas ang pusta sa pagtugon sa pagkiling ng AI. Kung hindi mapipigilan, ang mga baluktot na algorithm ay maaaring magpatibay ng sistematikong diskriminasyon sa likod ng anyo ng neutralidad ng teknolohiya. Ang mga desisyon na ginawa (o ginabayan) ng AI – kung sino ang matatanggap sa trabaho, sino ang makakakuha ng pautang o parole, paano tinututukan ng pulis ang surveillance – ay may tunay na epekto sa buhay ng mga tao.

Epekto sa Karapatang Pantao

Pinapahina ang mga prinsipyo ng pagkakapantay-pantay at hindi diskriminasyon

- Na-deny ang mga oportunidad

- Mga ekonomikong hindi pagkakapantay-pantay

- Banta sa personal na kalayaan

Pagkawala ng Tiwala

Nasisira ang kumpiyansa ng publiko sa teknolohiya

- Pagbaba ng pagtanggap sa AI

- Pagkasira ng reputasyon

- Mga hadlang sa inobasyon

Pagbawas ng Benepisyo

Nililimitahan ang positibong potensyal ng AI

- Maling mga resulta

- Pagbaba ng bisa

- Hindi pantay na access sa mga benepisyo

Kung ang mga desisyong iyon ay hindi patas na nakatuon laban sa ilang kasarian, lahi, o komunidad, lumalawak ang mga panlipunang hindi pagkakapantay-pantay. Maaari itong magdulot ng pagtanggi sa mga oportunidad, ekonomikong hindi pagkakapantay-pantay, o kahit banta sa personal na kalayaan at kaligtasan para sa mga apektadong grupo.

Sa mas malawak na pananaw, ang pagkiling ng algorithm ay pinapahina ang mga karapatang pantao at katarungang panlipunan, na salungat sa mga prinsipyo ng pagkakapantay-pantay at hindi diskriminasyon na pinangangalagaan ng mga demokratikong lipunan.

Higit pa rito, ang pagkiling ng algorithm ay maaaring bawasan ang posibleng benepisyo ng AI. Nangangako ang AI na mapabuti ang kahusayan at paggawa ng desisyon, ngunit kung ang mga resulta nito ay diskriminatoryo o mali para sa ilang bahagi ng populasyon, hindi nito maaabot ang buong positibong epekto.

Halimbawa, ang isang AI health tool na mahusay para sa isang demograpiko ngunit hindi epektibo para sa iba ay hindi tunay na epektibo o katanggap-tanggap. Tulad ng napansin ng OECD, ang pagkiling sa AI ay hindi patas na nililimitahan ang mga oportunidad at maaaring magdulot ng pagkawala ng reputasyon ng negosyo at tiwala ng mga gumagamit.

Sa madaling salita, ang pagtugon sa pagkiling ay hindi lamang moral na tungkulin kundi kritikal din upang mapakinabangan ang mga benepisyo ng AI para sa lahat nang patas.

Mga Estratehiya para Mabawasan ang Pagkiling sa AI

Dahil malawak nang kinikilala ang pagkiling ng algorithm, lumitaw ang iba't ibang estratehiya at pinakamahusay na mga gawi upang mabawasan ito. Ang pagtiyak na patas at inklusibo ang mga sistema ng AI ay nangangailangan ng aksyon sa maraming yugto ng pagbuo at paggamit:

Mas Mahusay na Mga Gawi sa Datos

Dahil ang baluktot na datos ay ugat ng problema, mahalaga ang pagpapabuti ng kalidad ng datos. Nangangahulugan ito ng paggamit ng iba-ibang, kinatawang mga dataset sa pagsasanay na kasama ang mga minoryang grupo, at masusing pagsusuri para sa baluktot o kakulangan.

- Gumamit ng iba-ibang, kinatawang mga dataset sa pagsasanay na kasama ang mga minoryang grupo

- Masusing i-audit ang datos para sa makasaysayang pagkiling (iba't ibang resulta ayon sa lahi/kasarian)

- Itama o balansehin ang baluktot na datos bago sanayin ang modelo

- Gamitin ang data augmentation o synthetic data para sa mga hindi kinakatawang grupo

- Magpatupad ng patuloy na pagmamanman ng mga output ng AI upang maagang matukoy ang mga isyu sa pagkiling

Makatarungang Disenyo ng Algorithm

Dapat na sinasadya ng mga developer na isama ang mga limitasyon sa katarungan at mga teknik sa pagbabawas ng pagkiling sa pagsasanay ng modelo. Maaaring kabilang dito ang paggamit ng mga algorithm na maaaring i-tune para sa katarungan (hindi lamang katumpakan).

Ipatupad ang Mga Teknik sa Katarungan

Gumamit ng mga algorithm na na-tune para sa katarungan, magpatupad ng mga teknik upang pantayin ang mga rate ng error sa mga grupo, muling bigyan ng timbang ang datos, o maingat na baguhin ang mga threshold ng desisyon.

Gumamit ng Mga Kasangkapan sa Pagsusuri ng Pagkiling

Gamitin ang mga open-source na kasangkapan at framework para sa pagsusuri ng mga modelo para sa pagkiling at paggawa ng mga pagsasaayos habang nade-develop.

Tukuyin ang Mga Pamantayan sa Katarungan

Makipagtulungan sa mga eksperto sa larangan at mga apektadong komunidad sa pagtukoy ng mga pamantayan sa katarungan, dahil may iba't ibang matematikal na depinisyon ng katarungan na minsan ay nagkakasalungatan.

Pangangasiwa ng Tao at Pananagutan

Walang sistema ng AI ang dapat gumana nang walang pananagutan ng tao. Mahalaga ang pangangasiwa ng tao upang matukoy at maitama ang mga pagkiling na maaaring matutunan ng makina.

Human-in-the-Loop

- Mga recruiter na nire-review ang mga kandidato na sinuri ng AI

- Mga hukom na maingat na isinasaalang-alang ang mga risk score ng AI

- Mga propesyonal sa medisina na nagva-validate ng mga diagnosis ng AI

Mga Panukala sa Pananagutan

- Regular na pag-audit ng mga desisyon ng AI

- Pagsusuri ng epekto ng pagkiling

- Explainable AI reasoning

- Malinaw na pagtatalaga ng responsibilidad

Dapat tandaan ng mga organisasyon na sila ay mananagot sa mga desisyong ginawa ng kanilang mga algorithm tulad ng mga desisyong ginawa ng mga empleyado. Ang transparency ay isa pang haligi dito: ang pagiging bukas tungkol sa kung paano gumagana ang isang sistema ng AI at ang mga kilalang limitasyon nito ay maaaring magtayo ng tiwala at payagan ang independiyenteng pagsusuri.

Ang ilang mga hurisdiksyon ay kumikilos na upang ipag-utos ang transparency para sa mga desisyong algorithmic na may mataas na panganib (na nangangailangan ng mga pampublikong ahensya na ipahayag kung paano ginagamit ang mga algorithm sa mga desisyong nakakaapekto sa mga mamamayan). Ang layunin ay tiyakin na ang AI ay sumusuporta sa paggawa ng desisyon ng tao nang hindi pumapalit sa etikal na paghatol o legal na pananagutan.

Mga Iba't Ibang Koponan at Regulasyon

Inklusibong Pag-unlad

Isang lumalaking grupo ng mga eksperto ang nagtatampok ng kahalagahan ng pagkakaiba-iba sa mga developer ng AI at mga stakeholder. Ang mga produkto ng AI ay sumasalamin sa mga pananaw at mga blind spot ng mga bumuo nito.

Regulasyon at Mga Patnubay sa Etika

Ang mga pamahalaan at mga internasyonal na katawan ay aktibong kumikilos upang matiyak na natutugunan ang pagkiling sa AI:

- Rekomendasyon ng UNESCO sa Etika ng AI (2021): Unang pandaigdigang balangkas na pinagtibay nang walang pagtutol, na naglalaman ng mga prinsipyo ng transparency, katarungan, at hindi diskriminasyon

- EU AI Act (2024): Ginagawang prayoridad ang pag-iwas sa pagkiling, na nangangailangan ng mahigpit na pagsusuri para sa katarungan sa mga sistemang AI na may mataas na panganib

- Aksyon ng Lokal na Pamahalaan: Mahigit isang dosenang pangunahing lungsod (San Francisco, Boston, Minneapolis) ang nagbawal sa paggamit ng pulisya ng facial recognition dahil sa pagkiling sa lahi

Ang Daan Pasulong: Pagbuo ng Etikal na AI

Ang AI at pagkiling ng algorithm ay isang pandaigdigang hamon na nagsisimula pa lamang nating epektibong harapin. Ang mga halimbawa at pagsisikap sa itaas ay nagpapakita na ang pagkiling ng AI ay hindi isang maliit na isyu – ito ay nakakaapekto sa mga oportunidad sa ekonomiya, hustisya, kalusugan, at panlipunang pagkakaisa sa buong mundo.

Ang pag-abot dito ay mangangailangan ng patuloy na pagbabantay: patuloy na pagsusuri ng mga sistema ng AI para sa pagkiling, pagpapabuti ng datos at mga algorithm, paglahok ng iba't ibang stakeholder, at pag-update ng mga regulasyon habang umuunlad ang teknolohiya.

Sa pinakapuso nito, ang paglaban sa pagkiling ng algorithm ay tungkol sa pagtutugma ng AI sa ating mga pagpapahalaga sa pagkakapantay-pantay at katarungan. Tulad ng sinabi ni Audrey Azoulay, Direktor-Heneral ng UNESCO, kahit ang "maliit na pagkiling sa nilalaman ng [AI] ay maaaring malaki ang epekto sa pagpapalawak ng mga hindi pagkakapantay-pantay sa totoong mundo".

Maliit na pagkiling sa nilalaman ng AI ay maaaring malaki ang epekto sa pagpapalawak ng mga hindi pagkakapantay-pantay sa totoong mundo.

— Audrey Azoulay, Direktor-Heneral ng UNESCO

Kaya, ang paghahangad ng walang pagkiling na AI ay kritikal upang matiyak na ang teknolohiya ay nagpapalakas sa lahat ng bahagi ng lipunan sa halip na palakasin ang mga lumang pagkiling.

Sa pamamagitan ng pagbibigay-priyoridad sa mga etikal na prinsipyo sa disenyo ng AI – at pagsuporta sa mga ito ng kongkretong mga aksyon at patakaran – maaari nating gamitin ang makabagong lakas ng AI habang pinangangalagaan ang dignidad ng tao.

No comments yet. Be the first to comment!