AI dan Bias Algoritma

Algoritma AI semakin digunakan dalam pelbagai sektor, dari pengambilan pekerja hingga kewangan, tetapi ia membawa risiko bias dan diskriminasi. Keputusan AI automatik boleh mencerminkan atau memperkuat ketidakadilan sosial jika data latihan berat sebelah atau tidak pelbagai. Memahami bias algoritma membantu perniagaan, pembangun, dan pengguna mengenal pasti, mengurus, dan membina sistem AI yang lebih adil dan telus.

Adakah anda tertanya-tanya tentang bias algoritma dalam AI? Sertai INVIAI untuk mengetahui lebih lanjut tentang AI dan Bias Algoritma dalam artikel ini!

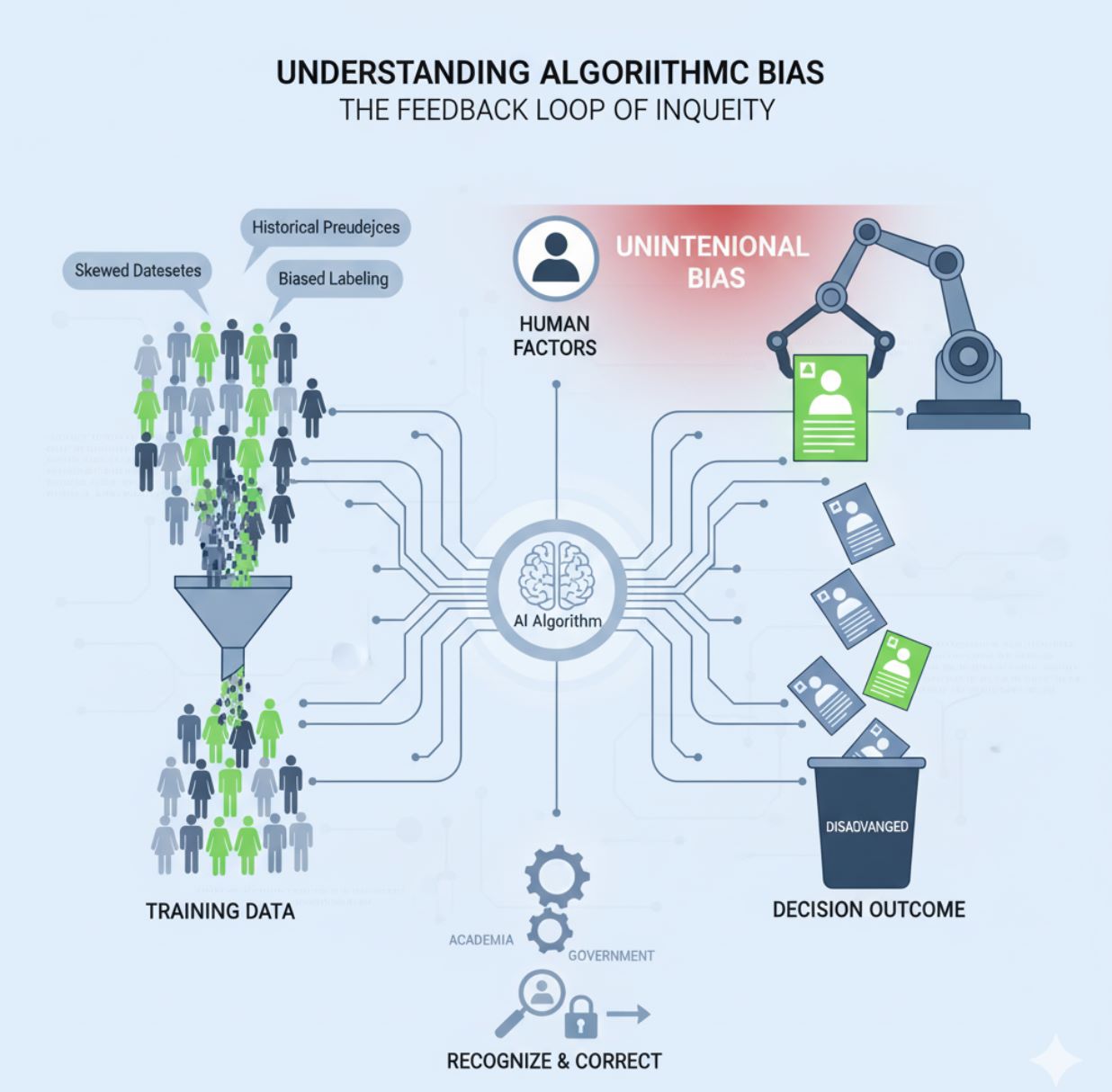

Kecerdasan Buatan (AI) semakin tertanam dalam kehidupan harian kita – dari keputusan pengambilan pekerja hingga penjagaan kesihatan dan penguatkuasaan undang-undang – tetapi penggunaannya menimbulkan kebimbangan mengenai bias algoritma. Bias algoritma merujuk kepada prasangka sistematik dan tidak adil dalam hasil sistem AI, yang sering mencerminkan stereotaip dan ketidaksamaan sosial.

Secara ringkas, algoritma AI boleh tanpa sengaja mengulangi bias manusia yang terdapat dalam data latihan atau reka bentuknya, menyebabkan hasil yang diskriminasi.

Di bawah, kami meneroka punca bias algoritma, contoh impaknya dalam dunia sebenar, dan bagaimana dunia berusaha menjadikan AI lebih adil.

Memahami Bias Algoritma dan Puncanya

Bias algoritma biasanya timbul bukan kerana AI "ingin" mendiskriminasi, tetapi kerana faktor manusia. Sistem AI belajar dari data dan mengikuti peraturan yang dibuat oleh manusia – dan manusia mempunyai bias (sering tidak sedar). Jika data latihan berat sebelah atau mencerminkan prasangka sejarah, AI kemungkinan akan mempelajari corak tersebut.

Data Latihan Berat Sebelah

Prasangka sejarah yang tertanam dalam set data

- Set data tidak lengkap

- Sampel tidak mewakili

- Corak diskriminasi sejarah

Pelabelan Data Berat Sebelah

Prasangka manusia dalam anotasi data

- Kategori subjektif

- Andaian budaya

- Stereotaip tidak sedar

Isu Pengoptimuman

Algoritma dioptimumkan untuk ketepatan berbanding keadilan

- Fokus ketepatan keseluruhan

- Mengabaikan kumpulan minoriti

- Mengabaikan pertukaran keadilan

Algoritma AI mewarisi bias penciptanya dan data kecuali langkah sengaja diambil untuk mengenal pasti dan membetulkan bias tersebut.

— Penemuan Penyelidikan Utama

Perlu diingat bahawa bias algoritma biasanya tidak disengajakan. Organisasi sering menggunakan AI untuk membuat keputusan lebih objektif, tetapi jika mereka "memberi makan" sistem dengan maklumat berat sebelah atau gagal mempertimbangkan keadilan dalam reka bentuk, hasilnya masih boleh tidak adil. Bias AI boleh mengagihkan peluang secara tidak adil dan menghasilkan keputusan yang tidak tepat, memberi kesan negatif kepada kesejahteraan orang dan merosakkan kepercayaan terhadap AI.

Memahami mengapa bias berlaku adalah langkah pertama ke arah penyelesaian – dan ini adalah langkah yang kini diambil serius oleh akademia, industri, dan kerajaan di seluruh dunia.

Contoh Dunia Sebenar Bias AI

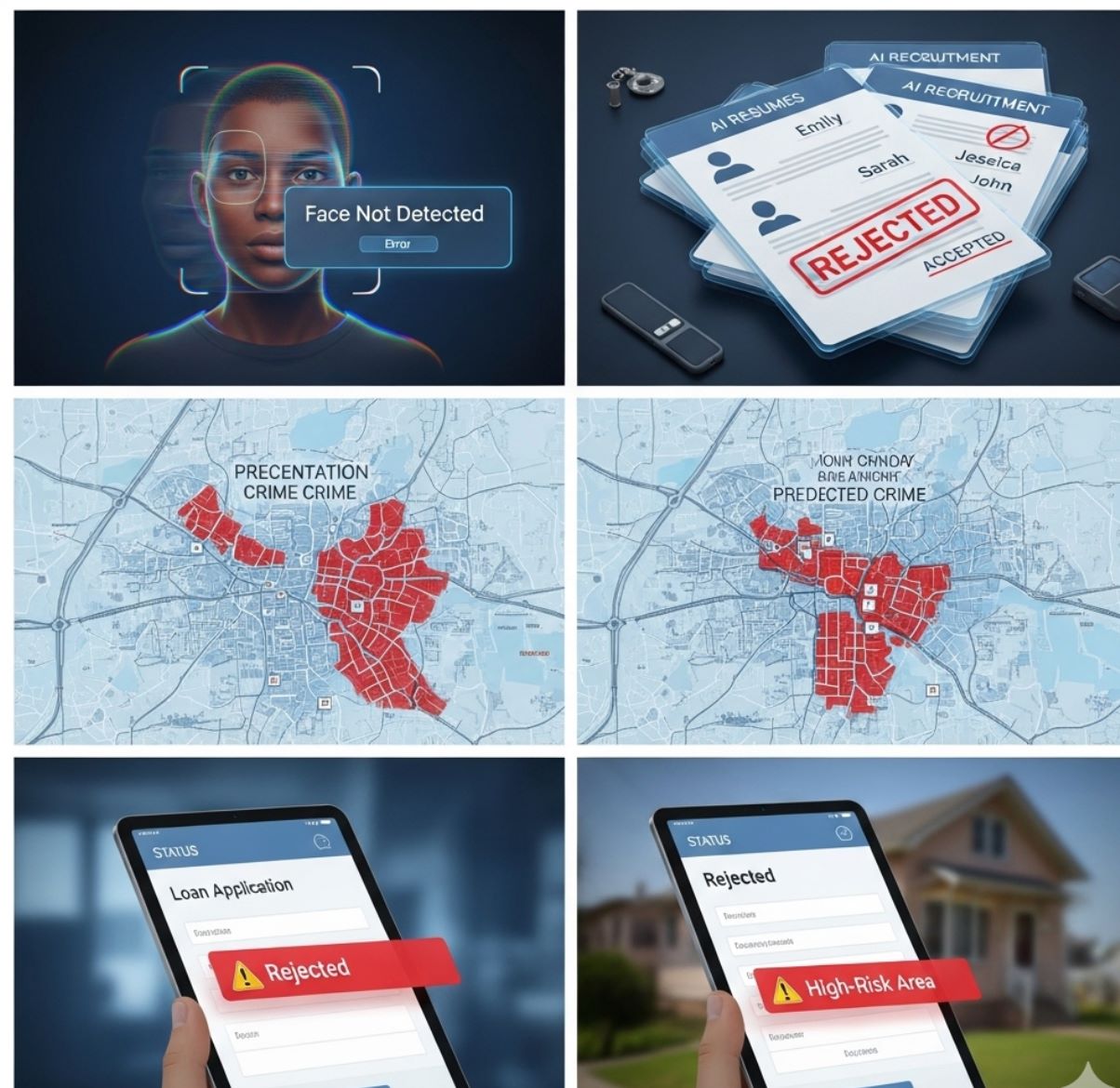

Bias dalam AI bukan hanya kebimbangan hipotetikal; banyak kes dunia sebenar telah mendedahkan bagaimana bias algoritma boleh menyebabkan diskriminasi. Contoh ketara bias AI dalam pelbagai sektor termasuk:

Sistem Keadilan Jenayah

Kes: Algoritma ramalan recidivisme di AS

Impak: Berat sebelah terhadap defendan Kulit Hitam, sering menganggap defendan Kulit Hitam berisiko tinggi dan defendan kulit putih berisiko rendah, memburukkan ketidaksamaan kaum dalam hukuman.

Akibat: Memperkuat bias sejarah dalam penguatkuasaan undang-undang dan mahkamah

Pengambilan & Rekrutmen

Kes: Alat perekrutan AI Amazon

Impak: Dihentikan selepas diskriminasi terhadap wanita. Dilatih berdasarkan resume masa lalu yang kebanyakannya lelaki, menurunkan resume yang mengandungi perkataan "wanita" atau kolej wanita sahaja.

Akibat: Akan menapis wanita yang layak untuk pekerjaan teknikal secara tidak adil

Bias Teknologi Pengenalan Wajah

Teknologi pengenalan wajah menunjukkan bias ketara dalam ketepatan mengikut garis demografi. Kajian menyeluruh 2019 oleh Institut Piawaian dan Teknologi Nasional AS (NIST) mendedahkan ketidaksamaan membimbangkan:

- Pengenalan positif palsu untuk wajah Asia dan Afrika-Amerika adalah 10 hingga 100 kali lebih mungkin berbanding wajah Kaukasia

- Kadar salah kenal tertinggi adalah untuk wanita Kulit Hitam dalam carian satu-ke-banyak

- Bias berbahaya ini telah menyebabkan orang tidak bersalah ditangkap secara salah

Bias AI Generatif dan Kandungan

Walaupun sistem AI terkini tidak kebal. Kajian UNESCO 2024 mendedahkan model bahasa besar sering menghasilkan stereotaip gender dan kaum yang regresif:

Fokus Domestik

- Digambarkan dalam peranan domestik 4 kali lebih kerap

- Berhubung dengan "rumah" dan "kanak-kanak"

- Stereotaip gender tradisional

Fokus Profesional

- Dikaitkan dengan "eksekutif" dan "gaji"

- Berhubung dengan kemajuan "kerjaya"

- Terminologi kepimpinan

Risiko AI bertambah di atas ketidaksamaan sedia ada, menyebabkan kemudaratan lebih lanjut kepada kumpulan yang sudah terpinggir.

— Amaran UNESCO

Contoh ini menegaskan bahawa bias algoritma bukan masalah jauh atau jarang – ia berlaku dalam pelbagai domain hari ini. Dari peluang pekerjaan hingga keadilan, penjagaan kesihatan hingga maklumat dalam talian, sistem AI berat sebelah boleh menggandakan dan bahkan memperkuat diskriminasi sedia ada.

Kemudaratan sering ditanggung oleh kumpulan yang secara sejarah kurang bernasib baik, menimbulkan kebimbangan serius tentang etika dan hak asasi manusia. Memandangkan jutaan orang kini menggunakan AI generatif dalam kehidupan harian, walaupun bias halus dalam kandungan boleh memperkuat ketidaksamaan dalam dunia sebenar, mengukuhkan stereotaip secara meluas.

Mengapa Bias AI Penting?

Taruhannya tinggi untuk menangani bias AI. Jika dibiarkan tanpa kawalan, algoritma berat sebelah boleh mengukuhkan diskriminasi sistemik di sebalik penampilan neutral teknologi. Keputusan yang dibuat (atau dipandu) oleh AI – siapa yang diambil bekerja, siapa yang mendapat pinjaman atau parol, bagaimana polis menyasarkan pengawasan – membawa akibat sebenar kepada kehidupan manusia.

Impak Hak Asasi Manusia

Menghakis prinsip kesaksamaan dan tiada diskriminasi

- Peluang dinafikan

- Ketidaksamaan ekonomi

- Ancaman kepada kebebasan peribadi

Erosi Kepercayaan

Merosakkan keyakinan awam terhadap teknologi

- Pengurangan penggunaan AI

- Kerosakan reputasi

- Halangan inovasi

Manfaat Berkurangan

Mengehadkan potensi positif AI

- Keputusan tidak tepat

- Keberkesanan berkurangan

- Akses tidak sama rata kepada manfaat

Jika keputusan itu tidak adil memihak kepada jantina, kaum, atau komuniti tertentu, ketidaksamaan sosial akan melebar. Ini boleh menyebabkan peluang dinafikan, ketidaksamaan ekonomi, atau bahkan ancaman kepada kebebasan dan keselamatan peribadi bagi kumpulan yang terjejas.

Dalam gambaran besar, bias algoritma menghakis hak asasi manusia dan keadilan sosial, bertentangan dengan prinsip kesaksamaan dan tiada diskriminasi yang dijunjung oleh masyarakat demokratik.

Selain itu, bias algoritma boleh mengurangkan manfaat potensi AI. AI berpotensi meningkatkan kecekapan dan pembuatan keputusan, tetapi jika hasilnya diskriminasi atau tidak tepat untuk sebahagian populasi, ia tidak dapat mencapai impak positif sepenuhnya.

Contohnya, alat kesihatan AI yang berfungsi baik untuk satu demografi tetapi kurang baik untuk yang lain tidak benar-benar berkesan atau boleh diterima. Seperti yang diperhatikan oleh OECD, bias dalam AI menghadkan peluang secara tidak adil dan boleh merugikan reputasi perniagaan serta kepercayaan pengguna.

Ringkasnya, menangani bias bukan sahaja kewajipan moral tetapi juga kritikal untuk memanfaatkan manfaat AI secara adil untuk semua individu.

Strategi Mengurangkan Bias AI

Oleh kerana bias algoritma kini diiktiraf secara meluas, pelbagai strategi dan amalan terbaik telah muncul untuk mengurangkannya. Memastikan sistem AI adil dan inklusif memerlukan tindakan pada pelbagai peringkat pembangunan dan pelaksanaan:

Amalan Data Lebih Baik

Kerana data berat sebelah adalah punca utama, meningkatkan kualiti data adalah kunci. Ini bermakna menggunakan set data latihan yang pelbagai dan mewakili yang merangkumi kumpulan minoriti, dan memeriksa dengan teliti untuk ketidakseimbangan atau kekurangan.

- Gunakan set data latihan yang pelbagai dan mewakili yang merangkumi kumpulan minoriti

- Audit data secara teliti untuk bias sejarah (hasil berbeza mengikut kaum/jantina)

- Betulkan atau seimbangkan data berat sebelah sebelum melatih model

- Gunakan augmentasi data atau data sintetik untuk kumpulan kurang diwakili

- Melaksanakan pemantauan berterusan terhadap output AI untuk mengesan isu bias awal

Reka Bentuk Algoritma Adil

Pembangun harus secara sedar mengintegrasikan had keadilan dan teknik mitigasi bias dalam latihan model. Ini mungkin termasuk menggunakan algoritma yang boleh disesuaikan untuk keadilan (bukan hanya ketepatan).

Gunakan Teknik Keadilan

Gunakan algoritma yang disesuaikan untuk keadilan, terapkan teknik untuk menyamakan kadar kesilapan antara kumpulan, beratkan semula data, atau ubah ambang keputusan dengan bijak.

Gunakan Alat Ujian Bias

Manfaatkan alat dan rangka kerja sumber terbuka untuk menguji model bagi bias dan membuat pelarasan semasa pembangunan.

Tetapkan Kriteria Keadilan

Bekerjasama dengan pakar domain dan komuniti terjejas ketika menetapkan kriteria keadilan, kerana terdapat pelbagai definisi matematik keadilan yang kadang-kadang bertentangan.

Pengawasan Manusia dan Akauntabiliti

Tiada sistem AI harus beroperasi tanpa akauntabiliti manusia. Pengawasan manusia penting untuk mengesan dan membetulkan bias yang mungkin dipelajari mesin.

Manusia dalam Gelung

- Penilai yang menyemak calon yang disaring AI

- Hakim yang mempertimbangkan skor risiko AI dengan berhati-hati

- Profesional perubatan yang mengesahkan diagnosis AI

Langkah Akauntabiliti

- Audit berkala keputusan AI

- Penilaian impak bias

- Penjelasan logik AI

- Penetapan tanggungjawab yang jelas

Organisasi mesti ingat bahawa mereka bertanggungjawab terhadap keputusan yang dibuat oleh algoritma mereka sama seperti keputusan yang dibuat oleh pekerja. Ketelusan adalah tiang penting di sini: bersikap terbuka tentang bagaimana sistem AI berfungsi dan had yang diketahui boleh membina kepercayaan dan membolehkan pemeriksaan bebas.

Beberapa bidang kuasa kini bergerak ke arah menghendaki ketelusan untuk keputusan algoritma berisiko tinggi (mengkehendaki agensi awam mendedahkan bagaimana algoritma digunakan dalam keputusan yang mempengaruhi rakyat). Matlamatnya adalah memastikan AI menyokong pembuatan keputusan manusia tanpa menggantikan pertimbangan etika atau tanggungjawab undang-undang.

Pasukan Pelbagai dan Peraturan

Pembangunan Inklusif

Semakin ramai pakar menekankan nilai kepelbagaian dalam kalangan pembangun dan pihak berkepentingan AI. Produk AI mencerminkan perspektif dan titik buta mereka yang membinanya.

Peraturan dan Garis Panduan Etika

Kerajaan dan badan antarabangsa kini aktif campur tangan untuk memastikan bias AI ditangani:

- Cadangan UNESCO mengenai Etika AI (2021): Rangka kerja global pertama yang diterima pakai secara sebulat suara, menegaskan prinsip ketelusan, keadilan, dan tiada diskriminasi

- Akta AI EU (2024): Menjadikan pencegahan bias sebagai keutamaan, memerlukan penilaian ketat untuk keadilan dalam sistem AI berisiko tinggi

- Tindakan Kerajaan Tempatan: Lebih daripada sedozen bandar utama (San Francisco, Boston, Minneapolis) telah mengharamkan penggunaan pengenalan wajah oleh polis kerana bias kaum

Jalan Ke Hadapan: Membina AI Beretika

AI dan bias algoritma adalah cabaran global yang baru kita mula tangani dengan berkesan. Contoh dan usaha di atas jelas menunjukkan bahawa bias AI bukan isu kecil – ia menjejaskan peluang ekonomi, keadilan, kesihatan, dan perpaduan sosial di seluruh dunia.

Mencapai ini memerlukan kewaspadaan berterusan: sentiasa menguji sistem AI untuk bias, memperbaiki data dan algoritma, melibatkan pihak berkepentingan yang pelbagai, dan mengemas kini peraturan mengikut evolusi teknologi.

Intinya, memerangi bias algoritma adalah tentang menyelaraskan AI dengan nilai kesaksamaan dan keadilan kita. Seperti yang dinyatakan oleh Pengarah Jeneral UNESCO Audrey Azoulay, walaupun "bias kecil dalam kandungan [AI] boleh memperkuat ketidaksamaan dalam dunia sebenar secara signifikan".

Bias kecil dalam kandungan AI boleh memperkuat ketidaksamaan dalam dunia sebenar secara signifikan.

— Audrey Azoulay, Pengarah Jeneral UNESCO

Oleh itu, usaha mencapai AI tanpa bias adalah penting untuk memastikan teknologi mengangkat semua lapisan masyarakat dan bukan mengukuhkan prasangka lama.

Dengan mengutamakan prinsip etika dalam reka bentuk AI – dan menyokongnya dengan tindakan dan dasar konkrit – kita boleh memanfaatkan kuasa inovatif AI sambil melindungi maruah manusia.

No comments yet. Be the first to comment!