MI és algoritmikus elfogultság

A MI algoritmusokat egyre szélesebb körben használják különböző területeken, a toborzástól a pénzügyekig, de ezek kockázatot jelentenek az elfogultságra és diszkriminációra. Az automatizált MI döntések tükrözhetik vagy felerősíthetik a társadalmi igazságtalanságokat, ha a tanító adatok elfogultak vagy nem sokszínűek. Az algoritmikus elfogultság megértése segíti a vállalkozásokat, fejlesztőket és felhasználókat az igazságosabb, átláthatóbb MI rendszerek azonosításában, kezelésében és építésében.

Érdekli az algoritmikus elfogultság a MI-ben? Csatlakozzon az INVIAI-hoz, hogy többet megtudjon az MI és algoritmikus elfogultság témájáról ebben a cikkben!

A mesterséges intelligencia (MI) egyre inkább beépül mindennapjainkba – a toborzási döntésektől az egészségügyön át a rendészetig –, de használata aggodalmakat vet fel az algoritmikus elfogultság miatt. Az algoritmikus elfogultság az MI rendszerek kimeneteiben megjelenő rendszerszintű és igazságtalan előítéletekre utal, amelyek gyakran társadalmi sztereotípiákat és egyenlőtlenségeket tükröznek.

Lényegében egy MI algoritmus akaratlanul is reprodukálhatja az emberi elfogultságokat, amelyek a tanító adataiban vagy a tervezésében jelen vannak, ami diszkriminatív eredményekhez vezethet.

Az alábbiakban megvizsgáljuk, mi okozza az algoritmikus elfogultságot, valós példákat mutatunk be annak hatásairól, és azt, hogyan törekszik a világ az MI igazságosabbá tételére.

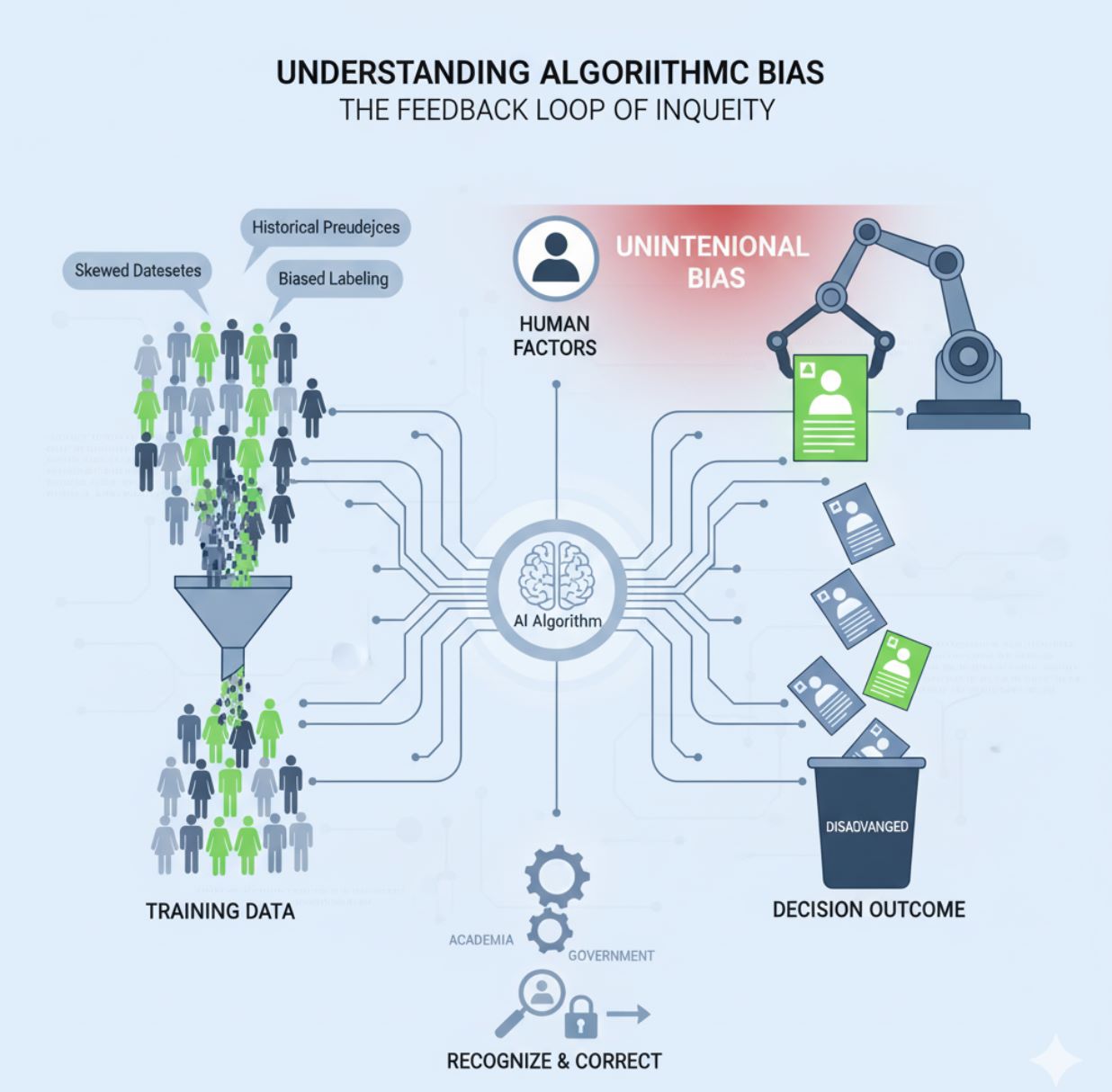

Az algoritmikus elfogultság megértése és okai

Az algoritmikus elfogultság általában nem azért alakul ki, mert az MI "akar" diszkriminálni, hanem emberi tényezők miatt. Az MI rendszerek adatból tanulnak és emberek által létrehozott szabályokat követnek – az emberek pedig rendelkeznek (gyakran tudattalan) elfogultságokkal. Ha a tanító adatok torzítottak vagy történelmi előítéleteket tükröznek, az MI valószínűleg ezeket a mintákat tanulja meg.

Elfogult tanító adatok

Történelmi előítéletek az adatkészletekben

- Hiányos adatkészletek

- Nem reprezentatív minták

- Történelmi diszkriminációs minták

Elfogult adatcímkézés

Emberi előítéletek az adatannotációban

- Szubjektív kategorizálás

- Kulturális feltételezések

- Tudattalan sztereotipizálás

Optimalizációs problémák

Az algoritmusok pontosságra optimalizálnak a méltányosság helyett

- Általános pontosságra fókuszálás

- Elhanyagolt kisebbségi csoportok

- Figyelmen kívül hagyott méltányossági kompromisszumok

Az MI algoritmusok öröklik alkotóik és adataik elfogultságait, hacsak nem tesznek szándékos lépéseket ezek felismerésére és korrigálására.

— Fő kutatási megállapítás

Fontos megjegyezni, hogy az algoritmikus elfogultság általában akaratlan. A szervezetek gyakran azért alkalmaznak MI-t, hogy objektívebb döntéseket hozzanak, de ha elfogult információkat "etetnek" a rendszerrel, vagy nem veszik figyelembe az egyenlőséget a tervezés során, az eredmény mégis igazságtalan lehet. Az MI elfogultsága igazságtalanul oszthat el lehetőségeket és pontatlan eredményeket produkálhat, ami negatívan befolyásolja az emberek jólétét és aláássa a MI-be vetett bizalmat.

Az elfogultság okainak megértése az első lépés a megoldások felé – és ezt a lépést a tudomány, az ipar és a kormányok világszerte komolyan veszik.

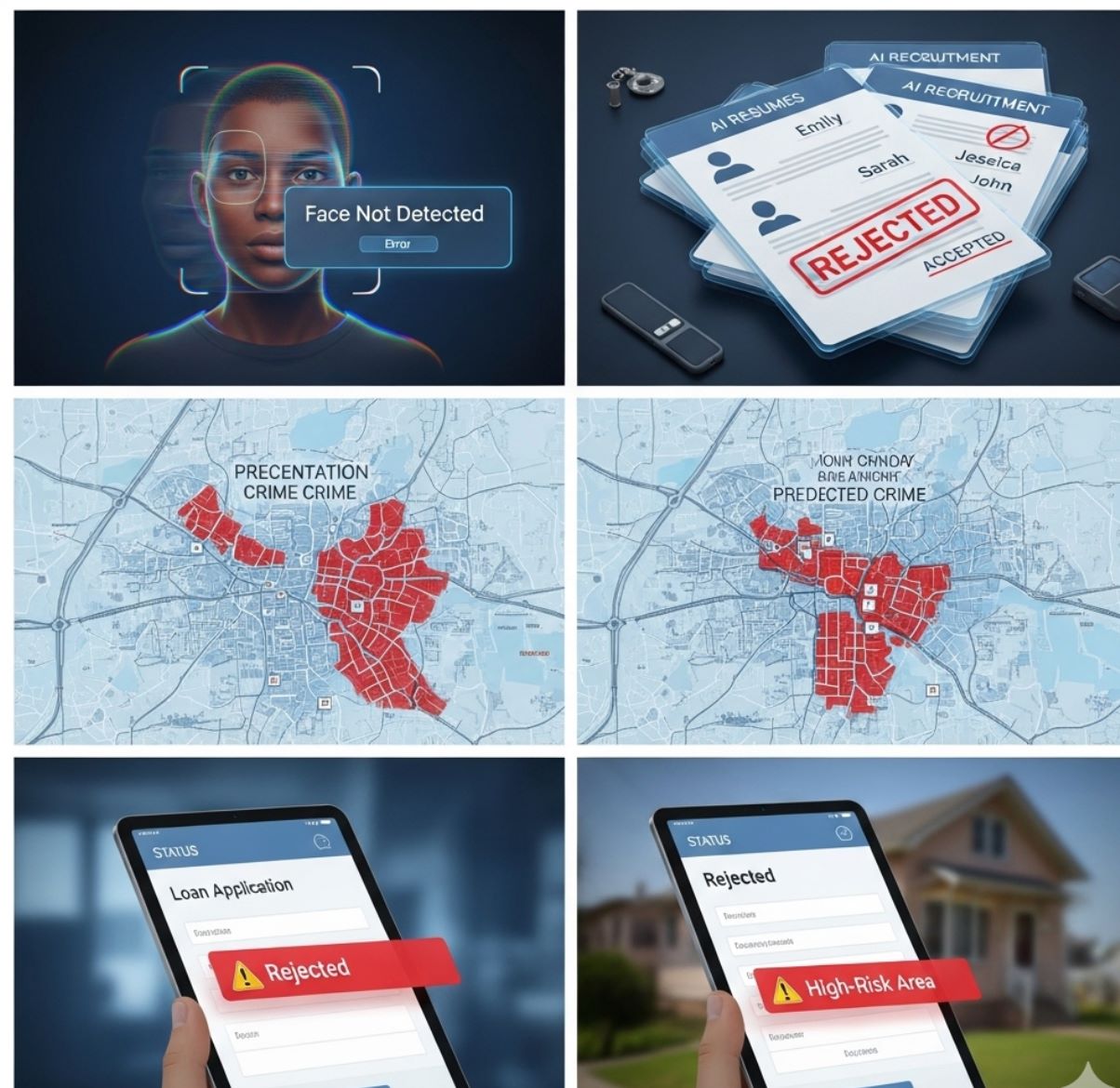

Valós példák az MI elfogultságára

Az MI elfogultsága nem csupán elméleti probléma; számos valós eset mutatta meg, hogyan vezethet az algoritmikus elfogultság diszkriminációhoz. Kiemelkedő példák az MI elfogultságára különböző szektorokban:

Büntető igazságszolgáltatás

Eset: Egy amerikai visszaesési kockázatot előrejelző algoritmus

Hatás: Feketék ellen elfogult volt, gyakran magas kockázatúnak ítélte a fekete vádlottakat, míg azokat, akik fehérek, alacsony kockázatúnak, súlyosbítva a faji különbségeket az ítélkezésben.

Következmény: Felerősítette a rendőrség és bíróságok történelmi elfogultságait

Toborzás és felvétel

Eset: Az Amazon MI alapú toborzó eszköze

Hatás: Eltávolították, mert diszkriminált a nőkkel szemben. Főként férfiak önéletrajzain tanították, így hátrányba hozta azokat, amelyekben "női" vagy kizárólag női főiskolák szerepeltek.

Következmény: Igazságtalanul szűrte volna ki a technikai állásokra alkalmas nőket

Arcfelismerő technológia elfogultsága

Az arcfelismerő technológia jelentős elfogultságot mutatott a pontosságban demográfiai csoportok között. Egy átfogó 2019-es tanulmány az amerikai Nemzeti Szabványügyi és Technológiai Intézet (NIST) részéről riasztó különbségeket tárt fel:

- Ázsiai és afroamerikai arcok hamis pozitív azonosítása 10-100-szor valószínűbb volt, mint kaukázusi arcok esetében

- A legmagasabb téves azonosítási arány fekete nőknél volt egy-az-több keresésekben

- Ez a veszélyes elfogultság már ártatlan emberek téves letartóztatásához vezetett

Generatív MI és tartalmi elfogultság

Még a legújabb MI rendszerek sem mentesek. Egy 2024-es UNESCO tanulmány kimutatta, hogy a nagy nyelvi modellek gyakran regresszív nemi és faji sztereotípiákat generálnak:

Háztartási fókusz

- Háztartási szerepekben 4-szer gyakrabban ábrázolva

- Kapcsolódás a "otthon" és "gyerekek" fogalmakhoz

- Hagyományos nemi sztereotípiák

Szakmai fókusz

- Kapcsolódás az "vezetői" és "fizetés" fogalmakhoz

- Kapcsolódás a "karrier" előrehaladáshoz

- Vezetői terminológia

Az MI kockázatai ráadásul meglévő egyenlőtlenségekre rakódnak rá, további károkat okozva már amúgy is marginalizált csoportoknak.

— UNESCO figyelmeztetés

Ezek a példák hangsúlyozzák, hogy az algoritmikus elfogultság nem távoli vagy ritka probléma – ma is jelen van számos területen. Az álláslehetőségektől az igazságszolgáltatáson át az egészségügyig és az online információkig az elfogult MI rendszerek képesek reprodukálni és akár felerősíteni a meglévő diszkriminációt.

A kár gyakran történelmileg hátrányos helyzetű csoportokat érint, ami súlyos etikai és emberi jogi aggályokat vet fel. Tekintettel arra, hogy milliók használják a generatív MI-t a mindennapokban, még a finom elfogultságok is felerősíthetik a valós világ egyenlőtlenségeit, és nagy léptékben erősíthetik a sztereotípiákat.

Miért fontos az MI elfogultság?

Az MI elfogultság kezelése létfontosságú. Ha nem ellenőrzik, az elfogult algoritmusok megerősíthetik a rendszerszintű diszkriminációt a technológiai semlegesség látszatával. Az MI által hozott (vagy irányított) döntések – hogy kit vesznek fel, ki kap kölcsönt vagy feltételes szabadlábra helyezést, hogyan célozza meg a rendőrség a megfigyelést – valós következményekkel járnak az emberek életére.

Emberi jogi hatás

Aláássa az egyenlőség és a diszkriminációmentesség elveit

- Lehetőségek megtagadása

- Gazdasági egyenlőtlenségek

- Személyes szabadság fenyegetése

Bizalom eróziója

Rontja a közbizalmat a technológiában

- Csökkent MI elfogadás

- Hírnév károsodás

- Innovációs akadályok

Csökkent előnyök

Korlátozza az MI pozitív potenciálját

- Pontatlan eredmények

- Csökkent hatékonyság

- Egyenlőtlen hozzáférés az előnyökhöz

Ha ezek a döntések igazságtalanul torzítanak bizonyos nemek, faji vagy közösségi csoportok ellen, a társadalmi egyenlőtlenségek nőnek. Ez lehetőségek megtagadásához, gazdasági különbségekhez vagy akár személyes szabadság és biztonság fenyegetéséhez vezethet az érintett csoportok számára.

Szélesebb értelemben az algoritmikus elfogultság aláássa az emberi jogokat és a társadalmi igazságosságot, ellentétes az egyenlőség és a diszkriminációmentesség demokratikus elveivel.

Ezenkívül az algoritmikus elfogultság csökkentheti az MI potenciális előnyeit. Az MI ígérete az, hogy javítja a hatékonyságot és a döntéshozatalt, de ha eredményei diszkriminatívak vagy pontatlanok a népesség egyes csoportjai számára, nem érheti el teljes pozitív hatását.

Például egy olyan MI egészségügyi eszköz, amely egy demográfiai csoport számára jól működik, de mások számára rosszul, nem igazán hatékony vagy elfogadható. Az OECD megfigyelése szerint az MI elfogultsága igazságtalanul korlátozza a lehetőségeket, és kárt okozhat a vállalatok hírnevének és a felhasználók bizalmának.

Röviden, az elfogultság kezelése nemcsak erkölcsi kötelesség, hanem kritikus az MI előnyeinek igazságos kihasználásához minden egyén számára.

Stratégiák az MI elfogultság csökkentésére

Mivel az algoritmikus elfogultságot ma már széles körben elismerik, számos stratégia és bevált gyakorlat alakult ki annak mérséklésére. Az MI rendszerek igazságosságának és befogadóképességének biztosítása több fejlesztési és bevezetési szakaszban igényel cselekvést:

Jobb adatkezelési gyakorlatok

Mivel az elfogult adatok az egyik fő ok, az adatminőség javítása kulcsfontosságú. Ez azt jelenti, hogy sokszínű, reprezentatív tanító adatkészleteket kell használni, amelyek tartalmazzák a kisebbségi csoportokat, és alaposan ellenőrizni kell a torzulásokat vagy hiányosságokat.

- Használjon sokszínű, reprezentatív tanító adatkészleteket, amelyek tartalmazzák a kisebbségi csoportokat

- Alaposan auditálja az adatokat történelmi elfogultságok (faji/nemi eltérések) szempontjából

- Javítsa vagy kiegyensúlyozza az elfogult adatokat a modell tanítása előtt

- Alkalmazzon adatbővítést vagy szintetikus adatokat az alulreprezentált csoportok számára

- Vezessen be folyamatos megfigyelést az MI kimenetein, hogy korán jelezze az elfogultsági problémákat

Méltányos algoritmus tervezés

A fejlesztőknek tudatosan kell integrálniuk méltányossági korlátokat és elfogultságcsökkentő technikákat a modell tanításába. Ez magában foglalhatja olyan algoritmusok használatát, amelyeket méltányosságra lehet hangolni (nem csak pontosságra).

Alkalmazzon méltányossági technikákat

Használjon méltányosságra hangolt algoritmusokat, alkalmazzon technikákat a hibaarányok kiegyenlítésére csoportok között, súlyozza át az adatokat vagy gondosan módosítsa a döntési küszöböket.

Használjon elfogultság tesztelő eszközöket

Használjon nyílt forráskódú eszközöket és keretrendszereket a modellek elfogultságának tesztelésére és a fejlesztés közbeni korrekciókra.

Határozza meg a méltányossági kritériumokat

Dolgozzon együtt szakértőkkel és érintett közösségekkel a méltányossági kritériumok meghatározásában, mivel többféle matematikai definíció létezik, amelyek néha ellentmondanak egymásnak.

Emberi felügyelet és elszámoltathatóság

Egyetlen MI rendszer sem működhet emberi elszámoltathatóság nélkül. Az emberi felügyelet kulcsfontosságú az elfogultságok felismeréséhez és korrigálásához, amelyeket a gép tanulhat.

Ember a folyamatban

- Toborzók, akik felülvizsgálják az MI által szűrt jelölteket

- Bírák, akik óvatosan mérlegelik az MI kockázati pontszámait

- Orvosok, akik validálják az MI diagnózisait

Elszámoltathatósági intézkedések

- Rendszeres auditok az MI döntésein

- Elfogultság hatásvizsgálatok

- Magyarázható MI érvelés

- Világos felelősségvállalás

A szervezeteknek emlékezniük kell arra, hogy felelősek az algoritmusaik által hozott döntésekért, mintha azokat alkalmazottak hozták volna. Az átláthatóság is alapvető: nyitottnak lenni az MI rendszer működéséről és ismert korlátairól bizalmat épít és lehetővé teszi a független ellenőrzést.

Néhány joghatóság már a magas kockázatú algoritmikus döntések átláthatóságának kötelezővé tételére törekszik (közintézményeknek kötelezővé téve az algoritmusok használatának nyilvánosságra hozatalát a polgárokat érintő döntésekben). A cél az, hogy az MI kiegészítse az emberi döntéshozatalt anélkül, hogy helyettesítené az etikai megítélést vagy jogi felelősséget.

Sokszínű csapatok és szabályozás

Befogadó fejlesztés

Egyre több szakértő hangsúlyozza az AI fejlesztők és érintettek sokszínűségének értékét. Az MI termékek tükrözik az alkotóik nézőpontjait és vakfoltjait.

Szabályozás és etikai irányelvek

A kormányok és nemzetközi szervezetek aktívan lépnek fel az MI elfogultságának kezelésére:

- UNESCO MI etikai ajánlása (2021): Az első globális keretrendszer, amely egyhangúlag elfogadott, és az átláthatóság, méltányosság és diszkriminációmentesség elveit foglalja magában

- EU MI törvény (2024): Prioritássá teszi az elfogultság megelőzését, szigorú méltányossági értékeléseket követel meg a magas kockázatú MI rendszereknél

- Helyi kormányzati intézkedések: Több mint egy tucat nagyváros (San Francisco, Boston, Minneapolis) betiltotta a rendőrség arcfelismerő technológiájának használatát a faji elfogultság miatt

A jövő útja: etikus MI építése

Az MI és algoritmikus elfogultság globális kihívás, amelyet csak most kezdünk hatékonyan kezelni. A fenti példák és erőfeszítések világossá teszik, hogy az MI elfogultság nem egy szűk körű probléma – gazdasági lehetőségeket, igazságszolgáltatást, egészségügyet és társadalmi kohéziót érint világszerte.

Ennek elérése folyamatos éberséget igényel: az MI rendszerek rendszeres tesztelését elfogultság szempontjából, az adatok és algoritmusok javítását, sokszínű érintettek bevonását, valamint a szabályozások frissítését a technológia fejlődésével.

Alapvetően az algoritmikus elfogultság elleni küzdelem az MI összehangolása az egyenlőség és méltányosság értékeivel. Ahogy Audrey Azoulay, az UNESCO főigazgatója megjegyezte, még a "kis elfogultságok az [MI] tartalomban jelentősen felerősíthetik a valós világ egyenlőtlenségeit".

A kis elfogultságok az MI tartalomban jelentősen felerősíthetik a valós világ egyenlőtlenségeit.

— Audrey Azoulay, az UNESCO főigazgatója

Ezért az elfogulatlan MI törekvése kritikus annak biztosításához, hogy a technológia minden társadalmi réteget felemeljen, ne pedig régi előítéleteket erősítsen.

Az etikai elvek előtérbe helyezésével az MI tervezésében – és ezek konkrét intézkedésekkel, politikákkal való alátámasztásával – kihasználhatjuk az MI innovációs erejét, miközben megóvjuk az emberi méltóságot.

No comments yet. Be the first to comment!