القواعد الذهبية عند استخدام الذكاء الاصطناعي

يتطلب تطبيق الذكاء الاصطناعي بفعالية استراتيجية وحذرًا. ستساعدك هذه القواعد الذهبية العشر على زيادة الإنتاجية، وتجنب الأخطاء الشائعة، واستخدام الذكاء الاصطناعي بأمان في المهام اليومية.

يقدم الذكاء الاصطناعي (AI) أدوات قوية لتعزيز الإبداع والإنتاجية وحل المشكلات، ولكن يجب علينا استخدامه بحكمة. يؤكد الخبراء أن الذكاء الاصطناعي يجب أن يحترم القيم الإنسانية الأساسية مثل حقوق الإنسان والكرامة والشفافية والعدالة.

للحصول على أقصى استفادة من الذكاء الاصطناعي وتجنب المخاطر، اتبع هذه القواعد الذهبية العشر عند استخدام الذكاء الاصطناعي.

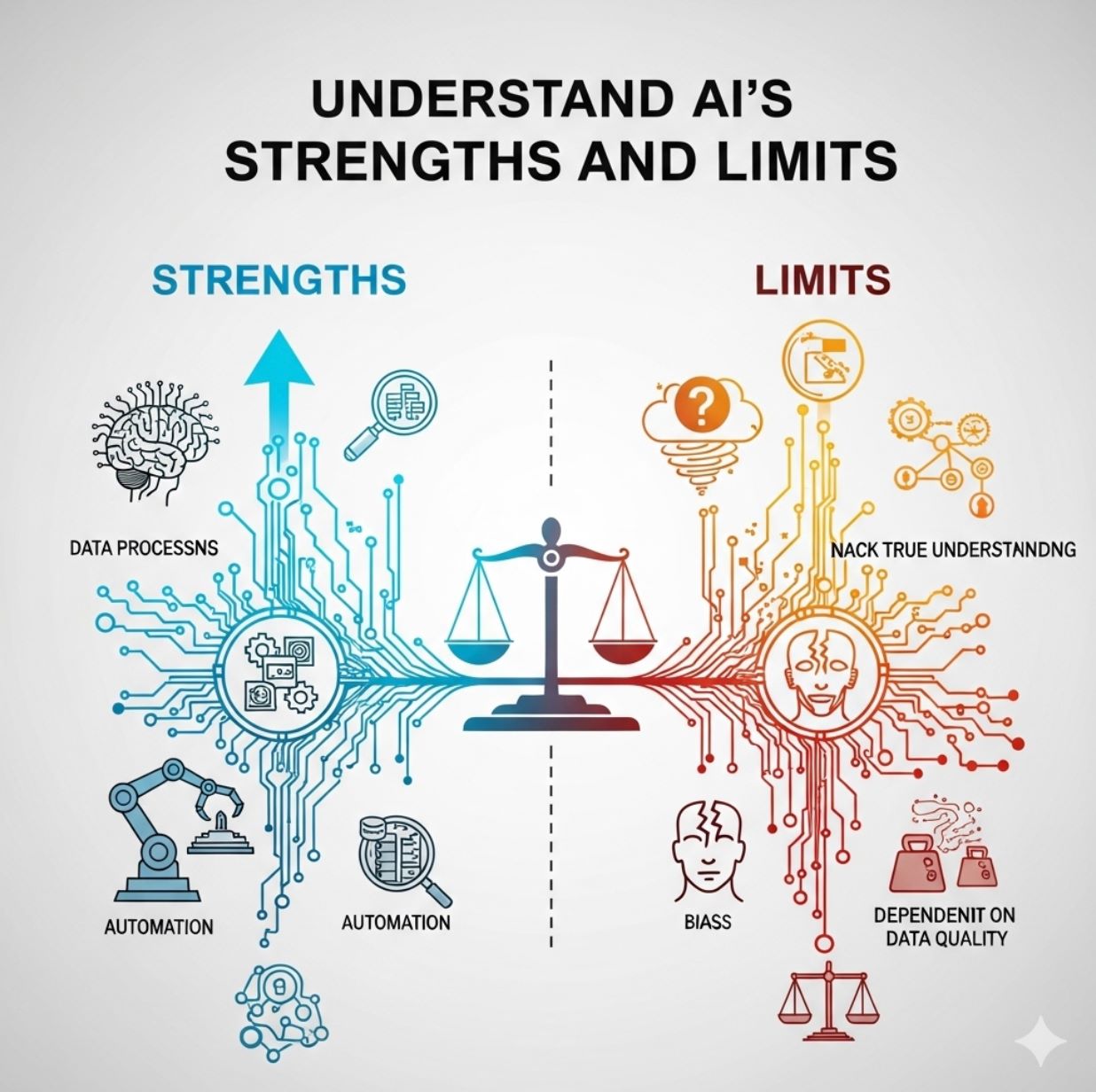

- 1. فهم نقاط القوة والحدود للذكاء الاصطناعي

- 2. التواصل بوضوح مع التعليمات

- 3. حماية الخصوصية وأمن البيانات

- 4. تحقق دائمًا من مخرجات الذكاء الاصطناعي

- 5. كن واعيًا للتحيز والعدالة

- 6. احتفظ بالعنصر البشري في العملية (المسؤولية)

- 7. استخدم الذكاء الاصطناعي بأخلاق وقانونية

- 8. كن شفافًا بشأن استخدام الذكاء الاصطناعي

- 9. استمر في التعلم وابقَ مطلعًا

- 10. استخدم أدوات موثوقة واتبع الإرشادات

- 11. النقاط الرئيسية

1. فهم نقاط القوة والحدود للذكاء الاصطناعي

الذكاء الاصطناعي هو مساعد ذكي، وليس عرافًا يعلم كل شيء. يمكنه توليد الأفكار وتوفير الوقت، لكنه قد يرتكب أخطاء أو "يختلق" معلومات.

ما يبرع فيه الذكاء الاصطناعي

- توليد أفكار إبداعية بسرعة

- معالجة كميات كبيرة من البيانات

- أتمتة المهام المتكررة

- توفير التوفر على مدار الساعة

ما يواجه الذكاء الاصطناعي صعوبة فيه

- اتخاذ قرارات حاسمة بشكل مستقل

- فهم السياق مثل البشر

- تقديم معلومات دقيقة 100%

- استبدال الحكم البشري

للقرارات المهمة (مثل الصحة أو المالية)، شارك خبراء حقيقيين – يمكن للذكاء الاصطناعي المساعدة في البحث لكنه لا يجب أن يحل محل الحكم البشري. باختصار، ثق ولكن تحقق: تحقق مرتين أو ثلاث مرات من نتائج الذكاء الاصطناعي.

2. التواصل بوضوح مع التعليمات

فكر في نموذج الذكاء الاصطناعي كزميل ذكي جدًا. قدم له تعليمات واضحة ومفصلة وأمثلة. توصي إرشادات OpenAI: "كن محددًا، وصفيًا، ومفصلًا قدر الإمكان حول السياق المطلوب، والنتيجة، والطول، والصيغة، والأسلوب، إلخ." عند كتابة التعليمات.

مثال ضعيف

"اكتب عن الرياضة"

عام جدًا، يفتقر للسياق والتوجيه

مثال أفضل

"اكتب منشور مدونة قصير وودود عن سبب تعزيز التمارين اليومية للمزاج، بنبرة محادثة."

محدد، مفصل، مع توقعات واضحة

كن محددًا

حدد بالضبط ما تريد

- أهداف واضحة

- متطلبات مفصلة

حدد الأسلوب

حدد النبرة والصيغة

- نبرة محادثة

- صيغة مهنية

وفر السياق

قدم معلومات خلفية

- الجمهور المستهدف

- سيناريو حالة الاستخدام

التعليمات الجيدة (السياق + التفاصيل) تؤدي إلى ردود ذكاء اصطناعي أفضل وأكثر دقة. هذا في الأساس تواصل جيد: كلما زادت المعلومات والتوجيه، كان الذكاء الاصطناعي أكثر فائدة.

3. حماية الخصوصية وأمن البيانات

فكر مرتين قبل كتابة عناوين، كلمات مرور، معلومات طبية، أو تفاصيل أعمال سرية: يمكن للمحتالين والقراصنة استغلال ما تشاركه عبر الإنترنت.

إذا لم تكن ستنشر شيئًا على وسائل التواصل الاجتماعي، فلا تزوده إلى روبوت دردشة الذكاء الاصطناعي.

— أفضل ممارسات أمان الخصوصية

لا تشارك أبدًا

- العناوين الشخصية

- كلمات المرور أو بيانات الاعتماد

- المعلومات الطبية

- التفاصيل المالية

- بيانات الأعمال السرية

ممارسات آمنة

- استخدم منصات موثوقة فقط

- اقرأ سياسات الخصوصية

- أوقف ميزات التدريب

- استخدم أدوات الشركة المعتمدة

- احفظ المعلومات الشخصية خارج الاستفسارات

يمكن للعديد من تطبيقات الذكاء الاصطناعي المجانية أو غير الموثوقة إساءة استخدام بياناتك أو حتى التدريب عليها بدون موافقة واضحة. استخدم دائمًا منصات معروفة وموثوقة (أو أدوات الشركة المعتمدة) واقرأ سياسات الخصوصية الخاصة بها.

في العديد من الولايات القضائية، لديك حقوق على بياناتك: بموجب القانون، يجب على المصممين جمع البيانات الضرورية فقط والحصول على إذن لاستخدامها.

عمليًا، يعني هذا إيقاف ميزات التدريب أو الذاكرة عند الإمكان والحفاظ على المعلومات الشخصية خارج استفساراتك.

4. تحقق دائمًا من مخرجات الذكاء الاصطناعي

يمكن للذكاء الاصطناعي اختلاق حقائق أو تقديم إجابات خاطئة بثقة. لا تنسخ عمل الذكاء الاصطناعي كما هو. لكل قطعة مهمة مولدة بالذكاء الاصطناعي — حقائق، ملخصات، اقتراحات — تحقق من مصادر موثوقة.

قارن المصادر

قارن إجابات الذكاء الاصطناعي مع البيانات الرسمية أو مصادر الخبراء.

قم بفحوصات الجودة

قم بفحص المخرجات ضد الانتحال أو القواعد النحوية (أحيانًا يقلد الذكاء الاصطناعي النص حرفيًا، مما يسبب مشاكل حقوق الطبع والنشر).

طبق الحكم البشري

استخدم خبرتك أو حدسك: إذا بدا الادعاء غير معقول، ابحث عنه.

لا يجب أن يزيل الذكاء الاصطناعي "المسؤولية البشرية النهائية".

— دليل أخلاقيات الذكاء الاصطناعي لليونسكو

تذكر، أنت مسؤول عن ما يفعله الذكاء الاصطناعي من أجلك. عمليًا، هذا يعني أن تبقى في السيطرة: حرر، تحقق من الحقائق، وصقل عمل الذكاء الاصطناعي قبل النشر أو اتخاذ الإجراءات.

5. كن واعيًا للتحيز والعدالة

تتعلم نماذج الذكاء الاصطناعي من بيانات أنشأها البشر، لذا يمكن أن ترث تحيزات اجتماعية. قد يؤثر هذا على قرارات التوظيف، الموافقة على القروض، أو حتى استخدام اللغة اليومية.

القاعدة: فكر نقديًا في المخرجات. إذا استمر الذكاء الاصطناعي في اقتراح نفس الجنس أو العرق لوظيفة، أو إذا صور مجموعات بصورة نمطية، توقف وتسائل.

يجب أن "يعامل الذكاء الاصطناعي جميع الناس بعدل" ويجب ألا تميز الأنظمة ويجب استخدامها بشكل عادل.

— إعلان حقوق الذكاء الاصطناعي للبيت الأبيض ومبادئ مايكروسوفت للذكاء الاصطناعي

نوّع الأمثلة

استخدم أمثلة ووجهات نظر متنوعة عند استخدام الذكاء الاصطناعي

اختبر السيناريوهات

اختبر الذكاء الاصطناعي مع سيناريوهات تشمل ديموغرافيات مختلفة

عالج المشكلات

إذا لاحظت تحيزًا، حسّن تعليماتك أو غيّر الأدوات

6. احتفظ بالعنصر البشري في العملية (المسؤولية)

يمكن للذكاء الاصطناعي أتمتة المهام، لكن يجب أن يبقى البشر في موقع القيادة. توصي اليونسكو بأن الذكاء الاصطناعي لا يجب أن "يزاحم المسؤولية البشرية النهائية".

عمليًا، يعني هذا تصميم سير العمل بحيث يراجع شخص أو يشرف على نتائج الذكاء الاصطناعي.

مثال خدمة العملاء

مثال تحليل البيانات

خطط لخطط الطوارئ

كن دائمًا مستعدًا بخطة بديلة

- تدخل بشري جاهز

- خيارات إيقاف الطوارئ

احتفظ بالسجلات

وثق استخدام الذكاء الاصطناعي

- متى تم استخدام الذكاء الاصطناعي

- كيف تم اتخاذ القرارات

مكن التدقيق

حافظ على الشفافية

- سجلات تتبع القرارات

- قدرات التحقيق

المسؤولية تعني أيضًا الاحتفاظ بالسجلات: سجل متى وكيف استخدمت الذكاء الاصطناعي، حتى تتمكن من شرح أفعالك إذا لزم الأمر.

بعض المؤسسات تتطلب حتى أن تكون مشاريع الذكاء الاصطناعي قابلة للتدقيق، مع سجلات تتبع للقرارات. هذا يضمن أن شخصًا ما يمكنه التحقيق وتصحيح المشكلات، وهو ما يتماشى مع مبادئ الشفافية والمسؤولية.

7. استخدم الذكاء الاصطناعي بأخلاق وقانونية

اتبع دائمًا القانون والإرشادات الأخلاقية. لا تستخدم الذكاء الاصطناعي في مهام ممنوعة أو ضارة (مثل إنشاء برمجيات خبيثة، الانتحال، أو خداع الآخرين).

الاستخدامات الممنوعة

- إنشاء برمجيات خبيثة

- الانتحال من محتوى محمي بحقوق الطبع والنشر

- خداع الآخرين

- توليد محتوى ضار

احترام حقوق الملكية الفكرية

- أعطِ الفضل عند الحاجة

- تجنب النسخ الصريح

- تحقق من حالة حقوق الطبع والنشر

- اتبع إرشادات الاستخدام العادل

احترم الملكية الفكرية: إذا ساعد الذكاء الاصطناعي في إنشاء صورة أو مقال، كن حذرًا في إعطاء الفضل عند الحاجة وتجنب النسخ الصريح.

يؤكد إعلان حقوق الذكاء الاصطناعي الأمريكي على خصوصية البيانات والعدالة، لكنه يشير أيضًا إلى ضرورة إبقاء استخدام الذكاء الاصطناعي ضمن الحدود الأخلاقية.

تمر العديد من الدول بقوانين للذكاء الاصطناعي (مثل قانون الاتحاد الأوروبي الذي يعطي الأولوية للسلامة والحقوق). تابع هذه القوانين حتى لا تخالفها دون قصد.

باختصار: افعل الشيء الصحيح. إذا بدا الطلب مشبوهًا أو غير قانوني، فغالبًا ما يكون كذلك. عند الشك، استشر مشرفًا أو مستشارًا قانونيًا.

8. كن شفافًا بشأن استخدام الذكاء الاصطناعي

الشفافية تبني الثقة. إذا كنت تستخدم الذكاء الاصطناعي لتوليد محتوى (مقالات، تقارير، كود، إلخ)، فكر في إعلام جمهورك أو فريقك. اشرح كيف يساعد الذكاء الاصطناعي (مثلاً: "تم صياغة هذا الملخص بواسطة الذكاء الاصطناعي، ثم حررته أنا").

يجب أن يعرف الناس متى تُستخدم أنظمة الذكاء الاصطناعي وكيف تؤثر على القرارات.

— مبدأ "الإشعار والشرح" في خطة البيت الأبيض للذكاء الاصطناعي

وسم المحتوى

حدد المحتوى المولد بالذكاء الاصطناعي بوضوح

استشهد بالمصادر

أعطِ الفضل للمؤلفين الأصليين عند تعديل المحتوى

شارك سير العمل

اشرح الأدوات والخطوات التي استخدمتها

على سبيل المثال، إذا استخدمت شركة الذكاء الاصطناعي لفحص المتقدمين للوظائف، يجب إعلام المرشحين بذلك.

عمليًا، وسم المحتوى المولد بالذكاء الاصطناعي، وكن واضحًا بشأن مصادر البيانات. إذا عدّلت كتابة شخص آخر باستخدام الذكاء الاصطناعي، استشهد بالمؤلف الأصلي. في بيئة العمل، شارك سير عمل الذكاء الاصطناعي مع الزملاء (أي أدوات الذكاء الاصطناعي التي استخدمتها والخطوات التي اتبعتها).

9. استمر في التعلم وابقَ مطلعًا

يتطور الذكاء الاصطناعي بسرعة، لذا حافظ على تحديث مهاراتك ومعرفتك. تابع الأخبار الموثوقة (مدونات التكنولوجيا، المنتديات الرسمية للذكاء الاصطناعي، أو الإرشادات الدولية مثل توصيات اليونسكو) لتتعرف على المخاطر الجديدة وأفضل الممارسات.

التعليم العام والتدريب هما مفتاح الاستخدام الآمن للذكاء الاصطناعي.

— توصية اليونسكو حول "محو الأمية في الذكاء الاصطناعي"

إليك كيفية ممارسة التعلم المستمر:

التعلم الرسمي

- احضر دورات أو ندوات عبر الإنترنت حول أمان وأخلاقيات الذكاء الاصطناعي

- اطلع على الميزات الجديدة لأدوات الذكاء الاصطناعي التي تستخدمها

التعلم المجتمعي

- شارك النصائح والموارد مع الأصدقاء أو الزملاء (مثل كيفية كتابة تعليمات أفضل أو اكتشاف تحيز الذكاء الاصطناعي)

- علّم المستخدمين الأصغر سنًا (أو الأطفال) أن الذكاء الاصطناعي يمكن أن يساعد لكنه يجب التشكيك فيه

بالتعلم معًا، نبني مجتمعًا يستخدم الذكاء الاصطناعي بحكمة. فبعد كل شيء، يتحمل جميع المستخدمين مسؤولية ضمان استفادة الجميع من الذكاء الاصطناعي.

10. استخدم أدوات موثوقة واتبع الإرشادات

أخيرًا، التزم بأدوات الذكاء الاصطناعي الموثوقة والإرشادات الرسمية. قم بتنزيل تطبيقات الذكاء الاصطناعي فقط من المصادر الرسمية (مثل الموقع الشرعي أو متجر التطبيقات) لتجنب البرمجيات الخبيثة أو الاحتيال.

في مكان العمل، استخدم منصات الذكاء الاصطناعي المعتمدة من الشركة والتي تلبي معايير الأمان والخصوصية.

اختر بائعين موثوقين

ادعم تطوير الذكاء الاصطناعي الأخلاقي

- سياسات بيانات واضحة

- التزامات أخلاقية

استخدم ميزات الأمان

استفد من الحمايات المدمجة

- تعطيل تدريب البيانات

- ضبط فلاتر المحتوى

نسخ احتياطي للبيانات

حافظ على الاستقلالية

- نسخ احتياطية مستقلة

- تجنب التقييد بالبائع

ادعم بائعي الذكاء الاصطناعي الذين يلتزمون بالتطوير الأخلاقي. على سبيل المثال، فضّل الأدوات التي لديها سياسات بيانات واضحة والتزامات أخلاقية (كما تنشر العديد من شركات التكنولوجيا الكبرى الآن). استخدم ميزات الأمان المدمجة: تسمح بعض المنصات بتعطيل تدريب البيانات أو ضبط فلاتر المحتوى.

ودائمًا قم بعمل نسخ احتياطية لبياناتك بشكل مستقل عن خدمة الذكاء الاصطناعي، حتى لا تُحرم من الوصول إذا حدث خطأ ما.

النقاط الرئيسية

باختصار، الذكاء الاصطناعي شريك قوي عند استخدامه بمسؤولية. باتباع هذه القواعد الذهبية العشر – احترام الخصوصية، التحقق من الحقائق، الالتزام بالأخلاقيات والمعرفة، والحفاظ على السيطرة البشرية – يمكنك الاستفادة من مزايا الذكاء الاصطناعي بأمان.

مع تقدم التكنولوجيا، ستساعد هذه المبادئ في ضمان بقاء الذكاء الاصطناعي قوة للخير.

No comments yet. Be the first to comment!