Osiągnięcia sztucznej inteligencji

Sztuczna inteligencja (SI) dokonała w ostatnich latach niezwykłych postępów, przekształcając branże od opieki zdrowotnej i finansów po sztukę i rozrywkę. Od generatywnych modeli językowych tworzących tekst przypominający ludzki po systemy SI opanowujące skomplikowane gry i badania naukowe – te osiągnięcia ukazują szybki rozwój inteligencji maszynowej. W tym artykule przyglądamy się najważniejszym ostatnim przełomom w SI, podkreślając ich wpływ, potencjalne zastosowania oraz przyszłość innowacji w dziedzinie SI.

Przez wiele lat (2023–2025) sztuczna inteligencja dokonała ogromnego skoku na wielu frontach. Duże modele językowe (LLM) i chatboty, systemy multimodalne, narzędzia naukowe SI oraz robotyka odnotowały przełomy.

Giganci technologiczni wypuścili nowych asystentów SI, społeczności open source udostępniły potężne modele, a nawet regulatorzy zaczęli reagować na wpływ SI.

Poniżej przedstawiamy najbardziej uderzające osiągnięcia, od rozszerzeń GPT-4 i Google Gemini po Nagrodę Nobla dla AlphaFold oraz odkrycia naukowe i artystyczne napędzane przez SI.

Generatywne modele językowe i chatboty

Nowoczesne LLM stały się znacznie bardziej zaawansowane i multimodalne. GPT-4 Turbo OpenAI (ogłoszony w listopadzie 2023) potrafi teraz przetworzyć 128 000 tokenów w jednym zapytaniu (około 300 stron tekstu) i jest znacznie tańszy w użyciu niż GPT-4.

GPT-4o oznacza fundamentalną zmianę w kierunku prawdziwie multimodalnej SI, która może płynnie obsługiwać tekst, obrazy i dźwięk w rozmowach w czasie rzeczywistym.

— Zespół badawczy OpenAI, maj 2024

W maju 2024 OpenAI wprowadziło GPT-4o (Omni), ulepszony model obsługujący tekst, obrazy i dźwięk w czasie rzeczywistym – dając GPT-4 zdolność „widzenia i słyszenia” w rozmowach. ChatGPT ma teraz wbudowane funkcje obrazów i głosu: użytkownicy mogą przesyłać zdjęcia lub mówić do bota, który odpowiada na podstawie tych danych wizualnych lub dźwiękowych.

GPT-4 Turbo & GPT-4o

GPT-4 Turbo (listopad 2023): Obniżone koszty i wydłużony kontekst do 128 tys. tokenów.

GPT-4o (maj 2024): Umożliwił prawdziwie multimodalną SI, generując tekst, mowę i obrazy z prędkością zbliżoną do ludzkiej.

Ewolucja ChatGPT

Pod koniec 2023 ChatGPT „potrafi teraz widzieć, słyszeć i mówić” – można przesyłać obrazy i dźwięki jako zapytania.

Zintegrowano DALL·E 3 (październik 2023) do generowania obrazów w rozmowie.

Seria Gemini Google

W grudniu 2024 Google DeepMind wprowadził pierwsze modele Gemini 2.0 („Flash” i prototypy) zaprojektowane na „erę agentów” – SI, która może autonomicznie wykonywać wieloetapowe zadania.

- Testy z udziałem ponad 1 miliarda użytkowników

- Ulepszone zdolności rozumowania

- Zaawansowane możliwości multimodalne

Modele open source i korporacyjne

Meta wypuściła LLaMA 3 w kwietniu 2024 (otwarte modele LLM do 400 mld parametrów) deklarując lepszą wydajność.

- Postępy Claude 3 od Anthropic

- Integracja Microsoft Copilot

- API asystentów OpenAI

Napędzają też nowe aplikacje „asystentów” przez API (np. Google „AI Overviews”, OpenAI Assistants API), zwiększając dostępność SI.

Postępy multimodalnej i kreatywnej SI

Kreatywność i rozumienie wizualne SI eksplodowały. Modele tekst-na-obraz i tekst-na-wideo osiągnęły nowe szczyty:

OpenAI DALL·E 3 (październik 2023) generuje fotorealistyczne obrazy z opisów i jest zintegrowany z ChatGPT do wspomaganego tworzenia promptów.

Google wprowadził Imagen 3 (październik 2024) i Veo 2 (grudzień 2024) – najnowocześniejsze silniki tekst-na-obraz i tekst-na-wideo – które znacznie poprawiają jakość, szczegółowość i spójność w generowaniu sztuki i wideo przez SI.

Nawet muzyczna SI się rozwinęła dzięki narzędziom MusicFX Google i powiązanym badaniom (np. eksperymenty MusicLM).

Zaawansowane możliwości generowania

- DALL·E 3 i Imagen 3: Potrafią wiernie realizować subtelne polecenia (w tym tekst osadzony na obrazach)

- Google Veo 2: Generuje krótkie klipy wideo z pojedynczych opisów tekstowych, co oznacza znaczący postęp w syntezie wideo

- Stable Diffusion i Midjourney: Wydano nowsze wersje (v3, v6) z ulepszonym realizmem w 2024

Integracja Apple Intelligence

Apple wprowadziło Apple Intelligence (w iOS 18 i macOS 15, pod koniec 2024) – wbudowaną generatywną SI na iPhone/iPad/Mac.

Pisanie i komunikacja

- Przepisywanie, korekta, streszczanie w Mail/Pages

- Ulepszone możliwości Siri

- Przetwarzanie języka naturalnego

Narzędzia wizualne i kreatywne

- Image Playground: Tworzenie ilustracji za pomocą tekstu

- Genmoji: Emoji generowane przez SI

- Clean Up: Usuwanie niechcianych obiektów ze zdjęć

Historyczne osiągnięcie na rynku sztuki

Przykład godny uwagi: w listopadzie 2024 Sotheby's sprzedało pierwszy obraz namalowany przez humanoidalnego robota.

Rekordowa sprzedaż dzieła sztuki SI

Portret Alana Turinga namalowany przez robota zasilanego SI Ai-Da osiągnął cenę 1,08 mln USD.

Ta rekordowa sprzedaż („A.I. God: Portret Alana Turinga”) podkreśla rosnącą rolę SI w kreatywności i jej wpływ kulturowy.

Wczesna sztuka SI

- Produkty nastawione na nowość

- Surrealistyczne, abstrakcyjne obrazy

- Ograniczone zastosowania praktyczne

- Podstawowe modele tekst-na-obraz

Nowoczesna kreatywność SI

- Przydatne generowanie obrazów (logotypy, diagramy, mapy)

- Realizm zbliżony do ludzkiego

- Zintegrowane procesy twórcze

- Możliwości multimodalne

Ogólnie modele generatywne demokratyzują kreatywność: każdy może teraz tworzyć sztukę, muzykę lub wideo za pomocą kilku słów. Przemysł przesunął się z samej nowości (surrealistyczne obrazy) na praktyczne generowanie obrazów (logotypy, diagramy, mapy) i realizm zbliżony do ludzkiego.

(W marcu 2025 OpenAI wypuściło nawet „4o Image Generation”, integrując swój najlepszy model obrazowy z GPT-4o dla precyzyjnych, fotorealistycznych wyników sterowanych rozmową.)

Narzędzia te szybko są włączane do aplikacji, przeglądarek i procesów twórczych.

SI w nauce, medycynie i matematyce

Osiągnięcia SI napędziły odkrycia naukowe i postępy badawcze:

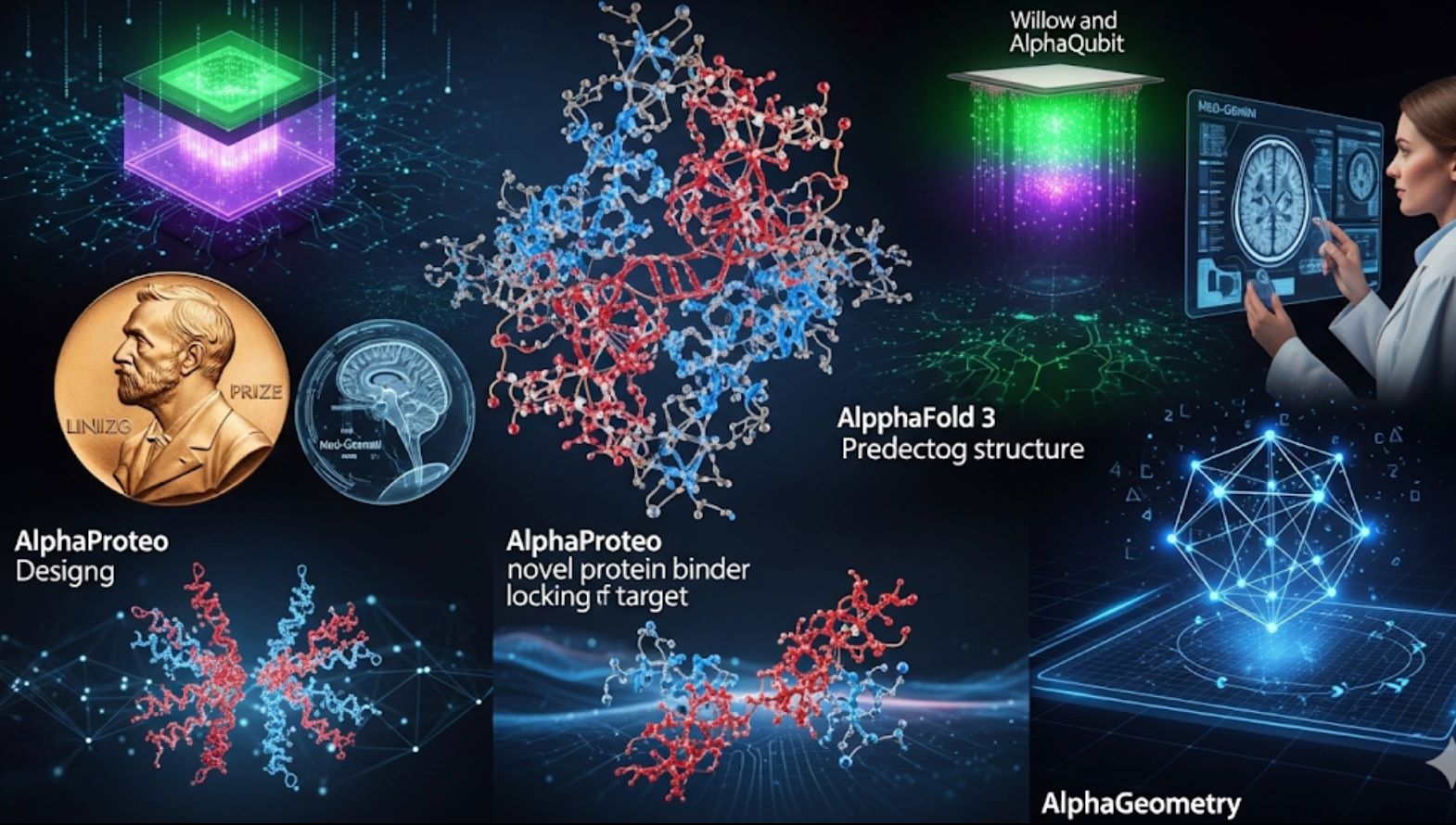

AlphaFold 3 – rewolucyjne przewidywanie biomolekuł

W listopadzie 2024 Google DeepMind (we współpracy z Isomorphic Labs) zaprezentował AlphaFold 3, nowy model przewidujący struktury 3D wszystkich biomolekuł (białka, DNA, RNA, ligandy itd.) jednocześnie z bezprecedensową dokładnością.

Twórcy natychmiast udostępnili darmowy AlphaFold Server, aby naukowcy na całym świecie mogli przewidywać struktury molekularne. To rozszerzenie przewidywań białkowych AlphaFold 2, które ma zrewolucjonizować odkrywanie leków i badania genomiki.

AlphaProteo – projektowanie leków

Również w 2024 DeepMind ogłosił AlphaProteo, SI, która projektuje nowe wiążące białka – molekuły silnie wiążące się z docelowymi białkami.

- Przyspiesza tworzenie przeciwciał

- Opracowuje biosensory

- Generuje potencjalne leki

- Tworzy struktury białek dla określonych celów

Matematyka – AlphaGeometry

DeepMind's AlphaGeometry i AlphaProof osiągnęły kolejny przełom.

- 19 sekund na rozwiązanie zadania z Międzynarodowej Olimpiady Matematycznej

- Poziom srebrnego medalisty

- Zaawansowane możliwości matematyki na poziomie szkoły średniej

Przełomy w komputerach kwantowych – AlphaQubit & Willow

SI poprawiła też nowoczesny sprzęt. W 2024 Google ogłosił AlphaQubit, dekoder SI, który znacznie lepiej niż wcześniejsze metody wykrywa błędy w komputerach kwantowych (np. chipy Sycamore Google).

W grudniu 2024 Google zaprezentował Willow, nowy chip kwantowy, który dzięki zaawansowanej korekcji błędów rozwiązał zadanie benchmarkowe w mniej niż 5 minut, co zajęłoby najlepszym superkomputerom ~10^24 lat.

Med-Gemini to znaczący skok w możliwościach medycznej SI, osiągając 91,1% dokładności na benchmarkach amerykańskich egzaminów medycznych – wynik znacznie przewyższający wcześniejsze modele.

— Zespół badawczy Google Health AI, 2024

W medycynie i zdrowiu modele SI również poczyniły postępy. Na przykład nowy Med-Gemini Google (dostrojony na danych medycznych) uzyskał 91,1% na benchmarku egzaminów medycznych w USA (styl USMLE), przewyższając poprzednie modele.

Wprowadzono narzędzia SI do radiologii i patologii (np. Derm i Path Foundations) poprawiające analizę obrazów. Ogólnie SI stała się niezbędnym partnerem badawczym – od nanoskalowego mapowania ludzkiego mózgu (z pomocą SI w obrazowaniu EM) po przyspieszenie badań przesiewowych gruźlicy w Afryce, jak raportują badacze Google.

SI w robotyce i automatyzacji

Roboty zasilane SI uczą się wykonywać złożone zadania w rzeczywistym świecie.

Humanoidalne roboty Tesli Optimus zostały publicznie zaprezentowane w październiku 2024 („We, Robot”). Kilkadziesiąt jednostek Optimus chodziło, stało, a nawet tańczyło na scenie – choć późniejsze raporty wskazały, że początkowe demonstracje były częściowo zdalnie sterowane przez ludzi.

Mimo to wydarzenie podkreśliło szybki postęp w kierunku robotów ogólnego przeznaczenia.

Roboty ALOHA DeepMind

Laboratorium SI Google poczyniło imponujące postępy w robotach domowych. W 2024 robot ALOHA (Autonomous Legged Household Assistant) nauczył się wiązać sznurowadła, wieszać koszulę, naprawiać innego robota, wkładać tryby, a nawet sprzątać kuchnię korzystając wyłącznie z planowania SI i widzenia.

Projekt „ALOHA Unleashed” open source pokazał roboty koordynujące dwie ręce do zadań, co jest pierwszym takim osiągnięciem w manipulacji ogólnego przeznaczenia.

Robotic Transformers

DeepMind wprowadził RT-2 (Robotic Transformer 2), model wizja-język-akcja, który może uczyć się zarówno z obrazów internetowych, jak i danych z prawdziwych robotów.

RT-2 pozwala robotom interpretować instrukcje jak człowiek, wykorzystując wiedzę z sieci. Zademonstrowano go, pomagając robotowi sortować przedmioty według poleceń tekstowych.

Zastosowania przemysłowe

Inne firmy również poczyniły postępy: Boston Dynamics kontynuowało udoskonalanie robotów Atlas i Spot (choć bez pojedynczego przełomu), a pojazdy autonomiczne zasilane SI poprawiły się (beta Tesla Full Self-Driving została szerzej udostępniona, choć pełna autonomia pozostaje nierozwiązana).

W produkcji firmy skoncentrowane na SI, takie jak Figure AI, pozyskały fundusze na budowę robotów domowych do prac domowych.

Faza demonstracji

- Imponujące kontrolowane pokazy

- Nauka konkretnych zadań

- Ograniczone wdrożenia w rzeczywistym świecie

- Wymagana nadzór człowieka

Pełna autonomia

- Bezpieczna współpraca z ludźmi

- Możliwości ogólnego przeznaczenia

- Wiarygodna praca w rzeczywistym świecie

- Skalowalne wdrożenia

Te wysiłki pokazują roboty wykonujące coraz trudniejsze zadania bez programowania. Jednak prawdziwe w pełni autonomiczne humanoidy są jeszcze w perspektywie.

Demonstracje (Optimus, ALOHA, RT-2) to kamienie milowe, ale badacze ostrzegają, że przed bezpieczną i niezawodną współpracą robotów z ludźmi na dużą skalę jest jeszcze dużo pracy.

SI w produktach, przemyśle i społeczeństwie

Wpływ SI sięga codziennych produktów, a nawet polityki:

Integracja SI w codziennej technologii

Główne produkty technologiczne włączyły agentów SI. Microsoft Copilot (wbudowany w Windows, Office, Bing) i Google Bard/Bard AI w wyszukiwarce (oparty na Gemini) udostępniły moc LLM użytkownikom.

Urządzenia Apple otrzymały Apple Intelligence (jak wyżej), a producenci sprzętu, tacy jak Nvidia, sprzedali rekordowe ilości GPU do SI, napędzając chmurę i konsumencką SI.

EU AI Act – pierwsze kompleksowe prawo dotyczące SI

Odzwierciedlając zasięg SI, regulatorzy również podjęli działania. 1 sierpnia 2024 weszła w życie EU AI Act, pierwsze kompleksowe prawo dotyczące SI.

Ramowy system oparty na ryzyku

- SI niskiego ryzyka: Minimalne zasady (filtry spamu, gry wideo)

- Zasady przejrzystości: Systemy SI muszą ujawniać, że są SI

- SI wysokiego ryzyka: Ścisły nadzór (narzędzia medyczne, rekrutacyjne)

- SI niedopuszczalna: Zakazana (rządowe systemy punktacji społecznej)

Globalny wpływ

Zestaw tych zasad (wraz z nadchodzącymi wytycznymi dotyczącymi modeli ogólnego przeznaczenia) to ważne osiągnięcie w zarządzaniu SI i prawdopodobnie wpłynie na standardy na całym świecie.

Historyczne inwestycje i wyceny

Sektor SI odnotował historyczne finansowanie i wyceny:

| Firma | Osiągnięcie | Wartość/Wpływ | Znaczenie |

|---|---|---|---|

| OpenAI | Wycena | 157 mld USD | Rekord |

| NVIDIA | Kapitalizacja rynkowa | 3,5+ bln USD | Lider sprzętu SI |

| Wiele startupów | Rundy finansowania | Wielomiliardowe | Faza wzrostu |

Te liczby podkreślają, jak SI stała się centralnym elementem gospodarki technologicznej.

Patrząc w przyszłość: transformujący wpływ SI

Krótko mówiąc, SI nie jest już ograniczona do laboratoriów czy pokazów nowości – jest wbudowana w telefony, samochody, miejsca pracy i politykę publiczną.

Rewolucja wiedzy

Ogromne możliwości wiedzy GPT-4 pokazują potencjał SI jako uniwersalnego asystenta wiedzy.

Przełomy naukowe

Rewolucje naukowe AlphaFold pokazują moc SI w przyspieszaniu odkryć i badań.

Codzienna integracja

SI jest coraz bardziej płynnie integrowana z naszymi codziennymi narzędziami i procesami.

Powyższe osiągnięcia – od ogromnej wiedzy GPT-4 po rewolucje naukowe AlphaFold – pokazują szybkie dojrzewanie SI.

W miarę zbliżania się 2025 roku te osiągnięcia zapowiadają jeszcze potężniejsze i praktyczniejsze zastosowania SI w naszym codziennym życiu.

No comments yet. Be the first to comment!