Kan AI lära sig utan data?

Dagens AI kan inte lära sig helt utan data. Maskininlärning och djupinlärning är beroende av data för att känna igen mönster, dra slutsatser och förbättra prestanda. Även avancerade modeller, som GPT eller förstärkningsinlärningssystem, behöver fortfarande indata eller erfarenhet från miljön för att "lära sig" och göra korrekta förutsägelser. Med andra ord är data den viktigaste drivkraften för att AI ska utvecklas, och utan data kan AI varken förstå eller fatta användbara beslut.

Förstå AI:s relation till data

Undrar du, "Kan AI lära sig själv utan någon data?" För att få det mest detaljerade och rimliga svaret, låt oss utforska detta ämne på djupet med INVIAI.

Till exempel, i övervakad inlärning lär sig AI från enorma datamängder som människor har märkt (bilder, text, ljud osv.) för att identifiera mönster.

Även i icke-övervakad inlärning kräver AI rå, omärkt data för att själv upptäcka dolda strukturer eller mönster i datan.

Därför, oavsett metod, måste AI "näras" med data – vare sig det är märkt data, självmärkt data (självövervakad) eller data från verkliga miljöer. Utan någon indata kan systemet inte lära sig något nytt.

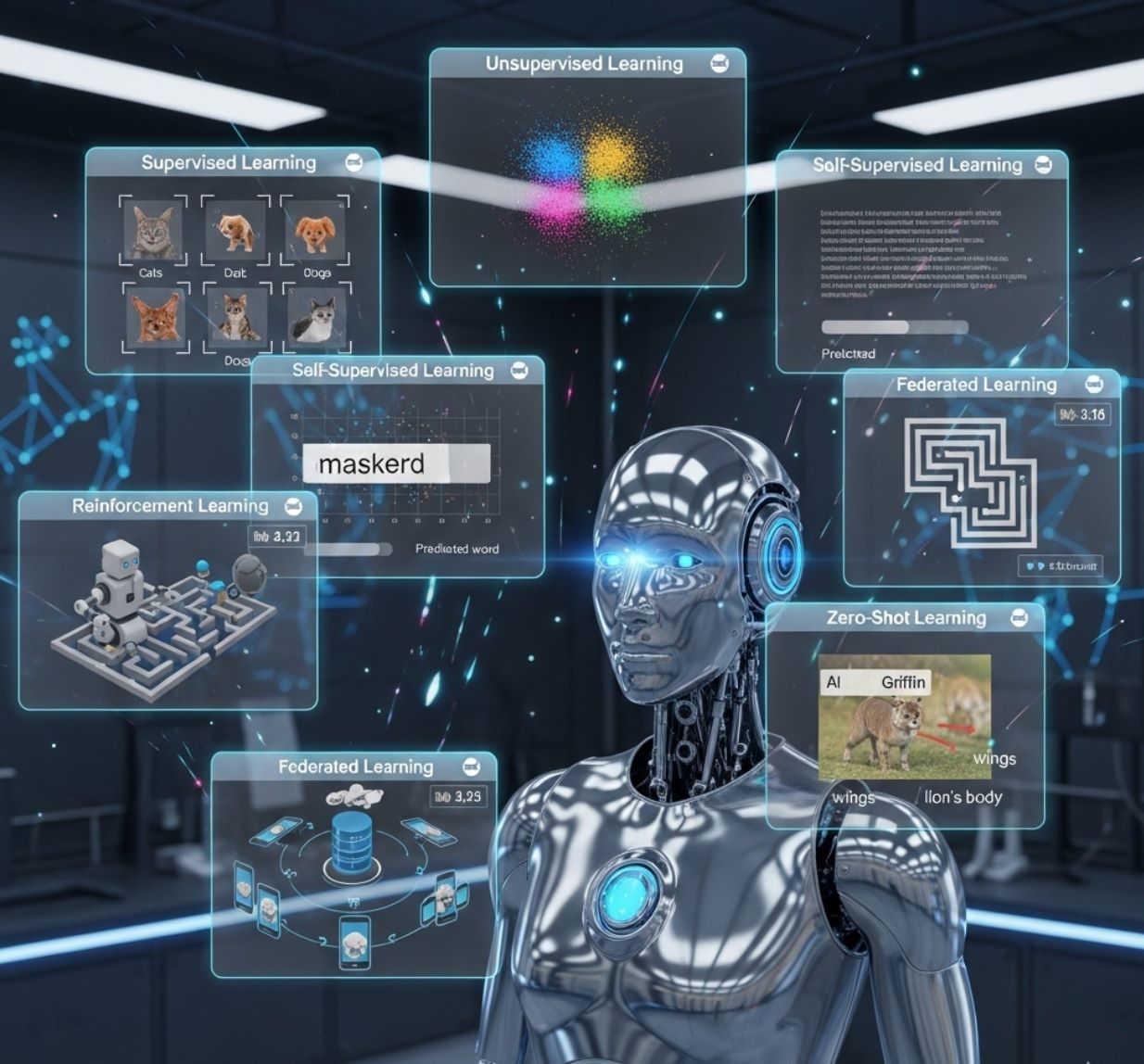

Vanliga AI-inlärningsmetoder

Idag lär sig AI-modeller främst genom följande metoder:

Övervakad inlärning

Icke-övervakad inlärning

Självövervakad inlärning

Förstärkningsinlärning (RL)

Förstärkningsinlärning är att lära en mjukvaruagent hur den ska bete sig i en miljö genom att informera den om resultaten av dess handlingar.

— Wikipedia

Federated Learning

För känslig data, som personliga medicinska bilder, tillåter Federated Learning flera enheter (eller organisationer) att gemensamt träna en delad modell utan att dela rådata.

- Global modell skickas till varje enhet

- Träning sker endast på lokal data

- Endast modelluppdateringar delas tillbaka

- Rådata lämnar aldrig enheten

Zero-Shot Learning

AI:s förmåga att dra slutsatser om nya koncept utan specifika exempel, baserat på tidigare inhämtad bred kunskap.

- Känner igen okända koncept

- Använder tidigare kunskapsbas

- Förtränad på enorma datamängder

- Möjliggör resonemang kring nya idéer

En AI-modell tränas för att känna igen eller klassificera objekt/koncept den aldrig tidigare sett exempel på.

— IBM, definition av Zero-Shot Learning

Sammanfattningsvis: Alla dessa metoder visar att det finns inget magiskt sätt för AI att lära sig utan data – på något sätt behövs data. AI kan minska beroendet av mänskligt märkta data eller lära sig från erfarenhet, men den kan inte lära sig från ingenting.

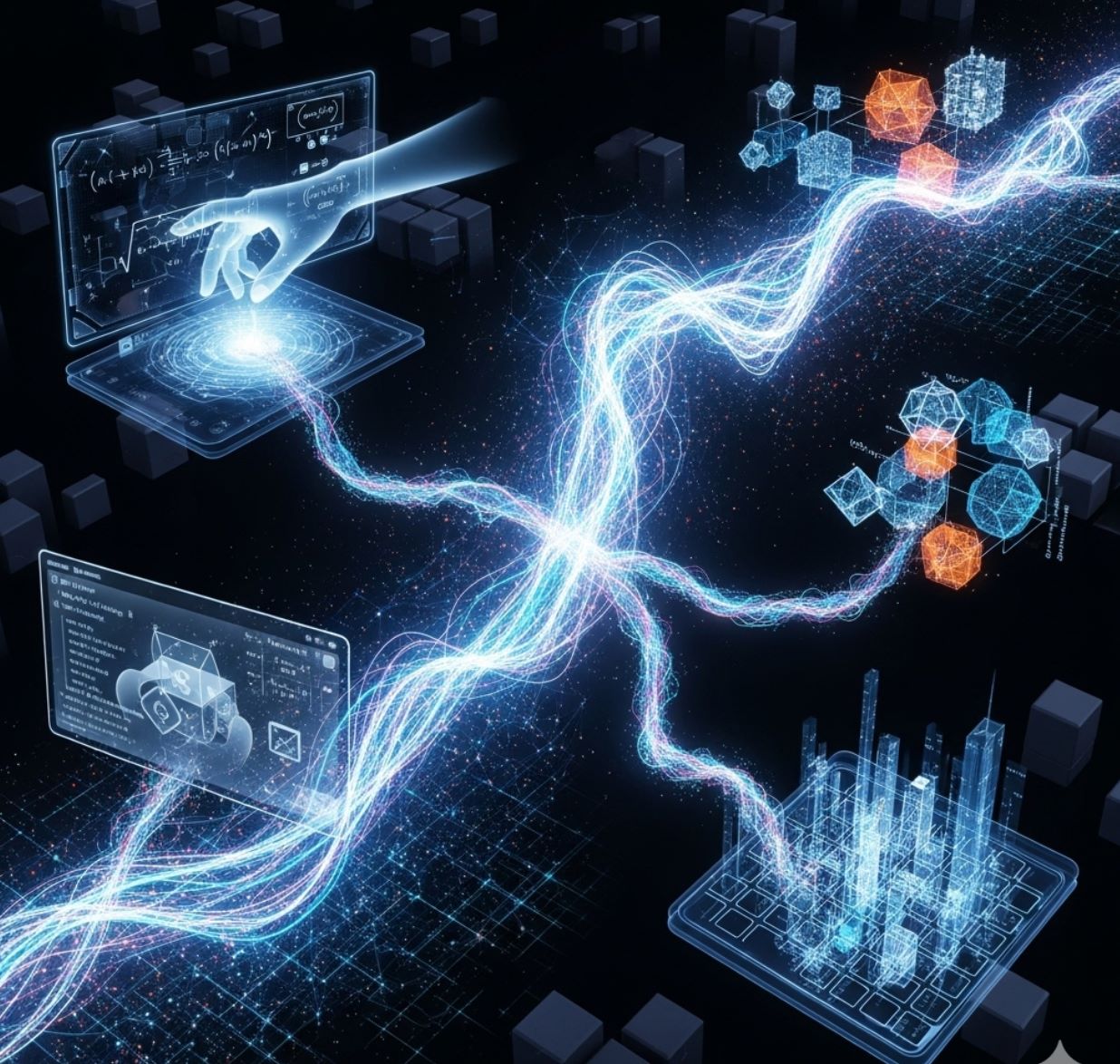

Avancerade trender: Lära från "erfarenhet" istället för statisk data

Forskare utforskar nu sätt för AI att bli mindre beroende av mänskligt tillhandahållen data. Till exempel föreslog DeepMind nyligen en "ström"-modell i en era av "erfarenhetsbaserad AI", där AI främst lär sig från sina egna interaktioner med världen snarare än från mänskligt designade problem och frågor.

Vi kan uppnå detta genom att låta agenter kontinuerligt lära sig från sina egna erfarenheter – det vill säga data som genereras av agenten själv när den interagerar med miljön… Erfarenhet kommer att bli det primära sättet att förbättras, och överträffa dagens mängd mänskligt tillhandahållen data.

— DeepMind Research, citerat av VentureBeat

Med andra ord kommer AI i framtiden själv att generera sin egen data genom experiment, observation och justering av handlingar – likt hur människor lär sig från verkliga erfarenheter.

Mänskligt tillhandahållen data

- Kräver märkta datamängder

- Beroende av mänsklig expertis

- Begränsad av tillgängliga exempel

- Statisk inlärningsmetod

Självgenererad data

- Skapar egna utmaningar

- Lär sig från miljöfeedback

- Kontinuerlig förbättring

- Dynamisk inlärningsmetod

Anmärkningsvärt är att trots att AZR inte använder extern träningsdata, uppnår den toppresultat i matematik och programmeringsuppgifter, och överträffar modeller tränade på tiotusentals märkta exempel. Detta visar att AI kan generera sin egen "datamängd" genom att kontinuerligt ställa och lösa utmaningar.

Autonoma inlärningssystem

Utöver AZR utforskar många studier AI som lär sig autonomt. Intelligenta agentsystem kan interagera med mjukvara och virtuella världar för att samla erfarenhetsdata.

- Interaktion med verktyg och webbplatser

- Lär sig från simuleringsspel

- Sätter egna mål och belöningar

- Utvecklar autonoma vanor

Viktiga slutsatser

Istället kan AI lära sig mindre från mänskligt tillhandahållen data genom att:

- Använda omärkt data (icke-övervakad inlärning)

- Lära sig från miljöfeedback (förstärkningsinlärning)

- Skapa egna utmaningar (t.ex. AZR-modellen)

Många experter tror att AI i framtiden i allt högre grad kommer att lära sig genom den erfarenhet den samlar själv, vilket gör erfarenhet till den huvudsakliga "datan" som hjälper den att förbättras.

No comments yet. Be the first to comment!