2023年から2025年にかけて、人工知能は多方面で飛躍的な進歩を遂げました。大規模言語モデル(LLM)やチャットボット、多モーダルシステム、科学的AIツール、ロボティクスなどが次々とブレイクスルーを迎えています。

テック大手は新たなAIアシスタントを発表し、オープンソースコミュニティは強力なモデルを公開、さらには規制当局もAIの影響に対応し始めました。

以下では、GPT-4の拡張版やGoogleのGemini、AlphaFoldのノーベル賞受賞、科学や芸術におけるAI主導の発見など、最も注目すべき成果を概観します。

生成型言語モデルとチャットボット

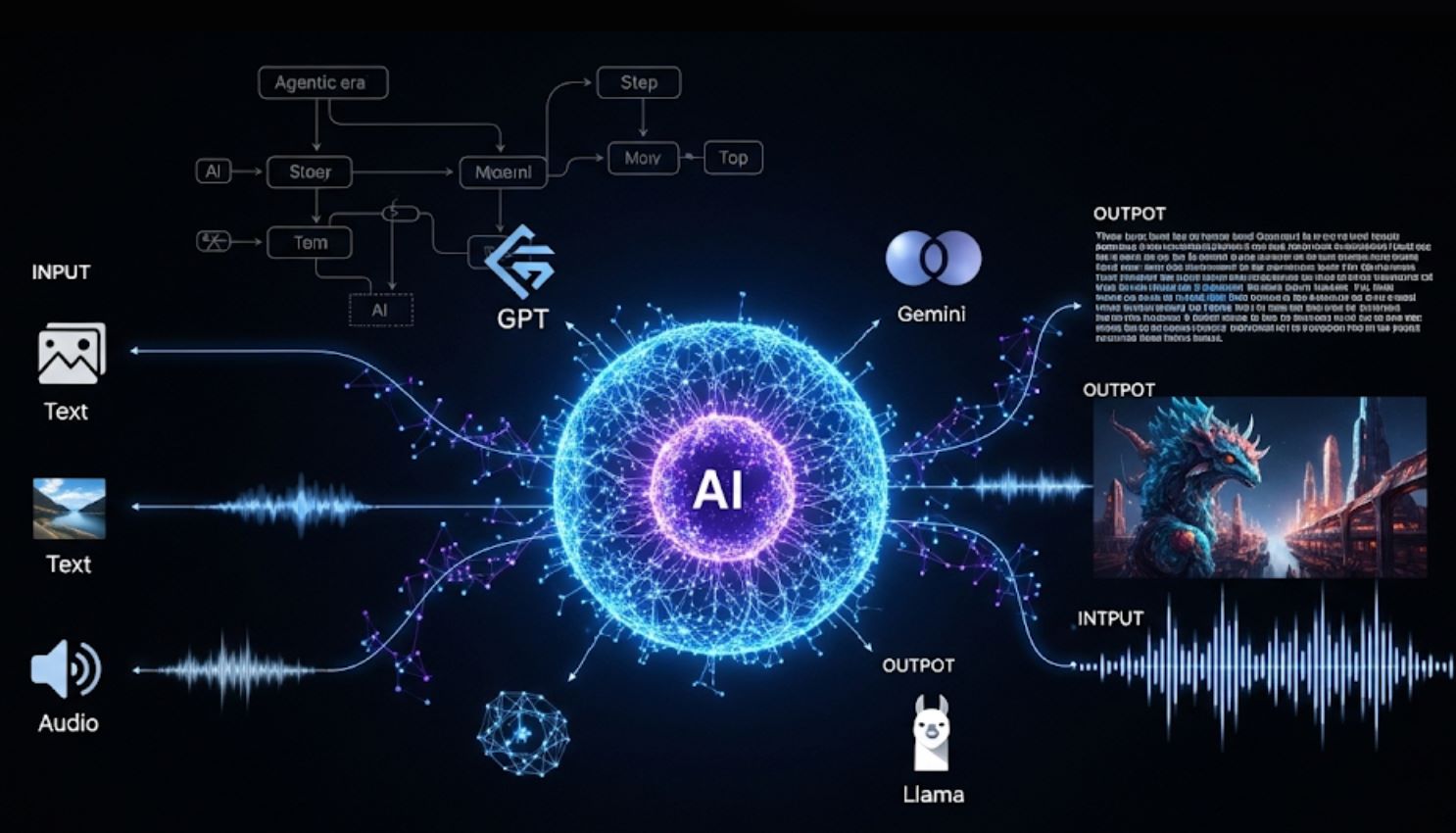

現代のLLMは大幅に能力が向上し、多モーダル対応も進みました。OpenAIのGPT-4 Turbo(2023年11月発表)は、1回のプロンプトで128,000トークン(約300ページ分のテキスト)を処理可能で、GPT-4よりもはるかに低コストで運用できます。

2024年5月には、OpenAIがGPT-4o(Omni)を発表。テキスト、画像、音声をリアルタイムで処理でき、GPT-4に「視覚」と「聴覚」の会話能力を付与しました。ChatGPT自体も画像や音声機能を内蔵し、ユーザーは写真をアップロードしたり話しかけたりすることで、その視覚・聴覚情報に基づいた応答が可能です。

- GPT-4 TurboとGPT-4o(Omni):GPT-4 Turbo(2023年11月)はコスト削減と128Kトークンのコンテキスト拡大を実現。GPT-4o(2024年5月)は真の多モーダルAIとなり、テキスト、音声、画像をほぼ人間並みの速度で生成・処理します。

- ChatGPTの進化:2023年末までにChatGPTは「見る、聞く、話す」能力を獲得。画像や音声をプロンプトとしてアップロード・発話でき、それに応じた回答が可能です。さらにDALL・E 3(2023年10月)を統合し、会話形式でのテキストから画像生成も可能になりました。

- GoogleのGeminiシリーズ:2024年12月、Google DeepMindは「エージェンティック時代」を見据えた初のGemini 2.0モデル(「Flash」やプロトタイプ)を発表。AIが自律的に多段階タスクを遂行可能です。Googleはすでに検索(AIオーバービュー)など10億人以上のユーザー向け製品でGemini 2.0のテストを開始し、推論力と多モーダル能力の向上を示しています。

- その他のモデル:Metaは2024年4月にLLaMA 3(最大4000億パラメータのオープンウェイトLLM)をリリースし、多くの既存モデルを上回る性能を主張。AnthropicのClaude 3やMicrosoftのコパイロットツールもこれらの進歩を基盤に構築されています(例:コパイロットはOpenAI技術を活用)。

これらの革新により、AIアシスタントはより長く、より豊かな対話を実現し、多様な入力に対応可能となりました。

また、Googleの「AIオーバービュー」やOpenAIのAssistants APIなど、APIを通じて新たな「アシスタント」アプリが生まれ、開発者やエンドユーザーにAIがより身近になっています。

多モーダル&クリエイティブAIの進展

AIの創造性と視覚理解能力が飛躍的に向上しました。テキストから画像やテキストから動画への生成モデルが新たな高みへ到達しています:

OpenAIのDALL・E 3(2023年10月)は、プロンプトからフォトリアリスティックな画像を生成し、ChatGPTと統合されてガイド付きプロンプト作成も可能です。

GoogleはImagen 3(2024年10月)とVeo 2(2024年12月)を発表。最先端のテキストから画像・動画生成エンジンで、AIアートや動画生成の品質、細部、整合性を大幅に向上させました。

音楽AIもGoogleのMusicFXツールや関連研究(例:MusicLM実験)で進化しています。

- 生成型アートモデル:DALL・E 3やImagen 3は、画像内の埋め込みテキストを含む微妙なプロンプトにも高精度で対応可能。GoogleのVeo 2は単一のテキスト記述から短い動画クリップを生成でき、動画合成の大きな一歩となりました。Stable DiffusionやMidjourneyも今年、新バージョン(v3、v6)でリアリズムを向上させています。

- デバイス内AI:Appleは2024年末にiOS 18およびmacOS 15でApple Intelligenceを導入。iPhone、iPad、Macに組み込まれた生成AIで、メールやPagesでの文章リライト、校正、要約アシスタント、より賢いSiri、テキストから楽しいイラストを作成するImage PlaygroundやAI生成のカスタム絵文字Genmojiなどの画像ツールを提供。写真は自然言語検索(「Mayaがスケートボードをしている写真を探す」)や不要物除去の「Clean Up」AI機能を備えています。Appleはオンデバイス処理とプライバシー保護を重視しています。

- 芸術におけるAI:注目すべき例として、2024年11月にソザビーズで人型ロボットによる初の絵画が落札されました。AI搭載ロボットAi-Daが描いたアラン・チューリングの肖像画は108万米ドルで取引されました。この記録的な販売(「A.I. God: Portrait of Alan Turing」)は、AIの創造性と文化的影響力の高まりを象徴しています。

全体として、生成モデルは創造性の民主化を促進し、誰もが数語でアートや音楽、動画を生成できるようになりました。業界の焦点は単なる新奇性(シュールな画像)から、実用的な画像生成(ロゴ、図表、地図)や人間らしいリアリズムへと移行しています。

(2025年3月にはOpenAIが「4o Image Generation」をリリースし、最高の画像モデルをGPT-4oに統合して、会話に導かれた精密でフォトリアリスティックな出力を実現しました。)

これらのツールは急速にアプリやブラウザ、クリエイティブワークフローに組み込まれています。

科学、医療、数学におけるAI

AIの成果は科学的発見や研究の進展を促進しています:

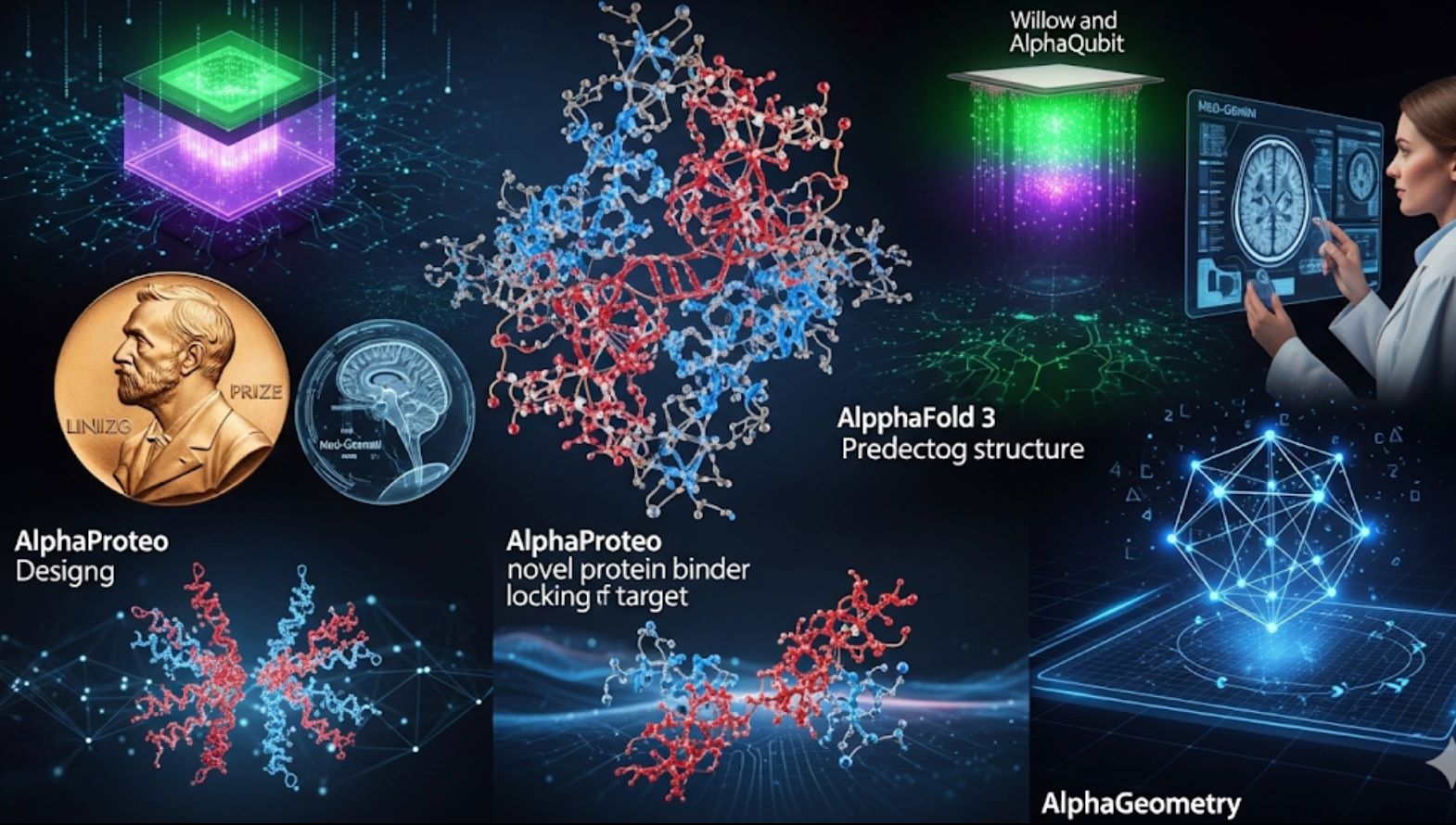

- AlphaFold 3 – 生体分子:2024年11月、Google DeepMind(Isomorphic Labsと共同)が、すべての生体分子(タンパク質、DNA、RNA、リガンドなど)を同時に予測可能な新モデルAlphaFold 3を発表。従来法より約50%高精度でタンパク質と薬物の相互作用を予測します。研究者向けに無料のAlphaFoldサーバーも公開され、タンパク質のみを対象としたAlphaFold 2の予測を拡張し、創薬やゲノム研究に革新をもたらすと期待されています。

- ノーベル賞 – タンパク質折りたたみ:この進歩の重要性は2024年のノーベル化学賞で強調されました。Demis Hassabis氏とJohn Jumper氏(DeepMind)はDavid Baker氏と共にAlphaFold開発で受賞。ノーベル委員会はAlphaFoldが「タンパク質設計に全く新しい可能性を開いた」と評価しました。(これはAIの最も注目される成果の一つです。)

- AlphaProteo – 薬剤設計:同じく2024年、DeepMindは標的タンパク質に強力に結合する新規タンパク質バインダーを設計するAIAlphaProteoを発表。新たな抗体やバイオセンサー、薬剤候補の創出を加速します。

- 数学 – AlphaGeometry:DeepMindのAlphaGeometryとAlphaProofも画期的な成果を挙げました。2024年7月、AlphaGeometry 2は国際数学オリンピックの問題を19秒で解き、銀メダル相当のレベルに到達。高度な高校数学問題をAIが解決した稀有な例です。

- 量子コンピューティング – AlphaQubit & Willow:AIは最先端ハードウェアの進化にも貢献。2024年、Googleは量子コンピュータの誤りを従来法より大幅に高精度で検出するAIベースのデコーダーAlphaQubitを発表。さらに12月には高度な誤り訂正を用い、現代最高のスーパーコンピュータで約10^24年かかる課題を5分未満で解決した新量子チップWillowを公開。これによりWillowは2024年「物理学のブレイクスルー賞」を受賞し、AIの量子技術進展への貢献が示されました。

医療・健康分野でもAIモデルは大きく進歩。例えばGoogleの新しいMed-Gemini(医療データでファインチューニング済み)は、米国医療試験ベンチマーク(USMLE形式)で91.1%のスコアを記録し、従来モデルを大きく上回りました。

放射線学や病理学向けのAIツール(DermやPath Foundationsなど)も画像解析の向上に寄与。全体として、AIはナノスケールでの人間の脳マッピング(AI支援EMイメージング)からアフリカでの結核スクリーニング加速まで、不可欠な研究パートナーとなっています(Google研究者報告)。

ロボティクスと自動化におけるAI

AI搭載ロボットは複雑な現実世界のタスクを学習しています。

テスラのOptimusヒューマノイドロボットは2024年10月の「We, Robot」イベントで公開デモを実施。数十体のOptimusが歩行、立位、さらにはステージ上でダンスを披露しましたが、後の報告では初期デモの一部は遠隔操作であったことが指摘されています。

それでも、このイベントは汎用ロボットへの急速な進展を示しました。

- DeepMindのALOHAロボット:GoogleのAI研究所は家庭用ロボットで顕著な進歩を遂げました。2024年、ALOHA(Autonomous Legged Household Assistant)はAIの計画と視覚のみで靴ひも結び、シャツ掛け、他ロボットの修理、ギア挿入、キッチン清掃を習得。「ALOHA Unleashed」オープンソースでは、二本の腕を協調させる汎用操作が初めて実現されました。

- ロボティック・トランスフォーマー:DeepMindは視覚・言語・行動モデルRT-2(Robotic Transformer 2)を発表。インターネット画像と実ロボットデータの両方から学習可能で、ウェブ知識を活用して人間のように指示を解釈します。テキストコマンドに従い物体を仕分けるロボット支援が実演されました。

- 産業用ロボット:他社も進展。Boston DynamicsはAtlasやSpotの改良を継続(大きなブレイクスルーはなし)、AI駆動の自動運転車も進化(テスラのFull Self-Driving Betaは展開拡大中だが完全自律は未解決)。製造業ではFigure AIなどが家庭用ロボット開発のため資金調達を実施しています。

これらの取り組みは、明示的なプログラミングなしにロボットがより難しいタスクをこなすことを示していますが、真の完全自律ヒューマノイドはまだ先の話です。

Optimus、ALOHA、RT-2のデモはマイルストーンですが、研究者はロボットが安全かつ信頼性高く人間と共存できるようになるにはさらなる努力が必要だと警告しています。

製品、産業、社会におけるAI

AIの影響は日常製品や政策にも及んでいます:

- 消費者向けデバイス:主要テック製品にAIエージェントが組み込まれました。MicrosoftのCopilot(Windows、Office、Bing内蔵)やGoogleのBard/Bard AI(Gemini搭載)はLLMの力をユーザーに提供。Appleのデバイスは前述のApple Intelligenceを搭載し、Nvidiaはクラウドと消費者向けAIを支えるGPUを過去最高の販売台数で供給しました。(Nvidiaは2024年にAIブームで世界最高時価総額企業となりました。)

- 規制 – EU AI法:AIの普及を受け、規制当局も動きました。2024年8月1日に施行されたEU AI法は初の包括的AI規制で、リスクベースの枠組みを確立。低リスクAI(スパムフィルター、ゲームなど)は最小限の規制、透明性ルールによりチャットボットなどはAIであることを明示、高リスクAI(医療や採用ツール)は厳格な監督、明確に許容できないAI(政府による個人の「社会的スコアリング」など)は禁止されます。この規則群はAIガバナンスの大きな前進であり、世界の基準に影響を与えると見込まれています。

- 産業の成長:AI分野は歴史的な資金調達と評価額を記録。OpenAIは2023年末に約1570億ドルの評価額に達し、Anthropic、Inflection、中国のAIスタートアップも数十億ドル規模の資金調達を実施。NVIDIAのAIハードウェア需要は2024年中頃に時価総額3.5兆ドル超えを牽引。これらはAIがテック経済の中心であることを示しています。

>>> これまでにお試しになったことはございますか:AIと人間の知能の比較 ?

要するに、AIはもはや研究室や新奇デモにとどまらず、スマートフォン、自動車、職場、公共政策に組み込まれています。

GPT-4の膨大な知識からAlphaFoldの科学革命まで、これらの進歩はAIの急速な成熟を示しています。

2025年に向けて、これらの成果は私たちの日常生活におけるさらに強力で実用的なAI応用の到来を予感させます。