La inteligencia artificial (IA) ofrece herramientas poderosas para potenciar la creatividad, la productividad y la resolución de problemas, pero debemos usarla con sabiduría. Los expertos enfatizan que la IA debe respetar valores humanos fundamentales como los derechos humanos, la dignidad, la transparencia y la equidad.

Para aprovechar al máximo la IA y evitar errores, sigue estas diez reglas de oro al usar la IA.

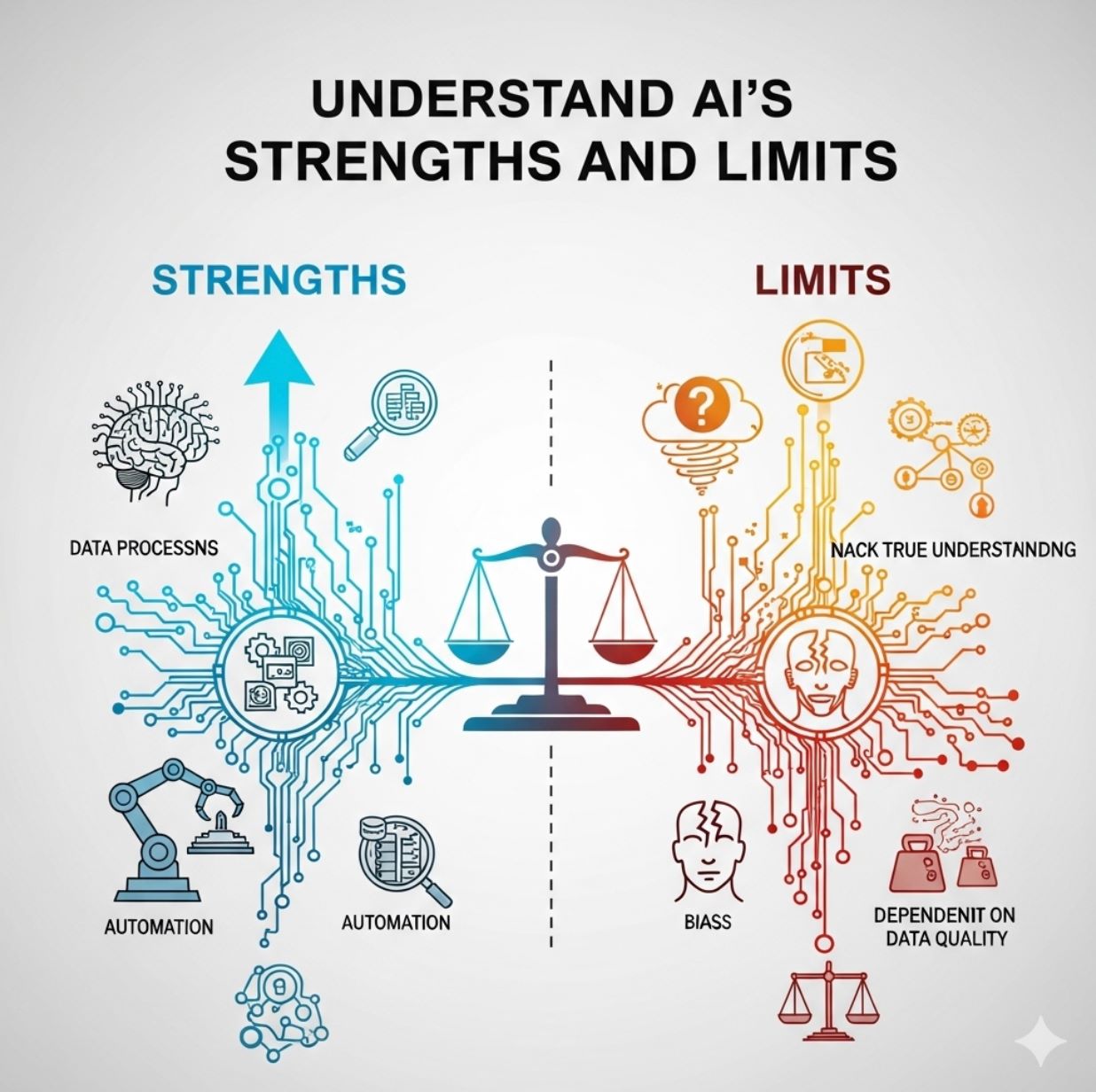

- 1. Comprende las Fortalezas y Límites de la IA

- 2. Comunica Claramente con las Indicaciones

- 3. Protege la Privacidad y la Seguridad de los Datos

- 4. Siempre Verifica Dos Veces los Resultados de la IA

- 5. Sé Consciente de los Sesgos y la Equidad

- 6. Mantén a un Humano en el Proceso (Responsabilidad)

- 7. Usa la IA de Forma Ética y Legal

- 8. Sé Transparente Sobre el Uso de la IA

- 9. Sigue Aprendiendo y Mantente Informado

- 10. Usa Herramientas Confiables y Sigue las Directrices

1. Comprende las Fortalezas y Límites de la IA

La IA es un asistente inteligente, no un oráculo omnisciente. Puede generar ideas y ahorrar tiempo, pero también puede cometer errores o “alucinar” información.

De hecho, investigaciones muestran que las herramientas de búsqueda basadas en IA se equivocan aproximadamente el 60% de las veces. Siempre trata los resultados de la IA como borradores, no como respuestas definitivas.

Para decisiones importantes (como salud o finanzas), involucra a expertos reales – la IA puede ayudar con la investigación, pero no debe reemplazar el juicio humano. En resumen, confía pero verifica: revisa dos y hasta tres veces los resultados de la IA.

2. Comunica Claramente con las Indicaciones

Piensa en tu modelo de IA como un colega muy inteligente. Dale instrucciones claras, detalladas y ejemplos. Las directrices de OpenAI aconsejan: “Sé específico, descriptivo y tan detallado como sea posible sobre el contexto deseado, resultado, extensión, formato, estilo, etc.” al escribir indicaciones.

En lugar de solicitudes vagas (“Escribe sobre deportes”), prueba con: “Escribe una publicación corta y amigable para un blog sobre por qué el ejercicio diario mejora el ánimo, en un tono conversacional.” Buenas indicaciones (contexto + detalles) conducen a respuestas de IA mejores y más precisas.

Esto es básicamente buena comunicación: cuanto más contexto y guía des, mejor podrá ayudarte la IA.

3. Protege la Privacidad y la Seguridad de los Datos

Nunca compartas datos personales o empresariales sensibles con herramientas de IA a menos que estés absolutamente seguro de que es seguro. Piensa dos veces antes de ingresar direcciones, contraseñas, información médica o detalles confidenciales de negocios: los estafadores y hackers pueden aprovechar lo que compartes en línea.

Por ejemplo, si no publicarías algo en redes sociales, no se lo des a un chatbot de IA.

Muchas aplicaciones gratuitas o no verificadas de IA pueden usar mal tus datos o incluso entrenarse con ellos sin consentimiento claro. Usa siempre plataformas conocidas y confiables (o herramientas aprobadas por la empresa) y lee sus políticas de privacidad.

En muchas jurisdicciones, tienes derechos sobre tus datos: por ley, los diseñadores solo deben recopilar los datos estrictamente necesarios y obtener permiso para su uso.

Prácticamente, esto significa desactivar funciones de entrenamiento o memoria cuando sea posible y mantener la información personal fuera de tus consultas.

4. Siempre Verifica Dos Veces los Resultados de la IA

La IA puede inventar hechos o dar respuestas erróneas con confianza. Nunca copies el trabajo de la IA tal cual. Para cada contenido importante generado por IA — hechos, resúmenes, sugerencias — verifica con fuentes confiables.

Un ciclo simple de verificación podría ser:

- Compara las respuestas de la IA con datos oficiales o fuentes expertas.

- Revisa los resultados con herramientas de detección de plagio o gramática (la IA a veces imita texto literalmente, causando problemas de derechos de autor).

- Usa tu propio conocimiento o intuición: si una afirmación suena increíble, búscala.

Recuerda, tú eres responsable de lo que la IA hace por ti. La guía ética de la UNESCO sobre IA enfatiza la supervisión humana: la IA no debe eliminar la “responsabilidad humana última”.

En la práctica, esto significa que tú mantienes el control: edita, verifica y perfecciona el trabajo de la IA antes de publicarlo o actuar según él.

5. Sé Consciente de los Sesgos y la Equidad

Los modelos de IA aprenden de datos creados por humanos, por lo que pueden heredar sesgos sociales. Esto puede afectar decisiones de contratación, aprobación de préstamos o incluso el uso cotidiano del lenguaje.

Regla: piensa críticamente sobre los resultados. Si una IA sigue sugiriendo el mismo género o raza para un trabajo, o si estereotipa grupos, detente y cuestiona.

La Carta de Derechos de la IA de la Casa Blanca dice explícitamente que los sistemas no deben discriminar y deben usarse de manera equitativa. Asimismo, líderes tecnológicos (como Microsoft) listan la equidad como un principio clave: la IA “debe tratar a todas las personas con justicia”.

Para seguir esta regla: usa ejemplos y perspectivas diversas cuando uses IA. Prueba la IA con escenarios que involucren diferentes demografías para ver si los resultados cambian injustamente.

Si detectas sesgos, ajusta tu indicación o cambia de herramienta. Siempre que sea posible, elige sistemas de IA que promuevan la inclusión y aborden los sesgos (muchos ahora incluyen listas de verificación de equidad y auditorías de sesgos).

6. Mantén a un Humano en el Proceso (Responsabilidad)

La IA puede automatizar tareas, pero los humanos deben seguir a cargo. La recomendación de la UNESCO enfatiza que la IA nunca debe “desplazar la responsabilidad humana última”.

En la práctica, esto significa diseñar tu flujo de trabajo para que una persona revise o supervise los resultados de la IA.

Por ejemplo, si usas un chatbot de IA para atención al cliente, capacita al personal para monitorear esas conversaciones y tomar el control si algo falla. Si usas IA para detectar spam o analizar datos, verifica que los filtros funcionen correctamente y ajústalos según sea necesario.

Siempre planifica un “plan de contingencia”: si la IA hace una sugerencia inusual o no entiende algo, el operador humano puede intervenir o apagarla.

La responsabilidad también implica mantener registros: anota cuándo y cómo usaste la IA, para poder explicar tus acciones si es necesario.

Algunas organizaciones incluso requieren que los proyectos de IA sean auditables, con registros de decisiones. Esto asegura que alguien pueda investigar y corregir problemas, lo que se alinea con los principios de transparencia y responsabilidad.

7. Usa la IA de Forma Ética y Legal

Que puedas pedirle algo a una IA no significa que debas hacerlo. Siempre sigue la ley y las normas morales. No uses la IA para tareas prohibidas o dañinas (por ejemplo, crear malware, plagiar textos con derechos de autor o engañar a otros).

Respeta la propiedad intelectual: si la IA ayuda a generar una imagen o artículo, ten cuidado de dar crédito cuando sea necesario y evita copiar directamente.

La Carta de Derechos de la IA de EE. UU. enfatiza la privacidad de datos y la equidad, pero también implica que debes mantener el uso de la IA dentro de límites éticos.

Por ejemplo, antes de usar IA para trabajos sensibles, verifica los requisitos de cumplimiento: salud y finanzas suelen tener reglas adicionales (HIPAA, GDPR, etc.). Muchos países están aprobando leyes sobre IA (como la Ley de IA de la UE que prioriza la seguridad y los derechos). Mantente informado para no incumplir regulaciones nuevas sin querer.

En resumen: haz lo correcto. Si una solicitud parece dudosa o ilegal, probablemente lo sea. En caso de duda, consulta a un supervisor o asesor legal.

8. Sé Transparente Sobre el Uso de la IA

La transparencia genera confianza. Si usas IA para generar contenido (artículos, informes, código, etc.), considera informar a tu audiencia o equipo. Explica cómo la IA está ayudando (por ejemplo, “Este resumen fue redactado por IA y luego editado por mí”).

El plan de la Casa Blanca incluso incluye un principio de “Aviso y Explicación”: las personas deben saber cuándo se usan sistemas de IA y cómo afectan las decisiones.

Por ejemplo, si una empresa usa IA para evaluar candidatos a un empleo, los postulantes deben ser informados.

En términos prácticos, etiqueta el contenido generado por IA y sé claro sobre las fuentes de datos. Si adaptas un texto de otra persona con IA, cita al autor original. En un entorno laboral, comparte tu flujo de trabajo con IA con colegas (qué herramientas usaste y qué pasos seguiste).

Esta apertura no solo cumple con estándares éticos, sino que ayuda a otros a aprender y detectar problemas temprano. Recuerda, la responsabilidad implica respaldar tus resultados y dar crédito donde corresponde.

9. Sigue Aprendiendo y Mantente Informado

La IA evoluciona rápido, así que mantén tus habilidades y conocimientos actualizados. Sigue noticias confiables (blogs tecnológicos, foros oficiales de IA o recomendaciones internacionales como las de la UNESCO) para conocer nuevos riesgos y mejores prácticas. La recomendación de la UNESCO destaca la “alfabetización en IA”: la educación pública y la capacitación son clave para un uso seguro de la IA.

Aquí te mostramos cómo practicar el aprendizaje continuo:

- Toma cursos en línea o seminarios web sobre seguridad y ética en IA.

- Infórmate sobre nuevas funciones de las herramientas de IA que usas.

- Comparte consejos y recursos con amigos o colegas (por ejemplo, cómo escribir mejores indicaciones o detectar sesgos en IA).

- Enseña a usuarios jóvenes (o niños) que la IA puede ayudar, pero debe ser cuestionada.

Al aprender juntos, construimos una comunidad que usa la IA con sabiduría. Al fin y al cabo, todos los usuarios comparten la responsabilidad de asegurar que la IA beneficie a todos.

10. Usa Herramientas Confiables y Sigue las Directrices

Finalmente, utiliza herramientas de IA reputadas y sigue las guías oficiales. Descarga aplicaciones de IA solo de fuentes oficiales (por ejemplo, el sitio web legítimo o la tienda de aplicaciones) para evitar malware o fraudes.

En el trabajo, usa plataformas de IA aprobadas por la empresa que cumplan con estándares de seguridad y privacidad.

Apoya a proveedores de IA que se comprometan con el desarrollo ético. Por ejemplo, prefiere herramientas con políticas claras de datos y compromisos éticos (como muchas grandes empresas tecnológicas ahora publican). Usa funciones de seguridad integradas: algunas plataformas permiten desactivar el entrenamiento con datos o configurar filtros de contenido.

Y siempre haz copias de seguridad de tus propios datos independientemente del servicio de IA, para no quedarte bloqueado si algo falla.

>>> Puede que necesites: Consejos para usar la IA de manera efectiva para principiantes

En resumen, la IA es un socio poderoso cuando se usa con responsabilidad. Siguiendo estas diez reglas de oro – respetando la privacidad, verificando hechos, manteniéndote ético e informado, y manteniendo a los humanos en control – puedes aprovechar los beneficios de la IA de forma segura.

A medida que la tecnología avanza, estos principios ayudarán a garantizar que la IA siga siendo una fuerza para el bien.