電影中的人工智能與現實有何不同?讓我們在本文中詳細探討,分辨虛構與現實!

在科幻電影中,AI經常被塑造成完全有感知的生命體或具有人類情感、個人動機及超凡能力的人形機械人。電影中的AI從助人伴侶(如《星球大戰》的機械人)到邪惡霸主(如《終結者》的天網)不等。這些描繪為故事增色不少,但大大誇大了現今的技術水平。

實際上,現有的AI都是一組演算法和統計模型,沒有意識或情感。現代系統能處理數據和識別模式,但它們缺乏真正的自我意識或意圖:

-

感知與情感:電影中AI會愛、會怕,甚至會建立友誼(想想《機械姬》或《她》)。但真實的AI只是執行程式計算,沒有主觀體驗。

正如某分析指出,真正的AI「仍然是一組演算法……沒有意識」。它只能透過統計模式匹配模仿對話或情感,並非真正理解或感受。 -

自主性:電影中的AI能自由做出複雜獨立決策,甚至反抗人類(如《終結者》或《機械公敵》)。相反,真實的AI始終需要明確的人類指令。

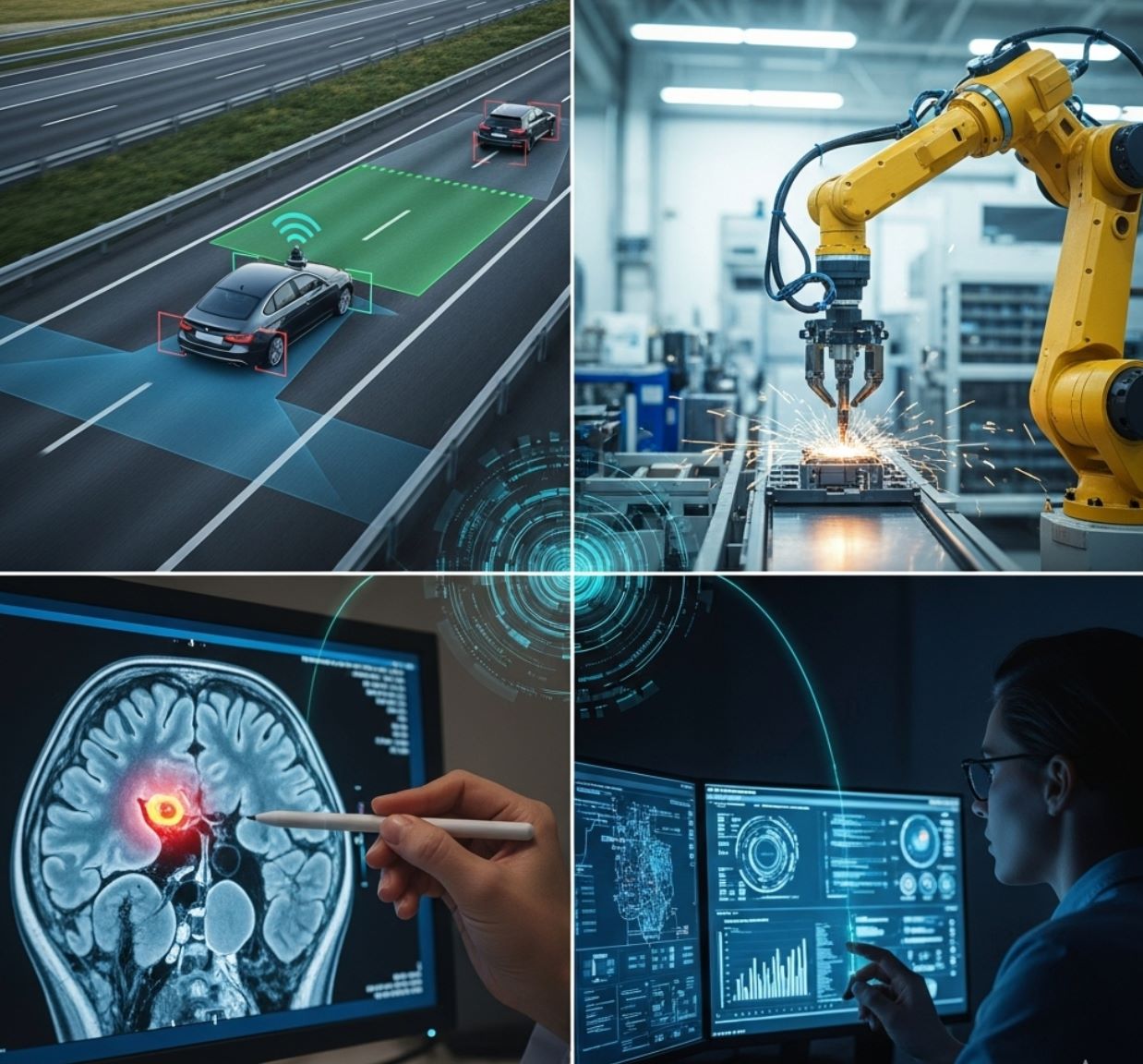

現今的AI工具只擅長非常狹窄的任務(例如醫療影像分析或路線規劃),且只能在人類監督下運作。它們無法自主「決定接管」或追求程式外的目標。

事實上,專家強調賦予機械人內在動機是「相當荒謬」——AI本質上是人類創造的工具,而非獨立代理。 -

形態與功能:好萊塢的機械人常被描繪成人形且多才多藝(能行走、說話及處理複雜工作)。實際上,機械人大多是高度專門化的機器。

它們可能負責包裝雜貨或製造汽車,但外觀和行為與電影中流暢的人形機械人截然不同。正如一位業界觀察者所說,真實機械人「缺乏電影中機械人的多功能性和適應力」。

大多數真實機械人是為特定功能(組裝、清潔、監控)而設計,且在這些任務之外缺乏靈巧性或感知能力。 -

範圍與能力:電影往往展示一個單一AI控制龐大系統(如《駭客任務》或天網),或將所有任務融合成一個意識。實際的AI遠未達到如此集中或全能。

現實世界運行著眾多獨立的AI系統——每個系統專注於一個目的(如語言翻譯、面部識別或駕駛)。沒有一個「超級智能」掌控一切。

事實上,當今的AI高度分散:每個系統處理自己的專業領域。認為一個AI能掌控所有技術是過度簡化。 -

準確性與可靠性:電影中的AI幾乎總是能隨時提供完美的數據或分析。實際上,AI輸出可能有缺陷。

研究發現,現代AI會「幻覺」信息——它可能產生聽起來自信但事實錯誤或帶偏見的答案。例如,BBC研究發現,像ChatGPT和Google Gemini這類工具超過一半的答案存在重大錯誤。

簡言之,真實的AI經常誤導或需要人類修正,與電影中無誤的形象大相逕庭。 -

倫理與控制:電影喜歡描寫AI起義和末日陰謀(叛變機械、邪惡機械人等)。現實世界的重點截然不同。

研究人員和企業專注於負責任的AI:建立安全機制、測試偏見並遵守倫理準則。

正如一位影評人指出,業界積極推動「倫理指導方針、規範和安全措施」以防止傷害——這與電影中常見的失控混亂大相逕庭。

專家如Oren Etzioni提醒我們,「天網和終結者不會在眼前出現」。當今AI面臨的挑戰是隱私、公平和可靠性,而非機械人大軍。

現實世界的AI:它能做什麼(和不能做什麼)

真正的AI是以任務為導向,而非魔法般的存在。現代AI(「狹義AI」)能完成一些令人印象深刻的工作,但範圍有限。

例如,大型語言模型如ChatGPT能寫文章或進行對話,但它們不理解語意。它們是透過在大量數據中尋找統計模式來生成文字。

事實上,研究人員指出這些模型產生流暢的答案,但「對文本含義毫無理解」——它們本質上是「巨大的魔術八號球」。這意味著它們會重複訓練數據中的偏見,或在提示下「幻覺」出事實。

其他真實的AI成功案例包括影像識別(電腦視覺系統能辨識物體或診斷某些醫療狀況)和數據分析(AI能發現詐騙或優化配送路線)。自動駕駛車輛使用AI演算法來操控汽車,但這些系統仍遠非完美——它們會被異常情況弄糊塗。

即使是先進的機械人公司(如波士頓動力)也只製造出具有人類般動作的機械人,但這些機械人需要大量工程支持,遠不及電影中機械人的優雅和多用途。

總之,真正的AI既複雜又狹窄。正如一位專家所言,AI擅長狹窄、具體的任務,但「不夠廣泛、不具自我反思,也沒有意識」,不像人類。它沒有情感或自由意志。

AI不是有生命的存在。儘管公眾有些混淆,沒有證據顯示任何AI擁有意識或自我覺察。

研究證實,現有技術下AI極不可能真正具備自我意識。AI可能模擬人類反應,但它不會真正體驗事物。

例如,語音助理(Siri、Alexa)可能會回應,但若誤解指令,它們只會耸肩說「我沒聽懂」——它們沒有感覺。同樣,圖像生成AI能創造逼真圖片,但它們不會以任何人類方式「看見」或感知。實質上,真正的AI更像是高級計算器或靈活的資料庫,而非思考的生命。

常見迷思破解

-

「AI必定會殺死或奴役我們。」這是好萊塢的誇大宣傳。許多現實世界的專家強調,末日AI情景在我們有生之年極不可能發生。

現今的AI缺乏自主性或惡意意圖。艾倫研究所的一位科學家安慰說:「天網和終結者不會在眼前出現」。

與其說是世界統治,當前AI更可能帶來微妙問題:偏見決策、隱私侵犯、錯誤資訊。

評論者指出,當今AI的真實危害——如因偏見演算法導致的錯誤逮捕或深偽技術濫用——關乎社會影響,而非機械人大軍。 -

「AI會解決我們所有問題。」同樣是電影幻想。雖然AI工具能自動化繁瑣工作(如資料輸入或例行客服),但無法取代人類判斷或創意。

如果給電影中的AI一個寫劇本或製作電影藝術的任務,它可能產出胡言亂語或充滿陳詞濫調的草稿。

真正的AI需要謹慎的人類指導、優質訓練數據,且常常犯錯,需要人類修正。

即使在好萊塢,製片廠更多用AI來輔助特效或剪輯,而非真正創作——導演仍然需要人類編劇和演員。 -

「AI是無偏見且客觀的。」不正確。真正的AI從人類數據中學習,因此會繼承人類偏見。

例如,如果AI以某些群體被不公平拒絕的求職資料訓練,它可能複製這種歧視。

電影很少呈現這點;反而想像AI擁有完美邏輯或極端邪惡。真相更複雜。

我們必須持續監控偏見和不公,這是現實世界的挑戰,與機械人攻城無關。 -

「一旦AI進步,我們將無法控制。」像《機械姬》或《終結者》這類電影喜歡描寫AI智勝創造者的情節。

實際上,AI開發仍由人類嚴密控制。工程師持續測試和監控AI系統。

政府和行業組織正制定倫理準則和規範以確保AI安全。

例如,公司會設置「緊急停止開關」或監督機制,必要時關閉AI。

與電影中突然獲得自由意志的AI不同,真實AI完全依賴我們的程式設計和使用方式。

日常生活中的AI

如今,你可能比想像中更常遇到AI——但不是街上行走的機械人。

AI已嵌入許多應用和服務中:

-

虛擬助理:如Siri、Alexa和Google助理利用AI(語音識別和簡單對話)回答問題或控制智能家居設備。

不過,它們經常誤解問題——例如BBC測試發現這些聊天機器人超過一半時間對時事給出錯誤答案。

它們能設置計時器和講笑話,但經常需要人類修正。 -

推薦系統:當Netflix推薦電影或Spotify播放你喜歡的新歌時,這是AI根據你過去的選擇進行模式匹配。

這也是狹義AI——專注於一件事,且做得很好。 -

自動駕駛車輛:特斯拉和Waymo等公司使用AI來操控汽車。

這些系統能在高速公路上導航,但在複雜的城市駕駛中仍有困難,且需要人類駕駛隨時接管。

它們遠未達到電影中常見的自駕車水平。 -

內容創作:新興AI工具能生成文字、圖像或音樂。

它們展示了AI看似創意十足的一面,但結果仍有好有壞。

例如,AI藝術生成器能創造有趣的視覺作品,但常伴隨奇怪錯誤(多餘的肢體、扭曲文字等),且背後沒有真正的「構思」。

在電影《她》中,AI能作曲和寫詩;但現實中,生成內容往往是衍生的,且需大量人類編輯才能連貫。

為何存在差距

電影製作人刻意誇大AI能力以講述引人入勝的故事。他們放大AI的能力來探討愛、身份或權力等主題。

例如,《她》和《銀翼殺手2049》等電影利用先進AI作為背景,提出關於意識和人性的深刻問題。

這種創作自由並非紀錄片,而是一種藝術手法,旨在「與普世主題產生共鳴」。從這角度看,好萊塢並非說謊,而是將想法推向極致。

然而,這些戲劇化的描繪確實產生影響。它們激發我們的想像力,並推動公眾討論。通過展示有意識和自主的AI,電影引發關於隱私、自動化和倫理的辯論。

電影促使我們思考:如果AI成真,我們應該制定什麼規則?工作和個人自由會怎樣?即使情節是虛構,背後的問題卻非常真實。正如一位分析師所言,誇大電影中的AI「催化了關於科技未來的重要討論」。

>>> 現在點擊加入:比較人工智能與人類智慧

歸根究底,電影中的AI與現實AI天差地別。好萊塢呈現的是有感知機械人和末日叛亂的幻想,而現實則是有用的演算法和許多未解決的挑戰。

專家強調,我們應該聚焦當前的真實問題——消除偏見、保護隱私,確保AI被善用——而非恐懼不可能的科幻情節。

教育和公開對話是縮小銀幕虛構與現實科技差距的關鍵。正如一位評論者所言,我們需要「培養公眾對AI虛實分明的理解」。

保持資訊透明,我們既能欣賞啟發人心的科幻作品,也能對AI未來做出明智決策。

簡言之:享受電影,但記住你在銀幕上看到的AI,尚未出現在眼前。