Apakah Model Bahasa Besar?

Model Bahasa Besar (LLM) adalah jenis kecerdasan buatan canggih yang dilatih menggunakan sejumlah besar data teks untuk memahami, menghasilkan, dan memproses bahasa manusia. LLM menggerakkan banyak aplikasi AI moden seperti chatbot, alat terjemahan, dan sistem penciptaan kandungan. Dengan mempelajari corak daripada berbilion perkataan, model bahasa besar dapat memberikan jawapan tepat, menghasilkan teks seperti manusia, dan menyokong tugasan merentasi pelbagai industri.

Model Bahasa Besar (LLM) adalah sistem AI yang dilatih menggunakan set data teks yang sangat besar untuk memahami dan menghasilkan bahasa seperti manusia. Dalam istilah mudah, LLM telah diberi makan jutaan atau berbilion perkataan (sering kali dari Internet) supaya ia dapat meramalkan dan menghasilkan teks mengikut konteks. Model ini biasanya dibina menggunakan rangkaian neural deep learning – paling lazim menggunakan seni bina transformer. Disebabkan skala mereka, LLM boleh melaksanakan banyak tugasan bahasa (berbual, terjemahan, penulisan) tanpa perlu diprogram secara khusus untuk setiap tugasan.

Ciri-ciri Teras Model Bahasa Besar

Ciri-ciri utama model bahasa besar termasuk:

Data Latihan yang Sangat Besar

LLM dilatih menggunakan korpus teks yang luas (berbilion halaman). Set latihan "besar" ini memberikan mereka pengetahuan luas tentang tatabahasa dan fakta.

Seni Bina Transformer

Mereka menggunakan rangkaian neural transformer dengan self-attention, yang bermaksud setiap perkataan dalam ayat dibandingkan dengan setiap perkataan lain secara serentak. Ini membolehkan model belajar konteks dengan cekap.

Berbilion Parameter

Model mengandungi jutaan atau berbilion berat (parameter). Parameter ini menangkap corak kompleks dalam bahasa. Contohnya, GPT-3 mempunyai 175 bilion parameter.

Pembelajaran Kendiri

LLM belajar dengan meramalkan perkataan yang hilang dalam teks tanpa label manusia. Contohnya, semasa latihan model cuba meneka perkataan seterusnya dalam ayat. Dengan melakukan ini berulang kali pada data besar, model menginternalisasi tatabahasa, fakta, dan juga sedikit penalaran.

Penalaan Halus dan Arahan

Selepas pra-latihan, LLM boleh ditala halus untuk tugasan tertentu atau dibimbing melalui arahan. Ini bermakna model yang sama boleh menyesuaikan diri dengan tugasan baru seperti soal jawab perubatan atau penulisan kreatif dengan melaraskan menggunakan set data lebih kecil atau arahan pintar.

Bersama-sama, ciri-ciri ini membolehkan LLM memahami dan menghasilkan teks seperti manusia. Dalam praktiknya, LLM yang dilatih dengan baik boleh menafsir konteks, melengkapkan ayat, dan menghasilkan respons lancar mengenai banyak topik (dari perbualan santai hingga subjek teknikal) tanpa kejuruteraan khusus tugasan.

Cara Kerja LLM: Seni Bina Transformer

LLM biasanya menggunakan seni bina rangkaian transformer. Seni bina ini adalah rangkaian neural dalam dengan banyak lapisan nod yang bersambung. Komponen utama adalah self-attention, yang membolehkan model memberi berat kepentingan setiap perkataan berbanding semua perkataan lain dalam ayat secara serentak.

Pemprosesan Berurutan

- Memproses perkataan satu persatu

- Latihan lebih perlahan pada GPU

- Pemahaman konteks terhad

Pemprosesan Selari

- Memproses keseluruhan input serentak

- Latihan jauh lebih pantas pada GPU

- Pemahaman konteks yang unggul

Berbeza dengan model berurutan lama (seperti RNN), transformer memproses keseluruhan input secara selari, membolehkan latihan jauh lebih pantas pada GPU. Semasa latihan, LLM melaraskan berbilion parameternya dengan cuba meramalkan setiap perkataan seterusnya dalam korpus teks yang sangat besar.

Seiring masa, proses ini mengajar model tatabahasa dan hubungan semantik. Hasilnya adalah model yang, apabila diberi arahan, boleh menghasilkan bahasa yang koheren dan relevan mengikut konteks secara sendiri.

Aplikasi LLM

Kerana mereka memahami dan menghasilkan bahasa semula jadi, LLM mempunyai banyak aplikasi merentasi industri. Beberapa kegunaan biasa adalah:

AI Perbualan

Penjanaan Kandungan

Terjemahan dan Ringkasan

Menjawab Soalan

Penjanaan Kod

Penyelidikan dan Analisis

Contohnya, GPT-3.5 dan GPT-4 di belakang ChatGPT mempunyai ratusan bilion parameter, manakala model Google (PaLM dan Gemini) dan lain-lain beroperasi secara serupa. Pembangun sering berinteraksi dengan LLM ini melalui perkhidmatan awan atau perpustakaan, menyesuaikannya untuk tugasan khusus seperti ringkasan dokumen atau bantuan pengaturcaraan.

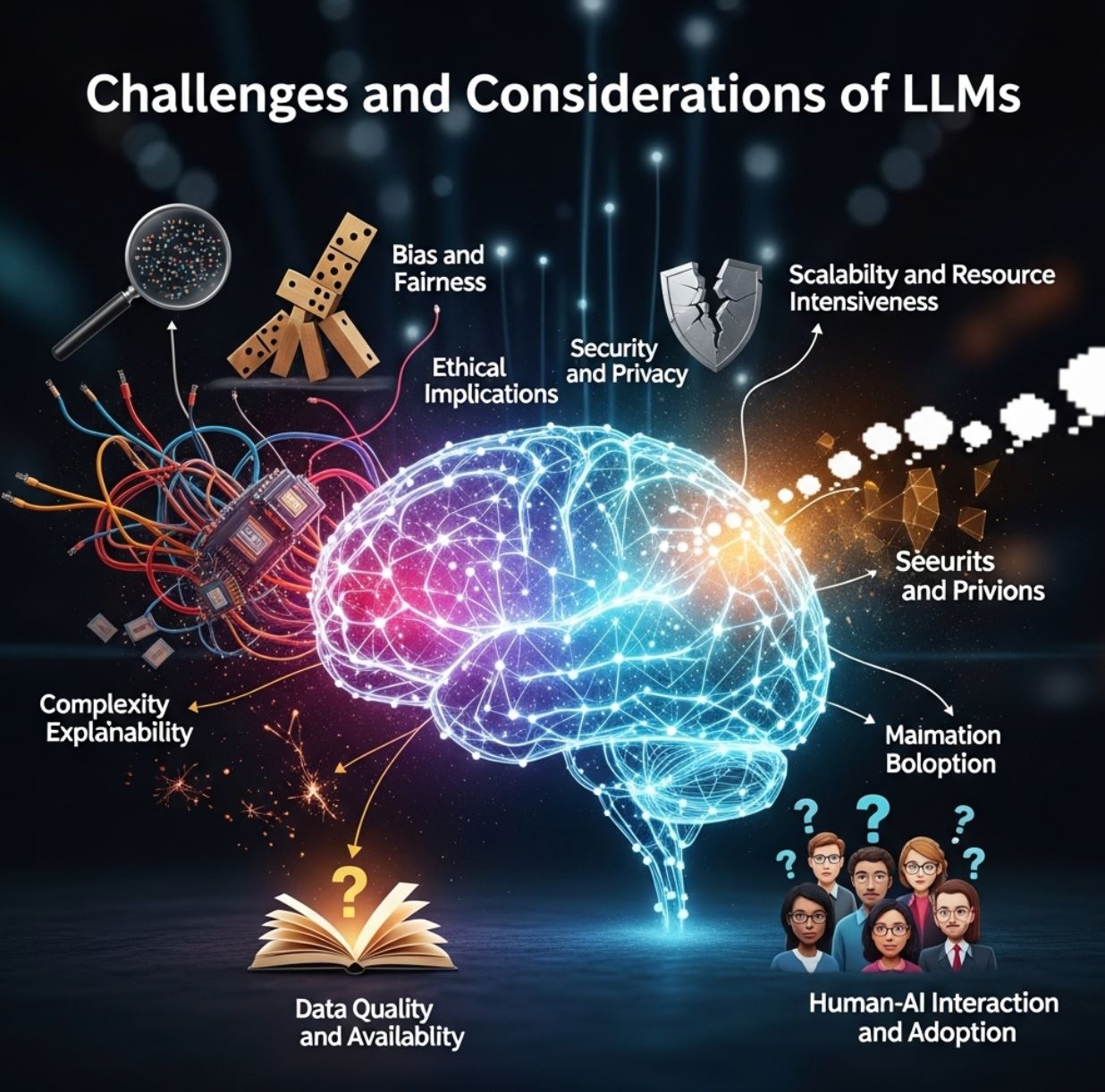

Cabaran dan Pertimbangan

LLM sangat berkuasa, tetapi tidak sempurna. Kerana mereka belajar dari teks dunia sebenar, mereka boleh menghasilkan bias yang terdapat dalam data latihan mereka. LLM mungkin menghasilkan kandungan yang berat sebelah budaya, atau mengeluarkan bahasa yang menyinggung atau stereotaip jika tidak ditapis dengan teliti.

Isu Bias

Halusinasi

Keperluan Sumber

Pengesahan Ketepatan

Isu lain ialah halusinasi: model boleh menghasilkan jawapan yang kedengaran lancar tetapi salah atau direka-reka. Contohnya, LLM mungkin dengan yakin mereka cipta fakta atau nama palsu. Kesilapan ini berlaku kerana model sebenarnya meneka sambungan teks yang paling munasabah, bukan mengesahkan fakta.

Walaupun begitu, pengguna LLM mesti sedar bahawa keputusan harus diperiksa untuk ketepatan dan bias. Selain itu, latihan dan penggunaan LLM memerlukan sumber pengkomputeran yang besar (GPU/TPU berkuasa dan banyak data), yang boleh mahal.

Ringkasan dan Pandangan Masa Depan

Secara ringkas, model bahasa besar adalah sistem AI berasaskan transformer yang dilatih menggunakan sejumlah besar data teks. Ia telah mempelajari corak bahasa melalui latihan kendiri, memberikan keupayaan untuk menghasilkan teks yang lancar dan relevan mengikut konteks. Disebabkan skala mereka, LLM boleh mengendalikan pelbagai tugasan bahasa – dari berbual dan menulis hingga menterjemah dan mengod – sering kali setanding atau melebihi tahap kefasihan manusia.

Model ini bersedia untuk mengubah cara kita berinteraksi dengan teknologi dan mengakses maklumat.

— Penyelidik AI terkemuka

Sehingga 2025, LLM terus berkembang (termasuk peluasan multimodal yang mengendalikan imej atau audio) dan kekal di barisan hadapan inovasi AI, menjadikannya komponen utama aplikasi AI moden.

No comments yet. Be the first to comment!