ما هو نموذج اللغة الكبير؟

نموذج اللغة الكبير (LLM) هو نوع متقدم من الذكاء الاصطناعي مدرب على كميات هائلة من بيانات النصوص لفهم اللغة البشرية وتوليدها ومعالجتها. تدعم نماذج اللغة الكبيرة العديد من تطبيقات الذكاء الاصطناعي الحديثة مثل روبوتات المحادثة وأدوات الترجمة وأنظمة إنشاء المحتوى. من خلال تعلم الأنماط من مليارات الكلمات، يمكن لنماذج اللغة الكبيرة تقديم إجابات دقيقة، وإنشاء نص يشبه النص البشري، ودعم المهام عبر الصناعات.

نماذج اللغة الكبيرة (LLMs) هي أنظمة ذكاء اصطناعي مدربة على مجموعات ضخمة من النصوص لفهم وتوليد لغة تشبه اللغة البشرية. ببساطة، تم تزويد نموذج اللغة الكبير بـ ملايين أو مليارات الكلمات (غالبًا من الإنترنت) ليتمكن من التنبؤ بالنص وإنتاجه في السياق المناسب. عادةً ما تُبنى هذه النماذج على شبكات عصبية تعلم عميق – وغالبًا ما تكون على بنية المحول. وبفضل حجمها الكبير، يمكن لنماذج اللغة الكبيرة أداء العديد من مهام اللغة (المحادثة، الترجمة، الكتابة) دون الحاجة إلى برمجتها صراحة لكل مهمة.

الميزات الأساسية لنماذج اللغة الكبيرة

تشمل الميزات الرئيسية لنماذج اللغة الكبيرة ما يلي:

بيانات تدريب ضخمة

تُدرّب نماذج اللغة الكبيرة على مجموعات نصية ضخمة (مليارات الصفحات). تمنحهم هذه المجموعة "الكبيرة" من البيانات معرفة واسعة بالقواعد والحقائق.

بنية المحول

تستخدم هذه النماذج شبكات المحول العصبية مع الانتباه الذاتي، مما يعني مقارنة كل كلمة في الجملة بكل كلمة أخرى في نفس الوقت. هذا يسمح للنموذج بتعلم السياق بكفاءة.

مليارات المعاملات

تحتوي النماذج على ملايين أو مليارات الأوزان (المعاملات). تلتقط هذه المعاملات أنماطًا معقدة في اللغة. على سبيل المثال، يحتوي GPT-3 على 175 مليار معاملة.

التعلم الذاتي الموجه

تتعلم نماذج اللغة الكبيرة من خلال التنبؤ بالكلمات المفقودة في النص دون الحاجة إلى تسميات بشرية. على سبيل المثال، أثناء التدريب يحاول النموذج تخمين الكلمة التالية في الجملة. من خلال تكرار هذا على بيانات ضخمة، يستوعب النموذج القواعد والحقائق وحتى بعض الاستدلال.

الضبط الدقيق والتوجيه

بعد التدريب المسبق، يمكن ضبط نماذج اللغة الكبيرة على مهمة محددة أو توجيهها عبر مطالبات. هذا يعني أن نفس النموذج يمكنه التكيف مع مهام جديدة مثل الأسئلة الطبية أو الكتابة الإبداعية عن طريق تعديله باستخدام مجموعة بيانات أصغر أو تعليمات ذكية.

معًا، تتيح هذه الميزات لنموذج اللغة الكبير فهم وتوليد النصوص مثل الإنسان. عمليًا، يمكن لنموذج مدرب جيدًا استنتاج السياق، إكمال الجمل، وإنتاج ردود سلسة في مواضيع متعددة (من المحادثات العادية إلى المواضيع التقنية) دون هندسة خاصة لكل مهمة.

كيف تعمل نماذج اللغة الكبيرة: بنية المحول

عادةً ما تستخدم نماذج اللغة الكبيرة بنية شبكة المحول. هذه البنية هي شبكة عصبية عميقة تحتوي على طبقات عديدة من العقد المترابطة. أحد المكونات الرئيسية هو الانتباه الذاتي، الذي يسمح للنموذج بتقييم أهمية كل كلمة بالنسبة لجميع الكلمات الأخرى في الجملة دفعة واحدة.

المعالجة التسلسلية

- معالجة الكلمات واحدة تلو الأخرى

- تدريب أبطأ على وحدات معالجة الرسوميات

- فهم محدود للسياق

المعالجة المتوازية

- معالجة الإدخال بالكامل في وقت واحد

- تدريب أسرع بكثير على وحدات معالجة الرسوميات

- فهم متفوق للسياق

على عكس النماذج التسلسلية القديمة (مثل RNNs)، تعالج المحولات الإدخال بالكامل بشكل متوازي، مما يسمح بتدريب أسرع بكثير على وحدات معالجة الرسوميات. أثناء التدريب، يقوم نموذج اللغة الكبير بضبط مليارات معاملاته من خلال محاولة التنبؤ بكل كلمة تالية في مجموعته الضخمة من النصوص.

مع مرور الوقت، يعلم هذا النموذج القواعد والعلاقات الدلالية. والنتيجة هي نموذج يمكنه، عند إعطائه مطالبة، توليد لغة متماسكة وذات صلة بالسياق بشكل مستقل.

تطبيقات نماذج اللغة الكبيرة

نظرًا لأنها تفهم وتولد اللغة الطبيعية، تمتلك نماذج اللغة الكبيرة العديد من التطبيقات عبر الصناعات. بعض الاستخدامات الشائعة هي:

الذكاء الاصطناعي الحواري

توليد المحتوى

الترجمة والتلخيص

الإجابة على الأسئلة

توليد الشيفرة البرمجية

البحث والتحليل

على سبيل المثال، يحتوي GPT-3.5 وGPT-4 خلف ChatGPT على مئات المليارات من المعاملات، بينما تعمل نماذج جوجل (PaLM وجيميني) وغيرها بطريقة مماثلة. غالبًا ما يتفاعل المطورون مع هذه النماذج عبر خدمات سحابية أو مكتبات، مخصصين إياها لمهام محددة مثل تلخيص الوثائق أو المساعدة في البرمجة.

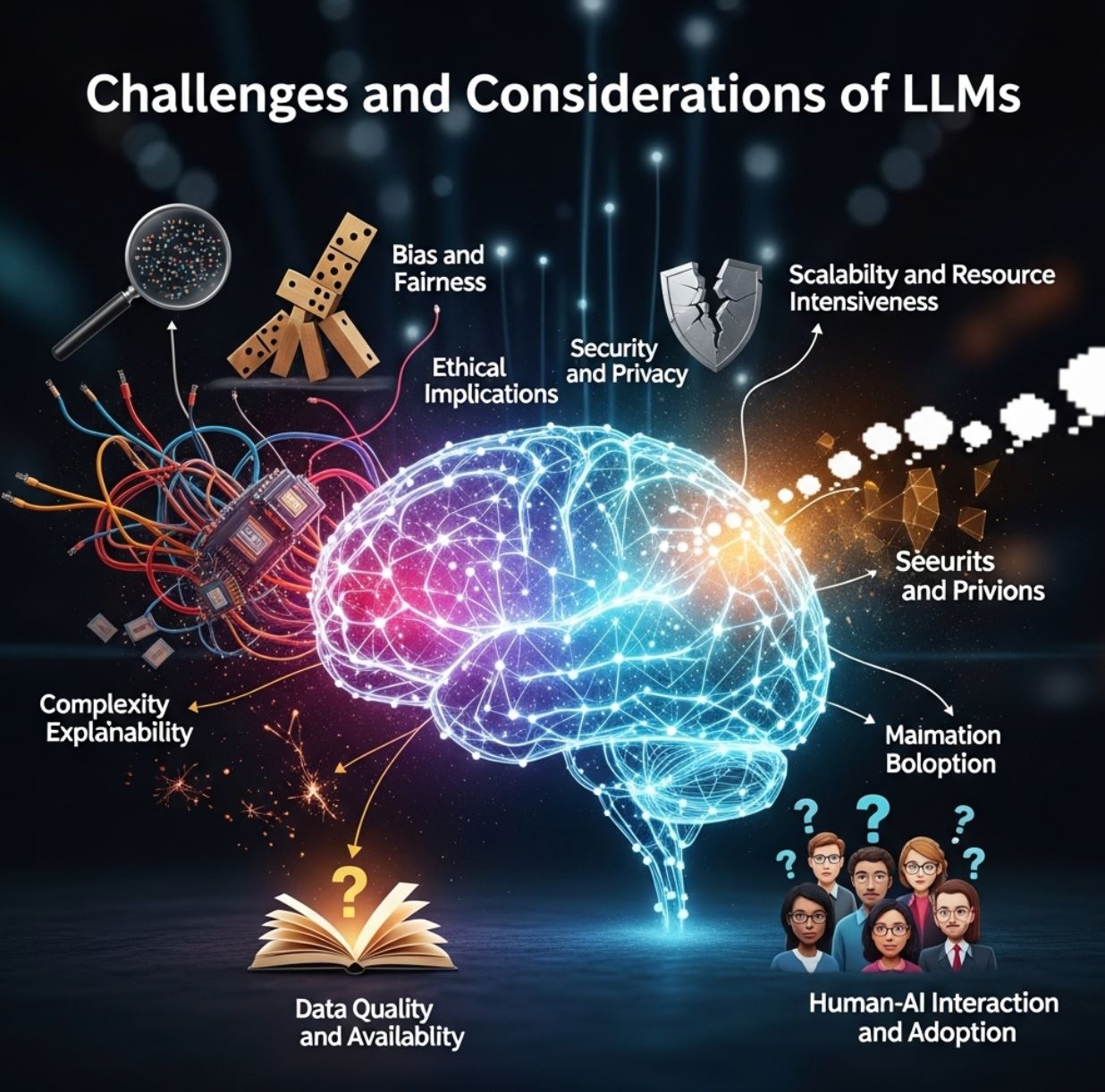

التحديات والاعتبارات

نماذج اللغة الكبيرة قوية، لكنها ليست مثالية. لأنها تتعلم من نصوص العالم الحقيقي، يمكنها إعادة إنتاج التحيزات الموجودة في بيانات التدريب. قد ينتج نموذج اللغة الكبير محتوى متحيزًا ثقافيًا، أو قد يصدر لغة مسيئة أو نمطية إذا لم يتم تصفيتها بعناية.

مشاكل التحيز

الهلوسات

متطلبات الموارد

التحقق من الدقة

مشكلة أخرى هي الهلوسات: يمكن للنموذج إنتاج إجابات تبدو سلسة لكنها خاطئة أو مختلقة تمامًا. على سبيل المثال، قد يخترع نموذج اللغة الكبير حقيقة أو اسمًا كاذبًا بثقة. تحدث هذه الأخطاء لأن النموذج يخمن ببساطة الاستمرارية الأكثر احتمالًا للنص، وليس التحقق من الحقائق.

ومع ذلك، يجب أن يكون مستخدمو نماذج اللغة الكبيرة على علم بضرورة التحقق من دقة النتائج والتحيز. بالإضافة إلى ذلك، يتطلب تدريب وتشغيل نماذج اللغة الكبيرة موارد حوسبة ضخمة (وحدات معالجة رسومية/وحدات معالجة تينسور قوية وكميات كبيرة من البيانات)، مما قد يكون مكلفًا.

الملخص والنظرة المستقبلية

باختصار، نموذج اللغة الكبير هو نظام ذكاء اصطناعي مبني على المحول ومدرب على كميات هائلة من بيانات النصوص. تعلم أنماط اللغة من خلال التدريب الذاتي الموجه، مما يمنحه القدرة على توليد نصوص سلسة وذات صلة بالسياق. وبفضل حجمه، يمكن لنماذج اللغة الكبيرة التعامل مع مجموعة واسعة من مهام اللغة – من المحادثة والكتابة إلى الترجمة والبرمجة – غالبًا بمستوى طلاقة يضاهي أو يتجاوز البشر.

هذه النماذج على وشك إعادة تشكيل طريقة تفاعلنا مع التكنولوجيا والوصول إلى المعلومات.

— كبار الباحثين في الذكاء الاصطناعي

حتى عام 2025، تستمر نماذج اللغة الكبيرة في التقدم (بما في ذلك التوسعات متعددة الوسائط التي تتعامل مع الصور أو الصوت) وتظل في طليعة ابتكارات الذكاء الاصطناعي، مما يجعلها مكونًا مركزيًا في تطبيقات الذكاء الاصطناعي الحديثة.

No comments yet. Be the first to comment!