מהו מודל שפה גדול?

מודל שפה גדול (LLM) הוא סוג מתקדם של בינה מלאכותית המאומן על כמויות עצומות של נתוני טקסט כדי להבין, ליצור ולעבד שפה אנושית. מודלים אלו מפעילים יישומי בינה מלאכותית מודרניים רבים כגון צ'אטבוטים, כלי תרגום ומערכות יצירת תוכן. על ידי למידת דפוסים ממיליארדי מילים, מודלי שפה גדולים יכולים לספק תשובות מדויקות, ליצור טקסט הדומה לטקסט אנושי ולתמוך במשימות במגוון תעשיות.

מודלי שפה גדולים (LLMs) הם מערכות בינה מלאכותית המאומנות על מאגרי טקסט עצומים כדי להבין וליצור שפה הדומה לשפה אנושית. במונחים פשוטים, מודל שפה גדול אכלס מיליונים או מיליארדי מילים (לעיתים קרובות מהאינטרנט) כדי שיוכל לחזות וליצור טקסט בהקשר. מודלים אלו בדרך כלל מבוססים על רשתות עצביות של למידה עמוקה – הנפוצה ביותר היא ארכיטקטורת ה-טרנספורמר. בשל היקפם, מודלי שפה גדולים יכולים לבצע משימות שפה רבות (שיחה, תרגום, כתיבה) ללא תכנות מפורש לכל אחת מהן.

תכונות מרכזיות של מודלי שפה גדולים

התכונות המרכזיות של מודלי שפה גדולים כוללות:

כמות עצומה של נתוני אימון

מודלי שפה גדולים מאומנים על מאגרי טקסט עצומים (מיליארדי עמודים). מאגר אימון "גדול" זה מעניק להם ידע רחב בדקדוק ועובדות.

ארכיטקטורת טרנספורמר

הם משתמשים ברשתות עצביות מסוג טרנספורמר עם תשומת לב עצמית, כלומר כל מילה במשפט מושוות לכל מילה אחרת במקביל. זה מאפשר למודל ללמוד הקשר בצורה יעילה.

מיליארדי פרמטרים

המודלים מכילים מיליונים או מיליארדי משקלים (פרמטרים). פרמטרים אלו לוכדים דפוסים מורכבים בשפה. לדוגמה, ל-GPT-3 יש 175 מיליארד פרמטרים.

למידה עצמית מפוקחת

מודלי שפה גדולים לומדים על ידי חיזוי מילים חסרות בטקסט ללא תוויות אנושיות. לדוגמה, במהלך האימון המודל מנסה לנחש את המילה הבאה במשפט. על ידי חזרה על תהליך זה על נתונים עצומים, המודל מפנים דקדוק, עובדות ואפילו קצת היגיון.

כיוונון עדין והנחיה

לאחר אימון מקדים, ניתן לכוונן את מודלי השפה הגדולים למשימות ספציפיות או להנחות אותם באמצעות הנחיות. משמעות הדבר היא שהמודל יכול להתאים את עצמו למשימות חדשות כמו שאלות ותשובות רפואיות או כתיבה יצירתית על ידי התאמה עם מאגר נתונים קטן יותר או הוראות חכמות.

ביחד, תכונות אלו מאפשרות למודל שפה גדול להבין וליצור טקסט בדומה לאדם. בפועל, מודל מאומן היטב יכול להסיק הקשר, להשלים משפטים ולספק תגובות שוטפות במגוון נושאים (משיחה יומיומית ועד נושאים טכניים) ללא הנדסה ייעודית למשימה.

כיצד פועלים מודלי שפה גדולים: ארכיטקטורת הטרנספורמר

מודלי שפה גדולים משתמשים בדרך כלל בארכיטקטורת רשת הטרנספורמר. ארכיטקטורה זו היא רשת עצבית עמוקה עם שכבות רבות של צמתים מחוברים. מרכיב מרכזי הוא תשומת לב עצמית, המאפשר למודל לשקלל את חשיבות כל מילה ביחס לכל המילים האחרות במשפט בו-זמנית.

עיבוד סדרתי

- מעבדים מילים אחת אחרי השנייה

- אימון איטי יותר על GPUs

- הבנת הקשר מוגבלת

עיבוד במקביל

- מעבדים את כל הקלט בו-זמנית

- אימון מהיר בהרבה על GPUs

- הבנת הקשר משופרת

בניגוד למודלים סדרתיים ישנים (כמו RNNs), הטרנספורמרים מעבדים את כל הקלט במקביל, מה שמאפשר אימון מהיר בהרבה על GPUs. במהלך האימון, מודל השפה הגדול מתאים את מיליארדי הפרמטרים שלו על ידי ניסיון לחזות כל מילה הבאה במאגר הטקסט העצום שלו.

עם הזמן, תהליך זה מלמד את המודל דקדוק ויחסים סמנטיים. התוצאה היא מודל שיכול, בהינתן הנחיה, ליצור שפה קוהרנטית ורלוונטית להקשר באופן עצמאי.

יישומים של מודלי שפה גדולים

מכיוון שהם מבינים ויוצרים שפה טבעית, למודלי שפה גדולים יש יישומים רבים במגוון תעשיות. כמה שימושים נפוצים הם:

בינה מלאכותית שיחתית

יצירת תוכן

תרגום וסיכום

מענה על שאלות

יצירת קוד

מחקר וניתוח

לדוגמה, ל-GPT-3.5 ו-GPT-4 שמאחורי ChatGPT יש מאות מיליארדי פרמטרים, בעוד שמודלים של גוגל (PaLM ו-Gemini) ואחרים פועלים בדומה. מפתחים לרוב מתקשרים עם מודלי שפה גדולים אלו דרך שירותי ענן או ספריות, ומותאמים למשימות ספציפיות כמו סיכום מסמכים או סיוע בקידוד.

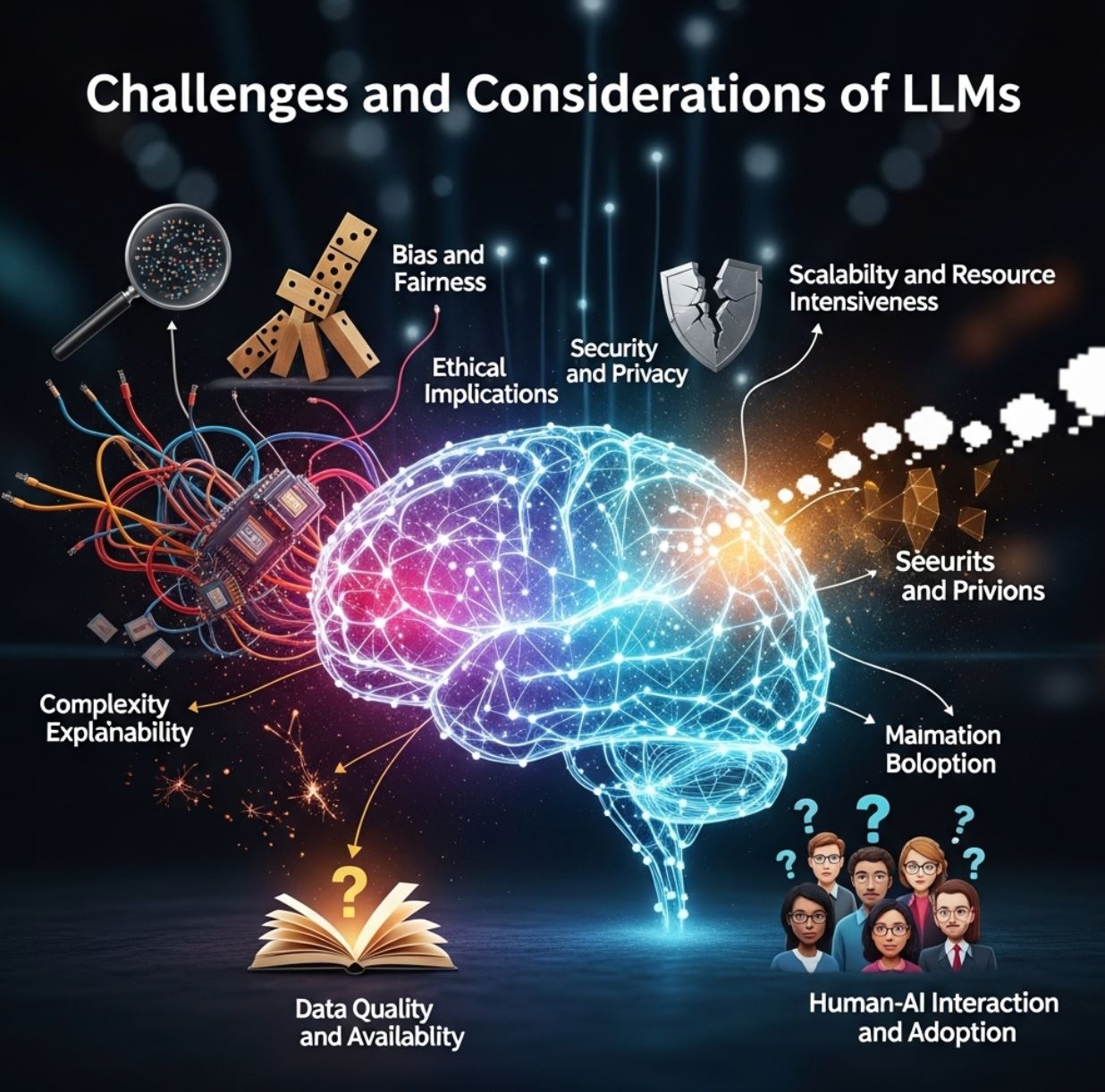

אתגרים ושיקולים

מודלי שפה גדולים הם רבי עוצמה, אך אינם מושלמים. מכיוון שהם לומדים מטקסט מהעולם האמיתי, הם עלולים לשכפל הטיות הנמצאות בנתוני האימון שלהם. מודל שפה גדול עלול ליצור תוכן מוטה תרבותית, או להפיק שפה פוגענית או סטריאוטיפית אם לא מסננים אותו בקפידה.

בעיות הטיה

הלוצינציות

דרישות משאבים

אימות דיוק

בעיה נוספת היא הלוצינציות: המודל עלול להפיק תשובות שנשמעות שוטפות אך שגויות לחלוטין או מומצאות. לדוגמה, מודל שפה גדול עלול להמציא עובדה או שם שקריים בביטחון מלא. שגיאות אלו מתרחשות כי המודל בעצם מנחש את ההמשך הסביר ביותר של הטקסט, ולא מאמת עובדות.

גם כן, משתמשי מודלי שפה גדולים חייבים להיות מודעים לכך שתוצאות יש לבדוק לדיוק והטיה. בנוסף, אימון והפעלת מודלים אלו דורשים משאבי חישוב עצומים (כרטיסי GPU/TPU חזקים וכמויות גדולות של נתונים), מה שעלול להיות יקר.

סיכום ומבט לעתיד

לסיכום, מודל שפה גדול הוא מערכת בינה מלאכותית מבוססת טרנספורמר המאומנת על כמויות עצומות של נתוני טקסט. הוא למד דפוסי שפה באמצעות למידה עצמית מפוקחת, מה שמעניק לו את היכולת ליצור טקסט שוטף ורלוונטי להקשר. בשל היקפו, מודלי שפה גדולים יכולים להתמודד עם מגוון רחב של משימות שפה – משיחה וכתיבה ועד תרגום וקידוד – לעיתים ברמה שווה או גבוהה מזו של בני אדם.

מודלים אלו עומדים לשנות את האופן שבו אנו מתקשרים עם טכנולוגיה וניגשים למידע.

— חוקרי בינה מלאכותית מובילים

נכון ל-2025, מודלי שפה גדולים ממשיכים להתפתח (כולל הרחבות מולטימודליות המטפלות בתמונות או קול) ונשארים בחזית החדשנות בבינה מלאכותית, מה שהופך אותם לרכיב מרכזי ביישומי בינה מלאכותית מודרניים.

No comments yet. Be the first to comment!