একটি বড় ভাষা মডেল কী?

একটি বড় ভাষা মডেল (এলএলএম) হল একটি উন্নত ধরনের কৃত্রিম বুদ্ধিমত্তা যা বিশাল পরিমাণ টেক্সট ডেটা দিয়ে প্রশিক্ষিত হয় মানুষের ভাষা বোঝা, তৈরি করা এবং প্রক্রিয়াকরণের জন্য। এলএলএমগুলি আধুনিক অনেক এআই অ্যাপ্লিকেশনের শক্তি যেমন চ্যাটবট, অনুবাদ সরঞ্জাম এবং বিষয়বস্তু সৃষ্টির সিস্টেম। বিলিয়ন শব্দ থেকে প্যাটার্ন শিখে, বড় ভাষা মডেল সঠিক উত্তর দিতে পারে, মানুষের মতো টেক্সট তৈরি করতে পারে এবং বিভিন্ন শিল্পে কাজ সমর্থন করে।

বড় ভাষা মডেল (এলএলএম) হল কৃত্রিম বুদ্ধিমত্তা সিস্টেম যা বিশাল টেক্সট ডেটাসেটে প্রশিক্ষিত হয়ে মানুষের মতো ভাষা বোঝে এবং তৈরি করে। সহজ কথায়, একটি এলএলএমকে মিলিয়ন বা বিলিয়ন শব্দ (সাধারণত ইন্টারনেট থেকে) খাওয়ানো হয়েছে যাতে এটি প্রসঙ্গ অনুযায়ী টেক্সট পূর্বাভাস দিতে এবং তৈরি করতে পারে। এই মডেলগুলি সাধারণত ডিপ লার্নিং নিউরাল নেটওয়ার্কের উপর নির্মিত – সবচেয়ে সাধারণভাবে ট্রান্সফরমার আর্কিটেকচার। তাদের আকারের কারণে, এলএলএমগুলি অনেক ভাষাগত কাজ (চ্যাট, অনুবাদ, লেখা) স্পষ্টভাবে প্রোগ্রাম না করেও করতে পারে।

বড় ভাষা মডেলের মূল বৈশিষ্ট্য

বড় ভাষা মডেলের মূল বৈশিষ্ট্যগুলি হল:

বিশাল প্রশিক্ষণ ডেটা

এলএলএমগুলি বিশাল টেক্সট কর্পাসে (বিলিয়ন পৃষ্ঠা) প্রশিক্ষিত হয়। এই "বড়" প্রশিক্ষণ সেট তাদের ব্যাকরণ এবং তথ্যের ব্যাপক জ্ঞান দেয়।

ট্রান্সফরমার আর্কিটেকচার

তারা ট্রান্সফরমার নিউরাল নেটওয়ার্ক ব্যবহার করে স্ব-মনোযোগ সহ, যার অর্থ একটি বাক্যের প্রতিটি শব্দ একসাথে অন্য সব শব্দের সাথে তুলনা করা হয়। এটি মডেলকে প্রসঙ্গ দক্ষতার সাথে শিখতে দেয়।

বিলিয়ন পরামিতি

মডেলগুলিতে মিলিয়ন বা বিলিয়ন ওজন (পরামিতি) থাকে। এই পরামিতিগুলি ভাষার জটিল প্যাটার্ন ধারণ করে। উদাহরণস্বরূপ, GPT-3 এর ১৭৫ বিলিয়ন পরামিতি আছে।

স্ব-পর্যবেক্ষণমূলক শিক্ষা

এলএলএমগুলি মানুষের লেবেল ছাড়া টেক্সটের অনুপস্থিত শব্দ পূর্বাভাস দিয়ে শেখে। উদাহরণস্বরূপ, প্রশিক্ষণের সময় মডেল একটি বাক্যের পরবর্তী শব্দ অনুমান করার চেষ্টা করে। বিশাল ডেটায় বারবার এটি করার মাধ্যমে মডেল ব্যাকরণ, তথ্য এবং কিছু যুক্তি অন্তর্ভুক্ত করে।

ফাইন-টিউনিং এবং প্রম্পটিং

প্রি-ট্রেনিংয়ের পরে, এলএলএমগুলি নির্দিষ্ট কাজের জন্য ফাইন-টিউন করা যায় বা প্রম্পট দ্বারা পরিচালিত হতে পারে। এর অর্থ একই মডেল নতুন কাজ যেমন চিকিৎসা প্রশ্নোত্তর বা সৃজনশীল লেখার জন্য ছোট ডেটাসেট বা বুদ্ধিমান নির্দেশনা দিয়ে মানিয়ে নিতে পারে।

এই বৈশিষ্ট্যগুলি একত্রে একটি এলএলএমকে মানুষের মতো টেক্সট বোঝা এবং তৈরি করা সক্ষম করে। বাস্তবে, একটি ভাল প্রশিক্ষিত এলএলএম প্রসঙ্গ অনুমান করতে পারে, বাক্য সম্পূর্ণ করতে পারে এবং অনেক বিষয়ে (সাধারণ চ্যাট থেকে প্রযুক্তিগত বিষয় পর্যন্ত) সাবলীল প্রতিক্রিয়া তৈরি করতে পারে, বিশেষ কাজের প্রকৌশল ছাড়াই।

এলএলএম কিভাবে কাজ করে: ট্রান্সফরমার আর্কিটেকচার

এলএলএমগুলি সাধারণত ট্রান্সফরমার নেটওয়ার্ক আর্কিটেকচার ব্যবহার করে। এই আর্কিটেকচার একটি গভীর নিউরাল নেটওয়ার্ক যা অনেক স্তরের সংযুক্ত নোড নিয়ে গঠিত। একটি মূল উপাদান হল স্ব-মনোযোগ, যা মডেলকে একটি বাক্যের প্রতিটি শব্দের গুরুত্ব একসাথে অন্য সব শব্দের তুলনায় নির্ধারণ করতে দেয়।

ক্রমাগত প্রক্রিয়াকরণ

- শব্দগুলো এক এক করে প্রক্রিয়া করে

- জিপিইউতে ধীর প্রশিক্ষণ

- সীমিত প্রসঙ্গ বোঝাপড়া

সমান্তরাল প্রক্রিয়াকরণ

- সম্পূর্ণ ইনপুট একসাথে প্রক্রিয়া করে

- জিপিইউতে অনেক দ্রুত প্রশিক্ষণ

- উন্নত প্রসঙ্গ বোঝাপড়া

পুরনো ক্রমাগত মডেলগুলোর (যেমন আরএনএন) বিপরীতে, ট্রান্সফরমাররা পুরো ইনপুট একসাথে প্রক্রিয়া করে, যা জিপিইউতে অনেক দ্রুত প্রশিক্ষণ সম্ভব করে। প্রশিক্ষণের সময়, এলএলএম তার বিলিয়ন পরামিতি সামঞ্জস্য করে বিশাল টেক্সট কর্পাসে প্রতিটি পরবর্তী শব্দ পূর্বাভাস দেওয়ার চেষ্টা করে।

সময়ক্রমে, এই প্রক্রিয়া মডেলকে ব্যাকরণ এবং অর্থগত সম্পর্ক শেখায়। ফলাফল হল একটি মডেল যা প্রম্পট পেলে স্বতন্ত্রভাবে সঙ্গতিপূর্ণ, প্রসঙ্গানুযায়ী প্রাসঙ্গিক ভাষা তৈরি করতে পারে।

এলএলএম-এর ব্যবহার

কারণ তারা প্রাকৃতিক ভাষা বোঝে এবং তৈরি করে, এলএলএমগুলির অনেক শিল্পে ব্যবহার রয়েছে। কিছু সাধারণ ব্যবহার হল:

কথোপকথনমূলক এআই

বিষয়বস্তু তৈরি

অনুবাদ এবং সারাংশ

প্রশ্নোত্তর

কোড তৈরি

গবেষণা এবং বিশ্লেষণ

উদাহরণস্বরূপ, ChatGPT-এর পিছনে GPT-3.5 এবং GPT-4 এর শত শত বিলিয়ন পরামিতি রয়েছে, যখন Google-এর মডেলগুলি (PaLM এবং Gemini) এবং অন্যান্যরা অনুরূপভাবে কাজ করে। ডেভেলপাররা প্রায়শই ক্লাউড সার্ভিস বা লাইব্রেরির মাধ্যমে এই এলএলএমগুলির সাথে ইন্টারঅ্যাক্ট করে, নির্দিষ্ট কাজ যেমন নথি সারাংশ বা কোডিং সাহায্যের জন্য কাস্টমাইজ করে।

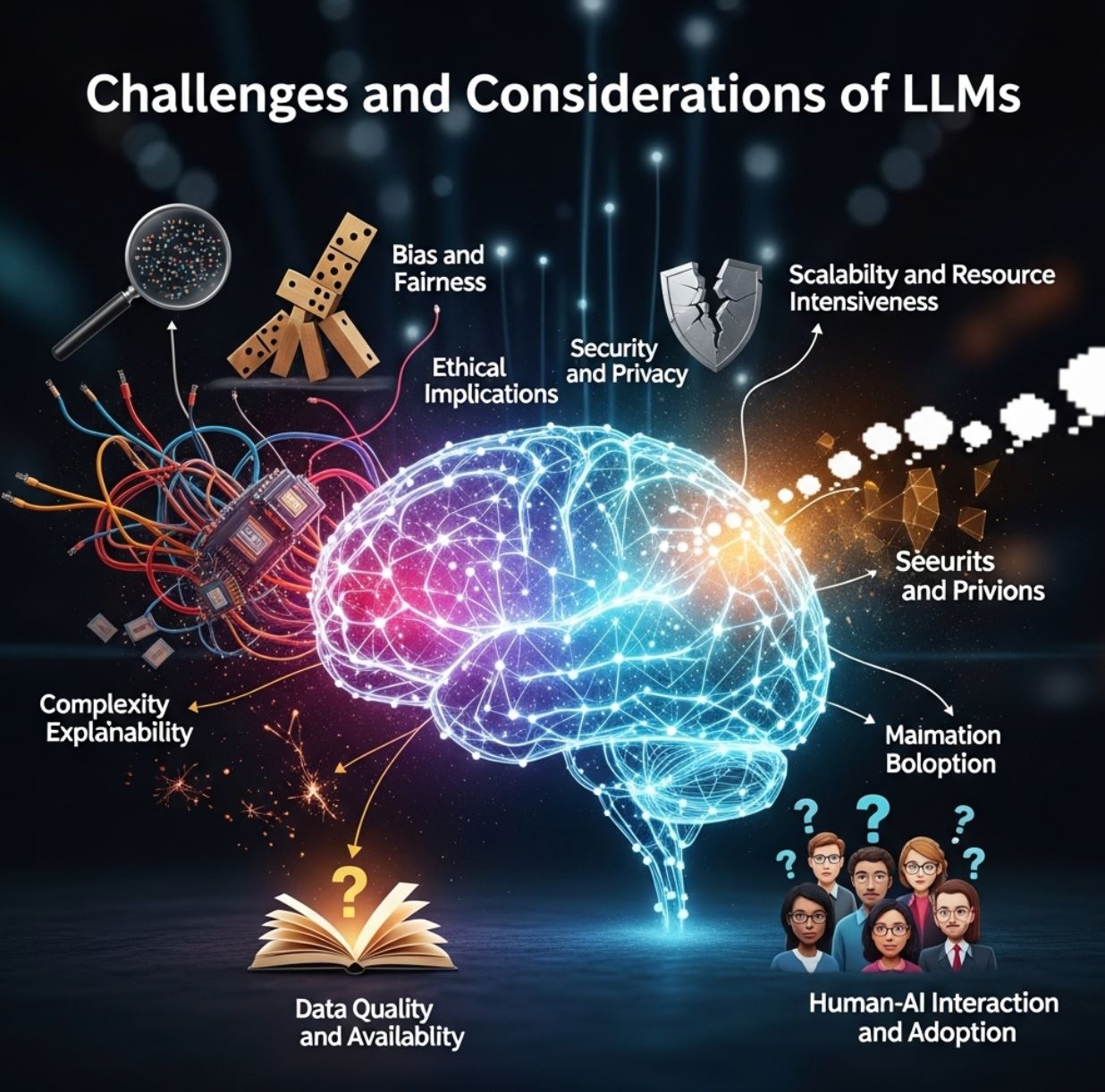

চ্যালেঞ্জ এবং বিবেচ্য বিষয়

এলএলএমগুলি শক্তিশালী, কিন্তু তারা নিখুঁত নয়। কারণ তারা বাস্তব বিশ্বের টেক্সট থেকে শেখে, তারা তাদের প্রশিক্ষণ ডেটায় থাকা পক্ষপাত পুনরুত্পাদন করতে পারে। একটি এলএলএম সাংস্কৃতিক পক্ষপাতযুক্ত বিষয়বস্তু তৈরি করতে পারে, বা সতর্কভাবে ফিল্টার না করলে আপত্তিকর বা স্টেরিওটাইপিক ভাষা ব্যবহার করতে পারে।

পক্ষপাত সমস্যা

হ্যালুসিনেশন

সম্পদ প্রয়োজনীয়তা

সঠিকতা যাচাই

আরেকটি সমস্যা হল হ্যালুসিনেশন: মডেলটি সাবলীল শোনানো উত্তর তৈরি করতে পারে যা সম্পূর্ণ ভুল বা গড়া। উদাহরণস্বরূপ, একটি এলএলএম আত্মবিশ্বাসের সাথে মিথ্যা তথ্য বা নাম উদ্ভাবন করতে পারে। এই ভুলগুলি ঘটে কারণ মডেল মূলত টেক্সটের সবচেয়ে সম্ভাব্য ধারাবাহিকতা অনুমান করে, তথ্য যাচাই করে না।

তবুও, এলএলএম ব্যবহারকারীদের অবশ্যই সচেতন থাকতে হবে যে ফলাফলগুলি সঠিকতা এবং পক্ষপাতের জন্য পরীক্ষা করা উচিত। এছাড়াও, এলএলএম প্রশিক্ষণ এবং চালানোতে বিশাল কম্পিউটিং সম্পদ প্রয়োজন, যা ব্যয়বহুল হতে পারে।

সারাংশ এবং ভবিষ্যৎ দৃষ্টিভঙ্গি

সারাংশে, একটি বড় ভাষা মডেল হল একটি ট্রান্সফরমার-ভিত্তিক এআই সিস্টেম যা বিশাল পরিমাণ টেক্সট ডেটা দিয়ে প্রশিক্ষিত। এটি স্ব-পর্যবেক্ষণমূলক প্রশিক্ষণের মাধ্যমে ভাষার প্যাটার্ন শিখেছে, যা এটিকে সাবলীল, প্রসঙ্গানুযায়ী প্রাসঙ্গিক টেক্সট তৈরি করার ক্ষমতা দেয়। তাদের আকারের কারণে, এলএলএমগুলি ভাষাগত কাজের বিস্তৃত পরিসর পরিচালনা করতে পারে – চ্যাট এবং লেখা থেকে অনুবাদ এবং কোডিং পর্যন্ত – প্রায়শই মানুষের সাবলীলতার সমতুল্য বা তারও বেশি।

এই মডেলগুলি প্রযুক্তির সাথে আমাদের যোগাযোগ এবং তথ্য অ্যাক্সেসের পদ্ধতি পুনর্গঠন করতে প্রস্তুত।

— শীর্ষস্থানীয় এআই গবেষকরা

২০২৫ সালের হিসাবে, এলএলএমগুলি উন্নতি অব্যাহত রাখছে (মাল্টিমোডাল এক্সটেনশনসহ যা ছবি বা অডিও পরিচালনা করে) এবং এআই উদ্ভাবনের অগ্রভাগে রয়েছে, যা আধুনিক এআই অ্যাপ্লিকেশনের একটি কেন্দ্রীয় উপাদান।

No comments yet. Be the first to comment!