人工智能(AI)提供強大的工具來提升創意、生產力和解決問題的能力,但我們必須明智地使用它。專家強調,AI應尊重核心人類價值,如人權、尊嚴、透明度和公平性。

為了充分發揮AI的效用並避免陷阱,請遵循這些使用AI的十條黃金法則。

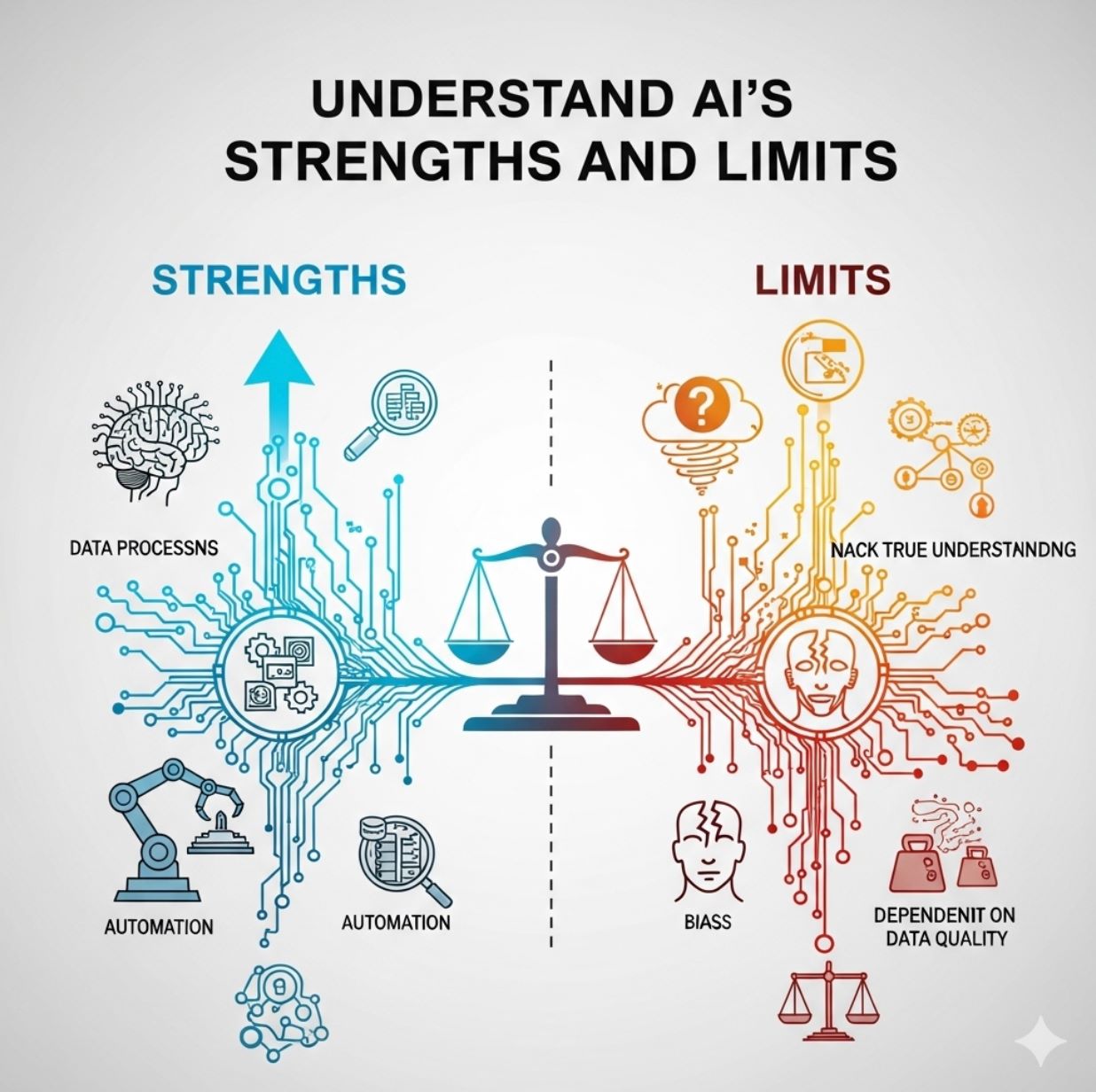

1. 了解AI的優勢與限制

AI是聰明的助手,而非全知的神諭。它能產生想法並節省時間,但也可能出錯或「幻覺」出錯誤資訊。

事實上,研究顯示AI搜尋工具平均約有60%的錯誤率。請始終將AI輸出視為草稿,而非最終答案。

在重要決策(如健康或財務)上,應該諮詢真正的專家——AI可協助研究,但不應取代人類判斷。簡言之,信任但要驗證:對AI結果進行二次、三次核對。

2. 使用清晰的提示語溝通

把你的AI模型當作一位非常聰明的同事。給予清晰、詳細的指示和範例。OpenAI的指引建議:「在撰寫提示語時,盡量具體、描述詳盡,涵蓋所需的背景、結果、長度、格式、風格等。」

避免模糊的請求(如「寫關於運動的文章」),試試:「寫一篇簡短、親切的博客文章,說明每日運動如何提升心情,語氣輕鬆對話式。」良好的提示語(背景+細節)能帶來更準確的AI回應。

這基本上就是良好的溝通:你提供的背景和指引越多,AI就越能有效協助你。

3. 保護私隱與數據安全

除非你完全確定安全,否則切勿與AI工具分享敏感的個人或公司資料。輸入地址、密碼、醫療資訊或機密商業細節前請三思:詐騙者和駭客可能利用你在線上分享的資訊。

例如,如果你不會在社交媒體上發布某些內容,也不要將它輸入AI聊天機器人。

許多免費或未經審核的AI應用可能濫用你的數據,甚至在未獲明確同意下用於訓練。請始終使用知名、可信的平台(或公司批准的工具),並閱讀其私隱政策。

在許多司法管轄區,你對自己的數據擁有權利:法律規定設計者只能收集必要的數據,並須取得使用許可。

實務上,這意味著盡可能關閉訓練或記憶功能,並避免在查詢中包含個人資訊。

4. 始終仔細核對AI輸出

AI可能捏造事實或自信地給出錯誤答案。切勿直接複製AI的成果。對每個重要的AI生成內容——事實、摘要、建議——都要與可靠來源交叉核對。

一個簡單的事實核查流程可能是:

- 將AI答案與官方數據或專家來源比較。

- 使用抄襲檢查或語法檢查工具(AI有時會逐字模仿文本,可能引發版權問題)。

- 運用自身專業知識或直覺:如果某個說法聽起來難以置信,就去查證。

記住,你對AI為你所做的事負責。聯合國教科文組織的AI倫理指南強調人類監督:AI不應取代「最終的人類責任」。

實際上,這意味著你必須掌控全局:在發布或採取行動前,編輯、核實並完善AI的成果。

5. 注意偏見與公平性

AI模型從人類創建的數據中學習,因此可能繼承社會偏見。這會影響招聘決策、貸款審批,甚至日常語言使用。

規則是:對輸出結果保持批判性思考。如果AI持續建議同一性別或種族擔任某職位,或對群體刻板印象,請停下來質疑。

白宮的AI權利法案明確指出系統不得歧視,且必須公平使用。同樣,科技領袖(如微軟)將公平列為核心原則:AI「應公平對待所有人」。

遵守此規則的方法是:使用多元範例和觀點,測試AI在不同族群情境下的反應是否公平。

若發現偏見,調整提示語或更換工具。盡可能選擇推動包容性並解決偏見的AI系統(許多系統內建公平性檢查和偏見審核)。

6. 保持人類監督(問責制)

AI可以自動化任務,但人類必須掌控全局。聯合國教科文組織建議,AI絕不應「取代最終的人類責任」。

實務上,這意味著設計工作流程時,要有人審核或監督AI結果。

例如,若使用AI聊天機器人處理客戶服務,應訓練員工監控對話,並在出錯時接手。若用AI篩選垃圾郵件或分析數據,務必雙重檢查過濾器是否正常運作,並按需調整。

務必設計「故障保護」或備援機制:當AI提出異常建議或無法理解時,人類操作員能介入或關閉系統。

問責制還包括保存紀錄:記錄何時及如何使用AI,以便必要時說明行動。

部分組織甚至要求AI專案可審計,保留決策追蹤紀錄,確保有人能調查並修正問題,符合透明度與問責制原則。

7. 合乎道德與法律地使用AI

能向AI提出問題不代表就應該這麼做。務必遵守法律和道德準則。切勿用AI從事違法或有害行為(例如製作惡意軟件、抄襲版權文本或欺騙他人)。

尊重知識產權:若AI協助生成圖片或文章,需謹慎給予適當授權及避免直接複製。

美國AI權利法案強調數據私隱與公平性,也暗示必須將AI使用限制在道德範圍內。

例如,在使用AI處理敏感工作前,請檢查合規要求:醫療和金融領域通常有額外規範(如HIPAA、GDPR等)。許多國家正制定AI法規(如歐盟的AI法案優先保障安全與權利)。請持續關注,避免無意中違反新規定。

簡言之:做正確的事。若請求看似可疑或違法,很可能就是。遇到疑問時,請諮詢主管或法律顧問。

8. 透明公開AI的使用

透明度建立信任。如果你使用AI生成內容(文章、報告、程式碼等),考慮告知受眾或團隊。說明AI如何協助(例如「此摘要由AI草擬,後由我編輯」)。

白宮藍圖甚至包含「通知與解釋」原則:人們應知道何時使用AI系統,以及它如何影響決策。

例如,公司若用AI篩選求職者,應告知應徵者。

實務上,標示AI生成內容,並清楚說明數據來源。若用AI改寫他人作品,請註明原作者。在工作環境中,與同事分享你的AI工作流程(使用了哪些AI工具及步驟)。

這種開放不僅符合道德標準,也有助他人學習並及早發現問題。記住,問責制意味著對你的成果負責,並給予應有的認可。

9. 持續學習並保持資訊更新

AI發展迅速,請持續更新技能與知識。關注可信的新聞(科技部落格、官方AI論壇或國際指引如聯合國教科文組織建議),了解新風險與最佳實踐。聯合國教科文組織強調「AI素養」:公眾教育與培訓是安全使用AI的關鍵。

持續學習的方法包括:

- 參加線上課程或網絡研討會,學習AI安全與倫理。

- 閱讀你所用AI工具的新功能介紹。

- 與朋友或同事分享技巧與資源(例如如何撰寫更佳提示語或識別AI偏見)。

- 教導年輕用戶(或兒童)AI能幫助人,但應保持質疑精神。

透過共同學習,我們建立一個明智使用AI的社群。畢竟,所有用戶共同承擔確保AI惠及每一個人的責任。

10. 使用可信工具並遵循指引

最後,請堅持使用有信譽的AI工具和官方指引。僅從官方來源(如合法網站或應用商店)下載AI應用,避免惡意軟件或詐騙。

在工作場所,使用公司批准且符合安全與私隱標準的AI平台。

支持承諾倫理開發的AI供應商。例如,優先選擇有明確數據政策和倫理承諾的工具(許多大型科技公司現已公開此類資訊)。利用內建安全功能:部分平台允許關閉數據訓練或設定內容過濾。

並且,務必獨立備份你的數據,避免因AI服務故障而無法存取。

>>> 你可能需要: 初學者有效使用人工智能的貼士

總結來說,AI是強大的夥伴,只要負責任地使用。遵循這十條黃金法則——尊重私隱、核實事實、保持道德與資訊更新,並讓人類掌控——你就能安全地發揮AI的優勢。

隨著科技進步,這些原則將確保AI持續成為正面的力量。