Протягом багатьох років (2023–2025) штучний інтелект зробив значний прорив на багатьох фронтах. Великі мовні моделі (LLM) і чатботи, мультимодальні системи, наукові інструменти ШІ та робототехніка всі зазнали проривів.

Технологічні гіганти випустили нових AI-асистентів, спільноти з відкритим кодом представили потужні моделі, а регулятори почали реагувати на вплив ШІ.

Нижче ми оглядаємо найяскравіші досягнення — від розширень GPT-4 і Google Gemini до Нобелівської премії AlphaFold та відкриттів у науці й мистецтві, здійснених за допомогою ШІ.

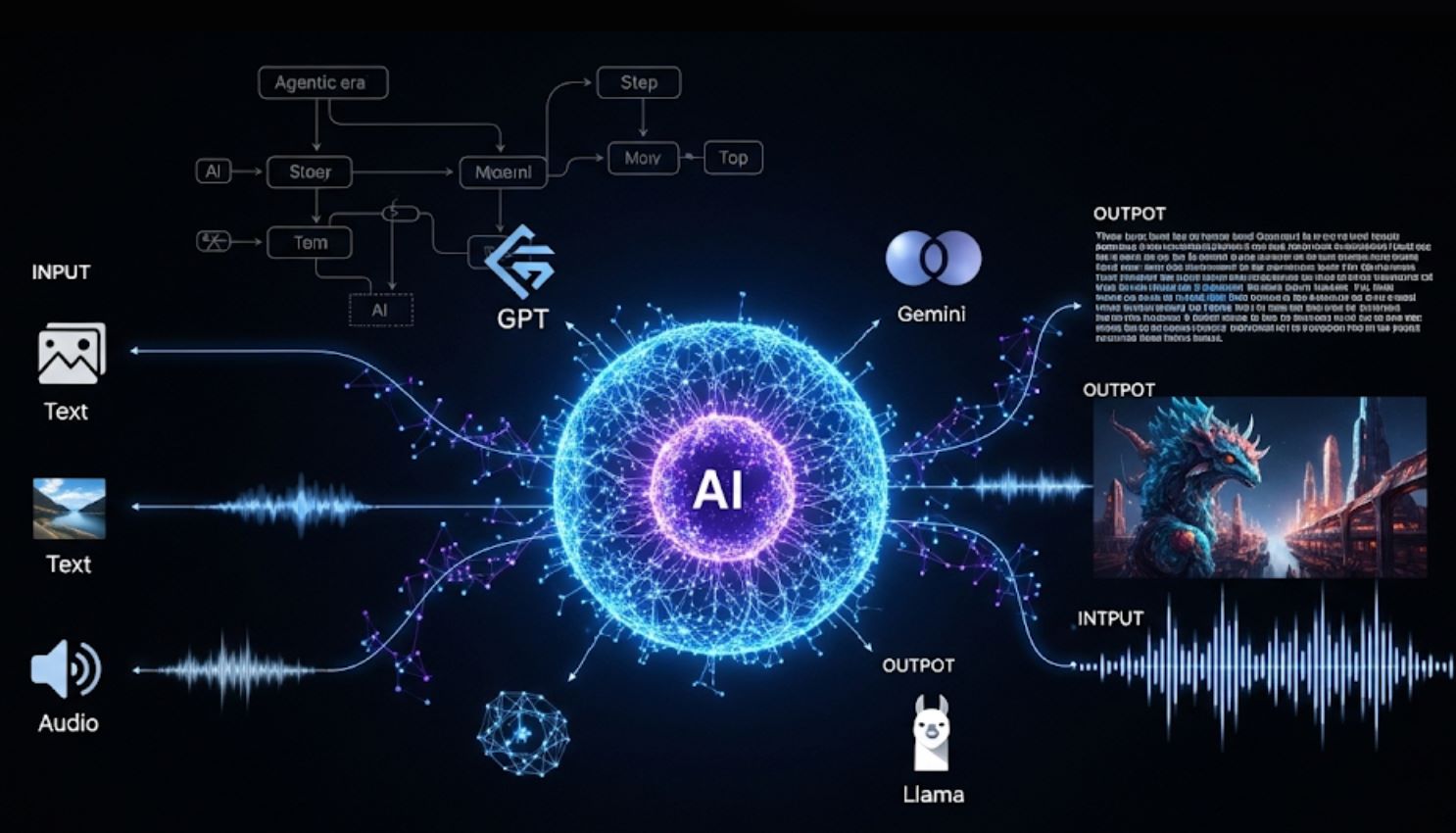

Генеративні мовні моделі та чатботи

Сучасні великі мовні моделі стали значно потужнішими та мультимодальними. GPT-4 Turbo від OpenAI (оголошений у листопаді 2023 року) тепер може обробляти 128 000 токенів в одному запиті (приблизно 300 сторінок тексту) і значно дешевший у використанні, ніж GPT-4.

У травні 2024 року OpenAI представила GPT-4o (Omni) — оновлену модель, яка в режимі реального часу працює з текстом, зображеннями та аудіо — фактично надаючи GPT-4 можливості «бачити» та «чути» в розмові. Сам ChatGPT тепер має вбудовані функції роботи з зображеннями та голосом: користувачі можуть завантажувати фото або говорити з ботом, а він відповідатиме на основі цього візуального чи аудіо-входу.

- GPT-4 Turbo і GPT-4o (Omni): GPT-4 Turbo (листопад 2023) знизив витрати та збільшив довжину контексту до 128 тис. токенів. GPT-4o (травень 2024) зробив ШІ справді мультимодальним, генеруючи текст, мову та зображення з майже людською швидкістю.

- Прогрес ChatGPT: До кінця 2023 року ChatGPT «тепер може бачити, чути і говорити» — можна завантажувати зображення та аудіо або диктувати запити, а бот відповідатиме відповідно.

Також інтегровано DALL·E 3 (жовтень 2023), що дозволяє генерувати зображення з тексту за допомогою розмовного підказування. - Серія Google Gemini: У грудні 2024 року Google DeepMind випустив перші моделі Gemini 2.0 («Flash» і прототипи), створені для «агентської епохи» — ШІ, який автономно виконує багатокрокові завдання.

Google вже почав тестувати Gemini 2.0 у Пошуку (AI Overviews) та інших продуктах для понад мільярда користувачів, демонструючи покращені можливості мислення та мультимодальність. - Інші моделі: Meta випустила LLaMA 3 у квітні 2024 року (відкриті великі мовні моделі з вагою до 400 млрд параметрів), заявляючи, що вона перевершує багато попередніх моделей.

Anthropic із Claude 3 та інструменти Microsoft Copilot також базуються на цих досягненнях (наприклад, Copilot побудований на технологіях OpenAI).

Ці інновації дозволяють AI-асистентам вести значно довші, глибші розмови та обробляти різноманітні типи вхідних даних.

Вони також забезпечують нові «асистентські» додатки через API (Google «AI Overviews», OpenAI Assistants API тощо), роблячи ШІ більш доступним для розробників і кінцевих користувачів.

Мультимодальні та творчі досягнення ШІ

Креативність і візуальне сприйняття ШІ стрімко зросли. Моделі текст-до-зображення та текст-до-відео досягли нових висот:

OpenAI DALL·E 3 (жовтень 2023) генерує фотореалістичні зображення за підказками і навіть інтегрований із ChatGPT для допомоги у формулюванні запитів.

Google представив Imagen 3 (жовтень 2024) і Veo 2 (грудень 2024) — передові движки текст-до-зображення та текст-до-відео, які суттєво покращують якість, деталізацію та послідовність у створенні мистецтва та відео за допомогою ШІ.

Навіть музичний ШІ покращився завдяки інструментам Google MusicFX та суміжним дослідженням (наприклад, експерименти MusicLM).

- Моделі генеративного мистецтва: DALL·E 3 і Imagen 3 можуть точно виконувати тонкі підказки (включно з текстом, вбудованим у зображення).

Google Veo 2 здатен створювати короткі відеокліпи за одним текстовим описом — важливий крок у синтезі відео.

Stable Diffusion і Midjourney також випустили нові версії (v3, v6) із покращеним реалізмом цього року. - ШІ в пристроях: Apple запустила Apple Intelligence (в iOS 18 і macOS 15, кінець 2024) — вбудований генеративний ШІ для iPhone/iPad/Mac.

Він додає помічників для написання (переписування, коректури, резюмування в Mail/Pages), ще розумнішого Siri та інструменти для зображень, як Image Playground (створення веселих ілюстрацій за текстом) і Genmoji (генерація унікальних емодзі за допомогою ШІ).

Фото отримали пошук природною мовою («знайти Майю на скейтборді»), а функція «Clean Up» видаляє небажані об’єкти з фото.

Підхід Apple акцентує увагу на обробці на пристрої та конфіденційності. - ШІ в мистецтві: Вражаючий приклад: у листопаді 2024 року Sotheby’s продали першу картину, створену гуманоїдним роботом.

Портрет Алана Тьюринга, намальований роботом з ШІ Ai-Da, був проданий за 1,08 млн доларів США.

Цей рекордний продаж («A.I. God: Portrait of Alan Turing») підкреслює зростаючу роль ШІ у творчості та його культурний вплив.

Загалом генеративні моделі демократизують творчість: тепер будь-хто може створювати мистецтво, музику чи відео за кілька слів.

Фокус індустрії змістився від простої новизни (сюрреалістичних зображень) до корисної генерації зображень (логотипи, діаграми, карти) та реалістичності, близької до людської.

(У березні 2025 року OpenAI навіть випустила «4o Image Generation», інтегрувавши найкращу модель зображень у GPT-4o для точних, фотореалістичних результатів, керованих розмовою.)

Ці інструменти швидко інтегруються в додатки, браузери та творчі робочі процеси.

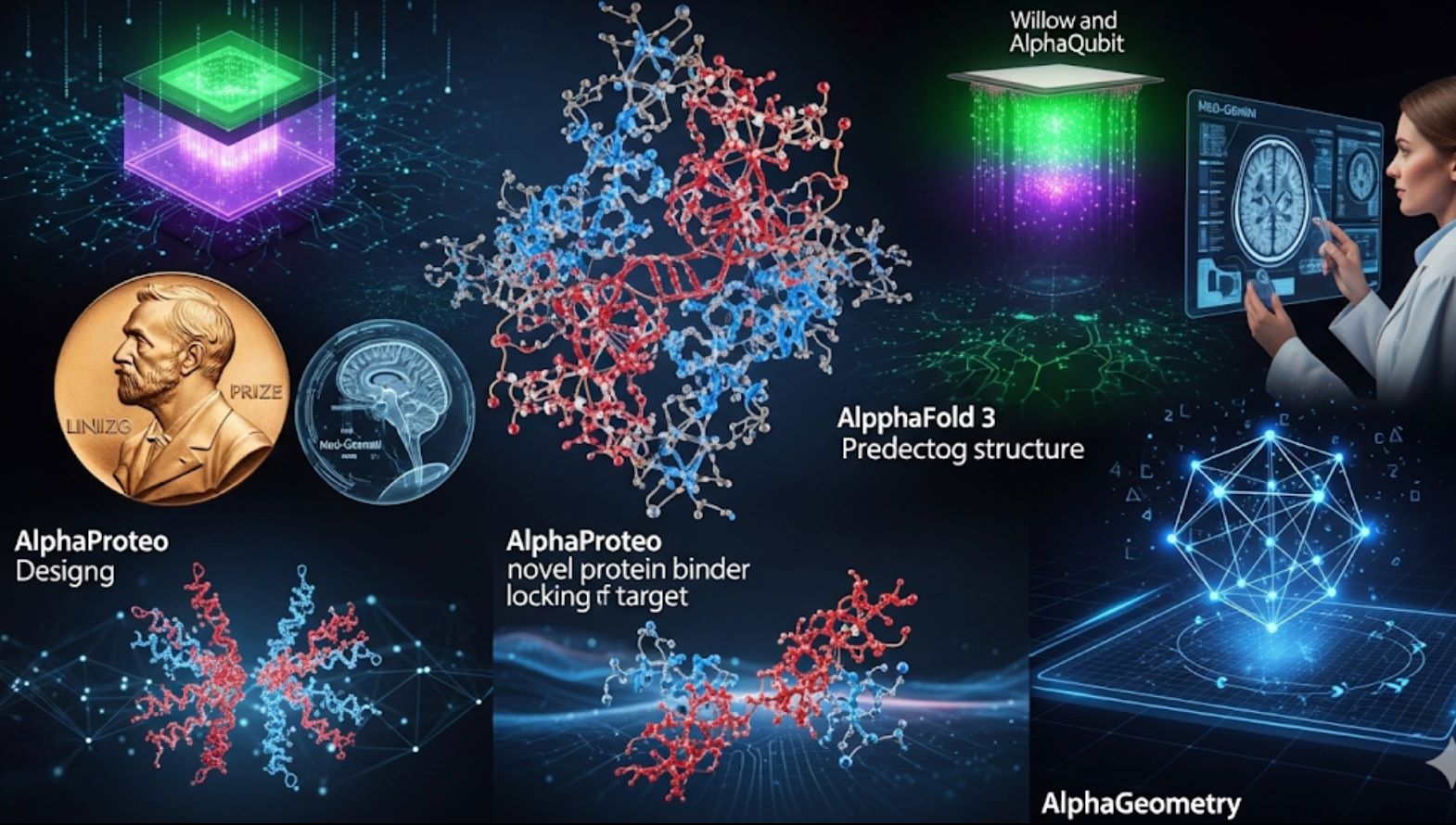

ШІ в науці, медицині та математиці

Досягнення ШІ стимулювали наукові відкриття та прогрес у дослідженнях:

- AlphaFold 3 – біомолекули: У листопаді 2024 року Google DeepMind (спільно з Isomorphic Labs) представив AlphaFold 3 — нову модель, яка одночасно з безпрецедентною точністю прогнозує 3D-структури всіх біомолекул (білків, ДНК, РНК, лігандів тощо).

Для взаємодії білок-лікарський засіб AlphaFold 3 приблизно на 50% точніший за традиційні методи.

Розробники одразу запустили безкоштовний AlphaFold Server, щоб дослідники з усього світу могли прогнозувати молекулярні структури.

Це розширення прогнозів AlphaFold 2, що працювали лише з білками, і очікується, що воно змінить відкриття ліків і геномні дослідження. - Нобелівська премія – згортання білків: Важливість цього прориву підтверджена Нобелівською премією з хімії 2024 року.

Деміс Хассабіс і Джон Джампер (DeepMind) поділили нагороду (разом із Девідом Бейкером) за розробку AlphaFold (ШІ для згортання білків).

Нобелівський комітет відзначив, що AlphaFold «відкрив абсолютно нові можливості» у дизайні білків.

(Це одне з найвідоміших досягнень ШІ на сьогодні.) - AlphaProteo – дизайн ліків: Також у 2024 році DeepMind анонсував AlphaProteo — ШІ, який проектує нові білкові зв’язувальні молекули — молекули, що міцно зв’язуються з цільовими білками.

AlphaProteo може прискорити створення нових антитіл, біосенсорів і потенційних ліків, генеруючи перспективні білкові структури для заданих цілей. - Математика – AlphaGeometry: DeepMind’s AlphaGeometry і AlphaProof також зробили прорив.

У липні 2024 року AlphaGeometry 2 розв’язала задачу з Міжнародної математичної олімпіади за 19 секунд, досягнувши рівня срібного призера.

Це рідкісний випадок, коли ШІ справляється зі складною шкільною математикою. - Квантові обчислення – AlphaQubit і Willow: ШІ також покращив передове обладнання.

У 2024 році Google анонсував AlphaQubit — ШІ-декодер, який значно краще виявляє помилки в квантових комп’ютерах (наприклад, у чіпах Sycamore від Google), ніж попередні методи.

У грудні 2024 року Google представив Willow — новий квантовий чіп, який за допомогою передової корекції помилок розв’язав еталонне завдання менш ніж за 5 хвилин, тоді як найкращому суперкомп’ютеру знадобилося б близько 10^24 років.

Ці досягнення принесли Willow нагороду «Прорив року в фізиці 2024», підкреслюючи роль ШІ в квантовому прогресі.

У медицині та охороні здоров’я моделі ШІ також зробили значний прогрес. Наприклад, новий Med-Gemini від Google (налаштований на медичні дані) набрав 91,1% на медичному іспиті в США (аналог USMLE), значно перевершивши попередні моделі.

Інструменти з підтримкою ШІ для радіології та патології (наприклад, Derm і Path Foundations) були випущені для покращення аналізу зображень.

Загалом ШІ тепер є незамінним партнером у дослідженнях — від картографування людського мозку на нанорівні (з допомогою ШІ для електронної мікроскопії) до прискорення скринінгу туберкульозу в Африці, як повідомляють дослідники Google.

ШІ в робототехніці та автоматизації

Роботи з підтримкою ШІ навчаються виконувати складні реальні завдання.

Гуманоїдні роботи Tesla Optimus були публічно продемонстровані в жовтні 2024 року на заході «We, Robot». Кілька десятків одиниць Optimus ходили, стояли і навіть танцювали на сцені — хоча пізніші звіти вказували, що початкові демонстрації частково керувалися дистанційно людьми.

Проте цей захід підкреслив швидкий прогрес у напрямку універсальних роботів.

- Роботи ALOHA від DeepMind: Лабораторія ШІ Google досягла значних успіхів у домашніх роботах.

У 2024 році робот ALOHA (Автономний Домашній Асистент на Ногах) навчився зав’язувати шнурки, вішати сорочку, ремонтувати іншого робота, вставляти шестерні та навіть прибирати кухню, використовуючи лише планування ШІ та зір.

Відкритий проект «ALOHA Unleashed» показав, як роботи координують дві руки для виконання завдань — це перший випадок універсальної маніпуляції. - Робототехнічні трансформери: DeepMind представив RT-2 (Robotic Transformer 2) — модель зору, мови та дії, яка може навчатися як на інтернет-зображеннях, так і на реальних даних роботів.

RT-2 дозволяє роботам інтерпретувати інструкції, як людина, використовуючи знання з мережі.

Демонструвалося, як він допомагає роботу сортувати об’єкти за текстовими командами. - Промислові роботи: Інші компанії також досягли прогресу: Boston Dynamics продовжує вдосконалювати роботів Atlas і Spot (хоча без значних проривів), а автономні транспортні засоби з ШІ покращуються (бета-версія Tesla Full Self-Driving розгортається ширше, хоча повна автономія ще не досягнута).

У виробництві компанії, орієнтовані на ШІ, як Figure AI, залучили кошти для створення домашніх роботів для побутових завдань.

Ці зусилля демонструють, що роботи виконують дедалі складніші завдання без явного програмування. Проте справжні повністю автономні гуманоїди ще попереду.

Демонстрації (Optimus, ALOHA, RT-2) є важливими віхами, але дослідники застерігають, що попереду ще багато роботи, щоб роботи могли безпечно і надійно працювати поруч із людьми у великому масштабі.

ШІ в продуктах, промисловості та суспільстві

Вплив ШІ поширюється на повсякденні продукти і навіть політику:

- Споживчі пристрої: Основні технологічні продукти інтегрували AI-агентів.

Copilot від Microsoft (вбудований у Windows, Office, Bing) і Bard/Bard AI від Google у Пошуку (на базі Gemini) надали користувачам потужність великих мовних моделей.

Пристрої Apple отримали Apple Intelligence (як зазначено вище), а виробники апаратного забезпечення, як Nvidia, продали рекордну кількість AI-GPU, що живлять як хмарний, так і споживчий ШІ.

(Nvidia стала найбільшою за капіталізацією компанією світу у 2024 році завдяки буму ШІ.) - Регулювання – Закон ЄС про ШІ: Відображаючи масштаб впливу ШІ, регулятори також діяли.

1 серпня 2024 року набув чинності Закон ЄС про ШІ — перший комплексний закон про штучний інтелект.

Він встановлює ризик-орієнтовану систему: ШІ з низьким ризиком (фільтри спаму, відеоігри) має мінімальні правила; правила прозорості зобов’язують системи ШІ, як чатботи, розкривати, що вони є ШІ; ШІ з високим ризиком (медичні або кадрові інструменти) підлягає суворому нагляду; а явно неприйнятний ШІ (наприклад, «соціальне оцінювання» осіб урядами) заборонений.

Цей набір правил (разом із майбутніми керівництвами щодо універсальних моделей) є важливим досягненням у сфері управління ШІ і, ймовірно, вплине на стандарти у всьому світі. - Зростання індустрії: Сам сектор ШІ отримав історичне фінансування та оцінки: OpenAI досягла оцінки в 157 млрд доларів наприкінці 2023 року, а компанії як Anthropic, Inflection і китайські стартапи ШІ залучили багатомільярдні інвестиції.

Попит на апаратне забезпечення NVIDIA для ШІ підняв її ринкову капіталізацію понад 3,5 трильйона доларів до середини 2024 року.

Ці цифри підкреслюють, наскільки ШІ став центральним у технологічній економіці.

>>> Ви коли-небудь пробували: Порівняння штучного інтелекту з людським інтелектом ?

Коротко кажучи, ШІ вже не обмежується лабораторіями чи демонстраціями новинок — він інтегрований у телефони, автомобілі, робочі місця та державну політику.

Вищезазначені досягнення — від величезних знань GPT-4 до наукових революцій AlphaFold — демонструють швидке дозрівання ШІ.

У міру наближення 2025 року ці досягнення передбачають ще потужніші та практичніші застосування ШІ у нашому повсякденному житті.