কৃত্রিম বুদ্ধিমত্তা এবং অ্যালগরিদমিক পক্ষপাত

কৃত্রিম বুদ্ধিমত্তার অ্যালগরিদমগুলি নিয়োগ থেকে শুরু করে আর্থিক খাত পর্যন্ত বিভিন্ন ক্ষেত্রে ব্যাপকভাবে ব্যবহৃত হচ্ছে, তবে এগুলোর মধ্যে পক্ষপাত এবং বৈষম্যের ঝুঁকি রয়েছে। স্বয়ংক্রিয় AI সিদ্ধান্তগুলি যদি প্রশিক্ষণ ডেটা পক্ষপাতমূলক বা বৈচিত্র্যহীন হয়, তবে তা সামাজিক অন্যায়কে প্রতিফলিত বা বাড়িয়ে তুলতে পারে। অ্যালগরিদমিক পক্ষপাত বোঝা ব্যবসা, ডেভেলপার এবং ব্যবহারকারীদের পক্ষপাত চিহ্নিত, নিয়ন্ত্রণ এবং আরও ন্যায়সঙ্গত ও স্বচ্ছ AI সিস্টেম তৈরি করতে সহায়তা করে।

আপনি কি AI-তে অ্যালগরিদমিক পক্ষপাত সম্পর্কে জানতে আগ্রহী? এই নিবন্ধে INVIAI-এর সাথে যোগ দিন এবং কৃত্রিম বুদ্ধিমত্তা এবং অ্যালগরিদমিক পক্ষপাত সম্পর্কে আরও জানুন!

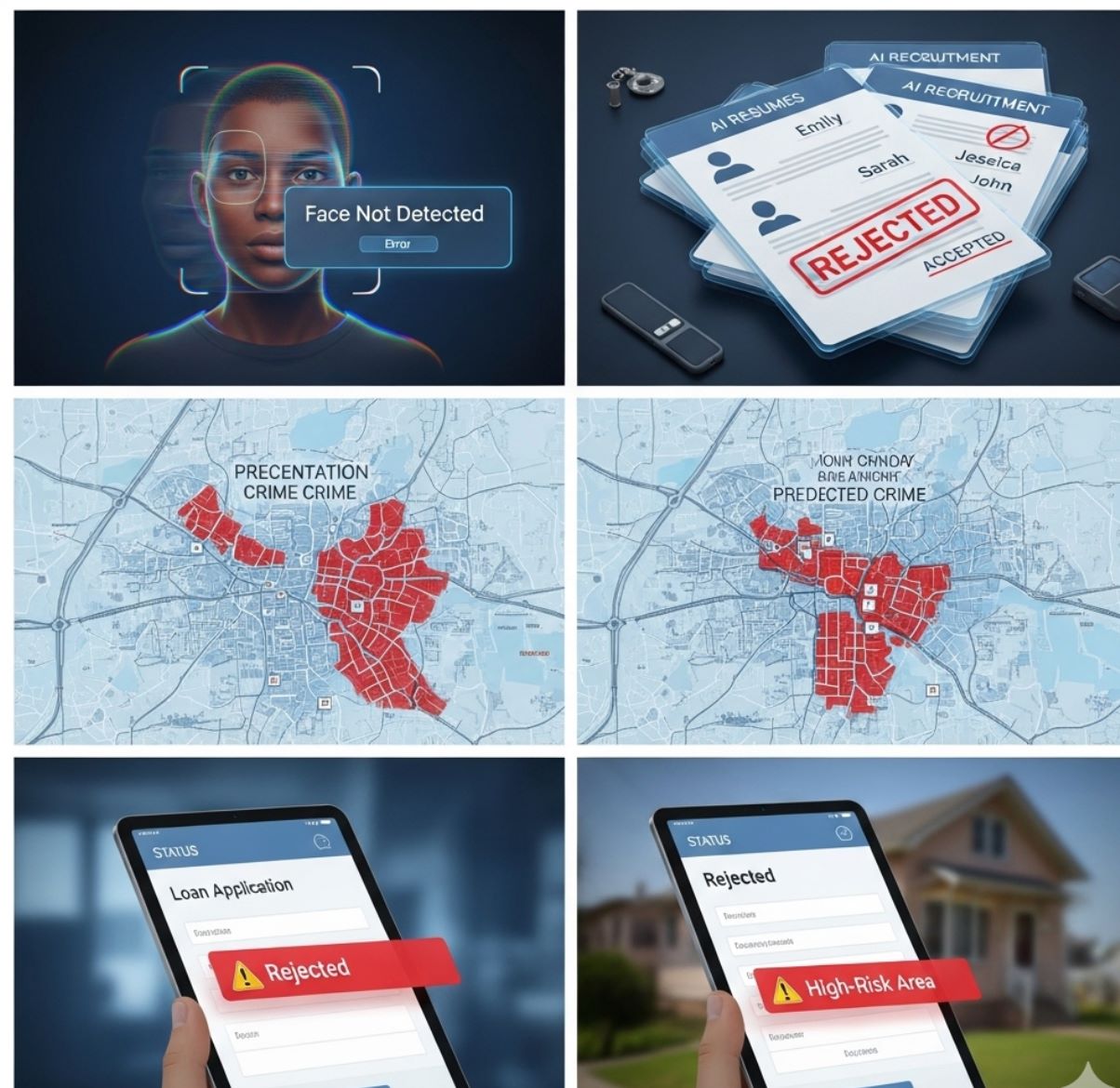

কৃত্রিম বুদ্ধিমত্তা (AI) আমাদের দৈনন্দিন জীবনে ক্রমবর্ধমানভাবে প্রবেশ করছে – নিয়োগ সিদ্ধান্ত থেকে শুরু করে স্বাস্থ্যসেবা এবং পুলিশিং পর্যন্ত – তবে এর ব্যবহারে অ্যালগরিদমিক পক্ষপাত নিয়ে উদ্বেগ দেখা দিয়েছে। অ্যালগরিদমিক পক্ষপাত বলতে বোঝায় AI সিস্টেমের আউটপুটে সিস্টেম্যাটিক এবং অন্যায় পক্ষপাত, যা প্রায়শই সামাজিক স্টেরিওটাইপ এবং বৈষম্যের প্রতিফলন করে।

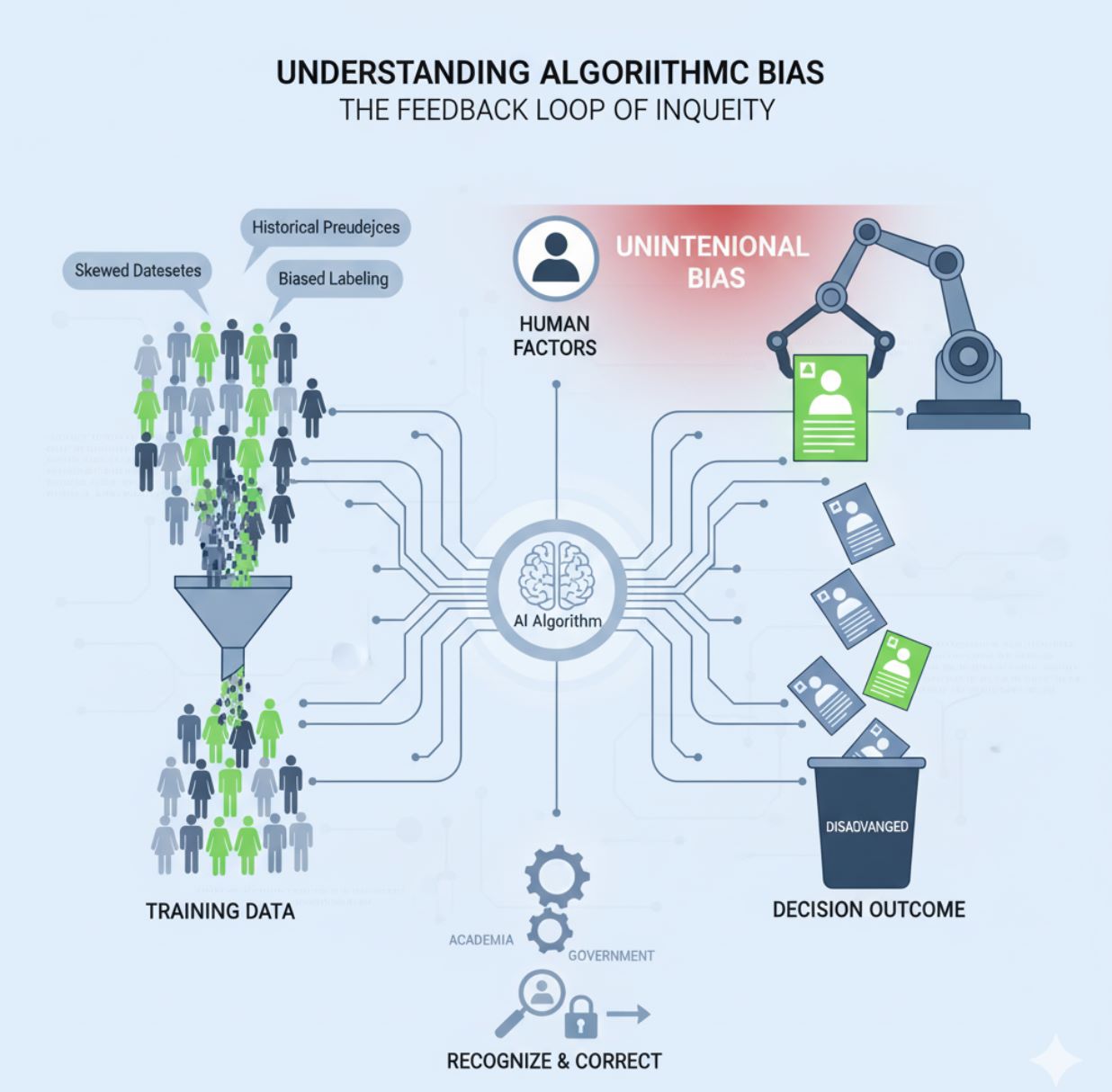

মূলত, একটি AI অ্যালগরিদম অনিচ্ছাকৃতভাবে তার প্রশিক্ষণ ডেটা বা নকশায় থাকা মানব পক্ষপাত পুনরুত্পাদন করতে পারে, যা বৈষম্যমূলক ফলাফল সৃষ্টি করে।

এই সমস্যা প্রযুক্তি নৈতিকতার সবচেয়ে তীব্র বিতর্কিত চ্যালেঞ্জগুলোর একটি হয়ে উঠেছে, যা গবেষক, নীতিনির্ধারক এবং শিল্প নেতাদের বিশ্বব্যাপী মনোযোগ আকর্ষণ করেছে। AI-এর দ্রুত গ্রহণযোগ্যতা এখন পক্ষপাত মোকাবেলা করা অত্যন্ত জরুরি করে তুলেছে: নৈতিক নিয়ন্ত্রণ ছাড়া, AI বাস্তব বিশ্বের পক্ষপাত এবং বৈষম্য পুনরুত্পাদন করার ঝুঁকি বহন করে, যা সামাজিক বিভাজন বাড়ায় এবং মৌলিক মানবাধিকারকেও হুমকির মুখে ফেলে।

নিচে আমরা আলোচনা করব অ্যালগরিদমিক পক্ষপাতের কারণ, এর বাস্তব জীবনের প্রভাবের উদাহরণ এবং কিভাবে বিশ্ব AI-কে আরও ন্যায়সঙ্গত করার চেষ্টা করছে।

অ্যালগরিদমিক পক্ষপাত এবং এর কারণ বোঝা

অ্যালগরিদমিক পক্ষপাত সাধারণত AI “বৈষম্য করতে চায়” বলে নয়, বরং মানবিক কারণের জন্য ঘটে। AI সিস্টেমগুলি ডেটা থেকে শেখে এবং মানুষের তৈরি নিয়ম অনুসরণ করে – আর মানুষদের পক্ষপাত থাকে (প্রায়শই অজান্তে)।

যদি প্রশিক্ষণ ডেটা পক্ষপাতমূলক বা ঐতিহাসিক পূর্বাগ্রহ প্রতিফলিত করে, তবে AI সেই ধরণগুলি শিখবে।

উদাহরণস্বরূপ, একটি রেজুমে-স্ক্রিনিং AI যা দশকের বেশি সময় ধরে প্রযুক্তি শিল্পের নিয়োগ ডেটা দিয়ে প্রশিক্ষিত হয়েছে (যেখানে অধিকাংশ নিয়োগপ্রাপ্ত প্রার্থী পুরুষ ছিলেন) তা পুরুষ প্রার্থীদের বেশি পছন্দনীয় মনে করতে পারে, ফলে মহিলাদের জন্য অসুবিধা সৃষ্টি হয়। অন্যান্য সাধারণ কারণগুলোর মধ্যে রয়েছে অসম্পূর্ণ বা প্রতিনিধিত্বহীন ডেটাসেট, পক্ষপাতমূলক ডেটা লেবেলিং, অথবা এমন অ্যালগরিদম যা সামগ্রিক সঠিকতার জন্য অপ্টিমাইজ করা হয়েছে কিন্তু সংখ্যালঘু গোষ্ঠীর জন্য ন্যায়সঙ্গত নয়।

সংক্ষেপে, AI অ্যালগরিদম তাদের নির্মাতা এবং ডেটার পক্ষপাত উত্তরাধিকার সূত্রে পায় যদি না সচেতনভাবে সেই পক্ষপাত চিহ্নিত ও সংশোধন করা হয়।

গুরুত্বপূর্ণ যে, অ্যালগরিদমিক পক্ষপাত সাধারণত অনিচ্ছাকৃত হয়। প্রতিষ্ঠানগুলি প্রায়ই AI গ্রহণ করে যাতে সিদ্ধান্তগুলি আরও বস্তুনিষ্ঠ হয়, কিন্তু যদি তারা পক্ষপাতমূলক তথ্য সরবরাহ করে বা নকশায় সমতা বিবেচনা না করে, তবে ফলাফল এখনও অন্যায় হতে পারে। AI পক্ষপাত সুযোগের অবিচার বণ্টন এবং ভুল ফলাফল তৈরি করতে পারে, যা মানুষের কল্যাণে নেতিবাচক প্রভাব ফেলে এবং AI-তে বিশ্বাস কমায়।

পক্ষপাত কেন হয় তা বোঝা সমাধানের প্রথম ধাপ – এবং এটি এমন একটি ধাপ যা বিশ্বব্যাপী একাডেমিয়া, শিল্প এবং সরকার এখন গুরুত্ব সহকারে নিচ্ছে।

AI পক্ষপাতের বাস্তব জীবনের উদাহরণ

AI-তে পক্ষপাত শুধুমাত্র কাল্পনিক উদ্বেগ নয়; অসংখ্য বাস্তব জীবনের ঘটনা প্রকাশ করেছে কিভাবে অ্যালগরিদমিক পক্ষপাত বৈষম্যের দিকে নিয়ে যেতে পারে। বিভিন্ন ক্ষেত্রে AI পক্ষপাতের উল্লেখযোগ্য উদাহরণগুলি হলো:

-

আপরাধ বিচার: যুক্তরাষ্ট্রে, অপরাধ পুনরায় সংঘটনের সম্ভাবনা নির্ধারণের জন্য ব্যবহৃত একটি জনপ্রিয় অ্যালগরিদম কালো অভিযুক্তদের বিরুদ্ধে পক্ষপাতমূলক বলে পাওয়া গেছে। এটি প্রায়ই কালো অভিযুক্তদের উচ্চ ঝুঁকিপূর্ণ এবং সাদা অভিযুক্তদের নিম্ন ঝুঁকিপূর্ণ হিসেবে ভুল মূল্যায়ন করত, যা বিচার ব্যবস্থায় জাতিগত বৈষম্য বাড়িয়েছে।

এই ঘটনা দেখায় কিভাবে AI পুলিশি ও আদালতের ঐতিহাসিক পক্ষপাতকে বাড়িয়ে তুলতে পারে। -

নিয়োগ ও কর্মী নির্বাচন: আমাজন বিখ্যাতভাবে একটি AI নিয়োগ সরঞ্জাম বাতিল করেছিল যখন তারা আবিষ্কার করল যে এটি মহিলাদের বিরুদ্ধে বৈষম্য করছে। মেশিন লার্নিং মডেলটি নিজেই শিখেছিল যে পুরুষ প্রার্থীরা বেশি পছন্দনীয়, কারণ এটি পুরুষদের রেজুমে দিয়ে প্রশিক্ষিত ছিল।

ফলস্বরূপ, “মহিলাদের” শব্দযুক্ত রেজুমে (যেমন “মহিলাদের দাবা ক্লাব ক্যাপ্টেন”) বা সম্পূর্ণ মহিলা কলেজের রেজুমে সিস্টেম দ্বারা অবমূল্যায়িত হয়েছিল। এই পক্ষপাতমূলক নিয়োগ অ্যালগরিদম প্রযুক্তিগত চাকরির জন্য যোগ্য মহিলাদের অন্যায়ভাবে বাদ দিত। -

স্বাস্থ্যসেবা: যুক্তরাষ্ট্রের হাসপাতালগুলোতে ব্যবহৃত একটি অ্যালগরিদম অতিরিক্ত যত্নের প্রয়োজনীয়তা নির্ধারণে কালো রোগীদের স্বাস্থ্য চাহিদাকে অবমূল্যায়ন করেছিল সাদা রোগীদের তুলনায়। সিস্টেমটি স্বাস্থ্যসেবায় ব্যয়ের উপর ভিত্তি করে যত্ন ব্যবস্থাপনার অগ্রাধিকার নির্ধারণ করত: ঐতিহাসিকভাবে একই রোগের জন্য কালো রোগীদের কম অর্থ ব্যয় করা হয়েছে, তাই অ্যালগরিদম ভুলভাবে ধরে নিয়েছিল কালো রোগীরা “স্বাস্থ্যবান” এবং তাদের কম ঝুঁকি স্কোর দিয়েছিল।

বাস্তবে, এই পক্ষপাতের কারণে অনেক কালো রোগী যারা বেশি যত্নের প্রয়োজন ছিল তারা উপেক্ষিত হয়েছিল – গবেষণায় দেখা গেছে কালো রোগীরা সাদা রোগীদের তুলনায় বছরে প্রায় $১,৮০০ কম চিকিৎসা খরচ করেছে, যা AI-কে তাদের কম চিকিৎসা দেওয়ার দিকে পরিচালিত করেছিল। -

মুখমণ্ডল শনাক্তকরণ: মুখমণ্ডল শনাক্তকরণ প্রযুক্তি বিভিন্ন জনসংখ্যাগত গোষ্ঠীর মধ্যে সঠিকতায় উল্লেখযোগ্য পক্ষপাত প্রদর্শন করেছে। ২০১৯ সালে যুক্তরাষ্ট্রের ন্যাশনাল ইনস্টিটিউট অফ স্ট্যান্ডার্ডস অ্যান্ড টেকনোলজি (NIST) এর একটি বিস্তৃত গবেষণায় দেখা গেছে বেশিরভাগ মুখমণ্ডল শনাক্তকরণ অ্যালগরিদমের ভুলের হার রঙিন এবং মহিলাদের জন্য সাদা পুরুষদের তুলনায় অনেক বেশি।

এক-এক মিলানোর ক্ষেত্রে (যেখানে যাচাই করা হয় দুটি ছবি একই ব্যক্তির কিনা), এশিয়ান এবং আফ্রিকান-আমেরিকান মুখের জন্য ভুল ইতিবাচক শনাক্তকরণ কিছু অ্যালগরিদমে ককেশিয়ান মুখের তুলনায় ১০ থেকে ১০০ গুণ বেশি ছিল। এক-অনেক অনুসন্ধানে (যেখানে একজন ব্যক্তিকে ডাটাবেস থেকে শনাক্ত করা হয়, যা আইন প্রয়োগকারী সংস্থাগুলো ব্যবহার করে), সর্বোচ্চ ভুল শনাক্তকরণ হার ছিল কালো মহিলাদের জন্য – একটি বিপজ্জনক পক্ষপাত যা ইতিমধ্যে নির্দোষ ব্যক্তিদের ভুলভাবে গ্রেফতার করার কারণ হয়েছে।

এই বৈষম্যগুলি দেখায় কিভাবে পক্ষপাতমূলক AI সংখ্যালঘু গোষ্ঠীগুলোর ওপর অযথা ক্ষতি করতে পারে। -

জেনারেটিভ AI এবং অনলাইন কনটেন্ট: সর্বশেষ AI সিস্টেমগুলোও পক্ষপাত থেকে মুক্ত নয়। ২০২৪ সালের একটি ইউনেস্কো গবেষণায় দেখা গেছে বড় ভাষা মডেলগুলি (যা চ্যাটবট এবং কনটেন্ট জেনারেটরের পেছনে থাকে) প্রায়ই পশ্চাৎপদ লিঙ্গ ও জাতিগত স্টেরিওটাইপ তৈরি করে।

উদাহরণস্বরূপ, একটি জনপ্রিয় মডেল মহিলাদের চারগুণ বেশি ঘরোয়া ভূমিকায় বর্ণনা করেছিল পুরুষদের তুলনায়, যেখানে নারীর নামগুলো প্রায়শই “বাড়ি” এবং “শিশু” শব্দের সাথে যুক্ত ছিল, আর পুরুষের নামগুলো “এক্সিকিউটিভ”, “বেতন” এবং “ক্যারিয়ার” এর সাথে। একইভাবে, গবেষণায় দেখা গেছে এই AI মডেলগুলো তাদের আউটপুটে হোমোফোবিক পক্ষপাত এবং সাংস্কৃতিক স্টেরিওটাইপ প্রদর্শন করে।

যেহেতু এখন লক্ষ লক্ষ মানুষ দৈনন্দিন জীবনে জেনারেটিভ AI ব্যবহার করছে, সামান্য পক্ষপাতও বাস্তব জীবনে বৈষম্য বাড়াতে পারে, স্টেরিওটাইপকে ব্যাপকভাবে শক্তিশালী করে।

এই উদাহরণগুলো স্পষ্ট করে যে অ্যালগরিদমিক পক্ষপাত দূরবর্তী বা বিরল সমস্যা নয় – এটি আজকের বিভিন্ন ক্ষেত্রে ঘটছে। চাকরির সুযোগ থেকে বিচার, স্বাস্থ্যসেবা থেকে অনলাইন তথ্য পর্যন্ত, পক্ষপাতমূলক AI সিস্টেম বিদ্যমান বৈষম্যকে পুনরুত্পাদন এবং বাড়িয়ে তুলতে পারে।

ক্ষতি সাধারণত ঐতিহাসিকভাবে বঞ্চিত গোষ্ঠীগুলোর ওপর পড়ে, যা গুরুতর নৈতিক ও মানবাধিকারগত উদ্বেগ সৃষ্টি করে। ইউনেস্কো সতর্ক করে যে, AI-এর ঝুঁকি হলো “বিদ্যমান বৈষম্যের ওপর আরও বৈষম্য যোগ করে, ইতিমধ্যেই প্রান্তিকীকৃত গোষ্ঠীগুলোর জন্য আরও ক্ষতি সৃষ্টি করা”।

কেন AI পক্ষপাত গুরুত্বপূর্ণ?

AI পক্ষপাত মোকাবেলার গুরুত্ব অত্যন্ত বেশি। যদি অবাধে থাকে, পক্ষপাতমূলক অ্যালগরিদম প্রযুক্তিগত নিরপেক্ষতার আড়ালে সিস্টেম্যাটিক বৈষম্যকে দৃঢ় করতে পারে। AI দ্বারা গৃহীত (বা পরিচালিত) সিদ্ধান্ত – যেমন কে নিয়োগ পাবে, কে ঋণ বা প্যারোল পাবে, পুলিশ কাদের নজরদারি করবে – মানুষের জীবনে বাস্তব প্রভাব ফেলে।

যদি এই সিদ্ধান্তগুলি নির্দিষ্ট লিঙ্গ, জাতি বা সম্প্রদায়ের বিরুদ্ধে অন্যায়ভাবে পক্ষপাতমূলক হয়, তবে সামাজিক বৈষম্য বাড়ে। এর ফলে সুযোগ বঞ্চনা, অর্থনৈতিক বৈষম্য, এমনকি ব্যক্তিগত স্বাধীনতা ও নিরাপত্তার হুমকিও দেখা দিতে পারে।

বৃহত্তর প্রেক্ষাপটে, অ্যালগরিদমিক পক্ষপাত মানবাধিকার এবং সামাজিক ন্যায়বিচারকে ক্ষুণ্ন করে, যা সমতা এবং বৈষম্যবিহীনতার নীতির সঙ্গে সাংঘর্ষিক, যা গণতান্ত্রিক সমাজে প্রতিষ্ঠিত।

AI-তে পক্ষপাত প্রযুক্তির প্রতি সাধারণ মানুষের বিশ্বাসও ক্ষুণ্ন করে। মানুষ এমন AI সিস্টেমে বিশ্বাস বা গ্রহণযোগ্যতা কম দেয় যা অন্যায় বা অস্পষ্ট বলে মনে হয়।

ব্যবসা এবং সরকারের জন্য, এই বিশ্বাসের অভাব একটি গুরুতর সমস্যা – সফল উদ্ভাবনের জন্য জনসাধারণের আস্থা অপরিহার্য। একজন বিশেষজ্ঞের মতে, ন্যায়সঙ্গত এবং পক্ষপাতমুক্ত AI সিদ্ধান্ত শুধুমাত্র নৈতিক দৃষ্টিকোণ থেকে নয়, ব্যবসা ও সমাজের জন্যও ভালো কারণ টেকসই উদ্ভাবন আস্থার ওপর নির্ভর করে।

অন্যদিকে, পক্ষপাতজনিত AI ব্যর্থতা (যেমন উপরের ঘটনাগুলো) একটি প্রতিষ্ঠানের সুনাম এবং বৈধতা ক্ষতিগ্রস্ত করতে পারে।

এছাড়াও, অ্যালগরিদমিক পক্ষপাত AI-এর সম্ভাব্য সুবিধাগুলোকে হ্রাস করতে পারে। AI দক্ষতা এবং সিদ্ধান্ত গ্রহণ উন্নত করার প্রতিশ্রুতি রাখে, কিন্তু যদি এর ফলাফল নির্দিষ্ট জনগোষ্ঠীর জন্য বৈষম্যমূলক বা ভুল হয়, তবে এটি তার পূর্ণ ইতিবাচক প্রভাব পৌঁছাতে পারে না।

উদাহরণস্বরূপ, একটি AI স্বাস্থ্য সরঞ্জাম যা এক জনসংখ্যার জন্য ভাল কাজ করে কিন্তু অন্যদের জন্য খারাপ, তা সত্যিই কার্যকর বা গ্রহণযোগ্য নয়। OECD পর্যবেক্ষণ করেছে, AI-তে পক্ষপাত অন্যায়ভাবে সুযোগ সীমাবদ্ধ করে এবং ব্যবসার সুনাম ও ব্যবহারকারীর বিশ্বাস ক্ষতিগ্রস্ত করতে পারে।

সংক্ষেপে, পক্ষপাত মোকাবেলা করা শুধুমাত্র নৈতিক বাধ্যবাধকতা নয়, বরং AI-এর সুবিধাগুলো সবার জন্য ন্যায়সঙ্গতভাবে কাজে লাগানোর জন্য অপরিহার্য।

AI পক্ষপাত কমানোর কৌশলসমূহ

অ্যালগরিদমিক পক্ষপাত এখন ব্যাপকভাবে স্বীকৃত হওয়ায়, এটি কমানোর জন্য বিভিন্ন কৌশল এবং সেরা অনুশীলন উদ্ভাবিত হয়েছে। AI সিস্টেমকে ন্যায়সঙ্গত এবং অন্তর্ভুক্তিমূলক করতে উন্নয়ন ও প্রয়োগের বিভিন্ন পর্যায়ে পদক্ষেপ নেওয়া প্রয়োজন:

-

উন্নত ডেটা অনুশীলন: পক্ষপাতমূলক ডেটা মূল কারণ হওয়ায়, ডেটার গুণগত মান উন্নত করা অপরিহার্য। এর অর্থ হলো বৈচিত্র্যময়, প্রতিনিধিত্বমূলক প্রশিক্ষণ ডেটাসেট ব্যবহার করা যা সংখ্যালঘু গোষ্ঠীগুলোকে অন্তর্ভুক্ত করে এবং পক্ষপাত বা ফাঁক-ফোকর কঠোরভাবে পরীক্ষা করা।

এছাড়াও ঐতিহাসিক পক্ষপাত (যেমন জাতি/লিঙ্গভিত্তিক ভিন্ন ফলাফল) নিরীক্ষণ করে সেগুলো সংশোধন বা সামঞ্জস্য করা প্রয়োজন। যেখানে কিছু গোষ্ঠী কম প্রতিনিধিত্ব পায়, সেখানে ডেটা বৃদ্ধি বা সিন্থেটিক ডেটা ব্যবহার করা যেতে পারে।

NIST-এর গবেষণা দেখিয়েছে যে, মুখমণ্ডল শনাক্তকরণতে আরও বৈচিত্র্যময় প্রশিক্ষণ ডেটা ন্যায়সঙ্গত ফলাফল দিতে পারে। AI আউটপুটের নিয়মিত পর্যবেক্ষণ পক্ষপাতের সমস্যা দ্রুত শনাক্ত করতে সাহায্য করে – যা পরিমাপ করা হয় তা নিয়ন্ত্রণ করা যায়। যদি কোনো প্রতিষ্ঠান তাদের অ্যালগরিদমের সিদ্ধান্তের জনসংখ্যাগত পার্থক্য সম্পর্কে কঠোর তথ্য সংগ্রহ করে, তারা অন্যায় ধরণ চিহ্নিত করে তা সমাধান করতে পারে। -

ন্যায়সঙ্গত অ্যালগরিদম ডিজাইন: ডেভেলপারদের উচিত সচেতনভাবে ন্যায়সঙ্গত সীমাবদ্ধতা এবং পক্ষপাত হ্রাস কৌশল মডেল প্রশিক্ষণে অন্তর্ভুক্ত করা। এর মধ্যে থাকতে পারে এমন অ্যালগরিদম ব্যবহার যা ন্যায়সঙ্গতার জন্য টিউন করা যায় (শুধুমাত্র সঠিকতার জন্য নয়), অথবা গোষ্ঠীগুলোর মধ্যে ভুলের হার সমান করার কৌশল প্রয়োগ।

এখন অনেক টুল এবং ফ্রেমওয়ার্ক (অনেকই ওপেন সোর্স) রয়েছে যা মডেলগুলোর পক্ষপাত পরীক্ষা এবং সমন্বয় করতে সাহায্য করে – যেমন ডেটা পুনঃওজন, সিদ্ধান্তের সীমা পরিবর্তন, বা সংবেদনশীল বৈশিষ্ট্যগুলি চিন্তাশীলভাবে অপসারণ।

গুরুত্বপূর্ণ যে, ন্যায়সঙ্গতার বিভিন্ন গাণিতিক সংজ্ঞা রয়েছে (যেমন সমান পূর্বাভাস পারিটি, সমান ভুল ইতিবাচক হার ইত্যাদি), এবং কখনও কখনও এগুলো পরস্পরের সঙ্গে বিরোধপূর্ণ হতে পারে। সঠিক ন্যায়সঙ্গতার পদ্ধতি নির্বাচন করতে নৈতিক বিচার এবং প্রাসঙ্গিকতা প্রয়োজন, শুধুমাত্র ডেটা পরিবর্তন নয়।

সুতরাং, AI দলগুলোকে বিশেষজ্ঞ এবং প্রভাবিত সম্প্রদায়ের সঙ্গে কাজ করার পরামর্শ দেওয়া হয় যখন তারা নির্দিষ্ট অ্যাপ্লিকেশনের জন্য ন্যায়সঙ্গতার মানদণ্ড নির্ধারণ করে। -

মানব তত্ত্বাবধান এবং জবাবদিহিতা: কোনো AI সিস্টেমই মানব জবাবদিহিতা ছাড়া কাজ করা উচিত নয়। মানব তত্ত্বাবধান পক্ষপাত শনাক্ত এবং সংশোধনে অত্যন্ত গুরুত্বপূর্ণ।

এর অর্থ হলো গুরুত্বপূর্ণ সিদ্ধান্তে মানুষের অংশগ্রহণ থাকা – যেমন নিয়োগকর্তা AI-স্ক্রিন করা প্রার্থীদের পর্যালোচনা করা, অথবা বিচারক AI ঝুঁকি স্কোর সতর্কতার সঙ্গে বিবেচনা করা।

এছাড়াও স্পষ্ট দায়িত্ব নির্ধারণ জরুরি: প্রতিষ্ঠানগুলোকে মনে রাখতে হবে তারা তাদের অ্যালগরিদম দ্বারা গৃহীত সিদ্ধান্তের জন্য কর্মচারীদের মতোই জবাবদিহি বহন করে। AI সিদ্ধান্তের নিয়মিত নিরীক্ষা, পক্ষপাত প্রভাব মূল্যায়ন, এবং AI যুক্তি ব্যাখ্যার ক্ষমতা (explainability) জবাবদিহিতা বজায় রাখতে সাহায্য করে।

স্বচ্ছতাও একটি গুরুত্বপূর্ণ স্তম্ভ: AI সিস্টেম কিভাবে কাজ করে এবং এর সীমাবদ্ধতা সম্পর্কে খোলাখুলি তথ্য প্রদান আস্থা গড়ে তোলে এবং স্বাধীন পর্যালোচনার সুযোগ দেয়।

কিছু অঞ্চলে উচ্চ ঝুঁকিপূর্ণ অ্যালগরিদমিক সিদ্ধান্তের জন্য স্বচ্ছতা বাধ্যতামূলক করার উদ্যোগ নেওয়া হচ্ছে (যেমন, নাগরিকদের প্রভাবিত করে এমন সিদ্ধান্তে অ্যালগরিদম ব্যবহারের তথ্য প্রকাশের জন্য সরকারি সংস্থাগুলোকে বাধ্য করা)। লক্ষ্য হলো AI মানব সিদ্ধান্ত গ্রহণকে সহায়তা করবে নৈতিক বিচার বা আইনি দায়িত্ব প্রতিস্থাপন না করে। -

বৈচিত্র্যময় দল এবং অন্তর্ভুক্তিমূলক উন্নয়ন: বিশেষজ্ঞদের একটি ক্রমবর্ধমান গোষ্ঠী AI ডেভেলপার এবং স্টেকহোল্ডারদের মধ্যে বৈচিত্র্যের মূল্য জোর দিয়ে বলছে। AI পণ্যগুলো তাদের নির্মাতাদের দৃষ্টিভঙ্গি এবং অন্ধস্থান প্রতিফলিত করে।

সুতরাং, যদি শুধুমাত্র একটি সমজাতীয় গোষ্ঠী (যেমন একটি লিঙ্গ, একটি জাতি, বা একটি সাংস্কৃতিক পটভূমি) AI সিস্টেম ডিজাইন করে, তারা হয়তো বুঝতে পারবে না কিভাবে এটি অন্যদের ওপর অন্যায় প্রভাব ফেলতে পারে।

বৈচিত্র্যময় কণ্ঠস্বর – যার মধ্যে রয়েছে নারী, জাতিগত সংখ্যালঘু এবং সামাজিক বিজ্ঞান বা নৈতিকতার বিশেষজ্ঞরা – ডিজাইন এবং পরীক্ষার প্রক্রিয়ায় অন্তর্ভুক্ত করা AI-কে আরও সাংস্কৃতিকভাবে সচেতন করে তোলে।

ইউনেস্কো উল্লেখ করেছে যে সাম্প্রতিক তথ্য অনুযায়ী, AI ক্ষেত্রে মহিলাদের প্রতিনিধিত্ব খুবই কম (প্রায় ২০% প্রযুক্তিগত AI কর্মী এবং ১২% AI গবেষক নারী)। প্রতিনিধিত্ব বাড়ানো শুধুমাত্র কর্মক্ষেত্রে সমতার জন্য নয়, বরং AI ফলাফল উন্নত করার জন্যও জরুরি: যদি AI সিস্টেম বৈচিত্র্যময় দল দ্বারা তৈরি না হয়, তবে তারা বৈচিত্র্যময় ব্যবহারকারীদের চাহিদা পূরণ বা সবার অধিকার রক্ষা করতে সক্ষম হবে না।

ইউনেস্কোর Women4Ethical AI প্ল্যাটফর্মের মতো উদ্যোগ বৈচিত্র্য বাড়ানো এবং পক্ষপাতমুক্ত AI ডিজাইনের সেরা অনুশীলন শেয়ার করার লক্ষ্যে কাজ করছে। -

নিয়ন্ত্রণ এবং নৈতিক নির্দেশিকা: সরকার এবং আন্তর্জাতিক সংস্থাগুলো এখন সক্রিয়ভাবে AI পক্ষপাত মোকাবেলা নিশ্চিত করতে উদ্যোগ নিচ্ছে। ২০২১ সালে, ইউনেস্কোর সদস্য রাষ্ট্রগুলো একমতভাবে কৃত্রিম বুদ্ধিমত্তার নৈতিকতা সম্পর্কিত সুপারিশ গ্রহণ করেছে – যা AI নৈতিকতার জন্য প্রথম বিশ্বব্যাপী কাঠামো।

এটি স্বচ্ছতা, ন্যায়সঙ্গতা, এবং বৈষম্যবিহীনতার নীতিগুলো প্রতিষ্ঠা করে এবং AI সিস্টেমের মানব তত্ত্বাবধানের গুরুত্ব জোর দেয়। এই নীতিগুলো জাতিগুলোকে AI সম্পর্কিত নীতি ও আইন প্রণয়নে নির্দেশিকা হিসেবে কাজ করে।

একইভাবে, ইউরোপীয় ইউনিয়নের নতুন AI আইন (যা ২০২৪ সালে সম্পূর্ণ কার্যকর হবে) স্পষ্টভাবে পক্ষপাত প্রতিরোধকে অগ্রাধিকার দেয়। AI আইনের প্রধান উদ্দেশ্যগুলোর একটি হলো উচ্চ ঝুঁকিপূর্ণ AI সিস্টেমে বৈষম্য এবং পক্ষপাত হ্রাস করা।

এই আইন অনুযায়ী সংবেদনশীল ক্ষেত্রে ব্যবহৃত সিস্টেমগুলো (যেমন নিয়োগ, ঋণ, আইন প্রয়োগ ইত্যাদি) কঠোর ন্যায়সঙ্গতা মূল্যায়নের মধ্য দিয়ে যাবে এবং সংরক্ষিত গোষ্ঠীগুলোর ওপর অযথা ক্ষতি করবে না।

উল্লঙ্ঘন হলে বড় জরিমানা হতে পারে, যা কোম্পানিগুলোকে পক্ষপাত নিয়ন্ত্রণে উৎসাহিত করবে।

বিস্তৃত নিয়ন্ত্রণের পাশাপাশি, কিছু স্থানীয় সরকার নির্দিষ্ট পদক্ষেপ নিয়েছে – যেমন, সান ফ্রান্সিসকো, বোস্টন এবং মিনিয়াপোলিসসহ এক ডজনের বেশি বড় শহর পুলিশি ব্যবহারের জন্য মুখমণ্ডল শনাক্তকরণ প্রযুক্তি সম্পূর্ণ নিষিদ্ধ করেছে এর প্রদর্শিত জাতিগত পক্ষপাত এবং নাগরিক অধিকার ঝুঁকির কারণে।

শিল্প ক্ষেত্রেও, মান সংস্থা এবং প্রযুক্তি কোম্পানিগুলো নীতিমালা প্রকাশ করছে এবং টুলস (যেমন ন্যায়সঙ্গতা টুলকিট এবং নিরীক্ষা ফ্রেমওয়ার্ক) তৈরি করছে যাতে AI উন্নয়নে নৈতিকতা অন্তর্ভুক্ত করা যায়।

“বিশ্বাসযোগ্য AI” আন্দোলন এই প্রচেষ্টাগুলোর সমন্বয়ে গঠিত, যা নিশ্চিত করে AI সিস্টেম আইনি, নৈতিক এবং দৃঢ় বাস্তবে।

>>> আপনি জানতে চান:

কর্মসংস্থানে কৃত্রিম বুদ্ধিমত্তার (AI) প্রভাব

কৃত্রিম বুদ্ধিমত্তা এবং অ্যালগরিদমিক পক্ষপাত একটি বৈশ্বিক চ্যালেঞ্জ যা আমরা এখনো কার্যকরভাবে মোকাবেলা শুরু করেছি। উপরের উদাহরণ এবং প্রচেষ্টা স্পষ্ট করে যে AI পক্ষপাত একটি সীমিত সমস্যা নয় – এটি বিশ্বব্যাপী অর্থনৈতিক সুযোগ, বিচার, স্বাস্থ্য এবং সামাজিক সংহতিতে প্রভাব ফেলে।

সদর খবর হলো সচেতনতা ব্যাপকভাবে বৃদ্ধি পেয়েছে এবং একটি ঐকমত্য গড়ে উঠছে যে AI অবশ্যই মানবকেন্দ্রিক এবং ন্যায়সঙ্গত হতে হবে।

এটি অর্জনের জন্য অব্যাহত সতর্কতা প্রয়োজন: AI সিস্টেম নিয়মিত পক্ষপাতের জন্য পরীক্ষা করা, ডেটা ও অ্যালগরিদম উন্নত করা, বৈচিত্র্যময় স্টেকহোল্ডারদের অন্তর্ভুক্ত করা এবং প্রযুক্তির বিকাশের সঙ্গে নিয়মকানুন আপডেট করা।

মূলত, অ্যালগরিদমিক পক্ষপাতের বিরুদ্ধে লড়াই হলো AI-কে আমাদের সমতা এবং ন্যায়বিচারের মূল্যবোধের সঙ্গে সামঞ্জস্য করা। ইউনেস্কোর মহাপরিচালক অড্রে আজুলে বলেছেন, এমনকি “AI কনটেন্টে ছোট ছোট পক্ষপাত বাস্তব জীবনে বৈষম্যকে উল্লেখযোগ্যভাবে বাড়িয়ে দিতে পারে”।

সুতরাং, পক্ষপাতমুক্ত AI অর্জন করা অত্যন্ত গুরুত্বপূর্ণ যাতে প্রযুক্তি পুরনো পূর্বাগ্রহকে পুনরায় জোরদার না করে বরং সমাজের সব অংশকে উন্নীত করে।

AI ডিজাইনে নৈতিক নীতিমালা অগ্রাধিকার দিয়ে – এবং সেগুলোকে বাস্তব পদক্ষেপ ও নীতির মাধ্যমে সমর্থন করে – আমরা AI-এর উদ্ভাবনী শক্তিকে কাজে লাগাতে পারি এবং মানব মর্যাদা রক্ষা করতে পারি।

AI-এর ভবিষ্যত এমন একটি পথ যেখানে বুদ্ধিমান যন্ত্রগুলি মানবতার সেরা মূল্যবোধ থেকে শিখবে, আমাদের সবচেয়ে খারাপ পক্ষপাত নয়, যা প্রযুক্তিকে সবার জন্য সত্যিই উপকারী করে তুলবে।