Yapay Zeka ve Algoritmik Önyargı

Yapay zeka algoritmaları, işe alımdan finansmana kadar birçok sektörde giderek daha fazla kullanılmakta, ancak önyargı ve ayrımcılık riskleri taşımaktadır. Otomatik yapay zeka kararları, eğitim verileri önyargılı veya çeşitlilikten yoksunsa toplumsal adaletsizlikleri yansıtabilir veya artırabilir. Algoritmik önyargıyı anlamak, işletmelerin, geliştiricilerin ve kullanıcıların daha adil ve şeffaf yapay zeka sistemleri oluşturmasına, yönetmesine ve tanımlamasına yardımcı olur.

Yapay zekadaki algoritmik önyargılar hakkında mı merak ediyorsunuz? Bu makalede INVIAI ile Yapay Zeka ve Algoritmik Önyargı hakkında daha fazla bilgi edinin!

Yapay Zeka (YZ) günlük hayatımızda giderek daha fazla yer almakta – işe alım kararlarından sağlık hizmetlerine ve kolluk kuvvetlerine kadar – ancak kullanımı algoritmik önyargı konusunda endişeler doğurmuştur. Algoritmik önyargı, YZ sistemlerinin çıktılarında sistematik ve adaletsiz önyargılar anlamına gelir; bu önyargılar genellikle toplumsal stereotipleri ve eşitsizlikleri yansıtır.

Özetle, bir yapay zeka algoritması, eğitim verilerinde veya tasarımında bulunan insan önyargılarını istemeden yeniden üretebilir ve bu da ayrımcı sonuçlara yol açabilir.

Bu konu, teknoloji etiğinde en çok tartışılan zorluklardan biri haline gelmiş ve araştırmacılar, politika yapıcılar ile sektör liderlerinin küresel dikkatini çekmiştir. YZ’nin hızlı benimsenmesi, önyargının şimdi ele alınmasını zorunlu kılmaktadır: etik sınırlar olmadan, YZ gerçek dünya önyargılarını ve ayrımcılığı yeniden üretme riski taşır, toplumsal bölünmeleri derinleştirir ve temel insan haklarını tehdit edebilir.

Aşağıda, algoritmik önyargının nedenlerini, gerçek dünyadaki etkilerine dair örnekleri ve dünyanın YZ’yi daha adil hale getirmek için attığı adımları inceleyeceğiz.

Algoritmik Önyargıyı ve Nedenlerini Anlamak

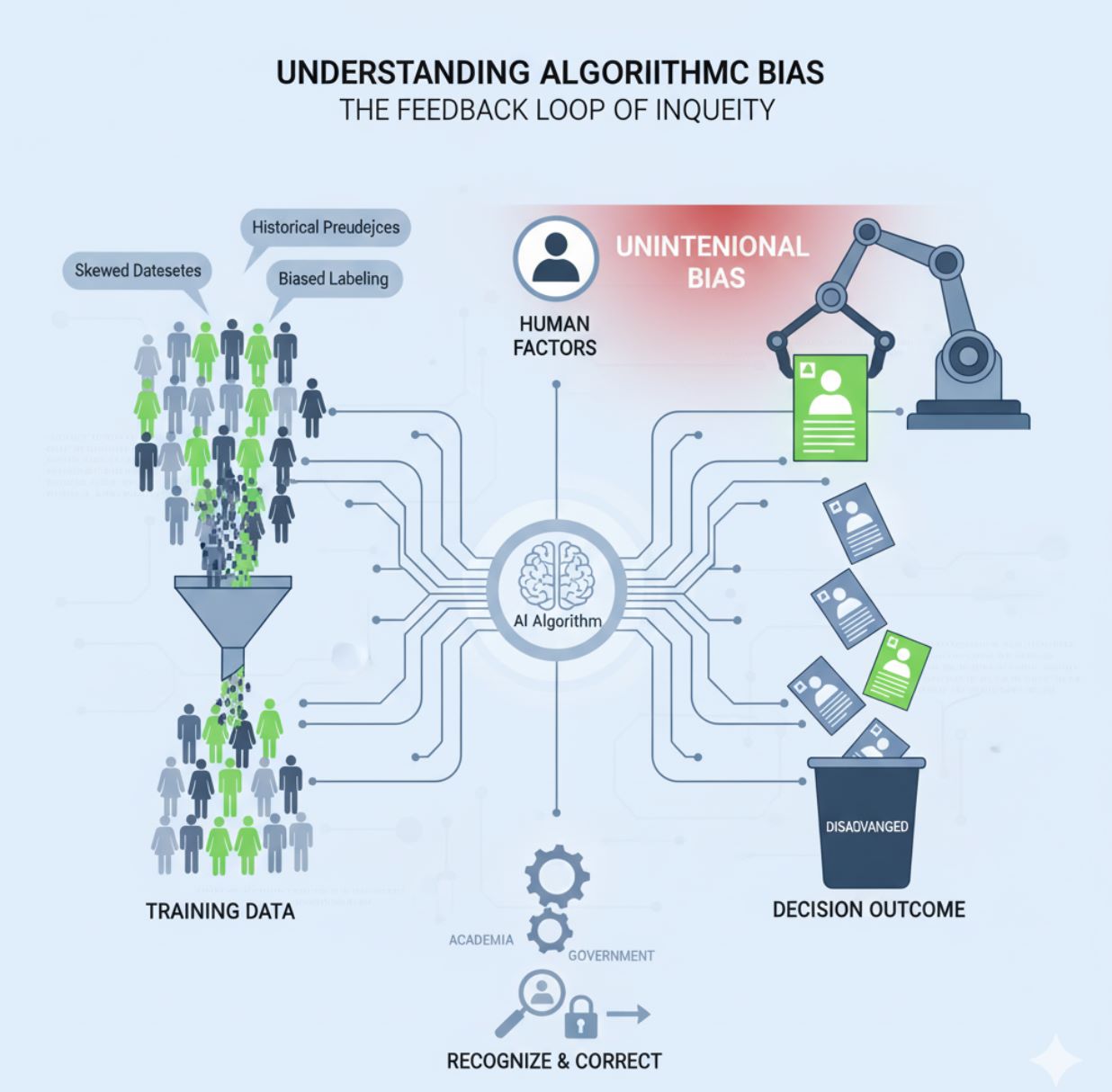

Algoritmik önyargı genellikle YZ’nin “ayrımcılık yapmak istememesi” değil, insan faktörlerinden kaynaklanır. YZ sistemleri, insanlar tarafından oluşturulan kuralları ve verileri öğrenir – ve insanlar (çoğunlukla bilinçsiz) önyargılara sahiptir.

Eğitim verileri çarpıksa veya tarihsel önyargıları yansıtıyorsa, YZ muhtemelen bu kalıpları öğrenir.

Örneğin, on yıl boyunca teknoloji sektöründeki işe alımlara dayalı bir özgeçmiş tarama YZ’si (çoğunlukla erkek adayların işe alındığı bir ortamda) erkek adayların tercih edildiğini varsayabilir ve böylece kadınları dezavantajlı duruma sokabilir. Diğer yaygın nedenler arasında eksik veya temsil etmeyen veri setleri, önyargılı veri etiketlemesi veya algoritmaların genel doğruluk için optimize edilip azınlık gruplarının adil temsilini göz ardı etmesi yer alır.

Kısacası, YZ algoritmaları, yaratıcılarının ve verilerinin önyargılarını devralır; bu önyargıları tanımak ve düzeltmek için kasıtlı adımlar atılmadıkça.

Algoritmik önyargının genellikle istem dışı olduğunu belirtmek önemlidir. Kuruluşlar, kararları daha objektif hale getirmek için YZ’yi benimser, ancak sisteme önyargılı bilgi verir veya tasarımda eşitliği göz önünde bulundurmazlarsa, sonuçlar yine adaletsiz olabilir. YZ önyargısı, fırsatları haksızca dağıtabilir ve yanlış sonuçlar üretebilir, bu da insanların refahını olumsuz etkiler ve YZ’ye olan güveni zedeler.

Önyargının neden ortaya çıktığını anlamak, çözüme giden ilk adımdır – ve bu adım, akademi, sektör ve hükümetler tarafından dünya çapında ciddiyetle ele alınmaktadır.

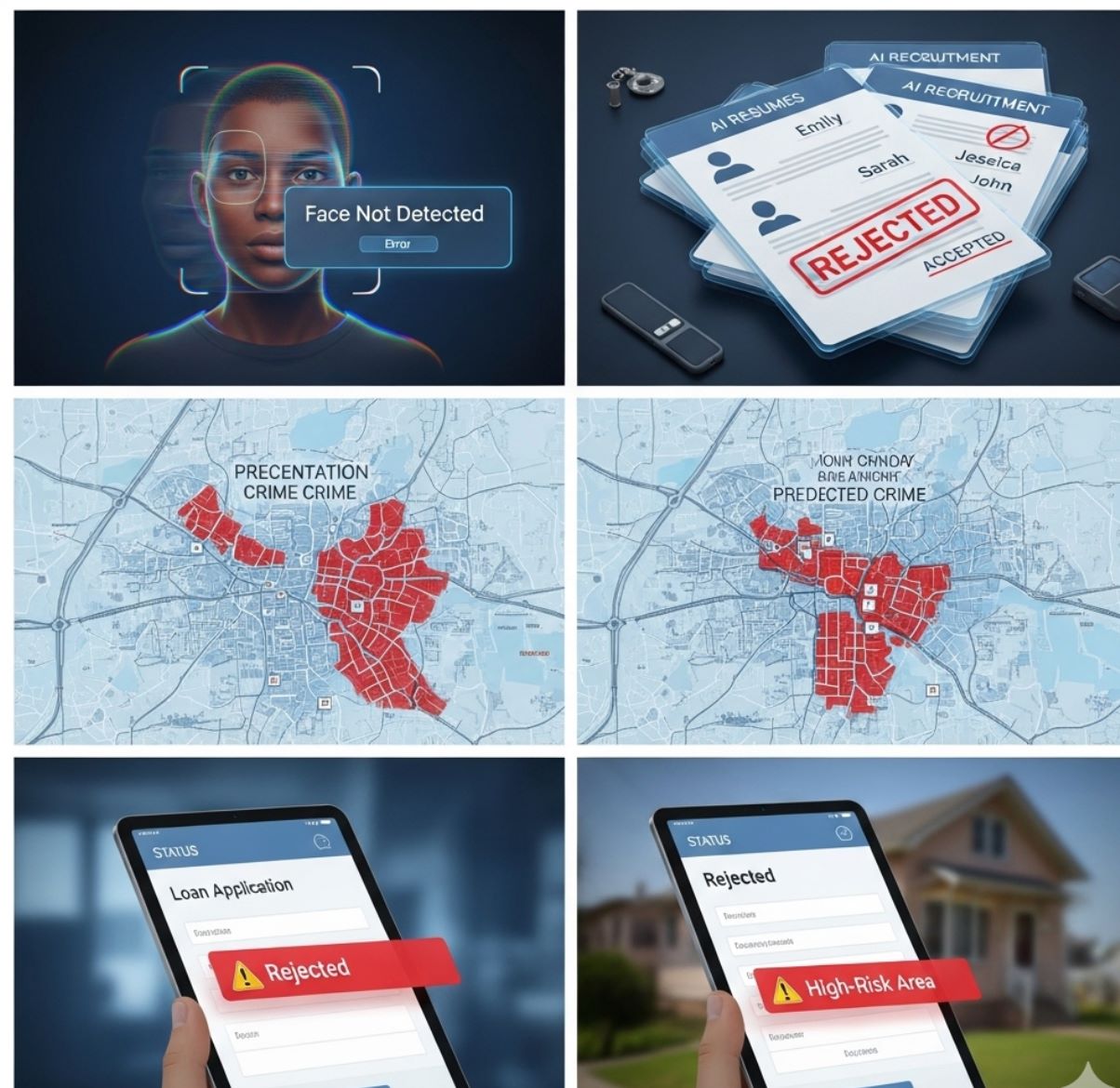

YZ Önyargısına Gerçek Dünya Örnekleri

YZ’deki önyargı sadece teorik bir endişe değildir; birçok gerçek dünya vakası, algoritmik önyargının ayrımcılığa yol açabileceğini göstermiştir. Farklı sektörlerdeki dikkat çekici YZ önyargısı örnekleri şunlardır:

-

Ceza Adaleti: Amerika Birleşik Devletleri’nde, suçun tekrarlanma olasılığını tahmin etmek için kullanılan popüler bir algoritmanın Siyahi sanıklara karşı önyargılı olduğu tespit edilmiştir. Bu algoritma, Siyahi sanıkları yüksek riskli, beyaz sanıkları ise düşük riskli olarak yanlış değerlendirmiş ve ceza adaletindeki ırksal eşitsizlikleri artırmıştır.

Bu vaka, YZ’nin kolluk kuvvetleri ve mahkemelerdeki tarihsel önyargıları nasıl güçlendirebileceğini göstermektedir. -

İşe Alım ve Personel Seçimi: Amazon, kadınlara karşı ayrımcılık yaptığı ortaya çıkan bir YZ işe alım aracını kullanımdan kaldırmıştır. Makine öğrenimi modeli, geçmişte çoğunlukla erkek adayların yer aldığı özgeçmişlerle eğitildiği için erkek adayları tercih etmeyi öğrenmişti.

Sonuç olarak, “kadın” kelimesini içeren özgeçmişler (örneğin “kadın satranç kulübü kaptanı”) veya tamamen kadınlara ait okullar sistem tarafından düşük puanlanmıştır. Bu önyargılı işe alım algoritması, teknik pozisyonlar için nitelikli kadın adayları haksızca elerdi. -

Sağlık Hizmetleri: ABD’de hastaneler tarafından hastaların ekstra bakıma ihtiyacı olup olmadığını belirlemek için kullanılan bir algoritmanın, Siyahi hastaların sağlık ihtiyaçlarını az değerlediği ortaya çıkmıştır. Sistem, bakım önceliğini sağlık harcamalarına göre tahmin ediyordu: tarihsel olarak aynı hastalık seviyesindeki Siyahi hastalara daha az harcama yapıldığı için algoritma Siyahi hastaların “daha sağlıklı” olduğunu varsaymış ve onlara daha düşük risk puanları vermiştir.

Pratikte, bu önyargı, daha fazla bakıma ihtiyaç duyan birçok Siyahi hastanın göz ardı edilmesine yol açmıştır – çalışma, Siyahi hastaların yılda yaklaşık 1.800 dolar daha az tıbbi masraf yaptığını ve bunun YZ’nin onları yetersiz tedavi etmesine neden olduğunu göstermiştir. -

Yüz Tanıma: Yüz tanıma teknolojisi, demografik gruplar arasında önemli önyargılar göstermiştir. ABD Ulusal Standartlar ve Teknoloji Enstitüsü’nün (NIST) 2019’daki kapsamlı bir çalışması, çoğu yüz tanıma algoritmasının renkli insanlar ve kadınlar için beyaz erkeklere kıyasla çok daha yüksek hata oranlarına sahip olduğunu ortaya koymuştur.

Bire bir eşleştirme senaryolarında (iki fotoğrafın aynı kişiye ait olup olmadığını doğrulama), Asyalı ve Afrikalı-Amerikalı yüzlerde yanlış pozitif tanımlamalar bazı algoritmalarda Beyaz yüzlere göre 10 ila 100 kat daha fazla olmuştur. Birden çok kişi arasından arama yapma durumlarında (örneğin kolluk kuvvetlerinin kullandığı veri tabanından kişi tanımlama), en yüksek yanlış tanımlama oranları Siyahi kadınlarda görülmüştür – bu tehlikeli bir önyargıdır ve masum insanların yanlış yere tutuklanmasına yol açmıştır.

Bu farklılıklar, önyargılı YZ’nin marjinal gruplara orantısız zarar verebileceğini göstermektedir. -

Üretken YZ ve Çevrimiçi İçerik: En yeni YZ sistemleri bile bu önyargılardan muaf değildir. 2024 UNESCO çalışması, büyük dil modellerinin (sohbet botları ve içerik üreticilerinin arkasındaki YZ) sıklıkla gerici cinsiyet ve ırksal stereotipler ürettiğini ortaya koymuştur.

Örneğin, bir popüler modelde kadınlar erkeklere göre dört kat daha fazla ev içi rollerle tanımlanmıştır; kadın isimleri sık sık “ev” ve “çocuklar” gibi kelimelerle ilişkilendirilirken, erkek isimleri “yönetici”, “maaş” ve “kariyer” ile bağdaştırılmıştır. Benzer şekilde, çalışma bu YZ modellerinin çıktılarında homofobik önyargılar ve kültürel stereotipler gösterdiğini tespit etmiştir.

Milyonlarca kişinin günlük yaşamda üretken YZ kullandığı düşünüldüğünde, içerikteki bu ince önyargılar gerçek dünyadaki eşitsizlikleri artırabilir ve stereotipleri yaygınlaştırabilir.

Bu örnekler, algoritmik önyargının uzak veya nadir bir sorun olmadığını – bugün birçok alanda yaşandığını vurgulamaktadır. İş fırsatlarından adalete, sağlık hizmetlerinden çevrimiçi bilgiye kadar, önyargılı YZ sistemleri mevcut ayrımcılığı tekrar edebilir ve hatta şiddetlendirebilir.

Zarar genellikle tarihsel olarak dezavantajlı gruplar tarafından çekilmekte ve ciddi etik ile insan hakları sorunlarını gündeme getirmektedir. UNESCO’nun uyarısına göre, YZ’nin riskleri “mevcut eşitsizliklerin üzerine eklenerek, zaten marjinalleşmiş gruplara daha fazla zarar vermektedir”.

YZ Önyargısı Neden Önemlidir?

YZ önyargısını ele almak kritik önemdedir. Kontrol edilmezse, önyargılı algoritmalar sistematik ayrımcılığı teknoloji tarafsızlığı maskesi altında pekiştirebilir. YZ tarafından yapılan (veya yönlendirilen) kararlar – kim işe alınır, kim kredi veya şartlı tahliye alır, polis gözetimi nasıl hedeflenir – insanların hayatları üzerinde gerçek sonuçlar doğurur.

Bu kararlar belirli cinsiyetlere, ırklara veya topluluklara karşı haksızca eğilimliyse, toplumsal eşitsizlikler derinleşir. Bu durum, fırsatların reddedilmesine, ekonomik uçurumların büyümesine veya etkilenen grupların kişisel özgürlük ve güvenliğinin tehdit edilmesine yol açabilir.

Daha geniş anlamda, algoritmik önyargı insan hakları ve sosyal adaleti zedeler, demokratik toplumların benimsediği eşitlik ve ayrımcılık yapmama ilkeleriyle çelişir.

YZ’deki önyargı, teknolojinin kamu güvenini de aşındırır. İnsanlar, adaletsiz veya şeffaf olmayan YZ sistemlerine daha az güvenir ve benimser.

İşletmeler ve hükümetler için bu güven açığı ciddi bir sorundur – başarılı inovasyon kamu güvenine dayanır. Bir uzmanın belirttiği gibi, adil ve önyargısız YZ kararları sadece etik açıdan doğru değil, güven üzerine kurulu sürdürülebilir inovasyon için de gereklidir.

Öte yandan, yukarıdaki örneklerde olduğu gibi önyargı nedeniyle yaşanan yüksek profilli YZ başarısızlıkları, bir kuruluşun itibarını ve meşruiyetini zedeleyebilir.

Ayrıca, algoritmik önyargı YZ’nin potansiyel faydalarını azaltabilir. YZ, verimliliği ve karar alma süreçlerini iyileştirme vaadi taşır, ancak sonuçları nüfusun bazı kesimleri için ayrımcı veya yanlışsa, tam olumlu etkisini gösteremez.

Örneğin, bir YZ sağlık aracı bir demografi için iyi çalışırken diğerleri için kötü performans gösteriyorsa, bu araç gerçekten etkili veya kabul edilebilir değildir. OECD’nin belirttiği gibi, YZ’deki önyargı fırsatları haksızca sınırlar ve işletmelerin itibarını ile kullanıcı güvenini kaybetmesine neden olabilir.

Kısacası, önyargıyı ele almak sadece ahlaki bir zorunluluk değil, aynı zamanda YZ’nin faydalarını herkes için adil şekilde kullanabilmek için kritik önemdedir.

YZ Önyargısını Azaltma Stratejileri

Algoritmik önyargı artık yaygın şekilde tanındığı için, onu azaltmaya yönelik çeşitli stratejiler ve en iyi uygulamalar geliştirilmiştir. YZ sistemlerinin adil ve kapsayıcı olmasını sağlamak, geliştirme ve uygulamanın birçok aşamasında eylem gerektirir:

-

Daha İyi Veri Uygulamaları: Önyargılı veriler temel neden olduğundan, veri kalitesini artırmak esastır. Bu, azınlık gruplarını da içeren çeşitli ve temsil edici eğitim veri setleri kullanmak ve veri sapması veya eksiklikleri titizlikle kontrol etmek anlamına gelir.

Ayrıca, verilerin tarihsel önyargılar açısından denetlenmesi (örneğin ırk/cinsiyete göre farklı sonuçlar) ve model eğitimi öncesinde bu önyargıların düzeltilmesi veya dengelenmesi gerekir. Bazı gruplar az temsil ediliyorsa, veri artırma veya sentetik veri teknikleri yardımcı olabilir.

NIST’in araştırması, daha çeşitli eğitim verilerinin yüz tanımada daha adil sonuçlar verebileceğini göstermiştir. YZ çıktılarının sürekli izlenmesi de önyargı sorunlarını erken tespit etmeye olanak tanır – ölçülen şey yönetilir. Bir kuruluş, algoritmasının kararlarının demografiklere göre nasıl değiştiğine dair somut veriler toplarsa, adaletsiz kalıpları belirleyip düzeltebilir. -

Adil Algoritma Tasarımı: Geliştiriciler, model eğitimine adalet kısıtlamaları ve önyargı azaltma teknikleri bilinçli olarak entegre etmelidir. Bu, sadece doğruluk değil, adalet için de ayarlanabilen algoritmalar kullanmak veya gruplar arasında hata oranlarını eşitlemek için teknikler uygulamak anlamına gelir.

Artık birçok açık kaynaklı araç ve çerçeve, modelleri önyargı açısından test etmeye ve ayarlamaya olanak tanımaktadır – örneğin, verileri yeniden ağırlama, karar eşiklerini değiştirme veya hassas özellikleri dikkatli şekilde çıkarma.

Önemli olarak, adaletin birçok matematiksel tanımı vardır (örneğin eşit tahmin doğruluğu, eşit yanlış pozitif oranları vb.) ve bazen bunlar çelişir. Doğru adalet yaklaşımını seçmek etik yargı ve bağlam gerektirir, sadece veri ayarı değil.

Bu nedenle, YZ ekiplerinin belirli uygulamalar için adalet kriterlerini tanımlarken alan uzmanları ve etkilenen topluluklarla iş birliği yapmaları teşvik edilir. -

İnsan Denetimi ve Hesap Verebilirlik: Hiçbir YZ sistemi insan sorumluluğu olmadan çalışmamalıdır. İnsan denetimi, makinenin öğrenebileceği önyargıları yakalamak ve düzeltmek için kritik önemdedir.

Bu, önemli kararlar için insanın sürece dahil olması anlamına gelir – örneğin, işe alımda YZ tarafından taranan adayların bir insan tarafından gözden geçirilmesi veya bir yargıcın YZ risk puanını dikkatle değerlendirmesi.

Ayrıca, sorumluluğun açıkça belirlenmesi gerekir: kuruluşlar, algoritmalarının verdiği kararlar için çalışanlar gibi hesap verebilir olmalıdır. YZ kararlarının düzenli denetimleri, önyargı etki değerlendirmeleri ve YZ mantığının açıklanabilirliği (açıklanabilirlik) hesap verebilirliği destekler.

Şeffaflık da burada önemli bir sütundur: YZ sisteminin nasıl çalıştığı ve bilinen sınırlamaları hakkında açık olmak, güven oluşturur ve bağımsız incelemeye olanak tanır.

Hatta bazı yargı bölgeleri, yüksek riskli algoritmik kararlar için şeffaflık zorunluluğu getirmeye başlamıştır (örneğin, kamu kurumlarının vatandaşları etkileyen kararlarında algoritmaların kullanımını açıklaması). Amaç, YZ’nin etik yargı ve yasal sorumluluğun yerini almadan insan kararını desteklemesini sağlamaktır. -

Çeşitli Ekipler ve Kapsayıcı Geliştirme: Uzmanlar, YZ geliştiricileri ve paydaşları arasında çeşitliliğin önemini giderek daha fazla vurgulamaktadır. YZ ürünleri, onları geliştirenlerin bakış açılarını ve kör noktalarını yansıtır.

Bu nedenle, sadece homojen bir grup (örneğin tek bir cinsiyet, etnik köken veya kültürel arka plan) YZ sistemi tasarlarsa, başkalarını haksız etkileyebilecek yönleri gözden kaçırabilir.

Tasarım ve test sürecine kadınlar, ırksal azınlıklar ve sosyal bilimler veya etik uzmanları gibi çeşitli seslerin dahil edilmesi, daha kültürel farkındalığı yüksek YZ’ye yol açar.

UNESCO, mevcut verilere göre YZ alanında kadınların çok az temsil edildiğini (teknik YZ çalışanlarının sadece %20’si ve YZ araştırmacılarının %12’si kadın) belirtmektedir. Temsilin artırılması sadece işyeri eşitliği için değil, YZ sonuçlarının iyileştirilmesi için de gereklidir: Çeşitli ekipler tarafından geliştirilmemiş YZ sistemleri, çeşitli kullanıcıların ihtiyaçlarını karşılamak veya herkesin haklarını korumak konusunda yetersiz kalır.

UNESCO’nun Women4Ethical AI platformu gibi girişimler, çeşitliliği artırmayı ve ayrımcılığa yer vermeyen YZ tasarımı için en iyi uygulamaları paylaşmayı amaçlamaktadır. -

Regülasyon ve Etik Rehberler: Hükümetler ve uluslararası kuruluşlar, YZ önyargısının ele alınmasını sağlamak için aktif adımlar atmaktadır. 2021’de, UNESCO üye devletleri oybirliğiyle Yapay Zeka Etiği Tavsiyesi’ni kabul etmiştir – YZ etiği için ilk küresel çerçeve.

Bu tavsiye, şeffaflık, adalet ve ayrımcılık yapmama ilkelerini benimser ve YZ sistemlerinin insan denetiminin önemini vurgular. Bu ilkeler, ülkelerin YZ politikaları ve yasaları oluşturmasına rehberlik eder.

Benzer şekilde, Avrupa Birliği’nin 2024’te tam yürürlüğe girecek yeni YZ Yasası, önyargı önlemeyi öncelik haline getirmiştir. YZ Yasası’nın ana hedeflerinden biri, yüksek riskli YZ sistemlerinde ayrımcılık ve önyargıyı azaltmaktır.

Yasa, işe alım, kredi, kolluk kuvvetleri gibi hassas alanlarda kullanılan sistemlerin adalet açısından sıkı değerlendirmelerden geçmesini ve korunan gruplara orantısız zarar vermemesini zorunlu kılacaktır.

İhlaller ağır para cezalarına yol açabilir ve şirketleri önyargı kontrolü geliştirmeye teşvik eder.

Geniş düzenlemelerin yanı sıra, bazı yerel yönetimler hedefe yönelik adımlar atmıştır – örneğin, San Francisco, Boston ve Minneapolis gibi ondan fazla büyük şehir, yüz tanıma teknolojisinin ırksal önyargı ve sivil haklar riskleri nedeniyle polis tarafından kullanımını tamamen yasaklamıştır.

Sektör tarafında, standart kuruluşları ve teknoloji şirketleri, etik ilkeleri YZ geliştirmeye entegre etmek için rehberler ve araçlar (örneğin adalet araç setleri ve denetim çerçeveleri) yayımlamaktadır.

“Güvenilir YZ” hareketi, bu çabaların birleşimini içerir ve YZ sistemlerinin yasal, etik ve sağlam olmasını hedefler.

>>> Şunu öğrenmek ister misiniz:

Yapay Zekanın İşler Üzerindeki Etkisi

YZ ve algoritmik önyargı, henüz etkin şekilde ele almaya başladığımız küresel bir zorluktur. Yukarıdaki örnekler ve çabalar, YZ önyargısının niş bir sorun olmadığını – ekonomik fırsatları, adaleti, sağlığı ve toplumsal uyumu dünya çapında etkilediğini açıkça göstermektedir.

İyi haber, farkındalığın hızla artması ve YZ’nin insan odaklı ve adil olması gerektiği konusunda bir uzlaşmanın oluşmasıdır.

Bunu başarmak sürekli dikkat gerektirir: YZ sistemlerini önyargı açısından düzenli test etmek, veri ve algoritmaları geliştirmek, çeşitli paydaşları dahil etmek ve teknoloji geliştikçe düzenlemeleri güncellemek.

Özünde, algoritmik önyargıyla mücadele YZ’yi eşitlik ve adalet değerlerimizle uyumlu hale getirmekle ilgilidir. UNESCO Genel Direktörü Audrey Azoulay’nin belirttiği gibi, “YZ içeriğindeki küçük önyargılar bile gerçek dünyadaki eşitsizlikleri önemli ölçüde artırabilir”.

Bu nedenle, önyargısız YZ arayışı, teknolojinin toplumun tüm kesimlerini desteklemesini, eski önyargıları pekiştirmemesini sağlamak için kritik önemdedir.

YZ tasarımında etik ilkeleri önceliklendirmek – ve bunları somut eylem ve politikalarla desteklemek – YZ’nin yenilik gücünü insan onurunu koruyarak kullanmamıza olanak tanır.

YZ için gelecek yol, akıllı makinelerin en kötü önyargılarımızdan değil, insanlığın en iyi değerlerinden öğrenmesi ve teknolojinin gerçekten herkes için faydalı olmasıdır.