Mô hình Ngôn ngữ Lớn (LLMs) là hệ thống AI được huấn luyện trên các bộ dữ liệu văn bản khổng lồ để hiểu và tạo ra ngôn ngữ giống con người. Nói một cách đơn giản, một LLM đã được cung cấp hàng triệu hoặc hàng tỷ từ (thường lấy từ Internet) để có thể dự đoán và tạo ra văn bản theo ngữ cảnh. Những mô hình này thường được xây dựng trên nền tảng mạng nơ-ron học sâu – phổ biến nhất là kiến trúc transformer. Nhờ quy mô lớn, LLM có thể thực hiện nhiều nhiệm vụ ngôn ngữ (trò chuyện, dịch thuật, viết lách) mà không cần lập trình riêng biệt cho từng nhiệm vụ.

Các đặc điểm chính của mô hình ngôn ngữ lớn bao gồm:

- Dữ liệu huấn luyện khổng lồ: LLMs được huấn luyện trên kho văn bản rộng lớn (hàng tỷ trang). Bộ dữ liệu “lớn” này giúp chúng có kiến thức sâu rộng về ngữ pháp và sự thật.

- Kiến trúc transformer: Chúng sử dụng mạng nơ-ron transformer với cơ chế tự chú ý, nghĩa là mỗi từ trong câu được so sánh song song với tất cả các từ khác. Điều này giúp mô hình học ngữ cảnh hiệu quả.

- Hàng tỷ tham số: Mô hình chứa hàng triệu hoặc hàng tỷ trọng số (tham số). Những tham số này ghi nhận các mẫu phức tạp trong ngôn ngữ. Ví dụ, GPT-3 có 175 tỷ tham số.

- Học tự giám sát: LLMs học bằng cách dự đoán từ bị thiếu trong văn bản mà không cần nhãn do con người cung cấp. Ví dụ, trong quá trình huấn luyện, mô hình cố gắng đoán từ tiếp theo trong câu. Qua việc lặp đi lặp lại trên lượng dữ liệu khổng lồ, mô hình nắm bắt được ngữ pháp, sự thật và thậm chí một số khả năng suy luận.

- Tinh chỉnh và hướng dẫn: Sau khi huấn luyện sơ bộ, LLM có thể được tinh chỉnh cho nhiệm vụ cụ thể hoặc được điều khiển bằng các câu lệnh hướng dẫn. Điều này giúp cùng một mô hình thích ứng với các nhiệm vụ mới như hỏi đáp y tế hoặc viết sáng tạo bằng cách điều chỉnh với bộ dữ liệu nhỏ hơn hoặc hướng dẫn thông minh.

Tổng hợp lại, những đặc điểm này cho phép một LLM hiểu và tạo ra văn bản giống con người. Trong thực tế, một LLM được huấn luyện tốt có thể suy luận ngữ cảnh, hoàn thành câu và tạo ra phản hồi mạch lạc về nhiều chủ đề (từ trò chuyện thông thường đến các lĩnh vực kỹ thuật) mà không cần lập trình riêng cho từng nhiệm vụ.

LLMs thường sử dụng kiến trúc mạng transformer. Kiến trúc này là mạng nơ-ron sâu với nhiều lớp nút kết nối. Một thành phần quan trọng là cơ chế tự chú ý, cho phép mô hình đánh trọng số tầm quan trọng của từng từ so với tất cả các từ khác trong câu cùng lúc.

Khác với các mô hình tuần tự cũ hơn (như RNN), transformer xử lý toàn bộ đầu vào song song, giúp việc huấn luyện trên GPU nhanh hơn nhiều. Trong quá trình huấn luyện, LLM điều chỉnh hàng tỷ tham số của mình bằng cách cố gắng dự đoán từng từ tiếp theo trong kho văn bản khổng lồ.

Theo thời gian, quá trình này dạy cho mô hình ngữ pháp và các mối quan hệ ngữ nghĩa. Kết quả là một mô hình có thể, khi được cung cấp câu lệnh đầu vào, tạo ra ngôn ngữ mạch lạc, phù hợp với ngữ cảnh một cách tự nhiên.

Ứng dụng của LLM

Vì hiểu và tạo ra ngôn ngữ tự nhiên, LLM có nhiều ứng dụng trong các ngành nghề khác nhau. Một số ứng dụng phổ biến là:

- AI hội thoại (Chatbot và Trợ lý ảo): LLM là nền tảng cho các chatbot tiên tiến có thể trò chuyện mở hoặc trả lời câu hỏi. Ví dụ, trợ lý ảo như bot hỗ trợ khách hàng hoặc các công cụ như Siri và Alexa sử dụng LLM để hiểu truy vấn và phản hồi tự nhiên.

- Tạo nội dung: Chúng có thể viết email, bài báo, nội dung marketing, thậm chí thơ ca và mã lập trình. Ví dụ, khi được cung cấp chủ đề, ChatGPT (dựa trên mô hình GPT) có thể soạn thảo bài luận hoặc câu chuyện. Các công ty dùng LLM để tự động hóa việc viết blog, quảng cáo và báo cáo.

- Dịch thuật và Tóm tắt: LLM dịch văn bản giữa các ngôn ngữ và tóm tắt tài liệu dài. Nhờ đã thấy các ví dụ song song trong quá trình huấn luyện, mô hình có thể tạo ra văn bản trôi chảy bằng ngôn ngữ khác hoặc rút gọn báo cáo 20 trang thành vài đoạn ngắn.

- Trả lời câu hỏi: Khi nhận câu hỏi, LLM có thể cung cấp câu trả lời hoặc giải thích dựa trên kiến thức của mình. Điều này hỗ trợ giao diện tìm kiếm hỏi đáp và gia sư ảo. Các mô hình kiểu ChatGPT có thể trả lời kiến thức tổng quát hoặc giải thích khái niệm bằng ngôn ngữ dễ hiểu.

- Tạo mã lập trình: Một số LLM chuyên biệt cho mã lập trình. Chúng có thể viết đoạn mã từ mô tả, tìm lỗi hoặc dịch giữa các ngôn ngữ lập trình. (GitHub Copilot sử dụng LLM được huấn luyện trên mã để hỗ trợ lập trình viên.)

- Nghiên cứu và Phân tích: Chúng giúp nhà nghiên cứu trích xuất thông tin từ bộ dữ liệu văn bản lớn, gắn thẻ nội dung hoặc phân tích cảm xúc phản hồi khách hàng. Trong nhiều lĩnh vực, LLM tăng tốc các công việc như tổng hợp tài liệu hoặc tổ chức dữ liệu bằng cách hiểu nội dung tài liệu.

Các ví dụ nổi bật về mô hình ngôn ngữ lớn bao gồm ChatGPT / GPT-4 (OpenAI), Bard (PaLM của Google), LLaMA (Meta), Claude (Anthropic), và Bing Chat (dựa trên GPT của Microsoft). Mỗi mô hình này được huấn luyện trên bộ dữ liệu khổng lồ và có thể truy cập qua API hoặc giao diện web.

Ví dụ, GPT-3.5 và GPT-4 đứng sau ChatGPT có hàng trăm tỷ tham số, trong khi các mô hình của Google (PaLM và Gemini) và các mô hình khác hoạt động tương tự. Các nhà phát triển thường tương tác với LLM qua dịch vụ đám mây hoặc thư viện, tùy chỉnh cho các nhiệm vụ cụ thể như tóm tắt tài liệu hoặc hỗ trợ lập trình.

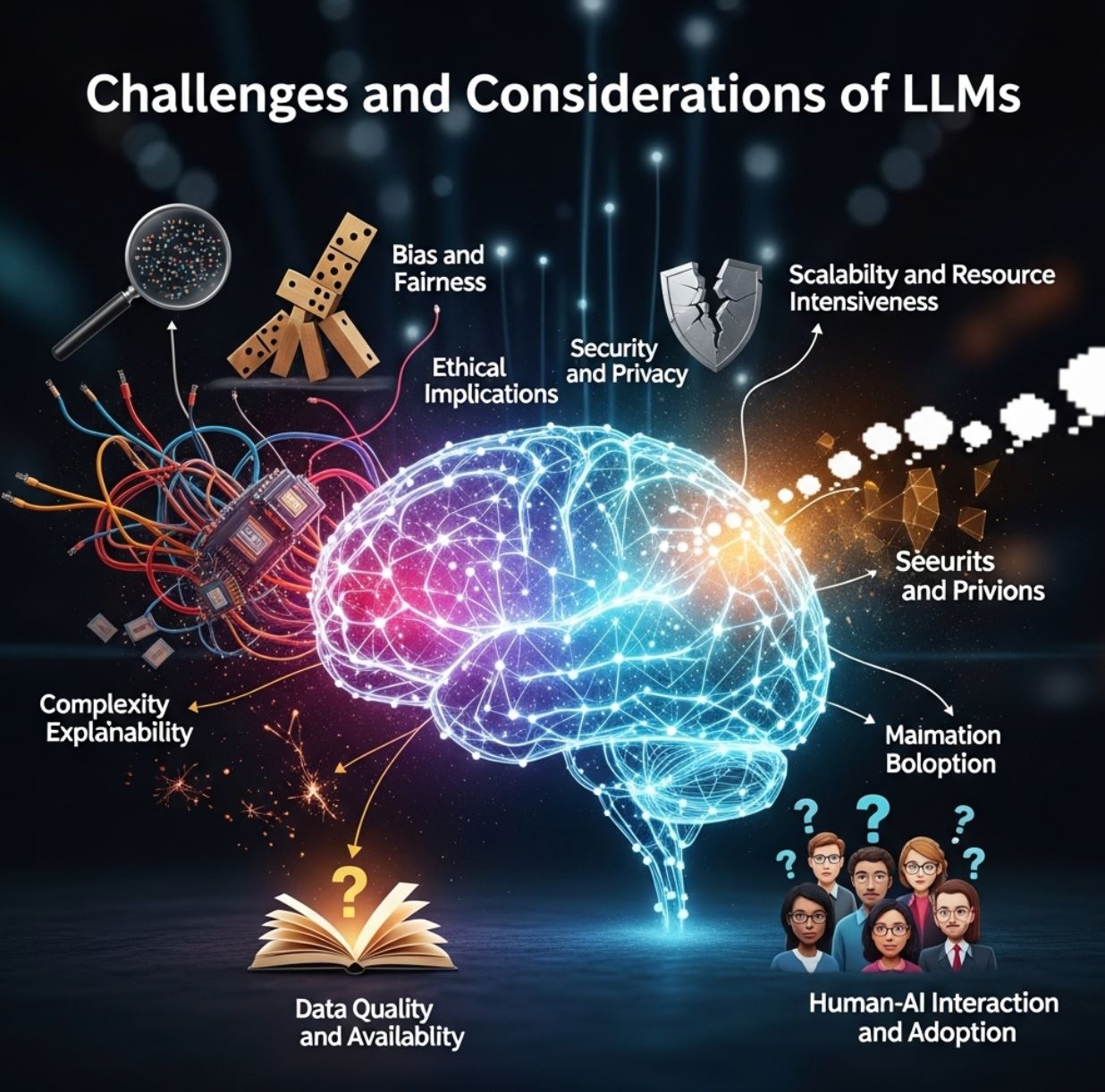

Thách thức và Lưu ý

LLM rất mạnh mẽ, nhưng không hoàn hảo. Vì học từ văn bản thực tế, chúng có thể tái tạo định kiến có trong dữ liệu huấn luyện. Một LLM có thể tạo ra nội dung mang định kiến văn hóa hoặc sử dụng ngôn ngữ xúc phạm, khuôn mẫu nếu không được lọc kỹ.

Một vấn đề khác là ảo tưởng thông tin: mô hình có thể tạo ra câu trả lời nghe rất thuyết phục nhưng hoàn toàn sai hoặc bịa đặt. Ví dụ, LLM có thể tự tin sáng tạo ra một sự thật sai hoặc tên gọi không đúng. Những lỗi này xảy ra vì mô hình chỉ đoán phần tiếp theo hợp lý nhất của văn bản, không kiểm chứng sự thật.

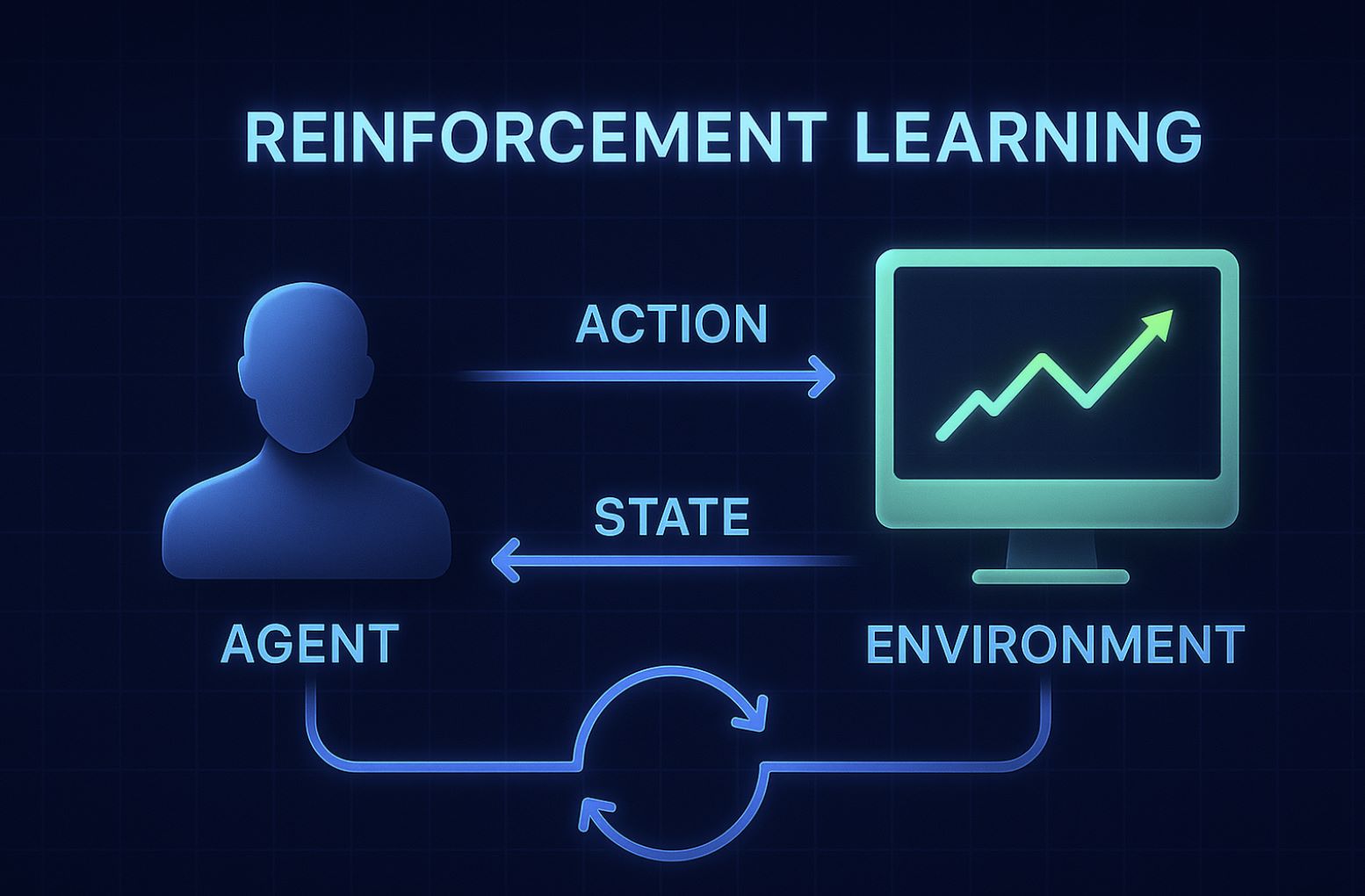

Các nhà phát triển giảm thiểu vấn đề này bằng cách tinh chỉnh với phản hồi con người, lọc kết quả đầu ra và áp dụng các kỹ thuật như học tăng cường dựa trên đánh giá của con người.

Dù vậy, người dùng LLM cần lưu ý kiểm tra độ chính xác và định kiến của kết quả. Thêm vào đó, việc huấn luyện và vận hành LLM đòi hỏi tài nguyên tính toán lớn (GPU/TPU mạnh và nhiều dữ liệu), điều này có thể tốn kém.

>>>Nhấn để xem:

Natural Language Processing là gì?

Tóm lại, một mô hình ngôn ngữ lớn là hệ thống AI dựa trên kiến trúc transformer được huấn luyện trên lượng lớn dữ liệu văn bản. Nó đã học được các mẫu ngôn ngữ qua quá trình học tự giám sát, giúp tạo ra văn bản trôi chảy, phù hợp ngữ cảnh. Nhờ quy mô lớn, LLM có thể xử lý nhiều nhiệm vụ ngôn ngữ – từ trò chuyện, viết lách đến dịch thuật và lập trình – thường đạt hoặc vượt mức độ lưu loát của con người.

Như các nhà nghiên cứu AI hàng đầu nhận định, những mô hình này sẽ định hình lại cách chúng ta tương tác với công nghệ và tiếp cận thông tin. Tính đến năm 2025, LLM tiếp tục phát triển (bao gồm các mở rộng đa phương tiện xử lý hình ảnh hoặc âm thanh) và vẫn là thành phần trung tâm trong các ứng dụng AI hiện đại.

Hãy theo dõi INVIAI để cập nhật thêm nhiều thông tin hữu ích!