Edge AI (đôi khi gọi là “AI tại biên”) có nghĩa là chạy các mô hình trí tuệ nhân tạo và học máy trên các thiết bị cục bộ (cảm biến, camera, điện thoại thông minh, cổng công nghiệp, v.v.) thay vì ở các trung tâm dữ liệu từ xa. Nói cách khác, “biên” của mạng – nơi dữ liệu được tạo ra – sẽ xử lý tính toán. Điều này cho phép các thiết bị phân tích dữ liệu ngay khi thu thập, thay vì liên tục gửi dữ liệu thô lên đám mây.

Theo giải thích của IBM, Edge AI cho phép xử lý ngay trên thiết bị theo thời gian thực mà không phụ thuộc vào máy chủ trung tâm. Ví dụ, một camera có Edge AI có thể phát hiện và phân loại đối tượng ngay lập tức, cung cấp phản hồi tức thì. Bằng cách xử lý dữ liệu tại chỗ, Edge AI có thể hoạt động ngay cả khi kết nối internet không ổn định hoặc không có kết nối.

Theo các báo cáo ngành, xu hướng này đang phát triển nhanh chóng: chi tiêu toàn cầu cho điện toán biên đạt khoảng 232 tỷ đô la vào năm 2024 (tăng 15% so với năm 2023), chủ yếu do sự tăng trưởng của IoT được hỗ trợ bởi AI.

Tóm lại, Edge AI đơn giản là đưa việc tính toán gần hơn với nguồn dữ liệu – triển khai trí tuệ trên các thiết bị hoặc nút gần đó, giúp tăng tốc độ phản hồi và giảm nhu cầu truyền tải toàn bộ dữ liệu lên đám mây.

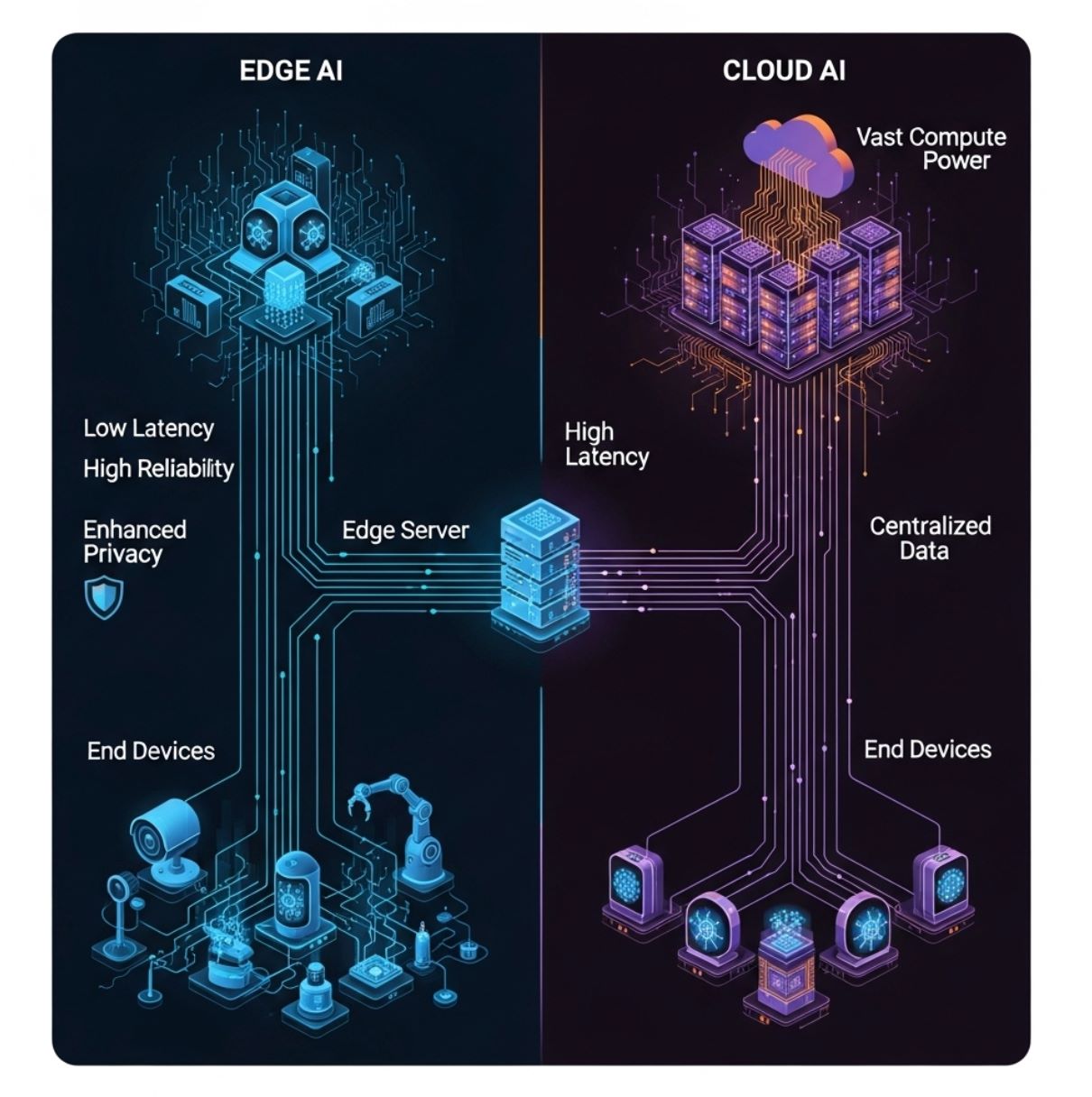

So sánh Edge AI và Cloud AI: Những điểm khác biệt chính

Khác với AI truyền thống dựa trên đám mây (gửi toàn bộ dữ liệu đến máy chủ tập trung), Edge AI phân phối việc tính toán trên phần cứng tại chỗ. Sơ đồ trên minh họa mô hình điện toán biên đơn giản: các thiết bị cuối (lớp dưới cùng) cung cấp dữ liệu cho máy chủ hoặc cổng biên (lớp giữa) thay vì chỉ gửi lên đám mây xa xôi (lớp trên cùng).

Trong cấu hình này, việc suy luận AI có thể diễn ra trên thiết bị hoặc nút biên cục bộ, giảm đáng kể độ trễ truyền thông.

- Độ trễ: Edge AI giảm thiểu độ trễ. Vì xử lý diễn ra tại chỗ, quyết định có thể được đưa ra trong vài mili giây. IBM lưu ý rằng suy luận dựa trên biên “cung cấp độ trễ thấp hơn bằng cách xử lý dữ liệu trực tiếp trên thiết bị,” trong khi AI đám mây gây ra độ trễ thêm do gửi dữ liệu đi và về giữa các máy chủ từ xa.

Điều này rất quan trọng cho các tác vụ nhạy cảm về thời gian (ví dụ: tránh tai nạn xe hoặc điều khiển robot). - Băng thông: Edge AI giảm tải mạng. Bằng cách phân tích hoặc lọc dữ liệu tại chỗ, lượng thông tin cần gửi lên trên giảm đáng kể. IBM giải thích rằng các hệ thống biên “yêu cầu băng thông thấp hơn” vì phần lớn dữ liệu được giữ lại tại chỗ.

Ngược lại, AI đám mây cần kết nối tốc độ cao liên tục để chuyển dữ liệu thô qua lại. Điều này làm cho Edge AI hiệu quả hơn và tiết kiệm chi phí khi mạng bận hoặc đắt đỏ. - Bảo mật/Quyền riêng tư: Edge AI có thể tăng cường bảo mật. Dữ liệu nhạy cảm (giọng nói, hình ảnh, thông tin sức khỏe) có thể được xử lý và lưu trữ trên thiết bị, không bao giờ truyền lên đám mây. Điều này giảm nguy cơ bị xâm phạm bởi bên thứ ba.

Ví dụ, điện thoại thông minh có thể nhận diện khuôn mặt bạn ngay trên thiết bị mà không cần tải ảnh lên. Trong khi đó, AI đám mây thường gửi dữ liệu cá nhân lên máy chủ bên ngoài, có thể gây rủi ro bảo mật. - Tài nguyên tính toán: Trung tâm dữ liệu đám mây có sức mạnh CPU/GPU gần như vô hạn, cho phép chạy các mô hình AI rất lớn. Các thiết bị biên có khả năng xử lý và lưu trữ hạn chế hơn nhiều. IBM lưu ý rằng các thiết bị biên bị “giới hạn bởi kích thước của thiết bị”.

Do đó, Edge AI thường sử dụng các mô hình được tối ưu hoặc nhỏ gọn. Trong thực tế, việc huấn luyện các mô hình lớn thường vẫn diễn ra trên đám mây, và chỉ các mô hình nhỏ gọn, đã được lượng tử hóa mới được triển khai trên thiết bị biên. - Độ tin cậy: Bằng cách giảm sự phụ thuộc vào kết nối liên tục, Edge AI có thể duy trì các chức năng quan trọng ngay cả khi mạng bị gián đoạn. Ví dụ, một drone có thể điều hướng bằng AI trên thiết bị khi mất tín hiệu với trạm điều khiển.

Tóm lại, AI biên và AI đám mây bổ trợ cho nhau. Máy chủ đám mây xử lý việc huấn luyện nặng, lưu trữ và phân tích dữ liệu lớn, trong khi Edge AI xử lý suy luận theo thời gian thực và quyết định nhanh gần nguồn dữ liệu.

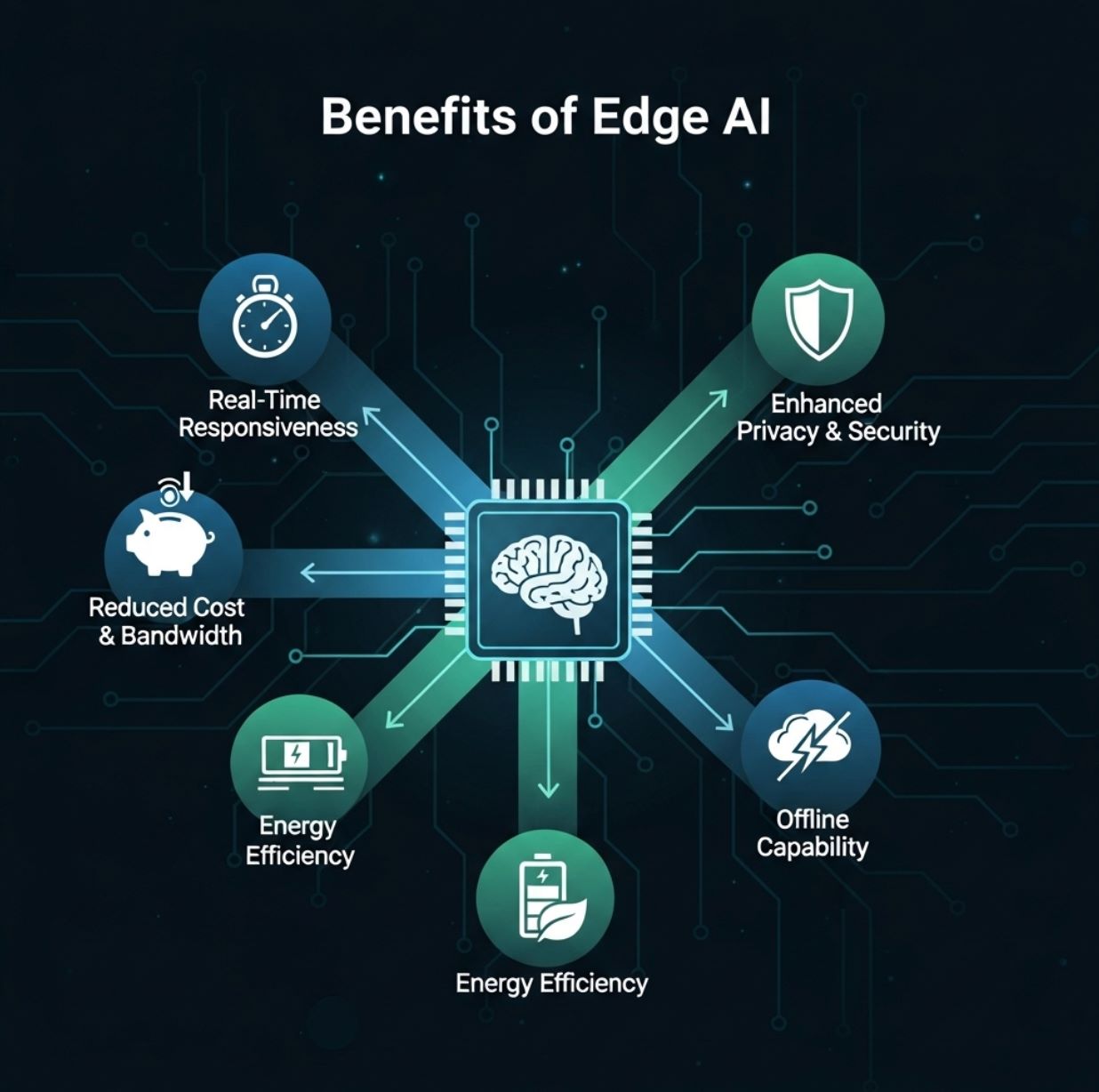

Lợi ích của Edge AI

Edge AI mang lại nhiều lợi ích thiết thực cho người dùng và tổ chức:

- Phản hồi theo thời gian thực: Xử lý dữ liệu tại chỗ cho phép phân tích ngay lập tức. Người dùng nhận được phản hồi tức thì (ví dụ: phát hiện đối tượng trực tiếp, trả lời giọng nói, cảnh báo bất thường) mà không phải chờ đợi chuyến đi vòng lên đám mây.

Độ trễ thấp này là lợi thế lớn cho các ứng dụng như thực tế tăng cường, phương tiện tự hành và robot. - Giảm băng thông và chi phí: Với Edge AI, chỉ kết quả tóm tắt hoặc các sự kiện bất thường mới cần gửi qua internet. Điều này giảm đáng kể chi phí truyền dữ liệu và lưu trữ đám mây.

Ví dụ, một camera an ninh có thể chỉ tải lên các đoạn video khi phát hiện mối đe dọa tiềm năng, thay vì phát trực tiếp liên tục. - Tăng cường bảo mật: Giữ dữ liệu trên thiết bị cải thiện an toàn. Thông tin cá nhân hoặc nhạy cảm không bao giờ rời phần cứng cục bộ nếu được xử lý tại biên.

Điều này đặc biệt quan trọng với các ứng dụng chịu quy định nghiêm ngặt về quyền riêng tư (y tế, tài chính, v.v.), vì Edge AI có thể giữ dữ liệu trong phạm vi quốc gia hoặc cơ sở. - Tiết kiệm năng lượng và chi phí: AI trên thiết bị có thể tiết kiệm điện năng. Chạy mô hình nhỏ trên chip công suất thấp thường tiêu thụ ít năng lượng hơn so với gửi dữ liệu lên máy chủ đám mây và nhận lại.

Nó cũng giảm chi phí máy chủ – các khối lượng công việc AI lớn rất tốn kém khi lưu trữ trên đám mây. - Khả năng hoạt động ngoại tuyến và độ bền: Edge AI có thể tiếp tục hoạt động khi mất kết nối. Thiết bị vẫn có thể vận hành với trí tuệ cục bộ, sau đó đồng bộ dữ liệu khi có kết nối.

Điều này làm cho hệ thống bền bỉ hơn, đặc biệt ở vùng xa xôi hoặc trong các ứng dụng quan trọng (ví dụ: giám sát công nghiệp).

Red Hat và IBM đều nhấn mạnh những lợi ích này. Edge AI “mang khả năng tính toán hiệu suất cao đến biên,” cho phép phân tích theo thời gian thực và tăng hiệu quả.

Theo một báo cáo, triển khai biên giúp giảm độ trễ và nhu cầu băng thông đồng thời nâng cao bảo mật và độ tin cậy.

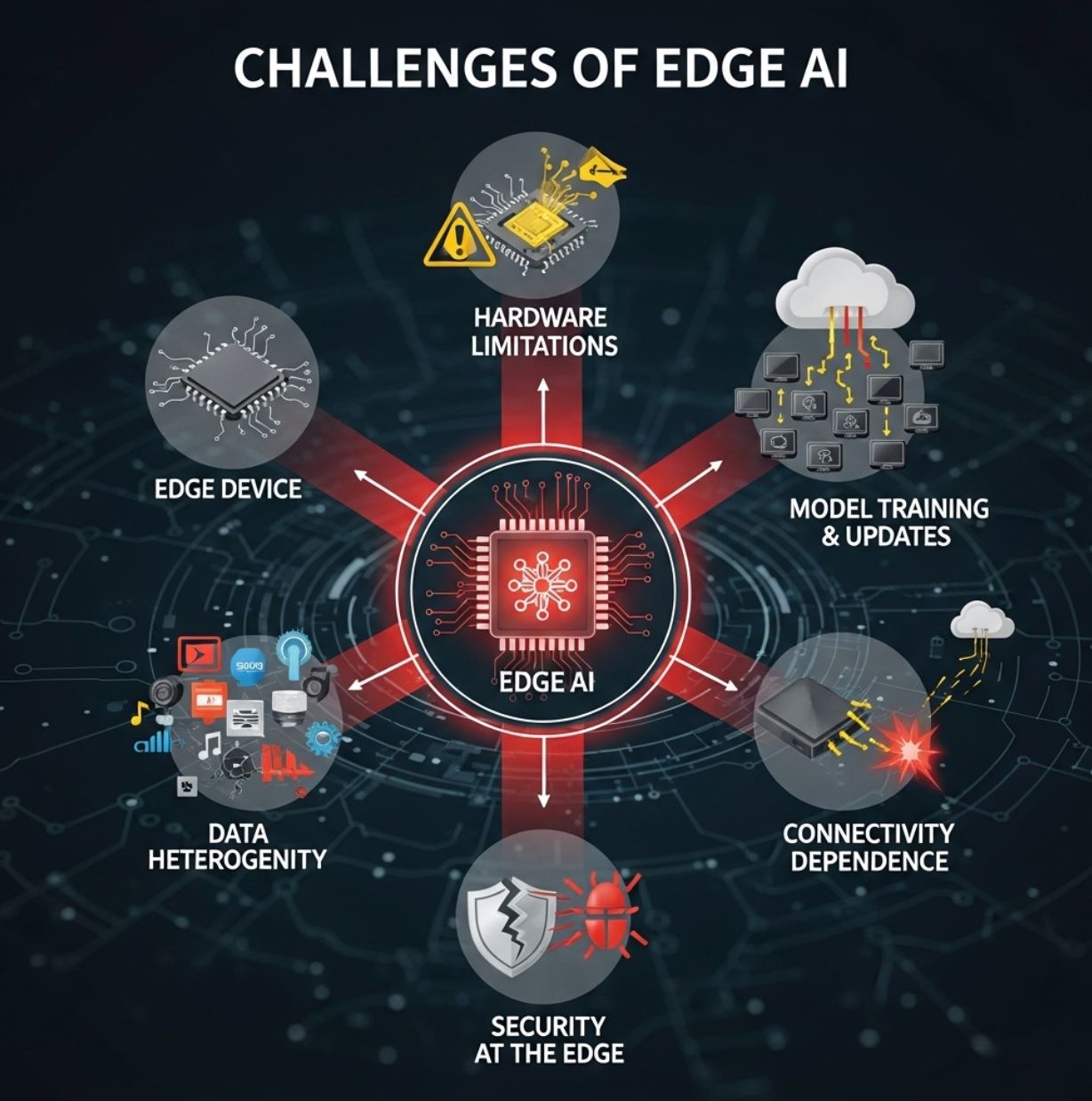

Thách thức của Edge AI

Mặc dù có nhiều ưu điểm, Edge AI cũng đối mặt với một số khó khăn:

- Giới hạn phần cứng: Các thiết bị biên thường nhỏ gọn và hạn chế tài nguyên. Chúng có thể chỉ có CPU khiêm tốn hoặc các NPU công suất thấp chuyên dụng, cùng bộ nhớ hạn chế.

Điều này buộc các kỹ sư AI phải sử dụng các kỹ thuật nén mô hình, cắt tỉa hoặc TinyML để phù hợp với thiết bị. Các mô hình học sâu phức tạp thường không thể chạy đầy đủ trên vi điều khiển, nên có thể phải hy sinh một phần độ chính xác. - Huấn luyện và cập nhật mô hình: Việc huấn luyện các mô hình AI phức tạp thường vẫn diễn ra trên đám mây, nơi có dữ liệu lớn và sức mạnh tính toán dồi dào. Sau khi huấn luyện, các mô hình này phải được tối ưu hóa (lượng tử hóa, cắt tỉa, v.v.) và triển khai đến từng thiết bị biên.

Việc duy trì cập nhật cho hàng nghìn hoặc hàng triệu thiết bị có thể rất phức tạp. Việc đồng bộ firmware và dữ liệu tạo thêm gánh nặng quản lý. - Trọng lực dữ liệu và tính đa dạng: Môi trường biên rất đa dạng. Các địa điểm khác nhau có thể thu thập các loại dữ liệu khác nhau (cảm biến thay đổi theo ứng dụng), và chính sách cũng có thể khác nhau theo vùng.

Việc tích hợp và chuẩn hóa toàn bộ dữ liệu này là thách thức. IBM lưu ý rằng triển khai Edge AI rộng rãi đặt ra các vấn đề về “trọng lực dữ liệu, tính đa dạng, quy mô và hạn chế tài nguyên”. Nói cách khác, dữ liệu thường giữ lại tại chỗ, khiến việc có cái nhìn toàn cầu trở nên khó khăn, và các thiết bị có nhiều hình dạng, kích thước khác nhau. - Bảo mật tại biên: Mặc dù Edge AI có thể cải thiện quyền riêng tư, nó cũng tạo ra các mối lo ngại bảo mật mới. Mỗi thiết bị hoặc nút là mục tiêu tiềm năng cho hacker.

Đảm bảo các mô hình cục bộ không bị giả mạo và firmware an toàn đòi hỏi các biện pháp bảo vệ mạnh mẽ. - Phụ thuộc kết nối cho một số tác vụ: Mặc dù suy luận có thể diễn ra tại chỗ, các hệ thống biên vẫn thường dựa vào kết nối đám mây cho các tác vụ nặng như huấn luyện lại mô hình, phân tích dữ liệu quy mô lớn hoặc tổng hợp kết quả phân tán.

Kết nối hạn chế có thể gây tắc nghẽn các chức năng hậu cần này.

Trong thực tế, hầu hết các giải pháp sử dụng mô hình lai: các thiết bị biên xử lý suy luận, trong khi đám mây đảm nhận huấn luyện, quản lý mô hình và phân tích dữ liệu lớn.

Sự cân bằng này giúp vượt qua giới hạn tài nguyên và cho phép Edge AI mở rộng quy mô.

Ứng dụng của Edge AI

Edge AI đang được áp dụng trong nhiều ngành công nghiệp. Ví dụ thực tế bao gồm:

- Phương tiện tự hành: Xe tự lái sử dụng Edge AI trên thiết bị để xử lý ngay lập tức dữ liệu từ camera và radar cho việc điều hướng và tránh chướng ngại vật.

Chúng không thể chịu được độ trễ khi gửi video lên máy chủ, nên mọi thứ (phát hiện đối tượng, nhận diện người đi bộ, theo dõi làn đường) đều diễn ra tại chỗ. - Sản xuất và Công nghiệp 4.0: Các nhà máy triển khai camera thông minh và cảm biến trên dây chuyền sản xuất để phát hiện lỗi hoặc bất thường theo thời gian thực.

Ví dụ, một camera Edge AI có thể phát hiện sản phẩm lỗi trên băng chuyền và kích hoạt hành động ngay lập tức. Tương tự, máy móc công nghiệp sử dụng AI tại chỗ để dự đoán sự cố thiết bị (bảo trì dự đoán) trước khi hỏng hóc xảy ra. - Y tế và Cứu hộ khẩn cấp: Thiết bị y tế di động và xe cứu thương hiện sử dụng Edge AI để phân tích dữ liệu bệnh nhân ngay tại chỗ.

Máy siêu âm hoặc thiết bị theo dõi dấu hiệu sinh tồn trên xe cứu thương có thể áp dụng AI ngay lập tức để phát hiện chấn thương nội tạng hoặc cảnh báo nhân viên y tế về dấu hiệu bất thường. Trong bệnh viện, Edge AI có thể giám sát liên tục bệnh nhân ICU và kích hoạt cảnh báo mà không cần chờ máy chủ trung tâm. - Thành phố thông minh: Hệ thống đô thị sử dụng Edge AI để quản lý giao thông, giám sát và cảm biến môi trường.

Đèn giao thông thông minh điều chỉnh thời gian dựa trên AI cục bộ phân tích dữ liệu camera, giảm ùn tắc theo thời gian thực. Camera đường phố có thể phát hiện sự cố (tai nạn, cháy) và cảnh báo ngay cho cơ quan chức năng. Bằng cách giữ xử lý tại chỗ, thành phố có thể phản ứng nhanh mà không làm quá tải mạng trung tâm. - Bán lẻ và IoT tiêu dùng: Edge AI nâng cao trải nghiệm và tiện lợi cho khách hàng.

Tại cửa hàng, camera thông minh hoặc cảm biến kệ hàng sử dụng AI để theo dõi hành vi khách và mức tồn kho ngay lập tức. Tại nhà, điện thoại, máy tính bảng và loa thông minh chạy nhận diện giọng nói hoặc khuôn mặt ngay trên thiết bị. Ví dụ, điện thoại có thể mở khóa hoặc nhận diện cử chỉ mà không cần truy cập đám mây. Thiết bị theo dõi sức khỏe phân tích dữ liệu (nhịp tim, bước chân) tại chỗ để cung cấp phản hồi theo thời gian thực.

Các ứng dụng mới nổi khác bao gồm nông nghiệp chính xác (drone và cảm biến sử dụng Edge AI để giám sát đất và cây trồng) và hệ thống an ninh (nhận diện khuôn mặt trên thiết bị cho khóa cửa). Theo một nghiên cứu của IEEE, Edge AI rất quan trọng cho các ứng dụng như nông nghiệp thông minh, điều khiển giao thông và tự động hóa công nghiệp.

Tóm lại, bất kỳ tình huống nào cần phân tích nhanh, tại chỗ đều là ứng viên sáng giá cho Edge AI.

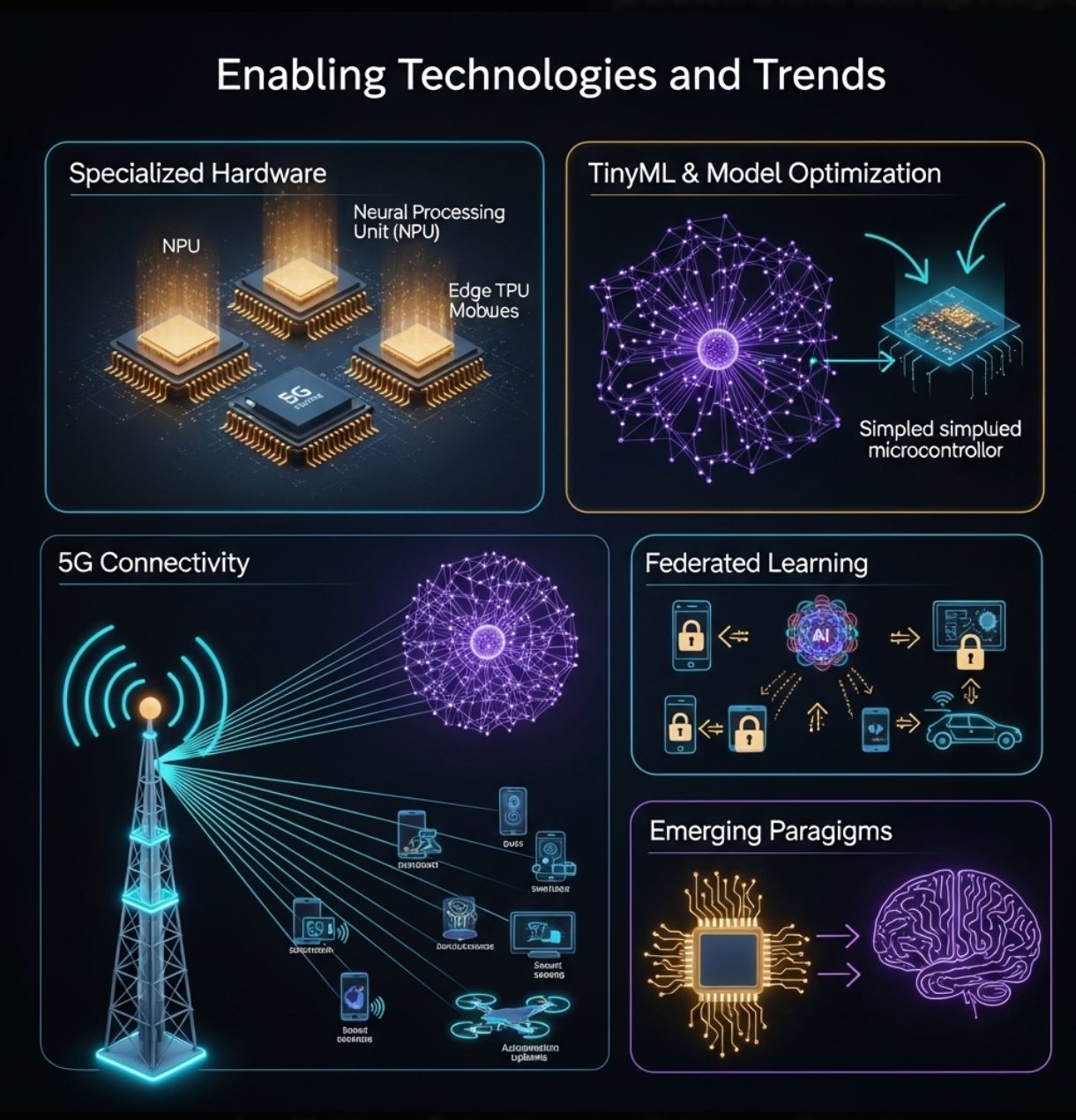

Công nghệ và xu hướng hỗ trợ

Sự phát triển của Edge AI được thúc đẩy bởi tiến bộ trong cả phần cứng và phần mềm:

- Phần cứng chuyên dụng: Các nhà sản xuất đang phát triển chip thiết kế riêng cho suy luận biên. Bao gồm các bộ tăng tốc thần kinh công suất thấp trên điện thoại (NPU) và các mô-đun AI biên chuyên dụng như Google Coral Edge TPU, NVIDIA Jetson Nano, cùng các bo mạch vi điều khiển giá rẻ (Arduino, Raspberry Pi có thêm AI).

Một báo cáo ngành gần đây cho biết tiến bộ trong bộ xử lý siêu tiết kiệm điện và thuật toán “bản địa biên” đang vượt qua giới hạn phần cứng thiết bị. - TinyML và tối ưu mô hình: Các công cụ như TensorFlow Lite và kỹ thuật cắt tỉa, lượng tử hóa, chưng cất giúp thu nhỏ mạng thần kinh để phù hợp với thiết bị nhỏ.

“TinyML” là lĩnh vực mới tập trung chạy ML trên vi điều khiển. Các phương pháp này mở rộng AI đến cảm biến và thiết bị đeo chạy bằng pin. - 5G và kết nối: Mạng không dây thế hệ mới (5G trở lên) cung cấp băng thông cao và độ trễ thấp, bổ trợ cho Edge AI.

Mạng cục bộ nhanh giúp dễ dàng phối hợp các cụm thiết bị biên và chuyển bớt tác vụ nặng khi cần. Sự kết hợp giữa 5G và AI mở ra các ứng dụng mới (ví dụ: nhà máy thông minh, giao tiếp xe-mọi thứ). - Học liên kết và hợp tác: Các phương pháp bảo vệ quyền riêng tư như học liên kết cho phép nhiều thiết bị biên cùng huấn luyện mô hình mà không chia sẻ dữ liệu thô.

Mỗi thiết bị cải thiện mô hình tại chỗ và chỉ chia sẻ cập nhật. Xu hướng này (được dự báo trong các lộ trình công nghệ tương lai) sẽ nâng cao Edge AI bằng cách tận dụng dữ liệu phân tán mà vẫn giữ riêng tư. - Các mô hình mới nổi: Trong tương lai, nghiên cứu đang khám phá điện toán thần kinh và AI sinh tạo trên thiết bị để tăng cường trí tuệ biên.

Theo một báo cáo, các đổi mới như chip lấy cảm hứng từ não bộ và mô hình ngôn ngữ lớn cục bộ có thể xuất hiện tại biên.

Những công nghệ này tiếp tục mở rộng giới hạn của Edge AI. Chúng cùng nhau giúp đưa “kỷ nguyên suy luận AI” đến gần người dùng và cảm biến hơn.

>>> Bạn có thể quan tâm:

Edge AI đang thay đổi cách chúng ta sử dụng trí tuệ nhân tạo bằng cách đưa việc tính toán đến gần nguồn dữ liệu hơn. Nó bổ sung cho AI đám mây, mang lại khả năng phân tích nhanh hơn, hiệu quả hơn và bảo mật hơn trên các thiết bị cục bộ.

Cách tiếp cận này giải quyết các thách thức về thời gian thực và băng thông vốn có trong kiến trúc tập trung đám mây. Trong thực tế, Edge AI là động lực cho nhiều công nghệ hiện đại – từ cảm biến thông minh và nhà máy đến drone và xe tự hành – bằng cách cung cấp trí tuệ ngay tại chỗ.

Khi các thiết bị IoT ngày càng phổ biến và mạng lưới được cải thiện, Edge AI sẽ còn phát triển mạnh mẽ. Tiến bộ về phần cứng (chip mạnh, TinyML) và kỹ thuật (học liên kết, tối ưu mô hình) giúp AI có thể hiện diện khắp nơi.

Theo các chuyên gia, Edge AI mang lại lợi ích rõ rệt về hiệu quả, bảo mật và sử dụng băng thông. Tóm lại, Edge AI là tương lai của trí tuệ nhúng – mang đến những gì tốt nhất của AI dưới dạng phân tán, ngay trên thiết bị.