O que é um Modelo de Linguagem Grande?

Um Modelo de Linguagem Grande (LLM) é um tipo avançado de inteligência artificial treinado com enormes quantidades de dados textuais para entender, gerar e processar a linguagem humana. Os LLMs alimentam muitas aplicações modernas de IA, como chatbots, ferramentas de tradução e sistemas de criação de conteúdo. Ao aprender padrões a partir de bilhões de palavras, os modelos de linguagem grandes podem fornecer respostas precisas, criar textos semelhantes aos humanos e apoiar tarefas em diversos setores.

Modelos de Linguagem Grandes (LLMs) são sistemas de IA treinados com enormes conjuntos de dados textuais para entender e gerar linguagem semelhante à humana. Em termos simples, um LLM foi alimentado com milhões ou bilhões de palavras (frequentemente da Internet) para que possa prever e produzir texto no contexto. Esses modelos geralmente são construídos sobre redes neurais de aprendizado profundo – mais comumente na arquitetura transformer. Devido à sua escala, os LLMs podem realizar muitas tarefas linguísticas (conversação, tradução, escrita) sem serem explicitamente programados para cada uma.

Principais Características dos Modelos de Linguagem Grandes

As principais características dos modelos de linguagem grandes incluem:

Massivos Dados de Treinamento

Os LLMs são treinados em vastos corpora textuais (bilhões de páginas). Esse conjunto de treinamento "grande" lhes confere amplo conhecimento de gramática e fatos.

Arquitetura Transformer

Eles usam redes neurais transformer com autoatenção, o que significa que cada palavra em uma frase é comparada a todas as outras em paralelo. Isso permite que o modelo aprenda o contexto de forma eficiente.

Bilhões de Parâmetros

Os modelos contêm milhões ou bilhões de pesos (parâmetros). Esses parâmetros capturam padrões complexos na linguagem. Por exemplo, o GPT-3 tem 175 bilhões de parâmetros.

Aprendizado Auto-supervisionado

Os LLMs aprendem prevendo palavras faltantes no texto sem rótulos humanos. Por exemplo, durante o treinamento, o modelo tenta adivinhar a próxima palavra em uma frase. Fazendo isso repetidamente em grandes dados, o modelo internaliza gramática, fatos e até algum raciocínio.

Ajuste Fino e Prompting

Após o pré-treinamento, os LLMs podem ser ajustados para uma tarefa específica ou guiados por prompts. Isso significa que o mesmo modelo pode se adaptar a novas tarefas como perguntas e respostas médicas ou escrita criativa, ajustando-o com um conjunto de dados menor ou instruções inteligentes.

Juntas, essas características permitem que um LLM entenda e gere texto como um humano. Na prática, um LLM bem treinado pode inferir contexto, completar frases e produzir respostas fluentes sobre muitos tópicos (de conversas casuais a assuntos técnicos) sem engenharia específica para cada tarefa.

Como os LLMs Funcionam: A Arquitetura Transformer

Os LLMs normalmente usam a arquitetura de rede transformer. Essa arquitetura é uma rede neural profunda com muitas camadas de nós conectados. Um componente chave é a autoatenção, que permite ao modelo ponderar a importância de cada palavra em relação a todas as outras em uma frase simultaneamente.

Processamento Sequencial

- Processam palavras uma a uma

- Treinamento mais lento em GPUs

- Compreensão limitada do contexto

Processamento Paralelo

- Processam toda a entrada simultaneamente

- Treinamento muito mais rápido em GPUs

- Compreensão superior do contexto

Diferentemente dos modelos sequenciais mais antigos (como RNNs), os transformers processam toda a entrada em paralelo, permitindo um treinamento muito mais rápido em GPUs. Durante o treinamento, o LLM ajusta seus bilhões de parâmetros tentando prever cada próxima palavra em seu enorme corpus textual.

Com o tempo, esse processo ensina o modelo gramática e relações semânticas. O resultado é um modelo que, dado um prompt, pode gerar linguagem coerente e relevante ao contexto por conta própria.

Aplicações dos LLMs

Porque eles entendem e geram linguagem natural, os LLMs têm muitas aplicações em diversos setores. Alguns usos comuns são:

IA Conversacional

Geração de Conteúdo

Tradução e Resumo

Perguntas e Respostas

Geração de Código

Pesquisa e Análise

Por exemplo, o GPT-3.5 e o GPT-4 por trás do ChatGPT têm centenas de bilhões de parâmetros, enquanto os modelos do Google (PaLM e Gemini) e outros operam de forma semelhante. Desenvolvedores frequentemente interagem com esses LLMs por meio de serviços em nuvem ou bibliotecas, customizando-os para tarefas específicas como resumo de documentos ou ajuda com programação.

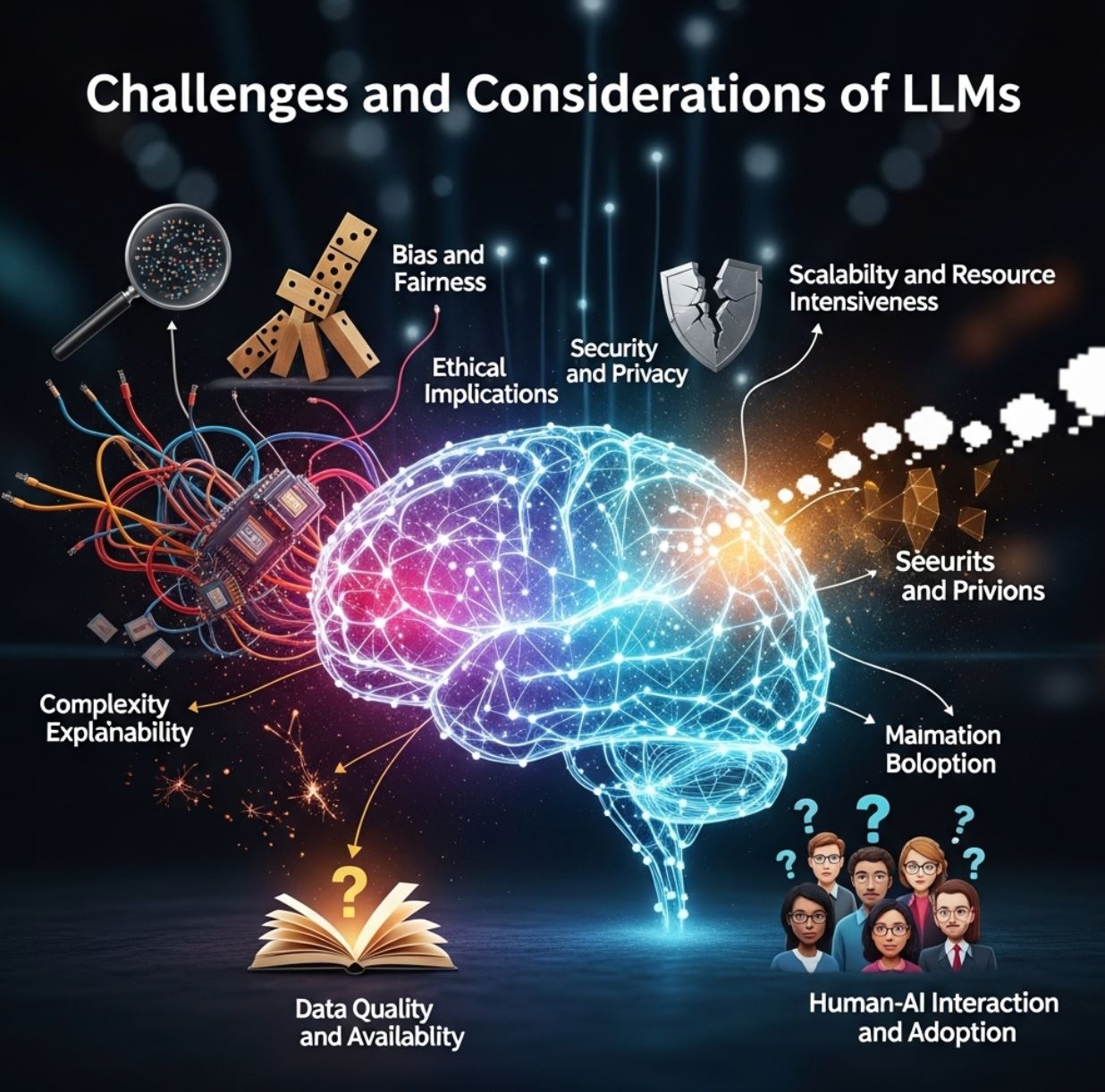

Desafios e Considerações

Os LLMs são poderosos, mas não são perfeitos. Como aprendem a partir de textos do mundo real, podem reproduzir viéses presentes em seus dados de treinamento. Um LLM pode gerar conteúdo culturalmente tendencioso ou produzir linguagem ofensiva ou estereotipada se não for cuidadosamente filtrado.

Problemas de Viés

Alucinações

Requisitos de Recursos

Verificação de Precisão

Outro problema são as alucinações: o modelo pode produzir respostas que soam fluentes, mas são completamente incorretas ou fabricadas. Por exemplo, um LLM pode inventar com confiança um fato ou nome falso. Esses erros ocorrem porque o modelo está essencialmente adivinhando a continuação mais plausível do texto, não verificando fatos.

Mesmo assim, os usuários de LLMs devem estar cientes de que os resultados precisam ser verificados quanto à precisão e viés. Além disso, treinar e executar LLMs requer enormes recursos computacionais (GPUs/TPUs poderosas e muitos dados), o que pode ser caro.

Resumo e Perspectivas Futuras

Em resumo, um modelo de linguagem grande é um sistema de IA baseado em transformer treinado com vastas quantidades de dados textuais. Ele aprendeu padrões da linguagem por meio de treinamento auto-supervisionado, o que lhe dá a capacidade de gerar texto fluente e relevante ao contexto. Devido à sua escala, os LLMs podem lidar com uma ampla gama de tarefas linguísticas – desde conversar e escrever até traduzir e programar – frequentemente igualando ou superando níveis humanos de fluência.

Esses modelos estão prontos para transformar a forma como interagimos com a tecnologia e acessamos informações.

— Pesquisadores líderes em IA

Em 2025, os LLMs continuam avançando (incluindo extensões multimodais que lidam com imagens ou áudio) e permanecem na vanguarda da inovação em IA, tornando-se um componente central das aplicações modernas de inteligência artificial.

Comentários 0

Deixe um Comentário

Ainda não há comentários. Seja o primeiro a comentar!