大型語言模型(LLMs)是人工智能系統,透過龐大的文本數據集訓練,以理解及生成類似人類的語言。簡單來說,LLM已經吸收了數百萬甚至數十億字詞(通常來自互聯網),因此能在語境中預測及產生文字。這些模型通常基於深度學習神經網絡,最常見的是Transformer架構。由於規模龐大,LLM能執行多種語言任務(如聊天、翻譯、寫作),而無需為每項任務特別編程。

大型語言模型的主要特點包括:

- 龐大的訓練數據:LLM在海量文本語料庫(數十億頁)上訓練,這個「大型」訓練集賦予它廣泛的語法及知識。

- Transformer架構:它們使用帶有自注意力機制的Transformer神經網絡,意味著句子中每個字詞會與其他字詞同時比較,令模型能有效學習語境。

- 數十億參數:模型包含數百萬至數十億個權重(參數),這些參數捕捉語言中的複雜模式。例如,GPT-3擁有1750億參數。

- 自監督學習:LLM透過預測文本中缺失的字詞來學習,無需人工標籤。例如,訓練時模型嘗試猜測句子中的下一個字詞。透過在龐大數據上反覆進行,模型內化了語法、知識甚至部分推理能力。

- 微調與提示:預訓練後,LLM可針對特定任務進行微調或透過提示引導。這意味著同一模型能透過較小數據集或巧妙指令,適應醫療問答或創意寫作等新任務。

這些特點使LLM能像人類一樣理解及生成文字。實際上,訓練良好的LLM能推斷語境、完成句子,並在多種主題(從日常對話到專業技術)上產生流暢回應,無需針對每項任務特別設計。

LLM通常採用Transformer網絡架構。該架構是一種深度神經網絡,包含多層相連節點。其核心組件是自注意力,讓模型能同時評估句子中每個字詞相對其他字詞的重要性。

與舊有的序列模型(如RNN)不同,Transformer能並行處理整個輸入,令GPU訓練速度大幅提升。訓練過程中,LLM透過嘗試預測龐大文本語料庫中的下一個字詞,不斷調整其數十億參數。

隨著時間推移,這個過程教會模型語法及語義關係。結果是,給定提示時,模型能自主生成連貫且語境相關的語言。

LLM的應用

由於它們能理解及生成自然語言,LLM在各行各業有廣泛應用。常見用途包括:

- 對話式人工智能(聊天機械人及助理):LLM驅動先進聊天機械人,能進行開放式對話或回答問題。例如,虛擬助理如客戶支援機械人或Siri、Alexa等工具,利用LLM理解查詢並自然回應。

- 內容生成:它們能撰寫電郵、文章、市場推廣文案,甚至詩歌及程式碼。例如,ChatGPT(基於GPT模型)可根據主題提示草擬論文或故事。企業利用LLM自動化博客寫作、廣告文案及報告生成。

- 翻譯與摘要:LLM能在語言間翻譯文本及總結長篇文件。因訓練時見過平行語料,模型可輸出流暢的另一種語言文本,或將20頁報告濃縮成幾段。

- 問答系統:給定問題,LLM能根據知識提供事實答案或解釋,支援問答搜尋介面及虛擬導師。例如,ChatGPT類模型能回答冷知識或用淺白語言解釋概念。

- 程式碼生成:部分LLM專門處理程式碼,能根據描述撰寫程式碼片段、找錯或跨語言轉換。(GitHub Copilot使用訓練於程式碼的LLM協助開發者。)

- 研究與分析:它們協助研究人員從大量文本數據中提取洞見、標註內容或對客戶反饋進行情感分析。在多個領域,LLM加速文獻回顧或資料整理等任務,因能理解文件內容。

知名大型語言模型包括ChatGPT / GPT-4(OpenAI)、Bard(Google的PaLM)、LLaMA(Meta)、Claude(Anthropic)及Bing Chat(微軟基於GPT)。這些模型均在龐大數據集上訓練,並可透過API或網頁介面存取。

例如,ChatGPT背後的GPT-3.5及GPT-4擁有數千億參數,而Google的PaLM及Gemini等模型亦類似。開發者通常透過雲端服務或函式庫與這些LLM互動,並針對特定任務如文件摘要或程式碼輔助進行定制。

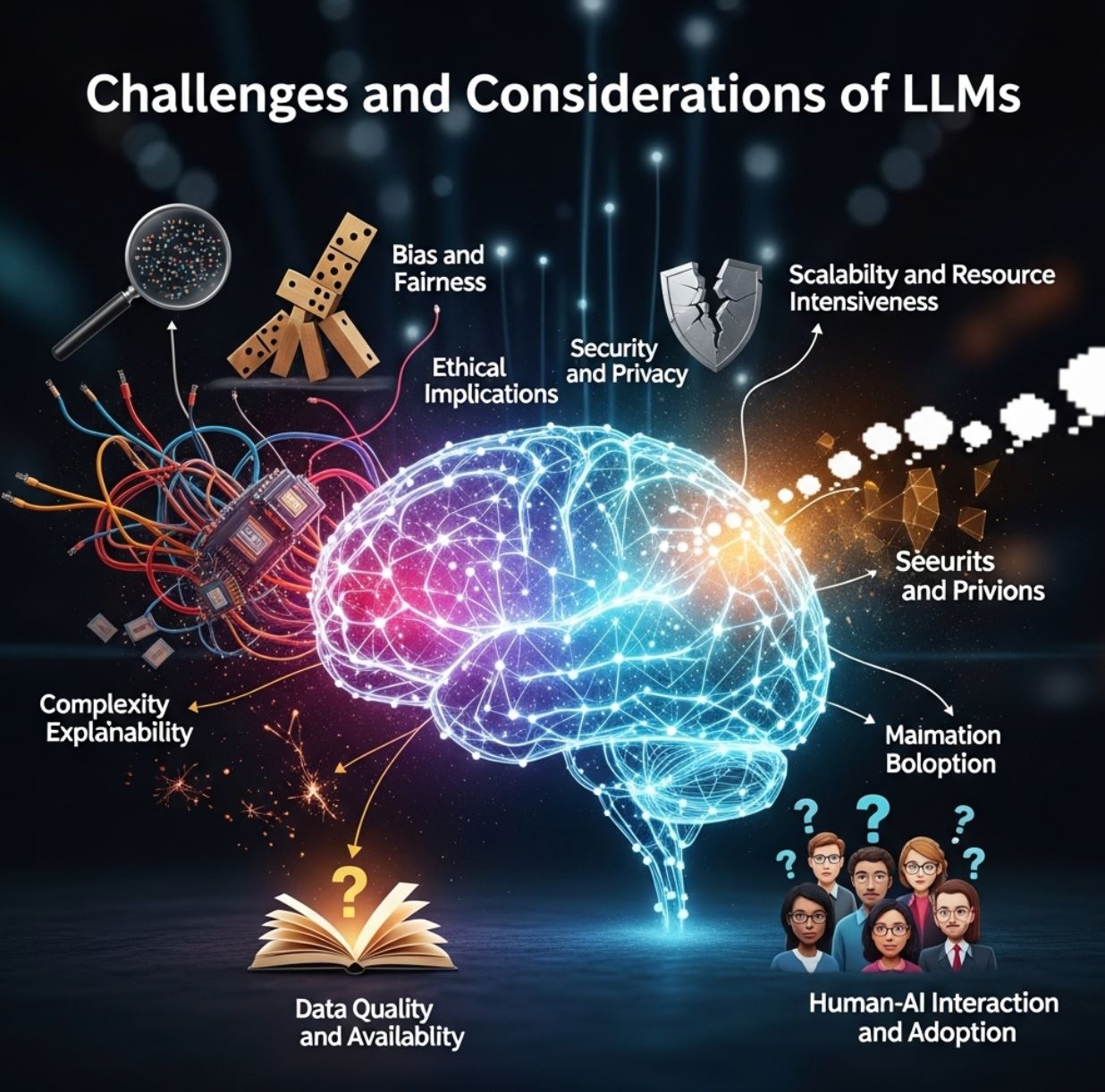

挑戰與考量

LLM功能強大,但並非完美。由於它們從真實世界文本學習,可能會複製訓練數據中的偏見。若未經嚴格篩選,LLM可能產生文化偏見內容,甚至輸出冒犯性或刻板印象語言。

另一問題是幻覺現象:模型可能生成聽起來流暢但完全錯誤或虛構的答案。例如,LLM可能自信地編造錯誤事實或名稱。這些錯誤源於模型本質上是在猜測最合理的文本延續,而非驗證事實。

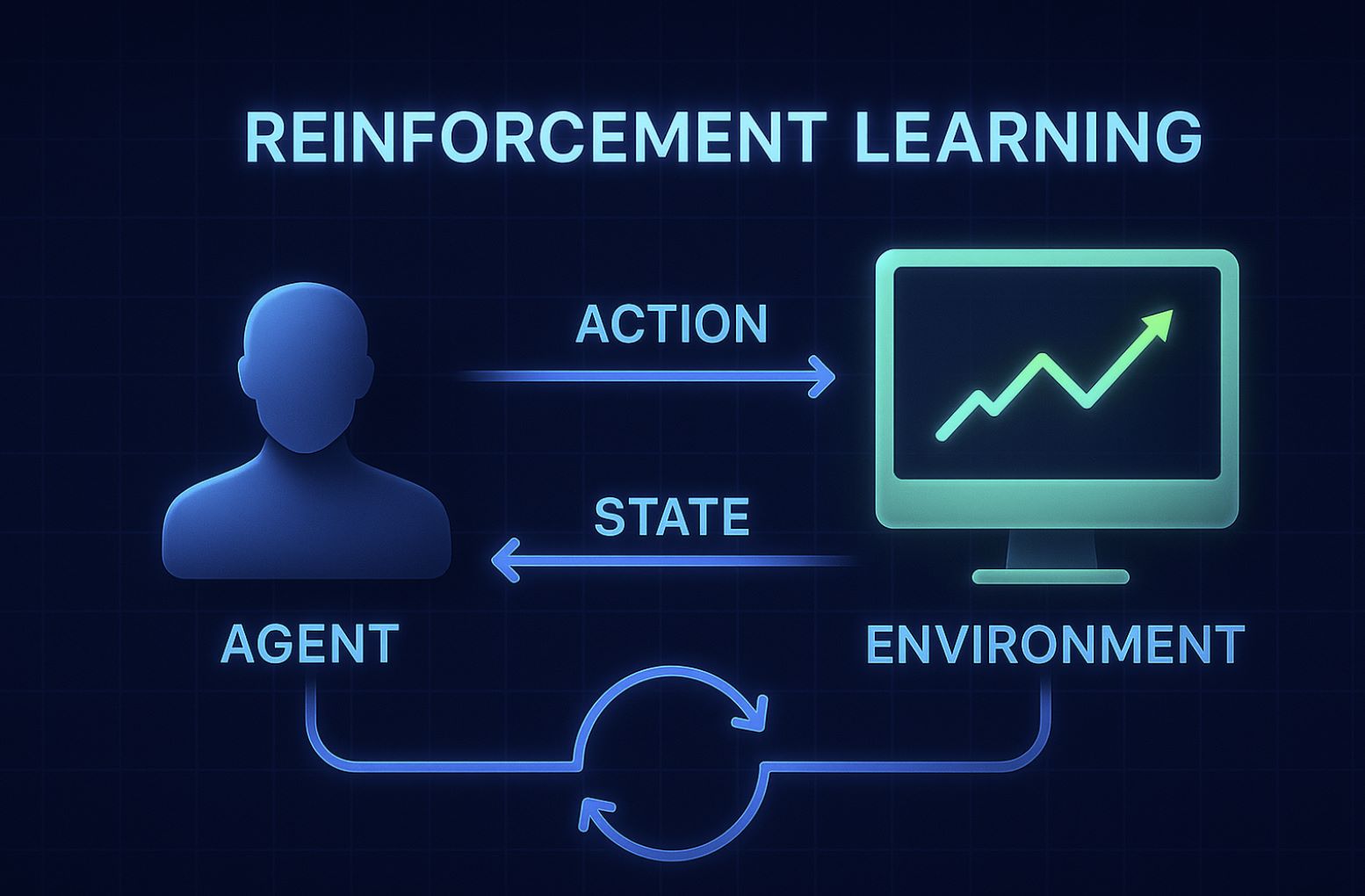

開發者透過人類反饋微調、輸出過濾及強化學習等技術減輕這些問題。

即使如此,LLM用戶仍須留意結果的準確性及偏見問題。此外,訓練及運行LLM需龐大計算資源(強大GPU/TPU及大量數據),成本不菲。

>>>點擊查看:

總結來說,大型語言模型是基於Transformer的人工智能系統,經過海量文本數據訓練。它透過自監督學習掌握語言模式,具備生成流暢且語境相關文字的能力。憑藉其規模,LLM能處理廣泛語言任務——從聊天、寫作到翻譯及編碼——往往達到甚至超越人類流暢度。

正如頂尖AI研究者所言,這些模型有望重塑我們與科技互動及獲取資訊的方式。截至2025年,LLM持續進步(包括處理圖像或音頻的多模態擴展),並保持AI創新的前沿,成為現代AI應用的核心組件。

請關注INVIAI,獲取更多實用資訊!