بڑے زبان ماڈلز (LLMs) ایسے مصنوعی ذہانت کے نظام ہیں جو انسانی زبان کو سمجھنے اور پیدا کرنے کے لیے بے پناہ متن کے ڈیٹا سیٹس پر تربیت یافتہ ہوتے ہیں۔ آسان الفاظ میں، ایک LLM کو لاکھوں یا اربوں الفاظ (اکثر انٹرنیٹ سے) کھلائے جاتے ہیں تاکہ یہ سیاق و سباق میں متن کی پیش گوئی اور تخلیق کر سکے۔ یہ ماڈلز عموماً گہری تعلیم والے نیورل نیٹ ورکس پر مبنی ہوتے ہیں – سب سے زیادہ عام طور پر ٹرانسفارمر فن تعمیر۔ اپنی وسعت کی وجہ سے، LLMs بہت سے زبان کے کام انجام دے سکتے ہیں (بات چیت، ترجمہ، تحریر) بغیر ہر ایک کے لیے خاص طور پر پروگرام کیے۔

بڑے زبان ماڈلز کی اہم خصوصیات میں شامل ہیں:

- وسیع تربیتی ڈیٹا: LLMs کو بے شمار صفحات پر مشتمل متن کے ذخیرے (اربوں صفحات) پر تربیت دی جاتی ہے۔ یہ "بڑا" تربیتی سیٹ انہیں گرامر اور حقائق کا وسیع علم فراہم کرتا ہے۔

- ٹرانسفارمر فن تعمیر: یہ خود توجہ (self-attention) کے ساتھ ٹرانسفارمر نیورل نیٹ ورکس استعمال کرتے ہیں، جس کا مطلب ہے کہ جملے کے ہر لفظ کا موازنہ ایک ساتھ دوسرے تمام الفاظ سے کیا جاتا ہے۔ اس سے ماڈل کو سیاق و سباق مؤثر طریقے سے سیکھنے میں مدد ملتی ہے۔

- اربوں پیرامیٹرز: ماڈلز میں لاکھوں یا اربوں وزن (پیرامیٹرز) ہوتے ہیں۔ یہ پیرامیٹرز زبان کے پیچیدہ نمونوں کو پکڑتے ہیں۔ مثال کے طور پر، GPT-3 میں 175 ارب پیرامیٹرز ہیں۔

- خود نگرانی والی تعلیم: LLMs بغیر انسانی لیبلز کے متن میں گمشدہ الفاظ کی پیش گوئی کر کے سیکھتے ہیں۔ مثال کے طور پر، تربیت کے دوران ماڈل جملے میں اگلے لفظ کا اندازہ لگانے کی کوشش کرتا ہے۔ اس عمل کو بار بار کرنے سے ماڈل گرامر، حقائق، اور کچھ استدلال کو اندرونی طور پر سمجھ لیتا ہے۔

- فائن ٹیوننگ اور پرامپٹنگ: پری ٹریننگ کے بعد، LLMs کو مخصوص کام کے لیے بہتر بنایا جا سکتا ہے یا پرامپٹس کے ذریعے رہنمائی دی جا سکتی ہے۔ اس کا مطلب ہے کہ ایک ہی ماڈل طبی سوال و جواب یا تخلیقی تحریر جیسے نئے کاموں کے لیے چھوٹے ڈیٹا سیٹ یا ہوشیار ہدایات کے ذریعے ڈھالا جا سکتا ہے۔

یہ خصوصیات مل کر ایک LLM کو انسان کی طرح متن سمجھنے اور پیدا کرنے کے قابل بناتی ہیں۔ عملی طور پر، ایک اچھی تربیت یافتہ LLM سیاق و سباق کا اندازہ لگا سکتی ہے، جملے مکمل کر سکتی ہے، اور مختلف موضوعات پر روانی سے جوابات دے سکتی ہے (سادہ بات چیت سے لے کر تکنیکی موضوعات تک) بغیر کسی مخصوص کام کے لیے انجینئرنگ کے۔

LLMs عام طور پر ٹرانسفارمر نیٹ ورک فن تعمیر استعمال کرتے ہیں۔ یہ فن تعمیر ایک گہرا نیورل نیٹ ورک ہے جس میں کئی پرتیں اور جڑے ہوئے نوڈز ہوتے ہیں۔ ایک اہم جزو خود توجہ ہے، جو ماڈل کو جملے میں ہر لفظ کی اہمیت کو ایک ساتھ تمام دوسرے الفاظ کے مقابلے میں وزن دینے کی اجازت دیتا ہے۔

پرانے تسلسل والے ماڈلز (جیسے RNNs) کے برعکس، ٹرانسفارمر پورے ان پٹ کو ایک ساتھ پروسیس کرتے ہیں، جس سے GPUs پر تربیت بہت تیز ہوتی ہے۔ تربیت کے دوران، LLM اپنے اربوں پیرامیٹرز کو اس طرح ایڈجسٹ کرتا ہے کہ وہ اپنے وسیع متن کے ذخیرے میں ہر اگلے لفظ کی پیش گوئی کر سکے۔

وقت کے ساتھ، یہ عمل ماڈل کو گرامر اور معنوی تعلقات سکھاتا ہے۔ نتیجہ ایک ایسا ماڈل ہوتا ہے جو دیے گئے پرامپٹ کے تحت خود بخود مربوط اور سیاق و سباق کے مطابق زبان پیدا کر سکتا ہے۔

LLMs کی ایپلیکیشنز

چونکہ یہ قدرتی زبان کو سمجھتے اور پیدا کرتے ہیں، LLMs کی صنعتوں میں کئی قسم کی ایپلیکیشنز ہیں۔ کچھ عام استعمالات یہ ہیں:

- مکالماتی AI (چیٹ بوٹس اور اسسٹنٹس): LLMs جدید چیٹ بوٹس کو طاقت دیتے ہیں جو کھلے مکالمے کر سکتے ہیں یا سوالات کے جواب دے سکتے ہیں۔ مثال کے طور پر، کسٹمر سپورٹ بوٹس یا Siri اور Alexa جیسے ورچوئل اسسٹنٹس LLMs استعمال کرتے ہیں تاکہ سوالات کو سمجھ کر قدرتی انداز میں جواب دے سکیں۔

- مواد کی تخلیق: یہ ای میلز، مضامین، مارکیٹنگ کاپی، یا حتیٰ کہ شاعری اور کوڈ بھی لکھ سکتے ہیں۔ مثال کے طور پر، موضوع کے پرامپٹ پر ChatGPT (جو GPT ماڈلز پر مبنی ہے) ایک مضمون یا کہانی تیار کر سکتا ہے۔ کمپنیاں LLMs کو بلاگ لکھنے، اشتہاری کاپی، اور رپورٹ بنانے کے لیے خودکار بناتی ہیں۔

- ترجمہ اور خلاصہ: LLMs زبانوں کے درمیان متن کا ترجمہ کرتے ہیں اور طویل دستاویزات کا خلاصہ بناتے ہیں۔ تربیت میں متوازی مثالیں دیکھ کر، ماڈل دوسری زبان میں روانی سے متن پیدا کر سکتا ہے یا 20 صفحات کی رپورٹ کو چند پیراگراف میں سمیٹ سکتا ہے۔

- سوال و جواب: سوال ملنے پر، LLM حقائق پر مبنی جوابات یا وضاحتیں فراہم کر سکتا ہے۔ یہ Q&A سرچ انٹرفیسز اور ورچوئل ٹیچرز کو طاقت دیتا ہے۔ ChatGPT جیسے ماڈلز، مثال کے طور پر، عمومی معلومات کے سوالات کے جواب دے سکتے ہیں یا آسان زبان میں تصورات کی وضاحت کر سکتے ہیں۔

- کوڈ کی تخلیق: کچھ LLMs کوڈ کے ساتھ کام کرنے کے لیے خاص ہوتے ہیں۔ یہ وضاحتوں سے کوڈ کے ٹکڑے لکھ سکتے ہیں، بگز تلاش کر سکتے ہیں، یا پروگرامنگ زبانوں کے درمیان ترجمہ کر سکتے ہیں۔ (GitHub Copilot ایک LLM استعمال کرتا ہے جو کوڈ پر تربیت یافتہ ہے تاکہ ڈویلپرز کی مدد کرے۔)

- تحقیق اور تجزیہ: یہ محققین کی مدد کرتے ہیں بڑے متن کے ڈیٹا سیٹس سے بصیرت نکالنے، مواد کی ٹیگنگ، یا صارف کی رائے پر جذباتی تجزیہ کرنے میں۔ کئی شعبوں میں، LLMs دستاویزات کا جائزہ لینے یا ڈیٹا کی تنظیم جیسے کاموں کو تیز کرتے ہیں کیونکہ یہ دستاویزات کے مواد کو سمجھتے ہیں۔

بڑے زبان ماڈلز کی مشہور مثالوں میں ChatGPT / GPT-4 (OpenAI)، Bard (Google کا PaLM)، LLaMA (Meta)، Claude (Anthropic)، اور Bing Chat (Microsoft کا GPT-based) شامل ہیں۔ ان میں سے ہر ماڈل کو وسیع ڈیٹا سیٹس پر تربیت دی گئی ہے اور انہیں APIs یا ویب انٹرفیس کے ذریعے استعمال کیا جا سکتا ہے۔

مثال کے طور پر، ChatGPT کے پیچھے GPT-3.5 اور GPT-4 میں سیکڑوں ارب پیرامیٹرز ہوتے ہیں، جبکہ گوگل کے ماڈلز (PaLM اور Gemini) اور دیگر بھی اسی طرح کام کرتے ہیں۔ ڈویلپرز اکثر ان LLMs کے ساتھ کلاؤڈ سروسز یا لائبریریز کے ذریعے تعامل کرتے ہیں، انہیں مخصوص کاموں جیسے دستاویزات کا خلاصہ یا کوڈنگ کی مدد کے لیے حسب ضرورت بناتے ہیں۔

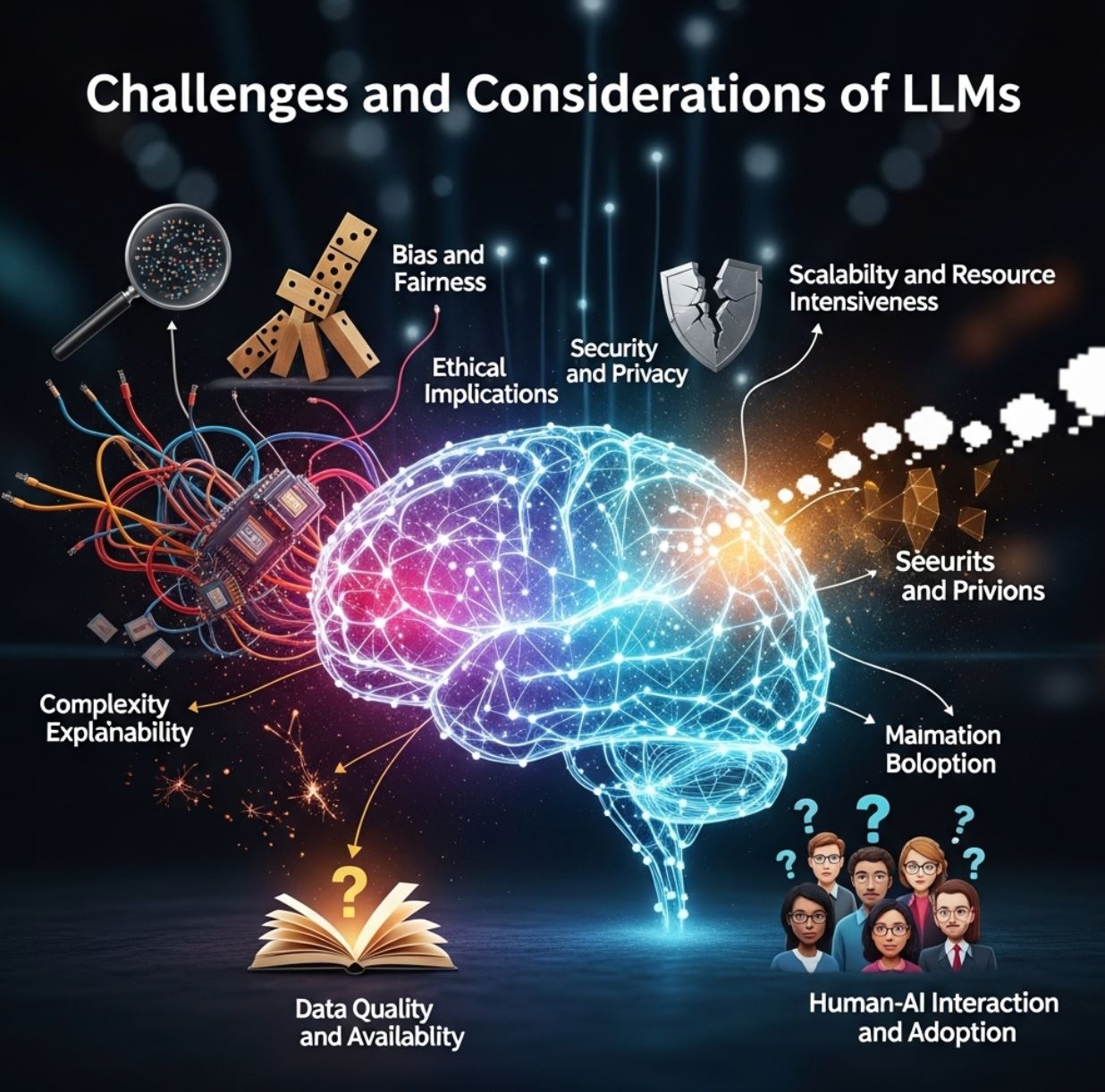

چیلنجز اور غور و فکر

LLMs طاقتور ہیں، لیکن کامل نہیں۔ چونکہ یہ حقیقی دنیا کے متن سے سیکھتے ہیں، یہ اپنے تربیتی ڈیٹا میں موجود تعصبات کو دہرا سکتے ہیں۔ ایک LLM ایسا مواد پیدا کر سکتا ہے جو ثقافتی طور پر جانبدار ہو، یا اگر احتیاط سے فلٹر نہ کیا جائے تو جارحانہ یا دقیانوسی زبان استعمال کر سکتا ہے۔

ایک اور مسئلہ ہیلوسینیشنز ہے: ماڈل ایسے جوابات دے سکتا ہے جو بہرحال روانی سے لگتے ہیں مگر بالکل غلط یا فرضی ہوتے ہیں۔ مثال کے طور پر، ایک LLM پراعتماد انداز میں غلط حقیقت یا نام گھڑ سکتا ہے۔ یہ غلطیاں اس لیے ہوتی ہیں کیونکہ ماڈل بنیادی طور پر متن کی سب سے ممکنہ تسلسل کی پیش گوئی کر رہا ہوتا ہے، حقائق کی تصدیق نہیں کر رہا۔

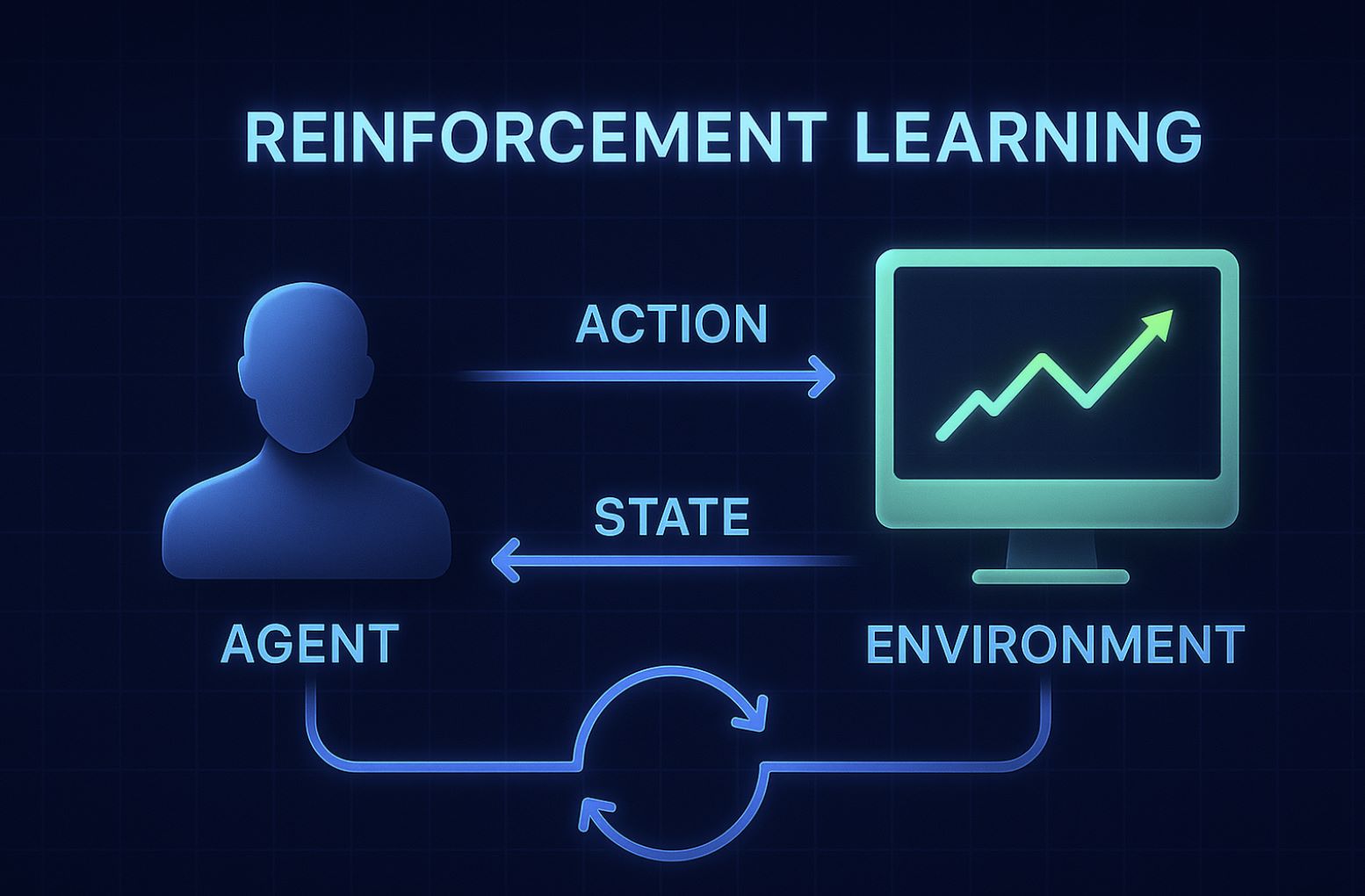

ڈویلپرز ان مسائل کو انسانی فیڈبیک کے ساتھ فائن ٹیوننگ، آؤٹ پٹ فلٹرنگ، اور انسانی درجہ بندی سے ری انفورسمنٹ لرننگ جیسی تکنیکوں کے ذریعے کم کرتے ہیں۔

اس کے باوجود، LLMs کے صارفین کو یہ جاننا چاہیے کہ نتائج کی درستگی اور تعصب کی جانچ ضروری ہے۔ مزید برآں، LLMs کی تربیت اور چلانے کے لیے بہت زیادہ کمپیوٹنگ وسائل (طاقتور GPUs/TPUs اور بہت سا ڈیٹا) درکار ہوتے ہیں، جو مہنگے ہو سکتے ہیں۔

>>>دیکھنے کے لیے کلک کریں:

نیچرل لینگویج پروسیسنگ کیا ہے؟

خلاصہ یہ کہ، ایک بڑا زبان ماڈل ایک ٹرانسفارمر پر مبنی AI نظام ہے جو وسیع مقدار میں متن کے ڈیٹا پر تربیت یافتہ ہوتا ہے۔ اس نے خود نگرانی والی تربیت کے ذریعے زبان کے نمونے سیکھے ہیں، جو اسے روانی اور سیاق و سباق کے مطابق متن پیدا کرنے کی صلاحیت دیتا ہے۔ اپنی وسعت کی وجہ سے، LLMs زبان کے مختلف کام انجام دے سکتے ہیں – بات چیت اور تحریر سے لے کر ترجمہ اور کوڈنگ تک – اکثر انسانی سطح کی روانی کے برابر یا اس سے بہتر۔

جیسا کہ معروف AI محققین کے خلاصے میں ذکر ہے، یہ ماڈلز ٹیکنالوجی کے ساتھ ہمارے تعامل اور معلومات تک رسائی کے طریقے کو بدلنے کے لیے تیار ہیں۔ 2025 تک، LLMs ترقی پذیر ہیں (جس میں ملٹی موڈل توسیعات شامل ہیں جو تصاویر یا آڈیو کو بھی سنبھالتی ہیں) اور AI کی جدید ترین ایج پر ہیں، جو انہیں جدید AI ایپلیکیشنز کا مرکزی جزو بناتی ہیں۔

مزید مفید معلومات کے لیے INVIAI کو فالو کریں!