Edge AI (uneori numită „AI la margine”) înseamnă rularea modelelor de inteligență artificială și învățare automată pe dispozitive locale (senzori, camere, smartphone-uri, gateway-uri industriale etc.) în loc de centre de date îndepărtate. Cu alte cuvinte, „marginea” rețelei – locul unde sunt generate datele – gestionează calculul. Astfel, dispozitivele pot analiza datele imediat ce sunt colectate, în loc să trimită constant date brute către cloud.

După cum explică IBM, Edge AI permite procesarea în timp real, pe dispozitiv, fără a depinde de un server central. De exemplu, o cameră cu Edge AI poate detecta și clasifica obiecte instantaneu, oferind feedback imediat. Prin procesarea locală a datelor, Edge AI poate funcționa chiar și cu conexiuni intermitente sau fără internet.

Conform rapoartelor din industrie, această schimbare se produce rapid: cheltuielile globale pentru calculul la margine au ajuns la aproximativ 232 miliarde de dolari în 2024 (în creștere cu 15% față de 2023), impulsionate în mare parte de creșterea IoT-ului alimentat de AI.

Pe scurt, Edge AI aduce calculul mai aproape de sursa datelor – implementând inteligența pe dispozitive sau noduri apropiate, ceea ce accelerează răspunsurile și reduce necesitatea de a transmite totul către cloud.

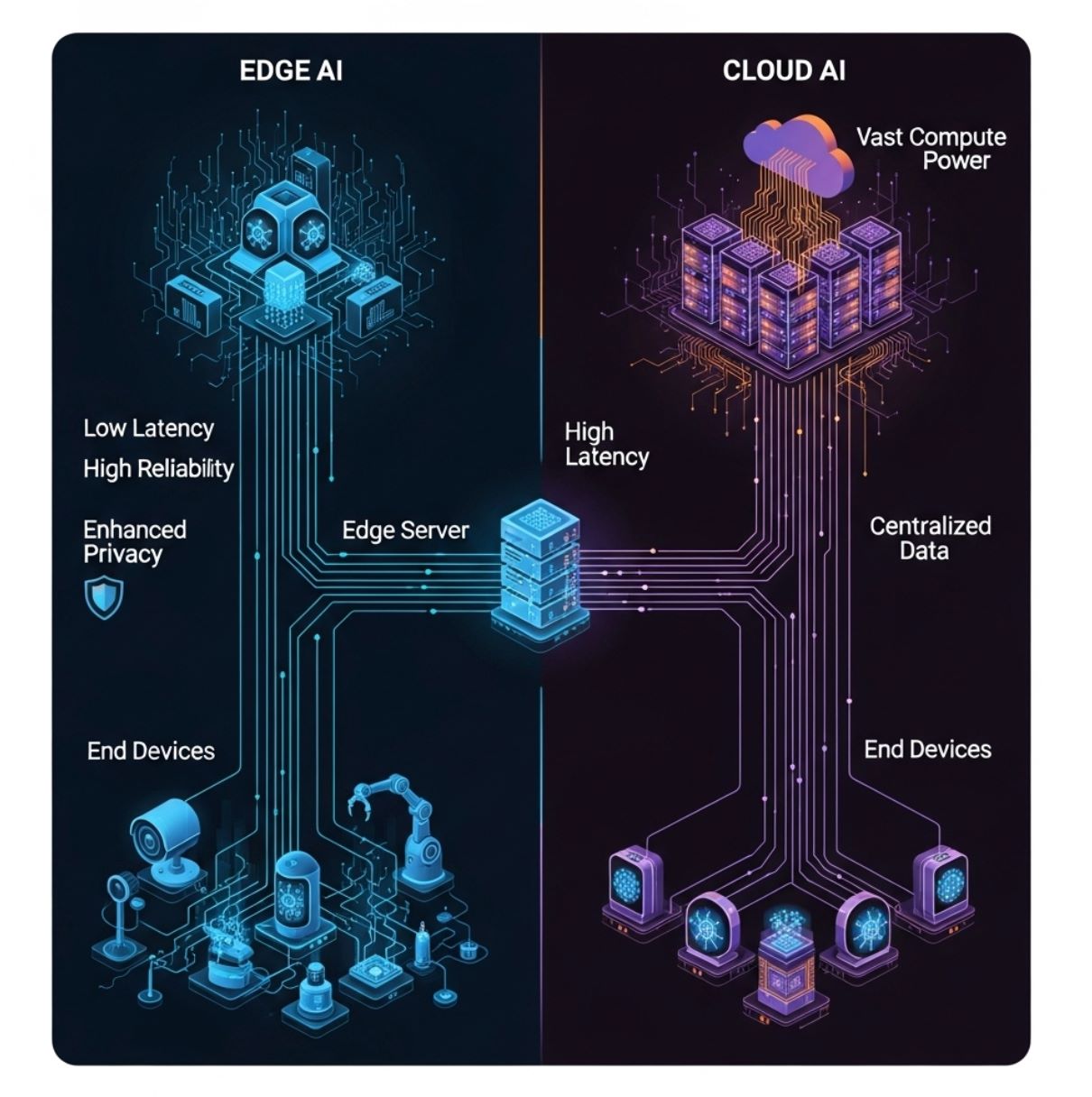

Edge AI vs Cloud AI: Diferențe cheie

Spre deosebire de AI-ul tradițional bazat pe cloud (care trimite toate datele către servere centralizate), Edge AI distribuie calculul între hardware-ul local. Diagrama de mai sus ilustrează un model simplu de calcul la margine: dispozitivele finale (stratul de jos) trimit date către un server sau gateway la margine (stratul mijlociu) în loc să le trimită doar către cloud-ul îndepărtat (stratul de sus).

În această configurație, inferența AI poate avea loc pe dispozitiv sau pe nodul local de margine, reducând semnificativ întârzierile de comunicare.

- Întârziere (latency): Edge AI minimizează decalajul. Deoarece procesarea este locală, deciziile pot fi luate în milisecunde. IBM menționează că inferența la margine „reduce latența prin procesarea datelor direct pe dispozitiv”, în timp ce AI-ul din cloud implică întârzieri suplimentare prin trimiterea datelor către și de la servere îndepărtate.

Acest aspect este esențial pentru sarcini sensibile la timp (de exemplu, evitarea unui accident auto sau controlul unui robot). - Lățime de bandă: Edge AI reduce încărcarea rețelei. Prin analizarea sau filtrarea datelor local, mult mai puține informații trebuie trimise în sus. IBM explică că sistemele la margine „solicită o lățime de bandă mai mică” deoarece majoritatea datelor rămân locale.

În schimb, AI-ul din cloud necesită conexiuni rapide și continue pentru a transfera date brute în ambele sensuri. Aceasta face ca Edge AI să fie mai eficient și mai economic în condiții de rețele aglomerate sau costisitoare. - Confidențialitate/Securitate: Edge AI poate spori confidențialitatea. Datele sensibile (voce, imagini, măsurători medicale) pot fi procesate și stocate pe dispozitiv, fără a fi transmise în cloud. Aceasta reduce expunerea la breșe de securitate din partea terților.

De exemplu, un smartphone poate recunoaște fața local, fără a încărca fotografia. În schimb, AI-ul din cloud implică adesea trimiterea datelor personale către servere externe, ceea ce poate crește riscurile de securitate. - Resurse de calcul: Centrele de date din cloud dispun de putere CPU/GPU practic nelimitată, permițând modele AI foarte mari. Dispozitivele la margine au mult mai puțină putere de procesare și stocare. După cum notează IBM, unitățile la margine sunt „limitare de constrângerile de dimensiune ale dispozitivului”.

Prin urmare, Edge AI folosește adesea modele optimizate sau mai mici. În practică, antrenarea modelelor complexe are loc în cloud, iar doar modele compacte și cuantificate sunt implementate pe dispozitivele la margine. - Fiabilitate: Reducând dependența de conectivitatea continuă, Edge AI poate menține funcțiile critice chiar și în cazul căderii rețelei. De exemplu, o dronă poate naviga folosind AI local atunci când pierde semnalul către bază.

Pe scurt, AI-ul la margine și cel din cloud se completează reciproc. Serverele cloud gestionează antrenamentele complexe, arhivarea și analizele pe volume mari de date, în timp ce Edge AI se ocupă de inferențe în timp real și decizii rapide aproape de sursa datelor.

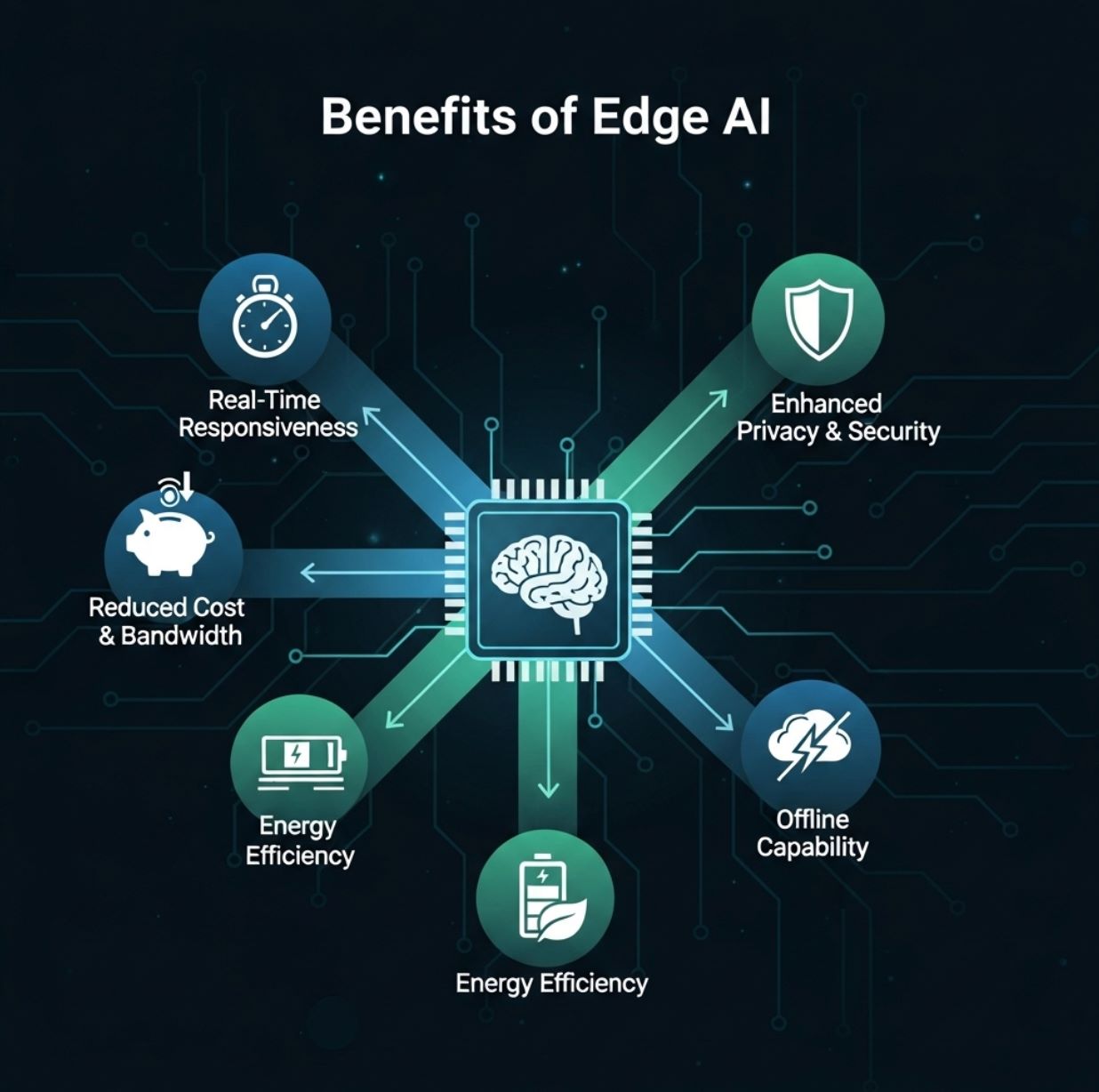

Beneficiile Edge AI

Edge AI oferă mai multe avantaje practice pentru utilizatori și organizații:

- Răspuns în timp real: Procesarea locală a datelor permite analiza imediată. Utilizatorii primesc feedback instantaneu (de exemplu, detectarea obiectelor în timp real, răspuns vocal, alertă de anomalie) fără a aștepta un drum dus-întors către cloud.

Această latență scăzută este un beneficiu major pentru aplicații precum realitatea augmentată, vehicule autonome și robotică. - Reducerea lățimii de bandă și a costurilor: Cu Edge AI, doar rezultatele sumarizate sau evenimentele neobișnuite trebuie trimise prin internet. Aceasta reduce semnificativ costurile de transfer și stocare în cloud.

De exemplu, o cameră de securitate poate încărca clipuri doar când detectează o potențială amenințare, în loc să transmită continuu. - Confidențialitate sporită: Păstrarea datelor pe dispozitiv îmbunătățește securitatea. Informațiile personale sau sensibile nu părăsesc hardware-ul local dacă sunt procesate la margine.

Acest aspect este deosebit de important pentru aplicații supuse unor reguli stricte de confidențialitate (sănătate, finanțe etc.), deoarece Edge AI poate menține datele în interiorul unei țări sau facilități. - Eficiență energetică și de cost: AI-ul pe dispozitiv poate economisi energie. Rularea unui model mic pe un cip cu consum redus folosește adesea mai puțină energie decât trimiterea datelor către un server cloud și înapoi.

De asemenea, reduce costurile serverelor – sarcinile mari AI sunt costisitoare de găzduit în cloud. - Funcționare offline și reziliență: Edge AI poate continua să funcționeze dacă conexiunea eșuează. Dispozitivele pot opera cu inteligență locală și se pot sincroniza ulterior.

Aceasta face sistemele mai robuste, mai ales în zone izolate sau în aplicații critice (de exemplu, monitorizare industrială).

Red Hat și IBM evidențiază aceste avantaje. Edge AI „aduce capacități de calcul performante la margine”, permițând analize în timp real și eficiență sporită.

Un raport rezumă că implementările la margine reduc latența și nevoia de lățime de bandă, în timp ce sporesc confidențialitatea și fiabilitatea.

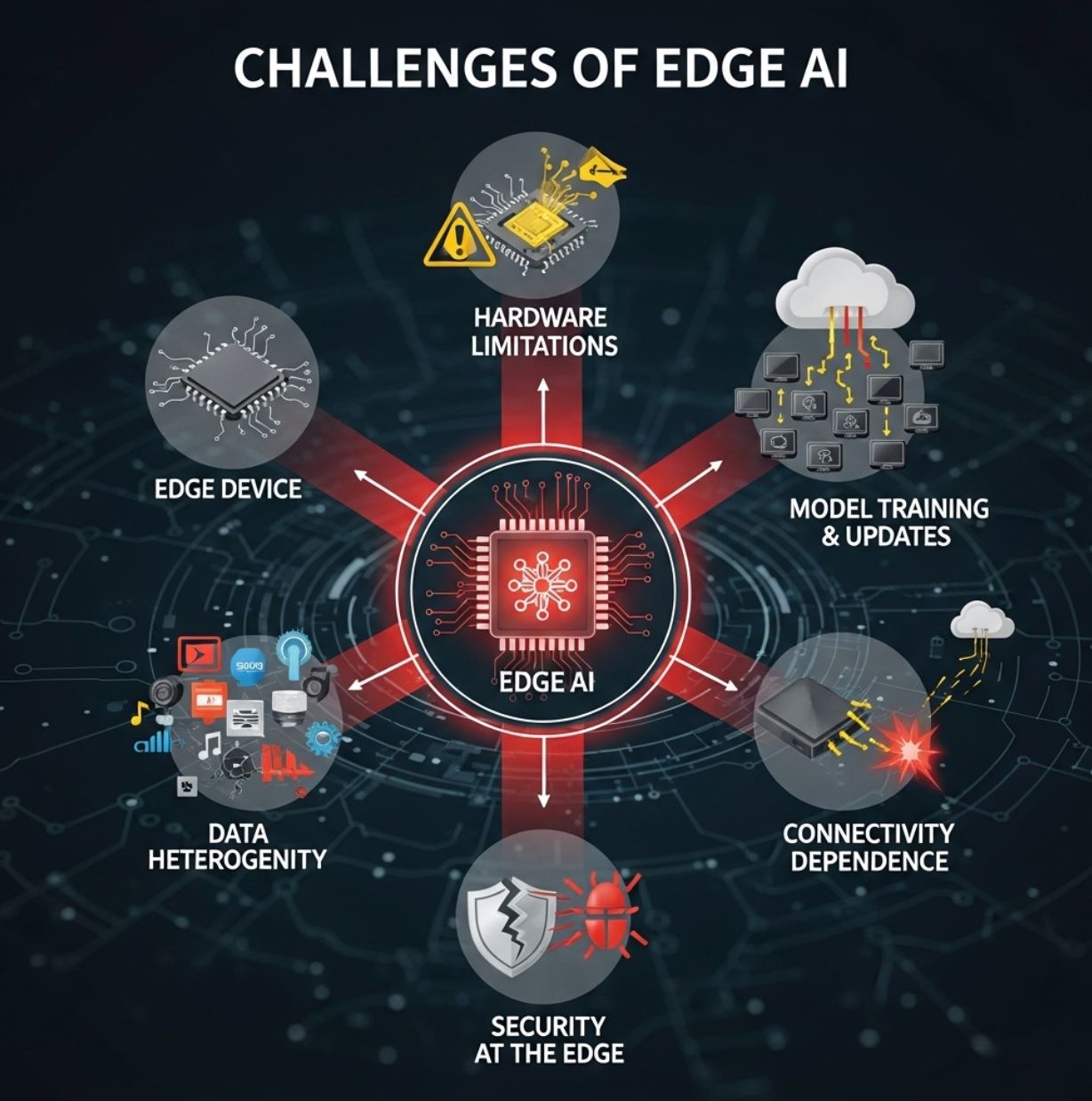

Provocările Edge AI

În ciuda avantajelor, Edge AI se confruntă și cu obstacole:

- Limitări hardware: Dispozitivele la margine sunt de obicei mici și cu resurse limitate. Pot avea doar procesoare modeste sau NPUs specializate cu consum redus și memorie limitată.

Aceasta obligă inginerii AI să folosească tehnici de comprimare, tăiere sau TinyML pentru a adapta modelele pe dispozitiv. Modelele complexe de învățare profundă nu pot rula complet pe microcontrolere, astfel că unele compromisuri de acuratețe sunt inevitabile. - Antrenarea și actualizările modelelor: Antrenarea modelelor AI sofisticate are loc de obicei în cloud, unde există date și putere de calcul masivă. După antrenare, modelele trebuie optimizate (cuantificate, tăiate etc.) și implementate pe fiecare dispozitiv la margine.

Menținerea actualizărilor pentru mii sau milioane de dispozitive poate fi complexă. Sincronizarea firmware-ului și a datelor adaugă sarcini administrative. - Gravitația și eterogenitatea datelor: Mediile la margine sunt diverse. Diferite locații pot colecta tipuri diferite de date (senzorii variază în funcție de aplicație), iar politicile pot diferi regional.

Integrarea și standardizarea acestor date este o provocare. După cum notează IBM, implementarea largă a Edge AI ridică probleme legate de „gravitația datelor, eterogenitate, scară și constrângeri de resurse”. Cu alte cuvinte, datele tind să rămână locale, ceea ce face dificilă obținerea unei perspective globale, iar dispozitivele vin în toate formele și dimensiunile. - Securitatea la margine: Deși Edge AI poate îmbunătăți confidențialitatea, introduce și noi riscuri de securitate. Fiecare dispozitiv sau nod este o țintă potențială pentru hackeri.

Asigurarea că modelele locale sunt protejate împotriva manipulării și că firmware-ul este securizat necesită măsuri riguroase. - Dependența de conectivitate pentru anumite sarcini: Deși inferența poate fi locală, sistemele la margine depind adesea de conectivitatea cloud pentru sarcini grele precum reantrenarea modelelor, analiza datelor la scară largă sau agregarea rezultatelor distribuite.

Conectivitatea limitată poate crea blocaje pentru aceste funcții back-office.

În practică, majoritatea soluțiilor folosesc un model hibrid: dispozitivele la margine gestionează inferența, în timp ce cloud-ul se ocupă de antrenare, managementul modelelor și analizele big data.

Acest echilibru ajută la depășirea limitărilor de resurse și permite scalarea Edge AI.

Exemple de utilizare ale Edge AI

Edge AI este aplicat în numeroase industrii. Exemple din viața reală includ:

- Vehicule autonome: Mașinile autonome folosesc Edge AI la bord pentru a procesa instantaneu datele de la camere și radare pentru navigație și evitare a obstacolelor.

Nu își pot permite întârzierea trimiterii video către un server, astfel că totul (detectarea obiectelor, recunoașterea pietonilor, urmărirea benzilor) se face local. - Producție și Industria 4.0: Fabricile folosesc camere inteligente și senzori pe liniile de producție pentru a detecta defecte sau anomalii în timp real.

De exemplu, o cameră Edge AI poate identifica un produs defect pe bandă și declanșa o acțiune imediată. Similar, mașinile industriale folosesc AI local pentru a prezice defecțiuni (mentenanță predictivă) înainte de apariția avariilor. - Sănătate și intervenții de urgență: Dispozitivele medicale portabile și ambulanțele folosesc acum Edge AI pentru a analiza datele pacientului pe loc.

Ecograful sau monitorul de semne vitale din ambulanță pot aplica AI instantaneu pentru a detecta leziuni interne sau a alerta paramedicii despre semne vitale anormale. În spitale, Edge AI poate monitoriza continuu pacienții din terapie intensivă și poate declanșa alarme fără a aștepta un server central. - Orașe inteligente: Sistemele urbane folosesc Edge AI pentru gestionarea traficului, supraveghere și monitorizarea mediului.

Semafoarele inteligente ajustează timpii folosind AI local care analizează imaginile de la camere, reducând aglomerația în timp real. Camerele stradale pot detecta incidente (accidente, incendii) și alerta autoritățile imediat. Prin păstrarea procesării locale, orașele pot reacționa rapid fără a supraîncărca rețelele centrale. - Retail și IoT pentru consumatori: Edge AI îmbunătățește experiența și confortul clienților.

În magazine, camerele inteligente sau senzorii de pe rafturi folosesc AI pentru a urmări comportamentul cumpărătorilor și nivelurile de stoc instantaneu. Acasă, smartphone-urile, tabletele și boxele inteligente rulează recunoaștere vocală sau facială pe dispozitiv. De exemplu, un smartphone poate debloca sau identifica gesturi fără acces la cloud. Brățările de fitness analizează local datele de sănătate (ritm cardiac, pași) pentru feedback în timp real.

Alte utilizări emergente includ agricultură de precizie (droni și senzori care folosesc Edge AI pentru monitorizarea solului și a culturilor) și sisteme de securitate (recunoaștere facială pe dispozitiv pentru încuietori). După cum notează un studiu IEEE, Edge AI este esențial pentru aplicații precum agricultura inteligentă, controlul traficului și automatizarea industrială.

Pe scurt, orice scenariu care beneficiază de analiză instantanee și locală este un candidat ideal pentru Edge AI.

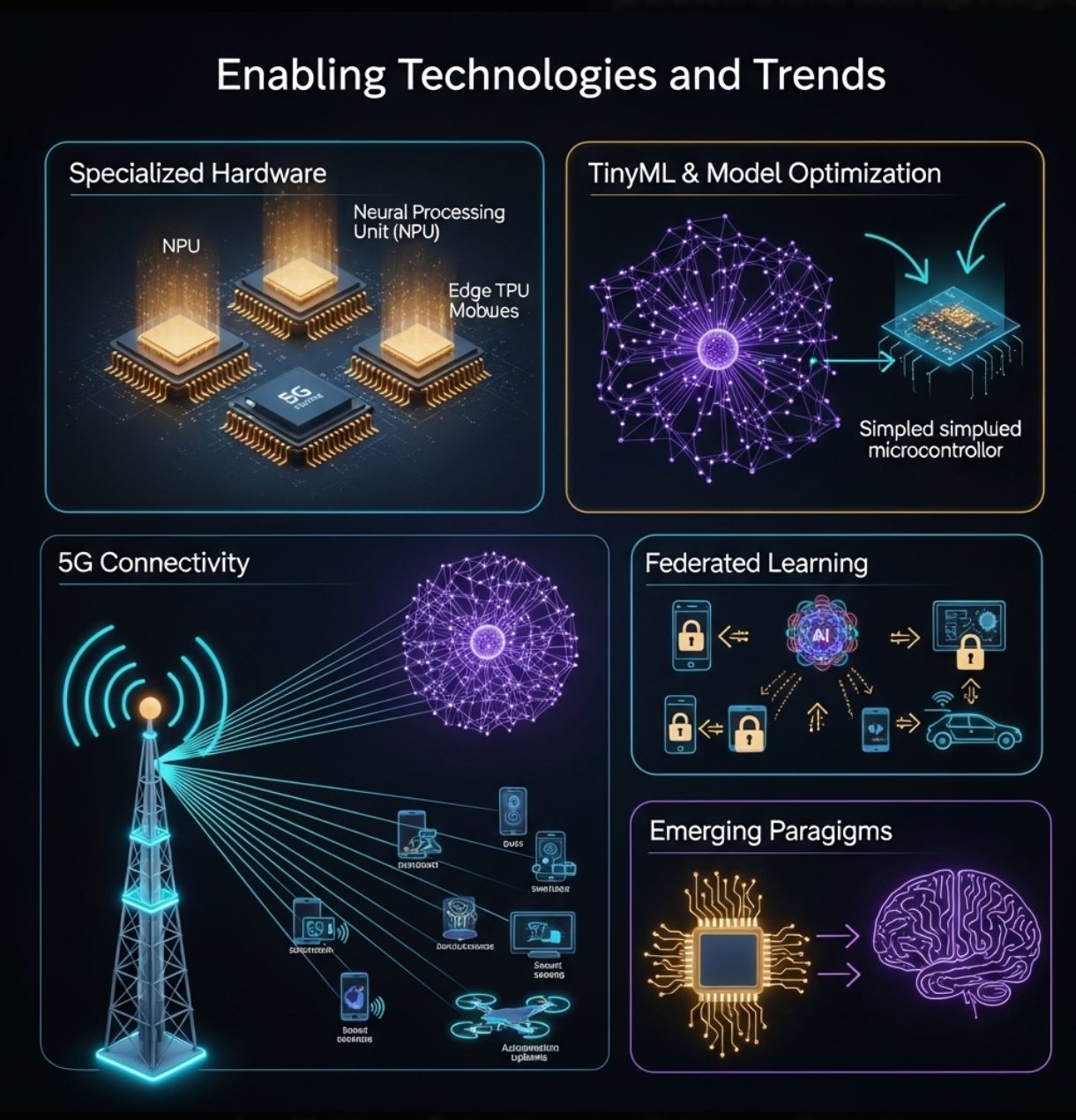

Tehnologii și tendințe care facilitează Edge AI

Creșterea Edge AI este susținută de progresele atât în hardware, cât și în software:

- Hardware specializat: Producătorii dezvoltă cipuri proiectate pentru inferența la margine. Acestea includ acceleratoare neuronale cu consum redus în smartphone-uri (NPU-uri) și module dedicate Edge AI precum Google Coral Edge TPU, NVIDIA Jetson Nano și plăci microcontroler low-cost (Arduino, Raspberry Pi cu extensii AI).

Un raport recent din industrie menționează că progresele în procesoare ultra-low-power și algoritmi „edge-native” depășesc limitele hardware-ului dispozitivelor. - TinyML și optimizarea modelelor: Instrumente precum TensorFlow Lite și tehnici precum tăierea, cuantizarea și distilarea modelelor permit reducerea rețelelor neuronale pentru a se potrivi pe dispozitive mici.

„TinyML” este un domeniu emergent axat pe rularea ML pe microcontrolere. Aceste abordări extind AI către senzori și dispozitive purtabile care funcționează pe baterii. - 5G și conectivitate: Rețelele wireless de generație următoare (5G și mai departe) oferă lățime de bandă mare și latență scăzută, complementând Edge AI.

Rețelele locale rapide facilitează coordonarea clusterelor de dispozitive la margine și descărcarea sarcinilor mai grele când este nevoie. Această sinergie între 5G și AI permite noi aplicații (de exemplu, fabrici inteligente, comunicații vehicul-la-tot). - Învățare federată și colaborativă: Metodele care protejează confidențialitatea, precum învățarea federată, permit mai multor dispozitive la margine să antreneze împreună un model fără a partaja date brute.

Fiecare dispozitiv îmbunătățește modelul local și partajează doar actualizările. Această tendință (menționată în planurile tehnologice viitoare) va spori Edge AI prin valorificarea datelor distribuite, păstrându-le private. - Paradigme emergente: Privind spre viitor, cercetările explorează calculul neuromorfic și AI generativ pe dispozitiv pentru a crește inteligența la margine.

Un raport prevede că inovații precum cipuri inspirate de creier și modele lingvistice mari locale ar putea apărea la margine.

Aceste tehnologii continuă să extindă limitele a ceea ce poate face Edge AI. Împreună, ele ajută la livrarea „epocii inferenței AI” – mutând inteligența mai aproape de utilizatori și senzori.

>>> Vă poate interesa:

Ce este Inteligența Artificială Generativă?

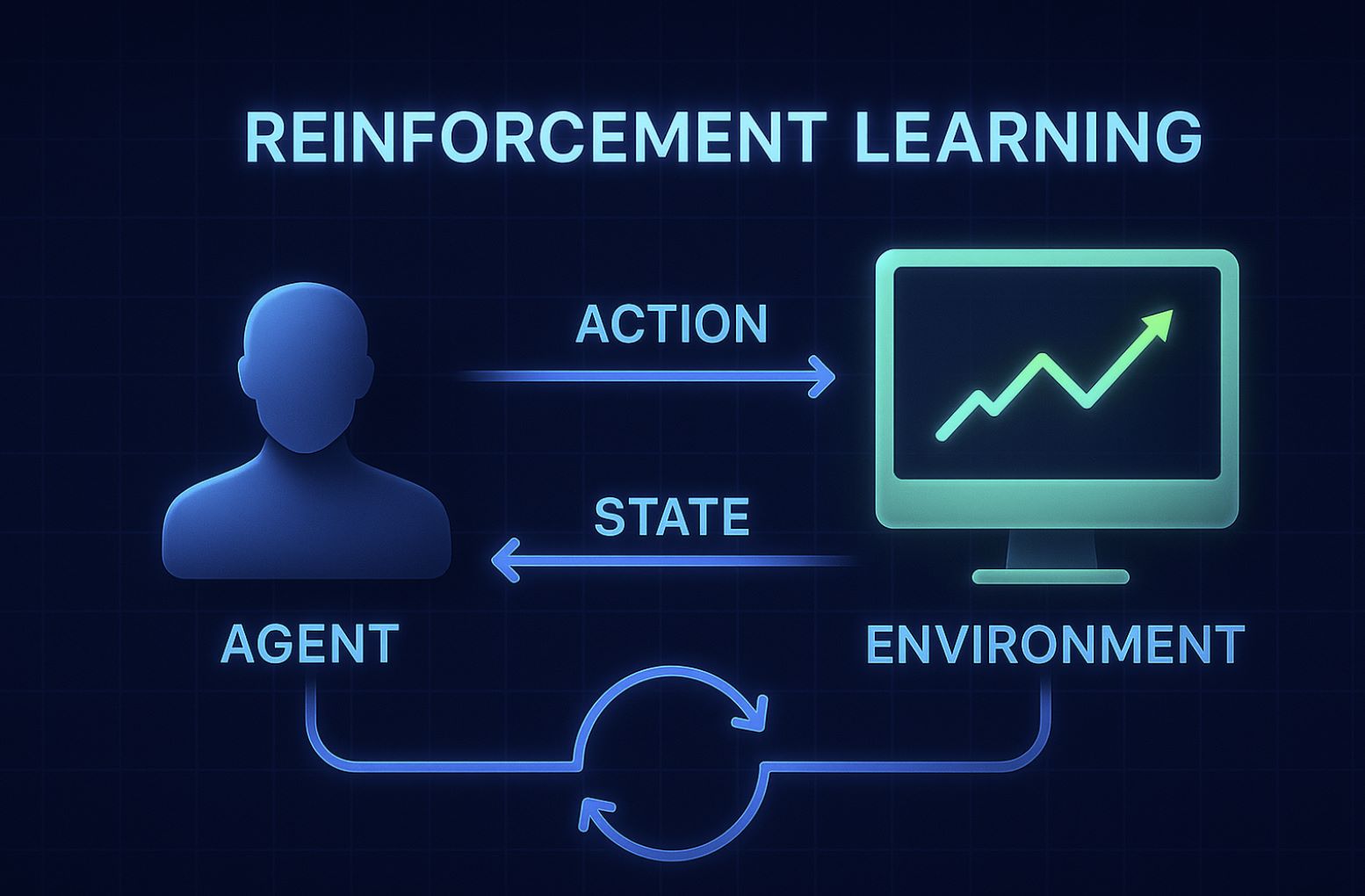

Ce este Învățarea prin Recompensare?

Edge AI transformă modul în care folosim inteligența artificială prin mutarea calculului către sursa datelor. Completează AI-ul din cloud, oferind analize mai rapide, mai eficiente și mai private pe dispozitive locale.

Această abordare răspunde provocărilor legate de timp real și lățime de bandă inerente arhitecturilor centrate pe cloud. În practică, Edge AI alimentează o gamă largă de tehnologii moderne – de la senzori inteligenți și fabrici până la drone și mașini autonome – prin oferirea de inteligență pe loc.

Pe măsură ce dispozitivele IoT se înmulțesc și rețelele se îmbunătățesc, Edge AI este pregătit să crească semnificativ. Progresele în hardware (microcipuri puternice, TinyML) și tehnici (învățare federată, optimizarea modelelor) fac mai ușoară implementarea AI peste tot.

Potrivit experților, Edge AI aduce câștiguri notabile în eficiență, confidențialitate și utilizarea lățimii de bandă. Pe scurt, Edge AI este viitorul inteligenței integrate – oferind ce e mai bun din AI într-o formă distribuită, pe dispozitiv.