Chatboty AI to programy komputerowe, które naśladują ludzką rozmowę. Przyjmują dane wejściowe od użytkownika w języku naturalnym (tekst lub mowa) i starają się udzielić pomocnej odpowiedzi. Według Microsoftu, chatboty AI to aplikacje, które „naśladują i rozumieją ludzkie rozmowy”.

Na przykład chatboty mogą odpowiadać na pytania, udzielać rekomendacji lub automatyzować zadania, takie jak umawianie wizyt. IBM podobnie wyjaśnia, że chatbot „symuluje ludzką rozmowę” i zauważa, że nowoczesne chatboty często wykorzystują przetwarzanie języka naturalnego do interpretacji pytań i tworzenia odpowiedzi. Krótko mówiąc, chatboty AI pozwalają ludziom komunikować się z komputerami za pomocą zwykłego języka, niwelując różnicę między mową ludzką a logiką maszynową.

Kluczowe technologie AI

Chatboty AI łączą kilka zaawansowanych technik sztucznej inteligencji:

- Przetwarzanie języka naturalnego (NLP): Umożliwia chatbotowi analizę i interpretację tekstu lub mowy. Na przykład algorytmy NLP dzielą zdanie na tokeny (słowa lub frazy) i pomagają botowi zrozumieć gramatykę oraz kontekst.

- Uczenie maszynowe i głębokie: Chatbot uczy się na podstawie przykładów języka i rozmów, aby z czasem poprawiać swoje odpowiedzi. Poprzez trening na rzeczywistych dialogach i tekstach system poznaje wzorce (np. typowe pytania i sposoby ich odpowiadania).

- Duże modele językowe (LLM): Bardzo duże sieci neuronowe (często oparte na architekturze transformerów) trenowane na ogromnych zbiorach tekstów. LLM mają miliardy parametrów i potrafią rozumieć oraz generować tekst przypominający ludzki. Skutecznie wychwytują wzorce językowe w różnych językach i dziedzinach.

Te technologie razem pozwalają chatbotom radzić sobie z pytaniami otwartymi i generować naturalnie brzmiące odpowiedzi.

Jak chatboty rozumieją użytkowników

Gdy wysyłasz wiadomość, chatbot stosuje zrozumienie języka naturalnego (NLU). Dzieli dane wejściowe na części (tokeny) i identyfikuje intencję użytkownika (co chce osiągnąć) oraz istotne elementy (ważne szczegóły, takie jak nazwy, daty czy miejsca).

Na przykład, jeśli zapytasz „Jaka będzie pogoda w Paryżu jutro?”, chatbot rozpoznaje intencję (zapytanie o prognozę pogody) i wyodrębnia elementy („Paryż” i „jutro”). Nowoczesne chatboty AI wykorzystują głębokie uczenie, dzięki czemu potrafią interpretować znaczenie nawet przy nieformalnym, niejasnym lub zawierającym błędy zapisie.

Szkolenie chatbotów AI

Chatboty AI są zasilane modelami językowymi trenowanymi na ogromnych zbiorach tekstów. Podczas treningu model przetwarza miliardy słów i dostosowuje swoje wewnętrzne parametry, aby przewidywać kolejne słowo w zdaniu na podstawie kontekstu.

W praktyce model otrzymuje ogromne korpusy tekstowe (np. całą Wikipedię lub internet) i uczy się z nich gramatyki, faktów oraz popularnych zwrotów.

Po treningu chatbot może generować nowe odpowiedzi, przewidując słowo po słowie, korzystając z poznanych wzorców. Co ważne, model nie zapamiętuje tekstu dosłownie; wiedza jest zakodowana w jego parametrach w sposób ukryty.

Dobrze wytrenowany chatbot potrafi więc odpowiedzieć na pytanie, syntetyzując odpowiedź na podstawie poznanych wzorców, nawet jeśli nigdy wcześniej nie widział dokładnie takiego pytania.

Transformery i duże modele językowe

Rysunek: architektura sieci transformera (enkoder po lewej, dekoder po prawej). Enkoder przetwarza dane wejściowe, a dekoder generuje wyjście. Nowoczesne chatboty opierają się na transformerach.

Sieć transformer zamienia słowa na wektory liczbowe i wykorzystuje uwagę wielogłową, aby jednocześnie powiązać każde słowo w zdaniu z każdym innym. Pozwala to modelowi uchwycić kontekst całego wejścia.

W przeciwieństwie do starszych modeli sekwencyjnych (np. RNN), transformery przetwarzają wszystkie słowa równolegle i uczą się znacznie szybciej. Poprzez nakładanie wielu warstw transformera powstaje duży model językowy (LLM), taki jak GPT-4 czy PaLM od Google. Te LLM są trenowane, by rozumieć i generować język na ogromną skalę, a także tłumaczyć, streszczać czy odpowiadać na pytania dzięki ogromnej liczbie parametrów.

Generowanie odpowiedzi

Podczas odpowiadania chatbot AI może korzystać z jednej z dwóch metod:

- Oparte na wyszukiwaniu: Chatbot wybiera odpowiedź z ustalonego zestawu możliwych odpowiedzi (np. bazy FAQ). Wczesne chatboty działały w ten sposób. Dla rozpoznanego pytania bot po prostu zwraca zapisaną odpowiedź. To podejście jest szybkie i niezawodne dla przewidywanych zapytań, ale nie radzi sobie z pytaniami spoza bazy.

- Generatywne modele AI: Chatbot generuje nową odpowiedź słowo po słowie, korzystając ze swojego modelu językowego. Na każdym kroku przewiduje najbardziej prawdopodobne kolejne słowo, biorąc pod uwagę dotychczasową rozmowę. Pozwala to botowi tworzyć unikalne odpowiedzi i odpowiadać na nowe pytania, których nigdy wcześniej nie widział. Jednak ze względu na oparcie na prawdopodobieństwach, czasem może generować błędne lub nielogiczne odpowiedzi.

Opinie ludzi i kontekst rozmowy

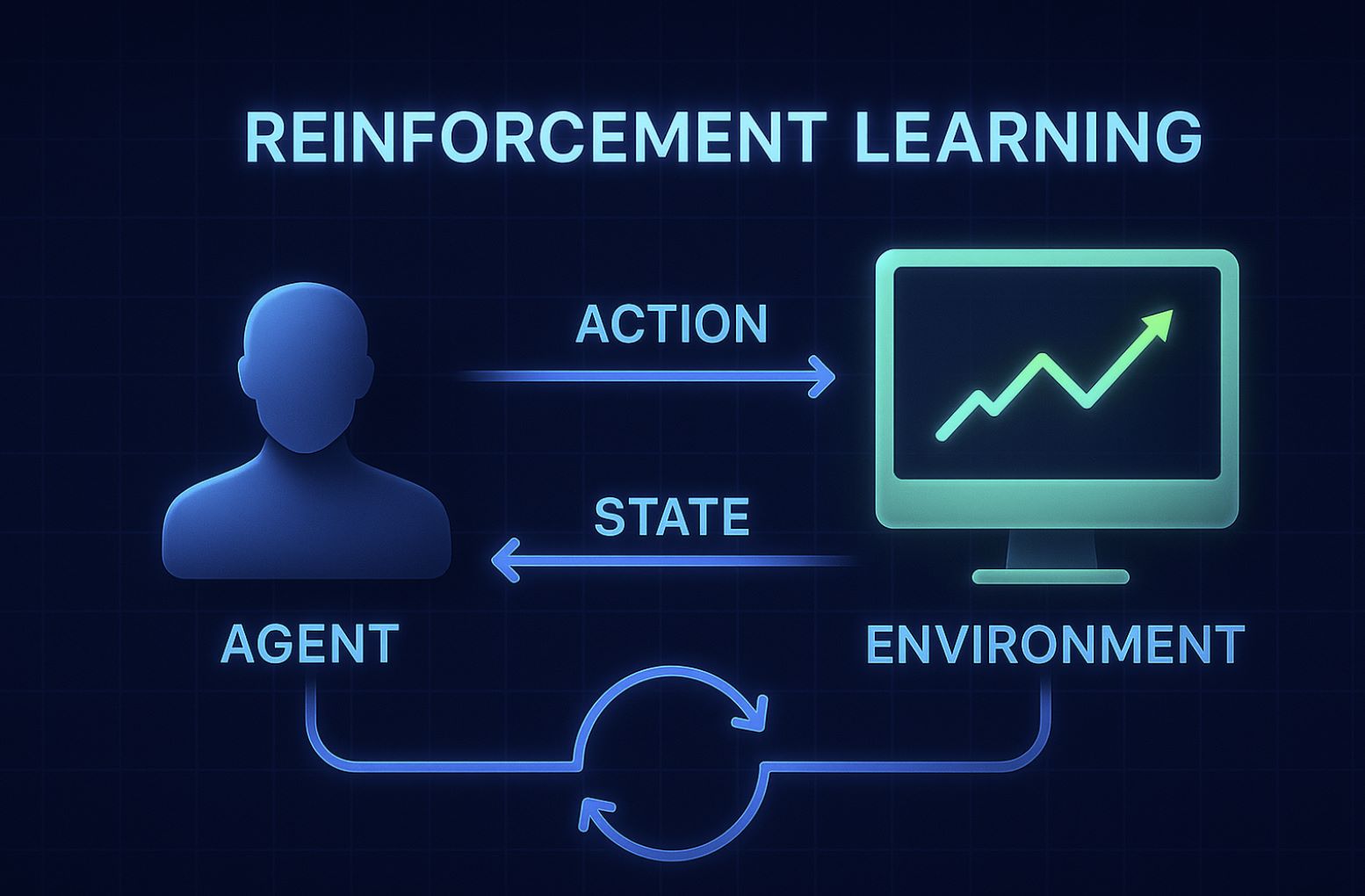

Po wstępnym treningu chatboty często są dopracowywane na podstawie opinii ludzi. Trenerzy oceniają odpowiedzi chatbota i pomagają mu się poprawić – wzmacniają dobre odpowiedzi i korygują błędne. Proces ten, znany jako uczenie ze wzmocnieniem na podstawie opinii ludzi (RLHF), pomaga systemowi unikać nieodpowiednich lub stronniczych treści. Na przykład ludzie mogą oznaczać odpowiedź jako „toksyczną” lub „nie na temat”, aby model nauczył się ich unikać.

Chatboty AI śledzą także kontekst rozmowy. Potrafią zapamiętać wcześniejsze części dialogu i wykorzystać tę informację, by odpowiedzi były spójne. Na przykład, jeśli zadasz pytania uzupełniające, chatbot wie, że odnoszą się do poprzedniego tematu i odpowiada odpowiednio. Ten stanowy kontekst umożliwia prowadzenie wieloetapowych rozmów i bardziej naturalną interakcję.

Przykłady chatbotów AI

Wiele znanych asystentów wirtualnych to chatboty AI. Siri od Apple i Alexa od Amazon reagują na polecenia głosowe, podczas gdy Gemini od Google i ChatGPT od OpenAI prowadzą rozmowy tekstowe. Firmy również wdrażają chatboty na stronach internetowych i w aplikacjach, aby obsługiwać zapytania klientów, umawiać wizyty lub pomagać w zakupach. Wszystkie te systemy opierają się na tych samych podstawowych technologiach AI do przetwarzania języka i generowania odpowiedzi.

Wyzwania i ograniczenia

Chatboty AI są potężne, ale nieidealne. Ponieważ zawsze starają się odpowiedzieć, czasem mogą halucynować – czyli pewnie podawać fałszywe lub mylące informacje. Jak zauważa jeden z ekspertów, chatbot to w gruncie rzeczy „maszyna wykonująca obliczenia matematyczne”, która generuje słowa. Nie rozumie prawdziwego znaczenia ani intencji jak człowiek.

W efekcie chatboty mogą udzielać różnych odpowiedzi na to samo pytanie w różnych momentach i mogą źle interpretować niejasne lub podchwytliwe zapytania. Użytkownicy powinni weryfikować ważne informacje uzyskane od chatbotów, zwłaszcza w krytycznych sytuacjach.

>>> Kliknij, aby dowiedzieć się więcej:

Czym jest Duży Model Językowy?

Chatboty AI działają, łącząc przetwarzanie języka naturalnego z uczeniem maszynowym i dużymi modelami językowymi. Analizują dane wejściowe użytkownika, aby wykryć intencję, a następnie albo pobierają gotową odpowiedź, albo generują nową za pomocą wytrenowanego modelu.

Nowoczesne chatboty wykorzystują oparte na transformerach LLM trenowane na ogromnych zbiorach tekstów, co pozwala im rozmawiać na szeroki zakres tematów z ludzką płynnością. Efektem jest narzędzie zdolne do prowadzenia zaskakująco naturalnych dialogów. W miarę jak modele te będą się rozwijać dzięki większym zbiorom danych i lepszemu treningowi, chatboty AI staną się jeszcze bardziej zaawansowane – jednak pozostają narzędziami statystycznymi, dlatego nadzór człowieka jest nadal niezbędny.