מודלים גדולים של שפה (LLMs) הם מערכות בינה מלאכותית שהוכשרו על מאגרי טקסט עצומים כדי להבין וליצור שפה הדומה לזו של בני אדם. בפשטות, מודל שפה גדול הוזן במיליונים או מיליארדי מילים (לעיתים קרובות מהאינטרנט) כדי שיוכל לחזות וליצור טקסט בהקשר מתאים. מודלים אלו מבוססים בדרך כלל על רשתות עצביות של למידה עמוקה – הנפוצה ביותר היא ארכיטקטורת הטרנספורמר. בשל היקפם, מודלים גדולים של שפה יכולים לבצע משימות שפה רבות (שיחה, תרגום, כתיבה) מבלי להיות מתוכנתים במפורש לכל אחת מהן.

תכונות מרכזיות של מודלים גדולים של שפה כוללות:

- כמות עצומה של נתוני אימון: מודלים אלו מאומנים על מאגרי טקסט עצומים (מיליארדי עמודים). מאגר אימון "גדול" זה מעניק להם ידע רחב בדקדוק ועובדות.

- ארכיטקטורת טרנספורמר: הם משתמשים ברשתות עצביות מסוג טרנספורמר עם תשומת לב עצמית, כלומר כל מילה במשפט מושוות לכל מילה אחרת במקביל. זה מאפשר למודל ללמוד הקשר בצורה יעילה.

- מיליארדי פרמטרים: המודלים מכילים מיליוני או מיליארדי משקלים (פרמטרים). פרמטרים אלו לוכדים דפוסים מורכבים בשפה. לדוגמה, ל-GPT-3 יש 175 מיליארד פרמטרים.

- למידה ללא השגחה ישירה: מודלים אלו לומדים על ידי חיזוי מילים חסרות בטקסט ללא תוויות אנושיות. לדוגמה, במהלך האימון המודל מנסה לנחש את המילה הבאה במשפט. תהליך זה, החוזר על עצמו על כמויות עצומות של נתונים, מאפשר למודל להפנים דקדוק, עובדות ואפילו היגיון מסוים.

- כיוונון עדין והנחיות: לאחר האימון הראשוני, ניתן לכוונן את המודל למשימה ספציפית או להנחות אותו באמצעות פרומפטים. משמעות הדבר היא שהמודל יכול להתאים את עצמו למשימות חדשות כמו שאלות ותשובות רפואיות או כתיבה יצירתית על ידי התאמה עם מאגר נתונים קטן יותר או הוראות חכמות.

כל התכונות הללו מאפשרות למודל שפה גדול להבין וליצור טקסט בדומה לבני אדם. בפועל, מודל מאומן היטב יכול להסיק הקשר, להשלים משפטים ולספק תגובות שוטפות במגוון נושאים (משיחה יומיומית ועד נושאים טכניים) מבלי צורך בהנדסה ייעודית לכל משימה.

מודלים גדולים של שפה משתמשים בדרך כלל בארכיטקטורת רשת טרנספורמר. ארכיטקטורה זו היא רשת עצבית עמוקה עם שכבות רבות של צמתים מחוברים. מרכיב מרכזי הוא תשומת לב עצמית, המאפשרת למודל לשקלל את חשיבות כל מילה ביחס לכל המילים האחרות במשפט בו-זמנית.

בניגוד למודלים סדרתיים ישנים יותר (כמו RNN), טרנספורמרים מעבדים את כל הקלט במקביל, מה שמאפשר אימון מהיר יותר על GPUs. במהלך האימון, המודל מתאים את מיליארדי הפרמטרים שלו על ידי ניסיון לחזות כל מילה הבאה במאגר הטקסט העצום שלו.

עם הזמן, תהליך זה מלמד את המודל דקדוק ויחסים סמנטיים. התוצאה היא מודל שיכול, בהתבסס על פרומפט, ליצור שפה קוהרנטית ורלוונטית להקשר באופן עצמאי.

יישומים של מודלים גדולים של שפה

מכיוון שהם מבינים ויוצרים שפה טבעית, למודלים גדולים של שפה יש יישומים רבים בתעשיות שונות. כמה שימושים נפוצים הם:

- בינה מלאכותית שיחתית (צ'אטבוטים ועוזרים וירטואליים): מודלים אלו מפעילים צ'אטבוטים מתקדמים שיכולים לנהל שיחות פתוחות או לענות על שאלות. לדוגמה, עוזרים וירטואליים כמו בוטי תמיכה בלקוחות או כלים כמו סירי ואלקסה משתמשים ב-LLM כדי להבין שאילתות ולהגיב באופן טבעי.

- יצירת תוכן: הם יכולים לכתוב מיילים, מאמרים, טקסט שיווקי ואפילו שירה וקוד. לדוגמה, כאשר מקבלים פרומפט בנושא מסוים, ChatGPT (מבוסס על מודלי GPT) יכול לנסח מאמר או סיפור. חברות משתמשות ב-LLM לאוטומציה של כתיבת בלוגים, טקסטים פרסומיים ודוחות.

- תרגום וסיכום: מודלים אלו מתרגמים טקסט בין שפות ומסכמים מסמכים ארוכים. לאחר שראו דוגמאות מקבילות באימון, המודל יכול להפיק טקסט שוטף בשפה אחרת או לקצר דוח בן 20 עמודים לכמה פסקאות.

- מענה על שאלות: בהינתן שאלה, מודל שפה גדול יכול לספק תשובות עובדתיות או הסברים בהתבסס על הידע שלו. זה מפעיל ממשקי חיפוש שאלות ותשובות ומדריכים וירטואליים. מודלים בסגנון ChatGPT, למשל, יכולים לענות על טריוויה או להסביר מושגים בשפה פשוטה.

- יצירת קוד: חלק מהמודלים מתמחים בעבודה עם קוד. הם יכולים לכתוב קטעי קוד מתיאורים, למצוא באגים או לתרגם בין שפות תכנות. (GitHub Copilot משתמש ב-LLM מאומן על קוד כדי לסייע למפתחים.)

- מחקר וניתוח: הם מסייעים לחוקרים בהפקת תובנות ממאגרי טקסט גדולים, תיוג תוכן או ביצוע ניתוח סנטימנט על משוב לקוחות. בתחומים רבים, מודלים אלו מזרזים משימות כמו סקירת ספרות או ארגון נתונים על ידי הבנת תוכן המסמכים.

דוגמאות פופולריות למודלים גדולים של שפה כוללות את ChatGPT / GPT-4 (OpenAI), Bard (PaLM של גוגל), LLaMA (Meta), Claude (Anthropic), ו-Bing Chat (מבוסס GPT של מיקרוסופט). כל אחד מהמודלים הללו אומן על מאגרי נתונים עצומים וניתן לגשת אליהם דרך APIs או ממשקי אינטרנט.

לדוגמה, ל-GPT-3.5 ו-GPT-4 שמאחורי ChatGPT יש מאות מיליארדי פרמטרים, בעוד שמודלים של גוגל (PaLM ו-Gemini) ואחרים פועלים בדומה. מפתחים לרוב מתקשרים עם מודלים אלו דרך שירותי ענן או ספריות, ומותאמים למשימות ספציפיות כמו סיכום מסמכים או סיוע בקידוד.

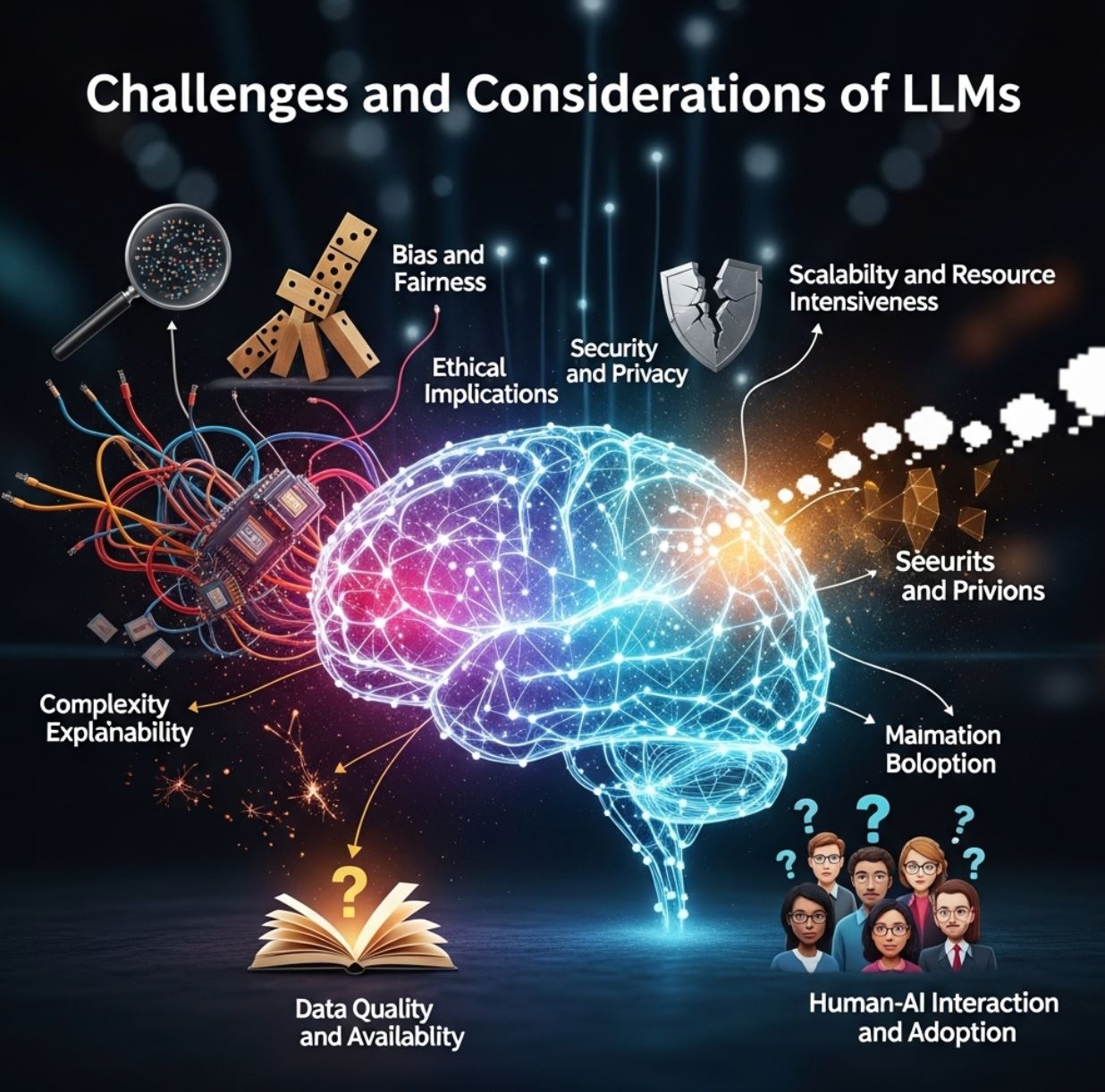

אתגרים ושיקולים

מודלים גדולים של שפה הם רבי עוצמה, אך אינם מושלמים. מכיוון שהם לומדים מטקסטים מהעולם האמיתי, הם עלולים לשכפל הטיות הקיימות בנתוני האימון שלהם. מודל שפה גדול עלול ליצור תוכן מוטה תרבותית, או להפיק שפה פוגענית או סטריאוטיפית אם לא מסננים אותו בקפידה.

בעיה נוספת היא הלוצינציות: המודל יכול לייצר תשובות שנשמעות שוטפות אך שגויות לחלוטין או מומצאות. לדוגמה, מודל עלול להמציא עובדה שגויה או שם בשקיפות. שגיאות אלו נובעות מכך שהמודל בעצם מנחש את ההמשך הסביר ביותר של הטקסט, ולא מאמת עובדות.

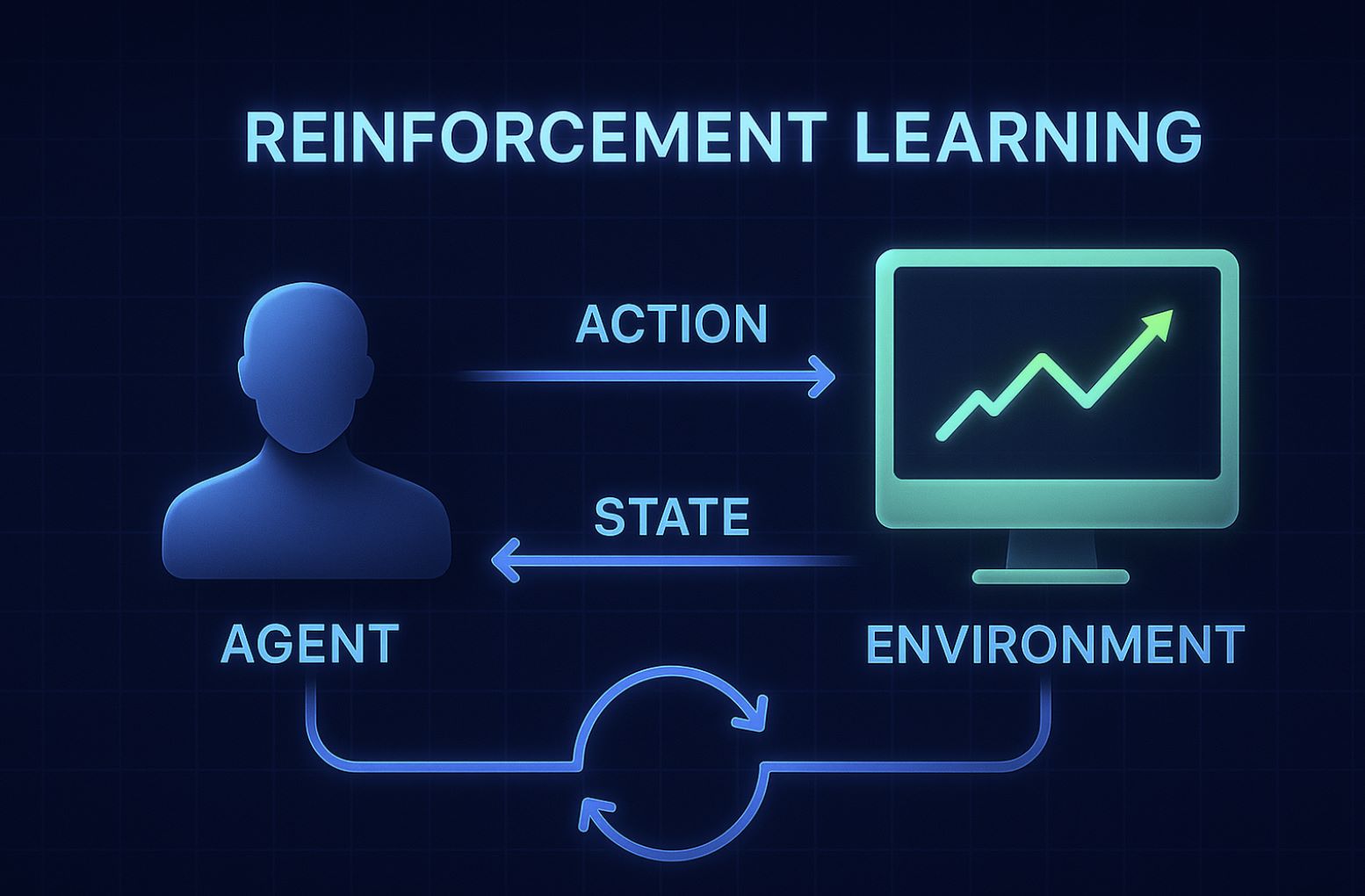

מפתחים מפחיתים בעיות אלו על ידי כיוונון עדין עם משוב אנושי, סינון פלטים, ושימוש בטכניקות כמו למידה מחוזקת עם דירוגים אנושיים.

עם זאת, משתמשי מודלים אלו חייבים להיות מודעים לכך שהתוצאות דורשות בדיקה לאימות ולזיהוי הטיות. בנוסף, אימון והפעלת מודלים גדולים דורשים משאבי חישוב עצומים (מעבדי GPU/TPU חזקים וכמויות גדולות של נתונים), מה שעלול להיות יקר.

>>>לחץ לצפייה:

לסיכום, מודל שפה גדול הוא מערכת בינה מלאכותית מבוססת טרנספורמר, המאומנת על כמויות עצומות של נתוני טקסט. הוא למד דפוסי שפה באמצעות אימון ללא השגחה ישירה, מה שמאפשר לו ליצור טקסט שוטף ורלוונטי להקשר. בשל היקפו, מודלים אלו מסוגלים להתמודד עם מגוון רחב של משימות שפה – משיחה וכתיבה ועד תרגום וקידוד – לעיתים ברמת שפה השווה או עולה על זו של בני אדם.

כפי שמסכמים חוקרי בינה מלאכותית מובילים, מודלים אלו עתידים לעצב מחדש את האופן שבו אנו מתקשרים עם טכנולוגיה וניגשים למידע. נכון ל-2025, מודלים גדולים ממשיכים להתפתח (כולל הרחבות מולטימודליות המטפלות בתמונות או קול) ונשארים בחזית החדשנות בבינה מלאכותית, מה שהופך אותם לרכיב מרכזי ביישומי AI מודרניים.

עקבו אחרי INVIAI לעדכונים נוספים ומידע שימושי!