বড় ভাষা মডেল (LLM) হল কৃত্রিম বুদ্ধিমত্তা সিস্টেম যা বিশাল টেক্সট ডেটাসেটে প্রশিক্ষিত হয়ে মানুষের মতো ভাষা বোঝা এবং তৈরি করতে সক্ষম। সহজ কথায়, একটি LLM-কে মিলিয়ন বা বিলিয়ন শব্দ (সাধারণত ইন্টারনেট থেকে) খাওয়ানো হয়েছে যাতে এটি প্রসঙ্গ অনুযায়ী টেক্সট পূর্বাভাস দিতে এবং তৈরি করতে পারে। এই মডেলগুলো সাধারণত ডিপ লার্নিং নিউরাল নেটওয়ার্কের উপর ভিত্তি করে তৈরি – সবচেয়ে প্রচলিত হল ট্রান্সফরমার আর্কিটেকচার। তাদের আকারের কারণে, LLM গুলো অনেক ভাষাগত কাজ (চ্যাট, অনুবাদ, লেখালেখি) স্পষ্টভাবে প্রোগ্রাম না করেও করতে পারে।

বড় ভাষা মডেলের প্রধান বৈশিষ্ট্যগুলো হল:

- বিশাল প্রশিক্ষণ ডেটা: LLM গুলো বিশাল টেক্সট কর্পাস (বিলিয়ন পৃষ্ঠা) দিয়ে প্রশিক্ষিত। এই “বড়” প্রশিক্ষণ সেট তাদের ব্যাকরণ এবং তথ্যের ব্যাপক জ্ঞান দেয়।

- ট্রান্সফরমার আর্কিটেকচার: তারা ট্রান্সফরমার নিউরাল নেটওয়ার্ক ব্যবহার করে যার মধ্যে রয়েছে সেলফ-অ্যাটেনশন, অর্থাৎ একটি বাক্যের প্রতিটি শব্দ অন্য সব শব্দের সাথে সমান্তরালে তুলনা করা হয়। এটি মডেলকে প্রসঙ্গ দক্ষতার সাথে শিখতে সাহায্য করে।

- বিলিয়ন বিলিয়ন প্যারামিটার: মডেলগুলোতে কোটি কোটি ওজন (প্যারামিটার) থাকে। এই প্যারামিটারগুলো ভাষার জটিল প্যাটার্ন ধারণ করে। উদাহরণস্বরূপ, GPT-3 এর ১৭৫ বিলিয়ন প্যারামিটার রয়েছে।

- সেলফ-সুপারভাইজড লার্নিং: LLM গুলো মানুষের লেবেল ছাড়াই টেক্সটের অনুপস্থিত শব্দ পূর্বাভাস দিয়ে শিখে। উদাহরণস্বরূপ, প্রশিক্ষণের সময় মডেলটি একটি বাক্যের পরবর্তী শব্দ অনুমান করার চেষ্টা করে। এই প্রক্রিয়া বারবার বিশাল ডেটায় চালিয়ে মডেল ব্যাকরণ, তথ্য এবং কিছু যুক্তি অন্তর্ভুক্ত করে।

- ফাইন-টিউনিং এবং প্রম্পটিং: প্রি-ট্রেনিংয়ের পরে, LLM গুলো নির্দিষ্ট কাজের জন্য ফাইন-টিউন করা যায় বা প্রম্পটের মাধ্যমে নির্দেশনা দেওয়া যায়। এর ফলে একই মডেল চিকিৎসা প্রশ্নোত্তর বা সৃজনশীল লেখালেখির মতো নতুন কাজের সাথে মানিয়ে নিতে পারে ছোট ডেটাসেট বা বুদ্ধিমত্তাপূর্ণ নির্দেশনা ব্যবহার করে।

এই বৈশিষ্ট্যগুলো মিলিয়ে একটি LLM মানুষের মতো টেক্সট বোঝা এবং তৈরি করতে পারে। বাস্তবে, একটি ভাল প্রশিক্ষিত LLM প্রসঙ্গ অনুমান করতে পারে, বাক্য সম্পূর্ণ করতে পারে এবং বিভিন্ন বিষয়ের উপর সাবলীল উত্তর দিতে পারে (সাধারণ চ্যাট থেকে প্রযুক্তিগত বিষয় পর্যন্ত) যেকোনো নির্দিষ্ট কাজের জন্য আলাদা প্রোগ্রামিং ছাড়াই।

LLM গুলো সাধারণত ট্রান্সফরমার নেটওয়ার্ক আর্কিটেকচার ব্যবহার করে। এই আর্কিটেকচার একটি গভীর নিউরাল নেটওয়ার্ক যার অনেক স্তরের সংযুক্ত নোড থাকে। এর একটি মূল উপাদান হল সেলফ-অ্যাটেনশন, যা মডেলকে একসঙ্গে একটি বাক্যের প্রতিটি শব্দের গুরুত্ব নির্ধারণ করতে দেয়।

পুরনো সিকুয়েন্সিয়াল মডেল (যেমন RNN) থেকে ভিন্ন, ট্রান্সফরমার পুরো ইনপুট একসঙ্গে প্রক্রিয়াকরণ করে, যা GPU তে দ্রুত প্রশিক্ষণ সম্ভব করে। প্রশিক্ষণের সময়, LLM তার বিলিয়ন বিলিয়ন প্যারামিটার সামঞ্জস্য করে প্রতিটি পরবর্তী শব্দ পূর্বাভাস দেওয়ার চেষ্টা করে।

সময়ের সাথে, এই প্রক্রিয়া মডেলকে ব্যাকরণ এবং অর্থগত সম্পর্ক শেখায়। ফলস্বরূপ, একটি প্রম্পট দেওয়া হলে মডেল স্বয়ংক্রিয়ভাবে সঙ্গতিপূর্ণ, প্রসঙ্গানুযায়ী প্রাসঙ্গিক ভাষা তৈরি করতে পারে।

LLM এর ব্যবহার

কারণ তারা প্রাকৃতিক ভাষা বোঝে এবং তৈরি করে, LLM গুলো বিভিন্ন শিল্পে বহুমুখী ব্যবহার পায়। কিছু সাধারণ ব্যবহার হল:

- কথোপকথনমূলক AI (চ্যাটবট এবং সহকারী): LLM গুলো উন্নত চ্যাটবট চালায় যা মুক্ত আলোচনা চালাতে বা প্রশ্নের উত্তর দিতে পারে। উদাহরণস্বরূপ, গ্রাহক সহায়তা বট বা সিরি ও আলেক্সার মতো ভার্চুয়াল সহকারী LLM ব্যবহার করে প্রশ্ন বুঝে প্রাকৃতিকভাবে উত্তর দেয়।

- বিষয়বস্তু সৃষ্টিঃ তারা ইমেইল, নিবন্ধ, বিপণন কপি, এমনকি কবিতা ও কোডও লিখতে পারে। উদাহরণস্বরূপ, একটি বিষয় প্রম্পট পেলে ChatGPT (GPT মডেলের উপর ভিত্তি করে) একটি প্রবন্ধ বা গল্প রচনা করতে পারে। কোম্পানিগুলো ব্লগ লেখা, বিজ্ঞাপন কপি এবং রিপোর্ট তৈরিতে LLM ব্যবহার করে স্বয়ংক্রিয়তা আনে।

- অনুবাদ এবং সারাংশ: LLM গুলো ভাষার মধ্যে টেক্সট অনুবাদ করে এবং দীর্ঘ নথি সংক্ষিপ্ত করে। প্রশিক্ষণে সমান্তরাল উদাহরণ দেখে, একটি মডেল অন্য ভাষায় সাবলীল টেক্সট তৈরি করতে পারে বা ২০ পৃষ্ঠার রিপোর্ট কয়েকটি অনুচ্ছেদে সংকুচিত করতে পারে।

- প্রশ্নোত্তর: প্রশ্ন পেলে, একটি LLM তার জ্ঞানের ভিত্তিতে তথ্যপূর্ণ উত্তর বা ব্যাখ্যা দিতে পারে। এটি Q&A সার্চ ইন্টারফেস এবং ভার্চুয়াল টিউটর চালায়। ChatGPT-শৈলীর মডেলগুলো, উদাহরণস্বরূপ, ট্রিভিয়া উত্তর দিতে বা সহজ ভাষায় ধারণা ব্যাখ্যা করতে পারে।

- কোড সৃষ্টিঃ কিছু LLM কোডের জন্য বিশেষায়িত। তারা বর্ণনা থেকে কোড স্নিপেট লিখতে পারে, বাগ খুঁজে পেতে পারে বা প্রোগ্রামিং ভাষার মধ্যে অনুবাদ করতে পারে। (GitHub Copilot কোডে প্রশিক্ষিত LLM ব্যবহার করে ডেভেলপারদের সহায়তা করে।)

- গবেষণা এবং বিশ্লেষণ: তারা গবেষকদের বড় টেক্সট ডেটাসেট থেকে অন্তর্দৃষ্টি আহরণ, বিষয়বস্তু ট্যাগিং বা গ্রাহক প্রতিক্রিয়ার অনুভূতি বিশ্লেষণে সাহায্য করে। অনেক ক্ষেত্রে, LLM গুলো সাহিত্য পর্যালোচনা বা ডেটা সংগঠনের মতো কাজ দ্রুততর করে কারণ তারা নথির বিষয়বস্তু বুঝতে পারে।

বড় ভাষা মডেলের জনপ্রিয় উদাহরণগুলোর মধ্যে রয়েছে ChatGPT / GPT-4 (OpenAI), Bard (Google-এর PaLM), LLaMA (Meta), Claude (Anthropic), এবং Bing Chat (Microsoft-এর GPT-ভিত্তিক)। প্রতিটি মডেল বিশাল ডেটাসেটে প্রশিক্ষিত এবং API বা ওয়েব ইন্টারফেসের মাধ্যমে অ্যাক্সেসযোগ্য।

উদাহরণস্বরূপ, ChatGPT-র পেছনে থাকা GPT-3.5 এবং GPT-4 এর শত শত বিলিয়ন প্যারামিটার রয়েছে, যেখানে Google-এর মডেল (PaLM এবং Gemini) এবং অন্যান্য মডেল একইভাবে কাজ করে। ডেভেলপাররা প্রায়শই ক্লাউড সার্ভিস বা লাইব্রেরির মাধ্যমে এই LLM গুলোর সাথে ইন্টারঅ্যাক্ট করে, নির্দিষ্ট কাজ যেমন নথি সারাংশ বা কোডিং সহায়তার জন্য কাস্টমাইজ করে।

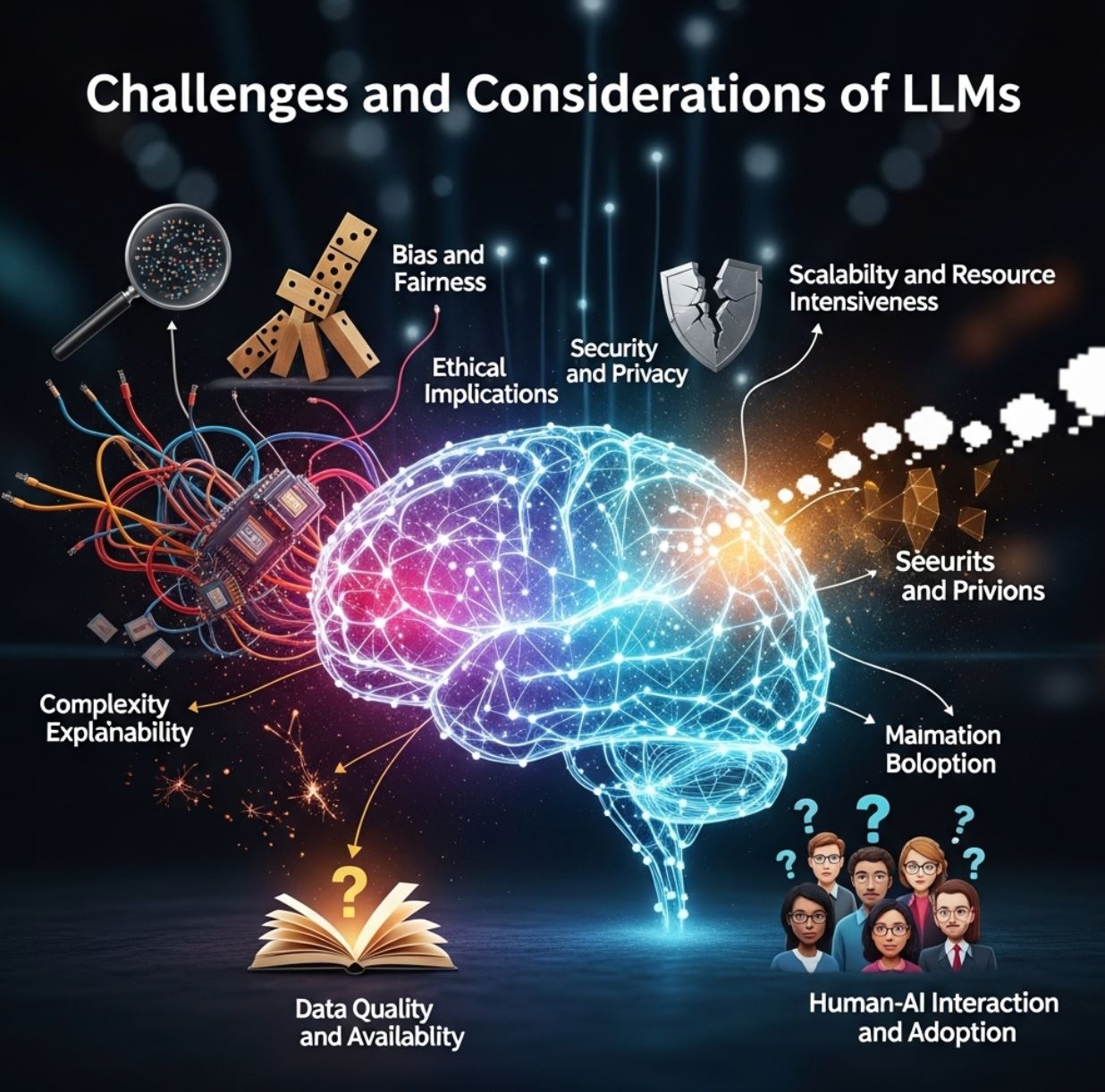

চ্যালেঞ্জ এবং বিবেচ্য বিষয়

LLM গুলো শক্তিশালী হলেও নিখুঁত নয়। তারা বাস্তব বিশ্বের টেক্সট থেকে শেখে, তাই তাদের প্রশিক্ষণ ডেটায় থাকা পক্ষপাত প্রতিফলিত হতে পারে। একটি LLM সাংস্কৃতিক পক্ষপাতপূর্ণ বিষয়বস্তু তৈরি করতে পারে, অথবা সতর্কতার সাথে ফিল্টার না করলে আপত্তিকর বা স্টেরিওটাইপিক ভাষা ব্যবহার করতে পারে।

আরেকটি সমস্যা হল হ্যালুসিনেশন: মডেল এমন সাবলীল উত্তর তৈরি করতে পারে যা সম্পূর্ণ ভুল বা কাল্পনিক। উদাহরণস্বরূপ, একটি LLM আত্মবিশ্বাসের সাথে মিথ্যা তথ্য বা নাম উদ্ভাবন করতে পারে। এই ভুলগুলো ঘটে কারণ মডেল মূলত টেক্সটের সবচেয়ে সম্ভাব্য ধারাবাহিকতা অনুমান করে, তথ্য যাচাই করে না।

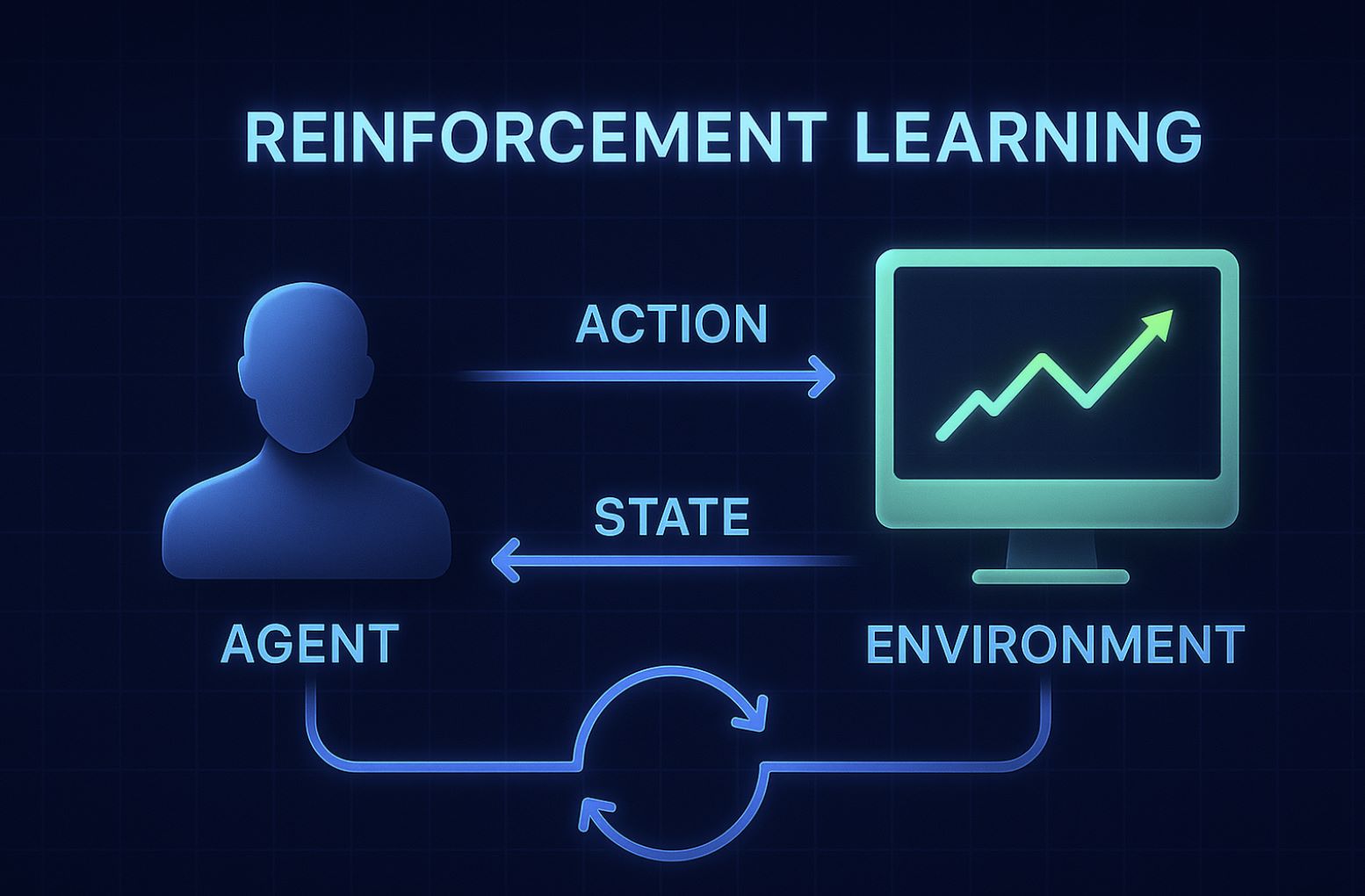

ডেভেলপাররা এই সমস্যাগুলো কমাতে মানব প্রতিক্রিয়া দিয়ে ফাইন-টিউনিং, আউটপুট ফিল্টারিং এবং মানব রেটিং থেকে রিইনফোর্সমেন্ট লার্নিংয়ের মতো কৌশল ব্যবহার করে।

তবুও, LLM ব্যবহারকারীদের অবশ্যই ফলাফল সঠিকতা এবং পক্ষপাতের জন্য যাচাই করতে হবে। এছাড়া, LLM প্রশিক্ষণ এবং চালানোতে প্রচুর কম্পিউটিং রিসোর্স (শক্তিশালী GPU/TPU এবং বিশাল ডেটা) লাগে, যা ব্যয়বহুল হতে পারে।

>>>দেখতে ক্লিক করুন:

ন্যাচারাল ল্যাঙ্গুয়েজ প্রসেসিং কী?

সংক্ষেপে, একটি বড় ভাষা মডেল হল ট্রান্সফরমার-ভিত্তিক AI সিস্টেম যা বিশাল পরিমাণ টেক্সট ডেটা দিয়ে প্রশিক্ষিত। এটি সেলফ-সুপারভাইজড প্রশিক্ষণের মাধ্যমে ভাষার প্যাটার্ন শিখেছে, যার ফলে সাবলীল এবং প্রসঙ্গানুযায়ী প্রাসঙ্গিক টেক্সট তৈরি করতে সক্ষম। তাদের আকারের কারণে, LLM গুলো ভাষাগত বিভিন্ন কাজ – চ্যাটিং, লেখালেখি, অনুবাদ এবং কোডিং – দক্ষতার সাথে করতে পারে, প্রায়শই মানুষের দক্ষতার সমতুল্য বা তারও বেশি।

প্রধান AI গবেষকদের সারাংশ অনুযায়ী, এই মডেলগুলো প্রযুক্তির সাথে আমাদের যোগাযোগ এবং তথ্য প্রাপ্তির পদ্ধতি পুনর্গঠন করার পথে রয়েছে। ২০২৫ সালের মধ্যে, LLM গুলো উন্নত হচ্ছে (মাল্টিমোডাল এক্সটেনশনসহ যা ছবি বা অডিও পরিচালনা করে) এবং AI উদ্ভাবনের শীর্ষে রয়েছে, যা আধুনিক AI অ্যাপ্লিকেশনের একটি কেন্দ্রীয় উপাদান।

আরও দরকারী তথ্যের জন্য INVIAI-কে অনুসরণ করুন!