Büyük Dil Modelleri (LLM’ler), insan benzeri dili anlamak ve üretmek için devasa metin veri setleri üzerinde eğitilmiş yapay zeka sistemleridir. Basitçe ifade etmek gerekirse, bir LLM, bağlam içinde metin tahmin edip üretebilmesi için milyonlarca ya da milyarlarca kelimeyle (çoğunlukla İnternet’ten) beslenmiştir. Bu modeller genellikle derin öğrenme sinir ağları üzerine inşa edilir – en yaygın olarak transformer mimarisi kullanılır. Ölçekleri nedeniyle, LLM’ler her biri için özel programlama yapılmadan birçok dil görevini (sohbet, çeviri, yazma) yerine getirebilir.

Büyük dil modellerinin temel özellikleri şunlardır:

- Devasa eğitim verisi: LLM’ler milyarlarca sayfadan oluşan geniş metin korpusları üzerinde eğitilir. Bu “büyük” eğitim seti, onlara geniş bir dilbilgisi ve bilgi birikimi sağlar.

- Transformer mimarisi: Self-attention (öz-dikkat) mekanizmasına sahip transformer sinir ağları kullanırlar; bu, bir cümledeki her kelimenin diğer tüm kelimelerle paralel olarak karşılaştırılması anlamına gelir. Bu sayede model bağlamı verimli şekilde öğrenir.

- Milyarlarca parametre: Modeller milyonlarca ya da milyarlarca ağırlık (parametre) içerir. Bu parametreler dildeki karmaşık örüntüleri yakalar. Örneğin, GPT-3’ün 175 milyar parametresi vardır.

- Öz-denetimli öğrenme: LLM’ler, insan etiketleri olmadan metindeki eksik kelimeleri tahmin ederek öğrenir. Örneğin, eğitim sırasında model bir cümledeki sonraki kelimeyi tahmin etmeye çalışır. Bu işlem devasa veriler üzerinde tekrarlandıkça, model dilbilgisini, gerçekleri ve hatta bazı mantıksal çıkarımları içselleştirir.

- İnce ayar ve yönlendirme: Ön eğitimden sonra, LLM’ler belirli bir görev için ince ayar yapılabilir veya komutlarla yönlendirilebilir. Bu, aynı modelin tıbbi soru-cevap veya yaratıcı yazarlık gibi yeni görevlere küçük bir veri seti veya akıllı talimatlarla uyum sağlamasını mümkün kılar.

Bu özellikler sayesinde bir LLM, insan gibi metin anlayabilir ve üretebilir. Pratikte, iyi eğitilmiş bir LLM bağlamı çıkarabilir, cümleleri tamamlayabilir ve birçok konuda (gündelik sohbetten teknik konulara kadar) akıcı yanıtlar verebilir; bunun için her görev için özel mühendislik gerekmez.

LLM’ler genellikle transformer ağ mimarisini kullanır. Bu mimari, çok katmanlı ve birbirine bağlı düğümlerden oluşan derin bir sinir ağıdır. Ana bileşenlerden biri olan öz-dikkat, modelin bir cümledeki her kelimenin diğerlerine göre önemini aynı anda değerlendirmesini sağlar.

Eski sıralı modellerin (RNN gibi) aksine, transformer’lar tüm girdiyi paralel işler, bu da GPU’larda çok daha hızlı eğitim imkanı sunar. Eğitim sırasında LLM, devasa metin korpusundaki her sonraki kelimeyi tahmin etmeye çalışarak milyarlarca parametresini ayarlar.

Zamanla bu süreç, modele dilbilgisi ve anlamsal ilişkileri öğretir. Sonuç olarak, verilen bir komutla tutarlı ve bağlama uygun dil üretebilen bir model ortaya çıkar.

LLM’lerin Uygulamaları

Doğal dili anlayıp üretebildikleri için, LLM’ler birçok sektörde çeşitli uygulamalara sahiptir. Yaygın kullanımlardan bazıları şunlardır:

- Konuşma yapay zekası (Sohbet botları ve Asistanlar): LLM’ler, açık uçlu sohbetler yapabilen veya soruları yanıtlayabilen gelişmiş sohbet botlarını destekler. Örneğin, müşteri destek botları veya Siri ve Alexa gibi sanal asistanlar, sorguları anlayıp doğal yanıtlar vermek için LLM’leri kullanır.

- İçerik Üretimi: E-posta, makale, pazarlama metni, hatta şiir ve kod yazabilirler. Örneğin, bir konu verildiğinde ChatGPT (GPT modellerine dayalı) bir makale veya hikaye taslağı oluşturabilir. Şirketler, blog yazımı, reklam metni ve rapor üretimini otomatikleştirmek için LLM’lerden yararlanır.

- Çeviri ve Özetleme: LLM’ler metinleri diller arasında çevirir ve uzun belgeleri özetler. Eğitim sırasında paralel örnekler gördükleri için, bir model başka bir dilde akıcı metin üretebilir veya 20 sayfalık bir raporu birkaç paragrafta özetleyebilir.

- Soru Yanıtlama: Bir soru verildiğinde, LLM bilgisine dayanarak gerçekçi yanıtlar veya açıklamalar sunabilir. Bu, soru-cevap arayüzleri ve sanal öğretmenler için temel oluşturur. ChatGPT tarzı modeller, örneğin, genel kültür sorularını yanıtlayabilir veya kavramları sade bir dille açıklayabilir.

- Kod Üretimi: Bazı LLM’ler kodla çalışmak üzere özelleştirilmiştir. Açıklamalardan kod parçacıkları yazabilir, hataları bulabilir veya programlama dilleri arasında çeviri yapabilirler. (GitHub Copilot, geliştiricilere yardımcı olmak için kod üzerinde eğitilmiş bir LLM kullanır.)

- Araştırma ve Analiz: Büyük metin veri setlerinden içgörü çıkarma, içerik etiketleme veya müşteri geri bildirimlerinde duygu analizi yapma gibi görevlerde araştırmacılara destek olur. Birçok alanda, LLM’ler literatür taraması veya veri organizasyonu gibi işleri hızlandırır.

Popüler büyük dil modelleri arasında ChatGPT / GPT-4 (OpenAI), Bard (Google’ın PaLM’i), LLaMA (Meta), Claude (Anthropic) ve Bing Chat (Microsoft’un GPT tabanlı modeli) bulunur. Bu modeller devasa veri setleri üzerinde eğitilmiş olup API’ler veya web arayüzleri aracılığıyla erişilebilir.

Örneğin, ChatGPT’nin arkasındaki GPT-3.5 ve GPT-4 yüzlerce milyar parametreye sahiptir; Google’ın modelleri (PaLM ve Gemini) ve diğerleri benzer şekilde çalışır. Geliştiriciler, bu LLM’lerle bulut hizmetleri veya kütüphaneler aracılığıyla etkileşim kurar, belge özetleme veya kodlama yardımı gibi belirli görevler için özelleştirir.

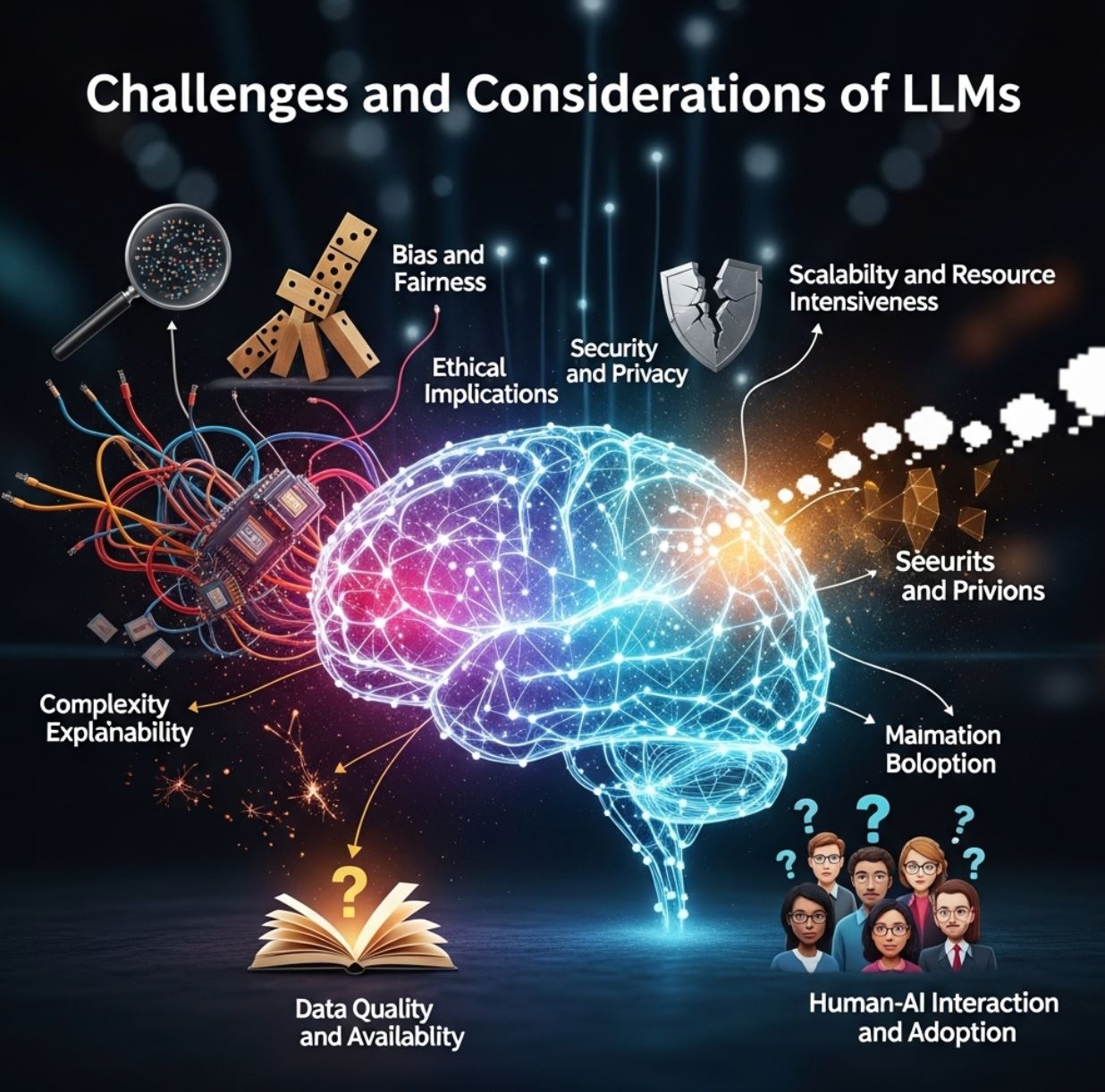

Zorluklar ve Dikkat Edilmesi Gerekenler

LLM’ler güçlüdür ancak kusursuz değildir. Gerçek dünya metinlerinden öğrendikleri için, eğitim verilerindeki önyargıları yansıtabilirler. Bir LLM, kültürel olarak önyargılı içerik üretebilir veya dikkatli filtrelenmezse saldırgan ya da klişeleşmiş dil kullanabilir.

Bir diğer sorun ise halüsinasyonlar: Model, tamamen yanlış veya uydurma ama akıcı görünen yanıtlar üretebilir. Örneğin, bir LLM yanlış bir gerçeği ya da ismi kendinden emin bir şekilde uydurabilir. Bu hatalar, modelin metnin en olası devamını tahmin etmesinden kaynaklanır; gerçekleri doğrulamaz.

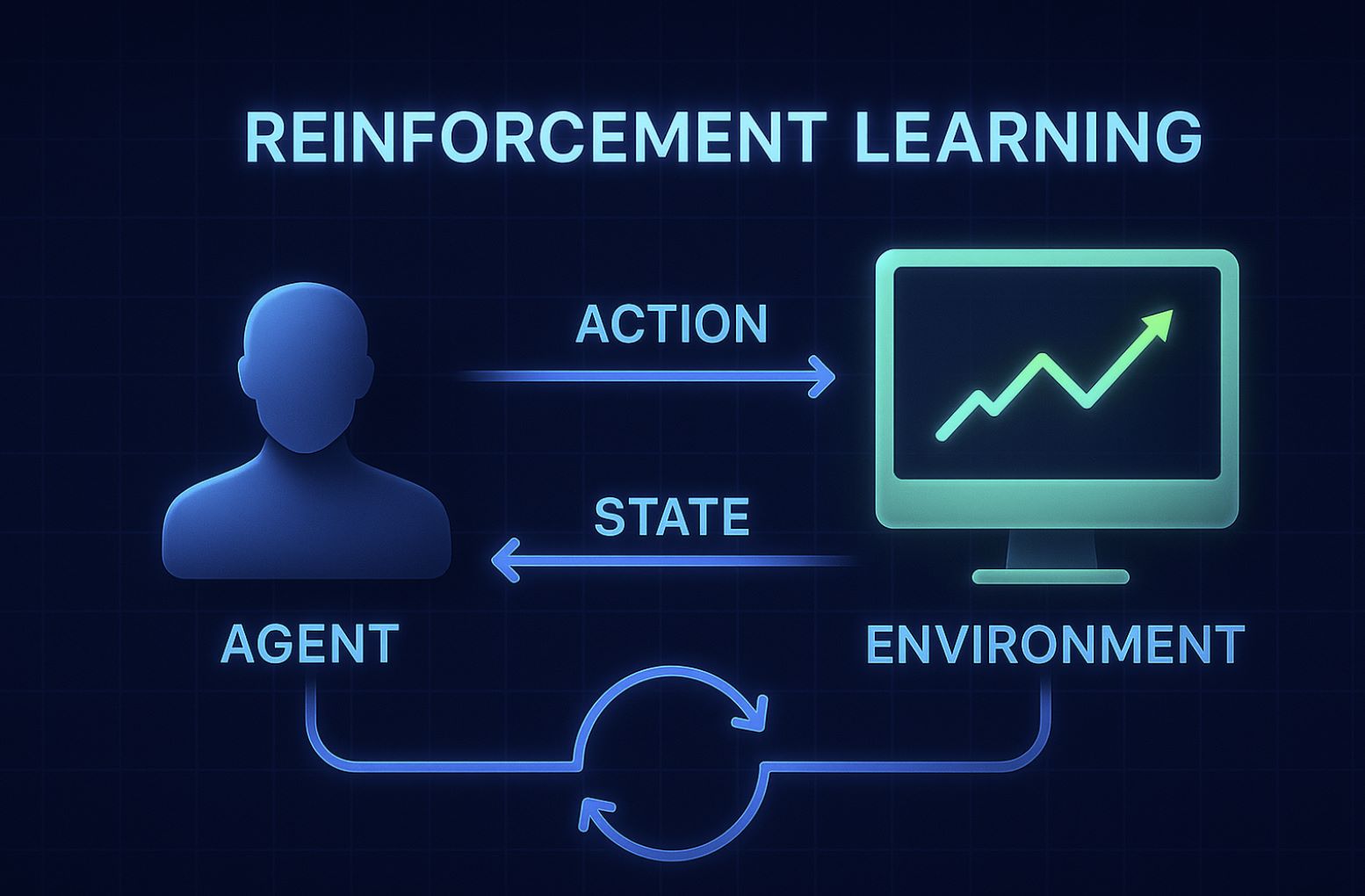

Geliştiriciler, insan geri bildirimiyle ince ayar yaparak, çıktıları filtreleyerek ve insan değerlendirmelerine dayalı pekiştirmeli öğrenme gibi teknikler uygulayarak bu sorunları azaltır.

Yine de, LLM kullanıcılarının sonuçları doğruluk ve önyargı açısından kontrol etmeleri gerekir. Ayrıca, LLM’lerin eğitimi ve çalıştırılması büyük hesaplama kaynakları (güçlü GPU/TPU’lar ve çok veri) gerektirir ve maliyetli olabilir.

>>>İncelemek için tıklayın:

Özetle, büyük dil modeli, devasa metin verileri üzerinde eğitilmiş transformer tabanlı bir yapay zeka sistemidir. Öz-denetimli eğitimle dil örüntülerini öğrenmiş olup, akıcı ve bağlama uygun metin üretme yeteneğine sahiptir. Ölçekleri sayesinde, sohbetten yazmaya, çeviriden kodlamaya kadar geniş bir dil görev yelpazesini insan seviyesinde veya daha iyi şekilde yerine getirebilirler.

Önde gelen yapay zeka araştırmacılarının özetlediği gibi, bu modeller teknolojiyle etkileşimimizi ve bilgiye erişimimizi yeniden şekillendirmeye adaydır. 2025 itibarıyla, LLM’ler (görüntü veya ses işleyebilen çok modlu uzantılar dahil) gelişmeye devam etmekte ve yapay zeka yeniliklerinin ön saflarında yer almakta, modern yapay zeka uygulamalarının merkez bileşeni olmaktadır.

Daha faydalı bilgiler için INVIAI’yi takip edin!