โมเดลภาษาขนาดใหญ่ (LLMs) คือ ระบบปัญญาประดิษฐ์ ที่ได้รับการฝึกฝนด้วยชุดข้อมูลข้อความจำนวนมหาศาลเพื่อให้เข้าใจและสร้างภาษาที่เหมือนมนุษย์ กล่าวง่ายๆ คือ LLM ได้รับการป้อนข้อมูล คำหลายล้านหรือหลายพันล้านคำ (ส่วนใหญ่จากอินเทอร์เน็ต) เพื่อให้สามารถทำนายและสร้างข้อความตามบริบทได้ โมเดลเหล่านี้มักสร้างขึ้นบนเครือข่ายประสาทเทียมแบบ เรียนรู้เชิงลึก โดยทั่วไปใช้สถาปัตยกรรม ทรานส์ฟอร์เมอร์ เป็นหลัก ด้วยขนาดที่ใหญ่ โมเดลภาษาขนาดใหญ่จึงสามารถทำงานด้านภาษาหลายอย่างได้ (เช่น การสนทนา การแปล การเขียน) โดยไม่ต้องเขียนโปรแกรมเฉพาะสำหรับแต่ละงาน

คุณสมบัติสำคัญของโมเดลภาษาขนาดใหญ่ ได้แก่:

- ข้อมูลฝึกอบรมจำนวนมหาศาล: LLMs ได้รับการฝึกด้วยชุดข้อมูลข้อความขนาดใหญ่ (หลายพันล้านหน้า) ซึ่งชุดข้อมูลขนาด “ใหญ่” นี้ช่วยให้โมเดลมีความรู้กว้างขวางทั้งด้านไวยากรณ์และข้อเท็จจริง

- สถาปัตยกรรมทรานส์ฟอร์เมอร์: โมเดลใช้เครือข่ายประสาททรานส์ฟอร์เมอร์ที่มี self-attention ซึ่งหมายความว่าคำแต่ละคำในประโยคจะถูกเปรียบเทียบกับคำอื่นๆ พร้อมกันทั้งหมด ทำให้โมเดลเรียนรู้บริบทได้อย่างมีประสิทธิภาพ

- พารามิเตอร์นับพันล้าน: โมเดลประกอบด้วยน้ำหนัก (พารามิเตอร์) หลายล้านถึงพันล้านพารามิเตอร์ ซึ่งพารามิเตอร์เหล่านี้จับรูปแบบที่ซับซ้อนในภาษา เช่น GPT-3 มีพารามิเตอร์ถึง 175 พันล้านตัว

- การเรียนรู้แบบไม่ต้องมีผู้สอน: LLMs เรียนรู้โดยการทำนายคำที่ขาดหายไปในข้อความโดยไม่ต้องใช้ป้ายกำกับจากมนุษย์ เช่น ในระหว่างการฝึก โมเดลจะพยายามทายคำถัดไปในประโยค การทำซ้ำแบบนี้กับข้อมูลจำนวนมหาศาลช่วยให้โมเดลเข้าใจไวยากรณ์ ข้อเท็จจริง และแม้แต่เหตุผลบางอย่าง

- การปรับแต่งและการใช้คำสั่ง: หลังจากการฝึกเบื้องต้น LLMs สามารถปรับแต่งเพื่อทำงานเฉพาะด้าน หรือถูกชี้นำด้วยคำสั่งพิเศษ ซึ่งหมายความว่าโมเดลเดียวกันนี้สามารถปรับใช้กับงานใหม่ๆ เช่น การตอบคำถามทางการแพทย์ หรือการเขียนเชิงสร้างสรรค์ โดยใช้ชุดข้อมูลขนาดเล็กหรือคำแนะนำที่ชาญฉลาด

คุณสมบัติเหล่านี้ช่วยให้ LLM เข้าใจและสร้างข้อความได้เหมือนมนุษย์ ในทางปฏิบัติ โมเดลที่ได้รับการฝึกอย่างดีสามารถตีความบริบท เติมประโยค และสร้างคำตอบที่ลื่นไหลในหัวข้อต่างๆ (ตั้งแต่การสนทนาทั่วไปจนถึงเรื่องเทคนิค) โดยไม่ต้องเขียนโปรแกรมเฉพาะสำหรับแต่ละงาน

LLMs มักใช้สถาปัตยกรรมเครือข่ายทรานส์ฟอร์เมอร์ ซึ่งเป็นเครือข่ายประสาทลึกที่มีหลายชั้นของโหนดเชื่อมต่อกัน ส่วนประกอบสำคัญคือ self-attention ที่ช่วยให้โมเดลประเมินความสำคัญของแต่ละคำเทียบกับคำอื่นๆ ในประโยคพร้อมกัน

แตกต่างจากโมเดลแบบลำดับก่อนหน้า (เช่น RNNs) ทรานส์ฟอร์เมอร์ประมวลผลข้อมูลทั้งหมดพร้อมกัน ทำให้การฝึกทำได้รวดเร็วขึ้นบน GPU ในระหว่างการฝึก LLM จะปรับพารามิเตอร์นับพันล้านตัวโดยพยายามทำนายคำถัดไปในชุดข้อมูลข้อความขนาดใหญ่

เมื่อเวลาผ่านไป กระบวนการนี้ช่วยให้โมเดลเรียนรู้ไวยากรณ์และความสัมพันธ์เชิงความหมาย ผลลัพธ์คือโมเดลที่เมื่อได้รับคำสั่ง สามารถสร้างภาษาที่สอดคล้องและเหมาะสมกับบริบทได้ด้วยตนเอง

การใช้งานของ LLMs

เนื่องจาก LLMs เข้าใจและสร้างภาษาธรรมชาติได้ จึงมีการใช้งานในหลายอุตสาหกรรม ตัวอย่างการใช้งานที่พบบ่อยได้แก่:

- ปัญญาประดิษฐ์สำหรับการสนทนา (แชทบอทและผู้ช่วย): LLMs ขับเคลื่อนแชทบอทขั้นสูงที่สามารถสนทนาแบบเปิดกว้างหรือให้คำตอบได้ เช่น ผู้ช่วยเสมือนอย่างบอทบริการลูกค้าหรือเครื่องมืออย่าง Siri และ Alexa ใช้ LLMs เพื่อเข้าใจคำถามและตอบกลับอย่างเป็นธรรมชาติ

- การสร้างเนื้อหา: โมเดลเหล่านี้สามารถเขียนอีเมล บทความ ข้อความโฆษณา หรือแม้แต่บทกวีและโค้ด เช่น เมื่อได้รับหัวข้อ ChatGPT (ซึ่งพัฒนาบนโมเดล GPT) สามารถร่างเรียงความหรือเรื่องราวได้ บริษัทต่างๆ ใช้ LLMs เพื่อทำงานเขียนบล็อก โฆษณา และรายงานโดยอัตโนมัติ

- การแปลและสรุป: LLMs สามารถแปลข้อความระหว่างภาษาและสรุปเอกสารยาวๆ ได้ เนื่องจากเคยเห็นตัวอย่างคู่ขนานในระหว่างการฝึก โมเดลจึงสามารถสร้างข้อความที่ลื่นไหลในภาษาอื่นหรือย่อรายงาน 20 หน้าให้เหลือเพียงไม่กี่ย่อหน้า

- การตอบคำถาม: เมื่อได้รับคำถาม LLM สามารถให้คำตอบที่เป็นข้อเท็จจริงหรือคำอธิบายตามความรู้ที่มี ซึ่งช่วยขับเคลื่อนอินเทอร์เฟซค้นหาแบบถามตอบและติวเตอร์เสมือน เช่น โมเดลสไตล์ ChatGPT สามารถตอบคำถามทั่วไปหรืออธิบายแนวคิดด้วยภาษาง่ายๆ

- การสร้างโค้ด: บาง LLM ถูกออกแบบเฉพาะสำหรับการทำงานกับโค้ด สามารถเขียนโค้ดจากคำอธิบาย ค้นหาข้อผิดพลาด หรือแปลระหว่างภาษาโปรแกรม (GitHub Copilot ใช้ LLM ที่ฝึกด้วยโค้ดเพื่อช่วยนักพัฒนา)

- การวิจัยและวิเคราะห์: ช่วยนักวิจัยโดยการสกัดข้อมูลเชิงลึกจากชุดข้อมูลข้อความขนาดใหญ่ การติดแท็กเนื้อหา หรือวิเคราะห์ความรู้สึกจากความคิดเห็นลูกค้า ในหลายสาขา LLMs ช่วยเร่งงานเช่น การทบทวนวรรณกรรมหรือการจัดระเบียบข้อมูลโดยเข้าใจเนื้อหาเอกสาร

ตัวอย่างโมเดลภาษาขนาดใหญ่ที่ได้รับความนิยม ได้แก่ ChatGPT / GPT-4 (OpenAI), Bard (PaLM ของ Google), LLaMA (Meta), Claude (Anthropic), และ Bing Chat (โมเดล GPT ของ Microsoft) โมเดลเหล่านี้ได้รับการฝึกด้วยชุดข้อมูลขนาดใหญ่และสามารถเข้าถึงผ่าน API หรืออินเทอร์เฟซเว็บ

ตัวอย่างเช่น GPT-3.5 และ GPT-4 ที่อยู่เบื้องหลัง ChatGPT มีพารามิเตอร์หลายร้อยพันล้านตัว ขณะที่โมเดลของ Google (PaLM และ Gemini) และโมเดลอื่นๆ ก็ทำงานในลักษณะเดียวกัน นักพัฒนามักโต้ตอบกับ LLM เหล่านี้ผ่านบริการคลาวด์หรือไลบรารี โดยปรับแต่งเพื่อทำงานเฉพาะ เช่น การสรุปเอกสารหรือช่วยเขียนโค้ด

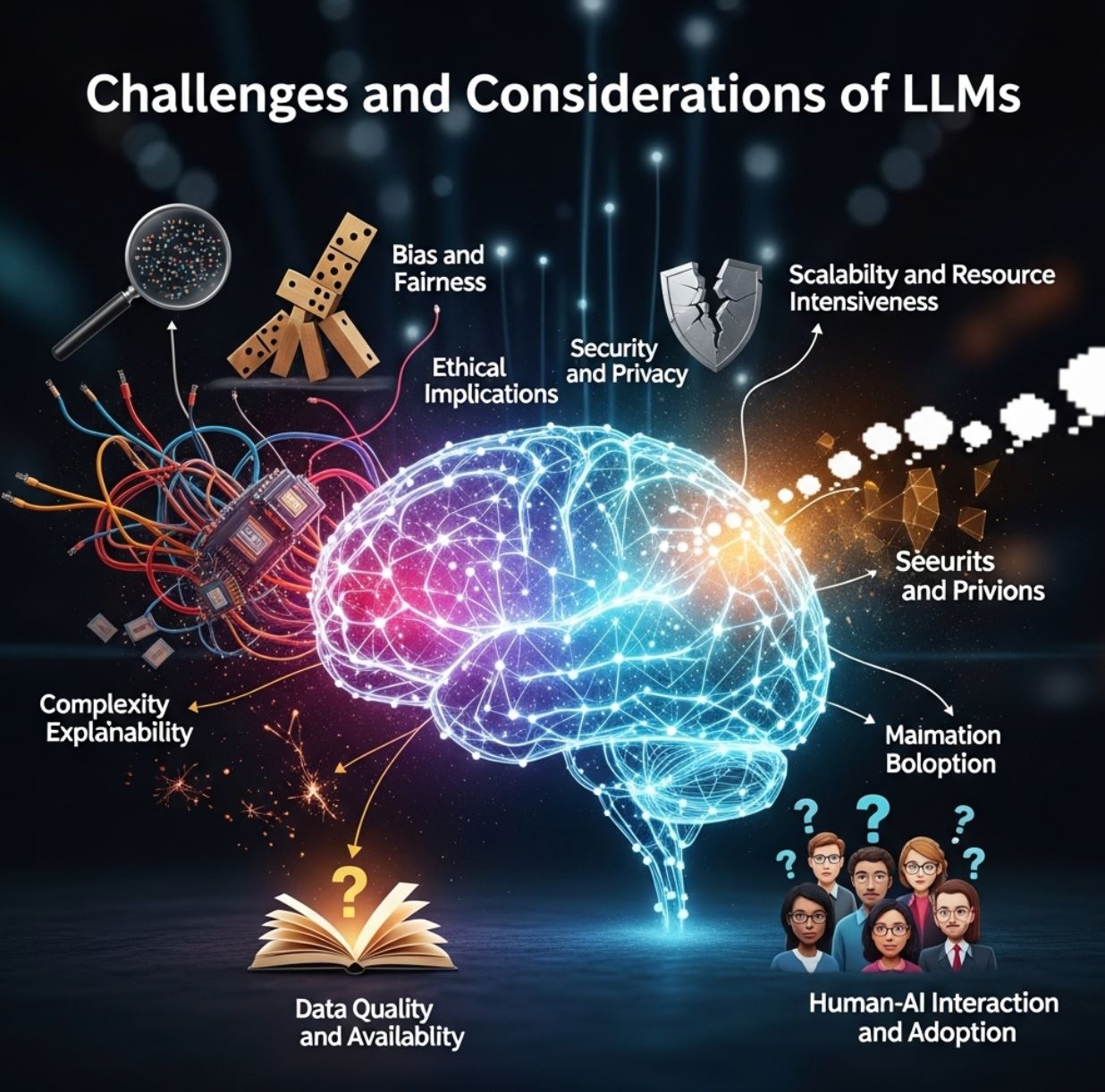

ความท้าทายและข้อควรพิจารณา

แม้ LLMs จะทรงพลัง แต่ก็ไม่สมบูรณ์แบบ เนื่องจากเรียนรู้จากข้อความในโลกจริง จึงอาจสะท้อน อคติ ที่มีอยู่ในข้อมูลฝึก โมเดลอาจสร้างเนื้อหาที่มีอคติทางวัฒนธรรม หรือแสดงภาษาที่ไม่เหมาะสมหรือเป็นแบบแผนถ้าไม่ได้กรองอย่างระมัดระวัง

อีกปัญหาคือ การสร้างข้อมูลเท็จ (hallucinations) คือโมเดลอาจให้คำตอบที่ฟังดูสมเหตุสมผลแต่ผิดหรือแต่งขึ้น เช่น โมเดลอาจมั่นใจสร้างข้อเท็จจริงเท็จหรือชื่อที่ไม่ถูกต้อง ข้อผิดพลาดเหล่านี้เกิดขึ้นเพราะโมเดลกำลังเดาคำต่อไปที่น่าจะเป็นไปได้มากที่สุด ไม่ใช่การตรวจสอบข้อเท็จจริง

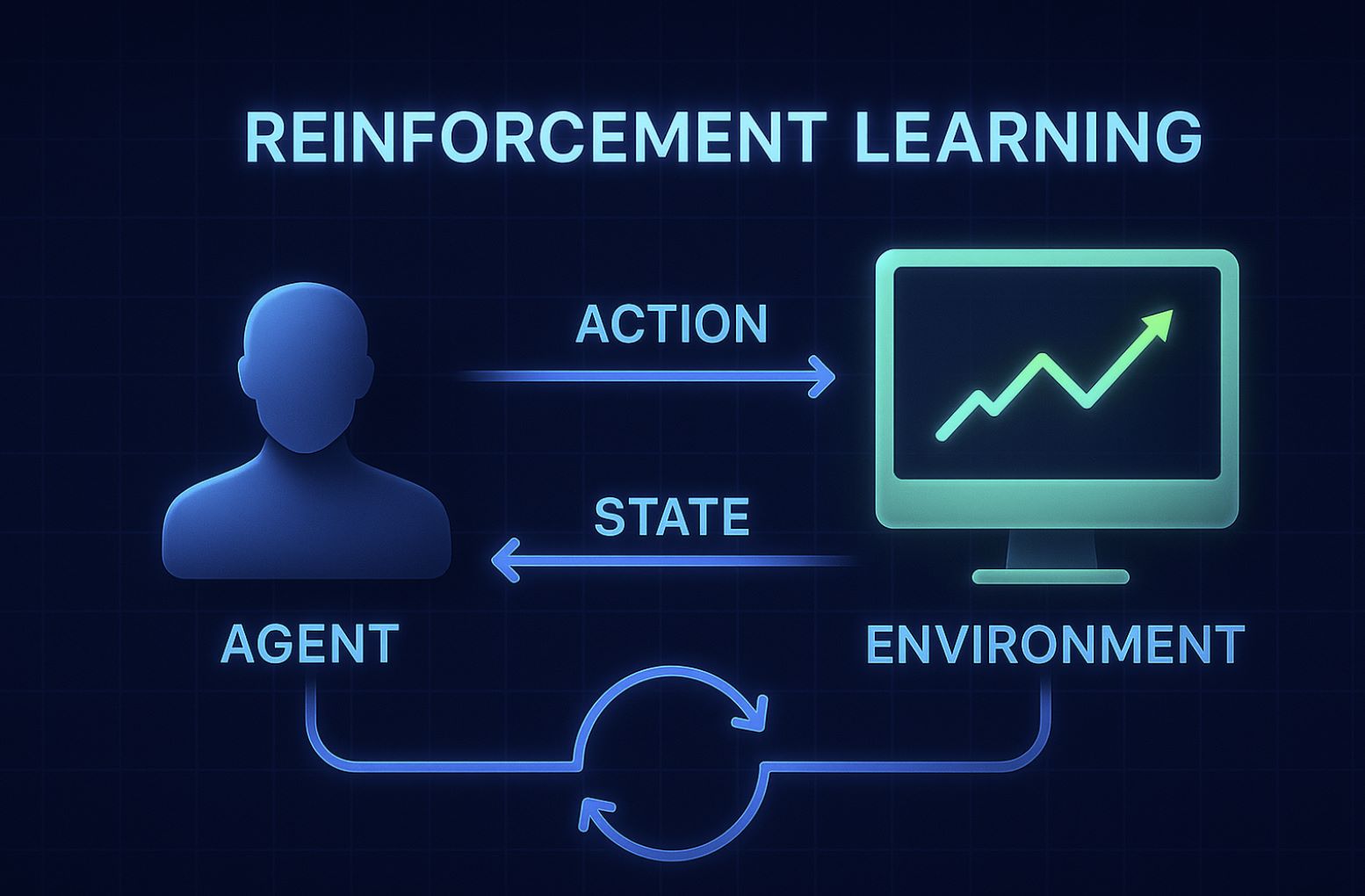

นักพัฒนาจึงลดปัญหาเหล่านี้ด้วยการปรับแต่งโดยใช้ความคิดเห็นจากมนุษย์ กรองผลลัพธ์ และใช้เทคนิคเช่น การเรียนรู้เสริมจากการให้คะแนนของมนุษย์

อย่างไรก็ตาม ผู้ใช้ LLM ควรตระหนักว่าผลลัพธ์ควรได้รับการตรวจสอบความถูกต้องและอคติ นอกจากนี้ การฝึกและใช้งาน LLM ต้องใช้ทรัพยากรคอมพิวเตอร์จำนวนมาก (GPU/TPU ที่ทรงพลังและข้อมูลจำนวนมาก) ซึ่งมีค่าใช้จ่ายสูง

>>>คลิกเพื่อดูเพิ่มเติม:

การประมวลผลภาษาธรรมชาติคืออะไร?

สรุปแล้ว โมเดลภาษาขนาดใหญ่ คือระบบ AI ที่ใช้สถาปัตยกรรมทรานส์ฟอร์เมอร์และได้รับการฝึกด้วยข้อมูลข้อความจำนวนมหาศาล โมเดลได้เรียนรู้รูปแบบของภาษาโดยการฝึกแบบไม่ต้องมีผู้สอน ทำให้สามารถสร้างข้อความที่ลื่นไหลและเหมาะสมกับบริบทได้ เนื่องจากขนาดที่ใหญ่ โมเดลเหล่านี้จึงสามารถจัดการงานด้านภาษาได้หลากหลาย ตั้งแต่การสนทนา การเขียน การแปล ไปจนถึงการเขียนโค้ด โดยมักมีความสามารถเทียบเท่าหรือเหนือกว่ามนุษย์ในด้านความคล่องแคล่ว

ตามที่นักวิจัย AI ชั้นนำสรุปไว้ โมเดลเหล่านี้ พร้อมที่จะเปลี่ยนแปลง วิธีที่เราสื่อสารกับเทคโนโลยีและเข้าถึงข้อมูล ในปี 2025 LLMs ยังคงพัฒนาอย่างต่อเนื่อง (รวมถึงการขยายสู่มัลติโมดัลที่รองรับภาพหรือเสียง) และยังคงเป็นหัวใจสำคัญของนวัตกรรม AI สมัยใหม่

ติดตาม INVIAI เพื่ออัปเดตข้อมูลที่เป็นประโยชน์เพิ่มเติม!