Generative KI ist ein Zweig der künstlichen Intelligenz, der Deep-Learning-(Neuronale-Netzwerk-)Modelle verwendet, die auf riesigen Datensätzen trainiert wurden, um neue Inhalte zu erstellen. Diese Modelle lernen Muster in Texten, Bildern, Audio oder anderen Daten, sodass sie als Antwort auf Nutzereingaben originelle Ergebnisse (wie Artikel, Bilder oder Musik) erzeugen können.

Mit anderen Worten generiert generative KI Medien „von Grund auf neu“ und analysiert oder klassifiziert nicht nur bestehende Daten. Das hier gezeigte Diagramm veranschaulicht, wie generative Modelle (mittlerer Kreis) innerhalb neuronaler Netzwerke angesiedelt sind, die Teil des maschinellen Lernens und des weiteren KI-Bereichs sind.

Beispielsweise beschreibt IBM generative KI als Deep-Learning-Modelle, die „hochwertige Texte, Bilder und andere Inhalte basierend auf den Daten erzeugen, auf denen sie trainiert wurden“, und sie beruht auf ausgeklügelten neuronalen Algorithmen, die Muster in riesigen Datensätzen erkennen, um neuartige Ergebnisse zu produzieren.

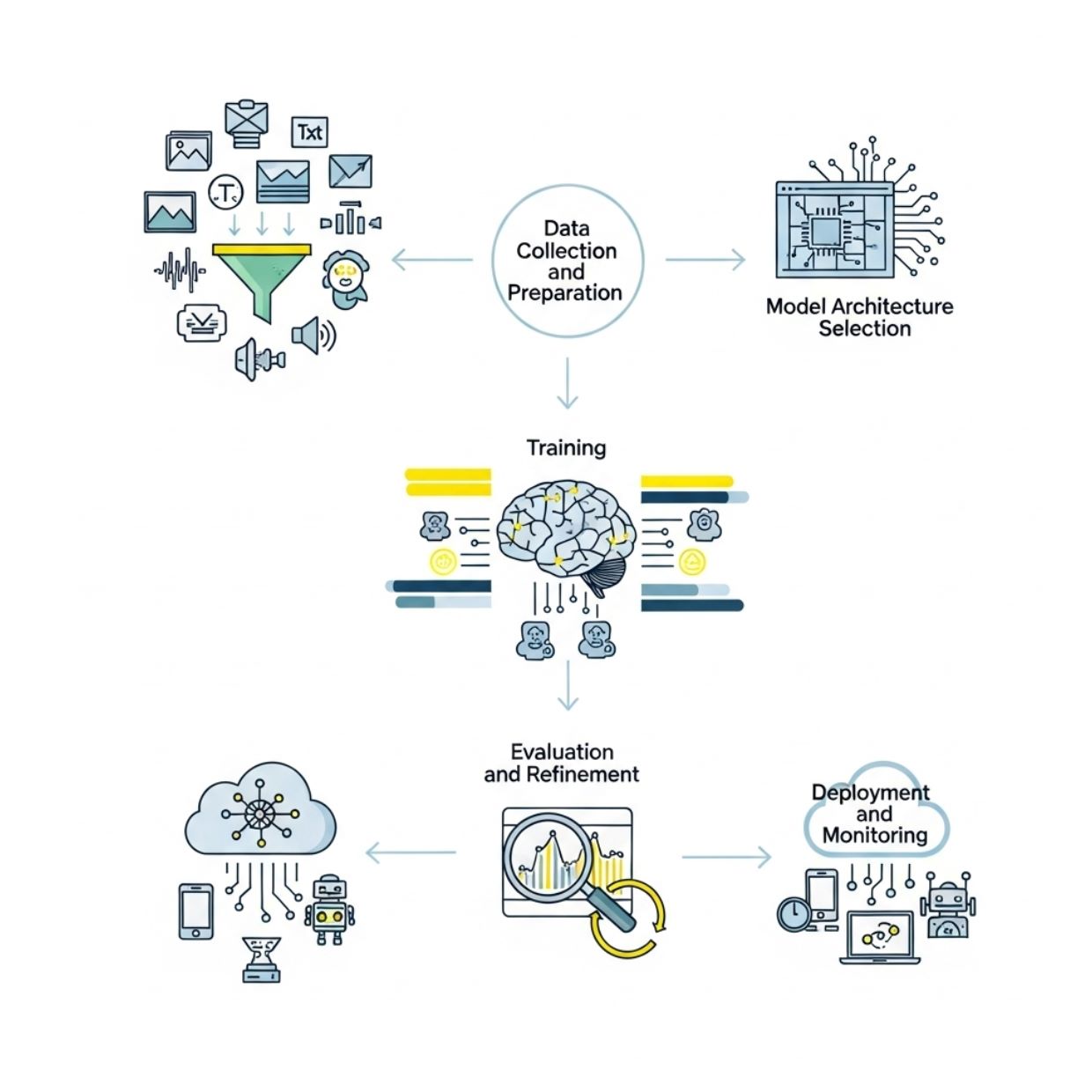

Wie Generative KI funktioniert

Der Aufbau eines generativen KI-Systems umfasst typischerweise drei Hauptphasen:

- Training (Foundation Model): Ein großes neuronales Netzwerk (oft als Foundation Model bezeichnet) wird mit enormen Mengen roher, unbeschrifteter Daten trainiert (z. B. Terabytes an Internettexten, Bildern oder Code). Während des Trainings lernt das Modell, fehlende Teile vorherzusagen (zum Beispiel das nächste Wort in Millionen von Sätzen zu ergänzen). Über viele Iterationen passt es sich an, um komplexe Muster und Zusammenhänge in den Daten zu erfassen. Das Ergebnis ist ein neuronales Netzwerk mit kodierten Repräsentationen, das Inhalte autonom als Antwort auf Eingaben erzeugen kann.

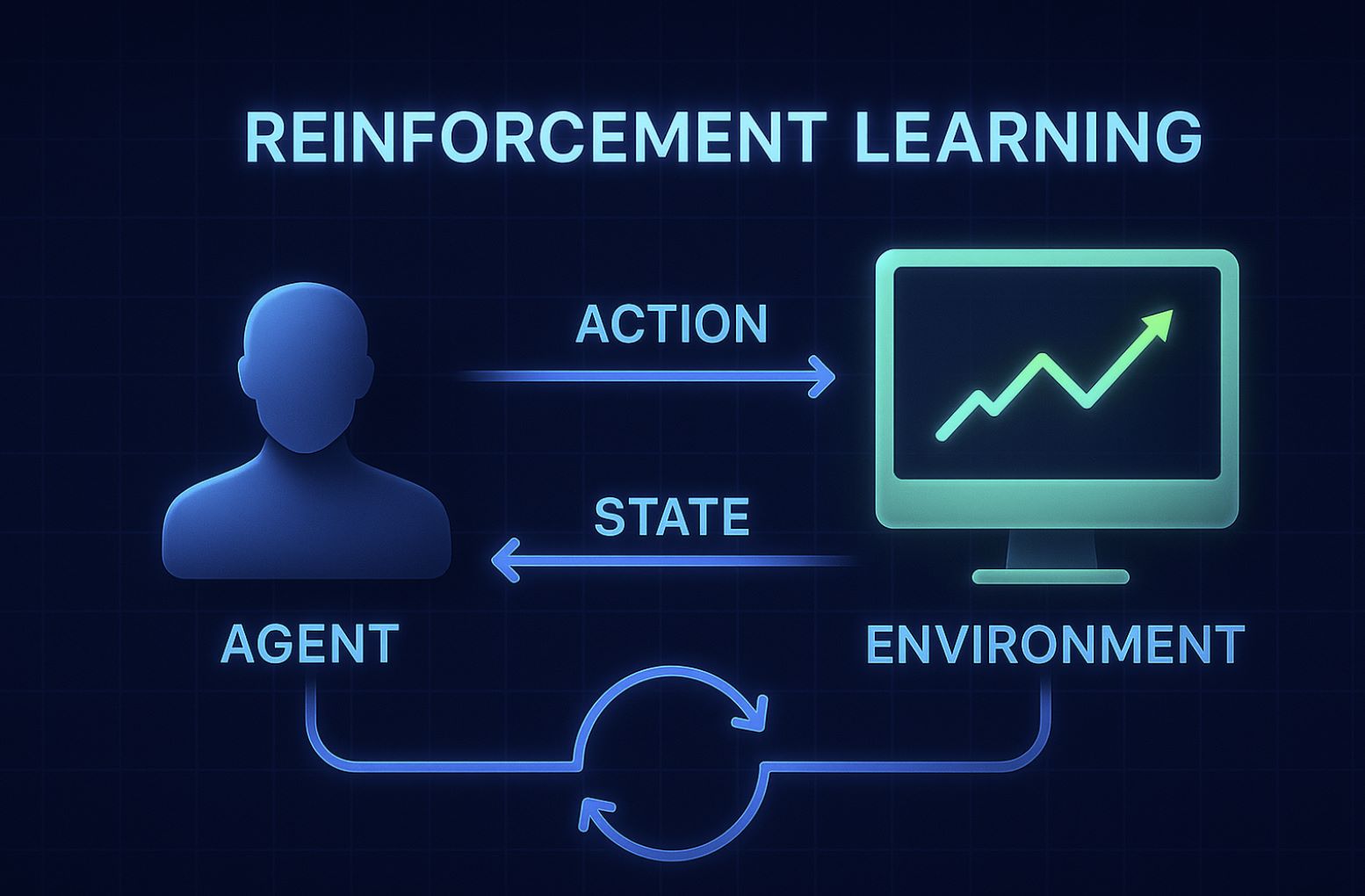

- Feinabstimmung: Nach dem ersten Training wird das Modell für spezifische Aufgaben durch Feinabstimmung angepasst. Dies kann zusätzliches Training mit beschrifteten Beispielen oder Reinforcement Learning mit menschlichem Feedback (RLHF) umfassen, bei dem Menschen die Ausgaben des Modells bewerten und das Modell sich zur Qualitätsverbesserung anpasst. Beispielsweise kann ein Chatbot-Modell mit einer Sammlung von Kundenfragen und idealen Antworten feinjustiert werden, um präzisere und relevantere Antworten zu liefern.

- Generierung: Nach dem Training und der Feinabstimmung erzeugt das Modell neue Inhalte basierend auf einer Eingabeaufforderung. Es tut dies, indem es aus den gelernten Mustern schöpft – z. B. indem es Wort für Wort Text vorhersagt oder Pixelmuster für Bilder verfeinert. Praktisch „generiert das Modell neue Inhalte, indem es Muster in bestehenden Daten erkennt“. Basierend auf der Nutzereingabe sagt die KI Schritt für Schritt eine Folge von Tokens oder Bildern voraus, um das Ergebnis zu erstellen.

- Abruf und Verfeinerung (RAG): Viele Systeme verwenden außerdem Retrieval-Augmented Generation, um die Genauigkeit zu verbessern. Dabei zieht das Modell zur Generierungszeit externe Informationen (wie Dokumente oder Datenbanken) hinzu, um seine Antworten auf aktuelle Fakten zu stützen und das während des Trainings Gelernte zu ergänzen.

Jede Phase ist rechenintensiv: Das Training eines Foundation Models kann Tausende von GPUs und Wochen an Rechenzeit erfordern. Das trainierte Modell kann anschließend als Dienst bereitgestellt werden (z. B. als Chatbot oder Bild-API), der Inhalte auf Abruf generiert.

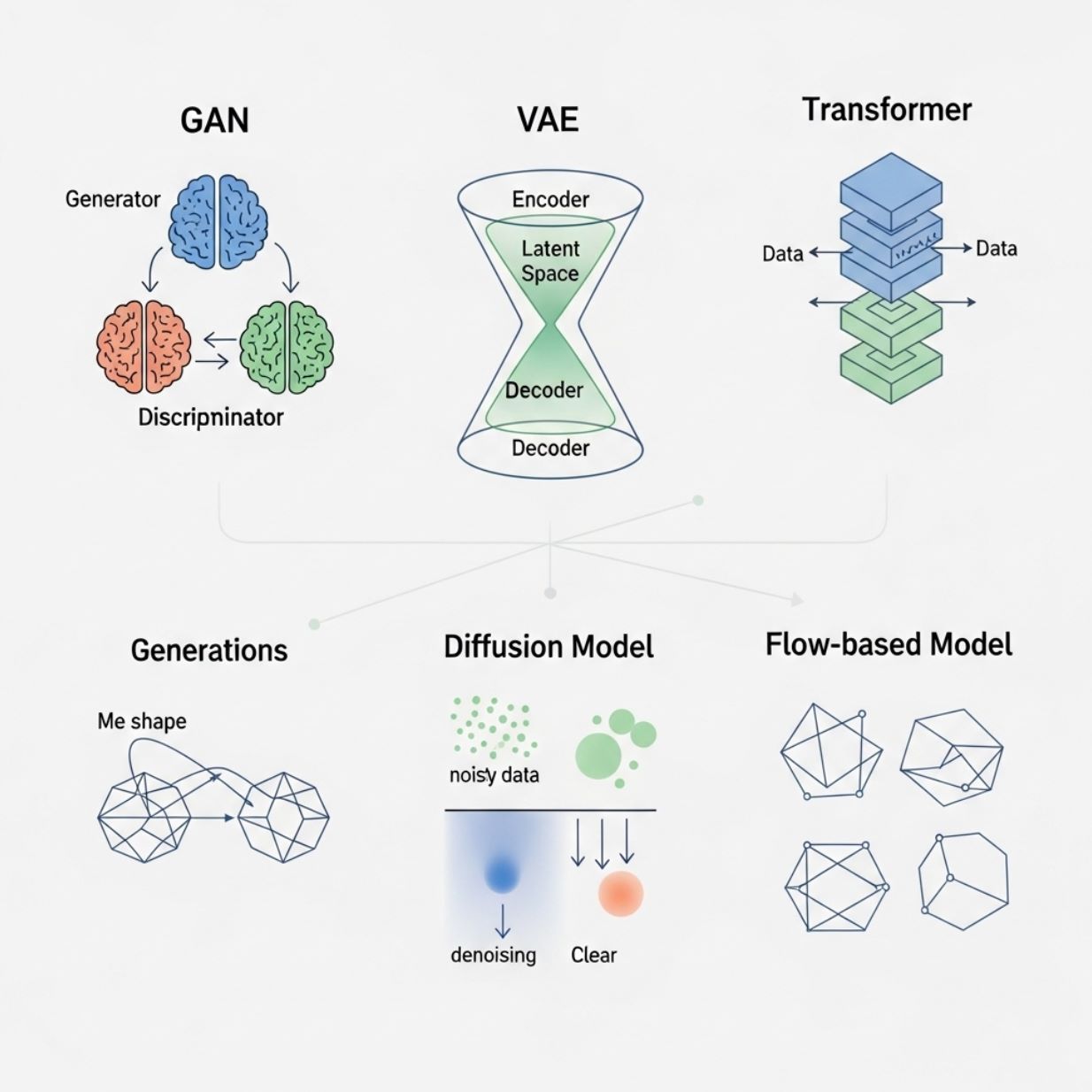

Wichtige Modelltypen und Architekturen

Generative KI nutzt verschiedene moderne neuronale Architekturen, die jeweils für unterschiedliche Medien geeignet sind:

- Große Sprachmodelle (LLMs) / Transformer: Diese bilden das Herzstück der heutigen textbasierten generativen KI (z. B. OpenAI GPT-4, Google Bard). Sie verwenden Transformer-Netzwerke mit Aufmerksamkeitsmechanismen, um kohärenten, kontextbewussten Text (oder sogar Code) zu erzeugen. LLMs werden mit Milliarden von Wörtern trainiert und können Sätze vervollständigen, Fragen beantworten oder Essays mit menschenähnlicher Sprachgewandtheit schreiben.

- Diffusionsmodelle: Beliebt für die Bild- (und teilweise Audio-)Generierung (z. B. DALL·E, Stable Diffusion). Diese Modelle starten mit zufälligem Rauschen und „entrauschen“ es schrittweise zu einem kohärenten Bild. Das Netzwerk lernt, einen Korruptionsprozess umzukehren und kann so hochrealistische Bilder aus Textanweisungen erzeugen. Diffusionsmodelle haben ältere Methoden der KI-Kunst weitgehend ersetzt, da sie eine feinkörnige Kontrolle über Bilddetails ermöglichen.

- Generative Adversarial Networks (GANs): Eine frühere Technik zur Bildgenerierung (ca. 2014) mit zwei konkurrierenden neuronalen Netzwerken: Ein Generator erstellt Bilder, ein Diskriminator bewertet sie. Durch diesen adversarialen Prozess erzeugen GANs extrem realistische Bilder und werden für Aufgaben wie Stiltransfer oder Datenaugmentation eingesetzt.

- Variationale Autoencoder (VAEs): Ein weiteres älteres Deep-Learning-Modell, das Daten in einen komprimierten Raum kodiert und daraus neue Variationen generiert. VAEs gehörten zu den ersten tiefen generativen Modellen für Bilder und Sprache (ca. 2013) und zeigten frühe Erfolge, obwohl moderne generative KI für höchste Qualität überwiegend auf Transformer und Diffusion setzt.

- (Andere): Es gibt auch spezialisierte Architekturen für Audio, Video und multimodale Inhalte. Viele hochmoderne Modelle kombinieren diese Techniken (z. B. Transformer mit Diffusion), um Text und Bild gemeinsam zu verarbeiten. IBM weist darauf hin, dass heutige multimodale Foundation Models die Erzeugung verschiedener Inhaltsarten (Text, Bilder, Ton) aus einem einzigen System unterstützen können.

Gemeinsam treiben diese Architekturen die Vielfalt der heute eingesetzten generativen Werkzeuge an.

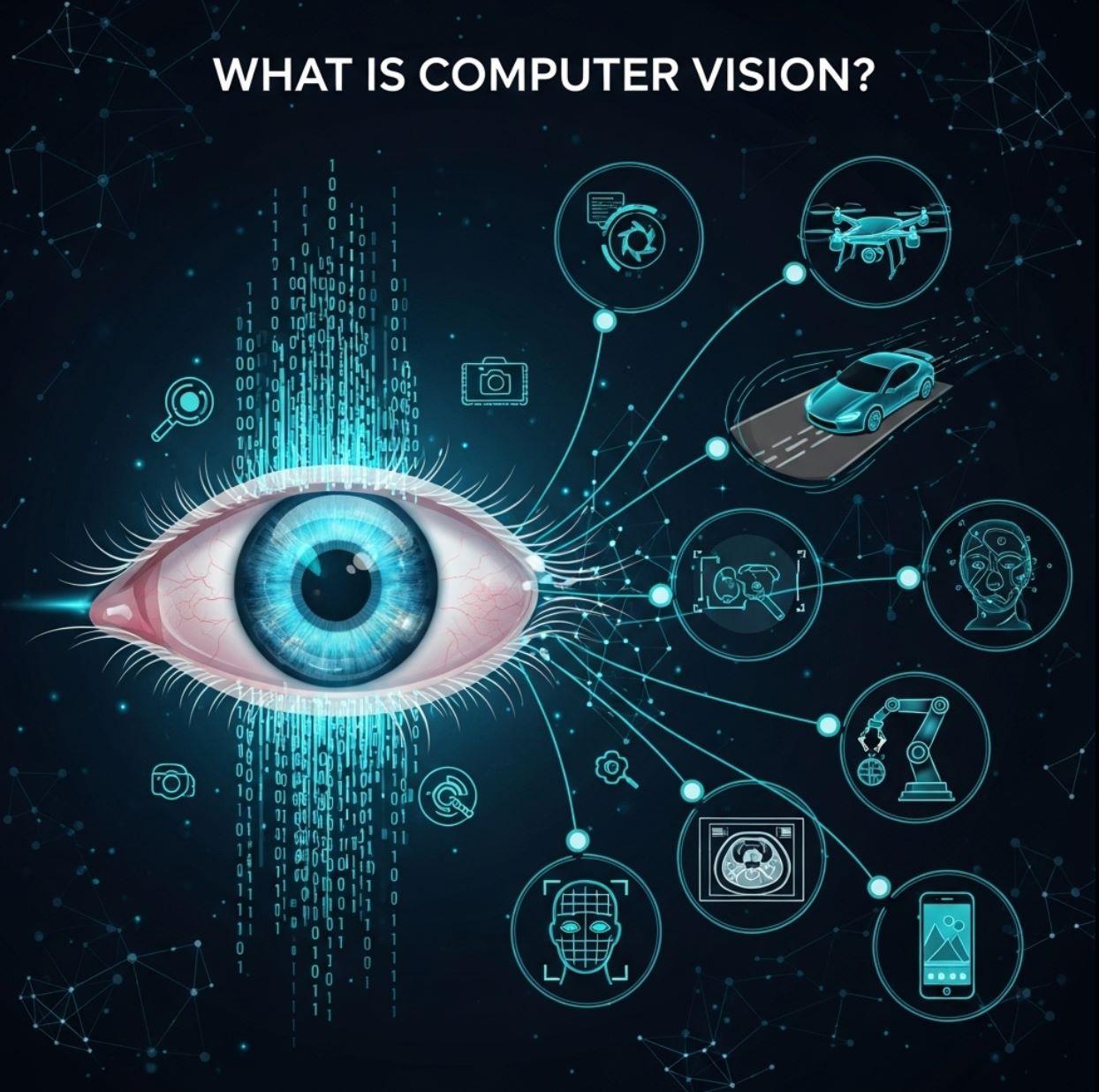

Anwendungsbereiche der Generativen KI

Generative KI wird in vielen Bereichen eingesetzt. Wichtige Anwendungsfälle sind:

- Marketing & Kundenerlebnis: Automatisches Verfassen von Marketingtexten (Blogs, Anzeigen, E-Mails) und die Produktion personalisierter Inhalte in Echtzeit. Sie treibt auch fortschrittliche Chatbots an, die mit Kunden kommunizieren oder sogar Aktionen ausführen können (z. B. bei Bestellungen unterstützen). Marketingteams können beispielsweise sofort mehrere Anzeigenvarianten generieren und diese nach Demografie oder Kontext anpassen.

- Softwareentwicklung: Automatisierung der Codeerstellung und -vervollständigung. Werkzeuge wie GitHub Copilot nutzen LLMs, um Code-Snippets vorzuschlagen, Fehler zu beheben oder zwischen Programmiersprachen zu übersetzen. Dies beschleunigt repetitive Programmieraufgaben erheblich und unterstützt die Modernisierung von Anwendungen (z. B. die Umstellung alter Codebasen auf neue Plattformen).

- Geschäftsautomatisierung: Erstellung und Überprüfung von Dokumenten. Generative KI kann schnell Verträge, Berichte, Rechnungen und andere Unterlagen verfassen oder überarbeiten, wodurch der manuelle Aufwand in HR, Recht, Finanzen und anderen Bereichen reduziert wird. Dies ermöglicht es Mitarbeitenden, sich auf komplexe Problemlösungen statt auf Routineaufgaben zu konzentrieren.

- Forschung & Gesundheitswesen: Vorschläge für neuartige Lösungen komplexer Probleme. In Wissenschaft und Technik können Modelle neue Wirkstoffmoleküle vorschlagen oder Materialien entwerfen. Beispielsweise kann KI synthetische Molekülstrukturen oder medizinische Bilder für die Ausbildung diagnostischer Systeme generieren. IBM weist darauf hin, dass generative KI in der medizinischen Forschung zur Erstellung synthetischer Daten (z. B. medizinischer Scans) verwendet wird, wenn reale Daten knapp sind.

- Kreative Künste & Design: Unterstützung oder Erstellung von Kunstwerken, Grafiken und Medien. Designer nutzen generative KI, um originelle Kunst, Logos, Spielelemente oder Spezialeffekte zu produzieren. Modelle wie DALL·E, Midjourney oder Stable Diffusion können Illustrationen erstellen oder Fotos auf Abruf bearbeiten. Sie bieten neue kreative Werkzeuge, etwa durch die Generierung mehrerer Bildvarianten zur Inspiration von Künstlern.

- Medien & Unterhaltung: Erzeugung von Audio- und Videoinhalten. KI kann Musik komponieren, natürlich klingende Sprache generieren oder sogar kurze Videos entwerfen. Beispielsweise kann sie Voiceover in einem gewählten Stil produzieren oder Musikstücke basierend auf Textbeschreibungen erstellen. Während die vollständige Videogenerierung noch in Entwicklung ist, existieren bereits Tools, die Animationsclips aus Texteingaben erzeugen, mit schnell steigender Qualität.

Diese Beispiele kratzen nur an der Oberfläche; die Technologie entwickelt sich so rasant, dass ständig neue Anwendungen entstehen (z. B. personalisiertes Lernen, Inhalte für virtuelle Realität, automatisierte Nachrichtenverfassung).

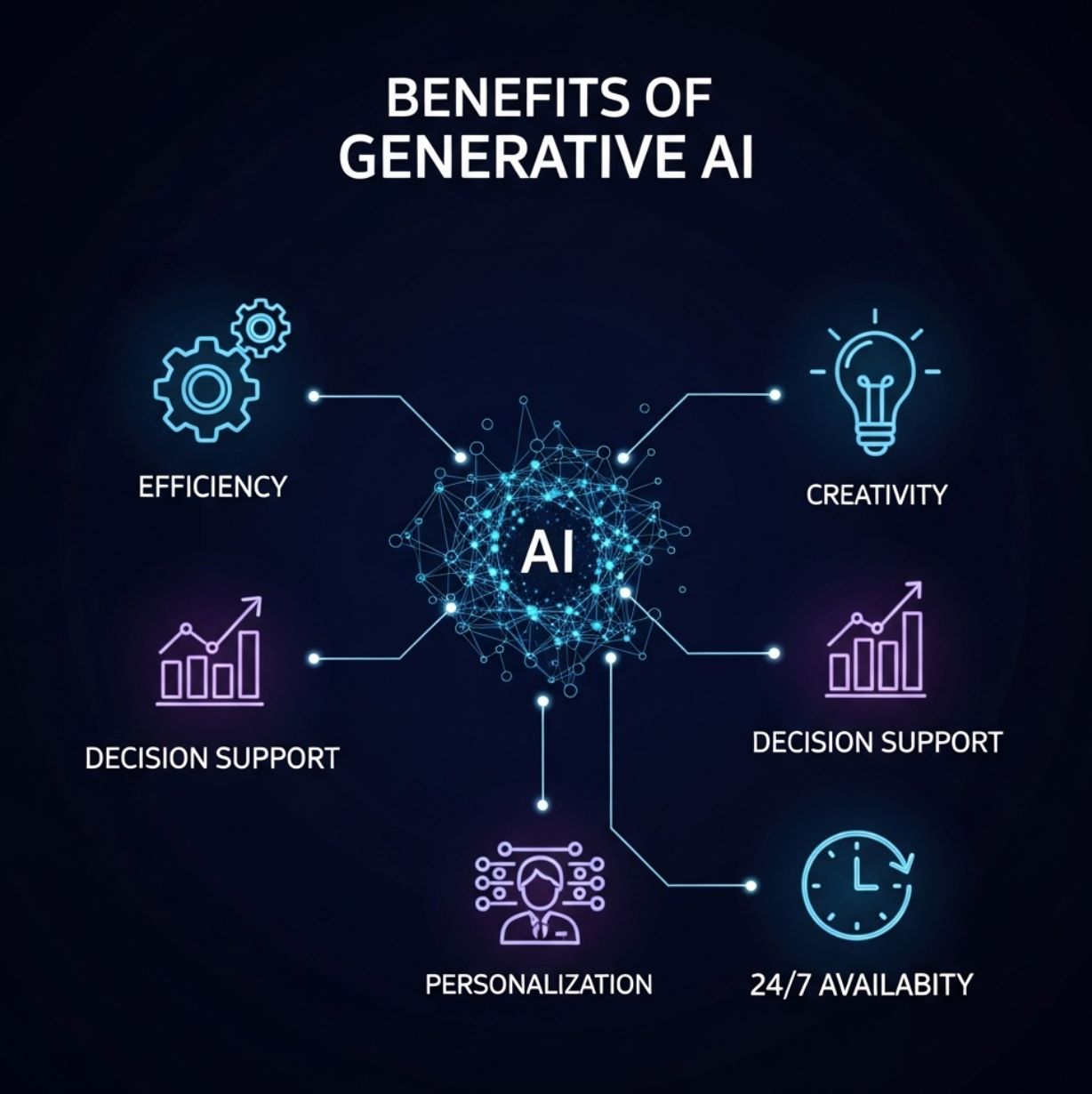

Vorteile der Generativen KI

Generative KI bietet mehrere Vorteile:

- Effizienz und Automatisierung: Sie automatisiert zeitaufwändige Aufgaben. Zum Beispiel kann sie E-Mails, Code oder Designideen in Sekunden entwerfen, was die Arbeit erheblich beschleunigt und Menschen ermöglicht, sich auf höherwertige Aufgaben zu konzentrieren. Organisationen berichten von dramatischen Produktivitätssteigerungen, da Teams Inhalte und Ideen viel schneller erzeugen können als zuvor.

- Erhöhte Kreativität: Sie kann Kreativität fördern, indem sie Brainstorming unterstützt und Variationen erkundet. Ein Autor oder Künstler kann mit einem Klick mehrere Entwürfe oder Designoptionen generieren, was hilft, Schreib- oder Kreativblockaden zu überwinden. Diese „kreative Partner“-Funktion ermöglicht es auch Laien, neue Konzepte auszuprobieren.

- Bessere Entscheidungsunterstützung: Durch die schnelle Analyse großer Datensätze kann generative KI Erkenntnisse oder Hypothesen liefern, die menschliche Entscheidungen unterstützen. Zum Beispiel kann sie komplexe Berichte zusammenfassen oder statistische Muster in Daten vorschlagen. IBM betont, dass sie durch das Durchforsten von Daten intelligentere Entscheidungen ermöglicht, indem sie hilfreiche Zusammenfassungen oder Vorhersagen generiert.

- Personalisierung: Modelle können Ausgaben an individuelle Vorlieben anpassen. Beispielsweise können sie personalisierte Marketinginhalte erstellen, Produkte empfehlen oder Benutzeroberflächen an den Kontext jedes Nutzers anpassen. Diese Echtzeit-Personalisierung verbessert die Nutzerbindung.

- Rund-um-die-Uhr-Verfügbarkeit: KI-Systeme ermüden nicht. Sie können rund um die Uhr Service bieten (z. B. Chatbots, die Tag und Nacht Fragen beantworten) ohne Ermüdung. Dies gewährleistet konstante Leistung und ständigen Zugang zu Informationen oder kreativer Unterstützung.

Zusammengefasst kann generative KI Zeit sparen, Innovationen anregen und groß angelegte kreative oder analytische Aufgaben schnell und in großem Umfang bewältigen.

Herausforderungen und Risiken der Generativen KI

Trotz ihrer Leistungsfähigkeit hat generative KI erhebliche Einschränkungen und Risiken:

- Ungenaue oder erfundene Ausgaben („Halluzinationen“): Modelle können plausibel klingende, aber falsche oder unsinnige Antworten erzeugen. Zum Beispiel könnte eine juristische Recherche-KI fälschlicherweise gefälschte Fallzitate angeben. Diese „Halluzinationen“ entstehen, weil das Modell Fakten nicht wirklich versteht – es sagt nur wahrscheinliche Fortsetzungen voraus. Nutzer müssen KI-Ausgaben sorgfältig überprüfen.

- Voreingenommenheit und Fairness: Da KI aus historischen Daten lernt, kann sie gesellschaftliche Vorurteile aus diesen Daten übernehmen. Dies kann zu unfairen oder anstößigen Ergebnissen führen (z. B. voreingenommene Jobempfehlungen oder stereotype Bildunterschriften). Die Vermeidung von Bias erfordert sorgfältige Auswahl der Trainingsdaten und kontinuierliche Evaluation.

- Datenschutz- und Urheberrechtsbedenken: Wenn Nutzer sensible oder urheberrechtlich geschützte Materialien in ein Modell einspeisen, könnte es versehentlich private Details in seinen Ausgaben offenbaren oder geistiges Eigentum verletzen. Modelle können auch abgefragt werden, um Teile ihrer Trainingsdaten preiszugeben. Entwickler und Nutzer müssen Eingaben schützen und Ausgaben auf solche Risiken überwachen.

- Deepfakes und Fehlinformationen: Generative KI kann hochrealistische gefälschte Bilder, Audio- oder Videoaufnahmen (Deepfakes) erzeugen. Diese können missbräuchlich verwendet werden, um Personen zu imitieren, falsche Informationen zu verbreiten oder Opfer zu betrügen. Die Erkennung und Verhinderung von Deepfakes ist eine wachsende Herausforderung für Sicherheit und Medienintegrität.

- Mangelnde Erklärbarkeit: Generative Modelle sind oft „Black Boxes“. Es ist meist unmöglich nachzuvollziehen, warum sie eine bestimmte Ausgabe erzeugt haben oder ihren Entscheidungsprozess zu prüfen. Diese Undurchsichtigkeit erschwert die Gewährleistung von Zuverlässigkeit oder die Fehlerverfolgung. Forscher arbeiten an erklärbarer KI, doch dies bleibt eine offene Herausforderung.

Weitere Probleme sind der enorme Rechenaufwand (mit steigenden Energiekosten und CO₂-Fußabdruck) sowie rechtliche und ethische Fragen zum Eigentum an Inhalten. Insgesamt erfordert generative KI trotz ihrer Stärke sorgfältige menschliche Aufsicht und Governance, um Risiken zu minimieren.

Die Zukunft der Generativen KI

Generative KI entwickelt sich mit rasanter Geschwindigkeit weiter. Die Verbreitung wächst schnell: Umfragen zeigen, dass etwa ein Drittel der Unternehmen bereits generative KI in irgendeiner Form nutzt, und Analysten prognostizieren, dass bis 2026 rund 80 % der Firmen sie implementiert haben werden. Experten erwarten, dass diese Technologie Billionen von Dollar zur Weltwirtschaft beiträgt und Branchen transformiert.

Oracle berichtet beispielsweise, dass generative KI nach dem Debüt von ChatGPT „ein globales Phänomen wurde“ und „erwartet wird, Billionen zur Wirtschaft beizutragen“, indem sie massive Produktivitätssteigerungen ermöglicht.

Zukünftig werden wir spezialisiertere und leistungsfähigere Modelle sehen (für Wissenschaft, Recht, Technik usw.), bessere Methoden zur Sicherstellung genauer Ausgaben (z. B. fortgeschrittenes RAG und verbesserte Trainingsdaten) sowie die Integration generativer KI in Alltagswerkzeuge und -dienste.

Neue Konzepte wie KI-Agenten – Systeme, die generative KI nutzen, um autonom mehrstufige Aufgaben zu erledigen – stellen einen nächsten Schritt dar (z. B. ein Agent, der eine Reise plant, KI-generierte Empfehlungen nutzt und dann Hotels und Flüge bucht). Gleichzeitig beginnen Regierungen und Organisationen, Richtlinien und Standards zu Ethik, Sicherheit und Urheberrecht für generative KI zu entwickeln.

>>>Möchten Sie wissen:

Was ist enge KI und allgemeine KI?

Zusammenfassend bezeichnet generative KI KI-Systeme, die neue, originelle Inhalte erstellen, indem sie aus Daten lernen. Angetrieben von tiefen neuronalen Netzwerken und großen Foundation Models kann sie Texte schreiben, Bilder generieren, Audio komponieren und mehr, was transformative Anwendungen ermöglicht.

Obwohl sie enorme Vorteile in Kreativität und Effizienz bietet, bringt sie auch Herausforderungen wie Fehler und Bias mit sich, die Nutzer adressieren müssen. Mit zunehmender Reife wird sie zunehmend ein integrales Werkzeug in vielen Branchen, wobei verantwortungsvoller Einsatz entscheidend ist, um ihr Potenzial sicher zu nutzen.