Per molti anni (2023–2025), l'intelligenza artificiale ha fatto balzi in avanti su molti fronti. I grandi modelli linguistici (LLM) e i chatbot, i sistemi multimodali, gli strumenti scientifici basati sull'IA e la robotica hanno tutti visto importanti progressi.

I giganti della tecnologia hanno lanciato nuovi assistenti IA, le comunità open-source hanno rilasciato modelli potenti e persino i regolatori si sono mossi per affrontare l'impatto dell'IA.

Di seguito esaminiamo i risultati più sorprendenti, dalle estensioni di GPT-4 e Google Gemini al Premio Nobel di AlphaFold e alle scoperte guidate dall'IA nella scienza e nell'arte.

Modelli Linguistici Generativi e Chatbot

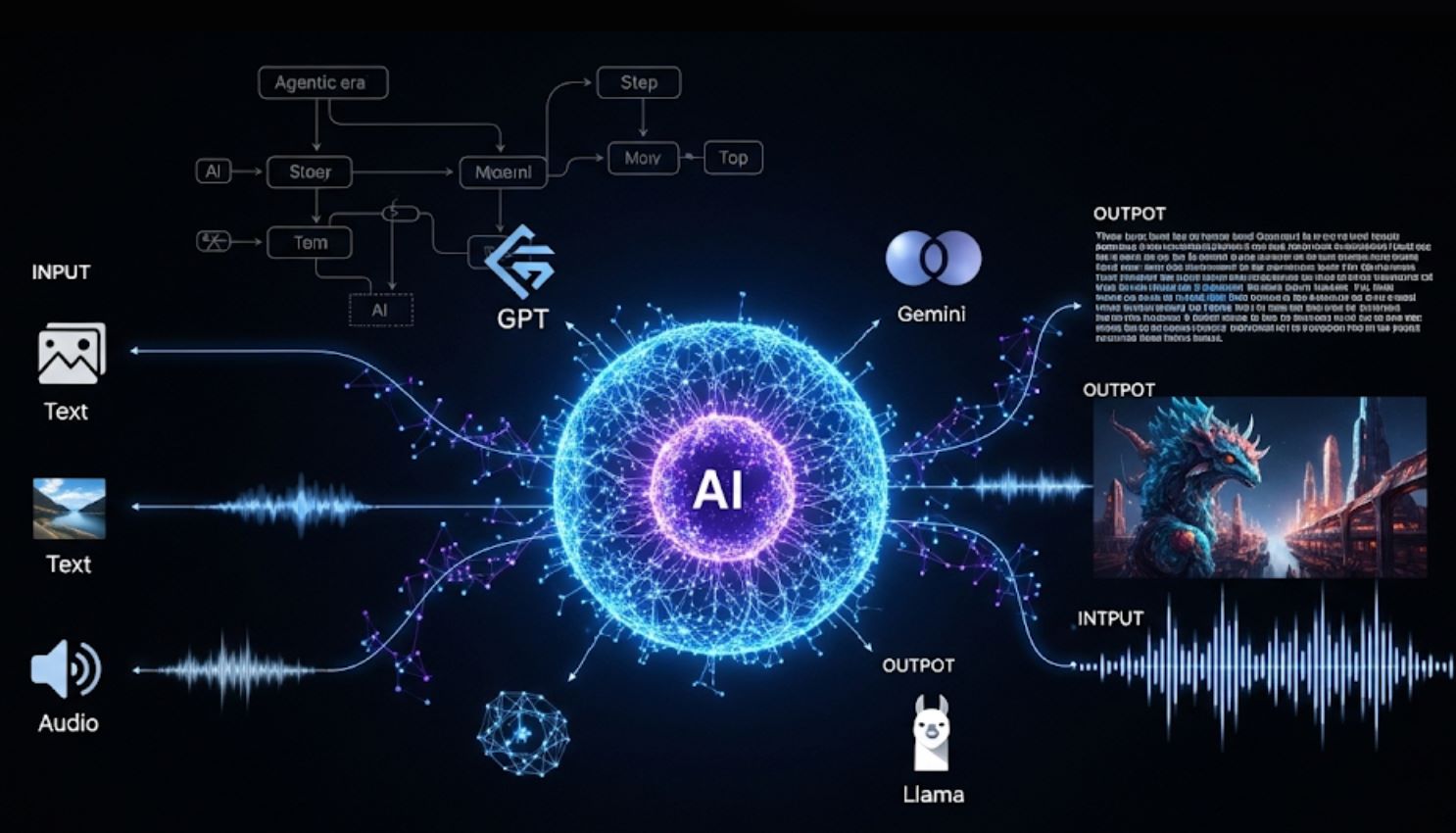

Gli LLM moderni sono diventati molto più capaci e multimodali. GPT-4 Turbo di OpenAI (annunciato a novembre 2023) può ora elaborare 128.000 token in un singolo prompt (circa 300 pagine di testo) ed è molto più economico da eseguire rispetto a GPT-4.

A maggio 2024 OpenAI ha introdotto GPT-4o (Omni), un modello aggiornato che gestisce testo, immagini e audio in tempo reale – offrendo a GPT-4 una vera e propria “visione e udito” conversazionale. ChatGPT ora integra funzionalità di immagini e voce: gli utenti possono caricare foto o parlare con il bot, che risponderà basandosi su questi input visivi o audio.

- GPT-4 Turbo e GPT-4o (Omni): GPT-4 Turbo (novembre 2023) ha ridotto i costi e ampliato la lunghezza del contesto a 128K token. GPT-4o (maggio 2024) ha reso l'IA veramente multimodale, generando testo, voce e immagini in modo intercambiabile con una velocità quasi umana.

- Progressi di ChatGPT: Alla fine del 2023, ChatGPT “ora può vedere, sentire e parlare” – è possibile caricare immagini e audio o usarli come prompt parlati, e il bot risponde di conseguenza.

Ha inoltre integrato DALL·E 3 (ottobre 2023) per generare immagini da testo con l’aiuto di prompt conversazionali. - Serie Gemini di Google: A dicembre 2024 Google DeepMind ha lanciato i primi modelli Gemini 2.0 (“Flash” e prototipi) progettati per l’“era agentica” – IA in grado di eseguire autonomamente compiti complessi a più fasi.

Google ha già iniziato a testare Gemini 2.0 in Search (AI Overviews) e altri prodotti per oltre un miliardo di utenti, riflettendo le sue capacità avanzate di ragionamento e multimodalità. - Altri modelli: Meta ha rilasciato LLaMA 3 ad aprile 2024 (LLM open-weight fino a 400 miliardi di parametri) affermando che supera molti modelli precedenti.

Anthropic con Claude 3 e gli strumenti copilot di Microsoft hanno anch’essi costruito su questi progressi (ad esempio Copilot basato sulla tecnologia OpenAI).

Queste innovazioni permettono agli assistenti IA di sostenere conversazioni molto più lunghe e ricche e di gestire input diversificati.

Alimentano inoltre nuove app “assistenti” tramite API (come “AI Overviews” di Google, Assistants API di OpenAI, ecc.), rendendo l’IA più accessibile a sviluppatori e utenti finali.

Progressi Multimodali e Creativi dell'IA

La creatività e la comprensione visiva dell’IA sono esplose. I modelli testo-immagine e testo-video hanno raggiunto nuovi livelli:

DALL·E 3 di OpenAI (ottobre 2023) genera immagini fotorealistiche da prompt ed è integrato con ChatGPT per guidare la scrittura dei prompt.

Google ha introdotto Imagen 3 (ottobre 2024) e Veo 2 (dicembre 2024) – motori all’avanguardia per testo-immagine e testo-video – che migliorano drasticamente qualità, dettaglio e coerenza nell’arte e nei video generati dall’IA.

Anche l’IA musicale è migliorata con gli strumenti MusicFX di Google e ricerche correlate (ad esempio esperimenti MusicLM).

- Modelli di arte generativa: DALL·E 3 e Imagen 3 seguono prompt sottili (incluso testo incorporato nelle immagini) con alta fedeltà.

Veo 2 di Google può generare brevi clip video da una singola descrizione testuale, un passo importante per la sintesi video.

Stable Diffusion e Midjourney hanno rilasciato nuove versioni (v3, v6) con realismo migliorato quest’anno. - IA nei dispositivi: Apple ha lanciato Apple Intelligence (in iOS 18 e macOS 15, fine 2024) – IA generativa integrata su iPhone/iPad/Mac.

Include assistenti di scrittura (riscrivere, correggere, riassumere in Mail/Pages), una Siri ancora più intelligente e strumenti per immagini come Image Playground (creare illustrazioni divertenti tramite testo) e Genmoji (emoji personalizzate generate dall’IA).

Le foto hanno una ricerca in linguaggio naturale (“trova Maya mentre fa skateboard”) e l’IA “Clean Up” rimuove oggetti indesiderati dalle immagini.

L’approccio Apple punta su elaborazione locale e privacy. - IA nell’arte: Un esempio notevole: a novembre 2024 Sotheby’s ha venduto il primo dipinto realizzato da un robot umanoide.

Un ritratto di Alan Turing disegnato dal robot AI Ai-Da è stato venduto per 1,08 milioni di dollari USA.

Questa vendita da record (“A.I. God: Ritratto di Alan Turing”) sottolinea il ruolo crescente dell’IA nella creatività e il suo impatto culturale.

In generale, i modelli generativi stanno democratizzando la creatività: chiunque può ora generare arte, musica o video con poche parole.

Il focus del settore si è spostato dalla mera novità (immagini surreali) alla generazione di immagini utili (loghi, diagrammi, mappe) e al realismo umano.

(A marzo 2025 OpenAI ha persino rilasciato “4o Image Generation”, integrando il suo miglior modello di immagini in GPT-4o per output precisi e fotorealistici guidati dalla conversazione.)

Questi strumenti vengono rapidamente integrati in app, browser e flussi di lavoro creativi.

IA nella Scienza, Medicina e Matematica

I risultati dell’IA hanno alimentato scoperte scientifiche e progressi nella ricerca:

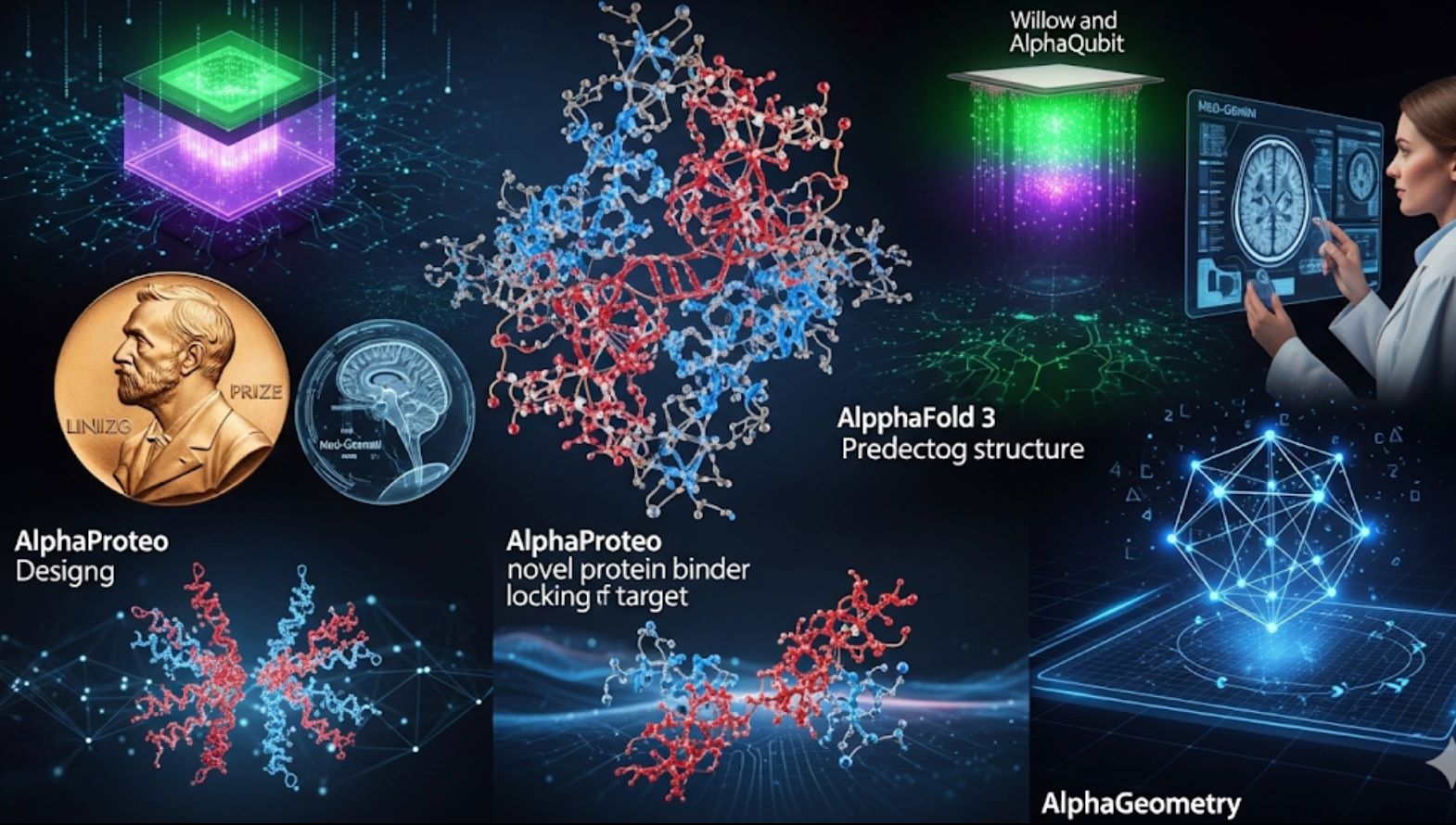

- AlphaFold 3 – biomolecole: A novembre 2024 Google DeepMind (con Isomorphic Labs) ha presentato AlphaFold 3, un nuovo modello che predice le strutture 3D di tutte le biomolecole (proteine, DNA, RNA, ligandi, ecc.) simultaneamente, con una precisione senza precedenti.

Per le interazioni proteina-farmaco, AlphaFold 3 è circa il 50% più preciso dei metodi tradizionali.

I suoi creatori hanno subito rilasciato un AlphaFold Server gratuito per permettere ai ricercatori di tutto il mondo di prevedere strutture molecolari.

Questo amplia le previsioni solo proteiche di AlphaFold 2 e si prevede rivoluzionerà la scoperta di farmaci e la ricerca genomica. - Premio Nobel – Piegatura delle Proteine: L’importanza di questo progresso è stata sottolineata dal Premio Nobel per la Chimica 2024.

Demis Hassabis e John Jumper (DeepMind) hanno condiviso il premio (con David Baker) per lo sviluppo di AlphaFold (IA per la piegatura delle proteine).

Il comitato Nobel ha osservato che AlphaFold “ha aperto possibilità completamente nuove” nel design delle proteine.

(Questo è uno dei risultati IA più noti fino ad oggi.) - AlphaProteo – progettazione di farmaci: Sempre nel 2024, DeepMind ha annunciato AlphaProteo, un’IA che progetta nuovi leganti proteici – molecole che si legano con forza a proteine target.

AlphaProteo può accelerare la creazione di nuovi anticorpi, biosensori e candidati farmaci generando strutture proteiche promettenti per obiettivi specifici. - Matematica – AlphaGeometry: AlphaGeometry e AlphaProof di DeepMind hanno segnato un altro traguardo.

A luglio 2024, AlphaGeometry 2 ha risolto un problema dell’Olimpiade Internazionale di Matematica in 19 secondi, raggiungendo il livello di un medaglia d’argento.

È un raro caso di IA che affronta matematica avanzata a livello liceale. - Calcolo quantistico – AlphaQubit e Willow: L’IA ha migliorato anche hardware all’avanguardia.

Nel 2024 Google ha annunciato AlphaQubit, un decodificatore basato su IA che identifica errori nei computer quantistici (ad esempio i chip Sycamore di Google) molto meglio dei metodi precedenti.

A dicembre 2024 Google ha presentato Willow, un nuovo chip quantistico che, grazie a una correzione avanzata degli errori, ha risolto un compito benchmark in meno di 5 minuti che al miglior supercomputer attuale richiederebbe circa 10^24 anni.

Questi risultati hanno valso a Willow il premio “Scoperta dell’anno in Fisica 2024”, evidenziando il ruolo dell’IA nel progresso quantistico.

In medicina e salute, i modelli IA hanno fatto progressi significativi. Ad esempio, il nuovo Med-Gemini di Google (ottimizzato su dati medici) ha ottenuto il 91,1% in un test medico statunitense (stile USMLE), superando di gran lunga i modelli precedenti.

Sono stati rilasciati strumenti IA per radiologia e patologia (ad esempio Derm e Path Foundations) per migliorare l’analisi delle immagini.

In generale, l’IA è ora un partner di ricerca indispensabile – dalla mappatura del cervello umano a livello nanoscalare (con imaging EM assistito da IA) all’accelerazione dello screening della tubercolosi in Africa, come riportato dai ricercatori Google.

IA in Robotica e Automazione

I robot alimentati dall’IA stanno imparando compiti complessi nel mondo reale.

I robot umanoidi Optimus di Tesla sono stati mostrati pubblicamente a ottobre 2024 (evento “We, Robot”). Diverse decine di unità Optimus hanno camminato, si sono messe in piedi e hanno persino ballato sul palco – anche se rapporti successivi hanno indicato che le dimostrazioni iniziali erano in parte controllate da remoto da operatori umani.

Tuttavia, l’evento ha evidenziato i rapidi progressi verso robot a uso generale.

- Robot ALOHA di DeepMind: Il laboratorio IA di Google ha fatto notevoli progressi nei robot domestici.

Nel 2024 il robot ALOHA (Assistente Domestico Autonomo a Gambe) ha imparato a allacciare le scarpe, appendere una camicia, riparare un altro robot, inserire ingranaggi e persino pulire una cucina usando solo pianificazione IA e visione.

Le open-source “ALOHA Unleashed” hanno mostrato robot che coordinano due braccia per compiti, una prima assoluta nella manipolazione a uso generale. - Transformer Robotici: DeepMind ha introdotto RT-2 (Robotic Transformer 2), un modello visione-linguaggio-azione che può imparare sia da immagini internet che da dati reali di robot.

RT-2 permette ai robot di interpretare istruzioni come farebbe un umano sfruttando la conoscenza web.

È stato dimostrato aiutare un robot a ordinare oggetti seguendo comandi testuali. - Robot industriali: Altre aziende hanno fatto progressi: Boston Dynamics ha continuato a perfezionare i robot Atlas e Spot (anche se senza grandi novità di rilievo), e i veicoli autonomi guidati dall’IA sono migliorati (la beta Full Self-Driving di Tesla è stata estesa, anche se l’autonomia completa resta un traguardo da raggiungere).

Nel settore manifatturiero, aziende focalizzate sull’IA come Figure AI hanno raccolto fondi per costruire robot domestici per le faccende.

Questi sforzi mostrano robot che eseguono compiti sempre più complessi senza programmazione esplicita. Tuttavia, i veri umanoidi completamente autonomi sono ancora all’orizzonte.

Le dimostrazioni (Optimus, ALOHA, RT-2) sono pietre miliari, ma i ricercatori avvertono che c’è ancora molto lavoro prima che i robot possano lavorare in sicurezza e affidabilità su larga scala accanto agli esseri umani.

IA in Prodotti, Industria e Società

L’impatto dell’IA si estende ai prodotti di uso quotidiano e persino alle politiche:

- Dispositivi consumer: I principali prodotti tecnologici hanno integrato agenti IA.

Copilot di Microsoft (incorporato in Windows, Office, Bing) e Bard/Bard AI di Google in Search (con Gemini dietro) hanno portato la potenza degli LLM agli utenti.

I dispositivi Apple hanno ricevuto Apple Intelligence (come sopra) e produttori di hardware come Nvidia hanno venduto un numero record di GPU IA, alimentando sia il cloud che l’IA consumer.

(Nvidia è diventata la società più preziosa al mondo nel 2024 grazie al boom dell’IA.) - Regolamentazione – EU AI Act: Riflettendo la portata dell’IA, anche i regolatori sono intervenuti.

Il 1° agosto 2024 è entrato in vigore il Regolamento UE sull’IA, la prima legge completa sull’intelligenza artificiale.

Stabilisce un quadro basato sul rischio: l’IA a basso rischio (filtri antispam, videogiochi) ha regole minime; regole di trasparenza obbligano sistemi IA come i chatbot a dichiarare di essere IA; l’IA ad alto rischio (strumenti medici o di selezione del personale) è sottoposta a rigorosi controlli; e l’IA chiaramente inaccettabile (ad esempio il “social scoring” degli individui da parte dei governi) è vietata.

Questo insieme di regole (insieme alle linee guida in arrivo sui modelli a uso generale) rappresenta un grande traguardo nella governance dell’IA e probabilmente influenzerà gli standard a livello globale. - Crescita del settore: Il settore IA ha visto finanziamenti e valutazioni storiche: OpenAI ha raggiunto una valutazione stimata di 157 miliardi di dollari a fine 2023, e aziende come Anthropic, Inflection e startup IA cinesi hanno raccolto finanziamenti per miliardi di dollari.

La domanda di hardware IA di NVIDIA ha portato la sua capitalizzazione di mercato oltre i 3,5 trilioni di dollari a metà 2024.

Questi numeri sottolineano come l’IA sia diventata centrale nell’economia tecnologica.

>>> Ha mai provato: Confrontare l'Intelligenza Artificiale con l'Intelligenza Umana ?

In sintesi, l’IA non è più confinata ai laboratori o a dimostrazioni di novità – è integrata in telefoni, auto, luoghi di lavoro e politiche pubbliche.

I progressi sopra descritti – dalla vastità della conoscenza di GPT-4 alle rivoluzioni scientifiche di AlphaFold – dimostrano la rapida maturazione dell’IA.

Mentre ci avviciniamo al 2025, questi risultati preannunciano applicazioni IA ancora più potenti e pratiche nella nostra vita quotidiana.