Τι είναι ένα Μεγάλο Γλωσσικό Μοντέλο;

Ένα Μεγάλο Γλωσσικό Μοντέλο (LLM) είναι ένας προηγμένος τύπος τεχνητής νοημοσύνης εκπαιδευμένος σε τεράστιες ποσότητες κειμένων για να κατανοεί, να δημιουργεί και να επεξεργάζεται την ανθρώπινη γλώσσα. Τα LLM τροφοδοτούν πολλές σύγχρονες εφαρμογές AI όπως chatbots, εργαλεία μετάφρασης και συστήματα δημιουργίας περιεχομένου. Μαθαίνοντας πρότυπα από δισεκατομμύρια λέξεις, τα μεγάλα γλωσσικά μοντέλα μπορούν να παρέχουν ακριβείς απαντήσεις, να δημιουργούν κείμενα που μοιάζουν ανθρώπινα και να υποστηρίζουν εργασίες σε διάφορους κλάδους.

Τα Μεγάλα Γλωσσικά Μοντέλα (LLMs) είναι συστήματα τεχνητής νοημοσύνης εκπαιδευμένα σε τεράστια σύνολα δεδομένων κειμένου για να κατανοούν και να δημιουργούν γλώσσα που μοιάζει ανθρώπινη. Με απλά λόγια, ένα LLM έχει τροφοδοτηθεί με εκατομμύρια ή δισεκατομμύρια λέξεις (συχνά από το Διαδίκτυο) ώστε να μπορεί να προβλέπει και να παράγει κείμενο στο πλαίσιο. Αυτά τα μοντέλα συνήθως βασίζονται σε βαθιά μάθηση και νευρωνικά δίκτυα – πιο συχνά στην αρχιτεκτονική transformer. Λόγω της κλίμακάς τους, τα LLM μπορούν να εκτελέσουν πολλές γλωσσικές εργασίες (συνομιλία, μετάφραση, συγγραφή) χωρίς να προγραμματιστούν ρητά για κάθε μία.

Βασικά Χαρακτηριστικά των Μεγάλων Γλωσσικών Μοντέλων

Τα βασικά χαρακτηριστικά των μεγάλων γλωσσικών μοντέλων περιλαμβάνουν:

Τεράστια Εκπαιδευτικά Δεδομένα

Τα LLM εκπαιδεύονται σε τεράστια σώματα κειμένου (δισεκατομμύρια σελίδες). Αυτό το "μεγάλο" σύνολο εκπαίδευσης τους παρέχει ευρεία γνώση γραμματικής και γεγονότων.

Αρχιτεκτονική Transformer

Χρησιμοποιούν νευρωνικά δίκτυα transformer με αυτοπροσοχή, που σημαίνει ότι κάθε λέξη σε μια πρόταση συγκρίνεται ταυτόχρονα με κάθε άλλη λέξη. Αυτό επιτρέπει στο μοντέλο να μαθαίνει το πλαίσιο αποτελεσματικά.

Δισεκατομμύρια Παράμετροι

Τα μοντέλα περιέχουν εκατομμύρια ή δισεκατομμύρια βάρη (παράμετροι). Αυτές οι παράμετροι αποτυπώνουν πολύπλοκα πρότυπα στη γλώσσα. Για παράδειγμα, το GPT-3 έχει 175 δισεκατομμύρια παραμέτρους.

Αυτοεποπτευόμενη Μάθηση

Τα LLM μαθαίνουν προβλέποντας τις ελλείπουσες λέξεις σε κείμενο χωρίς ανθρώπινη επισήμανση. Για παράδειγμα, κατά την εκπαίδευση το μοντέλο προσπαθεί να μαντέψει την επόμενη λέξη σε μια πρόταση. Επαναλαμβάνοντας αυτή τη διαδικασία σε τεράστια δεδομένα, το μοντέλο εσωτερικεύει γραμματική, γεγονότα και ακόμη και κάποια λογική.

Βελτιστοποίηση και Οδηγίες

Μετά την προεκπαίδευση, τα LLM μπορούν να βελτιστοποιηθούν για συγκεκριμένες εργασίες ή να καθοδηγηθούν με οδηγίες (prompts). Αυτό σημαίνει ότι το ίδιο μοντέλο μπορεί να προσαρμοστεί σε νέες εργασίες όπως ιατρικές ερωτήσεις-απαντήσεις ή δημιουργική συγγραφή με μικρότερο σύνολο δεδομένων ή έξυπνες οδηγίες.

Συνολικά, αυτά τα χαρακτηριστικά επιτρέπουν σε ένα LLM να κατανοεί και να παράγει κείμενο σαν άνθρωπος. Στην πράξη, ένα καλά εκπαιδευμένο LLM μπορεί να συμπεράνει το πλαίσιο, να ολοκληρώνει προτάσεις και να παράγει ρέουσες απαντήσεις σε πολλά θέματα (από ανεπίσημη συνομιλία έως τεχνικά θέματα) χωρίς ειδική μηχανική εργασίας.

Πώς Λειτουργούν τα LLM: Η Αρχιτεκτονική Transformer

Τα LLM χρησιμοποιούν συνήθως την αρχιτεκτονική νευρωνικού δικτύου transformer. Αυτή η αρχιτεκτονική είναι ένα βαθύ νευρωνικό δίκτυο με πολλά επίπεδα συνδεδεμένων κόμβων. Ένα βασικό στοιχείο είναι η αυτοπροσοχή, που επιτρέπει στο μοντέλο να αξιολογεί τη σημασία κάθε λέξης σε σχέση με όλες τις άλλες σε μια πρόταση ταυτόχρονα.

Ακολουθιακή Επεξεργασία

- Επεξεργασία λέξεων μία προς μία

- Πιο αργή εκπαίδευση σε GPUs

- Περιορισμένη κατανόηση πλαισίου

Παράλληλη Επεξεργασία

- Επεξεργασία ολόκληρης της εισόδου ταυτόχρονα

- Πολύ πιο γρήγορη εκπαίδευση σε GPUs

- Ανώτερη κατανόηση πλαισίου

Σε αντίθεση με τα παλαιότερα ακολουθιακά μοντέλα (όπως τα RNN), οι transformers επεξεργάζονται ολόκληρη την είσοδο παράλληλα, επιτρέποντας πολύ πιο γρήγορη εκπαίδευση σε GPUs. Κατά την εκπαίδευση, το LLM προσαρμόζει τα δισεκατομμύρια παραμέτρους του προσπαθώντας να προβλέψει κάθε επόμενη λέξη στο τεράστιο σώμα κειμένου του.

Με την πάροδο του χρόνου, αυτή η διαδικασία διδάσκει στο μοντέλο γραμματική και σημασιολογικές σχέσεις. Το αποτέλεσμα είναι ένα μοντέλο που, με δεδομένη μια οδηγία, μπορεί να παράγει συνεκτική, σχετική με το πλαίσιο γλώσσα από μόνο του.

Εφαρμογές των LLM

Επειδή κατανοούν και παράγουν φυσική γλώσσα, τα LLM έχουν πολλές εφαρμογές σε διάφορους κλάδους. Μερικές κοινές χρήσεις είναι:

Συνομιλητική Τεχνητή Νοημοσύνη

Δημιουργία Περιεχομένου

Μετάφραση και Περίληψη

Απαντήσεις σε Ερωτήσεις

Δημιουργία Κώδικα

Έρευνα και Ανάλυση

Για παράδειγμα, τα GPT-3.5 και GPT-4 πίσω από το ChatGPT έχουν εκατοντάδες δισεκατομμύρια παραμέτρους, ενώ τα μοντέλα της Google (PaLM και Gemini) και άλλα λειτουργούν παρόμοια. Οι προγραμματιστές συχνά αλληλεπιδρούν με αυτά τα LLM μέσω υπηρεσιών cloud ή βιβλιοθηκών, προσαρμόζοντάς τα για συγκεκριμένες εργασίες όπως περίληψη εγγράφων ή βοήθεια στον κώδικα.

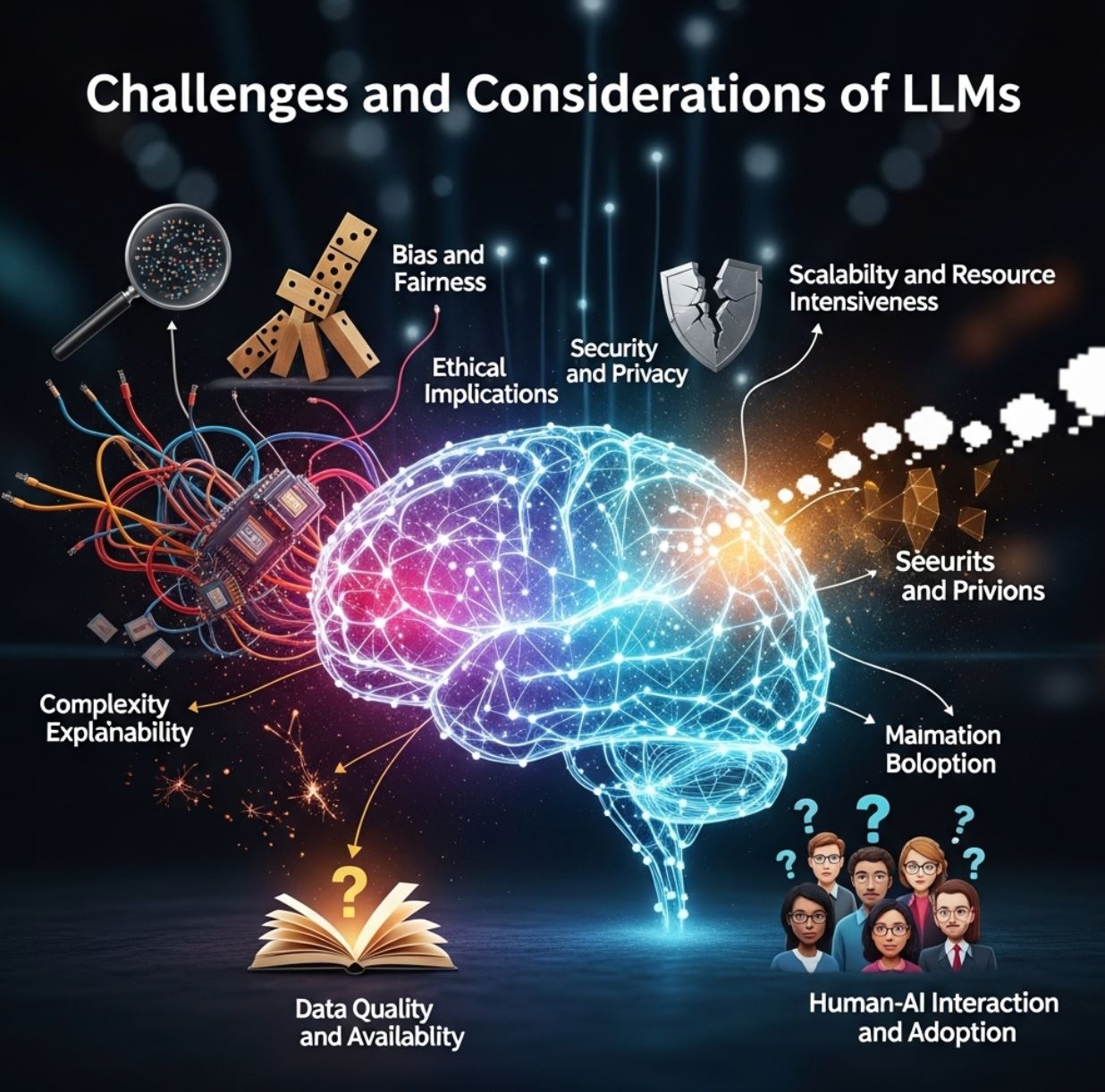

Προκλήσεις και Σκέψεις

Τα LLM είναι ισχυρά, αλλά δεν είναι τέλεια. Επειδή μαθαίνουν από κείμενα του πραγματικού κόσμου, μπορούν να αναπαράγουν προκαταλήψεις που υπάρχουν στα δεδομένα εκπαίδευσής τους. Ένα LLM μπορεί να δημιουργήσει περιεχόμενο με πολιτισμικές προκαταλήψεις ή να παράγει προσβλητική ή στερεοτυπική γλώσσα αν δεν φιλτραριστεί προσεκτικά.

Προβλήματα Προκαταλήψεων

Παραληρήματα

Απαιτήσεις Πόρων

Επαλήθευση Ακρίβειας

Ένα ακόμα ζήτημα είναι τα παραληρήματα: το μοντέλο μπορεί να παράγει απαντήσεις που ακούγονται ρέουσες αλλά είναι εντελώς λανθασμένες ή επινοημένες. Για παράδειγμα, ένα LLM μπορεί να επινοήσει με σιγουριά ένα ψευδές γεγονός ή όνομα. Αυτά τα λάθη συμβαίνουν επειδή το μοντέλο ουσιαστικά μαντεύει την πιο πιθανή συνέχεια του κειμένου, όχι επειδή επαληθεύει τα γεγονότα.

Παρόλα αυτά, οι χρήστες των LLM πρέπει να γνωρίζουν ότι τα αποτελέσματα πρέπει να ελέγχονται για ακρίβεια και προκατάληψη. Επιπλέον, η εκπαίδευση και η λειτουργία των LLM απαιτεί τεράστιους υπολογιστικούς πόρους (ισχυρές GPUs/TPUs και πολλά δεδομένα), κάτι που μπορεί να είναι δαπανηρό.

Περίληψη και Προοπτικές

Συνοψίζοντας, ένα μεγάλο γλωσσικό μοντέλο είναι ένα σύστημα τεχνητής νοημοσύνης βασισμένο σε transformer εκπαιδευμένο σε τεράστιες ποσότητες κειμένου. Έχει μάθει πρότυπα γλώσσας μέσω αυτοεποπτευόμενης εκπαίδευσης, δίνοντάς του τη δυνατότητα να παράγει ρέον, σχετικό με το πλαίσιο κείμενο. Λόγω της κλίμακάς τους, τα LLM μπορούν να χειριστούν ένα ευρύ φάσμα γλωσσικών εργασιών – από συνομιλία και συγγραφή έως μετάφραση και κωδικοποίηση – συχνά ισοφαρίζοντας ή υπερβαίνοντας τα ανθρώπινα επίπεδα ευφράδειας.

Αυτά τα μοντέλα είναι έτοιμα να αναδιαμορφώσουν τον τρόπο που αλληλεπιδρούμε με την τεχνολογία και έχουμε πρόσβαση στην πληροφορία.

— Κορυφαίοι ερευνητές τεχνητής νοημοσύνης

Μέχρι το 2025, τα LLM συνεχίζουν να εξελίσσονται (συμπεριλαμβανομένων πολυτροπικών επεκτάσεων που χειρίζονται εικόνες ή ήχο) και παραμένουν στην αιχμή της καινοτομίας AI, καθιστώντας τα κεντρικό στοιχείο των σύγχρονων εφαρμογών τεχνητής νοημοσύνης.

No comments yet. Be the first to comment!