Czym jest Edge AI?

Edge AI (Edge Artificial Intelligence) to połączenie sztucznej inteligencji (AI) i edge computingu. Zamiast przesyłać dane do chmury w celu przetworzenia, Edge AI umożliwia inteligentnym urządzeniom, takim jak smartfony, kamery, roboty czy maszyny IoT, analizowanie i podejmowanie decyzji bezpośrednio na urządzeniu. Takie podejście pomaga zmniejszyć opóźnienia, oszczędzać przepustowość, zwiększać bezpieczeństwo i zapewniać reakcję w czasie rzeczywistym.

Edge AI (czasami nazywane „AI na brzegu”) oznacza uruchamianie modeli sztucznej inteligencji i uczenia maszynowego na lokalnych urządzeniach (czujniki, kamery, smartfony, bramki przemysłowe itp.) zamiast w odległych centrach danych. Innymi słowy, „brzeg” sieci – miejsce generowania danych – zajmuje się przetwarzaniem. Pozwala to urządzeniom na natychmiastową analizę danych w momencie ich zbierania, zamiast ciągłego przesyłania surowych danych do chmury.

Edge AI umożliwia przetwarzanie w czasie rzeczywistym bezpośrednio na urządzeniu, bez polegania na centralnym serwerze. Na przykład kamera z Edge AI może na bieżąco wykrywać i klasyfikować obiekty, dając natychmiastową informację zwrotną. Przetwarzając dane lokalnie, Edge AI działa nawet przy przerywanym lub braku połączenia z internetem.

— IBM Research

Podsumowując, Edge AI po prostu przenosi obliczenia bliżej źródła danych – wdrażając inteligencję na urządzeniach lub pobliskich węzłach, co przyspiesza reakcje i zmniejsza potrzebę przesyłania wszystkiego do chmury.

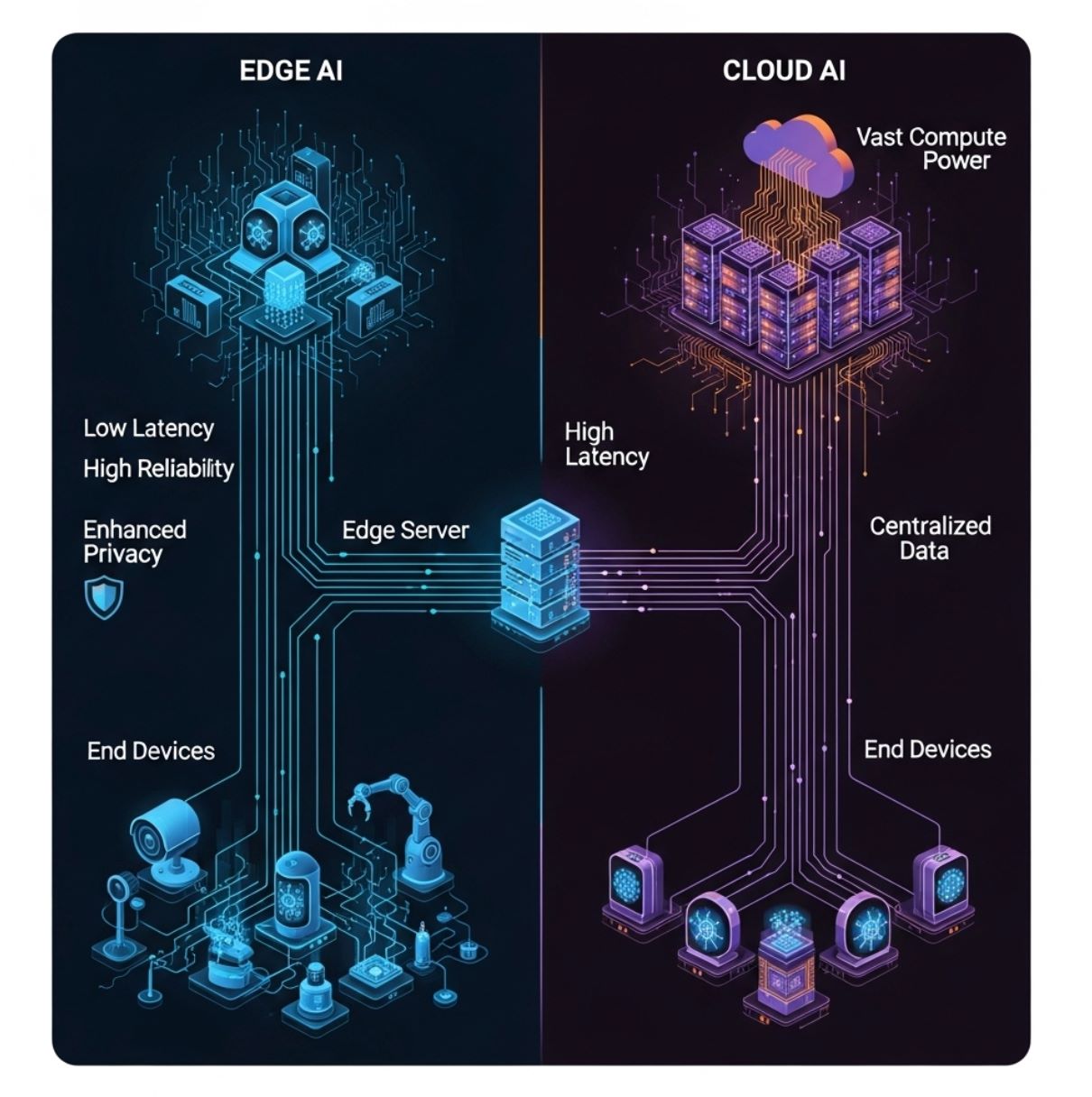

Edge AI a Cloud AI: Kluczowe różnice

W przeciwieństwie do tradycyjnej AI opartej na chmurze (która przesyła wszystkie dane do scentralizowanych serwerów), Edge AI rozdziela obliczenia na sprzęt lokalny. Poniższy schemat ilustruje prosty model edge computingu: urządzenia końcowe (dolna warstwa) przesyłają dane do serwera brzegowego lub bramki (warstwa środkowa) zamiast wyłącznie do odległej chmury (warstwa górna).

W tym układzie wnioskowanie AI może odbywać się na urządzeniu lub lokalnym węźle brzegowym, znacznie redukując opóźnienia komunikacyjne.

Tradycyjne podejście

- Dane przesyłane do zdalnych serwerów

- Wyższe opóźnienia z powodu sieci

- Wymaga ciągłego połączenia

- Nieograniczone zasoby obliczeniowe

- Obawy o prywatność przy przesyłaniu danych

Nowoczesne podejście

- Lokalne przetwarzanie na urządzeniach

- Czasy reakcji w milisekundach

- Działa offline, gdy potrzeba

- Ograniczone zasoby, ale efektywne

- Zwiększona ochrona prywatności

Opóźnienia

Edge AI minimalizuje opóźnienia. Ponieważ przetwarzanie odbywa się lokalnie, decyzje mogą zapadać w milisekundach.

- Krytyczne dla zadań wrażliwych na czas

- Unikanie wypadków samochodowych

- Sterowanie robotami w czasie rzeczywistym

Przepustowość

Edge AI zmniejsza obciążenie sieci, analizując lub filtrując dane na miejscu.

- Zdecydowanie mniej informacji przesyłanych dalej

- Bardziej efektywne i ekonomiczne

- Redukuje przeciążenia sieci

Prywatność/Bezpieczeństwo

Wrażliwe dane mogą być przetwarzane i przechowywane na urządzeniu, nigdy nie przesyłane do chmury.

- Dane głosowe, obrazy, odczyty zdrowotne pozostają lokalnie

- Zmniejsza ryzyko naruszeń przez osoby trzecie

- Rozpoznawanie twarzy bez przesyłania zdjęć

Zasoby obliczeniowe

Urządzenia brzegowe mają ograniczoną moc obliczeniową, ale korzystają z zoptymalizowanych modeli.

- Kompaktowe, kwantyzowane modele

- Szkolenie nadal odbywa się w chmurze

- Ograniczenia rozmiaru, ale efektywne

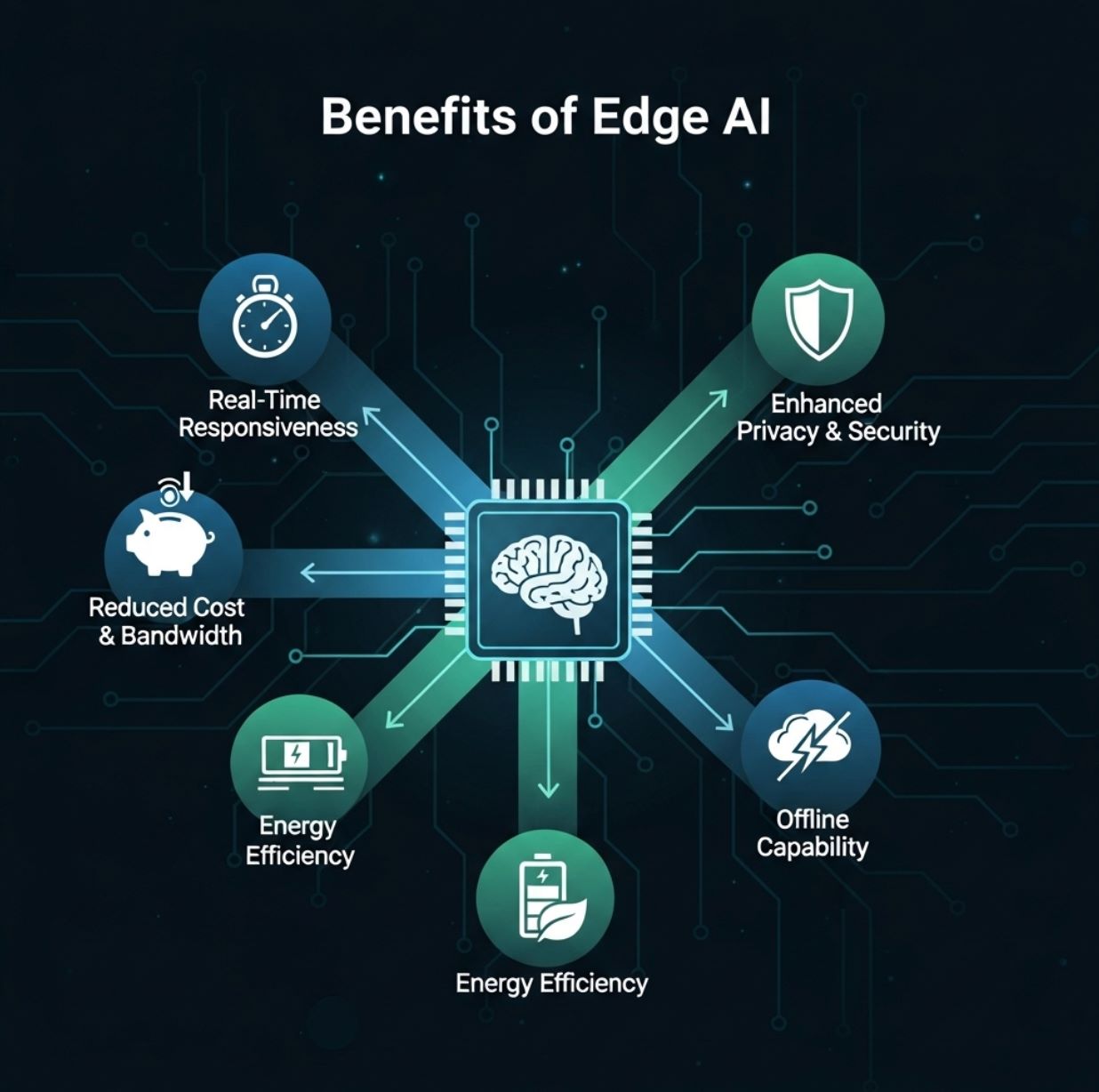

Korzyści Edge AI

Edge AI oferuje kilka praktycznych zalet dla użytkowników i organizacji:

Reakcja w czasie rzeczywistym

- Wykrywanie obiektów na żywo

- Systemy odpowiedzi głosowej

- Alerty anomalii

- Aplikacje rozszerzonej rzeczywistości

Zmniejszenie przepustowości i kosztów

- Kamery bezpieczeństwa przesyłają tylko fragmenty z zagrożeniami

- Mniejsze ciągłe strumieniowanie

- Niższe koszty hostingu w chmurze

Zwiększona prywatność

- Krytyczne dla służby zdrowia i finansów

- Dane pozostają w kraju/placówce

- Zgodność z przepisami o ochronie prywatności

Efektywność energetyczna i kosztowa

- Niższe zużycie energii

- Zmniejszone koszty serwerów

- Optymalizacja pod urządzenia mobilne

Edge AI dostarcza wysokowydajne możliwości obliczeniowe na brzegu, umożliwiając analizę w czasie rzeczywistym i poprawę efektywności.

— Raport wspólny Red Hat & IBM

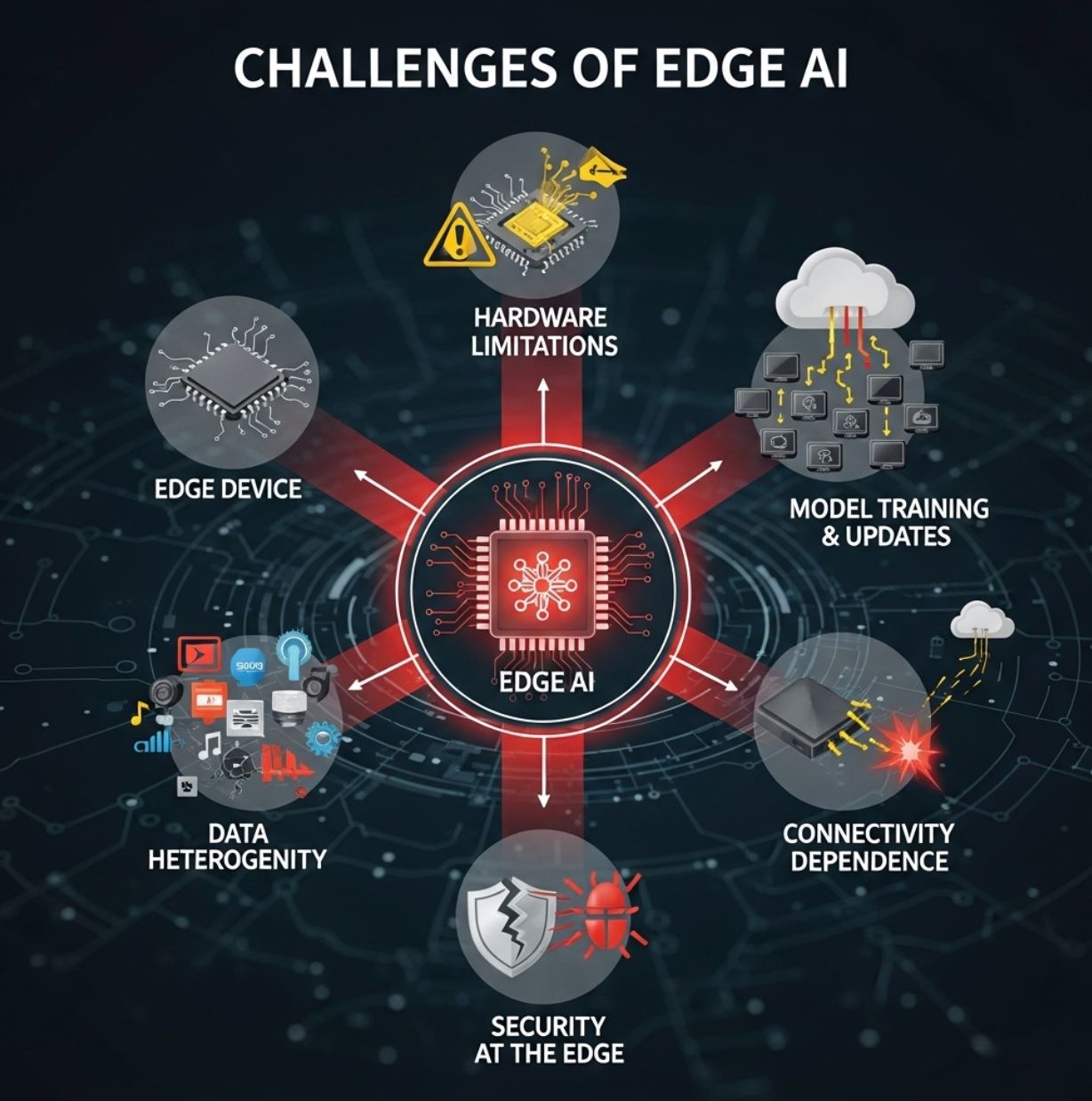

Wyzwania Edge AI

Pomimo zalet, Edge AI napotyka też istotne trudności:

Ograniczenia sprzętowe

Urządzenia brzegowe są zwykle małe i mają ograniczone zasoby. Mogą mieć jedynie skromne CPU lub specjalistyczne, energooszczędne NPU oraz ograniczoną pamięć.

- Wymusza stosowanie kompresji i przycinania modeli

- Techniki TinyML niezbędne dla mikrokontrolerów

- Złożone modele nie mogą działać w pełnej skali

- Może być konieczne poświęcenie dokładności

Szkolenie modeli i aktualizacje

Szkolenie zaawansowanych modeli AI zwykle nadal odbywa się w chmurze, gdzie dostępne są ogromne zasoby danych i mocy obliczeniowej.

- Modele muszą być zoptymalizowane i wdrożone na każde urządzenie

- Utrzymanie aktualności tysięcy urządzeń jest skomplikowane

- Synchronizacja oprogramowania układowego generuje narzut

- Kontrola wersji w rozproszonych systemach

Grawitacja danych i heterogeniczność

Środowiska brzegowe są zróżnicowane. Różne lokalizacje mogą zbierać różne typy danych, a polityki mogą się różnić w zależności od regionu.

- Dane zwykle pozostają lokalnie

- Trudno uzyskać globalny obraz

- Urządzenia mają różne kształty i rozmiary

- Wyzwania integracji i standaryzacji

Bezpieczeństwo na brzegu

Chociaż Edge AI może poprawić prywatność, wprowadza też nowe zagrożenia bezpieczeństwa. Każde urządzenie lub węzeł jest potencjalnym celem dla hakerów.

- Modele muszą być odporne na manipulacje

- Wymagania dotyczące bezpieczeństwa oprogramowania układowego

- Rozproszona powierzchnia ataku

- Potrzeba silnych zabezpieczeń

Zależności od łączności

Chociaż wnioskowanie może odbywać się lokalnie, systemy brzegowe często nadal polegają na łączności z chmurą dla cięższych zadań.

- Retrening modeli wymaga dostępu do chmury

- Analiza dużych zbiorów danych potrzebuje łączności

- Agregacja rozproszonych wyników

- Ograniczona łączność może spowalniać funkcje

Przykłady zastosowań Edge AI

Edge AI jest stosowane w wielu branżach z realnym wpływem:

Pojazdy autonomiczne

Samochody autonomiczne wykorzystują Edge AI na pokładzie do natychmiastowego przetwarzania danych z kamer i radarów dla nawigacji i unikania przeszkód.

- Nie można pozwolić sobie na opóźnienia w przesyłaniu wideo do serwera

- Wykrywanie obiektów odbywa się lokalnie

- Rozpoznawanie pieszych w czasie rzeczywistym

- Śledzenie pasa ruchu bez łączności

Przemysł i Przemysł 4.0

Fabryki wdrażają inteligentne kamery i czujniki na liniach produkcyjnych do wykrywania wad lub anomalii w czasie rzeczywistym.

Kontrola jakości

Kamery Edge AI wykrywają wadliwe produkty na taśmach i wywołują natychmiastową reakcję.

Predykcyjne utrzymanie ruchu

Maszyny przemysłowe wykorzystują AI na miejscu do przewidywania awarii zanim nastąpią.

Opieka zdrowotna i ratownictwo

Przenośne urządzenia medyczne i karetki korzystają teraz z Edge AI do analizy danych pacjentów na miejscu.

- Ultrasonograf w karetce z analizą AI

- Monitory parametrów życiowych wykrywają nieprawidłowości

- Alarmowanie ratowników o urazach wewnętrznych

- Monitorowanie pacjentów na OIOM z natychmiastowymi alarmami

Inteligentne miasta

Systemy miejskie wykorzystują Edge AI do zarządzania ruchem, nadzoru i monitoringu środowiska.

Zarządzanie ruchem

Nadzór

Monitorowanie środowiska

Handel detaliczny i IoT konsumenckie

Edge AI poprawia doświadczenia klientów i wygodę w handlu i zastosowaniach konsumenckich.

Analiza w sklepie

Inteligentne kamery i czujniki na półkach śledzą zachowania klientów i poziomy zapasów natychmiast.

Urządzenia mobilne

Smartfony uruchamiają rozpoznawanie głosu i twarzy lokalnie, bez dostępu do chmury, do odblokowywania i identyfikacji gestów.

Monitorowanie kondycji

Urządzenia noszone analizują dane zdrowotne (tętno, kroki) lokalnie, dostarczając informacje zwrotne w czasie rzeczywistym.

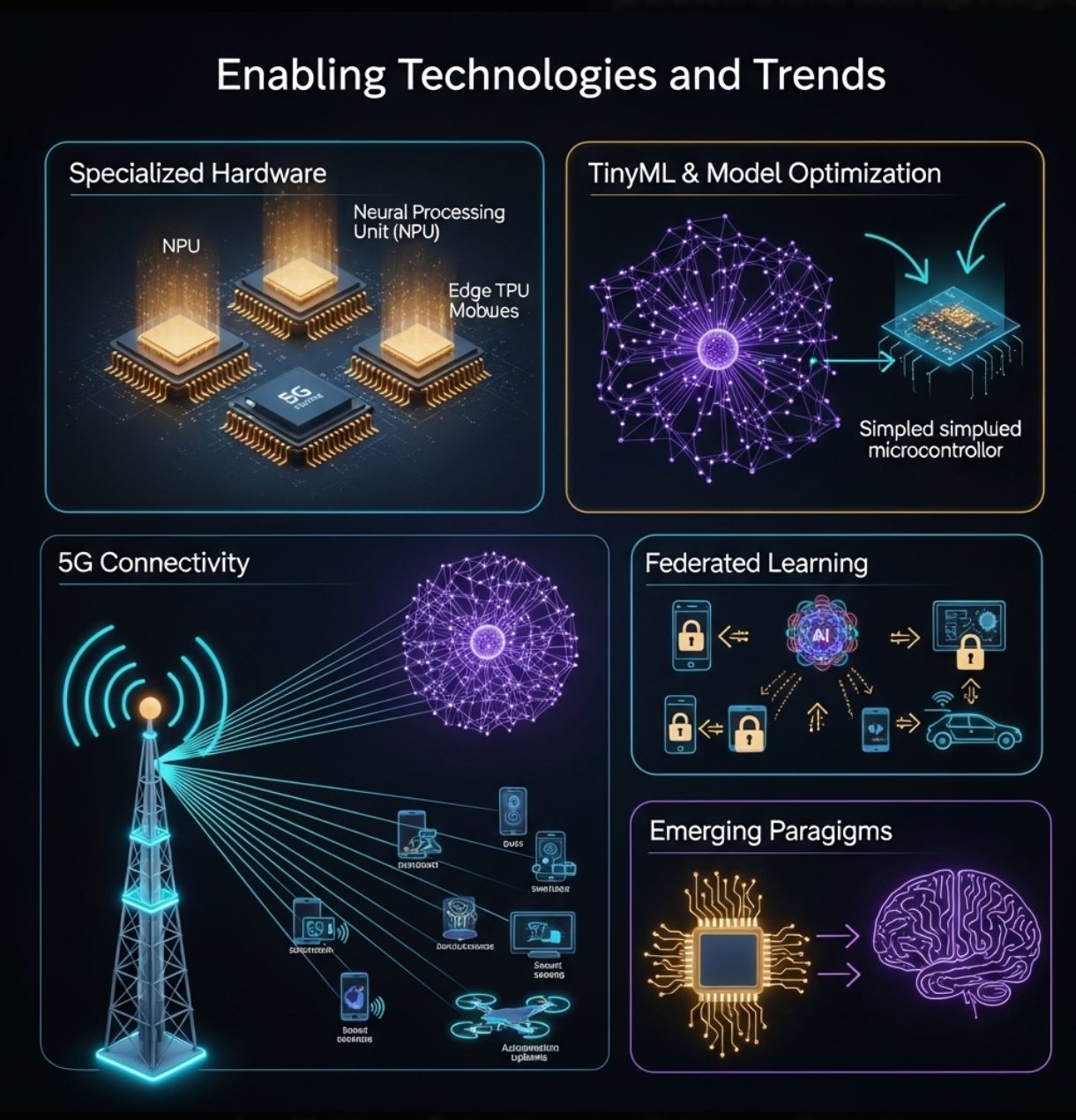

Technologie i trendy wspierające

Wzrost Edge AI napędzają postępy zarówno w sprzęcie, jak i oprogramowaniu:

Specjalistyczny sprzęt

Producenci tworzą chipy zaprojektowane specjalnie do wnioskowania na brzegu.

- Energooszczędne akceleratory neuronowe (NPU)

- Google Coral Edge TPU

- NVIDIA Jetson Nano

- Arduino i Raspberry Pi z dodatkami AI

TinyML i optymalizacja modeli

Narzędzia i techniki umożliwiają zmniejszanie sieci neuronowych dla małych urządzeń.

- Optymalizacja TensorFlow Lite

- Przycinanie i kwantyzacja modeli

- Destylacja wiedzy

- TinyML dla mikrokontrolerów

5G i łączność

Następna generacja sieci bezprzewodowych zapewnia wysoką przepustowość i niskie opóźnienia, uzupełniając Edge AI.

- Szybkie sieci lokalne do koordynacji urządzeń

- Odciążanie cięższych zadań w razie potrzeby

- Inteligentne fabryki i komunikacja V2X

- Ulepszone klastry urządzeń brzegowych

Uczenie federacyjne

Metody chroniące prywatność pozwalają wielu urządzeniom brzegowym wspólnie trenować modele bez udostępniania surowych danych.

- Lokalna poprawa modeli

- Udostępnianie tylko aktualizacji modeli

- Wykorzystanie rozproszonych danych

- Zwiększona ochrona prywatności

Te technologie nadal przesuwają granice możliwości Edge AI. Razem pomagają dostarczyć „erę wnioskowania AI” – przenosząc inteligencję bliżej użytkowników i czujników.

Podsumowanie

Edge AI zmienia sposób wykorzystania sztucznej inteligencji, przenosząc obliczenia bliżej źródła danych. Uzupełnia AI w chmurze, dostarczając szybszą, bardziej efektywną i bardziej prywatną analizę na lokalnych urządzeniach.

To podejście rozwiązuje wyzwania związane z czasem rzeczywistym i przepustowością, charakterystyczne dla architektur opartych na chmurze. W praktyce Edge AI napędza szeroką gamę nowoczesnych technologii – od inteligentnych czujników i fabryk po drony i samochody autonomiczne – umożliwiając inteligencję na miejscu.

Wraz z rozwojem urządzeń IoT i ulepszaniem sieci, Edge AI będzie się tylko rozwijać. Postępy w sprzęcie (wydajne mikroprocesory, TinyML) i technikach (uczenie federacyjne, optymalizacja modeli) ułatwiają wdrażanie AI wszędzie.

Komentarze 0

Dodaj komentarz

Brak komentarzy. Bądź pierwszym, który skomentuje!